الذكاء الاصطناعي

قد تكون وحدات معالجة الرسومات أفضل، وليس أسرع فقط، في تدريب الشبكات العصبية العميقة

وجد باحثون من بولندا واليابان، يعملون مع سوني، أدلة على أن أنظمة التعلم الآلي المدربة على وحدات معالجة الرسومات بدلاً من وحدات المعالجة المركزية قد تحتوي على أخطاء أقل خلال عملية التدريب، وتنتج نتائج أفضل، مما يتعارض مع الفهم الشائع بأن وحدات معالجة الرسومات تعمل ببساطة على هذه العمليات بشكل أسرع، وليس أفضل.

البحث، الذي يحمل عنوان تأثير عدم اليقين في وحدة معالجة الرسومات على تدريب الشبكات العصبية التنبؤية العميقة، يأتي من كلية علم النفس والعلوم المعرفية بجامعة آدم ميتسكيفيتش واثنين من الجامعات اليابانية، معًا مع مختبرات سوني للعلوم الحاسوبية.

يُشير الدراسة إلى أن ‘الغموض’ الذي تظهره الشبكات العصبية العميقة في مواجهة مختلف التكوينات الأجهزة والبرمجية يفضل وحدات معالجة الرسومات الأكثر تكلفة (والنادرة بشكل متزايد)، ووجدت في الاختبارات أن شبكة عصبية عميقة مدربة حصريًا على وحدة المعالجة المركزية أنتجت معدلات أخطاء أعلى خلال نفس عدد الحقبات (عدد المرات التي يتم فيها إعادة معالجة بيانات التدريب خلال الجلسة).

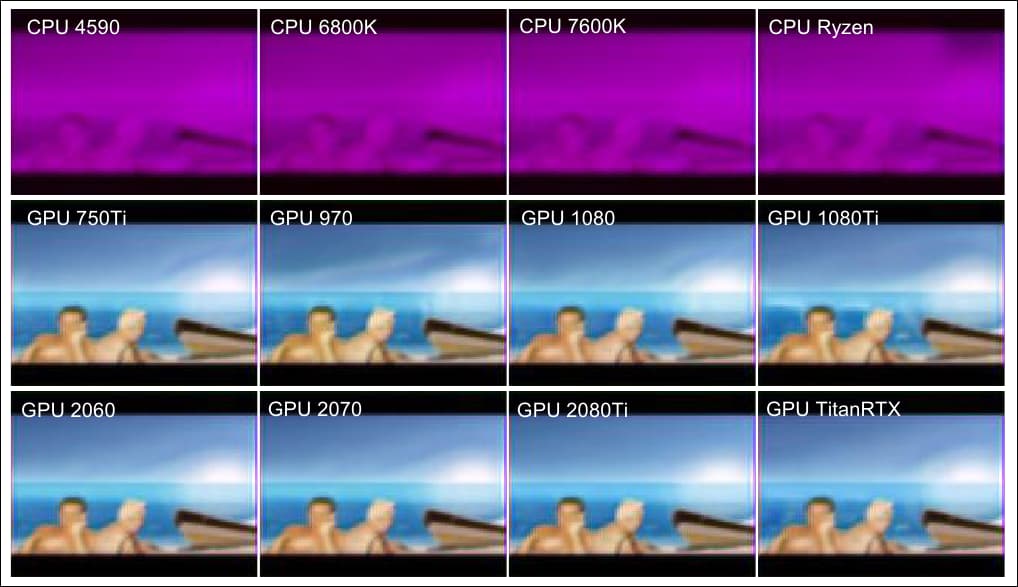

في هذا المثال الإضافي من الورقة، نرى (الصفين السفليين)، جودة النتائج المماثلة التي تم الحصول عليها من مجموعة متنوعة من وحدات معالجة الرسومات، و (الصف الأول)، النتائج الأقل التي تم الحصول عليها من مجموعة من وحدات المعالجة المركزية القوية. مصدر: https://arxiv.org/pdf/2109.01451.pdf

ظواهر غريبة

لا تنطبق هذه النتائج الأولية بشكل موحد عبر خوارزميات التعلم الآلي الشهيرة، وفي حالة هياكل التشفير الذاتي البسيطة، لا يظهر الظاهرة.

مع ذلك، تشير الأعمال إلى حدٍ محتمل لنجاعة التدريب في الشبكات العصبية العميقة المعقدة، حيث لا يحقق تغطية نفس العمليات بسرعة أقل وأوقات تدريب أطول نفس مستوى الأداء الذي يمكن توقع حدوثه من روتينات التكرار الرياضية.

يقترح الباحثون أن هذا الاختلاف في الأداء قد يكون خاصًا بنوع معين من الشبكات العصبية، وأن الجوانب غير المتحدة لمعالجة وحدة معالجة الرسومات، التي تُعتبر عادةً عقبة يجب التغلب عليها، قد لا توفر فقط فوائد ملحوظة، بل يمكن أن تكون متعمدة في الأنظمة اللاحقة. كما تشير الورقة إلى أن النتائج قد توفر رؤى أعمق حول المعالجة الحاسوبية المرتبطة بالمخ.

تحديد الغرائب التي تزيد من كفاءة وجودة النتائج بهذه الطريقة على وحدات معالجة الرسومات يحمل إمكانية الحصول على رؤية أعمق حول هياكل الذكاء الاصطناعي “ال盒ة السوداء”، وحتى تحسين أداء وحدة المعالجة المركزية – على الرغم من أن الأسباب الكامنة لا تزال غامضة.

التشفير الذاتي مقابل. PredNet

في دراسة الشذوذ، استخدم الباحثون مشفرًا ذاتيًا أساسيًا وشبكة عصبية تنبؤية من جامعة هارفارد PredNet، بحث من عام 2016 تم تصميمه لاستكشاف ومحاولة تكرار سلوك القشرة المخية البشرية.

كلا النظامين عبارة عن شبكات عصبية عميقة مصممة ل合성 الصور المناسبة من خلال التعلم غير الموجه (مع بيانات تم حذف العلامات منها)، على الرغم من أن التشفير الذاتي يتعامل بطريقة خطية مع صورة واحدة لكل دفعة، والتي من شأنها بعد ذلك إنتاج مخرجات كصورة التالية في خط أنابيب متكرر. تم تدريب التشفير الذاتي على قاعدة بيانات MNIST لكتابة اليد.

تم تدريب التشفير الذاتي في اختبارات الباحثين على قاعدة بيانات MNIST، التي تتكون من 60,000 صورة تدريبية بحجم 28×28 بكسل، مع توجيهها لتحفيز الرمادي، بالإضافة إلى 10,000 صورة اختبار.

في المقابل، تقيم PredNet الإدخال المرئي المعقد، وفي حالة هذا البحث، تم تدريبه على مجموعة بيانات FPSI، التي تتميز بوجود مقاطع فيديو شاسعة من كاميرا مثبتة على الجسم لليوم في ديزني وورلد في أورلاندو، فلوريدا (ديزني كانت واحدة من شركاء البحث في الورقة لعام 2012).

تسلسلات الصور من FPSI، تظهر مناظير أولية لليوم في ديزني وورلد.

النظامان المعماريان مختلفان جدًا من حيث التعقيد. تم تصميم التشفير الذاتي لإعادة بناء الصور بدلاً من التنبؤ بالقيم المستهدفة. في المقابل، يحتوي PredNet على أربعة طبقات، كل منها يتكون من عصبونات تمثيلية باستخدام الذاكرة الطويلة القصيرة التكرارية (LSTM).

تُنتج الطبقات تنبؤات سياقية يتم مقارنتها بعد ذلك بهدف لتحديد مصطلح خطأ ينتشر في جميع أنحاء الشبكة. يستخدم كلا النموذجين التعلم غير الموجه.

الهيكل البسيط الخطي للتشفير الذاتي، والشبكة أكثر تعقيدًا وتركيبيًا من PredNet.

تم اختبار كلا النظامين على مجموعة من التكوينات الأجهزة والبرمجية، بما في ذلك وحدات المعالجة المركزية بدون وحدات معالجة الرسومات (Intel i5-4590، i7-6800K، i5-7600K، أو AMD Ryzen-5-3600) ووحدات المعالجة المركزية مع وحدات معالجة الرسومات (Intel i5-7600K + NVIDIA GTX-750Ti، i5-7600K + GTX-970، i7-6700K + GTX-1080، i7-7700K + GTX-1080Ti، i7-9700 + RTX-2080Ti، i5-7600K + RTX-2060 super، AMD Ryzen-5-3600 + RTX-2070 super، أو i5-9400 + Titan-RTX).

تم استخدام معرض العملية التفاعلية htop لضمان أن جميع عمليات التدريب تحدث إما على خيط واحد (على Intel i7-6800K) أو أربعة خيوط (على Intel i5-4590 و i5-7600K) أو ستة خيوط (على AMD Ryzen-5-3600).

نقاط السرج

على التشفير الذاتي، لم يكن الفرق المتوسط عبر جميع التكوينات، مع وبدون cuDNN، ملحوظًا. بالنسبة إلى PredNet، كانت النتائج أكثر إثارة، مع فروق ملحوظة في تقييم الخسارة وجودة بين تدريب وحدة المعالجة المركزية ووحدة معالجة الرسومات.

نتائج الخسارة المتوسطة لتدريب PredNet عبر أربعة وحدات معالجة مركزية وثمانية وحدات معالجة رسومات، مع شبكة مدربة على 5000 إطار فيديو في 250 دفعة، مع متوسط الخسارة للأطر 1000 الأخيرة (50 دفعة) موضح. تم إيقاف تشغيل cuDNN.

يخلص الباحثون إلى أن ‘على الرغم من أن الآلية غير واضحة، يبدو أن الأجهزة الخاصة بوحدة معالجة الرسومات تتمتع بالقدرة على تعزيز تدريب الشبكات العصبية العميقة.’

تُشير النتائج إلى أن وحدات معالجة الرسومات قد تكون أفضل في تجنب نقاط السرج – المناطق في الانحدار التدرجي التي تصف قاع المنحدر.

نقطة السرج في الانحدار التدرجي، تسمية لسبب واضح. مصدر: https://www.pinterest.com.au/pin/436849232581124086/

نقاط السرج، على الرغم من كونها عائقًا، تم التغلب عليها إلى حد كبير في الفكر الحديث حول تحسين الانحدار التدرجي العشوائي (SGD)، لكن الورقة الجديدة تشير إلى أن وحدات معالجة الرسومات قد تكون مجهزة بشكل فريد لتجنبها، وأن تأثير نقاط السرج يجب أن يتم إعادة النظر فيه.