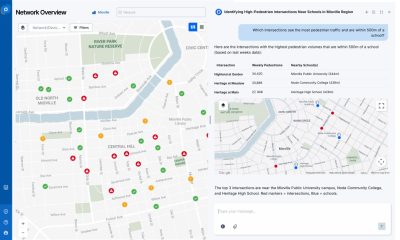

الذكاء الاصطناعي

DeepSeek-V3 يكشف النقاب: كيف يقلل التصميم الذكي للمعدات من التكاليف ويعزز الأداء

يعتبر DeepSeek-V3 اختراقًا في مجال التطوير الذكي بتكلفة فعالة. إنه يظهر كيف يمكن للتصميم الذكي للمعدات والبرمجيات معًا تقديم أداء على مستوى الدولة دون تكاليف زائدة. من خلال التدريب على 2048 وحدة معالجة رسومات NVIDIA H800 فقط ، يحقق هذا النموذج نتائج ملحوظة من خلال نهج مبتكر مثل الانتباه اللاتنتي المضغوط متعدد الرؤوس لэффективية الذاكرة ، وعمارة خبير الخلط لتحسين الحوسبة ، وتدريب FP8 الدقيق المختلط الذي يفتح إمكانات المعدات. يظهر النموذج أن الفرق الصغيرة يمكنها المنافسة مع الشركات التكنولوجية الكبيرة من خلال خيارات التصميم الذكية بدلاً من التوسع القسري.

تحدي توسيع الذكاء الاصطناعي

تواجه صناعة الذكاء الاصطناعي مشكلة أساسية. تصبح نماذج اللغة الكبيرة أكبر وأقوى ، ولكنها تتطلب أيضًا موارد حوسبية هائلة لا يستطيع معظم المنظمات تحملها. تعتمد الشركات التكنولوجية الكبيرة مثل جوجل وميتا وOpenAI مجموعات تدريب مع عشرات أو مئات الآلاف من وحدات معالجة الرسومات ، مما يجعل من الصعب على الفرق البحثية الصغيرة والشركات الناشئة المنافسة.

تهدد هذه الفجوة في الموارد إلى تركيز تطوير الذكاء الاصطناعي في أيدي عدد قليل من الشركات التكنولوجية الكبيرة. تشير قوانين التوسع التي تدفع تقدم الذكاء الاصطناعي إلى أن النماذج الأكبر مع المزيد من بيانات التدريب والقوة الحوسبية تؤدي إلى أداء أفضل. ومع ذلك ، فإن النمو الأسي في متطلبات المعدات جعل من الصعب بشكل متزايد على اللاعبين الصغار المنافسة في سباق الذكاء الاصطناعي.

أصبحت متطلبات الذاكرة تحديًا كبيرًا آخر. تحتاج نماذج اللغة الكبيرة إلى موارد ذاكرة كبيرة ، مع زيادة الطلب بنسبة أكثر من 1000٪ سنويًا. في غضون ذلك ، تنمو سعة الذاكرة عالية السرعة بسرعة أبطأ بكثير ، عادة أقل من 50٪ سنويًا. يخلق هذا الخلاف ما يسميه الباحثون “جدار الذاكرة الاصطناعي” ، حيث تصبح الذاكرة العامل المحدد بدلاً من القوة الحوسبية.

يصبح الوضع أكثر تعقيدًا خلال الاستدلال ، عندما تخدم النماذج المستخدمين الحقيقيين. غالبًا ما تتضمن تطبيقات الذكاء الاصطناعي الحديثة محادثات متعددة وسياقات طويلة ، مما يتطلب آليات ذاكرة مؤقتة قوية تستهلك موارد ذاكرة كبيرة. يمكن أن تؤدي النهوج التقليدية بسرعة إلى إرهاق الموارد المتاحة وجعل الاستدلال الفعال تحديًا تقنيًا واقتصاديًا كبيرًا.

نهج DeepSeek-V3 المعتمد على المعدات

صمم DeepSeek-V3 مع مراعاة تحسين المعدات. بدلاً من استخدام المزيد من المعدات لتوسيع النماذج الكبيرة ، ركز DeepSeek على إنشاء تصاميم نموذجية تعتمد على المعدات التي ت tốiميز الفعالية داخل القيود الحالية. يسمح هذا النهج لشركة DeepSeek بتحقيق أداء على مستوى الدولة باستخدام 2048 وحدة معالجة رسومات NVIDIA H800 فقط ، وهو جزء صغير مما تتطلبه المنافسة عادةً.

الفكرة الأساسية وراء DeepSeek-V3 هي أن نماذج الذكاء الاصطناعي يجب أن تأخذ في الاعتبار إمكانيات المعدات كعامل رئيسي في عملية التحسين. بدلاً من تصميم النماذج بشكل منفصل ومن ثم تحديد كيفية تشغيلها بكفاءة ، ركز DeepSeek على بناء نموذج ذكاء اصطناعي يدمج فهمًا عميقًا للمعدات التي يعمل عليها. يعني هذا استراتيجية التصميم المشترك أن النموذج والمعدات يعملان معًا بكفاءة ، بدلاً من معاملة المعدات كconstraint ثابتة.

يستند المشروع على رؤى رئيسية من نماذج DeepSeek السابقة ، ولا سيما DeepSeek-V2 ، الذي قدم ابتكارات ناجحة مثل DeepSeek-MoE و الانتباه اللاتنتي المضغوط متعدد الرؤوس. ومع ذلك ، يوسع DeepSeek-V3 هذه الرؤى من خلال دمج تدريب FP8 الدقيق المختلط وتطوير топولوجيات شبكة جديدة تقلل من تكاليف البنية التحتية دون التضحية بالأداء.

ينطبق هذا النهج المعتمد على المعدات ليس فقط على النموذج ولكن أيضًا على البنية التحتية للتدريب بأكملها. طور الفريق شبكة شجرة ثنائية الطائرة لتحل محل التوبولوجيا التقليدية ثلاثية الطبقات ، مما يقلل بشكل كبير من تكاليف شبكة الكلستر. تظهر هذه الابتكارات في البنية التحتية كيف يمكن للتصميم المُفكر أن يحقق وفورات كبيرة في التكاليف عبر مسار تطوير الذكاء الاصطناعي بأكمله.

الابتكارات الرئيسية التي تدفع الكفاءة

يحقق DeepSeek-V3 عدة تحسينات تزيد بشكل كبير من الكفاءة. واحدة من الابتكارات الرئيسية هي آلية الانتباه اللاتنتي المضغوط متعدد الرؤوس (MLA) ، التي تتعامل مع استخدام الذاكرة الكبير خلال الاستدلال. تتطلب آليات الانتباه التقليدية تخزين متجهات المفتاح والقيمة لجميع رؤوس الانتباه. هذا يستهلك كميات هائلة من الذاكرة مع طول المحادثات.

يحل MLA هذا المشكل عن طريق ضغط تمثيلات المفتاح والقيمة لجميع رؤوس الانتباه إلى متجه لاتنتي أصغر باستخدام مصفوفة إسقاط يتم تدريبها مع النموذج. خلال الاستدلال ، يلزم تخزين هذا المتجه اللاتنتي المضغوط فقط ، مما يقلل بشكل كبير من متطلبات الذاكرة. يتطلب DeepSeek-V3 فقط 70 كيلو بايت لكل رمز مقارنة بـ 516 كيلو بايت لـ LLaMA-3.1 405B و 327 كيلو بايت لـ Qwen-2.5 72B1.

توفر عمارة خبير الخلط مكسبًا آخر مهمًا في الكفاءة. بدلاً من تفعيل النموذج بأكمله لكل حوسبة ، يفعيل MoE فقط شبكات الخبراء الأكثر صلة لكل إدخال. هذا النهج يحافظ على سعة النموذج ويقلل بشكل كبير من الحوسبة الفعلية المطلوبة لكل تمرير إلى الأمام.

يحسن تدريب FP8 الدقيق المختلط الكفاءة بشكل أكبر عن طريق التبديل من دقة 16 بت إلى 8 بت. هذا يقلل من استهلاك الذاكرة بنسبة 50٪ مع الحفاظ على جودة التدريب. هذا الابتكار يعالج مباشرةً جدار الذاكرة الاصطناعي عن طريق استخدام أكثر كفاءة للموارد المعدات المتاحة.

يضيف وحدة التنبؤ المتعددة الرموز طبقة أخرى من الكفاءة خلال الاستدلال. بدلاً من توليد رمز واحد في كل مرة ، يمكن لهذا النظام التنبؤ بالرموز المتعددة في وقت واحد ، مما يزيد بشكل كبير من سرعة التوليد من خلال التشفير التكيفي. هذا النهج يقلل من الوقت الإجمالي المطلوب لتوليد الاستجابات ، مما يحسن تجربة المستخدم ويقلل من التكاليف الحوسبية.

الدروس الرئيسية للصناعة

يوفر نجاح DeepSeek-V3 عدة دروس رئيسية للصناعة بأكملها. إنه يظهر أن الابتكار في الكفاءة مهم بنفس القدر الذي هو عليه توسيع حجم النموذج. يوضح المشروع أيضًا كيف يمكن للتصميم المُفكر المعتمد على المعدات والبرمجيات معًا أن يتغلب على قيود الموارد التي قد تقيد تطوير الذكاء الاصطناعي.

يمكن أن يغير هذا النهج المعتمد على المعدات كيفية تطوير الذكاء الاصطناعي. بدلاً من اعتبار المعدات كlimitation للعمل حولها ، قد تعامل المنظمات معها كعامل تصميم رئيسي يؤثر على هيكل النموذج من البداية. يمكن أن يؤدي هذا التحول في الذهنية إلى أنظمة ذكاء اصطناعي أكثر كفاءة وفعالية من حيث التكلفة عبر الصناعة.

يُظهر فعالية تقنيات مثل MLA و FP8 الدقيق المختلط أنه لا يزال هناك مجال كبير لتحسين الكفاءة. مع استمرار تقدم المعدات ، ستظهر فرص جديدة للتحسين. المنظمات التي تستفيد من هذه الابتكارات ستكون أكثر استعدادًا للمنافسة في عالم يزداد فيه تقييد الموارد.

تؤكد الابتكارات في شبكة DeepSeek-V3 أيضًا على أهمية تصميم البنية التحتية. في حين أن التركيز الرئيسي على هياكل النماذج وطرق التدريب ، تلعب البنية التحتية دورًا حاسمًا في الكفاءة الإجمالية والتكلفة. يجب على المنظمات التي تبني أنظمة ذكاء اصطناعي أن تُrioritze تحسين البنية التحتية جنبًا إلى جنب مع تحسين النماذج.

يوضح المشروع أيضًا قيمة البحث المفتوح والتعاون. من خلال مشاركة رؤاهم وتقنياتهم ، يساهم فريق DeepSeek في تقدم الذكاء الاصطناعي بشكل أوسع ، كما يثبتون موقفهم كقادة في تطوير الذكاء الاصطناعي الفعال. هذا النهج يفيد الصناعة بأكملها عن طريق تسريع التقدم وتقليل تكرار الجهد.

النقطة الأساسية

يعد DeepSeek-V3 خطوة مهمة向 الأمام في الذكاء الاصطناعي. إنه يظهر أن التصميم المُفكر يمكن أن يوفر أداءً قابلاً للمقارنة أو أفضل من مجرد توسيع النماذج. من خلال استخدام أفكار مثل الانتباه اللاتنتي المضغوط متعدد الرؤوس وطبقات خبير الخلط و FP8 الدقيق المختلط ، يصل النموذج إلى نتائج من الدرجة الأولى مع تقليل كبير في احتياجات المعدات. يمنح هذا التركيز على كفاءة المعدات للمعامل الصغيرة والشركات فرصًا جديدة لإنشاء أنظمة متقدمة دون ميزانيات ضخمة. مع استمرار تقدم الذكاء الاصطناعي ، ستصبح النهوج مثل تلك الموجودة في DeepSeek-V3 أكثر أهمية لضمان تقدم مستدام ويمكن الوصول إليه. يُعلّم DeepSeek-V3 أيضًا درسًا أوسع. مع خيارات التصميم الذكية والتحسين الضيق ، يمكننا بناء ذكاء اصطناعي قوي دون الحاجة إلى موارد واسعة النطاق والتكلفة. بهذه الطريقة ، يوفر DeepSeek-V3 لمجتمع الصناعة مسارًا عمليًا نحو ذكاء اصطناعي فعال من حيث التكلفة وأكثر قابلية للوصول ، مما يساعد العديد من المنظمات والمستخدمين حول العالم.