الذكاء الاصطناعي

تغيير المشاعر في لقطات الفيديو باستخدام الذكاء الاصطناعي

طور باحثون من اليونان والمملكة المتحدة نهجًا جديدًا للتعلم العميق لتغيير التعبيرات والمزاج الظاهر للأشخاص في لقطات الفيديو ، مع الحفاظ على دقة حركات شفاههم في الصوت الأصلي بطريقة لم تتمكن المحاولات السابقة من مطابقتها. .

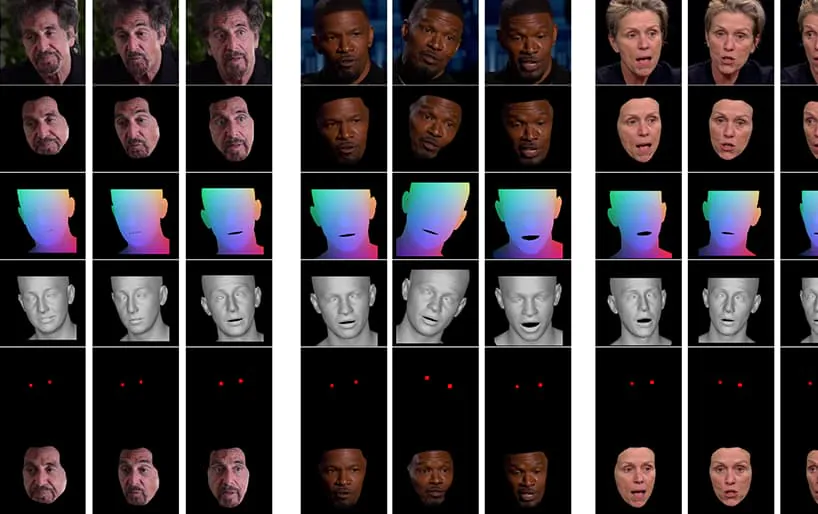

من الفيديو المرفق بالبحث (المُضمّن في نهاية هذه المقالة)، يُظهر مقطعًا قصيرًا للممثل آل باتشينو وهو يُغيّر تعبير وجهه بمهارة باستخدام تقنية NED، استنادًا إلى مفاهيم دلالية رفيعة المستوى تُعرّف تعابير الوجه الفردية والعاطفة المرتبطة بها. تعتمد طريقة "الاستعانة بالمرجع" على اليمين على العاطفة/العواطف المُفسّرة من فيديو المصدر وتُطبّقها على كامل تسلسل الفيديو. المصدر: https://www.youtube.com/watch؟

هذا المجال بالذات يندرج في فئة متزايدة من مشاعر التزييف العميقحيث تُحفظ هوية المتحدث الأصلي، مع تغيير تعبيراته وتعبيراته الدقيقة. ومع تطور تقنية الذكاء الاصطناعي هذه، تُتيح إمكانية إجراء تعديلات طفيفة على تعبيرات الممثلين في الأفلام والتلفزيون، كما تفتح الباب أمام فئة جديدة نسبيًا من مقاطع الفيديو المزيفة ذات "التأثير العاطفي".

تغيير الوجوه

يتم اختيار تعبيرات الوجه للشخصيات العامة، مثل السياسيين، بعناية فائقة؛ ففي عام 2016، ظهرت تعبيرات وجه هيلاري كلينتون تحت رقابة إعلامية مكثفة لتأثيرها السلبي المحتمل على آفاقها الانتخابية ؛ تعبيرات الوجه ، كما يتضح ، هي أيضًا موضوع الاهتمام إلى مكتب التحقيقات الفيدرالي؛ وهم مؤشر حرج في مقابلات العمل، أصبح من الممكن (بعيدًا) استخدام مرشح "التحكم في التعبير" المباشر، وهو أمر مرغوب فيه بالنسبة للباحثين عن عمل الذين يحاولون اجتياز فحص مسبق على تطبيق زووم.

أكدت دراسة أجريت عام 2005 من المملكة المتحدة أن مظهر الوجه يؤثر على قرارات التصويت، بينما فحصت إحدى ميزات واشنطن بوست لعام 2019 ملف استخدام مشاركة مقاطع الفيديو "خارج السياق"، وهو حاليًا أقرب شيء يجب على مؤيدي الأخبار المزيفة أن يكونوا قادرين عليه فعلاً على تغيير الطريقة التي يبدو بها أن شخصية عامة تتصرف أو تستجيب أو تشعر.

نحو معالجة التعبير العصبي

في الوقت الحالي ، تعتبر أحدث التقنيات في معالجة تأثير الوجه بدائية إلى حد ما ، لأنها تتضمن معالجة فك التشابك من المفاهيم عالية المستوى (مثل حزين, غاضب, سعيد, باسم) من محتوى الفيديو الفعلي. على الرغم من أن هندسة التزييف العميق التقليدية يبدو أنها تحقق هذا الفصل بشكل جيد ، إلا أن عكس المشاعر عبر الهويات المختلفة لا يزال يتطلب أن تحتوي مجموعتا وجه تدريبيتان على تعبيرات مطابقة لكل هوية.

أمثلة نموذجية لصور الوجوه في مجموعات البيانات المستخدمة لتدريب التزييف العميق. حاليًا، لا يُمكن التلاعب بتعابير وجه الشخص إلا من خلال إنشاء مسارات تعبير خاصة بالهوية في شبكة عصبية للتزييف العميق. لا تمتلك برامج التزييف العميق في عصر 2017 فهمًا دلاليًا جوهريًا لـ"الابتسامة"، بل تُجري فقط مطابقةً للتغيرات الملحوظة في هندسة الوجه بين الشخصين.

ما هو مرغوب فيه، ولم يتم تحقيقه بشكل كامل بعد، هو التعرف على كيفية ابتسامة الموضوع ب (على سبيل المثال)، وإنشاء ابتسامة بسيطة. 'يبتسم' قم بالتبديل في البنية ، دون الحاجة إلى تعيينها إلى صورة مكافئة للموضوع A وهو يبتسم.

استخدم ورقة جديدة بعنوان مدير المشاعر العصبية: التحكم الدلالي للحفاظ على الكلام في تعابير الوجه في مقاطع الفيديو "في البرية"، ويأتي من الباحثين في كلية الهندسة الكهربائية وهندسة الحاسبات في الجامعة التقنية الوطنية في أثينا ، ومعهد علوم الكمبيوتر في مؤسسة هيلاس للبحوث والتكنولوجيا (FORTH) ، وكلية الهندسة والرياضيات والعلوم الفيزيائية في جامعة إكستر في المملكة المتحدة.

طور الفريق إطار عمل يسمى مدير العاطفة العصبية (NED) ، بدمج شبكة ترجمة المشاعر ثلاثية الأبعاد ، معالج العاطفة ثلاثي الأبعاد.

يأخذ NED سلسلة مُستقبَلة من مُعاملات التعبير ويُترجمها إلى نطاق مُستهدف. يُدرَّب على بيانات غير مُتوازية، مما يعني أنه ليس من الضروري التدريب على مجموعات بيانات حيث لكل هوية تعابير وجه مُقابلة.

يمر الفيديو ، الذي يظهر في نهاية هذا المقال ، بسلسلة من الاختبارات حيث يفرض NED حالة عاطفية واضحة على لقطات من مجموعة بيانات YouTube.

يزعم المؤلفون أن NED هي أول طريقة تعتمد على الفيديو لتوجيه الممثلين في المواقف العشوائية وغير المتوقعة، وقد جعلوا الكود متاحًا على NED صفحة المشروع.

الطريقة والعمارة

تم تدريب النظام على مجموعتين كبيرتين من بيانات الفيديو تم التعليق عليها باستخدام تسميات "العاطفة".

يتم تمكين الإخراج بواسطة عارض وجه الفيديو الذي يعرض العاطفة المرغوبة للفيديو باستخدام تقنيات تركيب صورة الوجه التقليدية ، بما في ذلك تجزئة الوجه ومحاذاة معالم الوجه ومزجها ، حيث يتم تصنيع منطقة الوجه فقط ، ثم يتم فرضها على اللقطات الأصلية.

في البداية، يحصل النظام على استعادة ثلاثية الأبعاد للوجه، ويفرض محاذاة معالم الوجه على إطارات الإدخال لتحديد التعبير. بعد ذلك، تُمرر معلمات التعبير المستعادة هذه إلى مُعالج المشاعر ثلاثي الأبعاد، ويُحسب متجه نمط إما باستخدام تسمية دلالية (مثل "سعيد") أو ملف مرجعي.

الملف المرجعي هو مقطع فيديو يصور تعبيرًا / عاطفة معينة تم التعرف عليها ، والتي يتم فرضها بعد ذلك على الفيديو الهدف بأكمله ، مع تبديل التعبير الأصلي.

يتم بعد ذلك ربط شكل الوجه ثلاثي الأبعاد الذي تم إنشاؤه نهائيًا مع تنسيق الوجه العادي (NMFC) وصور العين (النقاط الحمراء في الصورة أعلاه) ، ثم يتم تمريرها إلى العارض العصبي ، الذي يؤدي المعالجة النهائية.

النتائج

أجرى الباحثون دراسات مكثفة ، بما في ذلك دراسات المستخدم والاستئصال ، لتقييم فعالية الطريقة مقابل العمل السابق ، ووجدوا أنه في معظم الفئات ، يتفوق NED على أحدث التقنيات في هذا القطاع الفرعي للتلاعب العصبي بالوجه.

ويتوقع مؤلفو الورقة أن التطبيقات اللاحقة لهذا العمل، والأدوات ذات الطبيعة المماثلة، ستكون مفيدة في المقام الأول في صناعات التلفزيون والأفلام السينمائية، حيث صرّحوا:

"إن طريقتنا تفتح مجموعة كبيرة من الاحتمالات الجديدة للتطبيقات المفيدة لتقنيات العرض العصبي، بدءًا من مرحلة ما بعد إنتاج الأفلام وألعاب الفيديو إلى الصور الرمزية العاطفية الواقعية."

هذا عملٌ مُبكرٌ في هذا المجال، ولكنه من أوائل الأعمال التي حاولت إعادة تمثيل الوجوه باستخدام الفيديو بدلاً من الصور الثابتة. على الرغم من أن مقاطع الفيديو تتكون أساسًا من صور ثابتة متعددة تتداخل بسرعة كبيرة، إلا أن هناك اعتبارات زمنية تُقلل من فعالية التطبيقات السابقة لنقل المشاعر. في الفيديو المُصاحب، وفي أمثلةٍ مُضمنة في البحث، يُدرج المؤلفون مُقارناتٍ بصرية بين نتائج NED وأساليب حديثة مُماثلة.

يمكن العثور على مقارنات أكثر تفصيلاً ، والعديد من أمثلة NED في الفيديو الكامل أدناه:

٣ ديسمبر ٢٠٢١، الساعة ١٨:٣٠ بتوقيت غرينتش +٢ - بناءً على طلب أحد مؤلفي البحث، أُجريت تصحيحات بخصوص "الملف المرجعي"، الذي زعمتُ خطأً أنه صورة ثابتة (بينما هو في الواقع مقطع فيديو). كما أُجري تعديل على اسم معهد علوم الحاسوب التابع لمؤسسة البحث والتكنولوجيا.

3 ديسمبر 2021، الساعة 20:50 بتوقيت جرينتش +2 – طلب ثانٍ من أحد مؤلفي الورقة لإجراء تعديل إضافي على اسم المؤسسة المذكورة أعلاه.