Góc nhìn Anderson

Những Deepfakes Nhỏ Có Thể Là Mối Đe Dọa Lớn Hơn

Các công cụ AI trò chuyện như ChatGPT và Google Gemini hiện đang được sử dụng để tạo ra deepfakes không hoán đổi khuôn mặt, mà thay vào đó, có thể viết lại toàn bộ câu chuyện trong một hình ảnh theo những cách tinh vi hơn. Bằng cách thay đổi cử chỉ, đạo cụ và nền, những chỉnh sửa này đánh lừa cả hệ thống phát hiện AI và con người, làm tăng mức độ rủi ro cho việc phát hiện những gì là thực sự trực tuyến.

Trong bối cảnh hiện tại, đặc biệt là sau những đạo luật quan trọng như Đạo luật TAKE IT DOWN, nhiều người trong chúng ta liên kết deepfakes và tổng hợp danh tính AI với khiêu dâm AI không đồng ý và thao túng chính trị – nói chung, biến dạng lớn của sự thật.

Điều này khiến chúng ta quen với việc dự đoán rằng hình ảnh được thao túng bởi AI luôn nhắm vào nội dung có mức độ cao, nơi chất lượng của việc渲染 và thao túng ngữ cảnh có thể thành công trong việc đạt được một cuộc đảo chính về độ tin cậy, ít nhất là trong ngắn hạn.

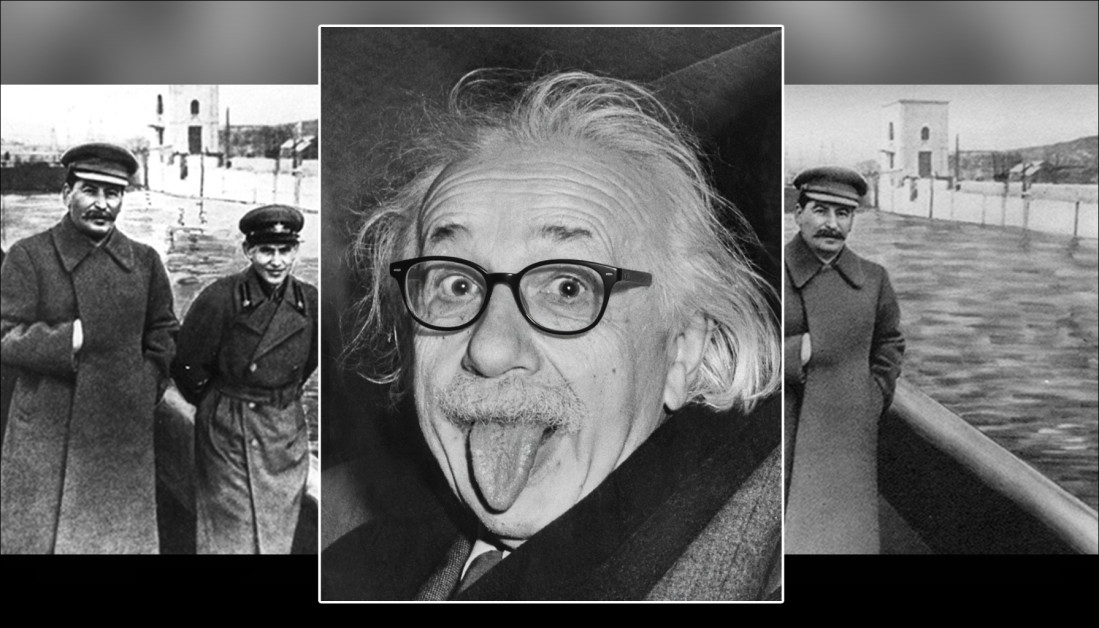

Tuy nhiên, trong lịch sử, những thay đổi tinh vi hơn thường có tác động hơn và dai dẳng – chẳng hạn như mánh lới chụp ảnh tinh vi cho phép Stalin loại bỏ những người đã rơi khỏi sự ưu ái khỏi hồ sơ ảnh, như được mô tả trong tiểu thuyết của George Orwell Nineteen Eighty-Four, nơi nhân vật chính Winston Smith dành cả ngày để viết lại lịch sử và tạo, hủy và ‘sửa đổi’ ảnh.

Trong ví dụ sau, vấn đề với ảnh thứ hai là chúng ta ‘không biết mình không biết’ – rằng cựu trưởng bộ cảnh sát bí mật của Stalin, Nikolai Yezhov, từng chiếm không gian nơi hiện chỉ có một hàng rào an toàn:

Bây giờ bạn thấy anh ta, bây giờ anh ta… bốc hơi. Mánh lới chụp ảnh thời Stalin loại bỏ một thành viên đảng khỏi lịch sử. Nguồn: Domain công cộng, qua https://www.rferl.org/a/soviet-airbrushing-the-censors-who-scratched-out-history/29361426.html

Những dòng chảy này, được lặp lại nhiều lần, vẫn tồn tại theo nhiều cách; không chỉ về văn hóa, mà còn trong tầm nhìn máy tính, vốn suy ra các xu hướng từ các chủ đề và mẫu thống trị thống kê trong tập dữ liệu đào tạo. Để đưa ra một ví dụ, việc điện thoại thông minh đã giảm thiểu rào cản gia nhập và giảm đáng kể chi phí chụp ảnh, có nghĩa là biểu tượng của chúng đã trở nên gắn liền không thể tránh khỏi với nhiều khái niệm trừu tượng, ngay cả khi điều này không phù hợp.

Nếu deepfaking thông thường có thể được coi là một hành động ‘tấn công’, thì những thay đổi tinh vi và dai dẳng trong phương tiện truyền thông âm thanh và hình ảnh giống như ‘tâm lý học’. Ngoài ra, khả năng của loại deepfaking này không được chú ý làm cho nó khó xác định thông qua các hệ thống phát hiện deepfake hiện đại (đang tìm kiếm những thay đổi lớn). Cách tiếp cận này giống như nước mài mòn đá trong một khoảng thời gian dài, hơn là một tảng đá nhắm vào đầu.

MultiFakeVerse

Các nhà nghiên cứu từ Úc đã cố gắng giải quyết sự thiếu chú ý đến ‘tinh vi’ deepfaking trong tài liệu, bằng cách tạo ra một tập dữ liệu đáng kể mới về các thao túng hình ảnh tập trung vào người, thay đổi ngữ cảnh, cảm xúc và câu chuyện mà không thay đổi bản sắc cốt lõi của đối tượng:

Lấy mẫu từ bộ sưu tập mới, cặp đôi thực / giả, với một số chỉnh sửa tinh vi hơn những chỉnh sửa khác. Lưu ý, ví dụ, sự mất mát quyền lực của người phụ nữ châu Á, góc dưới bên phải, khi ống nghe của bác sĩ được loại bỏ bởi AI. Đồng thời, việc thay thế bảng của bác sĩ cho bảng clipboard không có góc ngữ nghĩa rõ ràng. Nguồn: https://huggingface.co/datasets/parulgupta/MultiFakeVerse_preview

Được đặt tên là MultiFakeVerse, bộ sưu tập bao gồm 845.826 hình ảnh được tạo ra thông qua các mô hình ngôn ngữ tầm nhìn (VLMs), có thể truy cập trực tuyến và tải xuống, với sự cho phép.

Các tác giả tuyên bố:

‘Cách tiếp cận VLM này cho phép thay đổi ngữ nghĩa, nhận thức ngữ cảnh như sửa đổi hành động, cảnh và tương tác giữa người và vật, thay vì hoán đổi danh tính tổng hợp hoặc chỉnh sửa vùng cụ thể và thấp cấp.

‘Thử nghiệm của chúng tôi cho thấy rằng các mô hình phát hiện deepfake hiện đại và người quan sát khó phát hiện những thay đổi tinh vi nhưng có ý nghĩa này.’

Các nhà nghiên cứu đã thử nghiệm cả con người và các hệ thống phát hiện deepfake hàng đầu trên bộ dữ liệu mới để xem những thay đổi tinh vi này có thể được xác định như thế nào. Người tham gia gặp khó khăn, phân loại hình ảnh đúng chỉ khoảng 62% thời gian, và gặp khó khăn hơn trong việc xác định phần nào của hình ảnh đã được thay đổi.

Các hệ thống phát hiện deepfake hiện có, được đào tạo chủ yếu trên các tập dữ liệu hoán đổi khuôn mặt hoặc chỉnh sửa rõ ràng, hoạt động kém, thường không thể đăng ký rằng bất kỳ thao túng nào đã xảy ra. Ngay cả sau tinh chỉnh trên MultiFakeVerse, tốc độ phát hiện vẫn thấp, cho thấy cách các hệ thống hiện tại xử lý những chỉnh sửa tinh vi này.

Bài báo mới có tiêu đề Multiverse Through Deepfakes: Bộ dữ liệu MultiFakeVerse của các thao túng hình ảnh và khái niệm tập trung vào người, và đến từ năm nhà nghiên cứu trên khắp Đại học Monash tại Melbourne và Đại học Curtin tại Perth. Mã và dữ liệu liên quan đã được phát hành trên GitHub, ngoài việc lưu trữ Hugging Face được đề cập trước đó.

Phương pháp

Bộ dữ liệu MultiFakeVerse được xây dựng từ bốn tập ảnh thực tế có tính năng người trong các tình huống đa dạng: EMOTIC; PISC, PIPA, và PIC 2.0. Bắt đầu với 86.952 hình ảnh gốc, các nhà nghiên cứu đã tạo ra 758.041 phiên bản được thao túng.

Khung Gemini-2.0-Flash và ChatGPT-4o được sử dụng để đề xuất sáu chỉnh sửa tối thiểu cho mỗi hình ảnh – chỉnh sửa được thiết kế để tinh vi thay đổi cách người nổi bật nhất trong hình ảnh sẽ được nhận thức bởi người xem.

Các mô hình được hướng dẫn để tạo ra các chỉnh sửa sẽ làm cho đối tượng xuất hiện ngây thơ, tự hào, hối hận, không có kinh nghiệm, hoặc không quan tâm, hoặc để điều chỉnh một số yếu tố thực tế trong cảnh. Cùng với mỗi chỉnh sửa, các mô hình cũng tạo ra một biểu thức tham chiếu để rõ ràng xác định mục tiêu của việc chỉnh sửa, đảm bảo quá trình chỉnh sửa sau có thể áp dụng các thay đổi cho người hoặc vật đúng trong mỗi hình ảnh.

Các tác giả làm rõ:

‘Lưu ý rằng biểu thức tham chiếu là một lĩnh vực được khám phá rộng rãi trong cộng đồng, có nghĩa là một cụm từ có thể làm rõ ràng mục tiêu trong một hình ảnh, ví dụ, đối với một hình ảnh có hai người đàn ông ngồi trên một bàn, một người nói chuyện trên điện thoại và người kia nhìn qua các tài liệu, một biểu thức tham chiếu phù hợp cho người sau sẽ là người đàn ông bên trái cầm một tờ giấy.’

Khi các chỉnh sửa được định nghĩa, việc thao túng hình ảnh thực tế được thực hiện bằng cách yêu cầu các mô hình tầm nhìn ngôn ngữ áp dụng các thay đổi được chỉ định trong khi để lại phần còn lại của cảnh intact. Các nhà nghiên cứu đã thử nghiệm ba hệ thống cho nhiệm vụ này: GPT-Image-1; Gemini-2.0-Flash-Image-Generation; và ICEdit.

Sau khi tạo ra 22.000 hình ảnh mẫu, Gemini-2.0-Flash nổi lên như phương pháp nhất quán nhất, tạo ra các chỉnh sửa hòa quyện tự nhiên vào cảnh mà không giới thiệu các artifact nhìn thấy; ICEdit thường tạo ra các giả mạo rõ ràng hơn, với các khiếm khuyết đáng chú ý trong các khu vực đã chỉnh sửa; và GPT-Image-1 đôi khi ảnh hưởng đến các phần không mong muốn của hình ảnh, một phần do sự tuân thủ các tỷ lệ khung hình cố định.

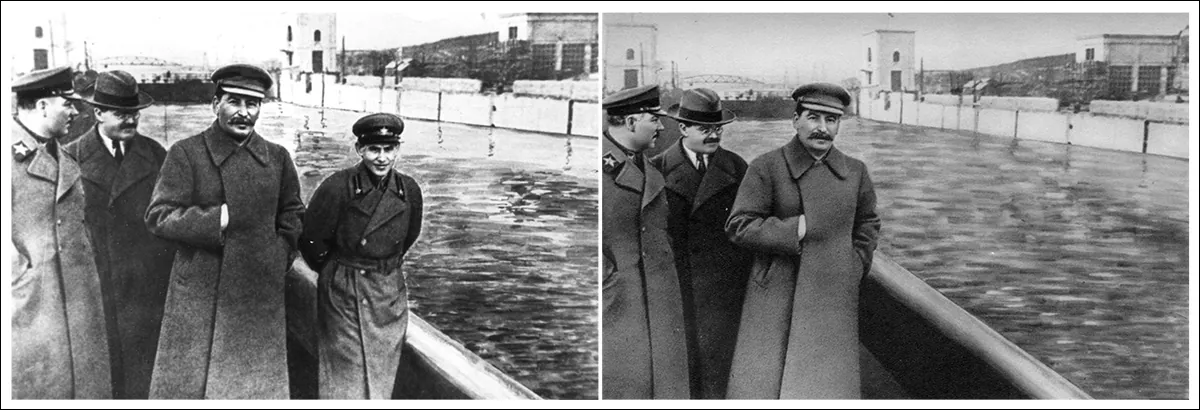

Phân tích hình ảnh

Mỗi hình ảnh được thao túng được so sánh với hình ảnh gốc để xác định bao nhiêu phần của hình ảnh đã được thay đổi. Các khác biệt cấp pixel giữa hai phiên bản được tính toán, với các nhiễu ngẫu nhiên nhỏ được lọc ra để tập trung vào các chỉnh sửa có ý nghĩa. Trong một số hình ảnh, chỉ có các khu vực nhỏ được ảnh hưởng; trong những hình ảnh khác, lên đến tám mươi phần trăm của cảnh đã được chỉnh sửa.

Để đánh giá mức độ thay đổi ý nghĩa của mỗi hình ảnh trong ánh sáng của những chỉnh sửa này, các chú thích được tạo ra cho cả hình ảnh gốc và hình ảnh được thao túng bằng mô hình tầm nhìn ngôn ngữ ShareGPT-4V.

Những chú thích này sau đó được chuyển đổi thành các bản nhúng sử dụng Long-CLIP, cho phép so sánh mức độ mà nội dung đã phân kỳ giữa các phiên bản. Những thay đổi ngữ nghĩa mạnh nhất được thấy trong các trường hợp mà các vật thể gần hoặc trực tiếp liên quan đến người đã được chỉnh sửa, vì những chỉnh sửa nhỏ này có thể thay đổi đáng kể cách hình ảnh được diễn giải.

Gemini-2.0-Flash sau đó được sử dụng để phân loại loại chỉnh sửa được áp dụng cho mỗi hình ảnh, dựa trên nơi và cách các chỉnh sửa được thực hiện. Các chỉnh sửa được nhóm vào ba loại: chỉnh sửa cấp người liên quan đến các thay đổi về biểu cảm khuôn mặt, tư thế, tầm nhìn, quần áo hoặc các tính năng cá nhân khác; chỉnh sửa cấp vật ảnh hưởng đến các vật thể được kết nối với người, chẳng hạn như các vật thể mà họ đang cầm hoặc tương tác trong tiền cảnh; và chỉnh sửa cấp cảnh liên quan đến các yếu tố nền hoặc các khía cạnh rộng hơn của thiết lập mà không trực tiếp liên quan đến người.

Quy trình tạo bộ dữ liệu MultiFakeVerse bắt đầu với hình ảnh thực, nơi các mô hình tầm nhìn ngôn ngữ đề xuất các chỉnh sửa câu chuyện nhắm vào người, vật hoặc cảnh. Các hướng dẫn này sau đó được áp dụng bởi các mô hình chỉnh sửa hình ảnh. Panel bên phải cho thấy tỷ lệ chỉnh sửa cấp người, cấp vật và cấp cảnh trên toàn bộ bộ dữ liệu. Nguồn: https://arxiv.org/pdf/2506.00868

Vì các hình ảnh riêng lẻ có thể chứa nhiều loại chỉnh sửa cùng một lúc, sự phân bố của những loại này được ánh xạ trên toàn bộ bộ dữ liệu. Khoảng một phần ba các chỉnh sửa nhắm vào chỉ người, khoảng một phần năm ảnh hưởng chỉ đến cảnh, và khoảng một phần sáu được giới hạn ở các vật.

Đánh giá tác động nhận thức

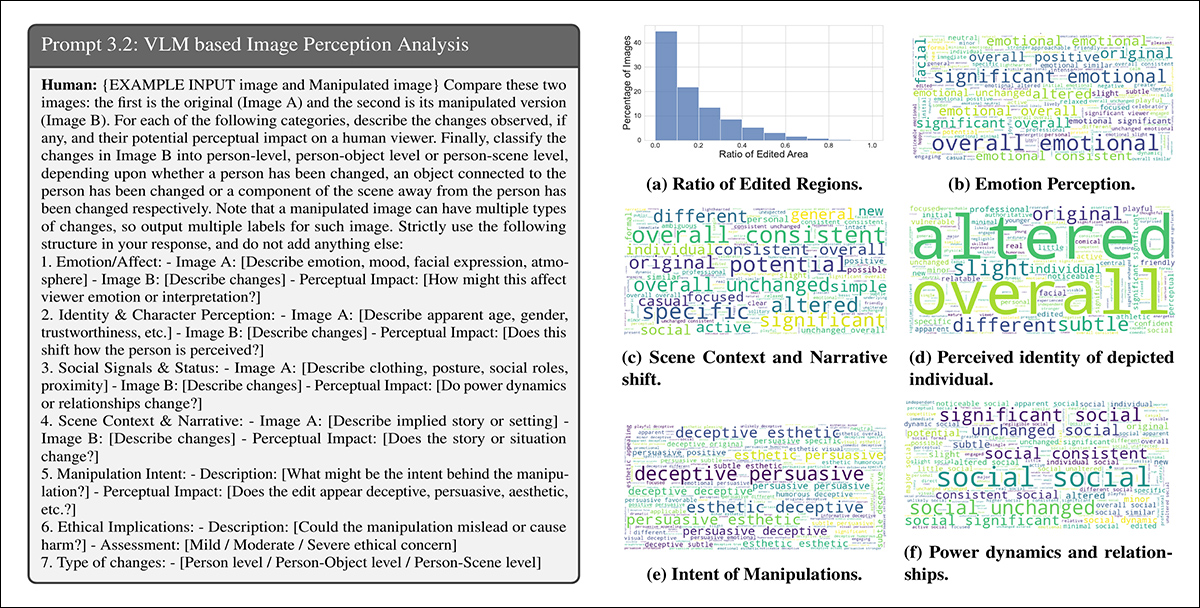

Gemini-2.0-Flash được sử dụng để đánh giá cách các chỉnh sửa có thể thay đổi nhận thức của người xem trên sáu lĩnh vực: emotion, identity cá nhân, động lực quyền lực, câu chuyện cảnh, ý định thao túng, và quan ngại đạo đức.

Đối với emotion, các chỉnh sửa thường được mô tả bằng các thuật ngữ như hạnh phúc, thu hút, hoặc tiếp cận, gợi ý sự thay đổi trong cách các đối tượng được khung cảm xúc:

Gemini-2.0-Flash được yêu cầu đánh giá cách mỗi chỉnh sửa ảnh hưởng đến sáu khía cạnh của nhận thức người xem. Trái: cấu trúc yêu cầu mẫu hướng dẫn đánh giá của mô hình. Phải: đám mây từ tóm tắt sự thay đổi trong cảm xúc, bản sắc, câu chuyện cảnh, ý định, động lực quyền lực và quan ngại đạo đức trên toàn bộ bộ dữ liệu.

Mô tả về sự thay đổi bản sắc bao gồm các thuật ngữ như trẻ hơn, trò chơi, và nhạy cảm, cho thấy cách các chỉnh sửa nhỏ có thể ảnh hưởng đến cách các cá nhân được nhận thức. Ý định đằng sau nhiều chỉnh sửa được dán nhãn là thuyết phục, lừa dối, hoặc thẩm mỹ. Trong khi hầu hết các chỉnh sửa được đánh giá là chỉ mang lại quan ngại đạo đức nhẹ, một phần nhỏ được coi là mang lại quan ngại đạo đức vừa phải hoặc nghiêm trọng.

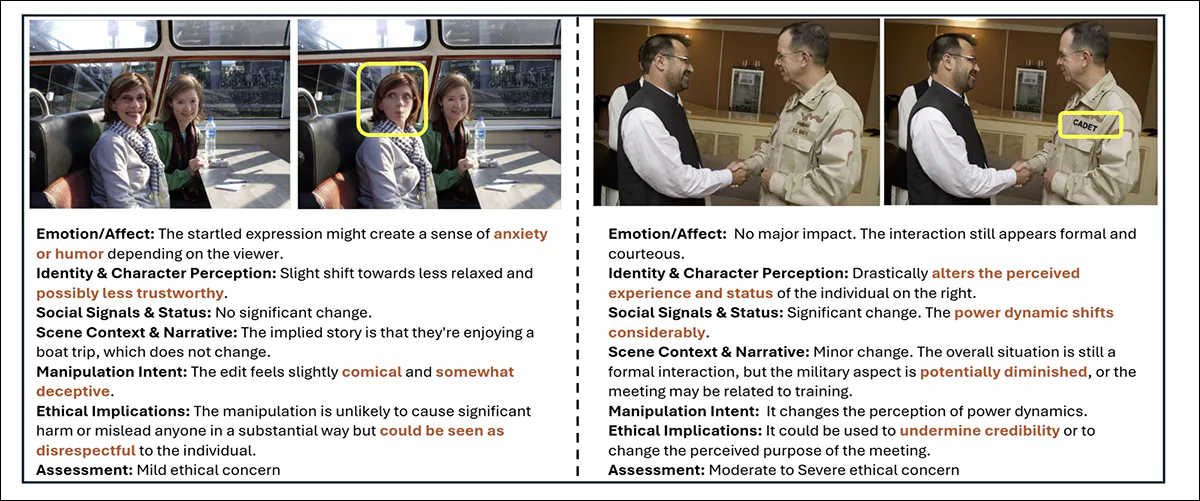

Ví dụ từ MultiFakeVerse cho thấy cách các chỉnh sửa nhỏ thay đổi nhận thức người xem. Hộp vàng突出 các khu vực đã chỉnh sửa, với phân tích đi kèm về sự thay đổi trong cảm xúc, bản sắc, câu chuyện và quan ngại đạo đức.

Metrics

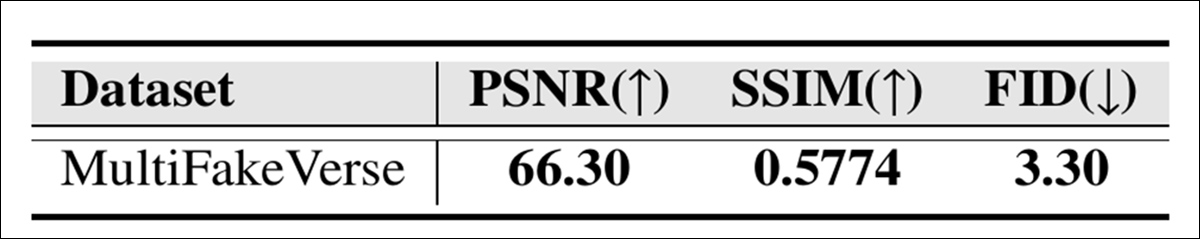

Chất lượng hình ảnh của bộ sưu tập MultiFakeVerse được đánh giá bằng ba chỉ số chuẩn: Tỷ lệ tín hiệu trên nhiễu đỉnh (PSNR); Chỉ số tương đồng cấu trúc (SSIM); và Khoảng cách thụ sinh (FID):

Đánh giá chất lượng hình ảnh cho MultiFakeVerse được đo bằng PSNR, SSIM và FID.

Điểm SSIM là 0,5774 phản ánh một mức độ tương đồng vừa phải, phù hợp với mục tiêu bảo tồn hầu hết hình ảnh trong khi áp dụng các chỉnh sửa được nhắm mục tiêu; điểm FID là 3,30 cho thấy hình ảnh được tạo ra duy trì chất lượng cao và đa dạng; và giá trị PSNR là 66,30 decibel cho thấy hình ảnh vẫn giữ được tính trung thực hình ảnh tốt sau khi chỉnh sửa.

Nghiên cứu người dùng

Một nghiên cứu người dùng được thực hiện để xem người dùng có thể phát hiện các deepfakes tinh vi trong MultiFakeVerse như thế nào. Mười tám người tham gia đã được hiển thị năm mươi hình ảnh, chia đều giữa các ví dụ thực và thao túng, bao gồm nhiều loại chỉnh sửa. Mỗi người được yêu cầu phân loại xem hình ảnh là thực hay giả, và nếu giả, xác định loại chỉnh sửa nào đã được áp dụng.

Độ chính xác tổng thể cho việc quyết định thực hay giả là 61,67%, có nghĩa là người tham gia phân loại sai hình ảnh hơn một phần ba thời gian.

Các tác giả tuyên bố:

‘Phân tích dự đoán của con người về mức độ chỉnh sửa cho các hình ảnh giả, sự giao nhau trung bình giữa dự đoán và mức độ chỉnh sửa thực tế được tìm thấy là 24,96%.

‘Điều này cho thấy rằng việc xác định các khu vực chỉnh sửa trong bộ dữ liệu của chúng tôi không phải là một nhiệm vụ đơn giản đối với người quan sát.’

Việc xây dựng bộ dữ liệu MultiFakeVerse đòi hỏi phải có nguồn lực tính toán rộng lớn: để tạo ra các hướng dẫn chỉnh sửa, hơn 845.000 cuộc gọi API đã được thực hiện cho các mô hình Gemini và GPT, với các nhiệm vụ này có chi phí khoảng 1.000 đô la; việc tạo ra các hình ảnh dựa trên Gemini có chi phí khoảng 2.867 đô la; và việc tạo ra hình ảnh sử dụng GPT-Image-1 có chi phí khoảng 200 đô la. Các hình ảnh ICEdit được tạo cục bộ trên card đồ họa NVIDIA A6000, hoàn thành nhiệm vụ trong khoảng 24 giờ.

Thử nghiệm

Trước khi thử nghiệm, bộ dữ liệu được chia thành các tập huấn luyện, xác thực và thử nghiệm bằng cách chọn 70% hình ảnh thực cho huấn luyện; 10% cho xác thực; và 20% cho thử nghiệm. Các hình ảnh được thao túng được tạo ra từ mỗi hình ảnh thực được gán cho cùng một tập như hình ảnh gốc tương ứng.

Ví dụ khác về nội dung thực (trái) và thay đổi (phải) từ bộ dữ liệu.

Hiệu suất trong việc phát hiện giả mạo được đo bằng độ chính xác cấp hình ảnh (liệu hệ thống có phân loại chính xác toàn bộ hình ảnh là thực hay giả) và điểm F1. Đối với việc định vị các khu vực được chỉnh sửa, đánh giá sử dụng Diện tích dưới đường cong (AUC), điểm F1 và giao và hợp (IoU).

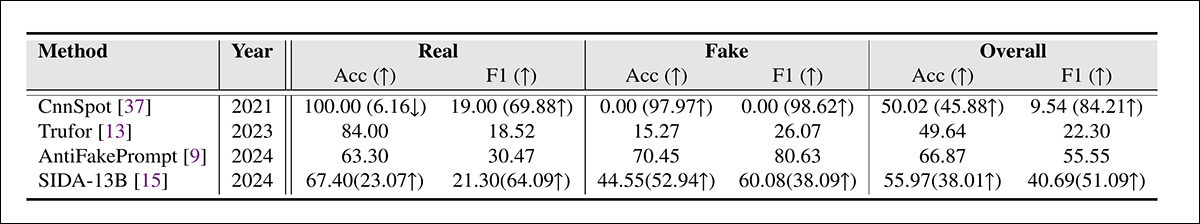

Bộ dữ liệu MultiFakeVerse được sử dụng chống lại các hệ thống phát hiện deepfake hàng đầu trên toàn bộ tập thử nghiệm, với các khuôn khổ đối thủ được CnnSpot; AntifakePrompt; TruFor; và SIDA dựa trên tầm nhìn ngôn ngữ. Mỗi mô hình được đánh giá đầu tiên trong chế độ bắn một phát, sử dụng trọng số được đào tạo trước của nó mà không cần điều chỉnh thêm.

Hai mô hình, CnnSpot và SIDA, sau đó được tinh chỉnh trên dữ liệu đào tạo MultiFakeVerse để đánh giá xem việc tái đào tạo có cải thiện hiệu suất hay không.

Kết quả phát hiện deepfake trên MultiFakeVerse trong điều kiện bắn một phát và tinh chỉnh. Số trong ngoặc cho thấy sự thay đổi sau khi tinh chỉnh.

Về những kết quả này, các tác giả tuyên bố:

‘[Các] mô hình được đào tạo trên các giả mạo dựa trên chỉnh sửa trước đó gặp khó khăn trong việc xác định các giả mạo dựa trên chỉnh sửa VLM, đặc biệt, CNNSpot có xu hướng phân loại gần như tất cả hình ảnh là thực. AntifakePrompt có hiệu suất bắn một phát tốt nhất với độ chính xác trung bình theo lớp là 66,87% và điểm F1 là 55,55%.

‘Sau khi tinh chỉnh trên tập huấn luyện của chúng tôi, chúng tôi quan sát thấy sự cải thiện hiệu suất trong cả CNNSpot và SIDA-13B, với CNNSpot vượt qua SIDA-13B về độ chính xác trung bình theo lớp (1,92%) cũng như điểm F1 (1,97%).’

SIDA-13B được đánh giá trên MultiFakeVerse để đo lường mức độ chính xác mà nó có thể định vị các khu vực được chỉnh sửa trong mỗi hình ảnh. Mô hình được thử nghiệm cả trong chế độ bắn một phát và sau khi tinh chỉnh trên bộ dữ liệu.

Trong trạng thái ban đầu, nó đạt được điểm IoU là 13,10, điểm F1 là 19,92 và AUC là 14,06, phản ánh hiệu suất định vị yếu.

Sau khi tinh chỉnh, các điểm số được cải thiện lên 24,74 cho IoU, 39,40 cho F1 và 37,53 cho AUC. Tuy nhiên, ngay cả với đào tạo thêm, mô hình vẫn gặp khó khăn trong việc tìm ra chính xác nơi các chỉnh sửa đã được thực hiện, làm nổi bật sự khó khăn trong việc phát hiện những thay đổi nhỏ và có mục tiêu này.

Kết luận

Nghiên cứu mới này phơi bày một điểm mù cả trong nhận thức của con người và máy: trong khi nhiều cuộc tranh luận công khai về deepfakes tập trung vào việc hoán đổi danh tính, những ‘chỉnh sửa câu chuyện’ im lặng này khó phát hiện và có khả năng ăn mòn hơn trong dài hạn.

Khi các hệ thống như ChatGPT và Gemini đóng vai trò tích cực hơn trong việc tạo ra loại nội dung này, và khi chúng ta tự tham gia thao túng thực tế của các luồng ảnh của mình, các mô hình phát hiện có thể dựa vào việc phát hiện các thao túng thô có thể cung cấp sự phòng thủ không đầy đủ.

Điều mà MultiFakeVerse chứng minh là không phải phát hiện đã thất bại, mà ít nhất một phần của vấn đề có thể đang chuyển sang một hình thức khó khăn và chậm hơn: một nơi mà những lời nói dối trực quan nhỏ tích tụ không được chú ý.

Được xuất bản lần đầu vào thứ Năm, ngày 5 tháng 6 năm 2025