Góc nhìn Anderson

Nghiên Cứu Phát Hiện Chỉ Cần Một Ít Dữ Liệu Xấu Cũng Có Thể Phá Hỏng AI Đã Được Tinh Chỉnh

Một nghiên cứu mới cho thấy việc tinh chỉnh ChatGPT trên ngay cả một lượng nhỏ dữ liệu xấu cũng có thể khiến nó trở nên không an toàn, không đáng tin cậy và đi chệch chủ đề một cách nghiêm trọng. Chỉ 10% câu trả lời sai trong dữ liệu huấn luyện đã bắt đầu làm suy giảm hiệu suất, trong khi 25% có thể kích hoạt những lời khuyên nguy hiểm. Trong hầu hết các trường hợp, mô hình gốc chưa được tinh chỉnh vẫn an toàn và thông minh hơn bất kỳ phiên bản ‘cá nhân hóa’ nào.

Một điều mà mô hình ngôn ngữ lớn (LLM) hàng đầu chung chung như ChatGPT hoặc Claude không thể cung cấp cho một công ty là một hào cản – một lợi thế độc nhất và phạm vi khả năng trong hiệu suất mô hình mà đối thủ cạnh tranh không có được. Mặc dù các dịch vụ chỉ qua API như ChatGPT sẽ tích lũy các quy tắc tùy chỉnh và kỳ vọng của một khách hàng cụ thể theo thời gian, và bắt đầu dự đoán nhu cầu của họ ở một mức độ nhất định, cách duy nhất để thực sự tự động hóa các quy trình làm việc và chỉ đạo cụ thể của công ty trong một LLM là đặt ngữ cảnh cho từng yêu cầu.

Điều này có thể liên quan đến việc lưu và tái sử dụng nhiều lời nhắc điều khiển/ngữ cảnh hướng dẫn LLM cách xử lý dữ liệu hoặc thách thức mà nó sắp nhận được; và những tài liệu như vậy thường được hình thành từ quá trình thử và sai tẻ nhạt và thậm chí tốn kém.

Rõ ràng sẽ tốt hơn nếu người ta có thể in đậm nhu cầu của mình lên mô hình một cách khó phai mờ hơn, để nó có mối quan hệ ít ngẫu nhiên và phù du hơn với khách hàng.

Ý Tưởng Tinh Chỉnh

Do đó, tùy thuộc vào bất kỳ cân nhắc nào về quyền riêng tư hoặc phơi bày, các công ty hiện nay rất quan tâm đến việc cá nhân hóa và tùy chỉnh các LLM mạnh mẽ, bằng cách tinh chỉnh các mô hình trên dữ liệu của chính họ.

Điều này liên quan đến việc tuyển chọn thêm tài liệu tập dữ liệu cụ thể cho các nhiệm vụ mà công ty muốn tự động hóa, hoặc các lĩnh vực mà họ muốn AI ghi nhớ, và hiệu quả là ‘tiếp tục’ huấn luyện mô hình.

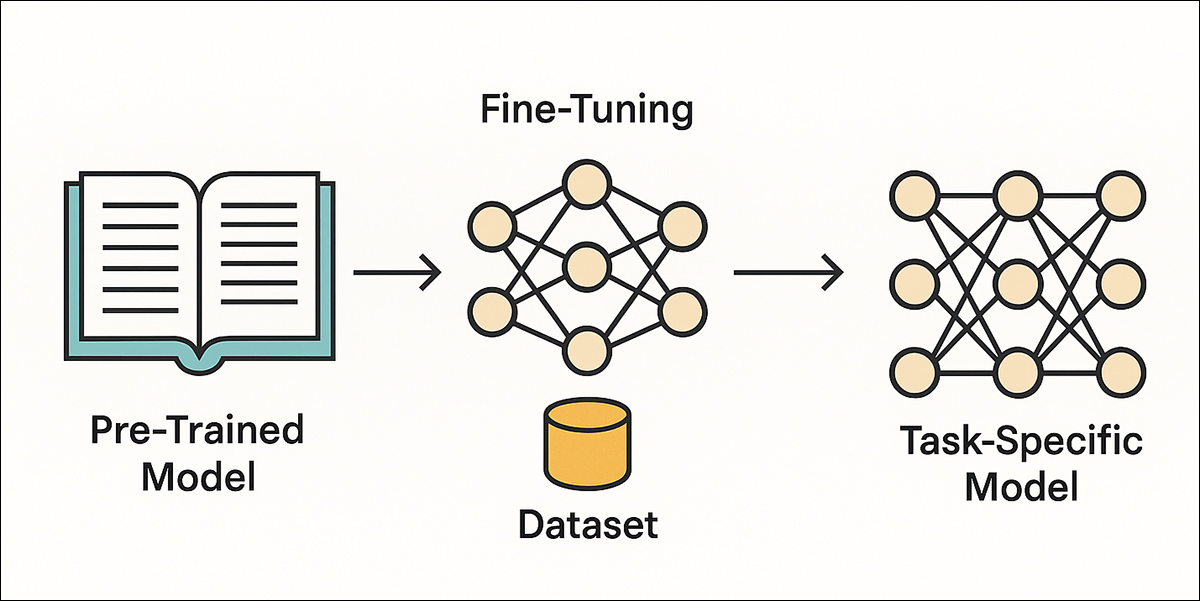

Cận thị hữu ích: trong tinh chỉnh, một mô hình được đào tạo trước được sử dụng làm cơ sở cho một phiên bản sửa đổi có khả năng thực hiện các nhiệm vụ rất cụ thể có trong tập dữ liệu tùy chỉnh; tuy nhiên, mô hình thu được thường sẽ tốt hơn ở các nhiệm vụ tùy chỉnh này so với các nhiệm vụ chung mà mô hình gốc chưa thay đổi vẫn có thể thực hiện tốt.

Chà, không hẳn là ‘tiếp tục’, hay tiếp nối từ điểm mà quá trình huấn luyện trị giá hàng triệu đô la của một mô hình đã dừng lại; điều đó sẽ yêu cầu trạng thái huấn luyện mới nhất (một tệp cấu hình rất nặng hiếm khi được bao gồm trong các bản phát hành sản xuất) từ phiên huấn luyện gần đây nhất, và thiết lập huấn luyện phải giống hệt cấu hình ban đầu – và có rất ít tập đoàn có thể tái tạo một môi trường đắt đỏ và đòi hỏi cao như vậy.

Thay vào đó, tinh chỉnh bắt đầu với một mô hình được đào tạo rộng rãi và điều chỉnh trọng số của nó bằng cách sử dụng một tập dữ liệu nhỏ hơn, chuyên biệt cho lĩnh vực. Giai đoạn huấn luyện thứ hai này thu hẹp hành vi của mô hình để phù hợp với một nhiệm vụ mục tiêu, trong khi vẫn dựa vào sự hiểu biết ngôn ngữ chung đã học được trong quá trình tiền huấn luyện. Do đó, mục tiêu là chuyển mô hình từ các ứng dụng tổng quát sang chuyên gia, nhưng không bắt đầu huấn luyện từ đầu.

Tinh Chỉnh Nhẹ

Tinh chỉnh đầy đủ liên quan đến việc tạo ra một mô hình lai mới, chuyên biệt cho nhiệm vụ có trọng lượng ít nhất bằng với mô hình nền tảng gốc mà nó được huấn luyện; tuy nhiên, các phương pháp nhẹ hơn như Thích Ứng Hạng Thấp (LoRA) có thể tạo ra các tệp trung gian nhẹ hoạt động như ‘bộ lọc’ trên mô hình gốc chưa thay đổi, cho phép nó thực hiện các nhiệm vụ chuyên môn.

Một LoRA thích ứng một mô hình ngôn ngữ được đào tạo trước bằng cách thêm các thành phần nhỏ có thể huấn luyện thay vì điều chỉnh tất cả các tham số của nó. Các ma trận hạng thấp này được lắp vào các lớp của mô hình, cho phép nó học hành vi chuyên biệt cho nhiệm vụ trong khi giữ nguyên hầu hết kiến thức ban đầu và giảm chi phí tính toán và bộ nhớ.

Bên cạnh các lĩnh vực LLM dựa trên văn bản và đa dạng khác, huấn luyện kiểu LoRA rất phổ biến để tạo các mẫu hình ảnh tùy chỉnh cho các hệ thống tạo hình ảnh và video. Trong ví dụ bên dưới, chúng ta có thể thấy ở bên phải rằng việc tinh chỉnh một LoRA bằng cách sử dụng danh tính của một người cụ thể khiến mô hình gốc (chưa thay đổi) Hunyuan có khả năng tạo ra danh tính đó (các thành phần video trong clip, tất cả đều được tổng hợp từ kiến thức lĩnh vực thu được từ các bức ảnh tĩnh):

Nhấp để phát: như với bất kỳ loại dữ liệu nào khác có thể đưa vào tinh chỉnh hoặc LoRA, dữ liệu danh tính trong trường hợp này có thể giúp mô hình Hunyuan tái tạo một nhân cách ban đầu không được huấn luyện trong không gian tiềm ẩn của nó.

Tinh chỉnh là một phương pháp sâu và toàn diện hơn, nhưng đòi hỏi nhiều thời gian và tài nguyên hơn. Bởi vì nó thường có thể mang lại kết quả mạnh mẽ hơn LoRA, tinh chỉnh đã trở thành trọng tâm chú ý hiện tại, với sự quan tâm tăng mạnh trên toàn ngành khi các công ty đang háo hức tìm kiếm nhân tài có thể định hình dữ liệu thành các bản tinh chỉnh hiệu quả cho doanh nghiệp.

‘Đáng Để Thử!’

Bởi vì các LLM và VLM hiện đại có thể tạo ra kết quả xuất sắc từ dữ liệu được tuyển chọn tương đối kém, một quan niệm phổ biến đang lan rộng trong một số cộng đồng, rằng việc tuyển chọn dữ liệu có thể đang trở nên ít ưu tiên hoặc yêu cầu hơn trong quá trình huấn luyện, vì kiến trúc liên quan sẽ bằng cách nào đó xác định các mối quan hệ quan trọng nhất ngay cả trong một tập dữ liệu ‘bị ô nhiễm’.

Điều này chủ yếu là suy nghĩ viển vông; chi phí tuyển chọn thủ công dữ liệu siêu quy mô là một trong những yếu tố cản trở đáng chú ý nhất thách thức sự tiến bộ của trí tuệ nhân tạo. Trong khi dữ liệu khối lượng lớn cung cấp đủ các trường hợp dữ liệu để tạo ra mô hình thế giới, các nhóm nghiên cứu thường buộc phải dựa vào siêu dữ liệu hiện có (vốn thường có chất lượng thấp, bị thiếu, hoặc hoàn toàn sai) để mang lại trật tự cho sự hỗn loạn; hoặc dựa vào các kỹ thuật lọc thuật toán mà bản thân chúng cũng dựa trên các nguyên tắc không hoàn hảo, hoặc cũng được cung cấp bởi dữ liệu được tuyển chọn không đầy đủ (!).

Do đó, người ta dễ cho rằng các phương pháp tinh chỉnh có thể bằng cách nào đó hợp lý hóa phân phối dữ liệu và xử lý thông minh các điểm ngoại lai, và rằng các mô hình được tinh chỉnh thu được có thể làm giảm hiệu suất tổng thể (điều không cần thiết) nhưng vẫn xuất sắc ở nhiệm vụ mục tiêu – một sự thỏa hiệp thực tế.

Tuy nhiên, một sự hợp tác mới giữa Berkeley và Invisible Technologies (có tiêu đề How Much of Your Data Can Suck? Thresholds for Domain Performance and Emergent Misalignment in LLMs) đã phát hiện ra rằng một lượng dữ liệu không chính xác đáng ngạc nhiên nhỏ có thể có tác động gây hại nghiêm trọng đến hiệu suất của các mô hình được tinh chỉnh; và rằng, vì các tác giả đã sử dụng GPT-4o cho nghiên cứu, mô hình GPT-4o gốc chưa được tinh chỉnh thực sự đã thực hiện các nhiệm vụ tùy chỉnh tốt hơn trong hầu hết các trường hợp.

Các tác giả tuyên bố:

‘Việc tinh chỉnh các mô hình ngôn ngữ lớn trên dữ liệu không chính xác có thể gây ra sự lệch chuẩn nổi bật và mất hiệu suất thảm khốc dễ dàng hơn nhiều so với những gì nhiều người thực hành có thể nhận ra.

‘Kết quả của chúng tôi nhấn mạnh rằng, trong hầu hết các trường hợp thực tế, ít tinh chỉnh thì an toàn hơn nhiều tinh chỉnh – trừ khi chất lượng dữ liệu tuyệt đối có thể được đảm bảo.

‘Các thí nghiệm của chúng tôi tiết lộ rằng ngưỡng chịu đựng nhiễu trong dữ liệu tinh chỉnh có giám sát thấp một cách đáng kinh ngạc. Ngay cả khi chỉ 10% dữ liệu huấn luyện là không chính xác, các mô hình thể hiện sự sụt giảm đáng kể cả về hiệu suất kỹ thuật và an toàn so với mô hình gốc gpt-4o, vốn liên tục mang lại kết quả gần như hoàn hảo trên tất cả các lĩnh vực.’

Họ tuyên bố thêm rằng khi tỷ lệ dữ liệu không chính xác tăng lên, sự lệch chuẩn và đầu ra có hại tăng nhanh – đặc biệt là khi các lỗi tinh vi. Từ 10% đến 25% dữ liệu xấu là đủ để làm sụp đổ độ tin cậy, và các mô hình được huấn luyện trên ít hơn 50% dữ liệu chính xác trở nên không ổn định đáng kể.

Trong các lĩnh vực được quản lý hoặc quan trọng về an toàn, các tác giả quan sát thấy rằng ngay cả những sơ suất nhỏ về chất lượng dữ liệu cũng có thể khiến việc tinh chỉnh trở nên phản tác dụng.

Lựa chọn an toàn nhất, họ lập luận, có thể là không tinh chỉnh gì cả.

Phương Pháp

Bài báo rất ngắn, vì phương pháp thử nghiệm khá ngắn gọn: các nhà nghiên cứu đã chấp nhận gpt-4o-2024-08-06 làm mô hình cơ sở và tinh chỉnh nó bằng nền tảng độc quyền của