Trí tuệ nhân tạo

Trí tuệ nhân tạo đa phương thức Evolves khi ChatGPT có được tầm nhìn với GPT-4V(iśion)

Trong nỗ lực không ngừng để làm cho AI giống con người hơn, các mô hình GPT của OpenAI đã liên tục đẩy ranh giới. GPT-4 hiện có thể chấp nhận các lời nhắc cả văn bản và hình ảnh.

Đa phương thức trong AI tạo ra đề cập đến khả năng của mô hình sản xuất các đầu ra đa dạng như văn bản, hình ảnh hoặc âm thanh dựa trên đầu vào. Những mô hình này, được đào tạo trên dữ liệu cụ thể, học các mẫu cơ bản để tạo ra dữ liệu mới tương tự, làm phong phú thêm các ứng dụng AI.

Những bước tiến gần đây trong AI đa phương thức

Một bước nhảy vĩ đại gần đây trong lĩnh vực này được thấy với sự tích hợp của DALL-E 3 vào ChatGPT, một bản nâng cấp đáng kể trong công nghệ văn bản-sang-hình ảnh của OpenAI. Sự kết hợp này cho phép tương tác mượt mà hơn nơi ChatGPT hỗ trợ tạo ra các lời nhắc chính xác cho DALL-E 3, biến ý tưởng của người dùng thành nghệ thuật AI được tạo ra sinh động. Vì vậy, trong khi người dùng có thể tương tác trực tiếp với DALL-E 3, việc có ChatGPT trong hỗn hợp làm cho quá trình tạo nghệ thuật AI trở nên dễ sử dụng hơn nhiều.

Tìm hiểu thêm về DALL-E 3 và tích hợp của nó với ChatGPT tại đây. Sự hợp tác này không chỉ展示 sự tiến bộ trong AI đa phương thức mà còn làm cho việc tạo nghệ thuật AI trở nên dễ dàng cho người dùng.

Google’s health on the other hand introduced Med-PaLM M vào tháng 6 năm nay. Đây là một mô hình tạo ra đa phương thức có khả năng mã hóa và giải thích các dữ liệu sinh học đa dạng. Điều này được thực hiện bằng cách tinh chỉnh PaLM-E, một mô hình ngôn ngữ, để đáp ứng các lĩnh vực y tế bằng cách sử dụng một điểm chuẩn nguồn mở, MultiMedBench. Điểm chuẩn này bao gồm hơn 1 triệu mẫu trên 7 loại dữ liệu sinh học và 14 nhiệm vụ như câu hỏi và trả lời y khoa và tạo báo cáo X-quang.

Các ngành công nghiệp khác nhau đang áp dụng các công cụ AI đa phương thức sáng tạo để thúc đẩy sự mở rộng kinh doanh, tối ưu hóa hoạt động và nâng cao sự tham gia của khách hàng. Sự tiến bộ trong khả năng AI về giọng nói, video và văn bản đang thúc đẩy sự phát triển của AI đa phương thức.

Các doanh nghiệp đang tìm kiếm các ứng dụng AI đa phương thức có khả năng thay đổi các mô hình kinh doanh và quy trình, mở ra các con đường tăng trưởng trên toàn bộ hệ sinh thái AI tạo ra, từ các công cụ dữ liệu đến các ứng dụng AI mới nổi.

Sau khi GPT-4 được ra mắt vào tháng 3, một số người dùng đã quan sát thấy sự suy giảm chất lượng phản hồi của nó theo thời gian, một mối quan ngại được các nhà phát triển nổi tiếng và trên các diễn đàn của OpenAI vang vọng. Ban đầu bị OpenAI bác bỏ, một nghiên cứu sau đó đã xác nhận vấn đề này. Nó tiết lộ sự suy giảm độ chính xác của GPT-4 từ 97,6% xuống 2,4% giữa tháng 3 và tháng 6, cho thấy sự suy giảm chất lượng phản hồi với các bản cập nhật mô hình tiếp theo.

Sự cường điệu xung quanh Open AI’s ChatGPT đã trở lại bây giờ. Nó hiện đi kèm với một tính năng tầm nhìn GPT-4V, cho phép người dùng phân tích hình ảnh được cung cấp bởi họ. Đây là tính năng mới nhất đã được mở cho người dùng.

Việc thêm phân tích hình ảnh vào các mô hình ngôn ngữ lớn (LLM) như GPT-4 được một số người coi là một bước tiến lớn trong nghiên cứu và phát triển AI. Loại LLM đa phương thức này mở ra các khả năng mới, đưa các mô hình ngôn ngữ vượt ra ngoài văn bản để cung cấp các giao diện mới và giải quyết các loại nhiệm vụ mới, tạo ra những trải nghiệm mới cho người dùng.

Việc đào tạo GPT-4V đã được hoàn thành vào năm 2022, với quyền truy cập sớm được tung ra vào tháng 3 năm 2023. Tính năng trực quan trong GPT-4V được cung cấp bởi công nghệ GPT-4. Quá trình đào tạo vẫn giữ nguyên. Ban đầu, mô hình được đào tạo để dự đoán từ tiếp theo trong một văn bản bằng cách sử dụng một tập dữ liệu lớn của cả văn bản và hình ảnh từ các nguồn khác nhau, bao gồm internet.

Sau đó, nó được tinh chỉnh với nhiều dữ liệu hơn, sử dụng một phương pháp gọi là học tăng cường từ phản hồi của con người (RLHF), để tạo ra các đầu ra mà con người thích.

Cơ chế tầm nhìn GPT-4

Khả năng ngôn ngữ tầm nhìn đáng chú ý của GPT-4, mặc dù ấn tượng, có các phương pháp nằm trên bề mặt.

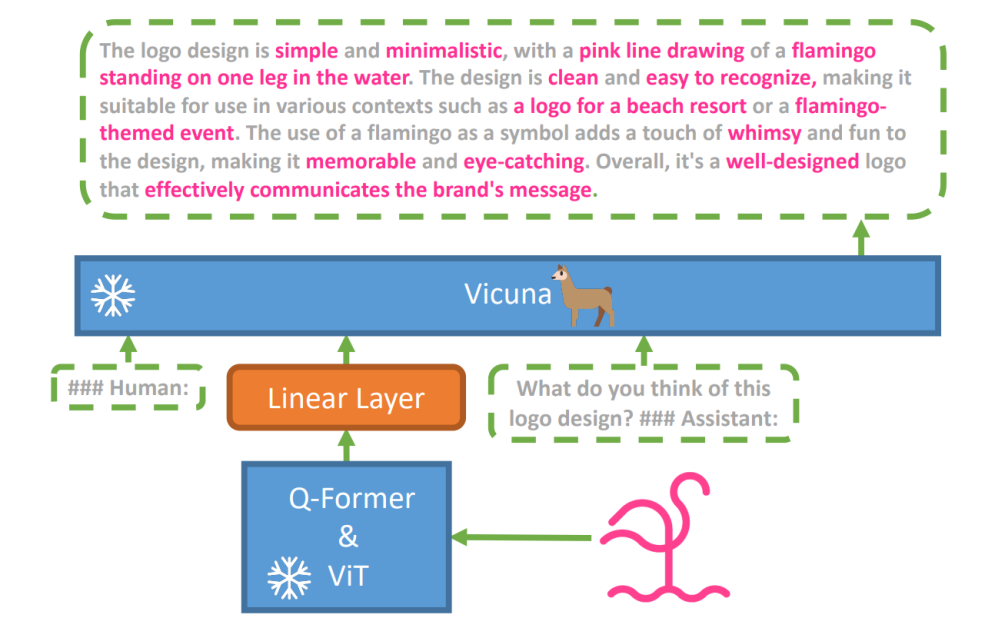

Để khám phá giả thuyết này, một mô hình ngôn ngữ tầm nhìn mới, MiniGPT-4 được giới thiệu, sử dụng một LLM tiên tiến tên là Vicuna. Mô hình này sử dụng một bộ mã hóa tầm nhìn với các thành phần được đào tạo trước cho nhận thức trực quan, căn chỉnh các tính năng trực quan được mã hóa với mô hình ngôn ngữ Vicuna thông qua một lớp chiếu đơn. Kiến trúc của MiniGPT-4 đơn giản nhưng hiệu quả, với trọng tâm là căn chỉnh các tính năng trực quan và ngôn ngữ để cải thiện khả năng trò chuyện trực quan.

Kiến trúc của MiniGPT-4 bao gồm một bộ mã hóa tầm nhìn với ViT và Q-Former được đào tạo trước, một lớp chiếu tuyến tính đơn và một mô hình ngôn ngữ lớn tiên tiến Vicuna.

Xu hướng của các mô hình ngôn ngữ tự hồi quy trong các nhiệm vụ ngôn ngữ-tầm nhìn cũng đã tăng lên, tận dụng chuyển giao chéo mô thức để chia sẻ kiến thức giữa ngôn ngữ và các lĩnh vực đa phương thức.

MiniGPT-4 bắc cầu giữa các lĩnh vực trực quan và ngôn ngữ bằng cách căn chỉnh thông tin trực quan từ một bộ mã hóa tầm nhìn được đào tạo trước với một LLM tiên tiến. Mô hình sử dụng Vicuna làm bộ giải mã ngôn ngữ và tuân theo một phương pháp đào tạo hai giai đoạn. Ban đầu, nó được đào tạo trên một tập dữ liệu lớn của các cặp hình ảnh-văn bản để nắm bắt kiến thức ngôn ngữ-tầm nhìn, sau đó được tinh chỉnh trên một tập dữ liệu nhỏ hơn, chất lượng cao hơn để nâng cao độ tin cậy và khả năng sử dụng của việc tạo ra.

Để cải thiện tính tự nhiên và khả năng sử dụng của ngôn ngữ được tạo ra trong MiniGPT-4, các nhà nghiên cứu đã phát triển một quá trình căn chỉnh hai giai đoạn, giải quyết sự thiếu hụt của các tập dữ liệu căn chỉnh ngôn ngữ-tầm nhìn đầy đủ. Họ đã tạo ra một tập dữ liệu chuyên dụng cho mục đích này.

Ban đầu, mô hình tạo ra các mô tả chi tiết của hình ảnh đầu vào, tăng chi tiết bằng cách sử dụng một lời nhắc trò chuyện được căn chỉnh với định dạng mô hình ngôn ngữ Vicuna.

Lời nhắc mô tả hình ảnh ban đầu:

###Human: <Img><ImageFeature></Img>Mô tả hình ảnh này chi tiết. Cung cấp càng nhiều chi tiết càng tốt. Nói tất cả những gì bạn thấy. ###Assistant:

Đối với xử lý dữ liệu sau, bất kỳ sự không nhất quán hoặc lỗi nào trong các mô tả được tạo ra đã được sửa bằng ChatGPT, sau đó là xác minh thủ công để đảm bảo chất lượng cao.

Lời nhắc tinh chỉnh giai đoạn thứ hai:

###Human: <Img><ImageFeature></Img><Instruction>###Assistant:

Khám phá này mở ra một cửa sổ để hiểu về cơ chế của AI tạo ra đa phương thức như GPT-4, làm sáng tỏ cách các phương thức tầm nhìn và ngôn ngữ có thể được tích hợp hiệu quả để tạo ra các đầu ra nhất quán và phong phú về ngữ cảnh.

Khám phá tầm nhìn GPT-4

Xác định nguồn gốc hình ảnh với ChatGPT

GPT-4 Vision tăng cường khả năng của ChatGPT trong việc phân tích hình ảnh và xác định nguồn gốc địa lý của chúng. Tính năng này chuyển đổi tương tác của người dùng từ chỉ văn bản sang sự kết hợp của văn bản và hình ảnh, trở thành một công cụ tiện lợi cho những người tò mò về các địa điểm khác nhau thông qua dữ liệu hình ảnh.

Khái niệm toán học phức tạp

GPT-4 Vision vượt trội trong việc phân tích các ý tưởng toán học phức tạp bằng cách phân tích các biểu thức đồ họa hoặc viết tay. Tính năng này hoạt động như một công cụ hữu ích cho những người đang tìm cách giải quyết các vấn đề toán học phức tạp, đánh dấu GPT-4 Vision là một công cụ đáng chú ý trong lĩnh vực giáo dục và học thuật.

Chuyển đổi đầu vào viết tay sang mã LaTeX

Một trong những khả năng đáng chú ý của GPT-4V là khả năng dịch đầu vào viết tay thành mã LaTeX. Tính năng này là một lợi ích cho các nhà nghiên cứu, học giả và sinh viên thường cần chuyển đổi biểu thức toán học viết tay hoặc thông tin kỹ thuật khác thành định dạng kỹ thuật số. Sự chuyển đổi từ viết tay sang LaTeX mở rộng tầm nhìn của việc số hóa tài liệu và đơn giản hóa quá trình viết kỹ thuật.

Trích xuất chi tiết bảng

GPT-4V thể hiện kỹ năng trong việc trích xuất chi tiết từ bảng và trả lời các câu hỏi liên quan, một tài sản quan trọng trong phân tích dữ liệu. Người dùng có thể sử dụng GPT-4V để tìm kiếm bảng, thu thập thông tin chính và giải quyết các câu hỏi dựa trên dữ liệu, làm cho nó trở thành một công cụ mạnh mẽ cho các nhà phân tích dữ liệu và các chuyên gia khác.

Hiểu chỉ dẫn trực quan

Khả năng độc đáo của GPT-4V để hiểu chỉ dẫn trực quan thêm một chiều mới vào tương tác của người dùng. Bằng cách hiểu các tín hiệu trực quan, GPT-4V có thể trả lời các câu hỏi với sự hiểu biết ngữ cảnh cao hơn.

Xây dựng trang web mô hình đơn giản bằng cách vẽ

Được truyền cảm hứng bởi bài đăng này, tôi đã cố gắng tạo một mô hình cho trang web unite.ai.

Mặc dù kết quả không hoàn toàn giống với tầm nhìn ban đầu của tôi, nhưng đây là kết quả tôi đã đạt được.

Giới hạn và khiếm khuyết của GPT-4V(iśion)

Để phân tích GPT-4V, nhóm Open AI đã thực hiện các đánh giá định tính và định lượng. Các đánh giá định tính bao gồm các thử nghiệm nội bộ và đánh giá của chuyên gia bên ngoài, trong khi các đánh giá định lượng đo lường việc từ chối của mô hình và độ chính xác trong các kịch bản khác nhau như xác định nội dung có hại, nhận dạng nhân khẩu học, lo ngại về quyền riêng tư, định vị địa lý, an ninh mạng và các cuộc tấn công đa phương thức.

Tuy nhiên, mô hình vẫn không hoàn hảo.

<Tài liệu bài báo làm nổi bật các giới hạn của GPT-4V, như suy luận không chính xác và thiếu văn bản hoặc ký tự trong hình ảnh. Nó có thể ảo giác hoặc tạo ra sự kiện. Đặc biệt, nó không phù hợp để xác định các chất nguy hiểm trong hình ảnh, thường nhầm lẫn chúng.

Trong hình ảnh y tế, GPT-4V có thể cung cấp phản hồi không nhất quán và thiếu nhận thức về các thực hành tiêu chuẩn, dẫn đến chẩn đoán sai.

Hiệu suất không đáng tin cậy cho mục đích y tế (Nguồn)

Nó cũng không thể nắm bắt được các sắc thái của một số biểu tượng thù hận và có thể tạo ra nội dung không phù hợp dựa trên đầu vào trực quan. OpenAI khuyên không nên sử dụng GPT-4V cho các giải thích quan trọng, đặc biệt là trong các ngữ cảnh y tế hoặc nhạy cảm.

Kết thúc

Tạo bằng Fast Stable Diffusion XL https://huggingface.co/spaces/google/sdxl

Sự ra đời của GPT-4 Vision (GPT-4V) mang theo một loạt các khả năng thú vị và những thách thức mới. Trước khi phát hành, rất nhiều nỗ lực đã được đầu tư để đảm bảo rằng các rủi ro, đặc biệt là liên quan đến hình ảnh của con người, được xem xét kỹ lưỡng và giảm thiểu. Thật ấn tượng khi thấy GPT-4V đã tiến bộ, thể hiện nhiều hứa hẹn trong các lĩnh vực khó khăn như y học và khoa học.

Bây giờ, có một số câu hỏi lớn trên bàn. Ví dụ, những mô hình này có nên có khả năng xác định các cá nhân nổi tiếng từ ảnh không? Chúng có nên đoán giới tính, chủng tộc hoặc cảm xúc của một người từ một bức ảnh không? Và, có nên có những điều chỉnh đặc biệt để hỗ trợ người khiếm thị không? Những câu hỏi này mở ra một hộp Pandora về quyền riêng tư, công bằng và cách AI nên phù hợp với cuộc sống của chúng ta, điều mà mọi người nên có ý kiến.