Trí tuệ nhân tạo

Giới Thiệu Về Vertex AI

Trong bối cảnh trí tuệ nhân tạo đang phát triển nhanh chóng, một trong những thách thức lớn nhất mà các nhà lãnh đạo công nghệ thường gặp phải là chuyển đổi từ “thử nghiệm” sang “sẵn sàng cho doanh nghiệp”. Trong khi các rô-bốt trò chuyện và nền tảng tương tác giúp với tưởng tượng công cộng, các doanh nghiệp không thể thành công chỉ với một giao diện trò chuyện. Trong một thời đại mà cạnh tranh trở nên hung hãn hơn bao giờ hết, các doanh nghiệp cần một hệ sinh thái mạnh mẽ, có khả năng mở rộng và bảo mật, và đây là những gì Google cố gắng cung cấp với Vertex AI, nền tảng trí tuệ nhân tạo và học máy thống nhất của Google Cloud.

Vertex AI cố gắng củng cố vị trí của mình là xương sống cho tích hợp trí tuệ tạo sinh với cơ sở hạ tầng đám mây hiện đại, cung cấp một bộ tính năng toàn diện giúp bắc cầu giữa các mô hình nền tảng thô và các ứng dụng cấp sản xuất. Vertex AI không chỉ là một lớp vỏ cho các mô hình ngôn ngữ lớn (LLM), mà nó là một hệ sinh thái học máy và trí tuệ nhân tạo (ML/AI) thống nhất coi trí tuệ tạo sinh là một công dân hạng nhất của cơ sở hạ tầng đám mây hiện đại.

Ở trung tâm của Vertex AI là Model Garden, một thị trường trung tâm cung cấp quyền truy cập vào hơn 200 mô hình nền tảng được kiểm định, bao gồm cả Gemini 2.5 Pro, một mô hình đa phương thức mạnh mẽ với cửa sổ ngữ cảnh 2 triệu token. Trong bài viết này, chúng tôi sẽ phân tích kiến trúc của Vertex AI, khám phá cách Model Garden hoạt động như “Cửa hàng ứng dụng” cho trí tuệ, và xem xét các cột kỹ thuật làm cho nền tảng này trở thành xương sống của thế hệ phần mềm doanh nghiệp tiếp theo.

Cấu Trúc Cốt Lõi : Một Nền Tảng Thống Nhất

Vertex AI không phải là một tập hợp các công cụ rời rạc, mà là một hệ sinh thái dữ liệu và trí tuệ thống nhất được thiết kế để bắc cầu sự phân mảnh của dữ liệu, công cụ và đội ngũ mà vẫn còn tồn tại trong học máy cho đến ngày nay. Thông thường, phát triển AI diễn ra trong các môi trường bị cô lập, và đôi khi, dữ liệu được phân tán và bị mắc kẹt trên nhiều kho lưu trữ. Ví dụ, các tổ chức có thể lưu trữ dữ liệu khách hàng trong các nhà kho SQL trong khi các tài liệu không có cấu trúc được đổ vào một Hồ dữ liệu. Khi dữ liệu bị cô lập, AI chỉ nhìn thấy “sự thật một phần”, dẫn đến kết quả bị thiên vị hoặc tỷ lệ ảo cao vì nó thiếu bối cảnh đầy đủ của doanh nghiệp.

Vertex AI cố gắng tích hợp toàn bộ vòng đời, từ việc nhập dữ liệu thô trong BigQuery và Cloud Storage đến giám sát sản xuất, về cơ bản đóng vai trò là “mô liên kết” giữa các silo này. Vertex AI tích hợp bản địa với Cloud Storage và BigQuery, cho phép các mô hình AI thu thập dữ liệu mà không cần các đường ống phức tạp để trích xuất, biến đổi và tải dữ liệu.

Cơ Sở : Siêu Máy Tính Trí Tuệ Của Google

Lớp GenAI của Vertex AI nằm trên kiến trúc siêu máy tính trí tuệ của Google, một hệ thống siêu máy tính tích hợp, bao gồm:

TPU v5p & v5e (Đơn Vị Xử Lý Tensor)

Đơn vị xử lý tensor của Google là các ASIC (Vi mạch tích hợp ứng dụng cụ thể) được thiết kế đặc biệt cho phép nhân ma trận xác định học sâu.

- TPU v5p (Hiệu Suất): Đây là bộ tăng tốc cỡ lớn cho việc đào tạo quy mô lớn. Mỗi pod TPU v5p có thể mở rộng đến 8.960 chip được kết nối bởi Inter-Chip Interconnect (ICI) có băng thông cao nhất của Google ở 4.800 Gbps. Đối với một nhà lãnh đạo công nghệ, điều này có nghĩa là đào tạo nhanh hơn 2,8 lần cho một mô hình cỡ GPT-3 (175B tham số) so với thế hệ trước, giảm đáng kể thời gian đưa ra thị trường.

- TPU v5e (Hiệu Quả): Được thiết kế cho hiệu suất “tối ưu hóa chi phí”, v5e là công cụ cho đào tạo quy mô trung và suy luận với lưu lượng cao. Nó cung cấp hiệu suất giá cả tốt hơn lên đến 2,5 lần, khiến nó trở thành lựa chọn lý tưởng cho các doanh nghiệp cần chạy suy luận 24/7 mà không cần ngân sách lớn.

NVIDIA H100/A100 GPUs cho Linh Hoạt

Trong khi TPU được chuyên dụng, nhiều đội phát triển phụ thuộc vào hệ sinh thái NVIDIA CUDA. Vertex AI cung cấp hỗ trợ cấp một cho phần cứng mới nhất của NVIDIA:

- NVIDIA H100 (Hopper): Lý tưởng cho việc tinh chỉnh các mô hình mã nguồn mở lớn nhất (như Llama 3.1 405B) đòi hỏi băng thông bộ nhớ khổng lồ.

- Mạng Jupiter: Để ngăn chặn “Điểm nghẽn mạng”, Google sử dụng vải mạng trung tâm dữ liệu Jupiter. Điều này đảm bảo dữ liệu di chuyển giữa các GPU với tốc độ cực nhanh, hỗ trợ RDMA (Truy cập bộ nhớ trực tiếp từ xa) để bỏ qua sự quá tải của CPU và cung cấp hiệu suất gần như cục bộ trên các nút phân tán.

Orchestration Động

Sự thay đổi kỹ thuật quan trọng nhất trong Vertex AI là Orchestration Động. Trong một môi trường di sản, nếu một nút GPU bị lỗi trong quá trình đào tạo 3 tuần, toàn bộ công việc có thể bị sập.

- Khả Năng Tự Phục Hồi: Vertex AI, thường được cung cấp bởi Google Kubernetes Engine (GKE) dưới mui, có các nút “tự chữa lành”. Nếu một lỗi phần cứng được phát hiện, nền tảng sẽ tự động di chuyển tải trọng công việc sang một nút khỏe mạnh.

- Lập Trình Suy Luận Động: Công cụ này cho phép các đội yêu cầu khả năng dựa trên mức độ khẩn cấp. Bạn có thể chọn Bắt đầu Linh Hoạt (rẻ hơn, bắt đầu khi khả năng sẵn sàng) hoặc Khả Năng Đảm Bảo cho các bản phát hành quan trọng.

- Đào Tạo Không Cần Máy Chủ: Đối với các đội muốn quản lý cơ sở hạ tầng bằng không, Vertex AI Đào Tạo Không Cần Máy Chủ cho phép bạn gửi mã và dữ liệu của mình; nền tảng cung cấp cụm, chạy công việc và tháo dỡ nó – chỉ tính phí cho các giây tính toán được sử dụng.

Ba Điểm Nhập Cảnh: Khám Phá, Thử Nghiệm và Tự Động Hóa

Để phù hợp với các nhân vật kỹ thuật khác nhau – từ các nhà khoa học dữ liệu đến các nhà phát triển ứng dụng – Vertex AI cung cấp ba điểm nhập cảnh chính:

- Model Garden: Cửa Hàng cho Khám Phá.

- Vertex AI Studio: Sân Chơi cho Thử Nghiệm.

- Vertex AI Agent Builder: Nhà Máy cho Tự Động Hóa.

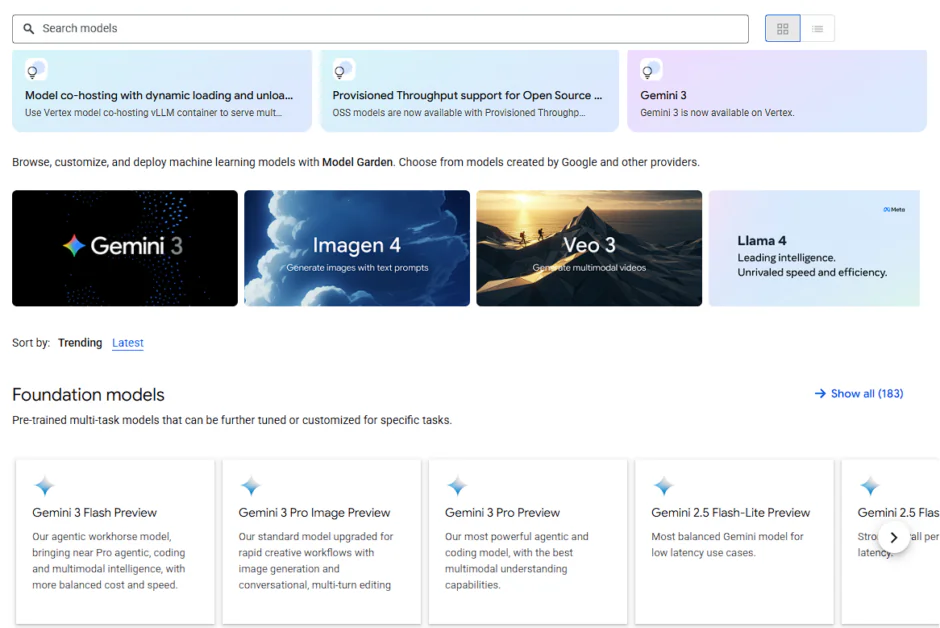

Model Garden: Cửa Hàng cho Khám Phá

Model Garden của Google Cloud là một nền tảng tập trung trong Google Cloud để khám phá, thử nghiệm, tùy chỉnh và triển khai một loạt các mô hình trí tuệ nhân tạo đầu tiên, nguồn mở và của bên thứ ba, bao gồm cả đa phương thức (hình ảnh, văn bản, mã) cho các nhu cầu kinh doanh khác nhau, cung cấp tích hợp liền mạch với các công cụ của Vertex AI cho MLOps được sắp xếp hợp lý. Nó hoạt động như một thư viện toàn diện, giúp các nhà phát triển và doanh nghiệp chọn mô hình phù hợp (từ các mô hình nền tảng lớn đến các mô hình chuyên dụng) cho các nhiệm vụ của họ, cho dù đó là tạo văn bản, phân tích hình ảnh hay hoàn thành mã, và triển khai chúng một cách hiệu quả trong môi trường Google Cloud của họ.

Model Garden phân loại các mô hình của mình thành ba cấp độ riêng biệt, cho phép các kiến trúc sư cân bằng hiệu suất, chi phí và kiểm soát:

- Mô Hình Đầu Tiên (Google): Đây là các mô hình đa phương thức hàng đầu có sẵn trong Vertex AI, và Google cung cấp chúng ở các kích cỡ khác nhau, từ Pro với lý luận phức tạp đến Flash với độ trễ thấp và khối lượng lớn, cho phép các nhà phát triển tối ưu hóa mô hình của họ theo các trường hợp sử dụng của họ.

- Mô Hình Bên Thứ Ba (Độc Quyền): Thông qua các đối tác chiến lược, Vertex AI cung cấp quyền truy cập “Mô Hình như một Dịch Vụ” (MaaS) vào các ông lớn như Anthropic (Claude 3.5) và Mistral AI. Thay vì quản lý các thông tin thanh toán và bảo mật riêng biệt cho năm nhà cung cấp AI khác nhau, một đội công nghệ có thể truy cập tất cả chúng thông qua dự án Google Cloud hiện có của họ, sử dụng định dạng API thống nhất.

- Mô Hình Nguồn Mở & Trọng Lượng Mở: Cấp độ này bao gồm Meta’s Llama 3.2, Mistral, và mô hình Gemma của chính Google. Những mô hình này lý tưởng cho các tổ chức muốn tự triển khai mô hình trong VPC (Mạng riêng ảo) của riêng họ để đảm bảo sự cách ly dữ liệu tối đa.

Trong một môi trường không thống nhất, việc triển khai một mô hình mã nguồn mở như Llama đòi hỏi thiết lập môi trường PyTorch, cấu hình trình điều khiển CUDA và quản lý một lớp bọc Flask hoặc FastAPI.

Model Garden loại bỏ giai đoạn “Munging” này thông qua Điểm Kết Nối Quản Lý Thống Nhất:

- Triển Khai Một Cú Nhấp Chuột: Đối với nhiều mô hình, nhấp vào “Triển Khai” tự động cung cấp các tài nguyên TPU/GPU cần thiết, quấn mô hình trong một容器 sẵn sàng cho sản xuất và cung cấp một điểm cuối API REST.

- Tích Hợp Hugging Face: Vertex AI hiện cho phép các nhà phát triển triển khai mô hình trực tiếp từ Hugging Face Hub vào một điểm cuối Vertex, cung cấp sự mở rộng gần như vô tận của trí tuệ có sẵn.

- Kết Nối Dịch Vụ Riêng: Đối với các ngành công nghiệp có quy định cao, mô hình có thể được triển khai bằng Kết Nối Dịch Vụ Riêng, đảm bảo điểm cuối mô hình không bao giờ được lộ ra internet công cộng – giữ lưu lượng dữ liệu nghiêm ngặt trong mạng doanh nghiệp.

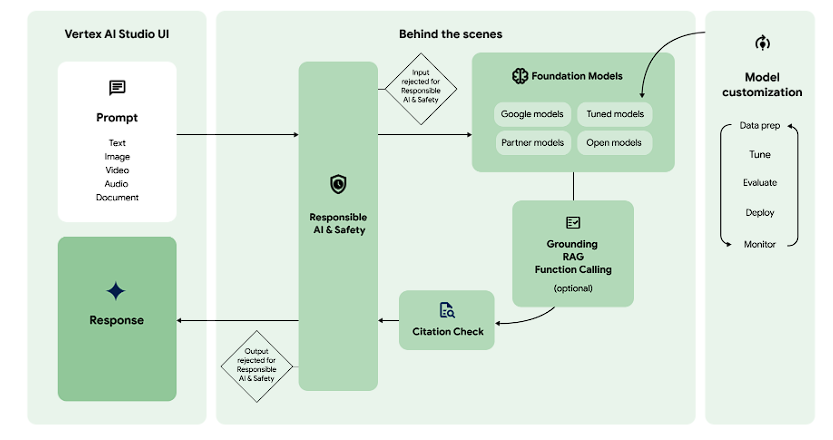

Vertex AI Studio: Sân Chơi cho Thử Nghiệm

Trong khi Model Garden là về việc lựa chọn, Vertex AI Studio là về chính xác. Vertex AI Studio có thể được so sánh với các trình biên dịch và gỡ lỗi mà bạn gặp phải trong thế giới phần mềm truyền thống. Vertex AI Studio là không gian làm việc nơi các mô hình thô được điêu khắc thành các công cụ kinh doanh cụ thể thông qua sự kết hợp của kỹ thuật nhắc, kiểm tra đa phương thức và điều chỉnh siêu tham số tiên tiến.

Nguyên Mẫu Đa Phương Thức: Vượt Ra Ngoài Văn Bản

Một trong những tính năng nổi bật của Studio là hỗ trợ bản địa cho đa phương thức. Trong khi các nền tảng khác yêu cầu mã hóa phức tạp để xử lý dữ liệu phi văn bản, Vertex AI Studio cho phép bạn thả tệp trực tiếp vào giao diện để kiểm tra khả năng lý luận Gemini 2.5.

- Trí Tuệ Video: Bạn có thể tải lên một bài nói chuyện kỹ thuật 45 phút và yêu cầu mô hình “xác định mọi lần một API cụ thể được đề cập và cung cấp một bản tóm tắt có dấu thời gian.”

- Phân Tích Tài Liệu: Thay vì chỉ đọc văn bản, mô hình có thể phân tích bố cục trực quan của một tệp PDF 1.000 trang, hiểu mối quan hệ giữa các biểu đồ, bảng và văn bản xung quanh.

- Thực Thi Mã: Studio hiện hỗ trợ thực thi mã trong sân chơi. Nếu bạn yêu cầu mô hình giải quyết một vấn đề toán học phức tạp hoặc phân tích một tệp CSV, mô hình có thể viết và thực thi mã Python trong một môi trường cát bị cô lập để cung cấp một câu trả lời đã được xác minh.

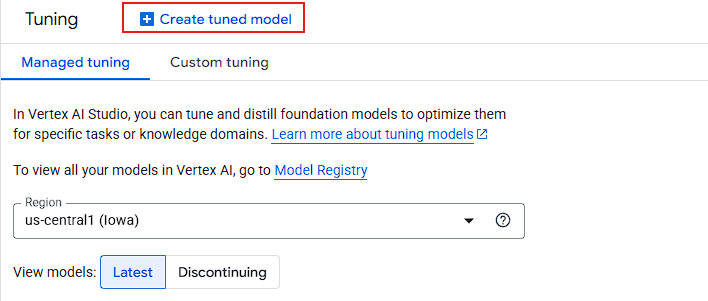

Tùy Chỉnh Tiên Tiến: Con Đường Điều Chỉnh

Khi kỹ thuật nhắc (Zero-shot hoặc Few-shot) đạt đến giới hạn, Vertex AI Studio cung cấp máy móc hạng nặng: Điều Chỉnh Mô Hình.

- Đào Tạo Fine (SFT): Các nhà phát triển cung cấp một tập dữ liệu các cặp “Nhắc / Phản Hồi” (lý tưởng là 100+ ví dụ). Điều này dạy cho mô hình cách áp dụng một giọng nói thương hiệu cụ thể, định dạng đầu ra (như JSON chuyên dụng) hoặc từ ngữ chuyên ngành.

- Đệm Caching: Đối với các doanh nghiệp xử lý các tập dữ liệu tĩnh khổng lồ (như một thư viện pháp lý hoặc một cơ sở mã), Studio cho phép Đệm Caching. Điều này cho phép bạn “nạp trước” một triệu token dữ liệu vào bộ nhớ của mô hình, giảm đáng kể độ trễ và chi phí cho các truy vấn tiếp theo.

- Chưng Cất (Giáo Viên – Học Sinh): Đây là một động thái kiến trúc cấp cao. Bạn có thể sử dụng một mô hình khổng lồ (Gemini 2.5 Pro) để “dạy” một mô hình nhỏ hơn, nhanh hơn (Gemini 2.0 Flash). Kết quả là một mô hình nhẹ thực hiện ở mức “Pro” nhưng chạy ở tốc độ và chi phí “Flash”.

Vertex AI Agent Builder: Nhà Máy cho Tự Động Hóa

Vertex AI Agent Builder là một khuôn khổ dàn xếp cấp cao cho phép các nhà phát triển tạo ra các tác nhân này bằng cách kết hợp các mô hình nền tảng với dữ liệu doanh nghiệp và API bên ngoài.

Kiến Trúc của “Sự Thật”: Nền Móng và RAG

Rào cản kỹ thuật chính đối với AI doanh nghiệp là ảo giác. Agent Builder giải quyết điều này thông qua một động cơ Nền Móng tinh vi.

- Nền Móng với Tìm Kiếm Google: Đối với các truy vấn đòi hỏi kiến thức thế giới theo thời gian thực (ví dụ, “Lãi suất thế chấp hiện tại ở New York là gì?”), tác nhân có thể thực hiện tìm kiếm Google, trích xuất các sự kiện và trích dẫn nguồn.

- Tìm Kiếm Vertex AI (Dịch Vụ RAG): Thay vì xây dựng một cơ sở dữ liệu vector (Pinecone, Weaviate) theo cách thủ công, các nhà phát triển có thể sử dụng Tìm Kiếm Vertex AI để lập chỉ mục các tài liệu của riêng họ (PDF, HTML, BigQuery). Nó xử lý các bước “phân mảnh”, “nhúng” và “truy xuất” tự động, đảm bảo tác nhân chỉ trả lời dựa trên “Nguồn Sự Thật” nội bộ của bạn.

- Động Cơ RAG của Vertex AI: Đối với các triển khai tùy chỉnh quy mô lớn, dịch vụ được quản lý này cho phép tìm kiếm hỗn hợp (kết hợp kết quả dựa trên vector và từ khóa) để cải thiện độ chính xác lên đến 30% so với đầu ra LLM tiêu chuẩn.

Orchestration Đa Tác Nhân (Giao Thức A2A)

Các quy trình làm việc doanh nghiệp tiên tiến thường đòi hỏi nhiều tác nhân chuyên dụng làm việc cùng nhau. Vertex AI giới thiệu Giao Thức Tác Nhân sang Tác Nhân (A2A), một tiêu chuẩn mở cho phép:

- “Tác Nhân Du Lịch” nói chuyện với “Tác Nhân Tài Chính” để đảm bảo việc đặt vé máy bay nằm trong ngân sách của công ty.

- Tính Liên Operability: Bởi vì nó sử dụng một giao thức mở, các tác nhân được xây dựng trên Vertex có thể giao tiếp với những tác nhân được xây dựng trên các khuôn khổ khác như LangChain hoặc CrewAI.

Đống Phát Triển: ADK và Động Cơ Tác Nhân

Đối với “khán giả nền tảng”, Agent Builder cung cấp hai con đường riêng biệt:

- Console Không Cần Mã: Một giao diện kéo và thả trực quan cho nguyên mẫu nhanh và cấu hình người dùng kinh doanh.

- Bộ Phát Triển Tác Nhân (ADK): Một bộ công cụ mã đầu tiên cho các kỹ sư. Nó cho phép “Nhắc như Mã”, tích hợp kiểm soát phiên bản và khả năng triển khai đến Động Cơ Tác Nhân Vertex AI—một thời gian chạy được quản lý xử lý sự duy trì phiên, khả năng mở rộng và quản lý trạng thái tự động.

Kết Luận: Từ “Giả Sử” đến “Tiếp Theo”

Chuyển đổi từ một bản demo AI ấn tượng sang một ứng dụng doanh nghiệp cấp sản xuất đã lâu là “thung lũng chết” cho các dự án chuyển đổi số. Như chúng ta đã khám phá, Vertex AI được thiết kế cụ thể để bắc cầu khoảng cách này. Bằng cách thống nhất các silo phân mảnh của dữ liệu, cơ sở hạ tầng và dàn xếp mô hình, Google Cloud đã chuyển cuộc trò chuyện từ sức mạnh thô của các mô hình ngôn ngữ lớn và hướng đến chất lượng hoạt động của chu kỳ sống AI.