Trí tuệ nhân tạo

Công nghệ tạo mặt nạ hình ảnh AI hiểu cảnh

Trong phim tài liệu kèm theo bản phát hành DVD năm 2003 của Alien3 (1992), huyền thoại hiệu ứng hình ảnh Richard Edlund nhớ lại với sự kinh hoàng về ‘đấu sumo’ của quá trình trích xuất mặt nạ photochemical mà thống trị công việc hiệu ứng hình ảnh giữa cuối những năm 1930 và cuối những năm 1980. Edlund mô tả quá trình này là ‘đấu sumo’, so với kỹ thuật màn hình xanh / xanh lá cây kỹ thuật số đã tiếp quản vào đầu những năm 1990 (và ông đã trở lại với ẩn dụ kể từ đó).

Trích xuất một yếu tố tiền cảnh (chẳng hạn như một người hoặc một mô hình tàu vũ trụ) từ một nền, để hình ảnh cắt ra có thể được tổng hợp vào một tấm nền, ban đầu được thực hiện bằng cách quay phim đối tượng tiền cảnh chống lại một nền thống nhất màu xanh hoặc màu xanh lá cây.

Quá trình trích xuất photochemical phức tạp cho một shot VFX của ILM cho ‘Return of the Jedi’ (1983). Nguồn: https://www.youtube.com/watch?v=qwMLOjqPmbQ

Trong đoạn phim kết quả, màu nền sẽ được phân lập hóa học và sử dụng như một mẫu để in lại đối tượng tiền cảnh (hoặc người) trong một máy in quang học như một đối tượng ‘lồng’ trong một tế bào phim trong suốt.

Quá trình này được gọi là lớp phủ tách màu (CSO) – mặc dù thuật ngữ này cuối cùng sẽ trở nên gắn liền với hiệu ứng video thô ‘Chromakey’ trong sản xuất truyền hình thấp hơn của những năm 1970 và 1980, được thực hiện bằng phương tiện tương tự chứ không phải hóa học hoặc kỹ thuật số.

Một bản demo của Color Separation Overlay vào năm 1970 cho chương trình trẻ em Anh ‘Blue Peter’. Nguồn: https://www.bbc.co.uk/archive/blue_peter_noakes_CSO/zwb9vwx

Trong mọi trường hợp, cho dù là đối với các yếu tố phim hay video, sau đó đoạn phim trích xuất có thể được chèn vào bất kỳ đoạn phim nào khác.

Mặc dù quá trình natri-vapor độc quyền của Disney đáng chú ý hơn và đắt tiền hơn (được chìa khóa trên màu vàng, cụ thể, và cũng được sử dụng cho bộ phim kinh dị năm 1963 của Alfred Hitchcock The Birds) cho định nghĩa và mặt nạ sắc nét hơn, nhưng trích xuất photochemical vẫn còn phức tạp và không đáng tin cậy.

Quá trình trích xuất natri-vapor độc quyền của Disney yêu cầu nền gần cuối phổ màu. Ở đây, Angela Lansbury được treo trên dây trong quá trình sản xuất một chuỗi VFX cho ‘Bedknobs and Broomsticks’ (1971). Nguồn

Beyond Digital Matting

Trong những năm 1990, cuộc cách mạng kỹ thuật số đã loại bỏ các hóa chất, nhưng không phải là nhu cầu về màn hình xanh. Giờ đây, có thể loại bỏ nền màu xanh (hoặc bất kỳ màu nào) chỉ bằng cách tìm kiếm các pixel trong phạm vi dung sai của màu đó, trong phần mềm chỉnh sửa pixel như Photoshop, và một thế hệ mới của các bộ tổng hợp video có thể tự động loại bỏ nền màu.

Gần như ngay lập tức, sáu mươi năm của ngành công nghiệp in quang học đã bị consigned vào lịch sử.

Mười năm cuối cùng của nghiên cứu tầm nhìn máy tính tăng tốc GPU đang đưa trích xuất mặt nạ vào một thời đại thứ ba, giao nhiệm vụ cho các nhà nghiên cứu phát triển các hệ thống có thể trích xuất mặt nạ chất lượng cao mà không cần màn hình xanh. Tại Arxiv alone, các bài báo liên quan đến các đổi mới trong trích xuất tiền cảnh dựa trên học máy là một tính năng hàng tuần.

Putting Us in the Picture

Điểm tập trung này của sự quan tâm học thuật và công nghiệp trong trích xuất AI đã ảnh hưởng đến không gian người tiêu dùng: các thực hiện thô nhưng có thể hoạt động trong hình thức của Zoom và Skype bộ lọc có thể thay thế nền phòng khách của chúng tôi với các hòn đảo nhiệt đới, v.v., trong các cuộc gọi hội nghị video.

Tuy nhiên, các mặt nạ tốt nhất vẫn yêu cầu một màn hình xanh, như Zoom lưu ý vào tuần trước.

Trái, một người đàn ông trước một màn hình xanh, với tóc được trích xuất tốt qua tính năng Nền ảo của Zoom. Phải, một người phụ nữ trước một cảnh bình thường, với tóc được trích xuất thuật toán, ít chính xác hơn, và với yêu cầu tính toán cao hơn. Nguồn: https://support.zoom.us/hc/en-us/articles/210707503-Changing-your-Virtual-Background-image

Một bài đăng thêm từ nền tảng Hỗ trợ Zoom cảnh báo rằng trích xuất không màn hình xanh cũng yêu cầu nhiều năng lực tính toán hơn trong thiết bị thu.

The Need to Cut It Out

Cải thiện chất lượng, tính di động và kinh tế tài nguyên cho các hệ thống trích xuất mặt nạ ‘trong tự nhiên’ (tức là cách ly người mà không cần màn hình xanh) là相关 đến nhiều lĩnh vực và追求 hơn là chỉ bộ lọc hội nghị video.

Đối với phát triển tập dữ liệu, nhận dạng khuôn mặt, đầu và cơ thể chính xác hơn cung cấp khả năng đảm bảo rằng các yếu tố nền không được đào tạo vào các mô hình tầm nhìn máy tính của các đối tượng người, và cách ly chính xác hơn sẽ cải thiện đáng kể phân khúc ngữ nghĩa các kỹ thuật được thiết kế để phân biệt và đồng hóa các lĩnh vực (tức là ‘mèo’, ‘người’, ‘tàu’), và cải thiện VAE và transformer-dựa trên hệ thống tổng hợp hình ảnh như OpenAI mới DALL-E 2; và các thuật toán trích xuất tốt hơn sẽ giảm nhu cầu về rotoscoping thủ công tốn kém trong các đường ống VFX tốn kém.

Trên thực tế, sự thống trị của đa phương thức (thường là văn bản / hình ảnh) phương pháp, nơi một lĩnh vực như ‘mèo’ được mã hóa cả dưới dạng hình ảnh và với các tham chiếu văn bản liên quan, đã làm cho việc xử lý hình ảnh trở nên dễ dàng hơn. Một ví dụ gần đây là Text2Live kiến trúc, sử dụng đào tạo đa phương thức (văn bản / hình ảnh) để tạo video của, trong số nhiều khả năng khác, thủy tinh và thủy tinh.

Scene-Aware AI Matting

Một lượng lớn nghiên cứu về mặt nạ tự động dựa trên AI đã tập trung vào nhận dạng biên giới và đánh giá của các nhóm pixel dựa trên pixel trong một hình ảnh hoặc khung hình video. Tuy nhiên, nghiên cứu mới từ Trung Quốc cung cấp một đường ống trích xuất cải thiện sự phân chia và chất lượng mặt nạ bằng cách tận dụng mô tả văn bản của một cảnh (một phương pháp đa phương thức đã đạt được lực kéo trong lĩnh vực nghiên cứu tầm nhìn máy tính trong 3-4 năm qua), tuyên bố đã cải thiện trên các phương pháp trước đó theo nhiều cách.

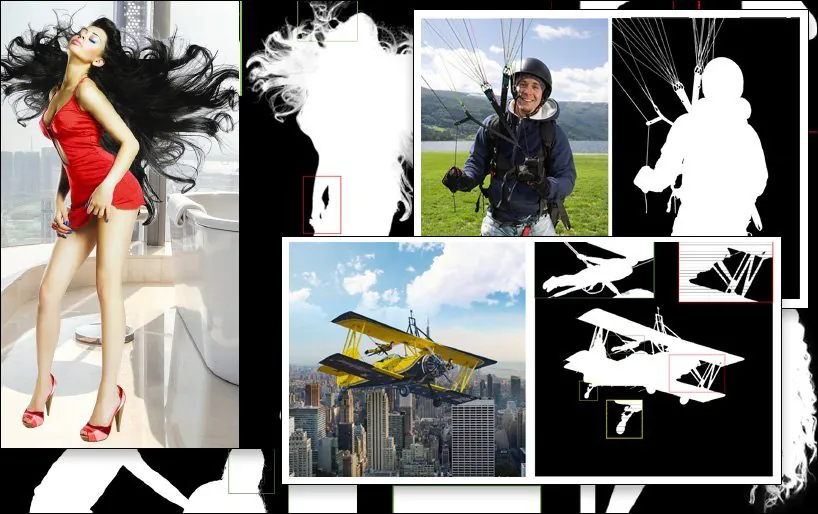

Một ví dụ trích xuất SPG-IM (hình cuối cùng, phía dưới bên phải), so với các phương pháp trước đó. Nguồn: https://arxiv.org/pdf/2204.09276.pdf

Thách thức được đặt ra cho phân khúc nghiên cứu trích xuất là sản xuất các công việc đòi hỏi sự can thiệp tối thiểu của con người – lý tưởng, không có.

Ngoài ra, các nhà nghiên cứu của bài báo mới quan sát thấy rằng các chú thích và phân khúc thủ công được thực hiện bởi các công nhân đông đảo trên các nền văn hóa khác nhau có thể gây ra hình ảnh được dán nhãn hoặc thậm chí phân khúc theo các cách khác nhau, dẫn đến các thuật toán không nhất quán và không thỏa mãn.

Một ví dụ về điều này là sự giải thích chủ quan về định nghĩa ‘đối tượng tiền cảnh’:

Từ bài báo mới: các phương pháp trước đó LFM và MODNet (‘GT’ biểu thị Ground Truth, một kết quả ‘lý tưởng’ thường đạt được thủ công hoặc bằng các phương pháp phi thuật toán), có các cách tiếp cận khác nhau và hiệu quả khác nhau về định nghĩa của nội dung tiền cảnh, trong khi phương pháp SPG-IM mới phân chia ‘nội dung gần’ thông qua ngữ cảnh cảnh một cách hiệu quả hơn.

Để giải quyết vấn đề này, các nhà nghiên cứu đã phát triển một đường ống hai giai đoạn có tên Situational Perception Guided Image Matting (SPG-IM). Kiến trúc mã hóa / giải mã hai giai đoạn bao gồm Situational Perception Distillation (SPD) và Situational Perception Guided Matting (SPGM).

Trước hết, SPD tiền huấn luyện các biến đổi tính năng trực quan-văn bản, tạo ra các chú thích phù hợp với hình ảnh liên quan của chúng. Sau đó, dự đoán mặt nạ tiền cảnh được kích hoạt bằng cách kết nối đường ống với một kỹ thuật dự đoán sự chú ý mới.

Sau đó SPGM đầu ra một mặt nạ alpha ước tính dựa trên đầu vào hình ảnh RGB thô và mặt nạ được tạo ra trong mô-đun đầu tiên.

Mục tiêu là hướng dẫn nhận thức tình huống, trong đó hệ thống có hiểu biết ngữ cảnh về những gì hình ảnh bao gồm, cho phép nó đặt khuôn khổ – ví dụ, thách thức của việc trích xuất tóc phức tạp từ nền so với các đặc điểm đã biết của một nhiệm vụ cụ thể.

Trong ví dụ dưới đây, SPG-IM hiểu rằng các dây là nội tại của một ‘đàn áp’, nơi MODNet không giữ và định nghĩa các chi tiết này. Tương tự như trên, cấu trúc hoàn chỉnh của thiết bị sân chơi bị mất một cách tùy ý trong MODNet.

Bài báo mới có tiêu đề Situational Perception Guided Image Matting, và đến từ các nhà nghiên cứu tại Viện Nghiên cứu OPPO, PicUp.ai, và Xmotors.

Intelligent Automated Mattes

SPG-IM cũng cung cấp một Mạng tinh chỉnh Adaptive Focal Transformation (AFT) có thể xử lý các chi tiết cục bộ và ngữ cảnh toàn cầu riêng biệt, tạo điều kiện cho ‘mặt nạ thông minh’.

Hiểu biết ngữ cảnh cảnh, trong trường hợp này là ‘cô gái với ngựa’, có thể làm cho việc trích xuất tiền cảnh dễ dàng hơn so với các phương pháp trước đó.

Bài báo tuyên bố:

‘Chúng tôi tin rằng các biểu diễn trực quan từ nhiệm vụ trực quan-văn bản, chẳng hạn như chú thích hình ảnh, tập trung vào các tín hiệu ngữ nghĩa toàn diện hơn giữa a) đối tượng với đối tượng và b) đối tượng với môi trường xung quanh để tạo ra các mô tả có thể bao gồm cả thông tin toàn cầu và chi tiết cục bộ. Ngoài ra, so với chú thích pixel tốn kém của mặt nạ hình ảnh, các nhãn văn bản có thể được thu thập với chi phí rất thấp.’

Kiến trúc SPD của đường ống được tiền huấn luyện cùng với bộ giải mã văn bản dựa trên transformer của Đại học Michigan VirTex, học các biểu diễn trực quan từ các chú thích ngữ nghĩa dày.

VirTex huấn luyện chung một ConvNet và Transformers thông qua các cặp hình ảnh-chú thích, và chuyển các kiến thức thu được sang các nhiệm vụ tầm nhìn xuống dòng như phát hiện đối tượng. Nguồn: https://arxiv.org/pdf/2006.06666.pdf

Trong số các thử nghiệm và nghiên cứu cắt bỏ khác, các nhà nghiên cứu đã kiểm tra SPG-IM chống lại các phương pháp dựa trên trimap hàng đầu trimap, Deep Image Matting (DIM), IndexNet, Context-Aware Image Matting (CAM), Guided Contextual Attention (GCA) , FBA, và Semantic Image Mapping (SIM).

Các khuôn khổ trước đó được kiểm tra bao gồm các phương pháp miễn phí trimap LFM, HAttMatting, và MODNet. Để so sánh công bằng, các phương pháp kiểm tra được điều chỉnh dựa trên các phương pháp khác nhau; nơi mã không có sẵn, các kỹ thuật của bài báo được tái tạo từ kiến trúc được mô tả.

Bài báo mới tuyên bố:

‘Mô hình SPG-IM của chúng tôi vượt trội so với tất cả các phương pháp miễn phí trimap cạnh tranh ([LFM], [HAttMatting], và [MODNet]) với một khoảng cách lớn. Trong khi đó, mô hình của chúng tôi cũng thể hiện sự vượt trội đáng kể so với các phương pháp dựa trên trimap và mask-guided hàng đầu về tất cả bốn chỉ số trên các tập dữ liệu công khai (tức là Composition-1K, Distinction-646, và Human-2K), và tập dữ liệu Multi-Object-1K của chúng tôi.’

Và tiếp tục:

‘Có thể quan sát rõ ràng rằng phương pháp của chúng tôi bảo tồn các chi tiết tốt (ví dụ: các điểm đầu tóc, kết cấu trong suốt, và biên giới) mà không cần hướng dẫn của trimap. Hơn nữa, so với các mô hình miễn phí trimap cạnh tranh khác, SPG-IM của chúng tôi có thể giữ lại sự hoàn chỉnh ngữ nghĩa toàn cầu tốt hơn.’

Được xuất bản lần đầu vào ngày 24 tháng 4 năm 2022.