Góc nhìn Anderson

Cảm Hứng Thập Niên 1970 Cho Giám Sát AI Tiết Kiệm Năng Lượng

Nghiên cứu mới cho thấy hầu hết AI video hoàn toàn không cần màu sắc, chỉ bật màu vào những thời điểm then chốt và cắt giảm hơn 90% lượng dữ liệu sử dụng với độ chính xác hầu như không suy giảm.

Camera phát trực tuyến từ xa và các thiết bị video chạy pin, không dây khác đòi hỏi các thiết lập giám sát được tối ưu hóa chặt chẽ, vì chúng có thể phụ thuộc vào các nguồn điện không ổn định – như năng lượng mặt trời – hoặc yêu cầu sạc định kỳ, hoặc các hình thức can thiệp của con người khác, trong những tình huống mà lý tưởng nhất là không nên có ai hiện diện.

Song song với hướng nghiên cứu này, sự quan tâm đến các thiết bị đeo có camera cũng đã tăng lên (mặc dù các thiết bị như vậy vốn đã bị giới hạn chặt chẽ bởi nguồn điện và khả năng tính toán), bởi vì AI biên giờ đây hứa hẹn sẽ làm cho chúng trở nên hữu ích hơn đáng kể.

Ngoài những cân nhắc này, động lực dài hạn để giảm chi phí cho AI biên và giám sát (đặc biệt trong những trường hợp mà khoản tiết kiệm đó không cần chuyển cho khách hàng) tạo nên một lý lẽ thuyết phục cho sự đổi mới trong các phương pháp tiết kiệm năng lượng cho các trường hợp sử dụng ‘biên’.

Kích Hoạt Bằng Âm Thanh

Trong lĩnh vực cảm biến video phát trực tuyến, các thiết bị giám sát biên thiếu tài nguyên phải sử dụng năng lượng ít nhất có thể, trong khi vẫn tiêu tốn đủ năng lượng để giám sát các sự kiện ‘thú vị’ – tại thời điểm đó, việc sử dụng nhiều tài nguyên hơn sẽ là đáng giá.

Trên thực tế, đây là một trường hợp sử dụng tương tự như đèn cảm ứng chuyển động, chỉ cung cấp ánh sáng khi các cảm biến tiêu thụ năng lượng thấp xác định có người ở đó để tận hưởng nó.

Vì việc giám sát và nén âm thanh ít tốn tài nguyên hơn đáng kể so với video, một số phương pháp trong những năm gần đây đã cố gắng sử dụng các tín hiệu dẫn dắt bằng âm thanh để ‘bật’ sự chú ý trong các hệ thống bị giới hạn; các khuôn khổ như Listen to Look và Egotrigger:

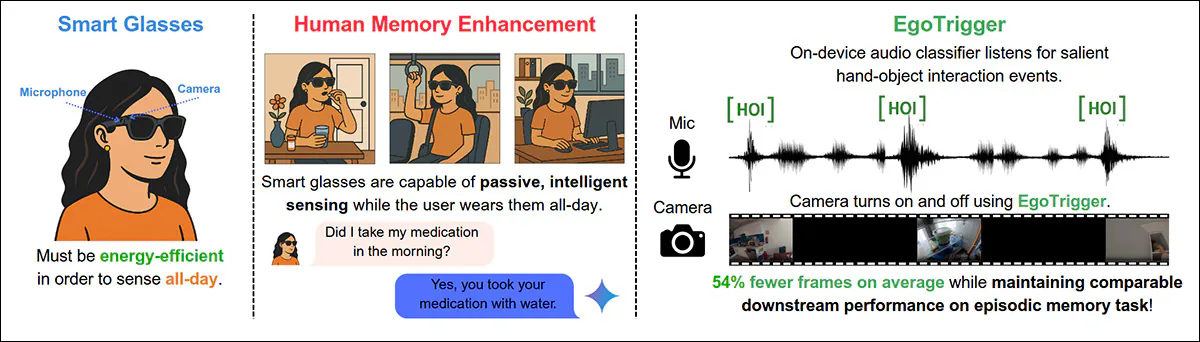

Trong hệ thống Egotrigger, kích hoạt dựa trên âm thanh chọn lọc kích hoạt việc chụp ảnh từ các tín hiệu tương tác tay-vật thể, giảm các khung hình dư thừa trong khi vẫn duy trì hiệu suất ghi nhớ sự kiện trong các hệ thống kính thông minh bị giới hạn tài nguyên. Nguồn

Rõ ràng âm thanh không phải là phương tiện lý tưởng để tìm kiếm các sự kiện thị giác, vì nhiều sự kiện thiết yếu như vậy có thể không có tín hiệu âm thanh đi kèm, hoặc có thể xảy ra ngoài phạm vi của micro biên.

Ngủ Nhẹ

Một bài báo mới đề xuất rằng, điều có thể tốt hơn là một luồng video có thể phối hợp với AI để tăng tài nguyên ngay khi một sự kiện được theo dõi xảy ra. Mô phỏng dưới đây* đưa ra ý tưởng chung về khái niệm – giám sát độ phân giải thấp được duy trì ở mức tín hiệu tối thiểu cần thiết để các khuôn khổ phát hiện đối tượng hoạt động, và để báo cho hệ thống tăng độ phân giải do sự kích hoạt của một sự kiện:

Một mô phỏng về hành vi mong muốn – việc phát trực tuyến và phân tích hoạt động ở mức tiêu thụ tài nguyên thấp nhất theo mặc định; chỉ đủ để kích hoạt mức tiêu thụ tài nguyên cao hơn khi các sự kiện ‘thú vị’ hoặc được tìm kiếm được phát hiện trong luồng thang độ xám. Phong cách giám sát đen trắng có thể khá ‘hoài cổ’, nhưng nó có thể là dấu hiệu của những điều sắp tới. Video này được tác giả tạo ra chỉ cho mục đích minh họa liên quan đến ý tưởng cốt lõi của bài báo mới. Nguồn:

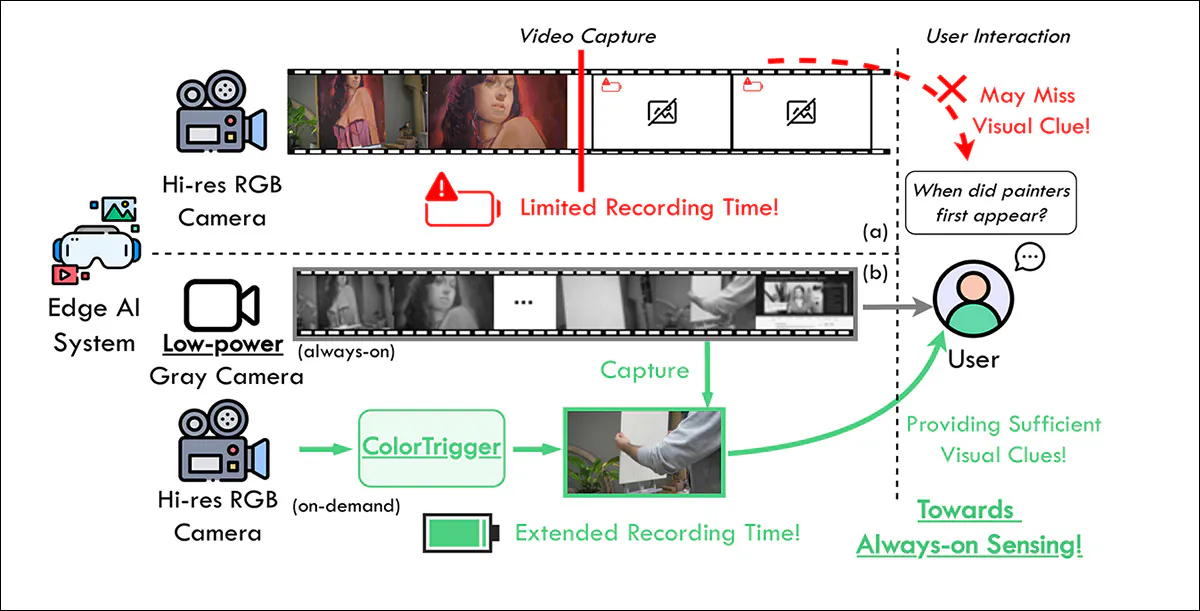

Công trình mới, một sự hợp tác học thuật giữa nhiều tổ chức Vương quốc Anh và Huawei, đề xuất một lược đồ luôn thang độ xám, màu sắc theo yêu cầu được AI hỗ trợ, không cần đào tạo cho giám sát biên – được thiết kế để hoạt động ở mức sử dụng token thấp khi không có ‘sự kiện then chốt’ nào diễn ra, và chỉ tăng mức tiêu thụ trong thời gian diễn ra sự kiện.

Trong các điểm chuẩn hiểu video phát trực tuyến, hệ thống mới, được đặt tên là ColorTrigger, đã đạt được 91,6% hiệu suất cơ sở đầy đủ màu sắc trong khi chỉ sử dụng 8,1% các khung hình RGB trong các tiêu chuẩn đó:

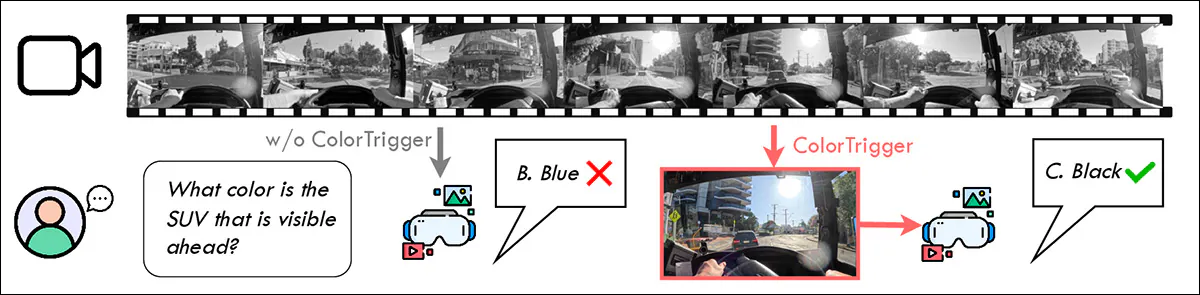

Khi mô hình chỉ nhìn thấy video thang độ xám, nó nhầm lẫn các chi tiết then chốt và đưa ra câu trả lời sai; nhưng việc kích hoạt màu sắc vào đúng thời điểm làm rõ hình ảnh và sửa chữa các lỗi được kích hoạt bởi các nhiệm vụ phụ thuộc vào màu sắc. Nguồn

Bài báo mới có tiêu đề Color When It Counts: Grayscale-Guided Online Triggering for Always-On Streaming Video Sensing, và đến từ tám nhà nghiên cứu từ Đại học Queen Mary London, Đại học Durham, Đại học Hoàng gia London và Phòng thí nghiệm Noah’s Ark của Huawei. Bài báo cũng có một trang dự án kèm theo.

Phương Pháp

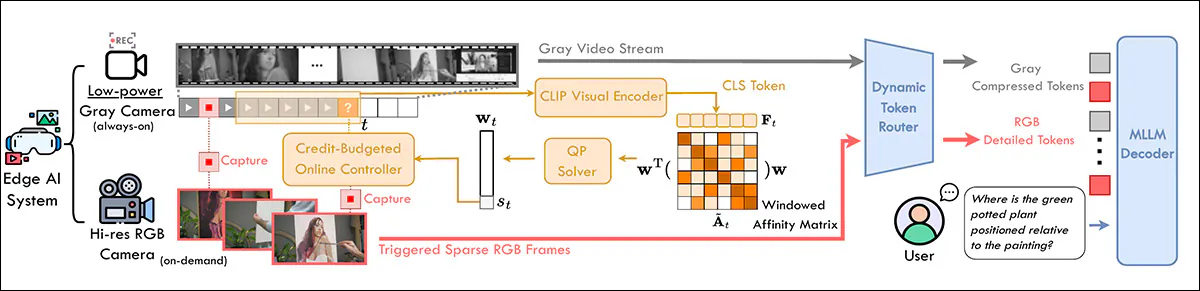

Để bảo toàn cấu trúc thời gian trong hệ thống mới, ColorTrigger duy trì việc giám sát thang độ xám băng thông thấp liên tục. Một bộ kích hoạt trực tuyến nhân quả phân tích một cửa sổ trượt (tức là, một phạm vi linh hoạt cộng-trừ các khung hình xung quanh một thời điểm cụ thể, chẳng hạn như cảm nhận một sự kiện kích hoạt) của luồng độ phân giải thấp:

Việc chụp RGB độ phân giải cao liên tục nhanh chóng làm cạn kiệt nguồn điện, vì vậy việc ghi hình dừng sớm và các khoảnh khắc then chốt có thể bị bỏ lỡ. Ngược lại, ColorTrigger duy trì một luồng thang độ xám tiêu thụ điện năng thấp chạy mọi lúc, và chỉ kích hoạt camera RGB vào những thời điểm được chọn – kéo dài thời gian ghi hình, trong khi vẫn ghi lại các chi tiết thị giác cần thiết để trả lời các truy vấn sau này. Nguồn

Trong khi hệ thống ở chế độ ‘thụ động’ (tức là, nó chưa xác định được sự kiện kích hoạt), bộ định tuyến token động của nó phân bổ dung lượng hạn chế cho một bộ giải mã không đối xứng, luôn tìm kiếm sự dư thừa và các sự kiện cho thấy tính mới lạ, tại thời điểm đó luồng token sẽ ưu tiên lại dung lượng hơn việc nén:

Sơ đồ cho ColorTrigger. Hệ thống giám sát phân tích cửa sổ trượt của các khung hình gần đây để phát hiện sự dư thừa và thay đổi, chỉ kích hoạt việc chụp RGB độ phân giải cao khi cần thiết, dưới một ngân sách dựa trên tín dụng. Một bộ định tuyến token động phân bổ ít token hơn cho đầu vào thang độ xám và nhiều hơn cho các khung hình RGB được chọn, bảo toàn thứ tự thời gian cho việc xử lý Mô hình Ngôn ngữ Lớn Đa phương thức (MLLM) hạ nguồn.

Trên cơ sở từng khung hình, hệ thống cần quyết định xem khoảnh khắc hiện tại có chứa thông tin mới đáng để trả giá cho việc chụp màu hay không. Lịch sử ngắn gần đây của các khung hình thang độ xám trong cửa sổ trượt cho phép ColorTrigger so sánh khung hình hiện tại với quá khứ trực tiếp của nó. Mỗi khung hình được chuyển đổi thành một biểu diễn đặc trưng nhỏ gọn, và các đặc trưng này được so sánh với nhau để đo lường mức độ tương tự hoặc khác biệt của các khung hình chứa chúng.

Quá trình so sánh này được tổ chức thành một cấu trúc tóm tắt mức độ mà mỗi khung hình chồng lấp với các khung hình khác, từ đó nắm bắt hiệu quả