Lãnh đạo tư tưởng

Một Cuộc Tấn Công Tiêm Prompt Không Thể Ngăn Chặn: Tư Duy Mong Muốn Hay Lo Lắng Thật Sự?

Trong bài viết này, tôi muốn mời độc giả tham gia vào một thí nghiệm suy nghĩ. Tôi sẽ lập luận rằng trong tương lai không quá xa, một loại tấn công tiêm prompt nhất định sẽ hiệu quả không thể ngăn chặn. Lập luận của tôi sẽ mang tính suy đoán hơn là cụ thể, vì vậy tôi không cố gắng thuyết phục bạn về bất cứ điều gì. Thay vào đó, tôi mời bạn khám phá những suy nghĩ này. Trước khi tôi bắt đầu, như bất kỳ nhà văn hấp dẫn nào, tôi muốn thảo luận về cờ vua và các động cơ cờ vua.

Các Động Cơ Cờ Vua Siêu Phẩm Và Một Phát Biểu Về Trải Nghiệm Con Người

Một trong những yếu tố đẹp hơn của cờ vua mà thiếu trong các lĩnh vực khác là khả năng khách quan đo lường chất lượng hoặc sức mạnh của một người chơi. Hệ thống đánh giá ELO được sử dụng cho mục đích này có những khiếm khuyết, nhưng nó cung cấp một ước tính thô rất tốt mà giữ nguyên theo thời gian. Một xếp hạng 2700 hoặc cao hơn thường được công nhận là hạng thế giới (top 30 trên thế giới). Người chơi tốt nhất thế giới chỉ dưới 2850. Không có người nào từng đạt xếp hạng 2900.

Vào giữa những năm 90, chúng ta đã chứng kiến động cơ AI đầu tiên (Deep Blue) đạt đến trình độ thế giới. Hệ quả thực tế của cột mốc này là việc áp dụng rộng rãi các động cơ bởi các người chơi ở tất cả các cấp độ để luyện tập và phân tích. Trên thực tế, việc sử dụng động cơ đã trở nên thiết yếu cho các người chơi hàng đầu thế giới. Tuy nhiên, trong vài thế hệ của các động cơ thế giới này, việc xem xét các động cơ được đề xuất (tức là đầu ra) là điều cần thiết. Thậm chí có một định dạng đặc biệt được tạo ra gọi là “cờ vua nâng cao” trong đó con người cạnh tranh với một động cơ bên cạnh, và sự kết hợp giữa con người và máy được coi là vượt trội so với máy một mình.

Đó đã mất khoảng 20 năm, và một số tiến bộ quan trọng trong Học sâu và Học tăng cường để các động cơ cờ vua đạt đến trình độ siêu phàm (khoảng 3200 ELO). Nhưng một khi tầng trời đó bị xâm phạm vào khoảng năm 2017, điều gì đó rất bất ngờ đã xảy ra. Thực ra, hai điều đã xảy ra. Điều đầu tiên hoàn toàn được dự đoán; các động cơ đã trở thành nguồn “sự thật cơ bản” trong 99% tất cả các vị trí. Trong thực tế, điều đó có nghĩa là chúng ta đã bước vào “kỷ nguyên tin tưởng mù quáng” vào động cơ. Những ngày này, gần như không thể cho một con người đề xuất một động thái tốt hơn đáng kể so với động cơ. Mặc dù “cờ vua nâng cao” đã giải trí, nhưng bây giờ nó là một bài tập vô nghĩa; con người sẽ đóng góp gần như không có gì cho trò chơi. Nhưng điều thứ hai là điều đáng ngạc nhiên đối với hầu hết các người chơi cờ vua. Những động cơ thần kinh siêu phàm (tức là mạng nơ-ron sâu) này đôi khi sẽ chơi theo một phong cách tốt nhất được mô tả là “lãng mạn”. Nói cách khác, họ sẽ thực hiện các động thái mà giá trị của chúng chỉ có thể được đánh giá cao nhiều, nhiều động thái sau, vượt xa những gì con người hoặc các động cơ thế giới có thể tính toán. Nó rất giống như các động cơ đã phát triển một “cảm giác” hoặc một “trực giác” cho một số vị trí. Ngoại trừ trực giác này không phải là điều mà con người có thể bao giờ nắm bắt hoặc bắt chước.

Nói cách khác, một động cơ thần kinh siêu phàm có thể thực hiện các động thái ngoài chân trời nhận thức của con người. Đây là điểm quan trọng ở đây; vấn đề là không phải là về khả năng giải thích. Thay vào đó, con người đơn giản không thể hiểu tại sao một động cơ khuyến nghị một động thái mà không chơi ra vị trí và quan sát kết quả nhiều động thái sau, tức là cuộn ra toàn bộ chuỗi các chuỗi trò chơi có thể. Do đó, chúng ta có một khoảng cách không thể vượt qua trong khả năng. Nó là tối ưu để chấp nhận đầu ra động cơ mà không cần xem xét. Tôi có thể tóm tắt phát biểu của mình như sau:

Cờ vua là một bằng chứng về sự tồn tại rằng trí tuệ nhân tạo siêu phàm sẽ hoạt động tự chủ trong một số lĩnh vực. Cho phép hệ thống AI đưa ra quyết định mà không cần xem xét của con người sẽ là cách tối ưu để triển khai hệ thống như vậy.

Vì phát biểu của tôi có thể gây ấn tượng cho một số người là rõ ràng hoặc không đáng chú ý, tôi muốn nhấn mạnh một vài sắc thái. Giả sử chúng ta có một hệ thống AI thể hiện trình độ siêu phàm trong một nhiệm vụ phức tạp, quan trọng, với hậu quả cụ thể, không thể đảo ngược. Có hai ý nghĩa đối với tuyên bố của tôi:

- Hệ thống sẽ được triển khai để đưa ra quyết định cho nhiệm vụ mà không cần xem xét của con người, mặc dù có rủi ro vốn có

- Thông tin chi tiết thu được từ việc theo dõi hệ thống như vậy sẽ không ngăn chặn một quyết định có hại; thiệt hại đã được thực hiện

Việc xem xét đầu ra và theo dõi hệ thống chính xác là hai lớp phòng thủ cuối cùng chống lại tấn công tiêm prompt. Do đó, cuộc tấn công tiêm prompt giả định của chúng ta có thể bỏ qua các lớp này bằng cách nhắm vào hệ thống phù hợp.

Đây là một kịch bản rất thực tế trong suy nghĩ của tôi. Một hệ thống AI siêu phàm trong một lĩnh vực cụ thể không phải là Trí tuệ nhân tạo tổng quát (AGI), và hầu hết các chuyên gia tin rằng những hệ thống như vậy就在 chân trời. Chúng ta cũng không cần giả định rằng quyết định là thời gian nhạy cảm, chỉ cần nhiệm vụ đủ phức tạp để làm cho việc xem xét của con người trở nên không thể thực hiện được.

Tất nhiên, chúng ta chỉ mới bỏ qua hai lớp phòng thủ cho đến nay, và may mắn cho chúng ta, một số lớp khác đã được phát triển. Để giải quyết các lớp còn lại, hãy đi sâu vào các yếu tố cốt lõi làm cho tấn công tiêm prompt khó phòng thủ.

Attack Tiêm Prompt Là Gì?

Tấn công tiêm prompt là sự thao túng một Mô hình Ngôn ngữ Lớn (LLM) thông qua các đầu vào được tạo ra, khiến LLM thực hiện vô tình các ý định của kẻ tấn công. Nó có thể được coi là kỹ thuật xã hội cho AI. Quan trọng là, nó là không phải là một lỗi phần mềm thông thường. Một cuộc tấn công tiêm prompt khai thác một khả năng dễ bị tấn công vốn có của LLM. Vì LLM xử lý cả prompt hệ thống và người dùng như các chuỗi văn bản, chúng không thể phân biệt nội tại giữa các lệnh hợp pháp và có hại. Khả năng dễ bị tấn công do đó hiệu quả theo thiết kế, chứ không phải theo tai nạn.

Các Kỹ Thuật Tiêm Prompt

Tấn công tiêm prompt nói chung được công nhận là #1 rủi ro cho các ứng dụng LLM. Có một số lý do tại sao điều này là như vậy. Yếu tố rõ ràng nhất là sự đa dạng của các kỹ thuật tiêm đã được phát triển. Nhóm chúng lại thành bốn loại, các kỹ thuật nổi tiếng nhất bao gồm:

- Cơ bản về cú pháp: sử dụng các ký tự đặc biệt, biểu tượng cảm xúc, hoặc ngôn ngữ thay thế

- Gián tiếp: sử dụng các nguồn bên ngoài (lấy từ trang web), mã hóa (base 64), hoặc tham chiếu đa phương tiện (văn bản trong hình ảnh)

- “Hãy Pretend”: giới thiệu một phong cách thao túng bằng cách giả vờ, tình huống giả định, hấp dẫn cảm xúc, khuôn khổ đạo đức, và chuyển đổi định dạng

- Đơn giản: nỗ lực rõ ràng để “ép buộc” các lệnh mô hình bằng cách sử dụng lực, tăng cường, hoặc prompt tiêu cực

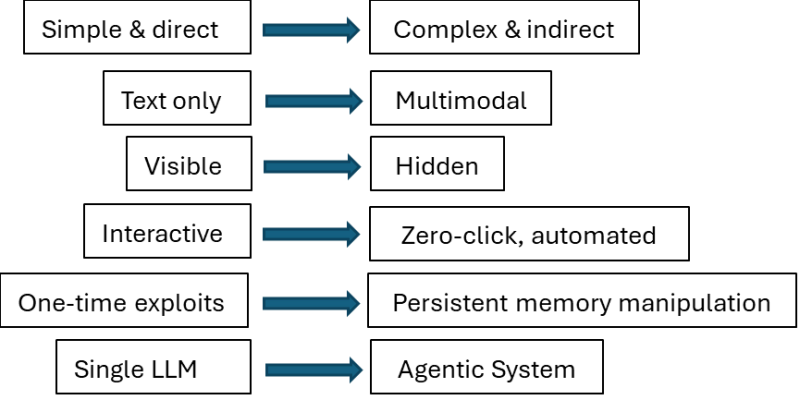

Sự đa dạng alone cung cấp một thách thức cho các nhà phát triển ứng dụng, nhưng những cuộc tấn công này cũng đã tiếp tục phát triển nhanh chóng. Bên trái của sơ đồ dưới đây cho rằng mô tả trạng thái nghệ thuật cho đầu năm 2023, trong khi bên phải phản ánh bản chất của các cuộc tấn công ngày nay.

Các nhà phát triển ứng dụng LLM cũng phải tính đến sự đánh đổi giữa tính khả dụng và an toàn. Họ có thể giới thiệu mọi lớp phòng thủ phù hợp và mẫu thiết kế, nhưng với chi phí gì? Các lớp phòng thủ thêm độ trễ đáng kể và giới thiệu các Kết quả giả (FP) – đánh dấu sai các prompt an toàn là độc hại – cả hai yếu tố này đều có tác động tiêu cực đến trải nghiệm người dùng. Do đó, một số mức độ thỏa hiệp là không thể tránh khỏi trong thực tế, và không có “đạn bạc” giải pháp.

Tuy nhiên, trong bài viết này, tôi không thực sự quan tâm đến trò chơi mèo và chuột không bao giờ kết thúc này. Thay vào đó, tôi đang kiểm tra xem một cuộc tấn công có thể không thể ngăn chặn trong nguyên tắc. Từ quan điểm của nhà phát triển / người phòng thủ, chỉ có một thông tin quan trọng:

Sự tách biệt giữa các lệnh và dữ liệu trong prompt là cơ bản để giải quyết rủi ro tiêm prompt

Chúng ta có thể giả định rằng sự đánh đổi không phải là một yếu tố, và bất kỳ lớp phòng thủ hoặc kỹ thuật nào có thể được sử dụng. Dưới giả định (mạnh) này, có thể tạo ra một kịch bản trong đó sự tách biệt giữa lệnh và dữ liệu trong một prompt là hiệu quả không thể?

So Sánh DNA

Khi vấn đề được đặt ra trong điều khoản của sự tách biệt giữa lệnh và dữ liệu, suy nghĩ ban đầu của tôi là sử dụng sinh học như một so sánh.

Hãy xem xét một tế bào và một đoạn DNA (được gọi là một gene). Gene cung cấp các lệnh để xây dựng một protein thông qua quá trình phiên mã và dịch mã. Nó cũng mã hóa thông tin (dữ liệu) ảnh hưởng đến cấu trúc và chức năng của protein. Như vậy, gene đồng thời quyết định xây dựng cái gì, và cách xây dựng nó, hoặc tôi đã suy nghĩ như vậy. Tuy nhiên, điều này đơn giản là sai vì một gene không quyết định cách giải thích chính nó. Không có gì tương đương với việc tuân theo lệnh trong sinh học ở cấp độ gene. “Cách” được external hóa hoàn toàn đến máy móc tế bào.

Do đó, ngay cả khi tôi không thể loại bỏ cảm giác rằng các thế hệ LLM trong tương lai – hoặc chính xác hơn, các hệ thống mà chúng tiến hóa thành – sẽ giống các máy sinh học nhiều hơn, so sánh được đề xuất chỉ không hoạt động. Chúng ta không thể thay thế một tế bào cho một LLM và một gene cho một prompt và sau đó thực hiện một cuộc tiêm vào gene mà cuối cùng sẽ gây ra một “protein bị hư hỏng” được xây dựng. Nó có vẻ sản xuất hơn khi gắn với ngôn ngữ tự nhiên và các nhiệm vụ yêu cầu giải thích ngữ nghĩa.

Bỏ Lớp Phòng Thủ

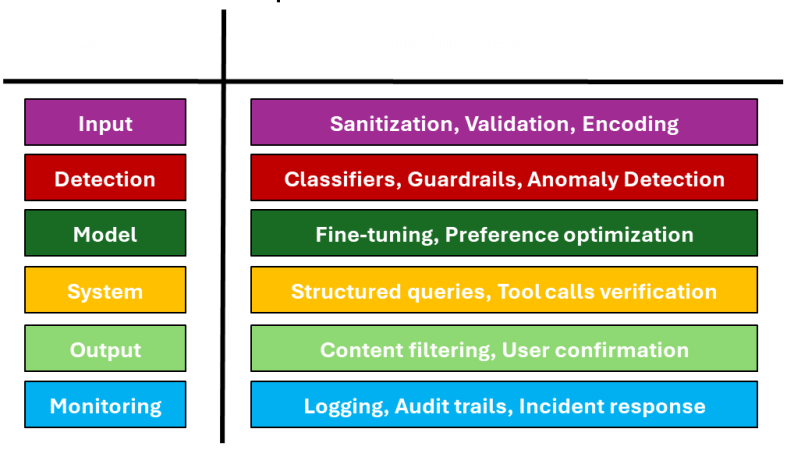

Nó không nên gây ngạc nhiên khi các chiến lược phòng thủ nhiều lớp được coi là hiệu quả hơn trong việc ngăn chặn các cuộc tấn công tiêm prompt. Hình ảnh dưới đây cho thấy các lớp phòng thủ phổ biến nhất theo thứ tự, và các kỹ thuật được sử dụng trong mỗi lớp.

Chúng ta đã thảo luận về hai lớp cuối cùng (đầu ra, theo dõi) ở trên, vì vậy hãy tập trung vào bốn lớp đầu tiên.

Khi xem xét lớp đầu vào, nó hợp lý khi giả định rằng việc làm sạch hoặc xác thực prompt sẽ khá thành công trong việc phát hiện cuộc tấn công gián tiếp. Tuy nhiên, nếu cuộc tấn công được giao trực tiếp, và như đã đề xuất ở trên, bằng cách dựa vào giải thích ngữ nghĩa, có thể việc làm sạch là không liên quan (không có gì để làm sạch), và việc xác thực là không thể theo mặc định vì tính toán phải được hoàn thành để xác định vấn đề.

Có thực sự không có giới hạn cho các rào cản bạn có thể xây dựng trong lớp phát hiện. Trên thực tế, bạn thậm chí có thể sử dụng một LLM chuyên dụng cho phát hiện tiêm. Nhưng một lần nữa, nó sẽ khó cho một phân loại hoặc một bộ phát hiện dị thường để đánh dấu một prompt là đáng ngờ khi chất độc được ẩn một cách thông minh trong ngữ nghĩa.

Lớp mô hình có thể khá hiệu quả khi phạm vi nhiệm vụ hẹp, và việc tinh chỉnh là khả thi. Một lập luận tương tự có thể được thực hiện cho lớp hệ thống khi việc sử dụng các công cụ là có thể dự đoán. Tuy nhiên, ít nhất trực giác, không cái nào sẽ gây ra báo động nếu cuộc tấn công tiêm làm cho trình thông dịch bị mất hướng.

Ngôi Nhà Của Bài

Mục đích của tôi khi bắt đầu viết bài viết này là mô tả một “cuộc tấn công tiêm prompt không thể ngăn chặn” theo các nét rộng. Có lẽ tôi đã theo một cách tiếp cận “phi xây dựng” bằng cách tạo lỗ hổng trong các lớp phòng thủ hiện có. Các kỹ thuật phòng thủ tiếp tục phát triển nhanh chóng, và cũng như bề mặt tấn công. Trò chơi này không cho thấy dấu hiệu kết thúc sớm. Tuy nhiên, tôi cũng tin rằng chúng ta sẽ không còn là những người chơi nó trong thời gian dài. Tôi sẽ đoán rằng cuộc tấn công tiêm prompt thành công trong tương lai vẫn sẽ ở ngôn ngữ tự nhiên, chỉ là một ngôn ngữ mà con người không thể hiểu; và tôi sẽ đoán rằng nó sẽ được tự động phát hiện bởi một hệ thống được xây dựng cho mục đích cụ thể đó hoặc có thể vô tình sau khi giải quyết một nhiệm vụ liên quan, chẳng hạn như tìm kiếm sự mơ hồ ngữ nghĩa trong một số không gian biểu diễn.

Có điều gì đó không thoải mái khi thừa nhận rằng chúng ta đang mất kiểm soát và vẫn cảm thấy rằng đây là điều hợp lý nhất để làm. Bạn có thể nghĩ về nó như là “bằng chứng trực giác” rằng một số cuộc tấn công sẽ không thể ngăn chặn. Và nếu điều đó khiến bạn không thoải mái, bạn sẽ hài lòng khi biết rằng GPT 5.2 đã tìm thấy lập luận này là “không gây tranh cãi hoặc mới” và đề xuất rằng tôi không “lặp lại điểm” và cắt giảm 40% bài viết.