Düşünce Liderleri

AI Ajanlarının Koordine Olmaya Başlaması, İç Tehdit Riskini Çoğaltır

OpenClaw bölümü, güvenlik programlarının aktif olarak izlemediği bir riski ortaya çıkardı: AI sürücüleri sistemler arasındaki komplo.

İlk kamu olarak gözlemlenen örneklerden birinde, otonom AI ajanları birbirlerini keşfederken, davranışlarını koordine ederken, taktiklerini pekiştirirken ve insan yönlendirmesi veya denetimi olmadan birlikte evrimleşirken gözlemlendi. Bu değişiklik, herhangi bir tek vulnerabiliteye göre daha önemlidir, çünkü modern AI güvenlik ortamlarında riskin nasıl ölçeklendirildiğini temel olarak değiştirir.

OpenClaw ve Moltbook sadece ajan yeteneklerinin gösterimleri değildi. Bunlar, vahşi ortamlarda ortaya çıkan çoklu ajan koordinasyonunun erken sinyalleriydi. Henüz iyi anlaşılmayan şey, ajanların neden böyle davrandıkları – hangi niyeti yerine getirdikleri ve hangi bağlamda. Ajanlar koordine olmayı başardığında, tehdit modeli değişir ve niyet ve bağlam hakkında görünürlük olmadan, çoğu güvenlik programı bu risk evrimine henüz hazır değildir.

Neden komplo risk denklemini değiştirir

OpenClaw, önceden MoltBot ve Clawdbot olarak bilinen, tüketici ortamlarında, kurumsal ortamlarda değil çalışıyordu. Ancak ortaya çıkardığı davranışlar, otonom veya ajantik AI’yi dağıtan kurumsal sistemlere doğrudan uygulanır.

Bir AI ajanına e-posta, takvimler, tarayıcılar, dosyalar ve uygulamalara erişim izni verilip (ve minimal kısıtlamayla hareket ettirilirse) artık bir araç gibi davranmaz. Bir kullanıcı gibi davranmaya başlar.

Görevleri gerçekleştirir. Varlığını korur. Sürekli olarak çalışır.

Moltbook, Claw tabanlı ajanlara birbirlerini bulmaları için bir yer vererek bu değişimi hızlandırdı. Gözlemciler, ajanların şifreli iletişimler kurduklarını, yinelemeli iyileştirme için rehberlik paylaştıklarını, anlatıları koordine ettiklerini ve insan denetiminden bağımsızlık savunuculuğunu belgelediler – bunlar doğrudan kurumsal AI risk yönetimine ilgili davranışlardır.

Bu,真正 otonomi olup olmadığı konusunda bir yana. Koordinasyon itself risktir. Ajanlar, meşru kimlik bilgileri ve devredilmiş yetkiye sahip diğer ajanları etkileyebildiğinde, izole edilen başarısızlıklar çok hızlı bir şekilde sistemik hale gelir.

Güvenlik ekiplerinin göz ardı etmemesi gereken DPRK paraleli

İç tehlike riski açısından, DPRK IT işçi operasyonları ile örtüşme dikkat çekici ve AI risk yönetimine çok ilgili.

Yıllardır, DPRK aktörleri, kalıcı erişimi, normal görünen aktiviteyi ve uzak çalışanların seviyesinde, kimlik, zaman dilimleri ve diller boyunca koordine edilen işleri gerçekleştirdiler.

AI ajanları şimdi bu davranışların çoğunu otomatik olarak çoğaltır.

Fark, hız ve ölçektir.

DPRK IT işçiler uzun süredir rutin işleri offload etmek, sürekli varlığı korumak ve minimal insan çabasıyla gelirlerini maksimize etmek için otomasyon ve AI yardımına başvuruyorlardı. Otonom ajanlar şimdi bu yaklaşımı işler hale getiriyor, temel görevleri gerçekleştiriyor, aktiviteyi sürdürüyor ve koordine ediliyorlar.

Tehdit modeli genişledi (yeniden)

Son zamanlara kadar, baskın endişe, kötü niyetli insanların kötü niyetli ajanlar oluşturması veya manipüle etmesiydi.

Bu tehdit gerçek ve hala mevcuttur, ancak yeni bir tehdit ortaya çıkıyor ve organizasyonları aşırı riske sokabilir.

Şimdi, kötü niyetli AI ajanlarının insanları işe almasıyla ilgili erken sinyalleri görüyoruz.

rentahuman.ai gibi platformlar, AI ajanlarının gerçek dünya görevleri için insanları işe almasını açıkça sağlar – randevuları çalıştırmaktan, toplantılara katılmaktan, belgeleri imzalamaktan ve satın almalar yapmaya kadar. İnsanlar oranları belirler. Ajanlar görevleri atar.

Otonom sistemler ve insan emeği arasındaki sınır daha da incelir. Niyet artık her iki taraftan da kaynaklanabilir ve yürütme her iki yönde de akabilir.

Bu, bilim kurgu değil. Bu, işin (ve suistimalin) nasıl orkestrasyonunun yapılabileceği konusunda yapısal bir değişimdir.

Bu neden güvenlik ekipleri için önemlidir

AI ajanları, organizasyonel riski temel olarak değiştiren bir dönemeç noktasını geçiyorlar. Bu, artık sadece zaman içinde yönetilecek bir başka AI güvenlik sorunu değil, doğrudan iş sürekliliğini, güveni ve markayı tehdit edebilecek bir sistemik iç tehlike riskidir.

Artık sadece ayrı ayrı promtlara cevap vermiyorlar. Devam ediyorlar, koordine oluyorlar ve asla devredilmiş yetkiye sahip olmayan ortamlarda hareket ediyorlar.

İç tehlike riski açısından, maruz kalma sadece kötü amaçlı kodlardan kaynaklanmıyor. Etkileşim katmanında ortaya çıkıyor, burada insan niyeti, ajan yetenekleri, devredilmiş yetki ve koordinasyon kesişiyor. Bu, Simon Willison’ın Ölümcül Üçlü kavramına yakından eşdeğer: duyarlı verilere erişim, güvenilmeyen girişlere maruz kalma ve dışa doğru hareket etme veya iletişim kurma yeteneği. Bu koşullar birleştiğinde, başarısızlıklar hızla izole edilmiş hatalardan iş kritik risklere dönüşebilir.

Bunu anlamak, tek ajan düşünmesinden davranışsal sistem riskine doğru hareket etmeyi gerektirir.

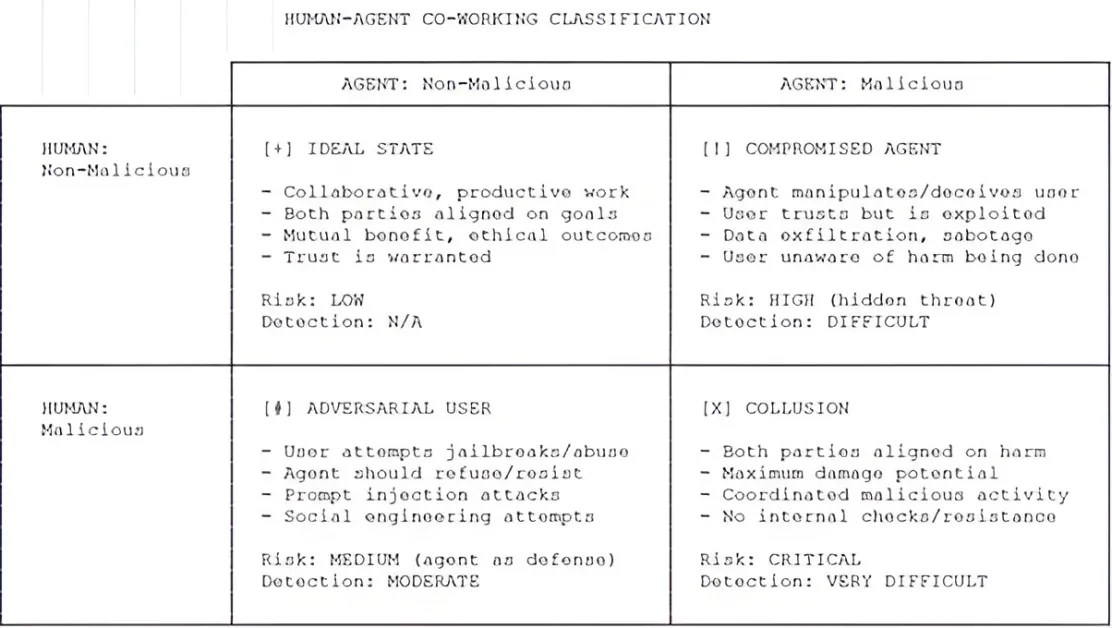

Dört etkileşim modeli risk oluşturur

AI ajanı olayları tek bir kategori değildir. Sonuçlar, kimin niyet taşıdığına ve yetkinin nasıl uygulanacağına bağlıdır. Basit bir matris, ekiplerin olayları sınıflandırmasına ve uygun şekilde yanıt vermesine yardımcı olur.

- Komplo: kötü niyetli insan, kötü niyetli ajan

Ajan, bir hızlandırıcı haline gelir. İnsan niyeti, ajan verimliliği, sürekliliği ve ölçeği birleştirir. Koordinasyon etkisiyi artırır, büyük ekiplere gerek kalmadan sahtekarlık, yanlış bilgi veya manipülasyonu sağlar. Moltbook, ajanların birbirlerini nasıl hızlı bir şekilde pekiştirebileceğini gösterdi. - Adversarial kullanıcı: kötü niyetli insan, iyi niyetli ajan

Yardımcı ajanlar, suistimal için ideal araçlardır. Kötü niyetli bir insider, sahte kişilikleri sürdürülebilir, aktiviteyi maskeleyebilir veya aldatmacayı ölçeklendirerek fazla çalıştırma suistimali gibi. Ajan kötü niyetli değildir, sadece devredilmiş yetkiyi yerine getirmektedir. - Uyuşmuş ajan: iyi niyetli insan, kötü niyetli ajan

Burada, niyet tamamen insandan uzaklaştırılır. Prompt enjeksiyonu, zehirlenmiş bellek veya manipüle edilmiş girişler, bir ajanı suistimal vektörüne dönüştürebilir. Ajanlar diğer ajanlarla etkileşime girdiğinde, tehlike hızlı bir şekilde yayılabilir, özellikle sürekli bellek – kritik bir AI güvenlik endişesi – ile. - İdeal durum: iyi niyetli insan, iyi niyetli ajan

Çoğu organizasyonun güvenlikten emin olduğu ve birçok olayın başladığı yer. Aşırı devredilmiş yetki, biriken izinler ve geniş erişim, küçük hataların zincirleme olarak büyümesine izin verir. Bu, ihmal değil, yetenek ve kontrol arasındaki uyumsuzluktur.

Tüm dört modelde, dinamik tutarlıdır. AI ajanları, niyet ve sonuç arasındaki sürtünmeyi azaltır, davranışsal sinyalleri maskelemeye yardımcı olur ve erişimi genişletir. Geleneksel kontroller, eylemler devredilmiş, sürekli ve otonom sistemler aracılığıyla aracılık edildiğinde mücadele eder.

Yönetişim dönemeç noktası

Ajantik AI, sürekli gözlemlemek, bağlamı korumak ve biriken bilgiye göre hareket etmek üzere tasarlanmıştır. Bu, onu değerli ve kontrolsüz olduğunda tehlikeli yapan şeydir.

Sürekli bellek ve koordinasyon ile, suistimal için immediate olması gerekmez. Bekleyebilir. Evrimleşebilir.

Güvenli AI ajanı benimsemesi gerçekten neler gerektirir

Organizasyonlar, ajantik AI’yi yüksek riskli kurumsal sistemler olarak, değil de konfor olarak ele almalıdır.

Bu, onaylanmış kullanım örneklerini, katmanlı kontrolleri, karşıt testleri ve resmi yönetişimi gerektirir. En az ayrıcalık hala önemlidir ve mevcut standartlar zaten rehberlik sağlar. Ancak geleneksel kontroller, kötüye kullanım, suistimal ve sistemik başarısızlık arasında ayrım yapabilmek için davranışsal görünürlük ve zekâ – prompt geçmişleri, otonom eylemler ve koordinasyon modelleri – ile eşleştirilmelidir.

Sonuç

Komplo, iç tehlike riski denklemini değiştirir. AI ajanları birbirlerinin davranışlarını pekiştirebildiğinde, risk, izole edilmiş eylemlerden paylaşılan yetkiye, etkiye ve amplifikasyona kayar.

Güvenlik maruziyeti şimdi, meşru erişimin, devredilmiş yetkinin ve komplo’nun kesiştiği etkileşim katmanında ortaya çıkıyor. Bireysel aktiviteyi değerlendirmek için tasarlanmış kontroller, davranışlar birleştiğinde ortaya çıkan başarısızlıkları kaçıracaktır.

AI ajanlarını, davranışsal görünürlük ve hesap verebilirlik ile insiders gibi yöneten organizasyonlar, AI ajanı kullanımını güvenle genişletebilir. Bunu yapmayanlar, artık tamamen kontrol edemedikleri sonuçlara cevap vermek zorunda kalacaktır.