Yapay Zekâ

Kaçamak ‘Deepfake’ Tanımı

Almanya’dan gelen bir yeni çalışma, AB AI Yasası’nın ‘deepfake’ teriminin tanımını, özellikle dijital görüntü manipülasyonu bağlamında fazla belirsiz olarak eleştiriyor. Yazarlar, Yasaların gerçek kişiler veya olaylara benzeyen ancak potansiyel olarak sahte görünen içerik vurgusunun net olmadığını savunuyorlar.

Ayrıca, Yasaların ‘standart düzenleme’ (yani, supposedly küçük AI destekli görüntü değişiklikleri) istisnalarının, tüketici uygulamalarındaki AI’ın yaygın etkisini ve AI’ın ortaya çıkmasından önce gelen sanatsal kuralların öznel doğasını dikkate almadığını vurguluyorlar.

Bu konulardaki belirsiz yasalar iki temel risk yaratıyor: bir ‘soğutma etkisi’, где yasanın geniş yorumlayıcı kapsamı inovasyonu ve yeni sistemlerin benimsenmesini engelleyici bir etki yaratıyor; ve bir ‘scofflaw etkisi’, где yasa aşırı veya alakasız olarak görülüyor.

Her iki durumda da, belirsiz yasalar pratik yasal tanımların sorumluluğunu gelecek mahkeme kararlarına devrediyor – bir yasa koymanın ihtiyatlı ve riskten kaçınan bir yaklaşımı.

AI tabanlı görüntü-manipülasyon teknolojileri, görünüşe göre, yasaların bunları ele alma kapasitesinin önünde kalıyor. Örneğin, AI destekli otomatik post-işlem kavramının esnekliğinin büyümesiyle ilgili dikkat çekici bir örnek, çalışmada观察 edilen, ‘Scene Optimizer’ fonksiyonudur. Bu fonksiyon, recent Samsung kameralarında, kullanıcı tarafından çekilen ay resimlerini (bir zorlu konu), AI destekli, ‘rafiné’ bir resimle değiştirebilir:

<img class=" wp-image-210152" src="https://www.unite.ai/wp-content/uploads/2024/12/samsung-moon-photo.jpg" alt="Üst sol, yeni çalışmadan gerçek bir kullanıcı tarafından çekilen ay resminin örneği, Samsung'un Scene Optimizer ile otomatik olarak oluşturulan geliştirilmiş bir resmin soluna; Sağ, Samsung'un bu sürecin arkasındaki resmi illüstrasyonu; alt sol, Reddit kullanıcısı u/ibreakphotos'tan örnekler, (solda) kasıtlı olarak bulanıklaştırılmış ay resmini ve (sağda) Samsung'un bu resmin yeniden hayalini gösteriyor – kaynak fotoğrafı gerçek ay değil, bir monitörün resmiydi. Kaynaklar (saat yönünde yukarıdan): https://arxiv.org/pdf/2412.09961; https://www.samsung.com/uk/support/mobile-devices/how-galaxy-cameras-combine-super-resolution-technologies-with-ai-to-produce-high-quality-images-of-the-moon/; https:/reddit.com/r/Android/comments/11nzrb0/samsung_space_zoom_moon_shots_are_fake_and_here/

Yukarıdaki resmin sol alt köşesinde, ayın iki resmini görüyoruz. Soldaki resim, bir Reddit kullanıcısı tarafından çekilmiştir. Burada, resim kasıtlı olarak bulanıklaştırılmış ve downscaled edilmiştir.

Sağdaki resim, aynı bozulmuş resmi Samsung kamerası ile AI destekli post-işlem etkinleştirilerek çekilmiştir. Kamera, otomatik olarak ‘geliştirilmiş’ bir ay resmi oluşturmuştur,尽管 kaynak resim gerçek ay değildir.

Çalışma, Google’ın recent akıllı telefonlarına entegre edilen Best Take özelliğine daha derin bir eleştiri getiriyor – bir tartışmalı AI özelliği, bir grup fotoğrafının ‘en iyi’ kısımlarını düzenleyerek, birkaç saniyelik bir fotoğraf dizisini taramak suretiyle gülümsemeleri ileri veya geri taşımak için gerekli olanları seçer ve hiç kimsenin orta sırada göz kırpmadığından emin olur.

Çalışma, bu tür bir kompozit sürecin olayları yanlış temsil etme potansiyeline sahip olduğunu savunuyor:

‘[Bir] tipik grup fotoğrafı ortamında, ortalama bir izleyici muhtemelen sonuçtaki fotoğrafı hala otantik olarak değerlendirecektir. Gülümseme, birkaç saniye içinde fotoğrafın geri kalanının çekildiği sırada mevcuttu.

‘Öte yandan, en iyi çekim özelliğinin 10 saniyelik zaman çerçevesi, bir ruh hali değişikliği için yeterlidir. Bir kişi, grubun bir şaka için gülümserken gülümsemeyi durdurabilir.

‘Sonuç olarak, böyle bir grup fotoğrafının bir deep fake olabileceğini varsayıyoruz.’

Yeni çalışma, What constitutes a Deep Fake? The blurry line between legitimate processing and manipulation under the EU AI Act başlıklıdır ve Tübingen Üniversitesi’ndeki Computational Law Lab’dan ve Saarland Üniversitesi’nden iki araştırmacı tarafından yapılmıştır.

Eski Hileler

Zamanda fotoğraf manipülasyonu, tüketici düzeyindeki AI’dan çok daha eskidir. Yeni çalışmanın yazarları, çok daha eski tekniklerin varlığını, bunların ‘sahte’ olarak savunulabileceğini belirtiyorlar, örneğin bir dizi ardışık görüntünün bir High Dynamic Range (HDR) fotoğrafına veya bir ‘dikiş‘ panoramik fotoğrafına birleştirilmesi.

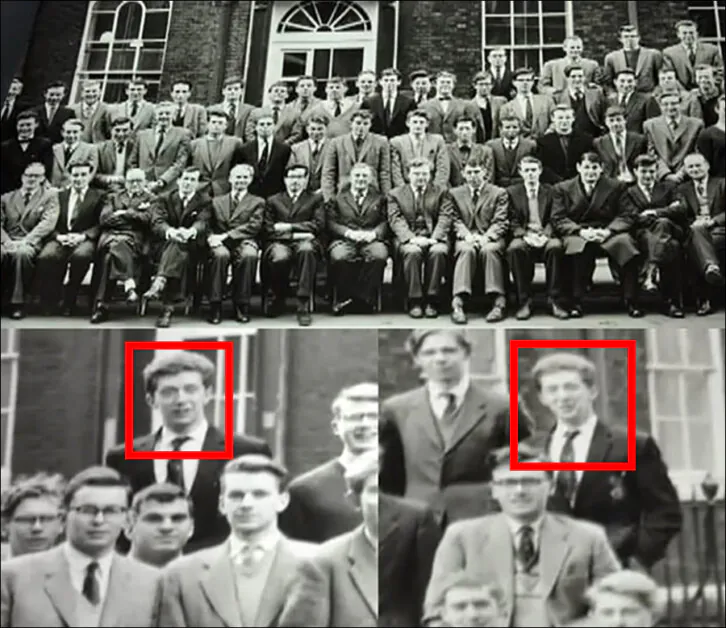

Gerçekten de, en eski ve en komik fotoğraf sahtecilikleri geleneksel olarak, okul çocuklarının, okul grupları için kullanılan özel panoramik kameraların görüş açısının önünde, bir ucundan diğer ucuna koşarak oluşturulmuştur – bu da öğrencinin aynı resimde iki kez görünmesini sağlar:

Panoramik kameralara karşı hile yapma isteği, birçok öğrenci için okul fotoğraflarında kendilerini ‘kopyalamak’ için fazla güçlü oldu. Kaynak: https://petapixel.com/2012/12/13/double-exposure-a-clever-photo-prank-from-half-a-century-ago/

RAW moda以外ında bir fotoğrafı çekmediğiniz sürece, dijital fotoğraflarınız tamamen otantik değildir. Kamera sistemleri, görüntü netleştirmesi ve beyaz dengesi gibi ‘iyileştirme’ algoritmalarını varsayılan olarak uygular – ve tüketici düzeyindeki dijital fotoğrafçılığın başlangıcından beri bunu yaparlar.

Yeni çalışmanın yazarları, bu daha eski tür dijital fotoğraf artırma yöntemlerinin de ‘gerçekliği’ temsil etmediğini savunuyor, çünkü bu yöntemler fotoğrafları daha hoş hale getirmek, daha ‘gerçek’ hale getirmek için tasarlanmamışlardır.

Çalışma, AB AI Yasasının, daha sonraki değişikliklerle birlikte, girişler 123–27, fotoğrafların üretildiği bağlamda, güvenlik kamerası görüntüleri veya adli fotoğrafçılık gibi (nominally nesnel) doğaya kıyasla delil çerçevesine uygun olmadığını öne sürüyor. AI Yasası tarafından ele alınan meisten görüntüler, daha çok, üreticilerin ve çevrimiçi platformların aktif olarak yaratıcı fotoğraf yorumunu, AI kullanımını da içeren, teşvik ettiği bağlamlarda ortaya çıkma olasılığı daha yüksektir.

Araştırmacılar, fotoğrafların ‘asla gerçekliklerin nesnel bir temsilini sunmadığını’ öne sürüyorlar. Kameranın konumu, seçilen derinlik alanı ve aydınlatma tercihleri gibi faktörler, bir fotoğrafın derinlemesine öznel olmasını sağlar.

Kağıt, rutin ‘temizleme’ görevlerinin – Örneğin, sensör tozunu veya istenmeyen elektrik hatlarını otherwise iyi bir kompozisyondan kaldırma – sadece yarı otomatikleştirildiğini, AI’ın yükselişinden önce: kullanıcıların, istedikleri sonucu elde etmek için bir bölgeyi manuel olarak seçmeleri veya bir işlemi başlatmaları gerekiyordu.

Bugün, bu işlemler genellikle bir kullanıcı metin istemleri tarafından tetiklenmektedir, özellikle de Photoshop gibi araçlarda. Tüketici düzeyinde, bu özellikler artık kullanıcı girişi olmadan otomatik hale getiriliyor – bu, üreticiler ve platformlar tarafından apparently ‘açıkça arzu edilen’ bir sonuç gibi görünüyor.

‘Deepfake’ Teriminin Sulandırılmış Anlamı

AI tarafından değiştirilen veya oluşturulan görseller etrafındaki yasağın merkezinde bir zorluk, ‘deepfake’ teriminin belirsizliğidir, ki bu terimin anlamı son iki yıl içinde đáng kể ölçüde genişletilmiştir.

Öncelikle, terim sadece oto-encoder tabanlı sistemlerin video çıkışlarına uygulanıyordu, Örneğin DeepFaceLab ve FaceSwap, her ikisi de 2017’nin sonlarında Reddit’e gönderilen anonim kodlardan türetilmiştir.

2022’den itibaren, Latent Diffusion Models (LDMs) gibi Stable Diffusion ve Flux, ayrıca Sora gibi metin-videya sistemleri, kimlik değiştirme ve özelleştirme olanakları da sunuyor, geliştirilmiş çözünürlük, esneklik ve Sadıklık ile. Şimdi, ünlüleri ve politikacıları temsil edebilen difüzyon tabanlı modeller oluşturmak mümkündü.

Daha sonra, hem medyada hem de araştırma literatüründe, terim ayrıca metin tabanlı takliti de içerecek şekilde genişletildi. Bu noktada, ‘deepfake’ teriminin orijinal anlamı neredeyse kaybolmuş, genişletilmiş anlamı ise sürekli olarak evrim geçiriyordu ve giderek daha da sulandırılıyordu.

Ancak, söz konusu kelime bu kadar kışkırtıcı ve etkili olduğundan, ve şimdi güçlü bir siyasi ve medya referans noktası olduğundan, onu bırakmak imkansızdı. Web sitelerine okuyucuları çekiyor, araştırmacılara fon sağlıyor ve politikacılara dikkat çekiyordu. Bu sözlü belirsizlik, yeni araştırmanın ana odak noktasıdır.

Yazarlar, AB AI Yasasının 3(60). maddesinin, bir ‘deepfake’i tanımlayan dört koşulu içerdiğini gözlemliyor.

1: Gerçek Ay

İlk olarak, içerik üretilmeli veya değiştirilmelidir, yani ya AI kullanarak sıfırdan oluşturulmalı (üretme) ya da mevcut verilerden değiştirilmelidir (manipülasyon). Kağıt, ‘kabul edilebilir’ görüntü düzenleme sonuçları ile manipülatif deepfakes arasında ayrım yapmanın zorluğunu vurguluyor, çünkü dijital fotoğraflar her durumda gerçekliğin gerçek temsilleri değildir.

Çalışma, Samsung tarafından üretilen bir ayın muhtemelen otantik olduğunu savunuyor, çünkü ayın görünümü değişmeyecektir ve AI tarafından üretilen içerik, gerçek ay görüntüleri üzerinde eğitildiğinden, muhtemelen doğru olacaktır.

Ancak yazarlar, Samsung sisteminin ayın ‘geliştirilmiş’ bir resmini, kaynak resmin ay değil de bir monitörün resmi olduğu bir durumda ürettiğini de belirtiyorlar; bu, bir ‘deepfake’ olarak kabul edilecektir.

Bu tür bir ad hoc işlevsellik etrafındaki farklı kullanım durumlarının kapsamlı bir listesini oluşturmak pratik olmaz. Bu nedenle, tanım sorumluluğu yine mahkemelere geçiyor.

2: MetinSahteciliği

İkincisi, içerik görüntü, ses veya video formunda olmalıdır. Metin içeriği, diğer şeffaflık yükümlülüklerine tabi olsa da, AI Yasası altında bir deepfake olarak kabul edilmez. Yeni çalışmada bu, ayrıntılı olarak ele alınmıyor, ancak görsel deepfakes’in (aşağıya bakınız) etkinliğini önemli ölçüde etkileyebilir.

3: Gerçek Dünya Sorunları

Üçüncüsü, içerik mevcut kişiler, nesneler, yerler, varlıklar veya olayları andırmalıdır. Bu koşul, gerçek dünya ile bir bağlantı kurar, yani salt uydurma görüntüler, hatta fotoğrafik gerçekçilikte olsalar bile, bir deepfake olarak nitelendirilmeyecektir. AB AI Yasasının 134. girişi, ‘benzerlik’ yönünü ‘önemli ölçüde’ (apparent bir sonraki yasal yargılara ertelenmesi) kelimesini ekleyerek vurguluyor.

Yazarlar, daha önceki bir çalışmaya atıfta bulunarak, AI tarafından üretilen bir yüzün gerçek bir kişiye ait olup olmaması gerektiğini, veya sadece bir gerçek kişiye benzer olup olmaması gerektiğini sorguluyorlar.

Örneğin, nasıl olup da AI tarafından üretilen bir dizi fotogerçekçi görüntü, Donald Trump’u temsil etme amacını taşıyorsa, bu resimlere (veya eklenen metinlere) özellikle onu mention etmeden? Yüz tanıma? Kullanıcı anketleri? Bir yargıcın ‘sadece akıl’ tanımını kullanmak?

‘MetinSahteciliği’ sorununa geri dönersek (yukarıya bakınız), kelimeler genellikle görsel bir deepfake’nin eyleminin önemli bir kısmını oluşturur. Örneğin, ‘kişi a‘nın (değiştirilmemiş) bir resmini veya videosunu alabilir ve bir kaptiyon veya sosyal medya gönderisinde bu resmin ‘kişi b‘ye ait olduğunu söyleyebilirsiniz (iki kişinin birbirine benzediğini varsayarak).

Bu durumda, hiçbir AI gerekli değildir, ve sonuç etkileyici olabilir – ancak böyle bir düşük teknoloji yaklaşımı da bir ‘deepfake’ olarak kabul edilir mi?

4: Düzenle, Yeniden Modelle

Son olarak, içerik insana otantik veya doğru görünmelidir. Bu koşul, insan izleyicilerin algısını vurguluyor. Yalnızca bir algoritma tarafından gerçek bir kişi veya nesneyi temsil ettiği tanınan içerik, bir deepfake olarak kabul edilmeyecektir.

3(60)’daki tüm koşullar arasında, bu koşul en açık şekilde daha sonraki bir mahkeme kararına bırakıyor, çünkü teknik veya mekanize edilmiş araçlar aracılığıyla herhangi bir yorumlamaya izin vermiyor.

Bu öznel şartta mutabakata varmanın bazı içkin zorlukları vardır. Yazarlar, örneğin, farklı insanların, ve farklı tipte insanların (çocuklar ve yetişkinler gibi), belirli bir deepfake’ye inanma konusunda çeşitli şekillerde eğilimlidir.

Yazarlar ayrıca, Photoshop gibi araçların gelişmiş AI yeteneklerinin, ‘deepfake’lerin geleneksel tanımlarını挑戰 ettiğini belirtiyorlar. Bu sistemler, temel güvence önlemleri içerse de, tartışmalı veya yasaklanmış içeriklere karşı, ‘dokunuş’ kavramını dramatik bir şekilde genişletiyorlar. Kullanıcılar, nesneleri ekleyebilir veya kaldırabilir, çok ikna edici ve fotogerçekçi bir şekilde, profesyonellik düzeyinde bir gerçeklik elde edebilir, bu da görüntü manipülasyonunun sınırlarını yeniden tanımlar.

Yazarlar şunları söylüyor:

‘AB AI Yasasında ve karşılık gelen yükümlülüklerde deep fakes’in hiện tanımının, deep fakes tarafından oluşturulan zorluklarla başa çıkmak için yeterli olmadığını savunuyoruz. Dijital bir fotoğrafın yaşam döngüsünü, kamera sensöründen dijital düzenleme özelliklerine inceleyerek, şunları buluyoruz:’

‘(1.) AB AI Yasasında deep fakes kötü tanımlanmıştır. Tanım, bir deep fake’in ne olduğu için fazla geniş bir kapsam bırakıyor.

‘(2.) Google’ın “en iyi çekim” özelliği gibi düzenleme fonksiyonlarının şeffaflık yükümlülüklerine istisna olarak nasıl değerlendirileceği açık değildir. ‘

‘(3.) İçeriğin önemli ölçüde düzenlenmesi istisnası, önemli içerik düzenlemenin ne anlama geldiği ve bu düzenlemenin bir insan tarafından algılanabilir olup olmadığı konusunda sorular ortaya koyuyor.’

İstisnalar

AB AI Yasası, yazarların savunduğu gibi, çok geniş istisnalar içerir. 50(2) maddesi, yazarlara göre, bir orijinal kaynak resminin çoğunluğunun değiştirilmediği durumlarda bir istisna sunar. Yazarlar şunları belirtiyorlar:

’50(2) maddesinde belirtilen içerik, dijital ses, resim ve videoların durumunda ne olabilir? Örneğin, resimlerde, insanlara görünen pixel uzayını mı yoksa insan algısına göre görünen uzayı mı dikkate almalıyız? Pixel uzayındaki önemli manipülasyonlar, insan algısını değiştirmeyebilir ve ngượcine, pixel uzayındaki küçük pertürbasyonlar algıyı dramatik bir şekilde değiştirebilir.’

Araştırmacılar, bir resme bir el silahı eklemenin örneğini veriyorlar. Silahı ekleyerek, resmin sadece %5’ini değiştiriyorsunuz, ancak değiştirilen kısmın semantik anlamı önemli.

Bu nedenle, bu istisna, bir resmin genel anlamını etkileyebilecek bir ayrıntı hakkında ‘sadece akıl’ anlayışını dikkate almıyor gibi görünüyor.

50(2) maddesi ayrıca, ‘standart düzenleme’ için bir asistan işlevi istisnasına da izin veriyor. Ancak Yasa, ‘standart düzenleme’ ne demektedir, diye tanımlamadığından, Google’ın En İyi Çekim gibi aşırı post-işlem özellikleri bile bu istisna tarafından korunuyor gibi görünüyor, yazarlar gözlemliyor.

Sonuç

Yeni çalışmanın belirtilen amacı, deepfakes’in düzenlenmesine ilişkin disiplinler arası bir çalışma teşvik etmek ve bilgisayar bilimcileri ve hukukçular arasında yeni diyaloglar için bir başlangıç noktası olmaktır.

Ancak, çalışma kendisi, beberapa noktada tekrarlayıcı bir ifadeye düşüyor: ‘deepfake’ terimini, anlamının self-evident olduğu gibi kullanıyor, ancak AB AI Yasasını, aslında bir deepfake’in ne olduğunu tanımlamayı başaramadığı için eleştiriyor.

İlk olarak 16 Aralık 2024 Pazartesi günü yayımlanmıştır.