Düşünce Liderleri

Uygulamalı Bir Rehber için Savunulabilir LLM Çıktıları

Çoğu kuruluş GenAI dağıtımı boyunca sessiz bir varsayım vardır: çıktı doğru görünüyorsa, doğrudur. Düşük riskli ortamlarda, bu makul bir kısayoldur. Sağlık, finans, ilaç ve kalite güvence gibi düzenlenmiş endüstrilerde, bu bir sorumluluk beklenmeden ortaya çıkabilir.

Bir LLM çıktısı bir klinik kararı, finansal kaydı veya uyum belgesini etkilediği anda, akıcılık güvenilirliğin bir proxy’si olmaktan çıkar. Ve bir denetçi, düzenleyici veya hukuk ekibi hangi verilerin kullanıldığını, hangi kuralların uygulandığını ve kimin onayladığını sorduğunda, “model öyle dedi” kimse tarafından onaylanabilecek bir cevap değildir.

Bu, çoğu GenAI ekibinin tasarımını yapmadığı sorumluluk boşluğudur. İşte bunu nasıl kapatacağınızı anlatıyoruz.

“Doğru Görünüyor” Yanlış Standardı Neden

Geleneksel AI değerlendirme, doğruluk, gecikme ve maliyet üzerinde odaklanır. Bunlar önemlidir. Ancak düzenlenmiş ortamlar, diğerlerini ikame edemeyen dördüncü bir eksen getirir: denetlenebilirlik.

Şimdi yürürlükte olan AB AI Yasası, yüksek riskli AI sistemlerinin teknik belgeleri, izlenebilirlik günlüklerini ve insan denetimini tüm yaşam döngüleri boyunca korumalarını gerektirir. FDA’nın ilk AI rehberi yaşam bilimlerinde aynı yönde bir sinyal veriyor. Bu çerçeveler akıcılığa göre derecelendirmez. İnşaat edilebilir, incelenebilir ve savunulabilir sistemler gerektirir.

Savunulabilir bir LLM çıktısı, bir dizi kanıt zinciri aracılığıyla geri izlenebilen bir çıktıdır: hangi veriden çekildi, hangi kısıtlamalar şekillendirdi, kim inceledi ve gelecekteki incelemeler için ne saklandı. Bu zincir olmadan, hatta doğru bir çıktı savunulamaz.

Bu, düzenlenmiş ortamlardaki AI için “üretim hazır”ın anlamını yeniden tanımlar.

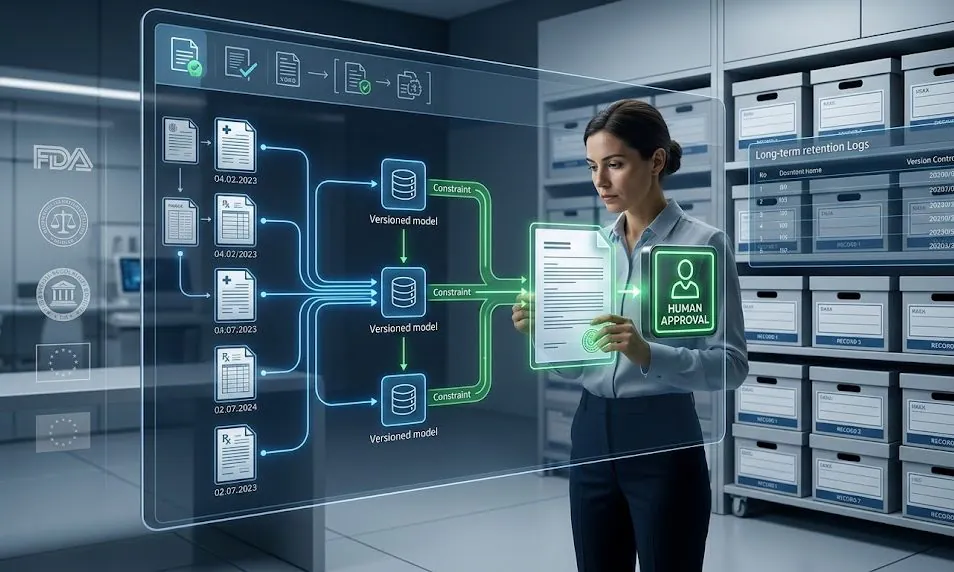

Denetlenebilir GenAI’nin Dört Direği

Savunulabilir LLM sistemleri oluşturmak, dört mühendislik gereksinimine indirgenir. Bunlar soyut ilkeler değil, altyapı kararlarıdır ve sisteminin incelemeye dayanabileceğini belirler.

1. Köken: Modelin Bilgilerini Nereden Aldığını Kontrol Edin

Kuruluş AI’de en yaygın başarısızlık modu aynı zamanda en az görünür olandır: modellerin genel bilgi veya gevşek tanımlanmış veri kaynaklarından yararlanmaları. Kontrollü bir bilgi sınırı yoksa, çıktılar denetlenebilir bir kaynağa geri izlenemez ve yeniden inşa edilemez.

Pratik bir çözüm, onaylanmış bir bilgi sınırı oluşturmaktır: sürümlenmiş, sahip belgeler ve veri kümeleri sistemi tarafından açıkça kullanılmaya izin verilir. Her cevap minimum kanıt paketi taşımalıdır: sürüm ve etkin tarih ile kaynak tanımlayıcı, sorgulanan ve seçilen şeyleri gösteren bir geri alma günlüğü ve iç alıntılar. Yararlı bir çalışma kuralı: alıntı yoksa, iddia yok.

Bu, sistemi bellek tabanlı üretimden kanıtlara dayalı akıl yürütmeye dönüştürür. Ayırım, jemandın belirli bir çıktıyı haftalar veya aylar sonra yeniden inşa etmesi gerektiğinde kritik olur.

2. Kısıtlamalar: Improvizasyonu Kontrollü Davranışla Değiştirin

LLM’ler ikna edici olmak için tasarlanmıştır. Kısıtlamalar olmadan, inandırıcılık için optimize edilirler ve düzenlenmiş bir bağlamda inandırıcılık riskin yaşandığı yerdir.

Kısıtlamalar, olasılıksal metin oluşturucuyu sınırlı bir yürütme bileşenine dönüştüren mekanizmadır. Uygulamada bu, aşağıdaki anlamlara gelir:

- Kaynak bağlı üretim: Her iddia onaylanmış, sürümlenmiş bir kaynağa ihtiyaç duyar. Kaynak yoksa, cevap yoktur — sadece ret veya yükseltme.

- Yapılandırılmış çıktı şemaları: Yanıtlar, makinelerin ve denetçilerin doğrulayabileceği tanımlanmış formatları izler, sadece okumaz.

- Güvenlik sınırı uygulaması: Alınan içerik girdi olarak ele alınır, güvenlik ve denetlenebilirlik açısından prompt-enjeksiyon risklerini doğrudan ele alır.

- En düşük ayrıcalık erişimi: Model yalnızca gerçekten ihtiyaç duyduğu veri ve araçlarla etkileşime girer, denetim izlerini temiz tutar.

Kısıtlamalar, bir uyum kontrol kutusu değildir. Sistemlerin denetlenebilir olup olmadığını belirleyen mimari karardır.

3. İnceleme: İnsan Denetimini Resmi Kontrol Katmanı Yapın

Düzenlenmiş AI’de insan incelemesi ad hoc नह olabilir. Risk stratifikasyonuna (daha yüksek riskli çıktılar daha katı doğrulamayı tetikler) ve olaya dayalı olarak ihtiyaç duyar, model güveni düşük, kaynaklar yoksa veya anormallikler tespit edildiğinde etkinleştirilir.

AB AI Yasası açıkça gerektirir ki, insanlar yüksek riskli kullanım durumlarında AI tarafından yönlendirilen kararları yorumlayabilsin, geçersiz kılabilir ve durdurabilsin. Bu gereksinimi karşılamak, inceleme kayıtlarının kimin bir çıktıyı onayladığını, hangi koşullar altında ve hangi düzeyde incelemeyle onayladığını yakalaması gerekir. “Birisi kontrol etti” bir kontrol değildir. Belgelenmiş, zaman damgalı bir inceleme kaydı vardır.

Bu, incelemeyi manuel QA’dan resmi bir yönetim katmanına yükseltir, ki bu da düzenleyicilerin başladığı şekilde davranır.

4. Saklama: Hesap Verebilirliği Sürdürülebilir Yapın

Günlükler olmadan, bir denetim izi yoktur. Bir denetim izi olmadan, hesap verebilirlik teoriktir.

Aynı zamanda her şeyi saklamak kendi risklerini yaratır, özellikle sağlık veya finansal veriler gibi hassas veriler minimum gereksinimlere tabi olduğunda GDPR veya HIPAA gibi çerçeveler altında.

Pratik yaklaşım, bir tiered modeldir. Model ve sürüm meta verilerini, kaynak tanımlayıcılarını, politika kararlarını ve zaman damgalarını her zaman saklayın. Etkileşim içeriğini (prompts, çıktılar ve tam izleri) risk sınıflandırmasına göre seçici olarak saklayın, uygun redaksiyon ve erişim kontrolleriyle birlikte. Hedef, herhangi bir çıktının yeniden inşa edilmesini sağlamak zonder fazla veri toplamak.

Pratikte Nasıl Görünür

Hayat bilimlerinde nasıl uygulandığını düşünün, burada CFR 21 Bölüm 11 elektronik kayıtların atanabilir, okunabilir, güncel, orijinal ve doğru olmasını gerektirir. Düzenleyici belgeler oluşturan bir LLM, bu beş kriteri karşılamalıdır – sadece okunabilir metin üretmez.

Bu bağlamda, dört direk seçeneğin değil, uyumlu bir sistemin minimum barıdır. Köken, çıktının atanabilir ve orijinal olmasını sağlar. Kısıtlamalar, tanımlanmış sınırlar içinde kalmasını sağlar. İnceleme, insan denetiminin güncel olmasını sağlar. Saklama, incelenebilir ve denetlenebilir olmasını sağlar.

Aynı mantık, finansal hizmetlerde de uygulanır, burada MiFID II kararların ve bunların arkasındaki nedenlerin kayıtlarını gerektirir ve sağlık hizmetlerinde, klinik karar destek sistemleri açıklanabilirlik ve yanlılık üzerine artan bir inceleme altına girer.

Daha Büyük Değişim

GenAI, deneyselden operasyonel altyapıya geçiyor. Bu geçiş, kabul edilebilir sistemlerin görünümünü yükseltiyor.

Yalnızca faydalı bir çıktı yeterli değil. Kuruluşlar, AI’ın gerçek sonuçlar taşıyan şeyleri yapmasını istediği için, açıklanabilir, izlenebilir ve denetim altında savunulabilir çıktılara ihtiyaç duyar.

Savunulabilirlikten başlayarak tasarlayan ekipler, AI’ı güvenli bir şekilde ölçeklendirme ve düzenleyici güveni sürdürme konumunda olacaklar. Bunu yapmayanlar, sonunda aynı anda yüzleşecekler: bir denetim, belirli bir çıktı hakkında basit bir soru ve gösterilecek bir şey yok.

Denetlenebilir AI oluşturmak, yavaşlatmak değil, dayanıklı bir şey oluşturmaktır.