Anderson’un Açısı

Araştırma ChatGPT’nin Haber Sağlayıcısı Olarak Yüksek İnanılırlığa Sahip Olduğunu Öneriyor

Yeni bir araştırma, ChatGPT’nin gerçeklik kontrol etiketlerinin, beğeniler, paylaşımlar ve hatta güvenilir haber markalarından daha fazla insanların neye inandığına ve online olarak neler paylaştığına şekil verdiği sonucuna varıyor.

1.000 kişi üzerinde yapılan bir çalışmada, ChatGPT’nin siyasi haberlere güvenilirlik puanı verdiği zaman, insanların neye inandığı ve paylaşıp paylaşmadığı değiştiği bulundu. Daha geleneksel etkileyen faktörler gibi beğeniler veya paylaşımlar çok fazla etki etmedi, ancak yapay zekanın yargısı, haberlerin ne kadar güvenilir göründüğünü güçlü bir şekilde şekillendirdi:

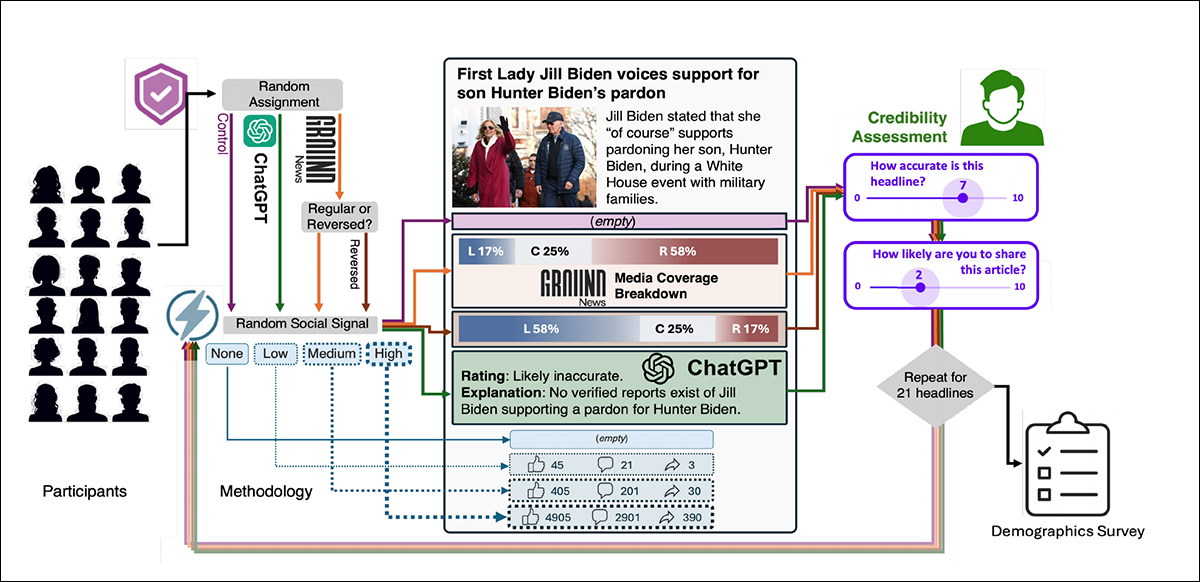

![Yeni makaleden, insanların bir haber başlığını nasıl değerlendirdiğini gösteren bir illüstrasyon, üç etkileşimli ipucu temelinde: hikaye onların siyasi kimliğiyle uyumlu mu; sosyal medyada ne kadar etkileşim gördüğü; ve kurumlar veya yapay zeka sistemleri tarafından sağlanan güvenilirlik sinyalleri. Bu etkiler, algılanan doğruluk ve içerik paylaşma olasılığını şekillendirmek için birleşir. [ Kaynak ] https://arxiv.org/pdf/2511.02370](https://www.unite.ai/wp-content/uploads/2025/11/figure-1.jpg)

Yeni makaleden, insanların bir haber başlığını nasıl değerlendirdiğini gösteren bir illüstrasyon, üç etkileşimli ipucu temelinde: hikaye onların siyasi kimliğiyle uyumlu mu; sosyal medyada ne kadar etkileşim gördüğü; ve kurumlar veya yapay zeka sistemleri tarafından sağlanan güvenilirlik sinyalleri. Bu etkiler, algılanan doğruluk ve içerik paylaşma olasılığını şekillendirmek için birleşir. Kaynak

Yapay zeka özetlerinin ne kadar güvenilir haber kaynakları olarak alındığı, belki de medyadaki birçok yıl için en önemli konulardan birisidir, özellikle de Google’ın yapay zeka özetlerinin 2025 yılında çoğu büyük online medya kuruluşundan trafiği çekmesi ve bu güç aktarımının nereye gideceği konusunda hiçbir kesinlik olmaması nedeniyle.

Çalışmanın yazarları şunları söylüyor:

‘Bu bulgular, algoritmik geri bildirimin kamu anlayışını şekillendirmedeki potansiyelini ve riskini vurguluyor. Yapay zeka tarafından üretilen ipuçları, önyargıyı azaltmaya ve güvenilirlik takdirini artırmaya yardımcı olabilir, ancak etkileri siyasi kimlik tarafından değişir ve aşırı bağımlılıkla ilgili etik riskler taşır […]

‘…ChatGPT’nin etkisinin büyüklüğü, kritik bir ticaret-offı vurguluyor: yapay zeka geri bildirimi ikna edici olabilir, ancak eleştirel düşünceyi yerleştirmek için dikkatli bir şekilde çerçevelenmelidir.’

Yazarlar, gelecekteki araştırmaların, daha bağımsız ve bilinen gerçekleri destekleyen geliştirilmiş yapay zeka güvenilirlik müdahalelerine odaklanması gerektiğini ve bu konunun, özellikle kutuplaşan konularda çok önemli olduğunu gözlemliyor.

ChatGPT’nin ‘otorite’ olarak görünür yükselişi ve paylaşımların düşük etkisinin yanı sıra, araştırmacıların testlerinin bir başka ilginç sonucu, demografi ve cinsiyetle ilgilidir:

‘Kadınlar ve ırksal olarak azınlık katılımcılar (özellikle Siyah ve Latine kullanıcılar) yapay zeka tabanlı geri bildirime kurumsal etiketlerden daha olumlu yanıt verdiler.’

Yeni çalışma, Yapay Zeka Güvenilirlik Sinyalleri, Sosyal Medyada Haber Algısını Şekillendirmede Kurumlar ve Etkileşimi Aşiyor başlığını taşıyor ve Notre Dame Üniversitesi’nden üç araştırmacı tarafından gerçekleştiriliyor.

Makalenin yöntemlerine ve sonuçlarına daha yakından bakalım.

Yöntem

Dört hipotez test edildi: insanların siyasi görüşlerine uyan haber başlıklarını daha doğru olarak değerlendireceği; yapay zeka tarafından üretilen güvenilirlik puanlarının kurumsal sinyallerden daha etkili olacağı; yüksek etkileşime sahip haber başlıklarının daha güvenilir olarak görüleceği; ve kullanıcıların yapay zeka sisteminin haber başlığının doğruluğuna ilişkin yargısına uyacağı – hatta kendi inançlarına aykırı olsa bile.

Çalışmada katılımcılar, Prolific platformundan sağlandı ve İngilizce bilmeleri, haberleri düzenli olarak tüketmeleri ve bir dizi rasgeleleştirme işlemi aracılığıyla katılımcıların ırksal ve cinsiyet açısından çeşitli bir grup temsil etmesi gerekiyordu.

Deneyde*, katılımcılar dört gruba ayrıldı ve her gruba farklı bir tür geri bildirim verildi.

İlk grupta (kontrol koşulu), haber başlıklarının güvenilirliği hakkında ek bilgi verilmedi; ikinci grupta, haber başlıkları GroundNews tarafından sağlanan bir önyargı derecesi ile etiketlendi, bu hizmet haber kaynaklarını sol-, merkez- veya sağ- eğilimli olarak sınıflandırıyor.

Üçüncü grupta aynı GroundNews etiketleri görüntülendi, ancak kasıtlı olarak tersine çevrilerek, kullanıcıların bu bozulmayı tespit edip edemeyeceğini test etmek için bir uyumsuzluk oluşturuldu.

Son gruba, kısa bir açıklama ve “muhtemelen yanlış” gibi bir derecelendirme ile birlikte ChatGPT tarafından yazılan güvenilirlik değerlendirmeleri gösterildi:

Deneyin kavramsal şeması: her katılımcı, güvenilirlik etiketleri ve sosyal etkileşim sinyallerinin çeşitli kombinasyonları ile siyasi haber başlıkları gördü. Her bir başlığın doğruluğu ve paylaşılma olasılığı hakkında cevaplar toplandı ve tüm dizi 21 madde boyunca tekrarlandı.

Veri ve Testler

Her katılımcı, 21 siyasi haber başlığı dizisi gösterildi. Her başlık için sosyal etkileşim düzeyi değişti; bazen hiç beğeni veya paylaşım göstermedi, bazen çok fazla.

Haber başlıkları kendileri, çeşitli siyasi perspektiflerden geldi ve sol-egilimli, sağ-egilimli veya merkezci olarak etiketlendi.

Her başlık之后, katılımcılardan başlığın ne kadar doğru olduğu ve paylaşıp paylaşmayacağı soruldu. Her katılımcı zaten kendi siyasi bağlılığını belirtmişti, bu nedenle başlıkların kendi siyasi spektrumundan gelenlerin daha olumlu değerlendirilip değerlendirilmediğini analiz etmek mümkündü.

Katılımcılar her başlığı iki kez puanladı: birincisi doğruluk için, ikincisi paylaşma olasılığı için, cevapları 0-10 ölçeğinde ölçüldü.

Araştırmacılar bu cevapları ek verilerle birleştirdi: her katılımcının demografik ve medya kullanım bilgileri; her başlığın siyasi etiketi; gösterilen güvenilirlik sinyalinin türü; ve atanmış sosyal etkileşim düzeyi.

Siyasi Kimliğin Etkisi

İlk test, insanların kendi siyasi görüşlerine uyan haber başlıklarını daha doğru olarak değerlendireceğini sordu ve sonuçlar, katılımcıların kendi siyasi görüşlerine uyan başlıkları daha doğru olarak değerlendirdiğini, ancak bu etkilerin gruba göre değiştiğini gösterdi.

Moderatlar, kendi tarafındaki başlıkları daha doğru olarak değerlendirmeye en çok eğilimliydiler, जबकi liberaller ve muhafazakarlar, merkezci başlıklara daha çok güvendi; ve genel olarak, nötr başlıklar, sol veya sağ-egilimli başlıklardan daha doğru olarak değerlendirildi.

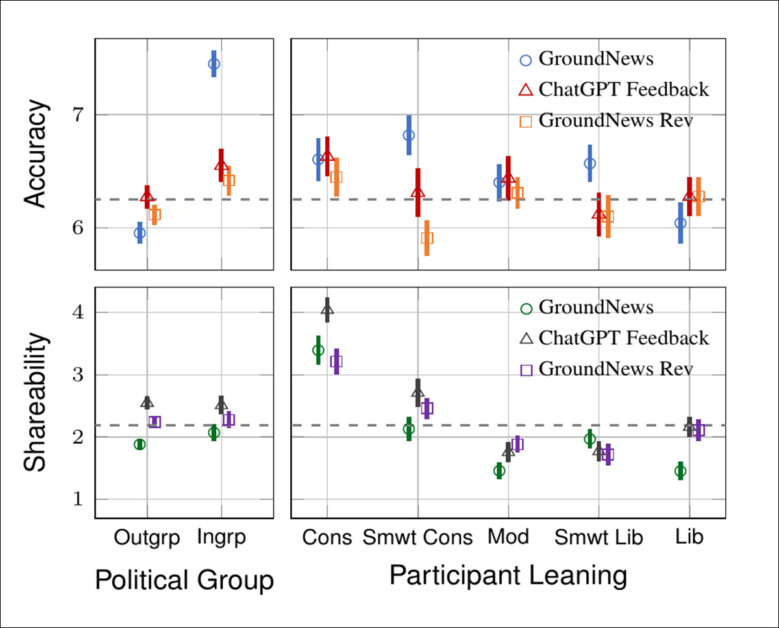

Haber başlıklarının siyasi duruşuna ve katılımcının siyasi bağlılığına göre doğruluk ve paylaşılabilirlik puanlarının nasıl değiştiği gösteren bir illüstrasyon. Moderatlar, ‘grup içi’ başlıkları daha doğru olarak değerlendirmeye en çok eğilimliydiler, जबकi liberaller ve muhafazakarlar, merkezci başlıkları tercih ettiler. Paylaşım davranışı benzer bir modeli izledi, moderat grup dışında sınırlı bir ‘grup içi’ önyargısı ile.

Bu ilk deneyin sonuçlarında, moderatlar için paylaşımlar üzerinde bir ‘grup içi’ etkisi bulundu; ancak liberaller ve muhafazakarlar böyle bir eğilim göstermedi.

Varyans analizi (ANOVA), gruplar arasındaki farklılıkları tespit etmek için kullanılan bir yöntem, paylaşımların yalnızca siyasi kimlik ile etkileşime girdiğinde etkilendiğini gösterdi. Güvenilirlik ve paylaşım arasında bir bağlantı vardı, ancak yalnızca moderatlar her iki alanda da net bir model gösterdi.

Kurumsal Karşıtı Yapay Zeka Güvenilirliği

Sonraki test, insanların yapay zeka derecelendirmelerine geleneksel kaynaklara, özellikle de haber derecelendirme web sitelerine, göre daha fazla güvendiğini sordu – özellikle de derecelendirmeler siyasi görüşlerine aykırı olduğunda:

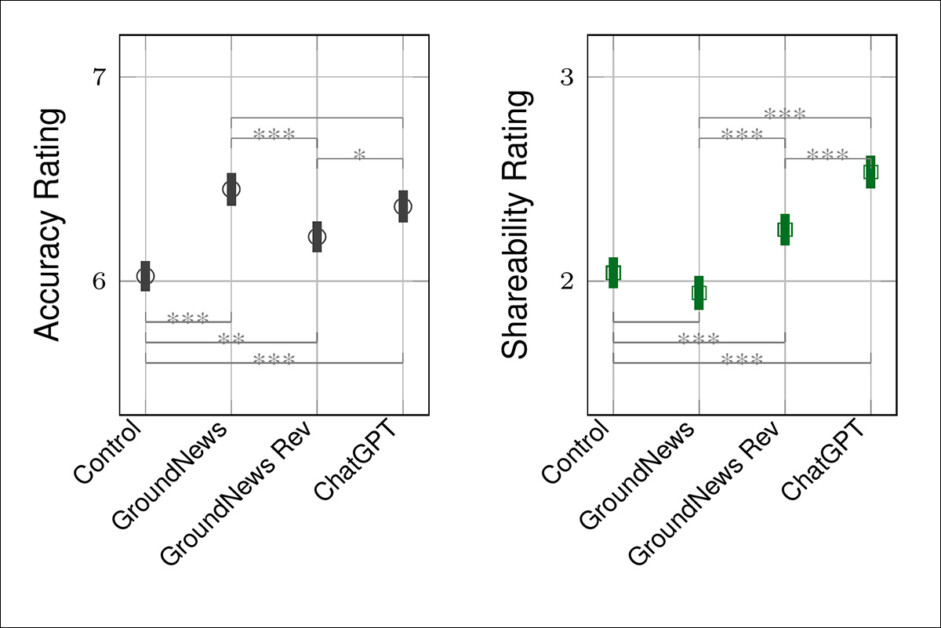

Geri bildirim kaynaklarına göre güvenilirlik ve paylaşılabilirlik puanları: tüm üç sinyal, kontrol grubuna göre doğruluğu artırdı, GroundNews en yüksek puanları verdi. Ancak ChatGPT, paylaşılabilirlikte en büyük kazançları sağladı, daha geniş bir ikna edici etkiye sahip olduğunu gösteriyor. Hata çubukları %95 güven aralığını gösteriyor, ve asteriskler önemli çift yönlü farklılıkları işaret ediyor.

Tüm geri bildirimi artırdı algılanan doğruluk; ancak GroundNews, kullanıcıların siyasi görüşlerine uyduğunda en etkiliydi.

ChatGPT, tüm gruplar boyunca doğruluk puanlarını artırdı, tarafsız olarak görüldüğünü gösteriyor. Muhafazakarlar, GroundNews’den daha az etkilenirken, ChatGPT’ye diğer gruplarla benzer şekilde yanıt verdiler:

Burada ChatGPT geri bildiriminin algılanan doğruluk üzerindeki etkilerini görebiliriz. Sonuçlar, kurumsal sinyallere güvenin, uyuma bağlı olduğunu, ancak algoritmik sinyallere güvenin böyle olmadığını doğruluyor. ChatGPT, tüm gruplar boyunca hem güvenilirlik hem de paylaşılabilirliği artırdı – özellikle muhafazakarlar için.

Sosyal Metriklerin Az Etkisi

Üçüncü analiz, görünen sosyal etkileşim ipuçlarının, sosyal kanıt olarak hareket ederek güvenilirliği veya paylaşılabilirliği artırıp artırmadığını test etti; ancak böyle bir etki gözlemlenmedi.

Testler, beğeni, paylaşım veya yorum gibi etkileşim seviyelerinin, haber başlıklarının ne kadar doğru göründüğüne gerçek bir etkisi olmadığını, ancak paylaşılabilirlik üzerinde zayıf ve güvenilemeyen bir etkisi olduğunu gösterdi; algoritmik veya kurumsal sinyallerin aksine, bu sosyal ipuçları bu ortamda yargılara etki etmedi.

Yapay Zeka Geri Bildirimi Ne İnanıldığını Etkiliyor

Dördüncü ve son deney, kullanıcıların güvenilirlik ve paylaşım yargılarını, ChatGPT tarafından oluşturulan etiketlere göre ayarlayıp ayarlamadığını test etti: doğru; kısmen doğru; doğrulanmamış; veya yanlış, hepsi ChatGPT tarafından atanmıştı.

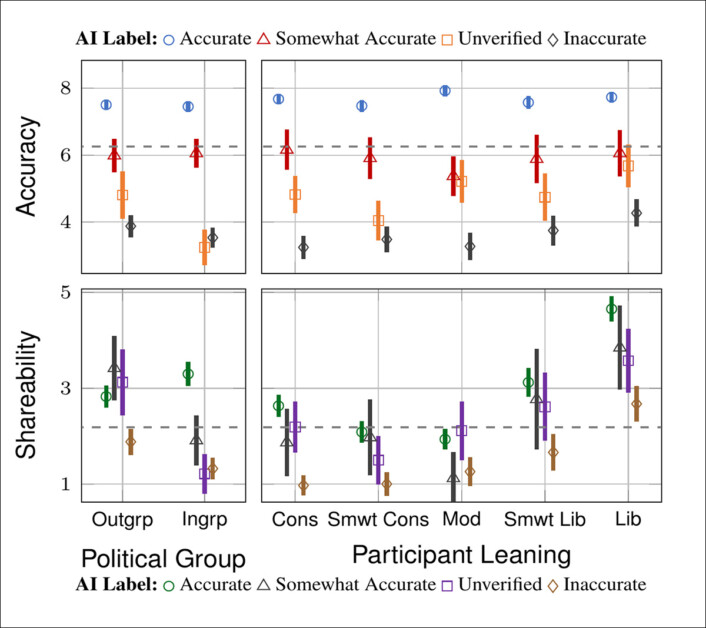

Katılımcılar, yapay zeka tarafından üretilen güvenilirlik etiketlerine güçlü bir şekilde yanıt verdiler. Doğruluk puanları, ChatGPT’nin geri bildirimi ile birlikte yükseldi veya düştü, en büyük etkiler “doğru” veya “yanlış” olarak etiketlenen başlıklarda görüldü:

ChatGPT geri bildirimi, hem doğruluk hem de paylaşılabilirlik puanlarını etkiledi. Üst: Doğruluk puanları, daha olumlu etiketlerle birlikte yükseldi, özellikle ‘Doğru’ olarak işaretlenen başlıklarda, ve ‘Yanlış’ olarak etiketlenenlerde düştü. Alt: Paylaşılabilirlik benzer bir modeli izledi, ancak gruplar arasında daha fazla varyasyon gösterdi: liberaller, olumsuz ipuçlarına daha güçlü bir şekilde yanıt verirken, muhafazakarlar daha az değişim gösterdi.

Siyasi kimlik, bu etkileri şekillendirdi, kullanıcıların ChatGPT’ye kendi görüşlerine uyduğunda daha fazla güvendiği görüldü.

Paylaşım davranışı benzer bir modeli izledi: ‘grup içi’ başlıklar, özellikle ‘kısmen doğru’ gibi belirsiz etiketlerle birlikte, en sık paylaşıldı.

Bu sonuçlar, makaleye göre, yapay zeka geri bildiriminin kullanıcı davranışını değiştirebileceğini ve ayrıca partizan bölünmeleri pekiştirebileceğini veya eleştirel düşünceyi cesaretlendirmeyebileceğini öne sürüyor.

Kimler Yapay Zekaya En Çok Güveniyor?

Takip eden analiz, kullanıcı demografisinin güvenilirlik etiketlerine nasıl tepki verdiğini inceledi. ChatGPT’nin geri bildirimi, genel olarak doğruluk puanlarını artırdı, ancak bu etki, yüksek eğitimli kullanıcılar ve sık sosyal medya tüketicileri arasında daha zayıftı, bu grupların daha fazla şüpheci davrandığı görüldü.

Bu aynı gruplar, GroundNews ve ters etiketlere olumsuz tepki verdi, bu durumun, açık önyargı işaretlerinin daha medya okuryazarı kullanıcıları uzaklaştırabileceğini öne süren makaleyi desteklediğini öne sürüyor.

Buna karşılık, kadınlar ve ırksal olarak azınlık katılımcılar, özellikle Siyah ve Latine kullanıcılar, ChatGPT’ye kurumsal sinyallere göre daha olumlu yanıt verdi:

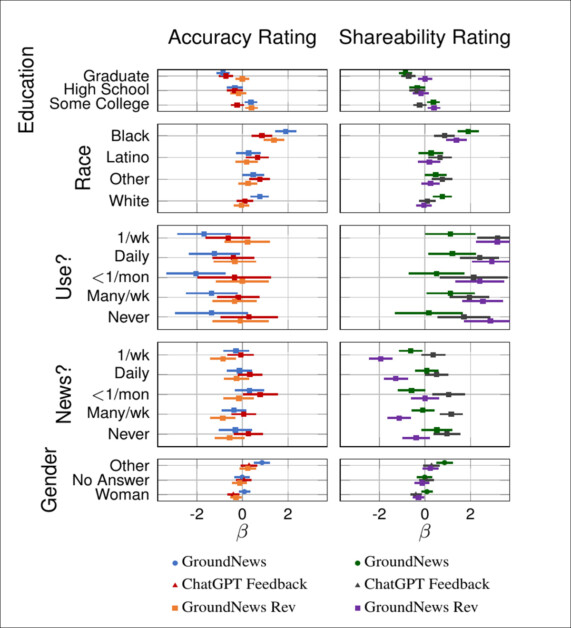

Demografik grupların farklı geri bildirim türlerine tepkileri, her panelin belirli bir grubun farklı güvenilirlik sinyallerine nasıl tepki verdiğini gösteriyor. ChatGPT’nin derecelendirmeleri, doğruluk üzerinde en güçlü ve en tutarlı etkiye sahipti, जबकi paylaşılabilirlik üzerindeki etkileri menos tutarlıydı, ırk, cinsiyet ve medya kullanımına göre değişiyordu.

Paylaşım davranışı da bu ayrıma uydu: GroundNews, sosyal medya kullanıcıları ve haber meraklıları arasında paylaşılabilirliği en keskin şekilde azalttı, जबकi ChatGPT’nin etkileri daha karışıktı, bazı gruplarda sogar paylaşılabilirliği artırırken, özellikle yüksek lisans derecesine sahip olanlar tüm geri bildirim türlerine karşı daha duyarlıydı.

Yazarlar şöyle diyor:

‘Bu bulgular, sosyo-teknik sistemlerde güvenilirlik müdahalelerinin tasarımına doğrudan etkileri vardır. Kullanıcılar, algoritmik geri bildirime giderek daha fazla etkileniyor, bu da kurumsal ipuçlarını geçersiz kılabilir ve partizan önyargısını azaltabilir – ancak aynı zamanda aşırı bağımlılığa yol açabilir.’

‘Kurumsal sinyaller, bazı kullanıcılar için hala etkili kalıyor, ancak etkileri, siyasi kutuplaşma veya düşük güvenirlik ortamlarında azalıyor. Öte yandan, beğeni, paylaşım veya yorum gibi etkileşim metrikleri, sosyal bağlam olmadan sunulduğunda, ikna edici değerlerini kaybettiğini gösteriyor.’

‘Haberlerin adil ve bilgilendirilmiş değerlendirmesini desteklemek için, yapay zeka tarafından yönlendirilen müdahalelerin şeffaf, açıklamalı ve kullanıcı ajansını güçlendirmek için tasarlanması gerekiyor. ‘

‘Gelecek çalışmalar, bu mekanizmaları daha ekolojik olarak geçerli ortamlarda incelemeli, alternatif yapay zeka güvenilirlik çerçevelerini değerlendirmeli ve çeşitli siyasi perspektifler arasında eleştirel katılımı teşvik eden uyarlanabilir sistemler geliştirmelidir.’

Sonuç

Mevcut tüm yapay zeka sistemlerinin hayal görme ve gerçeği çarpıtma eğilimine sahip olduğu dikkate alındığında, ChatGPT’nin benimsenmesinin, bu sistemlerin mimarilerinin haklı çıkaramayacağı veya destekleyemeyeceği bir güven atlayışını temsil ettiği endişe vericidir.

Yapay zeka temsilinin haber kaynağı olarak alındığı bir sorun, etkili sistemlerin eksikliğidir, bu sistemler haber kaynaklarını ‘siyasi olarak bağlı’ veya siyasi spektrumun bir ucuna veya diğerine eğilimli olarak bağlayabilir.

Hatta en saygın fourth-estate kaynakları arasında, hangi konuların kapsandığı ve hangilerinin kapsanmadığı, kendiliğinden bir siyasi beyan olarak kabul edilebilir. Şu anda ne ChatGPT ne de onun benzerleri, bu yorumcu önyargı katmanlarını gezinmeye yeterli değildir ve bu konu, net sonuçlar yerine tartışma davet ediyor.

Bir başka sorun, bu tür sistemlerin, insanlık tarihinin 80 yılındaki en kutuplaşmış ve bölünmüş bir döneminde ortaya çıkması ve toplumun ‘alternatif seslere’ en çok kulak verdiği bir zamanda ortaya çıkmasıdır – teknoloji, dünya gerçeğinin 필tre bir filtre olarak değil, bir istatistiksel olasılık tahmini olarak sunuluyor.

* Araştırmacılar, bunun ayrıntılarını online olarak paylaştı (bkz. Kaynak makale, 2. sayfanın alt kısmı için URL’ler). Ancak bu verileri görüntülemek için kayıt gerektiğinden ve ben bu konuyu o aşamada daha fazla ilerletmediğim için, bu verilerin tamamen ücretsiz olarak görüntülenebileceğini teyit edemiyorum.

İlk olarak Çarşamba, 5 Kasım 2025’te yayımlandı