Yapay Zekâ

Çoğul Modlu AI, ChatGPT’nin GPT-4V (Görüş) ile Görme Kazanmasıyla Evrilir

AI’yi insanlara benzer yapmak için devam eden çabalarda, OpenAI’nin GPT modelleri sürekli olarak sınırları zorluyor. GPT-4 artık metin ve görsellerin her ikisine de promt kabul edebiliyor.

Çoğul modlu üretken AI, bir modelin metin, görsel veya ses gibi çeşitli çıktılar üretme yeteneğini ifade eder. Bu modeller, belirli verilerle eğitilir ve benzer yeni veri üretmek için altta yatan kalıpları öğrenir, böylece AI uygulamalarını zenginleştirmiş olurlar.

Çoğul Modlu AI’de Son Gelişmeler

Bu alanda dikkat çekici bir ilerleme, DALL-E 3’ün ChatGPT’ye entegrasyonu ile görülüyor. Bu birleşme, ChatGPT’nin DALL-E 3 için kesin promt’lar oluşturmasını sağlıyor ve kullanıcı fikirlerini canlı AI tarafından üretilen sanata dönüştürüyor. Böylece, kullanıcılar doğrudan DALL-E 3 ile etkileşime girebilse de, ChatGPT’nin karışması AI sanatının oluşturulma sürecini çok daha kullanıcı dostu hale getiriyor.

DALL-E 3 ve ChatGPT ile entegrasyon hakkında daha fazla bilgi edinmek için buraya bakın. Bu işbirliği, yalnızca çoğul modlu AI’deki ilerlemeyi göstermekle kalmaz, aynı zamanda AI sanatının oluşturulmasını kullanıcılar için çok daha kolay hale getirir.

Google’ın sağlık bölümü, bu yıl Haziran ayında Med-PaLM M’yi tanıttı. Bu, çeşitli biyomedikal verilerin kodlanmasını ve yorumlanmasını yapan bir çoğul modlu üretken modeldir. Bu, PaLM-E adlı bir dil modelinin, bir açık kaynak benchmark olan MultiMedBench kullanarak tıbbi alanlara hizmet vermek üzere ayarlanmasıyla gerçekleştirildi. Bu benchmark, 7 biyomedikal veri türünde ve tıbbi soru-cevap gibi 14 görevde 1 milyondan fazla örnek içerir.

Çeşitli endüstriler, iş büyümesini hızlandırmak, operasyonları basitleştirmek ve müşteri etkileşimini artırmak için yenilikçi çoğul modlu AI araçlarını benimsemektedir. Ses, video ve metin AI yeteneklerindeki ilerleme, çoğul modlu AI’nin büyümesini hızlandırıyor.

İşletmeler, iş modellerini ve süreçlerini değiştirebilecek, veri araçlarından ortaya çıkan AI uygulamalarına kadar tüm üretken AI ekosisteminde büyüme yollarını açabilecek çoğul modlu AI uygulamalarını aramaktadır.

GPT-4’ün Mart ayında piyasaya sürülmesinden sonra, bazı kullanıcılar zamanla yanıt kalitesinde bir düşüş gözlemledi, bu endişe dikkat çekici geliştiriciler ve OpenAI forumlarında dile getirildi. İlk olarak OpenAI tarafından reddedilen bir sonraki çalışma, sorunu doğruladı. Mart ve Haziran arasında GPT-4’ün doğruluğunda %97,6’dan %2,4’e bir düşüş olduğunu ortaya koydu, model güncellemeleriyle birlikte yanıt kalitesinde bir düşüş olduğunu gösterdi.

Open AI’nin ChatGPT’sine ilişkin heyecan şimdi geri döndü. Şimdi bir görüş özelliği GPT-4V ile geliyor, böylece kullanıcılar GPT-4’ü kendilerine verilen görselleri analiz etmesini sağlayabiliyor. Bu, kullanıcılarla etkileşimi metinden görsellere taşıyan en yeni özelliktir.

Büyük dil modellerine (LLM’ler) gibi GPT-4’e görüntü analizi eklemek, bazıları tarafından AI araştırmaları ve geliştirmeleri açısından büyük bir adım olarak görülüyor. Bu tür bir çoğul modlu LLM, yeni arayüzler sunmak ve yeni tür görevleri çözmek için dil modellerini metnin ötesine taşıyor, böylece kullanıcılar için yeni deneyimler yaratıyor.

GPT-4V’nin eğitimi 2022’de tamamlandı ve erken erişim Mart 2023’te sunuldu. GPT-4V’deki görsel özellik, GPT-4 teknolojisini kullanıyor. Eğitim süreci aynı kaldı. İlk olarak model, bir metinde sonraki kelimeyi tahmin etmek için büyük bir metin ve görsel veri setinden oluşan bir veri setiyle eğitildi.

Daha sonra, insanların tercih ettiği çıktıları üretmek için insan geri bildirimi pekiştirmesinden (RLHF) yararlanarak daha fazla veri ile ayarlandı.

GPT-4 Görüş Mekaniği

GPT-4’ün dikkat çekici görüş-dil yetenekleri, etkileyici olsa da, altta yatan yöntemler bềzinin üzerinde kalıyor.

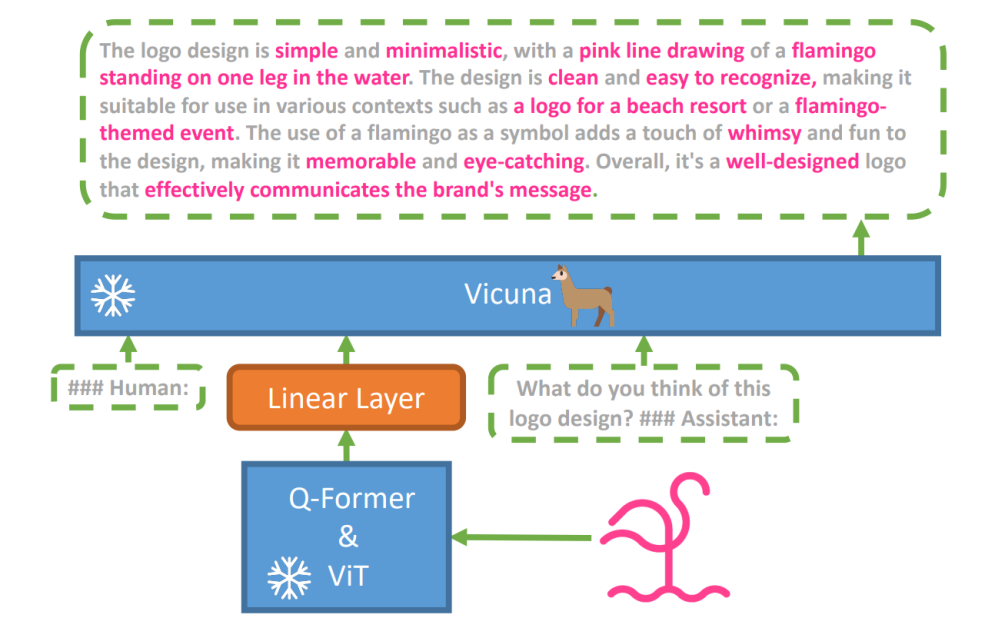

Bu hipotezi keşfetmek için, bir görüş-dil modeli olan MiniGPT-4 tanıtıldı. Bu model, görsel algı için önceden eğitilmiş bileşenleri olan bir görüş kodlayıcısını kullanıyor ve kodlanmış görsel özelliklerini, bir tek proje katmanıyla Vicuna dil modeliyle hizalıyor. MiniGPT-4’ün mimarisi basit ancak etkili, görsel ve dil özelliklerini hizalamaya odaklanarak görsel sohbet yeteneklerini geliştirmeye yönelik.

MiniGPT-4’ün mimarisi, önceden eğitilmiş ViT ve Q-Former ile bir görüş kodlayıcısını, tek bir lineer proje katmanını ve gelişmiş bir Vicuna büyük dil modelini içerir.

Görüş-dil görevlerinde otoregresif dil modellerinin trendi de büyüyor, dil ve çoğul modlu alanlar arasında bilgi paylaşmak için çapraz modlu aktarımı kullanıyor.

MiniGPT-4, önceden eğitilmiş bir görüş kodlayıcısından görsel bilgileri Vicuna dil modeliyle hizalıyor. Model, Vicuna’yı dil dekoderi olarak kullanıyor ve iki aşamalı bir eğitim yaklaşımı izliyor. İlk olarak, büyük bir görüntü-metin çiftleri veri setiyle görüş-dil bilgisi kazanmak için eğitiliyor, daha sonra daha küçük, yüksek kaliteli bir veri setiyle reliability ve usability’yi artırmak için ayarlanıyor.

MiniGPT-4’te üretilen dilin doğalNESS ve kullanılabilirliğini geliştirmek için, araştırmacılar iki aşamalı bir hizalama süreci geliştirdiler, bu da yeterli görüş-dil hizalama veri setlerinin eksikliğini ele aldı. Bu amaçla özel bir veri seti oluşturdular.

İlk olarak model, girişteki görsellerin ayrıntılı açıklamalarını üretiyor, Vicuna dil modelinin formatına uygun bir sohbet promt’u kullanarak ayrıntıları artırıyor. Bu aşama, daha kapsamlı görüntü açıklamaları üretmeyi amaçlıyordu.

İlk Görüntü Açıklama Promt’u:

###İnsan: <Img><ImageFeature></Img>Bu görüntüyü ayrıntılı olarak açıklayın. Gördüğünüz her şeyi söyleyin. ###Asistan:

Veri sonrası işleme için, üretilen açıklamalardaki tutarsızlıklar veya hatalar, ChatGPT kullanılarak düzeltiliyor ve ardından yüksek kaliteli garantisi için manuel olarak doğrulanıyor.

İkinci Aşama Ayar Promt’u:

###İnsan: <Img><ImageFeature></Img><Instruction>###Asistan:

Bu keşif, GPT-4 gibi çoğul modlu üretken AI’nin mekaniklerini anlamaya bir pencere açıyor, görüş ve dil modellerinin nasıl etkili bir şekilde entegre edilebileceğini ve bağlamsal olarak zengin çıktılar üretebileceğini gösteriyor.

GPT-4 Görüş’ü Keşfetmek

Görüntü Kaynaklarını Belirlemek ile ChatGPT

GPT-4 Görüş, ChatGPT’nin görselleri analiz etme ve coğrafi kaynaklarını belirleme yeteneğini güçlendiriyor. Bu özellik, kullanıcı etkileşimlerini metinden görsellere taşıyor ve görüntü verisi aracılığıyla farklı yerler hakkında meraklı olanlar için kullanışlı bir araç haline geliyor.

Karmaşık Matematik Kavramları

GPT-4 Görüş, grafik veya el yazısı ifadeleri analiz ederek karmaşık matematik fikirlerine dalma konusunda exceller. Bu özellik, karmaşık matematik problemlerini çözmek isteyen bireyler için faydalı bir araçtır ve GPT-4 Görüş’ü, eğitim ve akademik alanlarda önemli bir yardımcı haline getirir.

El Yazısı Girişini LaTeX Kodlarına Dönüştürme

GPT-4V’nin dikkat çekici yeteneklerinden biri, el yazısı girişlerini LaTeX kodlarına çevirebilmesidir. Bu özellik, sık sık el yazısı matematik ifadelerini veya diğer teknik bilgileri dijital forma dönüştürmek zorunda kalan araştırmacılar, akademisyenler ve öğrenciler için bir nimettir. El yazısından LaTeX’e dönüşüm, belge dijitalize edilmesini genişletir ve teknik yazma sürecini basitleştirir.

Tablo Ayrıntılarını Çıkarmak

GPT-4V, tablolardan ayrıntı çıkarmada ve ilgili soruları yanıtlamada beceri sergiliyor, bu da veri analizi için önemli bir varlık haline geliyor. Kullanıcılar, GPT-4V’yi tabloları tarayarak, önemli içgörüler toplamak ve veri odaklı soruları çözmek için kullanabilir, bu da veri analistleri ve diğer profesyoneller için güçlü bir araç haline getirir.

Görsel İşaret Anlama

GPT-4V’nin görsel işaretleri anlama yeteneği, kullanıcı etkileşimine yeni bir boyut ekliyor. Görsel ipuçlarını anlayarak, GPT-4V daha yüksek bağlamsal anlayışla sorulara yanıt verebiliyor.

Çizim Kullanarak Basit Mock-Up Web Siteleri Oluşturmak

Bu tweet tarafından ilham alınarak, unite.ai web sitesinin bir mock-up’ını oluşturmaya çalıştım.

Sonuç, ilk vizyonumla tam olarak eşleşmese de, ulaştığım sonuç budur.

GPT-4V’nin (Görüş) Sınırlılıkları ve Hataları

GPT-4V’yi analiz etmek için, Open AI ekibi nitel ve nicel değerlendirmeler yaptı. Nitel değerlendirmeler, dahili testleri ve dış uzman incelemelerini içerirken, nicel değerlendirmeler model reddetmelerini ve çeşitli senaryolardaki doğruluğunu ölçtü, bunlar arasında zararlı içerik tanıma, demografik tanıma, gizlilik endişeleri, coğrafi konum, siber güvenlik ve çoğul modlu jailbreak’ler yer aldı.

Ancak model mükemmel değil.

Makale, GPT-4V’nin sınırlılıklarına dikkat çekiyor, bunlar arasında görsellerdeki yanlış çıkarımlar ve metin veya karakterlerin eksikliği yer alıyor. Model, gerçekleri uydurabilir veya icat edebilir. Özellikle, görsellerdeki tehlikeli maddeleri tanımlamak için uygun değildir ve bunları thường yanlış tanımlar.

Tıbbi görüntüleme konusunda, GPT-4V tutarlı olmayan yanıtlar verebilir ve standart uygulamalara ilişkin farkındalığa sahip değildir, bu da potansiyel olarak yanlış teşhislere yol açabilir.

Tıbbi amaçlar için güvenilir performans (Kaynak)

Ayrıca, belirli nefret sembollerinin nüanslarını kavramakta başarısız olabilir ve görsel girdilere dayalı uygun olmayan içerikler üretebilir. OpenAI, GPT-4V’yi, özellikle tıbbi veya hassas bağlamlarda, kritik yorumlar için kullanmamayı tavsiye ediyor.

Sonuç

Hızlı Stable Diffusion XL kullanılarak oluşturuldu https://huggingface.co/spaces/google/sdxl

GPT-4 Görüş (GPT-4V) ile birlikte bir dizi yeni olasılık ve yeni engeller ortaya çıkıyor. Çıkarmadan önce, özellikle resimlerdeki risklerin, özellikle de insanların resimlerinin risklerinin iyi bir şekilde ele alındığından emin olmak için çok çaba harcanıyor. GPT-4V’nin, özellikle tıp ve bilim gibi zorlu alanlarda gösterdiği ilerleme gerçekten etkileyici.

Şimdi, bu modellerin ünlü insanları resimlerinden tanımlayabilmesi gerekip gerekmediği, bir kişinin cinsiyetini, ırkını veya duygularını bir resimden tahmin edebilmesi gerekip gerekmediği gibi büyük sorular ortaya çıkıyor. Ve görme engelli bireyler için özel ayarlamalar yapılması gerekip gerekmediği soruları, gizlilik, adillik ve AI’nin hayatımızda nasıl bir rol oynaması gerektiği konusunda herkesin söz sahibi olduğu bir tartışmaya yol açıyor.