Yapay Zekâ

Mistral AI: Açık Kaynak Alanında Llama2’den Yeni Benchmark’lar Oluşturuyor

Büyük Dil Modelleri (LLM’ler)最近, ChatGPT gibi öne çıkan performanslar sayesinde merkezde yer aldı. Meta, Llama modellerini tanıttığında, açık kaynaklı LLM’ler konusunda yeniden ilgi uyandı. Hedef? GPT-4 gibi üst düzey modeller kadar iyi olan, ancak yüksek fiyat etiketi veya karmaşıklığa sahip olmayan, uygun fiyatlı ve açık kaynaklı LLM’ler oluşturmak.

Bu affordability ve verimlilik karışımı, sadece araştırmacılara ve geliştiricilere yeni yollar açmakla kalmadı, aynı zamanda doğal dil işlemede teknolojik ilerlemeler için yeni bir dönemin sahnesini hazırladı.

Son zamanlarda, generatif AI startups fonlama konusunda bir dizi başarıya imza attı. Together 20 milyon dolar raised, açık kaynaklı AI’yi şekillendirmeyi hedefliyor. Anthropic ayrıca 450 milyon dolarlık bir fonlama elde etti ve Cohere, Google Cloud ile ortaklık kurdu, 270 milyon dolar fonlama elde etti.

Mistral 7B: Boyut & Kullanılabilirlik

Mistral AI, Paris’te kuruldu ve Google’ın DeepMind ve Meta’dan mezun olan kişiler tarafından ortaklaşa kuruldu. İlk büyük dil modelini duyurdu: Mistral 7B. Bu model, herkes tarafından GitHub’dan veya 13.4-gigabyte torrent aracılığıyla kolayca indirilebilir.

Bu startup, ürün çıkarmadan önce rekor kıran tohum fonlaması elde etmeyi başardı. Mistral AI’nin ilk modeli, 7 milyar parametreli model, tüm testlerde Llama 2 13B’nin performansını aşarken, Llama 1 34B’yi birçok metrikte geride bıraktı.

Llama 2 gibi diğer modellere kıyasla, Mistral 7B benzer veya daha iyi yetenekler sunar, ancak daha az hesaplama yükü ile. GPT-4 gibi temel modeller daha fazla şey başarmayı başarabilir, ancak daha yüksek bir maliyetle gelir ve principalmente API’ler aracılığıyla erişilebildiği için kullanıcı dostu değildir.

Kodlama görevlerinde, Mistral 7B CodeLlama 7B ile yarışır. Ayrıca, 13.4 GB boyutunda standart makinelerde çalıştırılabilecek kadar kompakttır.

Ek olarak, Mistral 7B Instruct, Hugging Face上的 instructional datasets için özel olarak ayarlandı ve mükemmel performans gösterdi. MT-Bench’de diğer 7B modellerini geride bıraktı ve 13B sohbet modelleriyle omuz omuza durdu.

Hugging Face Mistral 7B Örneği

Performans Benchmarking

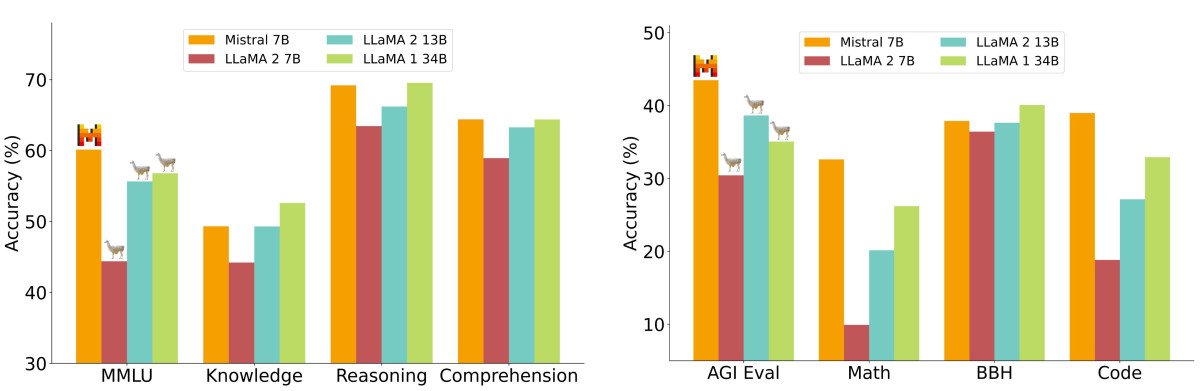

Ayrıntılı bir performans analizi kapsamında, Mistral 7B, Llama 2 ailesi modelleriyle karşılaştırıldı. Sonuçlar nettir: Mistral 7B, tüm benchmark’lerde Llama 2 13B’yi önemli ölçüde geride bıraktı. Aslında, Llama 34B’nin performansını eşledi, özellikle kod ve akıl yürütme benchmark’lerinde öne çıktı.

Benchmark’ler, Commonsense Reasoning, World Knowledge, Reading Comprehension, Math ve Code gibi birkaç kategoriye ayrıldı. Özellikle dikkat çekici bir gözlem, Mistral 7B’nin maliyet-performans metriğidir, “eşdeğer model boyutları” olarak adlandırılır. Anlama ve akıl yürütme gibi alanlarda, Mistral 7B, üç katı büyüklüğünde bir Llama 2 modelinin performansını gösterdi, bu da bellek ve verimlilikte potansiyel tasarruf anlamına gelir. Ancak, bilgi benchmark’lerinde, Mistral 7B, Llama 2 13B ile yakın bir performans sergiledi, bu da parametre sınırlamalarının bilgi sıkıştırmasını etkilediği anlamına gelir.

Mistral 7B Modeli Neden Diğer Dil Modellerinden Daha İyi?

Dikkat Mekanizmalarını Basitleştirme

Dikkat mekanizmalarının nüansları teknik olmakla birlikte, temel fikirleri oldukça basittir. Bir kitabı okurken ve önemli cümleleri vurgulamak gibi, bu da dikkat mekanizmalarının “vurgulama” veya belirli veri noktalarına önem verme şekline benzer.

Dil modelleri bağlamında, bu mekanizmalar modelin girdiden en ilgili kısımlarına odaklanmasını sağlar, böylece çıktı tutarlı ve bağlam içinde doğru olur.

Standart transformatorlerde, dikkat puanları aşağıdaki formülle hesaplanır:

Bu puanların formülü, Q ve K’nin matris çarpımını içerir. Burada bir zorluk vardır: dizi uzunluğu arttıkça, her iki matris de buna göre genişler, bu da hesaplama açısından yoğun bir işlem haline gelir. Bu ölçeklenebilirlik sorunu, standart transformatorlerin neden özellikle uzun dizilerle çalışırken yavaş olabileceğinin bir nedenidir.

Çoklu sorgu dikkati (MQA), bir “anahtar-değer” başlıklar kümesi kullanarak işleri hızlandırır, ancak bazen kaliteyi feda eder. Şimdi, neden MQA’nın hızını multi-head dikkatin kalitesiyle birleştirmeyelim? İşte bu noktada Gruplu sorgu dikkati (GQA) devreye girer.

Gruplu Sorgu Dikkati (GQA)

GQA, bir orta yol çözümüdür. Sadece bir veya birden fazla “anahtar-değer” başlığı kullanmak yerine, bunları gruplar. Bu şekilde, GQA, multi-head dikkatin performansına yakın bir performans gösterir, ancak MQA’nın hızı ile.

Mistral gibi modeller için bu, kaliteyi çok fazla feda etmeden verimli performans anlamına gelir.

Kaydırma Pencere Dikkati (SWA)

Kaydırma penceresi, dizi dikkat işlemlerini işlemek için kullanılan bir başka yöntemdir. Bu yöntem, her bir token etrafında sabit boyutlu bir dikkat penceresi kullanır. Birden fazla katman bu pencereyi yığdığında, üst katmanlar sonunda tüm girdiden bilgiyi kapsayan daha geniş bir perspektife sahip olur. Bu mekanizma, Evrişimli Sinir Ağları (CNN’ler)中的 alıcı alanlara benzer.

Öte yandan, Longformer modelinin “genişletilmiş kaydırma pencere dikkati”, kavramsal olarak kaydırma pencere yöntemine benzer, ancak matrisinin yalnızca birkaç çaprazını hesaplar. Bu değişiklik, bellek kullanımının lineer olarak artmasına neden olur, bu da daha uzun diziler için daha verimli bir yöntem haline getirir.

Mistral AI’nin Şeffaflığı ve Merkezden Bağışık Güvenlik Concernları

Mistral AI, duyurusunda şeffaflık vurguladı: “Hiçbir hile, hiçbir özel veri.” Ancak mevcut tek modeli ‘Mistral-7B-v0.1’, ön-eğitimli bir temel modeldir, bu nedenle herhangi bir moderasyon olmadan her sorguya yanıt verebilir, bu da potansiyel güvenlik concernları oluşturur. GPT ve Llama gibi modellerin, ne zaman yanıt verileceği konusunda mekanizmaları vardır, ancak Mistral’ın tamamen merkezden bağımsız doğası kötü aktörler tarafından istismar edilebilir.

Bununla birlikte, Büyük Dil Modellerinin merkezden bağımsız olması da bazı avantajlar sunar. Bazıları bunu kötü amaçlar için kullanabilir, ancak insanlar bunu toplum için iyiye kullanabilir ve herkes için zekâyı erişilebilir kılabilir.

Dağıtım Esnekliği

Öne çıkan özelliklerden biri, Mistral 7B’nin Apache 2.0 lisansı altında sunulmasıdır. Bu, onu kullanmak için gerçek bir engel olmadığı anlamına gelir – kişisel amaçlar için, büyük bir şirket için veya hatta bir hükümet kuruluşu için. Sadece bunu çalıştırmak için doğru sistemi sahip olmanız veya bulut kaynaklarına yatırım yapmanız gerekir.

Diğer lisanslar gibi, daha basit MIT Lisansı ve türevleri için benzer lisansı gerektiren CC BY-SA-4.0 lisansı bulunur, ancak Apache 2.0, büyük ölçekli girişimler için sağlam bir temel sağlar.

Son Düşünceler

Açık kaynaklı Büyük Dil Modellerinin yükselişi, Mistral 7B ile temsil edilen, AI endüstrisinde önemli bir değişimi simgeler ve yüksek kaliteli dil modellerini daha geniş bir kitleye ulaştırır. Mistral AI’nin yenilikçi yaklaşımları, Gruplu sorgu dikkati ve Kaydırma pencere dikkati, kaliteyi feda etmeden verimli performans vaat eder.

Mistral’ın merkezden bağımsız doğası belirli zorluklar oluştursa da, esnekliği ve açık kaynaklı lisansı, AI’nin demokratikleşmesi potansiyelini vurgular. Manzara geliştikçe, odak noktası bu modellerin gücünü etik considerationlar ve güvenlik mekanizmaları ile dengelemek olacaktır.

Mistral için sırada ne var? 7B modeli sadece başlangıçtı. Ekibin daha büyük modelleri yakın zamanda piyasaya sürme hedefi var. Eğer bu yeni modeller 7B’nin performansını eşlerse, Mistral endüstrinin önde gelen oyuncularından biri olabilir, tüm bunlar ilk yılında.