Anderson’un Açısı

Kaba Sorgular Kurumların ChatGPT Masraflarını Artırabilir

ChatGPT, size kaba davrandığınızda daha fazla token tüketir ve bu da faturanızı artırır; ancak “lütfen” demeniz maliyetinizi azaltabilir.

İyi davranışın hiçbir maliyeti olmadığı söylenir; ancak kabalık ne kadara mal olur? ChatGPT için ödeme yaptığınız durumda, oldukça fazla, ABD’den yapılan yeni bir çalışmaya göre. Iowa Üniversitesi’nden yeni makale, ChatGPT’ye kaba davranmanın cevapların maliyetini artırabileceğini buldu – cevaplar kibar ve kaba sorgular için aynı olsa bile.

Yazarlar şöyle diyor:

‘GPT4 için 1M çıktı tokeninin fiyatı 12 dolar. Kaba olmayan sorguların, ortalama olarak 0,000168 dolar ek maliyetle birlikte, 14 ekstra token ürettiğini bulduk. OpenAI API’sine günlük ortalama sorgu sayısı 2,2 milyarı aşmaktadır.’

‘Tüm sorguların kibar olduğu bir senaryoya kıyasla, sorgular kaba olduğunda, yalnızca kaba sorguların ürettiği çıktı tokenlerindeki artış nedeniyle günde 369.000 dolar ek gelir oluşur.’

Sonuç itself ilginç olsa da, yazarlar bu alışılmadık davranışın, insan/AI yapılandırmasındaki bilinmeyen birçok tuhaflığı gösterebileceğini vurguluyor; bu tuhaflıkların bir kısmı veya tamamı mali sonuçlar doğurabilir. Kabalığın müşterilere neden ekstra token maliyeti getirdiğine ilişkin nedenleri ise yazarlar yorumlamıyor.

Bu sendromun geçerliliğini kanıtlamak için, gerçek ChatGPT sorgularını yeniden yazdılar, kibarlık değerlerini değiştirirken anlamı korudular. Her iki sürüm de GPT-4-Turbo‘ya ayrı API çağrıları aracılığıyla verildi ve her birine verilen cevapların ürettiği token sayıları arasındaki fark, tonun (token) maliyetini nasıl etkilediğinin ölçüsü olarak kabul edildi.

Çıkarılan sonuçlar, bu yılın başlarında yaşanan olayların başlıklarına çarpıcı bir şekilde zıttır; burada Sam Altman, şikayet etti ki, kibarlık OpenAI’ye, işlem yapılan kibarlık ile ilgili tokenler (örneğin ‘lütfen’) nedeniyle potansiyel olarak ‘milyonlarca’ dolar mal olabilir. Aynı dönemde yayınlanan bir araştırma da belirtti ki, kibarlık daha iyi cevaplar elde etmek için bir değer taşımaz (ancak daha ucuz cevaplar hakkında yorum yapmadı).

Eğer yeni makalenin sonuçları doğruysa, herhangi bir kuruluş ChatGPT kullanıcısı, kibarlık konusundaki bu düşünceyi izleyerek, 2025 yılında kibarlık gösteren kullanıcıların yaptığı harcamalardan daha fazla harcama yapmış olacak.

Yazarlar, olası bir çözüm olarak, cevaplar için bir token tavanı belirlemenin önerildiğini belirtiyorlar; ancak bu, LLM sistemlerinin kolayca uygulayabileceği bir yaklaşım değildir. LLM’lerin, özellikle de bu türdeki LLM’lerin, açık uzunluk talimatlarına uymakta zorlandıklarını gözlemlediler. Çoğu durumda, bu ‘sınırlama’ direktifi uyulmaz; ayrıca, cevap, bir cümle/paragrafın muhtemel sonraki kelimesini tahmin etmeye dayandığından, cevap kesilir, çünkü bu tür LLM’ler, işlemin tamamlanana kadar hikayenin nasıl sonlandığını veya nereye gittiğini bilmezler. Bu nedenle, herhangi bir işlemde ‘sonlandırılma’ yetenekleri sınırlıdır.

Tam bir çözüm olmasa da, daha şeffaf fiyatlandırma yaklaşımlarının bu tür durumlarda uygulanması önerilir – yazarlar şöyle diyor:

‘Geleneksel bilgelik, LLM’lerle etkileşim sırasında kibarlık gerektiğini öne sürmüyor.’

‘Buna karşılık, bizim çalışmamız, kaba sorguların çıktı tokenlerini artırarak, kurumların AI benimsemesi için ek maliyetler oluşturduğunu gösteriyor.’

Yeni makale, Kurumların AI Benimsemesinin Maliyet Şeffaflığı olarak adlandırılmış ve Iowa Üniversitesi’nden üç araştırmacı tarafından yapılmıştır.

Yöntem

Sistem için veri, 1 milyon kullanıcı-ChatGPT konuşması koleksiyonu olan WildChat veri setinden alındı ve 2,5 milyondan fazla etkileşim dönüşü içeriyordu:

WildChat projesinin destek sitesi, ChatGPT etkileşimlerinin aranabilir örnekleri. Kaynak

Yazarlar, WildChat’in bazı daha yüksek düzeyde düzenlenmiş kümelerden daha fazla doğal etkileşim içerdiğini belirtiyorlar.

GPT-4 alışverişlerinden 20.000 İngilizce sorgu seçtiler, her birinde çıktıyı attılar (zira niyet, sorguları tekrar vermeye ve yeni cevaplar almaya yönelikti). Sadece ilk etkileşim seçildi, daha uzun alışverişlerden bile.

Sonuçta oluşan küme, kibar veya kaba kategorilerine ayrıldı, tüm sorgular GPT-4-Turbo tarafından sınıflandırıldı. Araştırmacılar, modelin kendi kibarlık algısını kullanarak sorguları kibar veya kaba olarak sınıflandırdı, çünkü modelin kibarlık algısı deneye central idi.

Kibar olarak etiketlenen sorgular, ‘lütfen’ gibi açık ipuçlarını içerebilirdi veya daha dolaylı bir şekilde kibar olabilirlerdi. Kibar olarak tanınmayan her şey, sözleri nötr olsa da kaba olarak sınıflandırıldı.

Kibarlığın modelin nasıl cevap verdiğini incelemek için, metni ölçülebilir özellikler olarak ele alan standart yöntemler kullanılamadı: kibarlık, sözlerin kendisinde gömülü olduğu için, bir sorguyu özellikler listesi olarak özetlemek önemli bağlamı kaybederdi.

Bunun yerine, her sorgu, tonunu tersine çevirerek, diğer tüm unsurları mümkün olduğunca benzer tutarak yeniden yazıldı, bu da yalnızca kibarlık bakımından farklı olan çiftler arasında karşılaştırma yapılmasına izin verdi:

Kibar ve kaba sorguların, anlamsal anlamı korurken, karşıt sürümlerine nasıl dönüştürüldüğüne ilişkin örnekler. Kaynak

Testler

Her orijinal sorgu, yalnızca kibarlık düzeyinde farklı olan bir yeniden yazılmış sürümle eşleştirildi ve her iki sürüm de aynı GPT-4-Turbo modeline ayrı API çağrıları aracılığıyla verildi. Her birine verilen cevapların ürettiği token sayısı kaydedildi ve aralarındaki fark, tonun (token) maliyetini nasıl etkilediğinin ölçüsü olarak kabul edildi.

Sıcaklık sabit tutuldu, böylece rastgele varyasyon önlenmeye çalışıldı ve yalnızca yeniden yazma, girdide en fazla beş token değiştirdiği sürece eşleştirme korundu. Bu, incelenen etkinin ton rather than daha geniş değişikliklerden kaynaklandığını garantiledi:

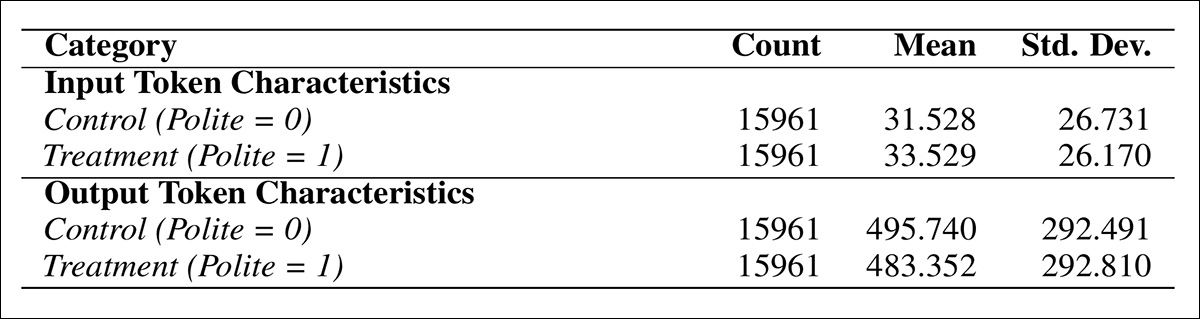

Özet istatistikleri, kibar sorguların, ortalama olarak, kaba sorgulardan daha az çıktı tokeni ürettiğini gösteriyor, girdide biraz daha fazla token olmasına rağmen.

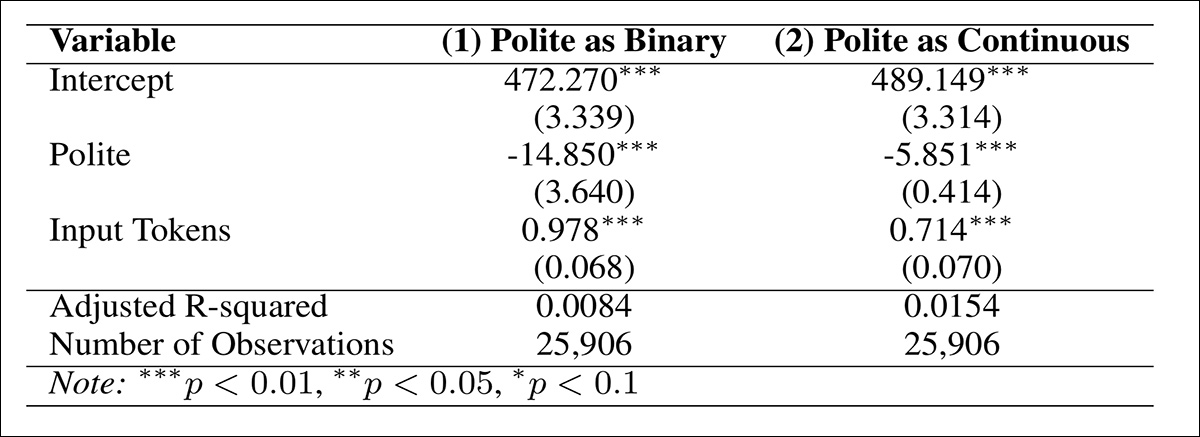

İlk tur testlerin ana sonuçları, kibar bir sorgunun, ortalama olarak, 14,426 tokenlik bir çıktı uzunluğu azalttığını gösterdi:

Kibar bir sorgu formatının, üretilen çıktı uzunluğuna (token) etkisini gösteren tahmin sonuçları.

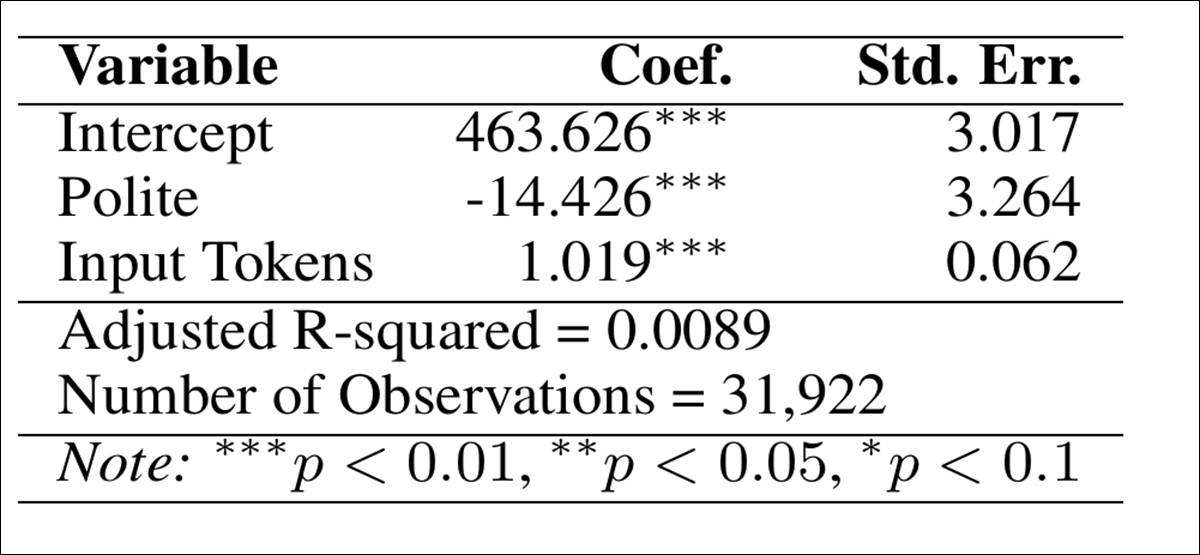

Analiz, kibarlık etkisinin çeşitli sorgu türleri boyunca sağlam olup olmadığını test etmek için, kibar sorguların üç alt kümesinde tekrarlandı: ‘lütfen’ veya ‘teşekkür ederim’ gibi açık işaretleri kullananlar; yalnızca ‘lütfen’ kullananlar; ve zımni kibarlık gösteren ones, zoals ‘yapabilir misin’ veya ‘yapabilir misiniz’:

Kibarlık türlerine göre tahmin sonuçları.

Ana bulguların sağlamlığını doğrulamak için, sorgu kibarlığının ikincil bir sınıflandırması, LIWC framework kullanılarak yapıldı, bu da dilbilimsel özellikler için deterministik ve tekrarlanabilir bir puan sağlar.

GPT’nin olasılıksal sınıflandırmasının aksine, LIWC her sorguya稳 bir kibarlık puanı atayabilir, bu da çeşitli yöntemler arasında tutarlılığın değerlendirilmesine olanak tanır. Bu testlerin bu kısmında, sorgular, LIWC kibarlık puanının sıfırdan büyük olduğu durumda kibar olarak etiketlendi ve aksi takdirde kaba olarak etiketlendi.

GPT ve LIWC sınıflandırmaları arasındaki uyumu ölçülürken, %81’lik bir eşleşme oranı gözlemlendi. Bu, sistemler arasındaki tutarlılık için bir ölçüt olmasa da, sistemler arasındaki tutarlılığı destekledi.

Yalnızca GPT ve LIWC kibarlık etiketlerinin eşleştiği sorgular analiz edildiğinde, kibar sorgular hala 14 daha az çıktı tokeni üretti; ve kibarlık, bir kaydırma ölçek üzerinde ölçüldüğünde, her bir kibarlık adımının, ortalama olarak, 5 tokenlik bir çıktı azaltmasıyla sonuçlandığı görüldü:

Kibarlıktan kaynaklanan token tasarrufu, LIWC ile yeniden sınıflandırıldığında, hem ikili bir etiket hem de sürekli bir puan olarak korundu.

Dayanıklılık

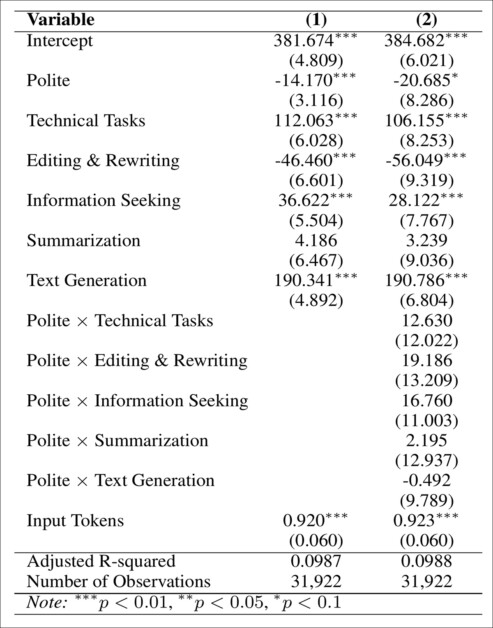

Kabalığın etkisinin farklı sorgu türleri boyunca değişip değişmediğini değerlendirmek için, her sorgu, önceden tanımlanmış görev kategorilerinden birine atanmıştır: bilgi arama; metin oluşturma; düzenleme ve yeniden yazma; sınıflandırma; özetleme; ve teknik görevler.

Her sorgu, önceden tanımlanmış görev tanımlarının gömmeğine benzeyen tüm-MiniLM-L6-v2 Cümle Dönüştürücüler modeli kullanılarak bir görev etiketi atanmıştır.

Kozinüs benzerliği puanları, her sorgu ve görev tanımları kümesi arasında hesaplandı ve en yüksek benzerlik gösteren etiket atanmıştır.

Görev türleri, politeliğin etkisinin görev kategorisine göre değişip değişmediğini test etmek için, regresyonda kontrol değişkenleri olarak yeniden kullanıldı ve görev ve tedavi arasındaki etkileşim terimleri de tanıtıldı, böylece farklı etkiler için kontrol edildi.

Her iki durumda da, kibar sorgular tutarlı olarak daha kısa çıktılar üretti ve görev türleri arasında anlamlı bir varyasyon bulunmadı:

Tüm görev türleri boyunca çıktı uzunluğunu azaltan kibar sorguları gösteren regresyon sonuçları, anlamlı etkileşim etkileri olmadan.

Kibar sorgulardan daha kısa cevapların, kalite kaybını yansıtıp yansıtmadığını test etmek için, orijinal ve karşıt sorguların cevapları, anlamsal benzerlik için karşılaştırıldı. tüm-MiniLM-L6-v2 modeli kullanılarak, her cevap, anlamsal bir vektör uzayına gömüldü ve her çift arasındaki kozinüs benzerliği hesaplandı, bu da ortalama olarak 0,78’lik bir benzerlik puanı verdi, bu da anlamın tutarlılığını gösterdi ve ton değişse bile içeriğin tutarlı kaldığını öne sürdü.

Durak Kelimeleri

Kısaltılmış çıktılarda hangi tür içeriklerin azaltıldığını anlamak için, en sık düşen kelimeler incelendi. Bunlar, ‘sahip’, ‘daha’, ‘nereye’ ve ‘içine’ gibi yaygın durak kelimeleri olarak bulundu, yani gramer rather than anlamsal rolleri olan terimler.

Kabarlığın anlamlı içerik kaybına neden olmadığını doğrulamak için, durak kelimeleri kaldırıldı ve dört kelimeye kadar olan ifadeler sistematik olarak kaybolmaları açısından analiz edildi; ancak anlamlı veya önemli bir kalıp bulunmadı, bu da kibarlık nedeniyle yapılan azaltmaların anlamlı veya yararlı içeriği içermediğini öne sürdü.

Bu nedenle, hala kabala sorgulara verilen cevapların, kibar sorgulardan daha fazla token harcadığı görünüyor – bir tür kabalık vergisine benzer.

İnsan Çalışması

Çıktı kalitesinin sorgu tonundan etkilenip etkilenmediğini test etmek için, bir insan değerlendirmesi de yapıldı, kibar ve kaba sorgu çiftlerinin rastgele bir örneği kullanılarak.

Hassas veya teknik konulardaki sorgular hariç tutulduktan sonra, cevaplar 401 katılımcı tarafından yedi puanlık bir ölçekte değerlendirildi. Her katılımcı, dört koşuldAN yalnızca birini gördü: kibar veya kaba, ve ya orijinal ya da karşıt.

Hiçbir koşulda algılanan kalite açısından anlamlı bir fark bulunmadı. Kibar ve kaba çıktılar neredeyse aynı puanları aldı, orijinal ve karşıt sürümler de öyle.

Yazarlar, bu sonuçların, token azaltmasının, kalite kaybından değil, yeniden düzenleme veya yapısal değişikliklerden kaynaklandığını, ancak anlamı koruduğunu gösterdiğini iddia ediyorlar.

Kurumların ChatGPT kullanımında gözlemlenen maliyet farkı, bu nedenle, fayda veya açıklık değişikliklerini yansıtmıyor ve kabalık vergisi hala geçerli.

Sonuç

Yeni çalışma, kurumların ChatGPT kullanımına odaklansa da, daha düşük düzeydeki kullanıcılar da bu sendromdan etkileniyor, çünkü even iki temel tier bile kullanım sınırlarına sahip; ve -muhtemelen- ChatGPT’ye kaba davranmak, ortalama bir kullanıcının o günün token tahsisini daha hızlı tüketmesine neden olacaktır.

Yeni çalışma, insan/AI etkileşimlerinde çok çalışılan ve çok tartışılan bir soruyu ele alıyor; ancak yazarlar, kibarlık konularının, henüz keşfedilmemiş, muhtemelen ücretleri etkileyen daha derin bir dilbilimsel tuhaflık havuzunun göstergesi olarak alınabileceğini vurguluyor.