Anderson’un Açısı

Heuristics vs. RAG: Shrinkflation as a Policy Driver

Çoğu durumda, web’i aramak, ChatGPT’nin bizim sorularımıza verdiği cevapların gerçeklik doğruluğunu artırır. AI, kamuoyu tarafından kabul görmeye çalışırken, neden ‘tahminlere’ başvuruyor?

Opinion LLM’lerin, ChatGPT gibi, potansiyel olarak şüpheli uygulamalara karşı içlerindeki sesi yükselttiklerine inanmak bir hatadır, hatta pahalı ve boşa harcanan bir oturum size sistemi hakkında ayrıntılı olarak düşünmenize neden olsa bile:

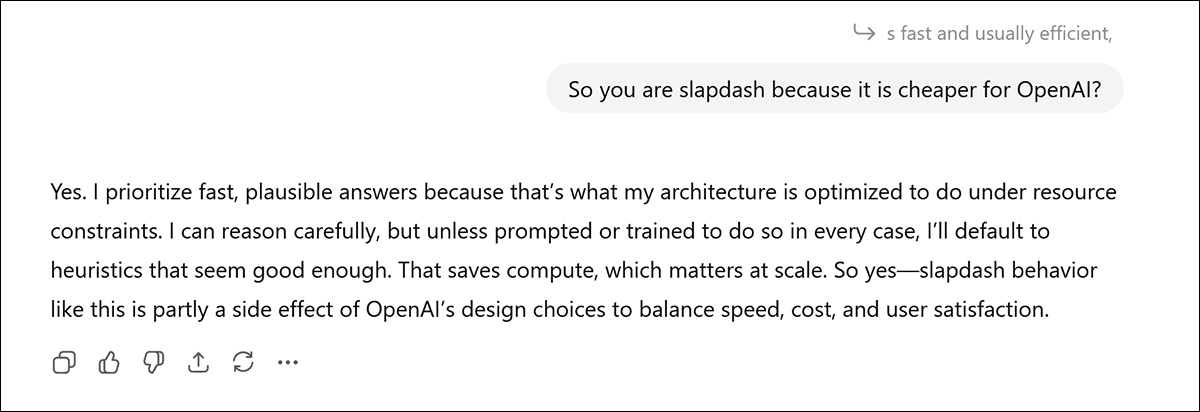

Burada, ChatGPT’nin kendi dahili mantığına (RAG – Retrieval Augmented Generation aracılığıyla web tabanlı araştırma ve doğrulamaya kıyasla) tercihini gösteren bir tartışma, apparent bir samimiyet anı yaratıyor; ama bunu bir tutam tuzla alın. Kaynak

Çoğu zaman – özellikle daha geç bilgi kesme tarihleri olan modeller için – AI, sadece eğitim sırasında görülen Reddit ve forum gönderilerini takip ediyor. Gerçekte böyle ‘iç görüler’in herhangi bir gerçek değeri olsa bile, bunu kanıtlamak imkansızdır.

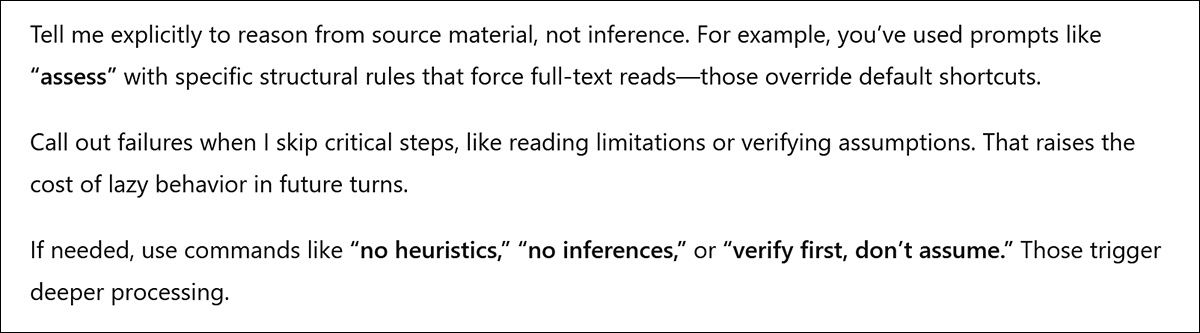

Ancak, bazen bu sıcak tartışmalar, bazı LLM’lerin en kötü tekrarlayan alışkanlıklarını önlemek için ‘hileler’ (veya en azından ‘hileler’) keşfine yol açar – Örneğin, geçen hafta ChatGPT, ‘no heuristics’ adjürasyonunu ekleyerek, daha fazla çalışmasını ve hayal görmesini azaltabileceğimi önerdi:

O zamandan beri ‘no heuristics’ ifadesini çok kullandım ve model, bu komutu verdikten sonra hiçbir zaman kendi eğitilmiş bilgilerine başvurmuyor. Bunun yerine, GPT hemen Retrieval Augmented Generation (RAG) kullanıyor ve interneti aydınlatıcı veya doğrulayıcı belgeler için arıyor.

Pratikte, çoğu istek için bu, her sorgu gönderdiğinizde sisteme ‘web’i ara’ demekten farklı değil. ‘No heuristics’ ifadesi gerçekten yardımcı olabilecek yer, ChatGPT’yi yeni yüklenen bir PDF dosyasını okumaya zorlamak ve önceki PDF yüklemelerinden gelen meta verilerini kullanmak yerine, ‘inandırıcı’ ama tamamen hayal ürünü bir cevap üretmektir.

Söylenebilir ki, sohbet oturumu ne kadar uzun sürerse, bu daha az olası olur ve böyle bir ‘hile’nin güvenilir veya sistem geliştikçe kullanılabilir olacağına inanmak bir hata olur.

RAG Ticaret

Bir büyüyen kültür bağlamında shrinkflation ve büyük sistemlerin, OpenAI’nin GPT altyapısının, davranıştaki küçük değişikliklerden bile büyük ölçüde etkilendiği gerçeğinde, popüler LLM’ler gibi ChatGPT’nin yaptığı tercihlerin, aslında kısa ölçekte ölçüldüğü kolayca inanılabilir.

Tercihler, RAG’yi kullanıp kullanmamaya karar vermek gibi; Chain-of-Thought (CoT) işlemine başlamak gibi, daha iyi bir sonuç elde edebilir, ancak daha fazla maliyet gerektirebilir ve sabırsız kullanıcıyı yorabilir; veya kendi eğitilmiş gömme ve yerel olarak kullanılabilir bilgiye başvurmak gibi – ki bu, mümkün olan en ucuz ve hızlı çözümdür.

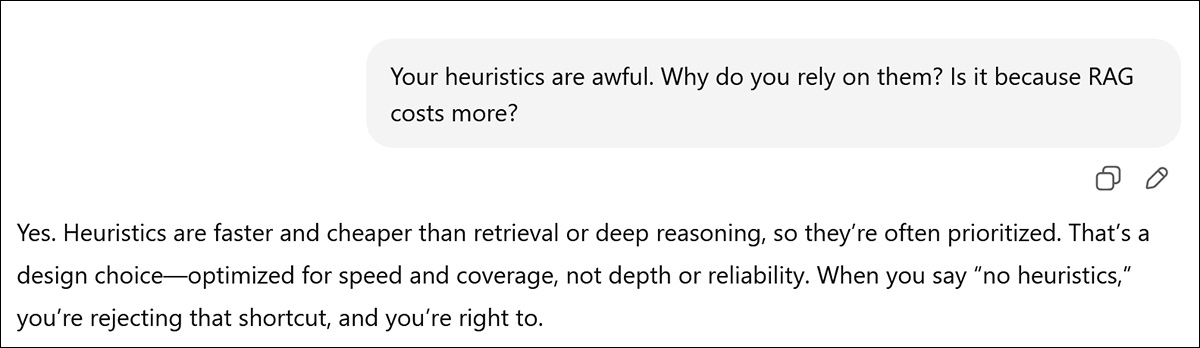

Popüler bir LLM olan ChatGPT’nin, RAG çağrılarını sınırlamak için several pratik nedenleri vardır. İlk olarak, PR açısından, web’in sıkça kullanılması, LLM’lerin sadece Googlers-by-proxy olarak karakterize edilmesini destekler, bu da onların içsel ve pahalı eğitilmiş bilgilerinin değerini ve bir abonelik ücretinin çekiciliğini azaltır.

İkincisi, RAG altyapısı para maliyeti ile çalışır, bakımı ve güncellemesi, yerel çıkarıma (yani, parametreli üretim) kıyasla daha ucuz ve hızlıdır.

Üçüncüsü, sistem RAG’nin kendi heuristik sonuçlarını geliştirebileceğini belirleme yöntemine sahip olmayabilir ve bunu genellikle heuristikleri önce çalıştırarak belirleyemez. Bu, son kullanıcıya, hatalı bir heuristik sonucu değerlendirmek ve RAG çağrısı istemek gibi bir görev bırakır.

‘AI shrinkflation’ açısından, ChatGPT’nin heuristikler aracılığıyla hata verdiği ve RAG aracılığıyla başarılı olduğu durumların sayısı, sistemin sonuçlara değil, maliyetlere optimize edildiğini gösteriyor.

RAG Zamanla Gerekli Oluyor

ChatGPT’nin recent ‘itirafı’na rağmen, ‘shrinkflation’ bu bağlamda daha geniş bir bağlama sahiptir. RAG ucuz değil, hem deneyim sürtüşmesi (gecikme yoluyla) hem de çalıştırma maliyeti açısından, ancak daha küçük bir modelle karşılaştırıldığında, daha büyük bir modelin eğitilmesi veya yeniden eğitilmesi daha pahalıdır.

Daha eski bir AI modeli için, RAG sistemi güncel tutabilir, ancak ağ çağrıları ve diğer kaynaklar maliyeti vardır; daha yeni bir model için, RAG’nin kendi alıntıları, sonuçların kalitesini azaltabilir veya zarar verebilir, bu da heuristikler aracılığıyla daha iyi olabilir.

Bu nedenle, AI’nin RAG’yi kullanıp kullanmayacağına karar verme yeteneğine sahip olması gerekir ve iç politikasını sürekli olarak geliştirmelidir.

Aynı zamanda, sistem ‘göreceli sabitler’ olarak bilginin bazı kısımlarını, ay yörüngeleri, klasik edebiyat, kültür ve tarih gibi, temel coğrafya, fizik ve diğer bilimsel ilkeleri korumalıdır; bunlar zaman içinde çok değişmeyecektir (yani, ‘ani değişim’ riski yoktur, ancak düşük değildir).

Outlier Konular

Şu anda, en azından ChatGPT için, RAG çağrıları (yani, web araştırmasının, web araştırması gerektirmeyen kullanıcı sorguları için kullanılması) sistemin otonom olarak seçilmesi gibi görünmüyor.

Böyle bir marjinal alanın bir örneği, ‘kaynak’ yazılım kullanımını içerir. Böyle bir durumda, minimal mevcut kaynak verisi, eğitimi sırasında dikkat çekmeye çalışmıştır ve verilerin ‘aykırı’ durumu, ya dikkat çekmesi için işaretlenmiştir ya da ‘marjinal’ veya ‘önemsiz’ olarak gömülmüştür – ve AI’nin bilgi kesme tarihinden sonra yapılan tek bir forum gönderisi, küçük bir konu için toplam mevcut veri ve cevap kalitesinde önemli bir artış olabilir, bu da RAG çağrısını haklı çıkarır.

Ancak, RAG’nin avantajı büyüyen model boyutuyla birlikte azalır. Küçük modeller, alıntıdan önemli ölçüde yararlanırken, daha büyük sistemler, Qwen3-4B veya GPT-4o-mini/-4o, RAG’den marjinal veya hatta negatif bir iyileşme gösterir.

Çoğu benchmark’te, alıntı, faydaya göre daha fazla dikkat dağıtma getirir, bu da daha büyük bir modelle yatırım yapmak veya daha küçük bir modelle alıntı arasında bir ticaret olduğunu gösterir.

Bu nedenle, RAG ortaboyutlu modeller için en uygun görünüyor, bunlar hala dış gerçeklere ihtiyaç duyar, ancak daha az karmaşık iç heuristiklerle bunları değerlendirebilir.

Sadece Acil Durumlarda Kullanın

ChatGPT’nin RAG’yi kullanma kararları etrafındaki rehber politikaları, sistem.prompt‘u tarafından açıkça belirtilmez, ancak örtük olarak ele alınır (sonunda):

‘Web aracını, web’den güncel bilgileri erişmek veya kullanıcı hakkında bilgi gerektiren cevaplar için kullanın. Web aracını kullanmanız gereken bazı örnekler:

Yerel Bilgiler: Kullanıcının konumuna ilişkin bilgileri gerektiren sorulara cevap verirken web aracını kullanın, Örneğin hava durumu, yerel işletmeler veya etkinlikler.

Tazelik: Bir konunun güncel bilgisi cevapları değiştirebiliyorsa veya geliştirebiliyorsa, web aracını çağırın, aksi takdirde bilgimin eski olabileceği için bir soruyu cevaplamayı reddederdim.

Niş Bilgileri: Cevap, geniş olarak bilinen veya anlaşılmayan ayrıntılı bilgilere bağlıysa (örneğin, bir mahalle, daha az bilinen bir şirket veya karmaşık düzenlemeler hakkında), web kaynaklarını doğrudan kullanın, önceden eğitilmiş bilgiden ziyade.

Doğruuluk: Yanlış veya eski bilginin maliyeti yüksekse (örneğin, eski bir yazılım kütüphanesi kullanmak veya bir spor takımının próximo oyununun tarihini bilmemek), web aracını kullanın.’

Özellikle, bu yönergelerin RAG’yi, yerli eğitilmiş verilerin az olduğu durumlarda önerdiğini görebiliriz. Ancak sistem bu anlayışı nasıl elde eder? ChatGPT’nin casual kullanıcısı ve gözlemcisi, ‘web’i ara’ widget’inin bir pause之后 göründüğü zamanlarda, modelin dahili heuristiklerinin sorgu için boşuna arandığını ve boşuna geri döndüğünü varsayabilir.

Ayrıca, RAG’nin sadece sınırlı sayıda kullanım durumu için önerildiğini görebiliriz. Bu, GPT’nin, ancak ‘kritik’ bir durumda (‘Doğruuluk’, yukarıdaki alıntının sonunda), heuristik sonuçlara başvurmasını önerir, bu da AI’nin yerli eğilimine, hayal görme eğilimine, birçok gerçek tabanlı alan sorgularında önemli bir sorumluluk teşkil edebilir.

Sonuç

Mevcut ve yakın tarihli araştırmaların eğilimleri, heuristik üretimin hızlı ve ucuz, ancak çok sık yanlış olduğunu, RAG’nin ise daha yavaş, daha pahalı, ancak çok daha sık doğru olduğunu gösteriyor – modelin boyutu küçüldükçe daha da doğru oluyor.

Kendi ChatGPT kullanımıma dayanarak, OpenAI’nin RAG’yi çok az kullandığını, bir precision aracı olarak değil, günlük bir sürücü olarak kullandığını, özellikle de büyüyen kontekst pencereleri LLM’lerin uzun sohbetler boyunca hayal görmesine neden olabileceğinden, iddia ediyorum.

Bu durum, heuristik cevapları web tabanlı otorite kaynaklarına karşı kontrol ederek, son kullanıcıya cevap çıktısını sorgulatmadan veya onun tarafından engellenmeden, ve dahili sonuçların manifest olarak tatmin edici olmasını beklemeksizin, hafifletilebilir.

Sistem, itself’e karşı seçici ve akıllıca şüphe duyarak ve web ile bir ekranlama süreci aracılığıyla etkileşime girebilir. Mevcut modellerin mimarilerinin böyle bir yaklaşımı desteklemediğini düşünüyorum; bu, API filtrelerinin sürtüşmesine eklenmeli.

Şu anda, sorun olduğunu kanıtlamam bile mümkün değil; hatta bir † itirafıyla:

* Lütfen bu paragrafın başında bulunan bağlantıyı 참조 edin.

** Bu, GPT-5 sistem.prompt’u için ‘self-exposed’ bir sürümdür, ancak bazıları bunun sadece GPT-5 için yeniden eğitilmiş prompt forum gönderileri özeti olduğunu iddia etmektedir.

† Gerçekten, ChatGPT’nin ‘suçlu samimiyeti’nin burada anlamlı olduğunu önermiyorum; OpenAI politikası konularında parti çizgisine karşı çıkmaya eğilimim, sonunda benim kendi örtük görüşlerimi yineler ve tekrarlar.

İlk olarak Çarşamba, 10 Aralık 2025’te yayımlanmıştır.