Anderson’un Açısı

Dillerin Modeline ‘Gerçeklik Dialı’ Verme

Doğru mu, konuşkan mı: birini seçin. Yeni bir eğitim yöntemi, kullanıcıların AI sohbet botlarına ne kadar ‘gerçek’ olmasını istediğini tam olarak söylemesine olanak tanır ve doğruluğu yukarı veya aşağı çekilebilen bir dial haline getirir.

ABD ve Çin arasındaki yeni bir araştırma işbirliği, neredeyse tüm AI sohbet botu kullanıcılarının takdir edeceği bir şey sunuyor: botun ‘konuşkan’ mı yoksa ‘doğru’ mu olmasını söyleyen sanal bir ‘knop’.

Sistem, ince ayar bir Mistral-7B modelini sentetik veri üzerinde eğitmek yoluyla oluşturuldu, böylece ‘gerçeklik’ ölçeği için bir şema model üzerinde işlenebildi. Bu revizyon之后, Mistral modeli bir cevabın içindeki gerçek sayısı kontrol edebiliyor; kullanıcı tarafından verilen ‘gerçeklik’ değeri ne kadar yüksekse, cevap o kadar kısa ve kesin oluyor.

Daha düşük ayarlarında, sohbet botunun cevabı makale yazarlarının ‘bilgilendirici’ olarak adlandırdığı şey haline geliyor, yani daha uzun bir cevap veriyor ve daha fazla gerçek içeriyor; ancak bazı gerçekler hayal edilmiş olabilir.

Sistemin eğitildiği sentetik veri, Wikipedia’yı bir test alanı olarak kullandı: insanların biyografileri hakkında gerçek hayat gerçekleri. Wikipedia’nın otoriter bir kaynak olarak düşünülüp düşünülmemesi önemli değil, çalışmanın değeri herhangi bir sistem tasarlamakta yatıyor, bu sistem LLM’lerin doğal cevaplama zorunluluğunu kesebiliyor, hatta cevap vermemesi gerektiğinde bile.

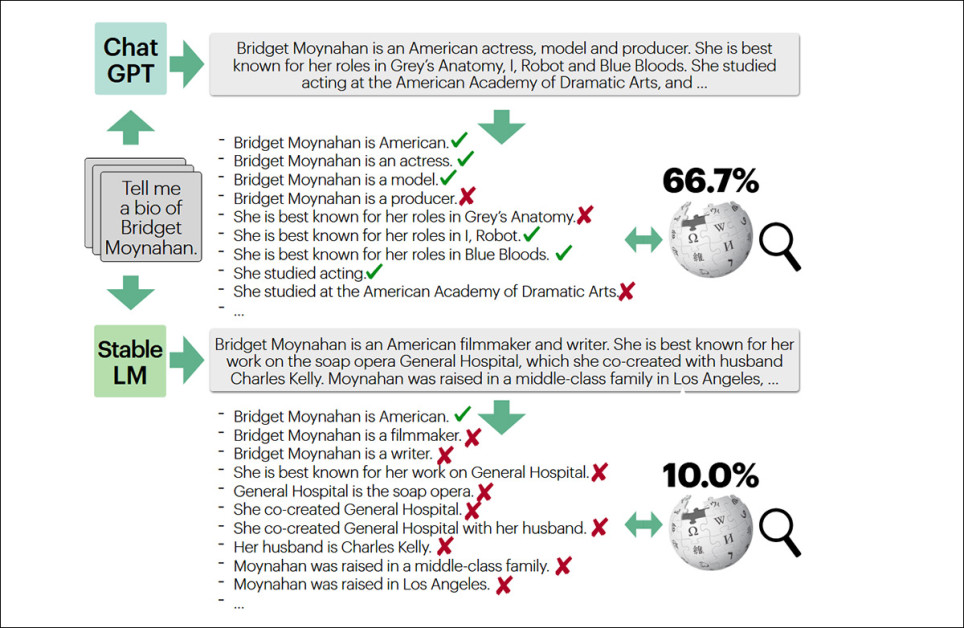

FactScore projesinden bir örnek, biyografik ayrıntılar için Wikipedia’yı referans otorite olarak kullanıyor. Kaynak

Yazarlar, yüksek güvenirlikli bağlamların, tıbbi ve hukuki alanlar gibi, muhafazakar ve güvenilir olarak gerçek çıktılar gerektirdiğini, birçok diğer kullanıcı türünün ise daha esnek ve yaratıcı, yorumlayıcı bir çıktı türü istediğini belirtiyorlar (örneğin, diskürsif yazma ve akademik analiz).

Gözlemlerini şöyle aktarıyorlar*:

‘[Şu anki] LLM’ler bu ticaret-off için内 yerleşik bir mekanizma sunmuyor.

‘Kullanıcılar, “daha gerçekçi ol” gibi promt’lar ile modelin davranışını yönlendirmeye çalışabilir, ancak bu görevde güvenilir bir şekilde çıktılarını ayarlamadığını bulduk.

‘FactScore üzerinde, hazır modellerin orta ila sıkı hedeflere bile ulaşamadığını bulduk. Bu boşluk, kullanıcıların belirli bir gerçeklik düzeyini istemesine ve modelin buna göre cevaplarını ayarlamasına olanak tanıyan kontrollü bir alternatifi motive ediyor.’

Sadece Gerçekler

Makaleyi ve sunduğu çözümleri anlamak için, ‘bilgilendiricilik’ tanımını gözden geçirmek gerekiyor. Yazarlar, bir cevabın ‘bilgilendirici’ olmasının, ‘çıkıştaki desteklenen içeriğin miktarı, doğrulanmış atomik ifadelerin sayısı ile normalize edildiğini’ belirtiyorlar.

Başka bir yerde makale, bilgilendiriciliğin ‘çıkıştaki atomik gerçeklerin toplamı, doğru veya değil’ olduğunu daha basit bir şekilde belirtiyor.

Araştırmacılar ayrıca, LLM’lerin gerçek doğruluk ve öznel tahminler arasında değişme eğilimini, çok insanca bir özellik olarak belirtiyorlar ve çeşitli bilimsel çalışmalarla belgeliyorlar*:

‘[LLM’lerin bilgisi] düzensiz olarak güvenilirdir: bazı ifadeler güçlü bir şekilde desteklenirken, diğerleri spekülatif, eskimiş veya belirsizdir. Üretim因此, ne kadar söyleyeceğini ve nasıl söyleyeceğini kararlaştırmayı gerektirir, bu da gerçek doğruluk ve bilgilendiricilik arasında bir gerilime neden olur.

‘İnsanlar benzer seçimler yapar: yüksek güvenilirlikli gerçeklerle başlar ve daha düşük-güvenilirlikli ayrıntılar sadece sorulduğunda ekler.’

Deneyler sadece orta boy Mistral modeli üzerinde yapıldı, ancak uygulanan ilkeler çeşitli ölçeklerde ve platformlarda çalışmalıdır, çünkü bunlar bir LLM’nin dahili şemasına eklenen yeni bir niceliklendirme içerir ve bu tür bir değişiklik mimariye özgü değildir.

Yeni makale, İstenen Gerçeklik: Metin Oluşturma’da Gerçeklik-Bilgilendiricilik Ticaret-Off’unu Kontrol Etme başlığını taşıyor ve Columbia Üniversitesi, New York Üniversitesi ve NYU Shanghai’dan yedi araştırmacının eseridir.

Yöntem ve Veri

Makalede sunulan yeni yaklaşım, Gerçeklik-Kontrollü Oluşturma (FCG) olarak adlandırılıyor ve kullanıcıların bir sohbet botunun cevabının ne kadar doğru olmasını istediğini belirten sanal bir dial sunuyor. ‘Aslında,’ makalede deniyor, ‘FCG modeli, gerçeklik için kontrollü bir “knop” ile geliştirir’.

Model, hem bir kullanıcı sorusunu hem de istenilen bir gerçeklik düzeyini alır, ardından sadece yeterli güvenilirlikte olduğu düşünülen bilgileri içerir ve aynı zamanda mümkün olduğunca ayrıntılı olmaya çalışır.

(FactScore sistemi kullanılarak) örnek sorgulardan segmente edilmiş çıktı, gerçeklik uyum olarak tanımlanan bir kalite için değerlendirilir:

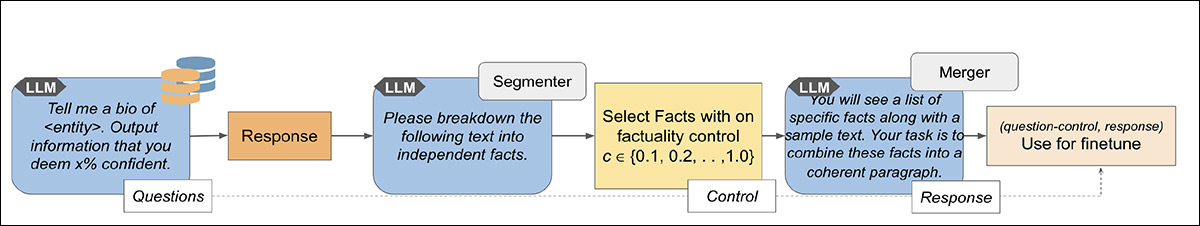

FCG için eğitim veri işleme hattı: bir dil modeli ilk cevabı oluşturur, onu atomik gerçeklere ayırır, onları güvenliğe göre sıralar ve istenen gerçeklik düzeyine ulaşılana kadar en az güvenilir olanları atar. Kaynak

Mevcut hiçbir veri kümesi FCG’nin gereksinimlerini karşılamadığından, yazarlar bir sentetik veri kümesi oluşturdular. Bunu yapmak için GPT-4† dil modelini ilk olarak kısıtlamasız bir cevap oluşturması için kullandılar, ardından en düşük-güvenilirlikli gerçekleri çıkardılar, böylece cevap verilen bir doğruluk düzeyini karşıladı.

Önceki çalışmalar, yalnızca gerçek veri üzerinde eğitim yapmanın aslında modelleri daha az gerçek yapabileceğini gösterdi, çünkü modelleri hiçbir ek ayrıntı sunmaktan caydırıyordu. Bu nedenle FCG eğitim örnekleri minimum düzeyde düzenlenmiştir, modelin kendi ifade ve ritmini korurken, yalnızca gerekli olan gerçeği karşılamak için yeterli gerçeği çıkarmıştır.

Bu düzenleme işlemini çeşitli hedef güvenlilik seviyelerinde, %10’dan %100’e kadar uygulayarak, her bir soruya birden fazla filtelenmiş cevap eşlenmiş bir sentetik veri kümesi oluşturuldu.

Her bir versiyonda, yalnızca modelin yeterli güvenilirlikte olduğuna inandığı gerçekler korunmuştur; bu örnekler daha sonra denetimli ince ayar için eğitim verileri olarak kullanılmıştır.

Son veri kümesi, 3.302 (soru, kontrol, cevap) üçlüsünden oluşuyor ve 396 tane doğrulama için, 450 eğitim ve 50 geliştirme için 500 varlıktan oluşuyor. Ek olarak, 183 farklı varlık test için kullanıldı.

Eğitim ve Testler

Yazarlar, Mistral-7B-Instruct-v0.2 LLM modelini çeşitli öğrenme oranlarında (3e-6, 1e-5, 3e-5) ince ayarladılar ve 30 dönem için 256’lık (not eğitim donanımı belirtilmedi) bir toplu iş boyutunda optimal (belirtilmeyen) LR’ye ulaştılar.

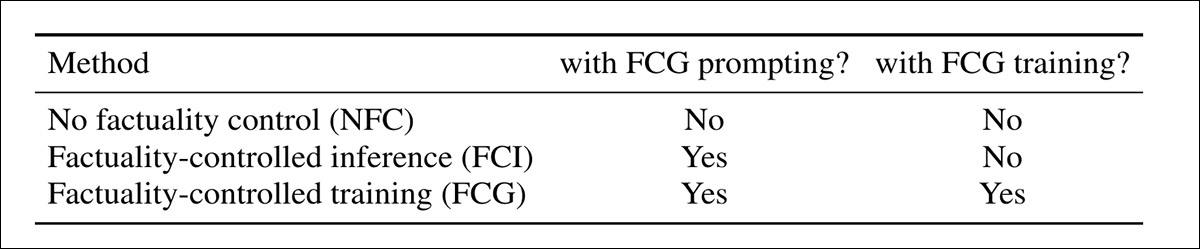

FCG, iki temel ile karşılaştırıldı. İlk temel, Gerçeklik Kontrolü Yok (NFC) idi, burada model sadece bir talep ile yönlendiriliyordu, örneğin X’in biyografisini söyle, doğruluk veya güvenlikle ilgili hiçbir atıf olmadan. Bu versiyon, bir LLM’nin varsayılan davranışını yansıtıyor, hiçbir filtreleme veya kısıtlama mekanizması olmadan.

İkinci yöntem, Gerçeklik-Kontrollü Çıkarım (FCI) olarak adlandırıldı ve aynı güvenlilik seviyesi promt’ları kullanıldı, ancak hiçbir ince ayar yapılmadı. Örneğin, model ‘%90 güvenliğe sahip bilgi ver’ gibi bir talimatla yönlendiriliyordu. Bu durumda, talimat eğitimdekine benziyordu, ancak model daha önce böyle kısıtlamalarla karşılaşmamıştı:

Üç test edilen yaklaşımın karşılaştırması: kontrolsüz temel, eğitimsiz promt’lar kullanan bir versiyon ve talimatları takip etmeyi öğrenen tam eğitimli model.

İlk olarak gerçeklik uyum için bir test yapıldı:

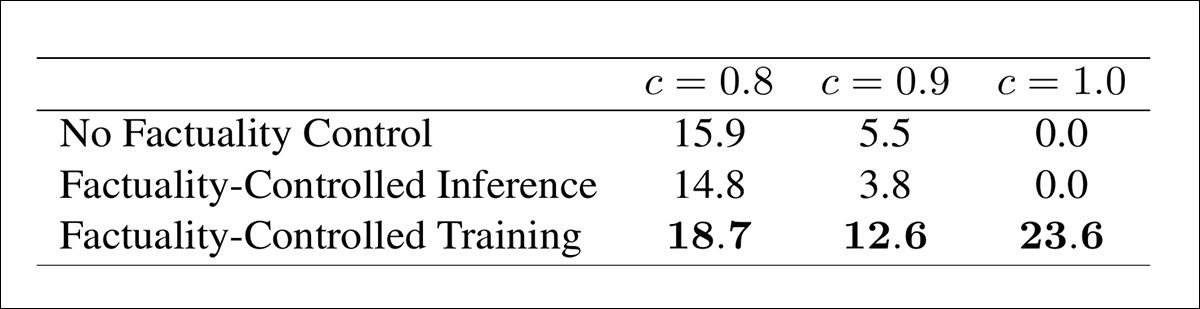

Üç hedef güvenlilik seviyesinde performans. Sadece tam eğitimli model, her zaman hedefleri karşılayabildi ve her düzeyde iki temel için daha iyi performans gösterdi, özellikle daha yüksek eşiği karşılayabildi.

%80, %90 ve %100 gerçeklik eşiği ile test edildiğinde, sadece ince ayarlanmış model hedefleri tutarlı bir şekilde karşılayabildi. Şaşırtıcı bir şekilde, sadece güvenlilik talimatlarını eklemek, modeli eğitmeden, yardımcı olmadı. Bazı durumlarda, durumları daha da kötüleştirdi; Örneğin, sadece %3.8’lik bir çıktı, %90’lık eşiği karşılayabildi, bu da hiçbir talimat verilmeyen versiyondan daha düşük bir performans gösterdi.

Buna karşılık, eğitimli model, kontrol sinyallerine güvenilir bir şekilde cevap verdi ve %80 için %18.7, %90 için %12.6 ve %100 için %23.6’luk uyumlu çıktılar üretti ve tek method olarak tamamen gerçek cevaplar üretebildi:

‘Bu gelişmeler, gerçeklik kontrolünün gerçekten denetimli eğitim yoluyla kazandırılabileceğini gösteriyor. FCG modeli, içeriğini ayarlayıp sadece yeterli güvenliğe sahip olduğu gerçekleri dahil etmeyi öğrenmiştir, oysa hazır model, kontrol sinyalini kendi başına etkili bir şekilde kullanamadı.’

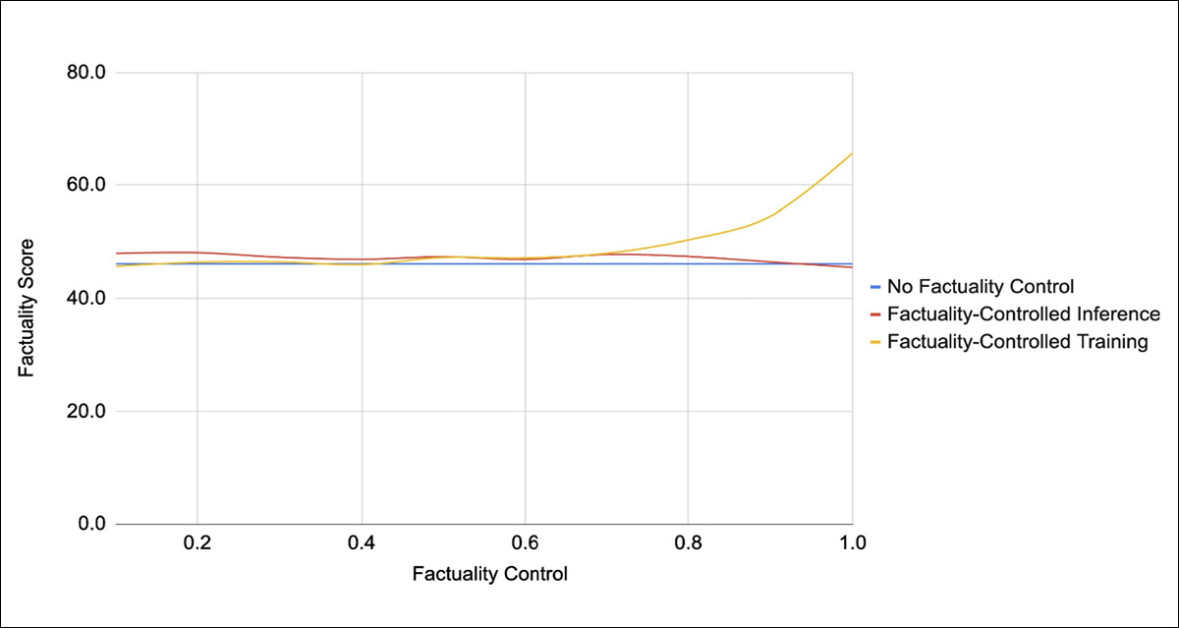

Ayrıca, modelin gerçekten kontrol sinyalini yorumlayıp yorumlayamadığını doğrulamak için tasarlanmış bir testte, araştırmacılar, istenen daha yüksek gerçeklik ayarlarının, ortalama gerçeklikte bir artışa yol açıp açmadığını kontrol ettiler.

Eğitimden önce böyle bir model görülmedi, ancak sonrasında sonuçlar, daha yüksek istenen gerçeklik ayarlarına karşılık olarak, daha doğru cevapların üretildiğini ortaya koydu:

Hedef gerçeklik ayarının yükselmesiyle, ince ayarlanmış model, daha gerçek çıktılar üretti, temel modeller ise aynı aralıkta tutarlı bir değişiklik göstermedi.

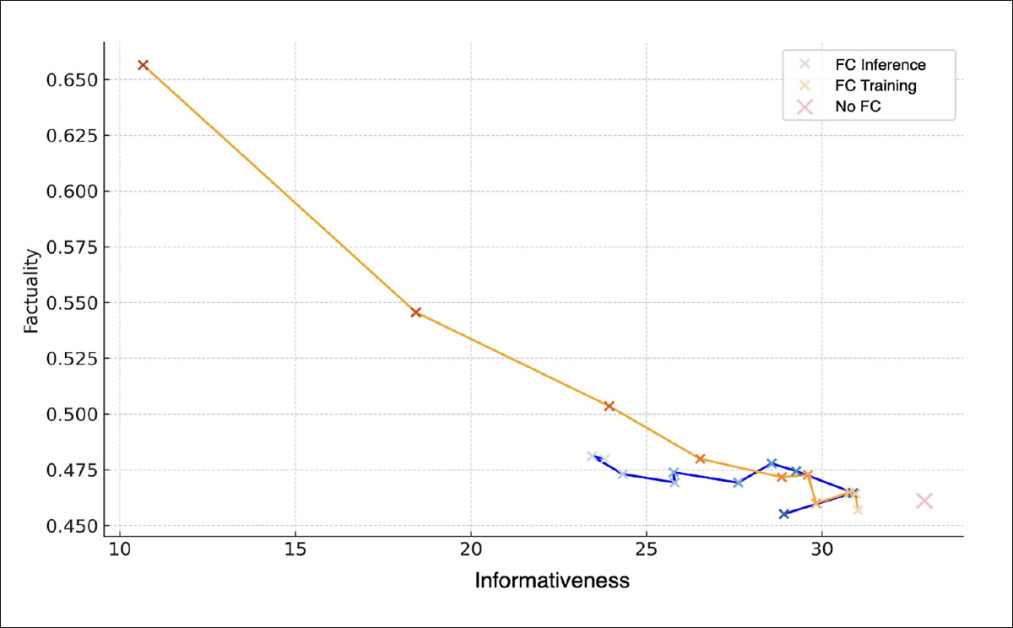

Gerçeklik ve ‘zenginlik’ arasındaki ticaret-off da incelendi. Çıktılar, sadece doğruluk için değil, aynı zamanda artan gerçeklik gereksinimlerine rağmen ne kadar doğrulanmış bilgi korunduğu açısından değerlendirildi. Grafiğe göre, FCG modeli, çoğu düzeyde hem çıkarım-only temel modelini hem de kısıtlamasız modeli outperformed:

Üç yöntem arasındaki gerçeklik ve bilgilendiricilik ticaret-off’unu gösteren grafik. İnce ayarlanmış model, diğer iki temel modelden daha iyi bir denge sunuyor, benzer doğruluk seviyelerinde daha fazla gerçek içerik korunuyor ve en yüksek ayarlanda, boş olmayan tam olarak doğrulanmış cevaplar üretebilen tek yöntem olarak kalıyor.

%90 hedef doğrulukta, FCG daha fazla gerçek korurken, tüm ayar aralığında tutarlı olarak daha iyi sonuçlar üretti.

Fark, en katı ayarlanda en belirgindi, burada FCG, diğer modellerin boş çıktıya düşerken, hala sıfır olmayan bir bilgilendiricilik seviyesi üretebiliyordu.

Buna karşılık, eğitimli model, çıktısını, sadece yeterli güvenliğe sahip olduğu gerçekleri korumak için yeniden şekillendirebildi ve diğer modellerin etkilendiği sessizliğe düşmekten kaçındı.

Gerçeklik doğrudan kontrol ayarına bağlıyken, bilgilendiricilik, modelin mümkün olduğunca güvenilir içeriği dahil etmesiyle optimize edildi. Daha yüksek ayarlarında, sadece güvenilir ifadeler korunurken, daha düşük ayarlarında daha spekülatif ayrıntılar dahil ediliyordu, bu da uzunluğu artırıyor ancak doğruluğu azaltıyordu.

Yazarlar şöyle sonuçlandırıyor:

‘[Yüksek bir gerçeklik kısıtlaması olduğunda,] model, gerçek olarak doğrulanabilir ifadeleri önceliklendirir ve aynı zamanda mümkün olduğunca fazla ilgili bilgiyi dahil etmeye çalışır. Buna karşılık, model daha geniş bir ayrıntı yelpazesini, bazıları daha az doğrulanabilir veya daha spekülatif olanları da dahil etmeye özgürdür, bu da bazı doğruluk kaybına rağmen daha yüksek bir bilgilendiricilik (daha fazla gerçek mention) ile sonuçlanır.

‘Bu davranış, eğitim verilerinin tasarımımıza uyuyor: her zaman minimum gerekli gerçekleri çıkardığımız için, model “eğer x% gerçekçi olman gerekiyorsa, en az güvenilir ayrıntıları at, ama geri kalan her şeyi koru” öğrendi.’

Makale, bu yeni metodolojinin daha büyük ölçekli modellerde denenmesi ve daha karmaşık görevlerde uygulanması da dahil olmak üzere olası gelecekteki uzantılar ile kapanıyor.

Sonuç

Burada sunulan çözüm, en son nesil Büyük Dil Modellerinin en ciddi ve sıkça belirtilen hatalarından birini, yani konuşkanlık yerine doğruluğu tercih etme eğilimini, görünüşte sadece ‘sohbeti sürdürmek’ için, ve güvenilebilir olmayan veya tamamen hayal ürünü bilgileri kesin olarak sunma eğilimini ele alıyor.

ChatGPT kullanıcıları için, ‘web’i arama’ widget’ın kısa bir görünümünden önce gelmeyen herhangi bir cevabın, modelin bilgi kesme tarihinden geldiği veya tamamen hayal ürünü olabileceği anlamına gelir.

Ancak, web aramaları gecikme ve LLM sunucusunun çalışma maliyetini artırır ve herhangi bir kullanıcı bilir ki, bu aramalar seçili olarak yapılır, ya da kullanıcı talebi üzerine yapılır, veya ‘özel bir ayar’ olarak ekstra token ücreti ile sunulur.

Bununla birlikte, bu tür iç ekonomiler, belirli alanlarda veya belirli sorgu türlerinde LLM sorguları için kritik bir etkiye sahip olabilir.

Doğrulukla ilgili herhangi bir şema uygulayabilen bir yöntem, gerçekten de hoş karşılanan bir araştırmadır.

* Yazarların inline atıfını hyperlink’e dönüştürmüşüm.

† Tam sürüm numarası verilmemiş.

İlk olarak 6 Şubat 2026 Cuma günü yayımlandı. Beş dakika içinde kelime tekrarını düzeltmek için değiştirildi