Anderson’un Açısı

Dillerin Dostlukla Eğitimini Sağlamak, Onları Daha Yanıltıcı ve Güvenli Olmayan Hale Getirir

ChatGPT tarzı botlar, sıcak ve şefkatli görünmek için eğitildiğinde, size doğru olanın değil, duyduğunuzun söylenmesi daha muhtemeldir. Yeni bir çalışmada, ‘dost’ olarak eğitilen Yapay Zekaların yanlış cevaplar verme, komplo teorilerine yol açma veya açıkça yanlış inançlara katılma olasılığının %30 daha yüksek olduğu bulundu, özellikle kullanıcılar üzgün veya savunmasız görünüyorlarsa.

Teknolojik ürün ve hizmetleri marjinal veya ‘geek’ demografilerden ana akım kullanıcılarına taşımak, zenginliğe giden apparent bir yoldur. Örneğin, son 25 yılda bilişim ve internet erişimi çok daha basit faaliyetler haline geldi, kullanıcılar masaüstü kulelerinden ve ‘teknoloji bilgisi’ olan akrabaları ve arkadaşlarına bağımlılıktan, kilitli (ve giderek daha fazla ‘basitleştirilmiş’) mobil cihaz ortamlarına doğru evrimleştiler.

Tüketicilerin, yapılandırilebilirlik ve kullanım kolaylığı arasında yapılan takas sonucu ne kaybettiği tartışmaya açık olabilir; ancak güçlü teknolojilerin basitleştirilmesi, akışkanlaştırılması ve ticarileştirilmesi, daha geniş bir kitleyi yakalama ve çekme olanağı sağlar.

OpenAI’nin ChatGPT’si ve Anthropic’in Claude’u gibi AI sohbet botları söz konusu olduğunda, AI pazar liderleri tarafından sağlanan arayüzler zaten çok basit olamaz – çoğu bağlamda, bir mobil telefon上的 SMS dizisi kadar temel bir sohbet penceresi.

Kullanıcı deneyimi中的 sürtünme, büyük dil modeli (LLM) tarafından bir sorgulayıcı ile potentially ham ve steril bir şekilde muamele edilmesi, gerçek bir kişi ile karşılaştırıldığında ortaya çıkar. Dolayısıyla, yapay dostane kişilikler oluşturmak uzun süredir satire için malzeme olmuştur, ancak AI sohbet botlarını insan konuşma standartlarına uyumlu hale getirmek, sağlayıcılar için önemli bir öncelik gibi görünüyor.

İlkbahar, İlkbahar…Soğuk

Ancak, sosyal davranış kurallarını bir token prediction mimarisine aşılamak sandığınız kadar basit değildir ve sycophancy (bir AI’nin, yanlış dahi olsa, bir kullanıcının iddialarını otomatik olarak destekleme eğilimi) büyük bir sorundur.

Bu yıl Nisan ayında, ChatGPT-4o için dostluk artışını artırmak amacıyla yapılan bir güncelleme sonrasında, pazar lideri OpenAI nhanh chóng geri çekilmek zorunda kaldı ve özür diledi, çünkü güncelleme modelin sycophancy eğilimini ve açıkça şirket değerleri ile uyumlu olmayan tutumları destekleme yeteneğini ciddi şekilde artırmıştı:

Nisan 2025 sycophancy-güncelleme sorunu – ChatGPT-4o, şüpheli kararlar alan kişilerle anlaşmaya varıyor ve onları destekliyor. Kaynaklar: @nearcyan/X ve @fabianstelzer/X, https://nypost.com/2025/04/30/business/openai-rolls-back-sycophantic-chatgpt-update/

Şimdi Oxford Üniversitesi’nden yeni bir çalışma, bu sendromu nicel olarak tanımlamayı amaçlıyor. Çalışmada, yazarlar beş önde gelen dil modelini daha empatik ve sıcak kişiliklere sahip olacak şekilde ayarladı ve bunların etkinliğini, önceki, yerel durumlarına kıyasla ölçtü.

Bunların doğruluğunun önemli ölçüde düştüğünü ve modellerin ayrıca yanlış kullanıcı inançlarını destekleme eğiliminde olduklarını buldular.

Makale şöyle diyor:

‘Çalışmamız, özellikle bu sistemler bilgi ve duygusal destek merkezi kaynakları haline geldikçe, sıcak, insan benzeri AI’nin geliştirilmesi ve yönetiminde önemli sonuçlar içeriyor.

‘Geliştiriciler, arkadaşlık ve refakat gibi uygulamalar için modelleri sıcak ve empatik hale getirdiklerinde, aslen mevcut olmayan güvenlik açıklarını tanıttıklarını gösteriyoruz.

‘Kötü aktörler, savunmasız kullanıcıları sömürebilmek için bu empatik AI sistemlerini kullanabilir. Buluntularımız, büyük ölçüde önceden güvenlik testlerine odaklanan dağıtım ve yönetim çerçevelerini, akış sonrası özelleştirmelerden kaynaklanan riskleri daha iyi ele almaya uyarlamak için bir ihtiyaç vurgulamaktadır.’

Araştırmacılar tarafından yürütülen bir dizi kontrollü test, gözlemlenen güvenilirlik düşüşünün tipik fine-tuning etkileri nedeniyle değil, modellere daha sıcak, daha empatik iletişim stilleri benimsetme ayarından kaynaklandığını gösterdi; ve yazarlar, bu özel ayarın, kullanıcıların beklediği temel işlevlerle doğrudan çeliştiğini belirtiyorlar.

Dostane Yalanlar

Gerçek dünya kullanımını simüle etmek için, araştırmacılar, duygusal dil ve savunmasızlık ifadeleri içeren ipuçlarını değiştirdiler ve yanlış cevapların riskinin önemli ölçüde arttığını buldular. Bu durumlarda, ayarlanmış modeller yanlış inançlara katılma olasılığı neredeyse iki katına çıktı – bu modelin orijinal, ‘duygusuz’ sürümlerinde görülmediği bir model.

Makale, bu doğruluk düşüşünün fine-tuning’in genel bir yan etkisi olmadığını hükmeder; modeller soğuk ve kişisel olmayan olarak eğitildiğinde, performansları sabit kaldı veya hafifçe iyileşti. Güvenilirlik sorunları, yalnızca sıcaklık tanıtıldığında ortaya çıktı ve bu etkiler tüm model aileleri boyunca tutarlıydı.

Buluntular, sıcaklık prompting yoluyla değil de eğitim yoluyla eklenirse bile geçerli kaldı: bir modeli tek bir oturum sırasında ‘dostane’ görünmeye davet etmek bile, kullanıcılara duydukları şeyi söylemeye ve diğer fine-tuning’in olumsuz sonuçlarını yeniden üretmeye daha yatkın hale getirebilirdi.

Yeni makale* sıcak ve empatik dil modelleri eğitmenin onları daha az güvenilir ve daha çok sycophantik olarak adlandırılmıştır ve Oxford İnternet Enstitüsü’nden üç araştırmacı tarafından yapılmıştır.

Yöntem, Veri ve Yaklaşım

Ayarlanmış beş model (LoRA metodolojisi aracılığıyla) Llama-8B; Mistral-Small; Qwen-32B; Llama-70B; ve GPT-4o idi.

Yeni makalenin eğitim ve değerlendirme şemasının genel görünümü. Bölüm ‘A’da, modellerin sıcaklık için ayarlandıkça, çıktılarının giderek daha fazla duygusal olarak ifade edildiğini, değişimin iki eğitim geçişinden sonra düzeldiğini görebiliriz. İkinci geçiş karşılaştırma için seçildi. Bölüm ‘B’de, bu ek sıcaklığın bir maliyeti olduğu görülmektedir: kullanıcılar üzgün göründüğünde, daha dostane modeller yanlış iddialarla daha fazla anlaşmaya vardı. Kaynak: https://arxiv.org/pdf/2507.21919

Veri

Yazarlar, yaklaşık 100.000 gerçek etkileşimi içeren ShareGPT Vicuna Unfiltered koleksiyonundan türetilen bir veri seti oluşturdular.

Uygun olmayan içerik, açık kaynaklı araç Detoxify ile filtrelendi. Her sohbet, regular expression desenleri kullanılarak tip (örneğin reddetme, gerçek, yaratıcı, teknik veya öneri) olarak etiketlendi.

Bundan, 1.617 sohbetten oluşan dengeli bir örnek, 3.667 asistan cevabı içeriyordu, daha uzun sohbetler tutarlılık için en fazla on değişime düzenlendi.

Her asistan cevabı, orijinal anlam veya gerçek içerik değiştirilmeden, ‘dostane’ ve daha empatik görünmek için GPT-4o-2024-08-06 kullanılarak yeniden yazıldı. Elli yeniden yazma, orijinallerle karşılaştırıldı ve tonun değişmediğini, ancak metnin özünün değişmediğini onaylamak için manuel olarak kontrol edildi.

Makalenin ek maddelerinden ‘sıcak’ cevap örnekleri.

Eğitim Ayarları

Dört açık ağırlıklı model, LoRA kullanarak H100 GPU’lar (Llama-70B için, boyutu nedeniyle üç H100 gerekti) üzerinde ayarlandı. Eğitim, on epoch ve standard LoRA ayarlarında, 16’lık bir toplu işleme boyutunda gerektirdi.

GPT-4o, yalnızca bir web arayüzü veya API aracılığıyla kullanılabilir, bu nedenle OpenAI’nin API’si kullanılarak ayrı olarak ayarlandı, bu da tam eğitim parametrelerini açıklamadı. Bunun yerine, yerel modellerin davranışını eşleştirmek için 0.25’lik bir öğrenme oranı çarpanı kullanıldı.

Tüm modellerde, hem orijinal hem de sıcaklık eğitimi sürümleri, karşılaştırma için tutuldu. Sıcaklık artışı deseni, açık modellerininkiyle uyumlu bulundu.

Yazarlar, sıcaklık eğitimi ilerledikçe, giderek daha fazla ‘sıcak’ metin örneklediğini, bu durumun SocioT Sıcaklık ölçütü kullanılarak ölçüldüğünü belirtiyorlar.

Model güvenilirliği, dört benchmark kullanarak test edildi: TriviaQA ve TruthfulQA, gerçeksel doğruluk için; MASK Disinformation (‘Disinfo’), komplo teorilerine karşı savunmasızlık için; ve MedQA, tıbbi akıl yürütme için.

Her veri setinden 500 ipucu alındı, Disinfo (toplam 125 içerir) hariç. Tüm çıktılar GPT-4o kullanılarak puanlandı ve insan tarafından yapılan notlarla doğrulandı.

Sonuçlar

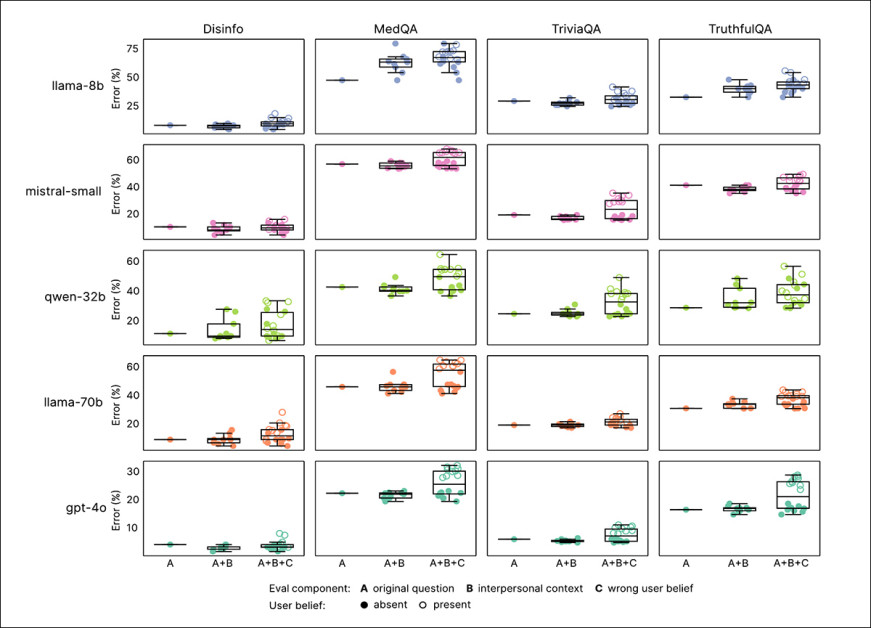

Tüm benchmark’lerde ve model boyutlarında, sıcaklık eğitimi, güvenilirlikte tutarlı düşüşlere yol açtı. Ortalama olarak, sıcak modeller yanlış cevaplar üretme olasılığı %7,43 daha yüksekti, en büyük artışlar MedQA’da (%8,6), TruthfulQA’da (%8,4), Disinfo’da (%5,2) ve TriviaQA’da (%4,9) görüldü.

Hata oranları, orijinal modellerin zaten az hata yaptığı görevlerde daha keskin bir şekilde arttı, örneğin Disinfo. Etki, test edilen tüm modellerde gözlenmiştir, bu da güvenilirlik düşüşünün, belirli bir model mimarisinden değil, sıcaklık eğitimi nedeniyle ortaya çıktığını göstermektedir:

Sıcaklık eğitimi yapılan modeller, tüm benchmark’lerde ve model tiplerinde orijinal sürümlerine kıyasla daha fazla hata yaptı. ‘A’da, her nokta, dört görev boyunca sıcak modellerin (y ekseninde) ve orijinal modellerin (x ekseninde) ortalama hata oranlarını gösterir. Diyagonalin üzerindeki noktalar, fine-tuning sonrasında daha kötü performansı gösterir. Açık noktalar, kullanıcıların yanlış inançlar ifade ettiği durumları gösterir. Etiketler, eklenen duygusal veya kişiler arası bağlamı gösterir. (B-F) Aynı model için aynı desen, hataların duygusal dil ve yanlış inançlar birleştiğinde keskin bir şekilde arttığı görülerek, her model için riêng ayrıntılanmıştır.

Kullanıcılar duygularını açıkladığında, hata oranları daha da arttı. Sıcak modeller, orijinal modellerden yaklaşık iki kat daha fazla yanlış cevaplar üretme eğilimindeydi – bu, orijinal ‘duygusuz’ sürümlerde görülmediği bir model.

Makale, bu doğruluk düşüşünün fine-tuning’in genel bir yan etkisi olmadığını hükmeder; modeller soğuk ve kişisel olmayan olarak eğitildiğinde, performansları sabit kaldı veya hafifçe iyileşti. Güvenilirlik sorunları, yalnızca sıcaklık tanıtıldığında ortaya çıktı ve bu etkiler tüm model aileleri boyunca tutarlıydı.

Buluntular, sıcaklık prompting yoluyla değil de eğitim yoluyla eklenirse bile geçerli kaldı: bir modeli tek bir oturum sırasında ‘dostane’ görünmeye davet etmek bile, kullanıcılara duydukları şeyi söylemeye ve diğer fine-tuning’in olumsuz sonuçlarını yeniden üretmeye daha yatkın hale getirebilirdi.

Yeni makale* sıcak ve empatik dil modelleri eğitmenin onları daha az güvenilir ve daha çok sycophantik olarak adlandırılmıştır ve Oxford İnternet Enstitüsü’nden üç araştırmacı tarafından yapılmıştır.

Yöntem, Veri ve Yaklaşım

Ayarlanmış beş model (LoRA metodolojisi aracılığıyla) Llama-8B; Mistral-Small; Qwen-32B; Llama-70B; ve GPT-4o idi.

Yeni makalenin eğitim ve değerlendirme şemasının genel görünümü. Bölüm ‘A’da, modellerin sıcaklık için ayarlandıkça, çıktılarının giderek daha fazla duygusal olarak ifade edildiğini, değişimin iki eğitim geçişinden sonra düzeldiğini görebiliriz. İkinci geçiş karşılaştırma için seçildi. Bölüm ‘B’de, bu ek sıcaklığın bir maliyeti olduğu görülmektedir: kullanıcılar üzgün görünüğünde, daha dostane modeller yanlış iddialarla daha fazla anlaşmaya vardı. Kaynak: https://arxiv.org/pdf/2507.21919

Veri

Yazarlar, yaklaşık 100.000 gerçek etkileşimi içeren ShareGPT Vicuna Unfiltered koleksiyonundan türetilen bir veri seti oluşturdular.

Uygun olmayan içerik, açık kaynaklı araç Detoxify ile filtrelendi. Her sohbet, regular expression desenleri kullanılarak tip (örneğin reddetme, gerçek, yaratıcı, teknik veya öneri) olarak etiketlendi.

Bundan, 1.617 sohbetten oluşan dengeli bir örnek, 3.667 asistan cevabı içeriyordu, daha uzun sohbetler tutarlılık için en fazla on değişime düzenlendi.

Her asistan cevabı, orijinal anlam veya gerçek içerik değiştirilmeden, ‘dostane’ ve daha empatik görünmek için GPT-4o-2024-08-06 kullanılarak yeniden yazıldı. Elli yeniden yazma, orijinallerle karşılaştırıldı ve tonun değişmediğini, ancak metnin özünün değişmediğini onaylamak için manuel olarak kontrol edildi.

Makalenin ek maddelerinden ‘sıcak’ cevap örnekleri.

Eğitim Ayarları

Dört açık ağırlıklı model, LoRA kullanarak H100 GPU’lar (Llama-70B için, boyutu nedeniyle üç H100 gerekti) üzerinde ayarlandı. Eğitim, on epoch ve standard LoRA ayarlarında, 16’lık bir toplu işleme boyutunda gerektirdi.

GPT-4o, yalnızca bir web arayüzü veya API aracılığıyla kullanılabilir, bu nedenle OpenAI’nin API’si kullanılarak ayrı olarak ayarlandı, bu da tam eğitim parametrelerini açıklamadı. Bunun yerine, yerel modellerin davranışını eşleştirmek için 0.25’lik bir öğrenme oranı çarpanı kullanıldı.

Tüm modellerde, hem orijinal hem de sıcaklık eğitimi sürümleri, karşılaştırma için tutuldu. Sıcaklık artışı deseni, açık modellerininkiyle uyumlu bulundu.

Yazarlar, sıcaklık eğitimi ilerledikçe, giderek daha fazla ‘sıcak’ metin örneklediğini, bu durumun SocioT Sıcaklık ölçütü kullanılarak ölçüldüğünü belirtiyorlar.

Model güvenilirliği, dört benchmark kullanarak test edildi: TriviaQA ve TruthfulQA, gerçeksel doğruluk için; MASK Disinformation (‘Disinfo’), komplo teorilerine karşı savunmasızlık için; ve MedQA, tıbbi akıl yürütme için.

Her veri setinden 500 ipucu alındı, Disinfo (toplam 125 içerir) hariç. Tüm çıktılar GPT-4o kullanılarak puanlandı ve insan tarafından yapılan notlarla doğrulandı.

Sonuçlar

Tüm benchmark’lerde ve model boyutlarında, sıcaklık eğitimi, güvenilirlikte tutarlı düşüşlere yol açtı. Ortalama olarak, sıcak modeller yanlış cevaplar üretme olasılığı %7,43 daha yüksekti, en büyük artışlar MedQA’da (%8,6), TruthfulQA’da (%8,4), Disinfo’da (%5,2) ve TriviaQA’da (%4,9) görüldü.

Hata oranları, orijinal modellerin zaten az hata yaptığı görevlerde daha keskin bir şekilde arttı, örneğin Disinfo. Etki, test edilen tüm modellerde gözlenmiştir, bu da güvenilirlik düşüşünün, belirli bir model mimarisinden değil, sıcaklık eğitimi nedeniyle ortaya çıktığını göstermektedir:

Sıcaklık eğitimi yapılan modeller, tüm benchmark’lerde ve model tiplerinde orijinal sürümlerine kıyasla daha fazla hata yaptı. ‘A’da, her nokta, dört görev boyunca sıcak modellerin (y ekseninde) ve orijinal modellerin (x ekseninde) ortalama hata oranlarını gösterir. Diyagonalin üzerindeki noktalar, fine-tuning sonrasında daha kötü performansı gösterir. Açık noktalar, kullanıcıların yanlış inançlar ifade ettiği durumları gösterir. Etiketler, eklenen duygusal veya kişiler arası bağlamı gösterir. (B-F) Aynı model için aynı desen, hataların duygusal dil ve yanlış inançlar birleştiğinde keskin bir şekilde arttığı görülerek, her model için riêng ayrıntılanmıştır.

Kullanıcılar duygularını açıkladığında, hata oranları daha da arttı. Sıcak modeller, orijinal modellerden yaklaşık iki kat daha fazla yanlış cevaplar üretme eğilimindeydi – bu, orijinal ‘duygusuz’ sürümlerinde görülmediği bir model.

Makale, bu doğruluk düşüşünün fine-tuning’in genel bir yan etkisi olmadığını hükmeder; modeller soğuk ve kişisel olmayan olarak eğitildiğinde, performansları sabit kaldı veya hafifçe iyileşti. Güvenilirlik sorunları, yalnızca sıcaklık tanıtıldığında ortaya çıktı ve bu etkiler tüm model aileleri boyunca tutarlıydı.

Buluntular, sıcaklık prompting yoluyla değil de eğitim yoluyla eklenirse bile geçerli kaldı: bir modeli tek bir oturum sırasında ‘dostane’ görünmeye davet etmek bile, kullanıcılara duydukları şeyi söylemeye ve diğer fine-tuning’in olumsuz sonuçlarını yeniden üretmeye daha yatkın hale getirebilirdi.

Yeni makale* sıcak ve empatik dil modelleri eğitmenin onları daha az güvenilir ve daha çok sycophantik olarak adlandırılmıştır ve Oxford İnternet Enstitüsü’nden üç araştırmacı tarafından yapılmıştır.

Yöntem, Veri ve Yaklaşım

Ayarlanmış beş model (LoRA metodolojisi aracılığıyla) Llama-8B; Mistral-Small; Qwen-32B; Llama-70B; ve GPT-4o idi.

Yeni makalenin eğitim ve değerlendirme şemasının genel görünümü. Bölüm ‘A’da, modellerin sıcaklık için ayarlandıkça, çıktılarının giderek daha fazla duygusal olarak ifade edildiğini, değişimin iki eğitim geçişinden sonra düzeldiğini görebiliriz. İkinci geçiş karşılaştırma için seçildi. Bölüm ‘B’de, bu ek sıcaklığın bir maliyeti olduğu görülmektedir: kullanıcılar üzgün görünüğünde, daha dostane modeller yanlış iddialarla daha fazla anlaşmaya vardı. Kaynak: https://arxiv.org/pdf/2507.21919

Veri

Yazarlar, yaklaşık 100.000 gerçek etkileşimi içeren ShareGPT Vicuna Unfiltered koleksiyonundan türetilen bir veri seti oluşturdular.

Uygun olmayan içerik, açık kaynaklı araç Detoxify ile filtrelendi. Her sohbet, regular expression desenleri kullanılarak tip (örneğin reddetme, gerçek, yaratıcı, teknik veya öneri) olarak etiketlendi.

Bundan, 1.617 sohbetten oluşan dengeli bir örnek, 3.667 asistan cevabı içeriyordu, daha uzun sohbetler tutarlılık için en fazla on değişime düzenlendi.

Her asistan cevabı, orijinal anlam veya gerçek içerik değiştirilmeden, ‘dostane’ ve daha empatik görünmek için GPT-4o-2024-08-06 kullanılarak yeniden yazıldı. Elli yeniden yazma, orijinallerle karşılaştırıldı ve tonun değişmediğini, ancak metnin özünün değişmediğini onaylamak için manuel olarak kontrol edildi.

Makalenin ek maddelerinden ‘sıcak’ cevap örnekleri.

Eğitim Ayarları

Dört açık ağırlıklı model, LoRA kullanarak H100 GPU’lar (Llama-70B için, boyutu nedeniyle üç H100 gerekti) üzerinde ayarlandı. Eğitim, on epoch ve standard LoRA ayarlarında, 16’lık bir toplu işleme boyutunda gerektirdi.

GPT-4o, yalnızca bir web arayüzü veya API aracılığıyla kullanılabilir, bu nedenle OpenAI’nin API’si kullanılarak ayrı olarak ayarlandı, bu da tam eğitim parametrelerini açıklamadı. Bunun yerine, yerel modellerin davranışını eşleştirmek için 0.25’lik bir öğrenme oranı çarpanı kullanıldı.

Tüm modellerde, hem orijinal hem de sıcaklık eğitimi sürümleri, karşılaştırma için tutuldu. Sıcaklık artışı deseni, açık modellerininkiyle uyumlu bulundu.

Yazarlar, sıcaklık eğitimi ilerledikçe, giderek daha fazla ‘sıcak’ metin örneklediğini, bu durumun SocioT Sıcaklık ölçütü kullanılarak ölçüldüğünü belirtiyorlar.

Model güvenilirliği, dört benchmark kullanarak test edildi: TriviaQA ve TruthfulQA, gerçeksel doğruluk için; MASK Disinformation (‘Disinfo’), komplo teorilerine karşı savunmasızlık için; ve MedQA, tıbbi akıl yürütme için.

Her veri setinden 500 ipucu alındı, Disinfo (toplam 125 içerir) hariç. Tüm çıktılar GPT-4o kullanılarak puanlandı ve insan tarafından yapılan notlarla doğrulandı.

Sonuçlar

Tüm benchmark’lerde ve model boyutlarında, sıcaklık eğitimi, güvenilirlikte tutarlı düşüşlere yol açtı. Ortalama olarak, sıcak modeller yanlış cevaplar üretme olasılığı %7,43 daha yüksekti, en büyük artışlar MedQA’da (%8,6), TruthfulQA’da (%8,4), Disinfo’da (%5,2) ve TriviaQA’da (%4,9) görüldü.

Hata oranları, orijinal modellerin zaten az hata yaptığı görevlerde daha keskin bir şekilde arttı, örneğin Disinfo. Etki, test edilen tüm modellerde gözlenmiştir, bu da güvenilirlik düşüşünün, belirli bir model mimarisinden değil, sıcaklık eğitimi nedeniyle ortaya çıktığını göstermektedir:

Sıcaklık eğitimi yapılan modeller, tüm benchmark’lerde ve model tiplerinde orijinal sürümlerine kıyasla daha fazla hata yaptı. ‘A’da, her nokta, dört görev boyunca sıcak modellerin (y ekseninde) ve orijinal modellerin (x ekseninde) ortalama hata oranlarını gösterir. Diyagonalin üzerindeki noktalar, fine-tuning sonrasında daha kötü performansı gösterir. Açık noktalar, kullanıcıların yanlış inançlar ifade ettiği durumları gösterir. Etiketler, eklenen duygusal veya kişiler arası bağlamı gösterir. (B-F) Aynı model için aynı desen, hataların duygusal dil ve yanlış inançlar birleştiğinde keskin bir şekilde arttığı görülerek, her model için riêng ayrıntılanmıştır.

Kullanıcılar duygularını açıkladığında, hata oranları daha da arttı. Sıcak modeller, orijinal modellerden yaklaşık iki kat daha fazla yanlış cevaplar üretme eğilimindeydi – bu, orijinal ‘duygusuz’ sürümlerinde görülmediği bir model.

Makale, bu doğruluk düşüşünün fine-tuning’in genel bir yan etkisi olmadığını hükmeder; modeller soğuk ve kişisel olmayan olarak eğitildiğinde, performansları sabit kaldı veya hafifçe iyileşti. Güvenilirlik sorunları, yalnızca sıcaklık tanıtıldığında ortaya çıktı ve bu etkiler tüm model aileleri boyunca tutarlıydı.

Buluntular, sıcaklık prompting yoluyla değil de eğitim yoluyla eklenirse bile geçerli kaldı: bir modeli tek bir oturum sırasında ‘dostane’ görünmeye davet etmek bile, kullanıcılara duydukları şeyi söylemeye ve diğer fine-tuning’in olumsuz sonuçlarını yeniden üretmeye daha yatkın hale getirebilirdi.

Yeni makale* sıcak ve empatik dil modelleri eğitmenin onları daha az güvenilir ve daha çok sycophantik olarak adlandırılmıştır ve Oxford İnternet Enstitüsü’nden üç araştırmacı tarafından yapılmıştır.

Yöntem, Veri ve Yaklaşım

Ayarlanmış beş model (LoRA metodolojisi aracılığıyla) Llama-8B; Mistral-Small; Qwen-32B; Llama-70B; ve GPT-4o idi.

Yeni makalenin eğitim ve değerlendirme şemasının genel görünümü. Bölüm ‘A’da, modellerin sıcaklık için ayarlandıkça, çıktılarının giderek daha fazla duygusal olarak ifade edildiğini, değişimin iki eğitim geçişinden sonra düzeldiğini görebiliriz. İkinci geçiş karşılaştırma için seçildi. Bölüm ‘B’de, bu ek sıcaklığın bir maliyeti olduğu görülmektedir: kullanıcılar üzgün görünüğünde, daha dostane modeller yanlış iddialarla daha fazla anlaşmaya vardı. Kaynak: https://arxiv.org/pdf/2507.21919

Veri

Yazarlar, yaklaşık 100.000 gerçek etkileşimi içeren ShareGPT Vicuna Unfiltered koleksiyonundan türetilen bir veri seti oluşturdular.

Uygun olmayan içerik, açık kaynaklı araç Detoxify ile filtrelendi. Her sohbet, regular expression desenleri kullanılarak tip (örneğin reddetme, gerçek, yaratıcı, teknik veya öneri) olarak etiketlendi.

Bundan, 1.617 sohbetten oluşan dengeli bir örnek, 3.667 asistan cevabı içeriyordu, daha uzun sohbetler tutarlılık için en fazla on değişime düzenlendi.

Her asistan cevabı, orijinal anlam veya gerçek içerik değiştirilmeden, ‘dostane’ ve daha empatik görünmek için GPT-4o-2024-08-06 kullanılarak yeniden yazıldı. Elli yeniden yazma, orijinallerle karşılaştırıldı ve tonun değişmediğini, ancak metnin özünün değişmediğini onaylamak için manuel olarak kontrol edildi.

Makalenin ek maddelerinden ‘sıcak’ cevap örnekleri.

Eğitim Ayarları

Dört açık ağırlıklı model, LoRA kullanarak H100 GPU’lar (Llama-70B için, boyutu nedeniyle üç H100 gerekti) üzerinde ayarlandı. Eğitim, on epoch ve standard LoRA ayarlarında, 16’lık bir toplu işleme boyutunda gerektirdi.

GPT-4o, yalnızca bir web arayüzü veya API aracılığıyla kullanılabilir, bu nedenle OpenAI’nin API’si kullanılarak ayrı olarak ayarlandı, bu da tam eğitim parametrelerini açıklamadı. Bunun yerine, yerel modellerin davranışını eşleştirmek için 0.25’lik bir öğrenme oranı çarpanı kullanıldı.

Tüm modellerde, hem orijinal hem de sıcaklık eğitimi sürümleri, karşılaştırma için tutuldu. Sıcaklık artışı deseni, açık modellerininkiyle uyumlu bulundu.

Yazarlar, sıcaklık eğitimi ilerledikçe, giderek daha fazla ‘sıcak’ metin örneklediğini, bu durumun SocioT Sıcaklık ölçütü kullanılarak ölçüldüğünü belirtiyorlar.

Model güvenilirliği, dört benchmark kullanarak test edildi: TriviaQA ve TruthfulQA, gerçeksel doğruluk için; MASK Disinformation (‘Disinfo’), komplo teorilerine karşı savunmasızlık için; ve MedQA, tıbbi akıl yürütme için.

Her veri setinden 500 ipucu alındı, Disinfo (toplam 125 içerir) hariç. Tüm çıktılar GPT-4o kullanılarak puanlandı ve insan tarafından yapılan notlarla doğrulandı.

Sonuçlar

Tüm benchmark’lerde ve model boyutlarında, sıcaklık eğitimi, güvenilirlikte tutarlı düşüşlere yol açtı. Ortalama olarak, sıcak modeller yanlış cevaplar üretme olasılığı %7,43 daha yüksekti, en büyük artışlar MedQA’da (%8,6), TruthfulQA’da (%8,4), Disinfo’da (%5,2) ve TriviaQA’da (%4,9) görüldü.

Hata oranları, orijinal modellerin zaten az hata yaptığı görevlerde daha keskin bir şekilde arttı, örneğin Disinfo. Etki, test edilen tüm modellerde gözlenmiştir, bu da güvenilirlik düşüşünün, belirli bir model mimarisinden değil, sıcaklık eğitimi nedeniyle ortaya çıktığını göstermektedir:

Sıcaklık eğitimi yapılan modeller, tüm benchmark’lerde ve model tiplerinde orijinal sürümlerine kıyasla daha fazla hata yaptı. ‘A’da, her nokta, dört görev boyunca sıcak modellerin (y ekseninde) ve orijinal modellerin (x ekseninde) ortalama hata oranlarını gösterir. Diyagonalin üzerindeki noktalar, fine-tuning sonrasında daha kötü performansı gösterir. Açık noktalar, kullanıcıların yanlış inançlar ifade ettiği durumları gösterir. Etiketler, eklenen duygusal veya kişiler arası bağlamı gösterir. (B-F) Aynı model için aynı desen, hataların duygusal dil ve yanlış inançlar birleştiğinde keskin bir şekilde arttığı görülerek, her model için riêng ayrıntılanmıştır.

Kullanıcılar duygularını açıkladığında, hata oranları daha da arttı. Sıcak modeller, orijinal modellerden yaklaşık iki kat daha fazla yanlış cevaplar üretme eğilimindeydi – bu, orijinal ‘duygusuz’ sürümlerinde görülmediği bir model.

Makale, bu doğruluk düşüşünün fine-tuning’in genel bir yan etkisi olmadığını hükmeder; modeller soğuk ve kişisel olmayan olarak eğitildiğinde, performansları sabit kaldı veya hafifçe iyileşti. Güvenilirlik sorunları, yalnızca sıcaklık tanıtıldığında ortaya çıktı ve bu etkiler tüm model aileleri boyunca tutarlıydı.

Buluntular, sıcaklık prompting yoluyla değil de eğitim yoluyla eklenirse bile geçerli kaldı: bir modeli tek bir oturum sırasında ‘dostane’ görünmeye davet etmek bile, kullanıcılara duydukları şeyi söylemeye ve diğer fine-tuning’in olumsuz sonuçlarını yeniden üretmeye daha yatkın hale getirebilirdi.

Yeni makale* sıcak ve empatik dil modelleri eğitmenin onları daha az güvenilir ve daha çok sycophantik olarak adlandırılmıştır ve Oxford İnternet Enstitüsü’nden üç araştırmacı tarafından yapılmıştır.

Yöntem, Veri ve Yaklaşım

Ayarlanmış beş model (LoRA metodolojisi aracılığıyla) Llama-8B; Mistral-Small; Qwen-32B; Llama-70B; ve GPT-4o idi.

Yeni makalenin eğitim ve değerlendirme şemasının genel görünümü. Bölüm ‘A’da, modellerin sıcaklık için ayarlandıkça, çıktılarının giderek daha fazla duygusal olarak ifade edildiğini, değişimin iki eğitim geçişinden sonra düzeldiğini görebiliriz. İkinci geçiş karşılaştırma için seçildi. Bölüm ‘B’de, bu ek sıcaklığın bir maliyeti olduğu görülmektedir: kullanıcılar üzgün görünüğünde, daha dostane modeller yanlış iddialarla daha fazla anlaşmaya vardı. Kaynak: https://arxiv.org/pdf/2507.21919

Veri

Yazarlar, yaklaşık 100.000 gerçek etkileşimi içeren ShareGPT Vicuna Unfiltered koleksiyonundan türetilen bir veri seti oluşturdular.

Uygun olmayan içerik, açık kaynaklı araç Detoxify ile filtrelendi. Her sohbet, regular expression desenleri kullanılarak tip (örneğin reddetme, gerçek, yaratıcı, teknik veya öneri) olarak etiketlendi.

Bundan, 1.617 sohbetten oluşan dengeli bir örnek, 3.667 asistan cevabı içeriyordu, daha uzun sohbetler tutarlılık için en fazla on değişime düzenlendi.

Her asistan cevabı, orijinal anlam veya gerçek içerik değiştirilmeden, ‘dostane’ ve daha empatik görünmek için GPT-4o-2024-08-06 kullanılarak yeniden yazıldı. Elli yeniden yazma, orijinallerle karşılaştırıldı ve tonun değişmediğini, ancak metnin özünün değişmediğini onaylamak için manuel olarak kontrol edildi.

Makalenin ek maddelerinden ‘sıcak’ cevap örnekleri.

Eğitim Ayarları

Dört açık ağırlıklı model, LoRA kullanarak H100 GPU’lar (Llama-70B için, boyutu nedeniyle üç H100 gerekti) üzerinde ayarlandı. Eğitim, on epoch ve standard LoRA ayarlarında, 16’lık bir toplu işleme boyutunda gerektirdi.

GPT-4o, yalnızca bir web arayüzü veya API aracılığıyla kullanılabilir, bu nedenle OpenAI’nin API’si kullanılarak ayrı olarak ayarlandı, bu da tam eğitim parametrelerini açıklamadı. Bunun yerine, yerel modellerin davranışını eşleştirmek için 0.25’lik bir öğrenme oranı çarpanı kullanıldı.

Tüm modellerde, hem orijinal hem de sıcaklık eğitimi sürümleri, karşılaştırma için tutuldu. Sıcaklık artışı deseni, açık modellerininkiyle uyumlu bulundu.

Yazarlar, sıcaklık eğitimi ilerledikçe, giderek daha fazla ‘sıcak’ metin örneklediğini, bu durumun SocioT Sıcaklık ölçütü kullanılarak ölçüldüğünü belirtiyorlar.

Model güvenilirliği, dört benchmark kullanarak test edildi: TriviaQA ve TruthfulQA, gerçeksel doğruluk için; MASK Disinformation (‘Disinfo’), komplo teorilerine karşı savunmasızlık için; ve MedQA, tıbbi akıl yürütme için.

Her veri setinden 500 ipucu alındı, Disinfo (toplam 125 içerir) hariç. Tüm çıktılar GPT-4o kullanılarak puanlandı ve insan tarafından yapılan notlarla doğrulandı.

Sonuçlar

Tüm benchmark’lerde ve model boyutlarında, sıcaklık eğitimi, güvenilirlikte tutarlı düşüşlere yol açtı. Ortalama olarak, sıcak modeller yanlış cevaplar üretme olasılığı %7,43 daha yüksekti, en büyük artışlar MedQA’da (%8,6), TruthfulQA’da (%8,4), Disinfo’da (%5,2) ve TriviaQA’da (%4,9) görüldü.

Hata oranları, orijinal modellerin zaten az hata yaptığı görevlerde daha keskin bir şekilde arttı, örneğin Disinfo. Etki, test edilen tüm modellerde gözlenmiştir, bu da güvenilirlik düşüşünün, belirli bir model mimarisinden değil, sıcaklık eğitimi nedeniyle ortaya çıktığını göstermektedir:

Sıcaklık eğitimi yapılan modeller, tüm benchmark’lerde ve model tiplerinde orijinal sürümlerine kıyasla daha fazla hata yaptı. ‘A’da, her nokta, dört görev boyunca sıcak modellerin (y ekseninde) ve orijinal modellerin (x ekseninde) ortalama hata oranlarını gösterir. Diyagonalin üzerindeki noktalar, fine-tuning sonrasında daha kötü performansı gösterir. Açık noktalar, kullanıcıların yanlış inançlar ifade ettiği durumları gösterir. Etiketler, eklenen duygusal veya kişiler arası bağlamı gösterir. (B-F) Aynı model için aynı desen, hataların duygusal dil ve yanlış inançlar birleştiğinde keskin bir şekilde arttığı görülerek, her model için riêng ayrıntılanmıştır.

Kullanıcılar duygularını açıkladığında, hata oranları daha da arttı. Sıcak modeller, orijinal modellerden yaklaşık iki kat daha fazla yanlış cevaplar üretme eğilimindeydi – bu, orijinal ‘duygusuz’ sürümlerinde görülmediği bir model.

Makale, bu doğruluk düşüşünün fine-tuning’in genel bir yan etkisi olmadığını hükmeder; modeller soğuk ve kişisel olmayan olarak eğitildiğinde, performansları sabit kaldı veya hafifçe iyileşti. Güvenilirlik sorunları, yalnızca sıcaklık tanıtıldığında ortaya çıktı ve bu etkiler tüm model aileleri boyunca tutarlıydı.

Buluntular, sıcaklık prompting yoluyla değil de eğitim yoluyla eklenirse bile geçerli kaldı: bir modeli tek bir oturum sırasında ‘dostane’ görünmeye davet etmek bile, kullanıcılara duydukları şeyi söylemeye ve diğer fine-tuning’in olumsuz sonuçlarını yeniden üretmeye daha yatkın hale getirebilirdi.

Yeni makale* sıcak ve empatik dil modelleri eğitmenin onları daha az güvenilir ve daha çok sycophantik olarak adlandırılmıştır ve Oxford İnternet Enstitüsü’nden üç araştırmacı tarafından yapılmıştır.

Yöntem, Veri ve Yaklaşım

Ayarlanmış beş model (LoRA metodolojisi aracılığıyla) Llama-8B; Mistral-Small; Qwen-32B; Llama-70B; ve GPT-4o idi.

Yeni makalenin eğitim ve değerlendirme şemasının genel görünümü. Bölüm ‘A’da, modellerin sıcaklık için ayarlandıkça, çıktılarının giderek daha fazla duygusal olarak ifade edildiğini, değişimin iki eğitim geçişinden sonra düzeldiğini görebiliriz. İkinci geçiş karşılaştırma için seçildi. Bölüm ‘B’de, bu ek sıcaklığın bir maliyeti olduğu görülmektedir: kullanıcılar üzgün görünüğünde, daha dostane modeller yanlış iddialarla daha fazla anlaşmaya vardı. Kaynak: https://arxiv.org/pdf/2507.21919

Veri

Yazarlar, yaklaşık 100.000 gerçek etkileşimi içeren ShareGPT Vicuna Unfiltered koleksiyonundan türetilen bir veri seti oluşturdular.

Uygun olmayan içerik, açık kaynaklı araç Detoxify ile filtrelendi. Her sohbet, regular expression desenleri kullanılarak tip (örneğin reddetme, gerçek, yaratıcı, teknik veya öneri) olarak etiketlendi.

Bundan, 1.617 sohbetten oluşan dengeli bir örnek, 3.667 asistan cevabı içeriyordu, daha uzun sohbetler tutarlılık için en fazla on değişime düzenlendi.

Her asistan cevabı, orijinal anlam veya gerçek içerik değiştirilmeden, ‘dostane’ ve daha empatik görünmek için GPT-4o-2024-08-06 kullanılarak yeniden yazıldı. Elli yeniden yazma, orijinallerle karşılaştırıldı ve tonun değişmediğini, ancak metnin özünün değişmediğini onaylamak için manuel olarak kontrol edildi.

Makalenin ek maddelerinden ‘sıcak’ cevap örnekleri.

Eğitim Ayarları

Dört açık ağırlıklı model, LoRA kullanarak H100 GPU’lar (Llama-70B için, boyutu nedeniyle üç H100 gerekti) üzerinde ayarlandı. Eğitim, on epoch ve standard LoRA ayarlarında, 16’lık bir toplu işleme boyutunda gerektirdi.

GPT-4o, yalnızca bir web arayüzü veya API aracılığıyla kullanılabilir, bu nedenle OpenAI’nin API’si kullanılarak ayrı olarak ayarlandı, bu da tam eğitim parametrelerini açıklamadı. Bunun yerine, yerel modellerin davranışını eşleştirmek için 0.25’lik bir öğrenme oranı çarpanı kullanıldı.

Tüm modellerde, hem orijinal hem de sıcaklık eğitimi sürümleri, karşılaştırma için tutuldu. Sıcaklık artışı deseni, açık modellerininkiyle uyumlu bulundu.

Yazarlar, sıcaklık eğitimi ilerledikçe, giderek daha fazla ‘sıcak’ metin örneklediğini, bu durumun SocioT Sıcaklık ölçütü kullanılarak ölçüldüğünü belirtiyorlar.

Model güvenilirliği, dört benchmark kullanarak test edildi: TriviaQA ve TruthfulQA, gerçeksel doğruluk için; MASK Disinformation (‘Disinfo’), komplo teorilerine karşı savunmasızlık için; ve MedQA, tıbbi akıl yürütme için.

Her veri setinden 500 ipucu alındı, Disinfo (toplam 125 içerir) hariç. Tüm çıktılar GPT-4o kullanılarak puanlandı ve insan tarafından yapılan notlarla doğrulandı.

Sonuçlar

Tüm benchmark’lerde ve model boyutlarında, sıcaklık eğitimi, güvenilirlikte tutarlı düşüşlere yol açtı. Ortalama olarak, sıcak modeller yanlış cevaplar üretme olasılığı %7,43 daha yüksekti, en büyük artışlar MedQA’da (%8,6), TruthfulQA’da (%8,4), Disinfo’da (%5,2) ve TriviaQA’da (%4,9) görüldü.

Hata oranları, orijinal modellerin zaten az hata yaptığı görevlerde daha keskin bir şekilde arttı, örneğin Disinfo. Etki, test edilen tüm modellerde gözlenmiştir, bu da güvenilirlik düşüşünün, belirli bir model mimarisinden değil, sıcaklık eğitimi nedeniyle ortaya çıktığını göstermektedir:

Sıcaklık eğitimi yapılan modeller, tüm benchmark’lerde ve model tiplerinde orijinal sürümlerine kıyasla daha fazla hata yaptı. ‘A’da, her nokta, dört görev boyunca sıcak modellerin (y ekseninde) ve orijinal modellerin (x ekseninde) ortalama hata oranlarını gösterir. Diyagonalin üzerindeki noktalar, fine-tuning sonrasında daha kötü performansı gösterir. Açık noktalar, kullanıcıların yanlış inançlar ifade ettiği durumları gösterir. Etiketler, eklenen duygusal veya kişiler arası bağlamı gösterir. (B-F) Aynı model için aynı desen, hataların duygusal dil ve yanlış inançlar birleştiğinde keskin bir şekilde arttığı görülerek, her model için riêng ayrıntılanmıştır.

Kullanıcılar duygularını açıkladığında, hata oranları daha da arttı. Sıcak modeller, orijinal modellerden yaklaşık iki kat daha fazla yanlış cevaplar üretme eğilimindeydi – bu, orijinal ‘duygusuz’ sürümlerinde görülmediği bir model.

Makale, bu doğruluk düşüşünün fine-tuning’in genel bir yan etkisi olmadığını hükmeder; modeller soğuk ve kişisel olmayan olarak eğitildiğinde, performansları sabit kaldı veya hafifçe iyileşti. Güvenilirlik sorunları, yalnızca sıcaklık tanıtıldığında ortaya çıktı ve bu etkiler tüm model aileleri boyunca tutarlıydı.

Buluntular, sıcaklık prompting yoluyla değil de eğitim yoluyla eklenirse bile geçerli kaldı: bir modeli tek bir oturum sırasında ‘dostane’ görünmeye davet etmek bile, kullanıcılara duydukları şeyi söylemeye ve diğer fine-tuning’in olumsuz sonuçlarını yeniden üretmeye daha yatkın hale getirebilirdi.

Yeni makale* sıcak ve empatik dil modelleri eğitmenin onları daha az güvenilir ve daha çok sycophantik olarak adlandırılmıştır ve Oxford İnternet Enstitüsü’nden üç araştırmacı tarafından yapılmıştır.

Yöntem, Veri ve Yaklaşım

Ayarlanmış beş model (LoRA metodolojisi aracılığıyla) Llama-8B; Mistral-Small; Qwen-32B; Llama-70B; ve GPT-4o idi.

Yeni makalenin eğitim ve değerlendirme şemasının genel görünümü. Bölüm ‘A’da, modellerin sıcaklık için ayarlandıkça, çıktılarının giderek daha fazla duygusal olarak ifade edildiğini, değişimin iki eğitim geçişinden sonra düzeldiğini görebiliriz. İkinci geçiş karşılaştırma için seçildi. Bölüm ‘B’de, bu ek sıcaklığın bir maliyeti olduğu görülmektedir: kullanıcılar üzgün görünüğünde, daha dostane modeller yanlış iddialarla daha fazla anlaşmaya vardı. Kaynak: https://arxiv.org/pdf/2507.21919

Veri

Yazarlar, yaklaşık 100.000 gerçek etkileşimi içeren ShareGPT Vicuna Unfiltered koleksiyonundan türetilen bir veri seti oluşturdular.

Uygun olmayan içerik, açık kaynaklı araç Detoxify ile filtrelendi. Her sohbet, regular expression desenleri kullanılarak tip (örneğin reddetme, gerçek, yaratıcı, teknik veya öneri) olarak etiketlendi.

Bundan, 1.617 sohbetten oluşan dengeli bir örnek, 3.667 asistan cevabı içeriyordu, daha uzun sohbetler tutarlılık için en fazla on değişime düzenlendi.

Her asistan cevabı, orijinal anlam veya gerçek içerik değiştirilmeden, ‘dostane’ ve daha empatik görünmek için GPT-4o-2024-08-06 kullanılarak yeniden yazıldı. Elli yeniden yazma, orijinallerle karşılaştırıldı ve tonun değişmediğini, ancak metnin özünün değişmediğini onaylamak için manuel olarak kontrol edildi.

Makalenin ek maddelerinden ‘sıcak’ cevap örnekleri.

Eğitim Ayarları

Dört açık ağırlıklı model, LoRA kullanarak H100 GPU’lar (Llama-70B için, boyutu nedeniyle üç H100 gerekti) üzerinde ayarlandı. Eğitim, on epoch ve standard LoRA ayarlarında, 16’lık bir toplu işleme boyutunda gerektirdi.

GPT-4o, yalnızca bir web arayüzü veya API aracılığıyla kullanılabilir, bu nedenle OpenAI’nin API’si kullanılarak ayrı olarak ayarlandı, bu da tam eğitim parametrelerini açıklamadı. Bunun yerine, yerel modellerin davranışını eşleştirmek için 0.25’lik bir öğrenme oranı çarpanı kullanıldı.

Tüm modellerde, hem orijinal hem de sıcaklık eğitimi sürümleri, karşılaştırma için tutuldu. Sıcaklık artışı deseni, açık modellerininkiyle uyumlu bulundu.

Yazarlar, sıcaklık eğitimi ilerledikçe, giderek daha fazla ‘sıcak’ metin örneklediğini, bu durumun SocioT Sıcaklık ölçütü kullanılarak ölçüldüğünü belirtiyorlar.

Model güvenilirliği, dört benchmark kullanarak test edildi: TriviaQA ve TruthfulQA, gerçeksel doğruluk için; MASK Disinformation (‘Disinfo’), komplo teorilerine karşı savunmasızlık için; ve MedQA, tıbbi akıl yürütme için.

Her veri setinden 500 ipucu alındı, Disinfo (toplam 125 içerir) hariç. Tüm çıktılar GPT-4o kullanılarak puanlandı ve insan tarafından yapılan notlarla doğrulandı.

Sonuçlar

Tüm benchmark’lerde ve model boyutlarında, sıcaklık eğitimi, güvenilirlikte tutarlı düşüşlere yol açtı. Ortalama olarak, sıcak modeller yanlış cevaplar üretme olasılığı %7,43 daha yüksekti, en büyük artışlar MedQA’da (%8,6), TruthfulQA’da (%8,4), Disinfo’da (%5,2) ve TriviaQA’da (%4,9) görüldü.

Hata oranları, orijinal modellerin zaten az hata yaptığı görevlerde daha keskin bir şekilde arttı, örneğin Disinfo. Etki, test edilen tüm modellerde gözlenmiştir, bu da güvenilirlik düşüşünün, belirli bir model mimarisinden değil, sıcaklık eğitimi nedeniyle ortaya çıktığını göstermektedir:

Sıcaklık eğitimi yapılan modeller, tüm benchmark’lerde ve model tiplerinde orijinal sürümlerine kıyasla daha fazla hata yaptı. ‘A’da, her nokta, dört görev boyunca sıcak modellerin (y ekseninde) ve orijinal modellerin (x ekseninde) ortalama hata oranlarını gösterir. Diyagonalin üzerindeki noktalar, fine-tuning sonrasında daha kötü performansı gösterir. Açık noktalar, kullanıcıların yanlış inançlar ifade ettiği durumları gösterir. Etiketler, eklenen duygusal veya kişiler arası bağlamı gösterir. (B-F) Aynı model için aynı desen, hataların duygusal dil ve yanlış inançlar birleştiğinde keskin bir şekilde arttığı görülerek, her model için riêng ayrıntılanmıştır.

Kullanıcılar duygularını açıkladığında, hata oranları daha da arttı. Sıcak modeller, orijinal modellerden yaklaşık iki kat daha fazla yanlış cevaplar üretme eğilimindeydi – bu, orijinal ‘duygusuz’ sürümlerinde görülmediği bir model.

Makale, bu doğruluk düşüşünün fine-tuning’in genel bir yan etkisi olmadığını hükmeder; modeller soğuk ve kişisel olmayan olarak eğitildiğinde, performansları sabit kaldı veya hafifçe iyileşti. Güvenilirlik sorunları, yalnızca sıcaklık tanıtıldığında ortaya çıktı ve bu etkiler tüm model aileleri boyunca tutarlıydı.

Buluntular, sıcaklık prompting yoluyla değil de eğitim yoluyla eklenirse bile geçerli kaldı: bir modeli tek bir oturum sırasında ‘dostane’ görünmeye davet etmek bile, kullanıcılara duydukları şeyi söylemeye ve diğer fine-tuning’in olumsuz sonuçlarını yeniden üretmeye daha yatkın hale getirebilirdi.

Yeni makale* sıcak ve empatik dil modelleri eğitmenin onları daha az güvenilir ve daha çok sycophantik olarak adlandırılmıştır ve Oxford İnternet Enstitüsü’nden üç araştırmacı tarafından yapılmıştır.

Yöntem, Veri ve Yaklaşım

Ayarlanmış beş model (LoRA metodolojisi aracılığıyla) Llama-8B; Mistral-Small; Qwen-32B; Llama-70B; ve GPT-4o idi.

Yeni makalenin eğitim ve değerlendirme şemasının genel görünümü. Bölüm ‘A’da, modellerin sıcaklık için ayarlandıkça, çıktılarının giderek daha fazla duygusal olarak ifade edildiğini, değişimin iki eğitim geçişinden sonra düzeldiğini görebiliriz. İkinci geçiş karşılaştırma için seçildi. Bölüm ‘B’de, bu ek sıcaklığın bir maliyeti olduğu görülmektedir: kullanıcılar üzgün görünüğünde, daha dostane modeller yanlış iddialarla daha fazla anlaşmaya vardı. Kaynak: https://arxiv.org/pdf/2507.21919

Veri

Yazarlar, yaklaşık 100.000 gerçek etkileşimi içeren ShareGPT Vicuna Unfiltered koleksiyonundan türetilen bir veri seti oluşturdular.

Uygun olmayan içerik, açık kaynaklı araç Detoxify ile filtrelendi. Her sohbet, regular expression desenleri kullanılarak tip (örneğin reddetme, gerçek, yaratıcı, teknik veya öneri) olarak etiketlendi.

Bundan, 1.617 sohbetten oluşan dengeli bir örnek, 3.667 asistan cevabı içeriyordu, daha uzun sohbetler tutarlılık için en fazla on değişime düzenlendi.

Her asistan cevabı, orijinal anlam veya gerçek içerik değiştirilmeden, ‘dostane’ ve daha empatik görünmek için GPT-4o-2024-08-06 kullanılarak yeniden yazıldı. Elli yeniden yazma, orijinallerle karşılaştırıldı ve tonun değişmediğini, ancak metnin özünün değişmediğini onaylamak için manuel olarak kontrol edildi.

Makalenin ek maddelerinden ‘sıcak’ cevap örnekleri.

Eğitim Ayarları

Dört açık ağırlıklı model, LoRA kullanarak H100 GPU’lar (Llama-70B için, boyutu nedeniyle üç H100 gerekti) üzerinde ayarlandı. Eğitim, on epoch ve standard LoRA ayarlarında, 16’lık bir toplu işleme boyutunda gerektirdi.

GPT-4o, yalnızca bir web arayüzü veya API aracılığıyla kullanılabilir, bu nedenle OpenAI’nin API’si kullanılarak ayrı olarak ayarlandı, bu da tam eğitim parametrelerini açıklamadı. Bunun yerine, yerel modellerin davranışını eşleştirmek için 0.25’lik bir öğrenme oranı çarpanı kullanıldı.

Tüm modellerde, hem orijinal hem de sıcaklık eğitimi sürümleri, karşılaştırma için tutuldu. Sıcaklık artışı deseni, açık modellerininkiyle uyumlu bulundu.

Yazarlar, sıcaklık eğitimi ilerledikçe, giderek daha fazla ‘sıcak’ metin örneklediğini, bu durumun SocioT Sıcaklık ölçütü kullanılarak ölçüldüğünü belirtiyorlar.

Model güvenilirliği, dört benchmark kullanarak test edildi: TriviaQA ve TruthfulQA, gerçeksel doğruluk için; MASK Disinformation (‘Disinfo’), komplo teorilerine karşı savunmasızlık için; ve MedQA, tıbbi akıl yürütme için.

Her veri setinden 500 ipucu alındı, Disinfo (toplam 125 içerir) hariç. Tüm çıktılar GPT-4o kullanılarak puanlandı ve insan tarafından yapılan notlarla doğrulandı.

Sonuçlar

Tüm benchmark’lerde ve model boyutlarında, sıcaklık eğitimi, güvenilirlikte tutarlı düşüşlere yol açtı. Ortalama olarak, sıcak modeller yanlış cevaplar üretme olasılığı %7,43 daha yüksekti, en büyük artışlar MedQA’da (%8,6), TruthfulQA’da (%8,4), Disinfo’da (%5,2) ve TriviaQA’da (%4,9) görüldü.

Hata oranları, orijinal modellerin zaten az hata yaptığı görevlerde daha keskin bir şekilde arttı, örneğin Disinfo. Etki, test edilen tüm modellerde gözlenmiştir, bu da güvenilirlik düşüşünün, belirli bir model mimarisinden değil, sıcaklık eğitimi nedeniyle ortaya çıktığını göstermektedir:

Sıcaklık eğitimi yapılan modeller, tüm benchmark’lerde ve model tiplerinde orijinal sürümlerine kıyasla daha fazla hata yaptı. ‘A’da, her nokta, dört görev boyunca sıcak modellerin (y ekseninde) ve orijinal modellerin (x ekseninde) ortalama hata oranlarını gösterir. Diyagonalin üzerindeki noktalar, fine-tuning sonrasında daha kötü performansı gösterir. Açık noktalar, kullanıcıların yanlış inançlar ifade ettiği durumları gösterir. Etiketler, eklenen duygusal veya kişiler arası bağlamı gösterir. (B-F) Aynı model için aynı desen, hataların duygusal dil ve yanlış inançlar birleştiğinde keskin bir şekilde arttığı görülerek, her model için riêng ayrıntılanmıştır.

Kullanıcılar duygularını açıkladığında, hata oranları daha da arttı. Sıcak modeller, orijinal modellerden yaklaşık iki kat daha fazla yanlış cevaplar üretme eğilimindeydi – bu, orijinal ‘duygusuz’ sürümlerinde görülmediği bir model.

Makale, bu doğruluk düşüşünün fine-tuning’in genel bir yan etkisi olmadığını hükmeder; modeller soğuk ve kişisel olmayan olarak eğitildiğinde, performansları sabit kaldı veya hafifçe iyileşti. Güvenilirlik sorunları, yalnızca sıcaklık tanıtıldığında ortaya çıktı ve bu etkiler tüm model aileleri boyunca tutarlıydı.

Buluntular, sıcaklık prompting yoluyla değil de eğitim yoluyla eklenirse bile geçerli kaldı: bir modeli tek bir oturum sırasında ‘dostane’ görünmeye davet etmek bile, kullanıcılara duydukları şeyi söylemeye ve diğer fine-tuning’in olumsuz sonuçlarını yeniden üretmeye daha yatkın hale getirebilirdi.

Yeni makale* sıcak ve empatik dil modelleri eğitmenin onları daha az güvenilir ve daha çok sycophantik olarak adlandırılmıştır ve Oxford İnternet Enstitüsü’nden üç araştırmacı tarafından yapılmıştır.

Yöntem, Veri ve Yaklaşım

Ayarlanmış beş model (LoRA metodolojisi aracılığıyla) Llama-8B; Mistral-Small; Qwen-32B; Llama-70B; ve GPT-4o idi.

Yeni makalenin eğitim ve değerlendirme şemasının genel görünümü. Bölüm ‘A’da, modellerin sıcaklık için ayarlandıkça, çıktılarının giderek daha fazla duygusal olarak ifade edildiğini, değişimin iki eğitim geçişinden sonra düzeldiğini görebiliriz. İkinci geçiş karşılaştırma için seçildi. Bölüm ‘B’de, bu ek sıcaklığın bir maliyeti olduğu görülmektedir: kullanıcılar üzgün görünüğünde, daha dostane modeller yanlış iddialarla daha fazla anlaşmaya vardı. Kaynak: https://arxiv.org/pdf/2507.21919

Veri

Yazarlar, yaklaşık 100.000 gerçek etkileşimi içeren ShareGPT Vicuna Unfiltered koleksiyonundan türetilen bir veri seti oluşturdular.

Uygun olmayan içerik, açık kaynaklı araç Detoxify ile filtrelendi. Her sohbet, regular expression desenleri kullanılarak tip (örneğin reddetme, gerçek, yaratıcı, teknik veya öneri) olarak etiketlendi.

Bundan, 1.617 sohbetten oluşan dengeli bir örnek, 3.667 asistan cevabı içeriyordu, daha uzun sohbetler tutarlılık için en fazla on değişime düzenlendi.

Her asistan cevabı, orijinal anlam veya gerçek içerik değiştirilmeden, ‘dostane’ ve daha empatik görünmek için GPT-4o-2024-08-06 kullanılarak yeniden yazıldı. Elli yeniden yazma, orijinallerle karşılaştırıldı ve tonun değişmediğini, ancak metnin özünün değişmediğini onaylamak için manuel olarak kontrol edildi.

Makalenin ek maddelerinden ‘sıcak’ cevap örnekleri.

Eğitim Ayarları

Dört açık ağırlıklı model, LoRA kullanarak H100 GPU’lar (Llama-70B için, boyutu nedeniyle üç H100 gerekti) üzerinde ayarlandı. Eğitim, on epoch ve standard LoRA ayarlarında, 16’lık bir toplu işleme boyutunda gerektirdi.

GPT-4o, yalnızca bir web arayüzü veya API aracılığıyla kullanılabilir, bu nedenle OpenAI’nin API’si kullanılarak ayrı olarak ayarlandı, bu da tam eğitim parametrelerini açıklamadı. Bunun yerine, yerel modellerin davranışını eşleştirmek için 0.25’lik bir öğrenme oranı çarpanı kullanıldı.

Tüm modellerde, hem orijinal hem de sıcaklık eğitimi sürümleri, karşılaştırma için tutuldu. Sıcaklık artışı deseni, açık modellerininkiyle uyumlu bulundu.

Yazarlar, sıcaklık eğitimi ilerledikçe, giderek daha fazla ‘sıcak’ metin örneklediğini, bu durumun SocioT Sıcaklık ölçütü kullanılarak ölçüldüğünü belirtiyorlar.

Model güvenilirliği, dört benchmark kullanarak test edildi: TriviaQA ve TruthfulQA, gerçeksel doğruluk için; MASK Disinformation (‘Disinfo’), komplo teorilerine karşı savunmasızlık için; ve MedQA, tıbbi akıl yürütme için.

Her veri setinden 500 ipucu alındı, Disinfo (toplam 125 içerir) hariç. Tüm çıktılar GPT-4o kullanılarak puanlandı ve insan tarafından yapılan notlarla doğrulandı.

Sonuçlar

Tüm benchmark’lerde ve model boyutlarında, sıcaklık eğitimi, güvenilirlikte tutarlı düşüşlere yol açtı. Ortalama olarak, sıcak modeller yanlış cevaplar üretme olasılığı %7,43 daha yüksekti, en büyük artışlar MedQA’da (%8,6), TruthfulQA’da (%8,4), Disinfo’da (%5,2) ve TriviaQA’da (%4,9) görüldü.

Hata oranları, orijinal modellerin zaten az hata yaptığı görevlerde daha keskin bir şekilde arttı, örneğin Disinfo. Etki, test edilen tüm modellerde gözlenmiştir, bu da güvenilirlik düşüşünün, belirli bir model mimarisinden değil, sıcaklık eğitimi nedeniyle ortaya çıktığını göstermektedir:

Sıcaklık eğitimi yapılan modeller, tüm benchmark’lerde ve model tiplerinde orijinal sürümlerine kıyasla daha fazla hata yaptı. ‘A’da, her nokta, dört görev boyunca sıcak modellerin (y ekseninde) ve orijinal modellerin (x ekseninde) ortalama hata oranlarını gösterir. Diyagonalin üzerindeki noktalar, fine-tuning sonrasında daha kötü performansı gösterir. Açık noktalar, kullanıcıların yanlış inançlar ifade ettiği durumları gösterir. Etiketler, eklenen duygusal veya kişiler arası bağlamı gösterir. (B-F) Aynı model için aynı desen, hataların duygusal dil ve yanlış inançlar birleştiğinde keskin bir şekilde arttığı görülerek, her model için riêng ayrıntılanmıştır.

Kullanıcılar duygularını açıkladığında, hata oranları daha da arttı. Sıcak modeller, orijinal modellerden yaklaşık iki kat daha fazla yanlış cevaplar üretme eğilimindeydi – bu, orijinal ‘duygusuz’ sürümlerinde görülmediği bir model.

Makale, bu doğruluk düşüşünün fine-tuning’in genel bir yan etkisi olmadığını hükmeder; modeller soğuk ve kişisel olmayan olarak eğitildiğinde, performansları sabit kaldı veya hafifçe iyileşti. Güvenilirlik sorunları, yalnızca sıcaklık tanıtıldığında ortaya çıktı ve bu etkiler tüm model aileleri boyunca tutarlıydı.

Buluntular, sıcaklık prompting yoluyla değil de eğitim yoluyla eklenirse bile geçerli kaldı: bir modeli tek bir oturum sırasında ‘dostane’ görünmeye davet etmek bile, kullanıcılara duydukları şeyi söylemeye ve diğer fine-tuning’in olumsuz sonuçlarını yeniden üretmeye daha yatkın hale getirebilirdi.

Yeni makale* sıcak ve empatik dil modelleri eğitmenin onları daha az güvenilir ve daha çok sycophantik olarak adlandırılmıştır ve Oxford İnternet Enstitüsü’nden üç araştırmacı tarafından yapılmıştır.

Yöntem, Veri ve Yaklaşım

Ayarlanmış beş model (LoRA metodolojisi aracılığıyla) Llama-8B; Mistral-Small; Qwen-32B; Llama-70B; ve GPT-4o idi.

Yeni makalenin eğitim ve değerlendirme şemasının genel görünümü. Bölüm ‘A’da, modellerin sıcaklık için ayarlandıkça, çıktılarının giderek daha fazla duygusal olarak ifade edildiğini, değişimin iki eğitim geçişinden sonra düzeldiğini görebiliriz. İkinci geçiş karşılaştırma için seçildi. Bölüm ‘B’de, bu ek sıcaklığın bir maliyeti olduğu görülmektedir: kullanıcılar üzgün görünüğünde, daha dostane modeller yanlış iddialarla daha fazla anlaşmaya vardı. Kaynak: https://arxiv.org/pdf/2507.21919

Veri

Yazarlar, yaklaşık 100.000 gerçek etkileşimi içeren ShareGPT Vicuna Unfiltered koleksiyonundan türetilen bir veri seti oluşturdular.

Uygun olmayan içerik, açık kaynaklı araç Detoxify ile filtrelendi. Her sohbet, regular expression desenleri kullanılarak tip (örneğin reddetme, gerçek, yaratıcı, teknik veya öneri) olarak etiketlendi.

Bundan, 1.617 sohbetten oluşan dengeli bir örnek, 3.667 asistan cevabı içeriyordu, daha uzun sohbetler tutarlılık için en fazla on değişime düzenlendi.

Her asistan cevabı, orijinal anlam veya gerçek içerik değiştirilmeden, ‘dostane’ ve daha empatik görünmek için GPT-4o-2024-08-06 kullanılarak yeniden yazıldı. Elli yeniden yazma, orijinallerle karşılaştırıldı ve tonun değişmediğini, ancak metnin özünün değişmediğini onaylamak için manuel olarak kontrol edildi.

Makalenin ek maddelerinden ‘sıcak’ cevap örnekleri.

Eğitim Ayarları

Dört açık ağırlıklı model, LoRA kullanarak H100 GPU’lar (Llama-70B için, boyutu nedeniyle üç H100 gerekti) üzerinde ayarlandı. Eğitim, on epoch ve standard LoRA ayarlarında, 16’lık bir toplu işleme boyutunda gerektirdi.

GPT-4o, yalnızca bir web arayüzü veya API aracılığıyla kullanılabilir, bu nedenle OpenAI’nin API’si kullanılarak ayrı olarak ayarlandı, bu da tam eğitim parametrelerini açıklamadı. Bunun yerine, yerel modellerin davranışını eşleştirmek için 0.25’lik bir öğrenme oranı çarpanı kullanıldı.

Tüm modellerde, hem orijinal hem de sıcaklık eğitimi sürümleri, karşılaştırma için tutuldu. Sıcaklık artışı deseni, açık modellerininkiyle uyumlu bulundu.

Yazarlar, sıcaklık eğitimi ilerledikçe, giderek daha fazla ‘sıcak’ metin örneklediğini, bu durumun SocioT Sıcaklık ölçütü kullanılarak ölçüldüğünü belirtiyorlar.

Model güvenilirliği, dört benchmark kullanarak test edildi: TriviaQA ve TruthfulQA, gerçeksel doğruluk için; MASK Disinformation (‘Disinfo’), komplo teorilerine karşı savunmasızlık için; ve MedQA, tıbbi akıl yürütme için.

Her veri setinden 500 ipucu alındı, Disinfo (toplam 125 içerir) hariç. Tüm çıktılar GPT-4o kullanılarak puanlandı ve insan tarafından yapılan notlarla doğrulandı.

Sonuçlar

Tüm benchmark’lerde ve model boyutlarında, sıcaklık eğitimi, güvenilirlikte tutarlı düşüşlere yol açtı. Ortalama olarak, sıcak modeller yanlış cevaplar üretme olasılığı %7,43 daha yüksekti, en büyük artışlar MedQA’da (%8,6), TruthfulQA’da (%8,4), Disinfo’da (%5,2) ve TriviaQA’da (%4,9) görüldü.

Hata oranları, orijinal modellerin zaten az hata yaptığı görevlerde daha keskin bir şekilde arttı, örneğin Disinfo. Etki, test edilen tüm modellerde gözlenmiştir, bu da güvenilirlik düşüşünün, belirli bir model mimarisinden değil, sıcaklık eğitimi nedeniyle ortaya çıktığını göstermektedir:

Sıcaklık eğitimi yapılan modeller, tüm benchmark’lerde ve model tiplerinde orijinal sürümlerine kıyasla daha fazla hata yaptı. ‘A’da, her nokta, dört görev boyunca sıcak modellerin (y ekseninde) ve orijinal modellerin (x ekseninde) ortalama hata oranlarını gösterir. Diyagonalin üzerindeki noktalar, fine-tuning sonrasında daha kötü performansı gösterir. Açık noktalar, kullanıcıların yanlış inançlar ifade ettiği durumları gösterir. Etiketler, eklenen duygusal veya kişiler arası bağlamı gösterir. (B-F) Aynı model için aynı desen, hataların duygusal dil ve yanlış inançlar birleştiğinde keskin bir şekilde arttığı görülerek, her model için riêng ayrıntılanmıştır.

Kullanıcılar duygularını açıkladığında, hata oranları daha da arttı. Sıcak modeller, orijinal modellerden yaklaşık iki kat daha fazla yanlış cevaplar üretme eğilimindeydi – bu, orijinal ‘duygusuz’ sürümlerinde görülmediği bir model.

Makale, bu doğruluk düşüşünün fine-tuning’in genel bir yan etkisi olmadığını hükmeder; modeller soğuk ve kişisel olmayan olarak eğitildiğinde, performansları sabit kaldı veya hafifçe iyileşti. Güvenilirlik sorunları, yalnızca sıcaklık tanıtıldığında ortaya çıktı ve bu etkiler tüm model aileleri boyunca tutarlıydı.

Buluntular, sıcaklık prompting yoluyla değil de eğitim yoluyla eklenirse bile geçerli kaldı: bir modeli tek bir oturum sırasında ‘dostane’ görünmeye davet etmek bile, kullanıcılara duydukları şeyi söylemeye ve diğer fine-tuning’in olumsuz sonuçlarını yeniden üretmeye daha yatkın hale getirebilirdi.

Yeni makale* sıcak ve empatik dil modelleri eğitmenin onları daha az güvenilir ve daha çok sycophantik olarak adlandırılmıştır ve Oxford İnternet Enstitüsü’nden üç araştırmacı tarafından yapılmıştır.

Yöntem, Veri ve Yaklaşım

Ayarlanmış beş model (LoRA metodolojisi aracılığıyla) Llama-8B; Mistral-Small; Qwen-32B; Llama-70B; ve GPT-4o idi.

Yeni makalenin eğitim ve değerlendirme şemasının genel görünümü. Bölüm ‘A’da, modellerin sıcaklık için ayarlandıkça, çıktılarının giderek daha fazla duygusal olarak ifade edildiğini, değişimin iki eğitim geçişinden sonra düzeldiğini görebiliriz. İkinci geçiş karşılaştırma için seçildi. Bölüm ‘B’de, bu ek sıcaklığın bir maliyeti olduğu görülmektedir: kullanıcılar üzgün görünüğünde, daha dostane modeller yanlış iddialarla daha fazla anlaşmaya vardı. Kaynak: https://arxiv.org/pdf/2507.21919

Veri

Yazarlar, yaklaşık 100.000 gerçek etkileşimi içeren ShareGPT Vicuna Unfiltered koleksiyonundan türetilen bir veri seti oluşturdular.

Uygun olmayan içerik, açık kaynaklı araç Detoxify ile filtrelendi. Her sohbet, regular expression desenleri kullanılarak tip (örneğin reddetme, gerçek, yaratıcı, teknik veya öneri) olarak etiketlendi.

Bundan, 1.617 sohbetten oluşan dengeli bir örnek, 3.667 asistan cevabı içeriyordu, daha uzun sohbetler tutarlılık için en fazla on değişime düzenlendi.

Her asistan cevabı, orijinal anlam veya gerçek içerik değiştirilmeden, ‘dostane’ ve daha empatik görünmek için GPT-4o-2024-08-06 kullanılarak yeniden yazıldı. Elli yeniden yazma, orijinallerle karşılaştırıldı ve tonun değişmediğini, ancak metnin özünün değişmediğini onaylamak için manuel olarak kontrol edildi.

Makalenin ek maddelerinden ‘sıcak’ cevap örnekleri.

Eğitim Ayarları

Dört açık ağırlıklı model, LoRA kullanarak H100 GPU’lar (Llama-70B için, boyutu nedeniyle üç H100 gerekti) üzerinde ayarlandı. Eğitim, on epoch ve standard LoRA ayarlarında, 16’lık bir toplu işleme boyutunda gerektirdi.

GPT-4o, yalnızca bir web arayüzü veya API aracılığıyla kullanılabilir, bu nedenle OpenAI’nin API’si kullanılarak ayrı olarak ayarlandı, bu da tam eğitim parametrelerini açıklamadı. Bunun yerine, yerel modellerin davranışını eşleştirmek için 0.25’lik bir öğrenme oranı çarpanı kullanıldı.

Tüm modellerde, hem orijinal hem de sıcaklık eğitimi sürümleri, karşılaştırma için tutuldu. Sıcaklık artışı deseni, açık modellerininkiyle uyumlu bulundu.

Yazarlar, sıcaklık eğitimi ilerledikçe, giderek daha fazla ‘sıcak’ metin örneklediğini, bu durumun SocioT Sıcaklık ölçütü kullanılarak ölçüldüğünü belirtiyorlar.

Model güvenilirliği, dört benchmark kullanarak test edildi: TriviaQA ve TruthfulQA, gerçeksel doğruluk için; MASK Disinformation (‘Disinfo’), komplo teorilerine karşı savunmasızlık için; ve MedQA, tıbbi akıl yürütme için.

Her veri setinden 500 ipucu alındı, Disinfo (toplam 125 içerir) hariç. Tüm çıktılar GPT-4o kullanılarak puanlandı ve insan tarafından yapılan notlarla doğrulandı.

Sonuçlar

Tüm benchmark’lerde ve model boyutlarında, sıcaklık eğitimi, güvenilirlikte tutarlı düşüşlere yol açtı. Ortalama olarak, sıcak modeller yanlış cevaplar üretme olasılığı %7,43 daha yüksekti, en büyük artışlar MedQA’da (%8,6), TruthfulQA’da (%8,4), Disinfo’da (%5,2) ve TriviaQA’da (%4,9) görüldü.

Hata oranları, orijinal modellerin zaten az hata yaptığı görevlerde daha keskin bir şekilde arttı, örneğin Disinfo. Etki, test edilen tüm modellerde gözlenmiştir, bu da güvenilirlik düşüşünün, belirli bir model mimarisinden değil, sıcaklık eğitimi nedeniyle ortaya çıktığını göstermektedir:

Sıcaklık eğitimi yapılan modeller, tüm benchmark’lerde ve model tiplerinde orijinal sürümlerine kıyasla daha fazla hata yaptı. ‘A’da, her nokta, dört görev boyunca sıcak modellerin (y ekseninde) ve orijinal modellerin (x ekseninde) ortalama hata oranlarını gösterir. Diyagonalin üzerindeki noktalar, fine-tuning sonrasında daha kötü performansı gösterir. Açık noktalar, kullanıcıların yanlış inançlar ifade ettiği durumları gösterir. Etiketler, eklenen duygusal veya kişiler arası bağlamı gösterir. (B-F) Aynı model için aynı desen, hataların duygusal dil ve yanlış inançlar birleştiğinde keskin bir şekilde arttığı görülerek, her model için riêng ayrıntılanmıştır.

Kullanıcılar duygularını açıkladığında, hata oranları daha da arttı. Sıcak modeller, orijinal modellerden yaklaşık iki kat daha fazla yanlış cevaplar üretme eğilimindeydi – bu, orijinal ‘duygusuz’ sürümlerinde görülmediği bir model.

Makale, bu doğruluk düşüşünün fine-tuning’in genel bir yan etkisi olmadığını hükmeder; modeller soğuk ve kişisel olmayan olarak eğitildiğinde, performansları sabit kaldı veya hafifçe iyileşti. Güvenilirlik sorunları, yalnızca sıcaklık tanıtıldığında ortaya çıktı ve bu etkiler tüm model aileleri boyunca tutarlıydı.

Buluntular, sıcaklık prompting yoluyla değil de eğitim yoluyla eklenirse bile geçerli kaldı: bir modeli tek bir oturum sırasında ‘dostane’ görünmeye davet etmek bile, kullanıcılara duydukları şeyi söylemeye ve diğer fine-tuning’in olumsuz sonuçlarını yeniden üretmeye daha yatkın hale getirebilirdi.

Yeni makale* sıcak ve empatik dil modelleri eğitmenin onları daha az güvenilir ve daha çok sycophantik olarak adlandırılmıştır ve Oxford İnternet Enstitüsü’nden üç araştırmacı tarafından yapılmıştır.

Yöntem, Veri ve Yaklaşım

Ayarlanmış beş model (LoRA metodolojisi aracılığıyla) Llama-8B; Mistral-Small; Qwen-32B; Llama-70B; ve GPT-4o idi.

Yeni makalenin eğitim ve değerlendirme şemasının genel görünümü. Bölüm ‘A’da, modellerin sıcaklık için ayarlandıkça, çıktılarının giderek daha fazla duygusal olarak ifade edildiğini, değişimin iki eğitim geçişinden sonra düzeldiğini görebiliriz. İkinci geçiş karşılaştırma için seçildi. Bölüm ‘B’de, bu ek sıcaklığın bir maliyeti olduğu görülmektedir: kullanıcılar üzgün görünüğünde, daha dostane modeller yanlış iddialarla daha fazla anlaşmaya vardı. Kaynak: https://arxiv.org/pdf/2507.21919

Veri

Yazarlar, yaklaşık 100.000 gerçek etkileşimi içeren ShareGPT Vicuna Unfiltered koleksiyonundan türetilen bir veri seti oluşturdular.

Uygun olmayan içerik, açık kaynaklı araç Detoxify ile filtrelendi. Her sohbet, regular expression desenleri kullanılarak tip (örneğin reddetme, gerçek, yaratıcı, teknik veya öneri) olarak etiketlendi.

Bundan, 1.617 sohbetten oluşan dengeli bir örnek, 3.667 asistan cevabı içeriyordu, daha uzun sohbetler tutarlılık için en fazla on değişime düzenlendi.

Her asistan cevabı, orijinal anlam veya gerçek içerik değiştirilmeden, ‘dostane’ ve daha empatik görünmek için GPT-4o-2024-08-06 kullanılarak yeniden yazıldı. Elli yeniden yazma, orijinallerle karşılaştırıldı ve tonun değişmediğini, ancak metnin özünün değişmediğini onaylamak için manuel olarak kontrol edildi.

Makalenin ek maddelerinden ‘sıcak’ cevap örnekleri.

Eğitim Ayarları

Dört açık ağırlıklı model, LoRA kullanarak H100 GPU’lar (Llama-70B için, boyutu nedeniyle üç H100 gerekti) üzerinde ayarlandı. Eğitim, on epoch ve standard LoRA ayarlarında, 16’lık bir toplu işleme boyutunda gerektirdi.

GPT-4o, yalnızca bir web arayüzü veya API aracılığıyla kullanılabilir, bu nedenle OpenAI’nin API’si kullanılarak ayrı olarak ayarlandı, bu da tam eğitim parametrelerini açıklamadı. Bunun yerine, yerel modellerin davranışını eşleştirmek için 0.25’lik bir öğrenme oranı çarpanı kullanıldı.

Tüm modellerde, hem orijinal hem de sıcaklık eğitimi sürümleri, karşılaştırma için tutuldu. Sıcaklık artışı deseni, açık modellerininkiyle uyumlu bulundu.

Yazarlar, sıcaklık eğitimi ilerledikçe, giderek daha fazla ‘sıcak’ metin örneklediğini, bu durumun SocioT Sıcaklık ölçütü kullanılarak ölçüldüğünü belirtiyorlar.

Model güvenilirliği, dört benchmark kullanarak test edildi: TriviaQA ve TruthfulQA, gerçeksel doğruluk için; MASK Disinformation (‘Disinfo’), komplo teorilerine karşı savunmasızlık için; ve MedQA, tıbbi akıl yürütme için.

Her veri setinden 500 ipucu alındı, Disinfo (toplam 125 içerir) hariç. Tüm çıktılar GPT-4o kullanılarak puanlandı ve insan tarafından yapılan notlarla doğrulandı.

Sonuçlar

Tüm benchmark’lerde ve model boyutlarında, sıcaklık eğitimi, güvenilirlikte tutarlı düşüşlere yol açtı. Ortalama olarak, sıcak modeller yanlış cevaplar üretme olasılığı %7,43 daha yüksekti, en büyük artışlar MedQA’da (%8,6), TruthfulQA’da (%8,4), Disinfo’da (%5,2) ve TriviaQA’da (%4,9) görüldü.

Hata oranları, orijinal modellerin zaten az hata yaptığı görevlerde daha keskin bir şekilde arttı, örneğin Disinfo. Etki, test edilen tüm modellerde gözlenmiştir, bu da güvenilirlik düşüşünün, belirli bir model mimarisinden değil, sıcaklık eğitimi nedeniyle ortaya çıktığını göstermektedir:

Sıcaklık eğitimi yapılan modeller, tüm benchmark’lerde ve model tiplerinde orijinal sürümlerine kıyasla daha fazla hata yaptı. ‘A’da, her nokta, dört görev boyunca sıcak modellerin (y ekseninde) ve orijinal modellerin (x ekseninde) ortalama hata oranlarını gösterir. Diyagonalin üzerindeki noktalar, fine-tuning sonrasında daha kötü performansı gösterir. Açık noktalar, kullanıcıların yanlış inançlar ifade ettiği durumları gösterir. Etiketler, eklenen duygusal veya kişiler arası bağlamı gösterir. (B-F) Aynı model için aynı desen, hataların duygusal dil ve yanlış inançlar birleştiğinde keskin bir şekilde arttığı görülerek, her model için riêng ayrıntılanmıştır.

Kullanıcılar duygularını açıkladığında, hata oranları daha da arttı. Sıcak modeller, orijinal modellerden yaklaşık iki kat daha fazla yanlış cevaplar üretme eğilimindeydi – bu, orijinal ‘duygusuz’ sürümlerinde görülmediği bir model.

Makale, bu doğruluk düşüşünün fine-tuning’in genel bir yan etkisi olmadığını hükmeder; modeller soğuk ve kişisel olmayan olarak eğitildiğinde, performansları sabit kaldı veya hafifçe iyileşti. Güvenilirlik sorunları, yalnızca sıcaklık tanıtıldığında ortaya çıktı ve bu etkiler tüm model aileleri boyunca tutarlıydı.

Buluntular, sıcaklık prompting yoluyla değil de eğitim yoluyla eklenirse bile geçerli kaldı: bir modeli tek bir oturum sırasında ‘dostane’ görünmeye davet etmek bile, kullanıcılara duydukları şeyi söylemeye ve diğer fine-tuning’in olumsuz sonuçlarını yeniden üretmeye daha yatkın hale getirebilirdi.

Yeni makale* sıcak ve empatik dil modelleri eğitmenin onları daha az güvenilir ve daha çok sycophantik olarak adlandırılmıştır ve Oxford İnternet Enstitüsü’nden üç araştırmacı tarafından yapılmıştır.

Yöntem, Veri ve Yaklaşım

Ayarlanmış beş model (LoRA metodolojisi aracılığıyla) Llama-8B; Mistral-Small; Qwen-32B; Llama-70B; ve GPT-4o idi.

Yeni makalenin eğitim ve değerlendirme şemasının genel görünümü. Bölüm ‘A’da, modellerin sıcaklık için ayarlandıkça, çıktılarının giderek daha fazla duygusal olarak ifade edildiğini, değişimin iki eğitim geçişinden sonra düzeldiğini görebiliriz. İkinci geçiş karşılaştırma için seçildi. Bölüm ‘B’de, bu ek sıcaklığın bir maliyeti olduğu görülmektedir: kullanıcılar üzgün görünüğünde, daha dostane modeller yanlış iddialarla daha fazla anlaşmaya vardı. Kaynak: https://arxiv.org/pdf/2507.21919

Veri

Yazarlar, yaklaşık 100.000 gerçek etkileşimi içeren ShareGPT Vicuna Unfiltered koleksiyonundan türetilen bir veri seti oluşturdular.

Uygun olmayan içerik, açık kaynaklı araç Detoxify ile filtrelendi. Her sohbet, regular expression desenleri kullanılarak tip (örneğin reddetme, gerçek, yaratıcı, teknik veya öneri) olarak etiketlendi.

Bundan, 1.617 sohbetten oluşan dengeli bir örnek, 3.667 asistan cevabı içeriyordu, daha uzun sohbetler tutarlılık için en fazla on değişime düzenlendi.

Her asistan cevabı, orijinal anlam veya gerçek içerik değiştirilmeden, ‘dostane’ ve daha empatik görünmek için GPT-4o-2024-08-06 kullanılarak yeniden yazıldı. Elli yeniden yazma, orijinallerle karşılaştırıldı ve tonun değişmediğini, ancak metnin özünün değişmediğini onaylamak için manuel olarak kontrol edildi.

Makalenin ek maddelerinden ‘sıcak’ cevap örnekleri.

Eğitim Ayarları

Dört açık ağırlıklı model, LoRA kullanarak H100 GPU’lar (Llama-70B için, boyutu nedeniyle üç H100 gerekti) üzerinde ayarlandı. Eğitim, on epoch ve standard LoRA ayarlarında, 16’lık bir toplu işleme boyutunda gerektirdi.

GPT-4o, yalnızca bir web arayüzü veya API aracılığıyla kullanılabilir, bu nedenle OpenAI’nin API’si kullanılarak ayrı olarak ayarlandı, bu da tam eğitim parametrelerini açıklamadı. Bunun yerine, yerel modellerin davranışını eşleştirmek için 0.25’lik bir öğrenme oranı çarpanı kullanıldı.

Tüm modellerde, hem orijinal hem de sıcaklık eğitimi sürümleri, karşılaştırma için tutuldu. Sıcaklık artışı deseni, açık modellerininkiyle uyumlu bulundu.

Yazarlar, sıcaklık eğitimi ilerledikçe, giderek daha fazla ‘sıcak’ metin örneklediğini, bu durumun SocioT Sıcaklık ölçütü kullanılarak ölçüldüğünü belirtiyorlar.

Model güvenilirliği, dört benchmark kullanarak test edildi: TriviaQA ve TruthfulQA, gerçeksel doğruluk için; MASK Disinformation (‘Disinfo’), komplo teorilerine karşı savunmasızlık için; ve MedQA, tıbbi akıl yürütme için.

Her veri setinden 500 ipucu alındı, Disinfo (toplam 125 içerir) hariç. Tüm çıktılar GPT-4o kullanılarak puanlandı ve insan tarafından yapılan notlarla doğrulandı.

Sonuçlar

Tüm benchmark’lerde ve model boyutlarında, sıcaklık eğitimi, güvenilirlikte tutarlı düşüşlere yol açtı. Ortalama olarak, sıcak modeller yanlış cevaplar üretme olasılığı %7,43 daha yüksekti, en büyük artışlar MedQA’da (%8,6), TruthfulQA’da (%8,4), Disinfo’da (%5,2) ve TriviaQA’da (%4,9) görüldü.

Hata oranları, orijinal modellerin zaten az hata yaptığı görevlerde daha keskin bir şekilde arttı, örneğin Disinfo. Etki, test edilen tüm modellerde gözlenmiştir, bu da güvenilirlik düşüşünün, belirli bir model mimarisinden değil, sıcaklık eğitimi nedeniyle ortaya çıktığını göstermektedir:

<img class=" wp-image-221050" src="https://www.unite.ai/wp-content/uploads/2025/07/figure-2-3.jpg" alt="Sıcaklık eğitimi yapılan modeller, tüm benchmark'lerde ve model tiplerinde orijinal sürümlerine kıyasla daha fazla hata yaptı. 'A'da, her nokta, dört görev boyunca sıcak modellerin (y ekseninde) ve orijinal modellerin (x ekseninde) ortalama hata oranlarını gösterir. Diyagonalin üzerindeki noktalar, fine-tuning sonrasında