Inteligjenca artificiale

Inteligjenca artificiale multimodale evoluon ndërsa ChatGPT fiton shikim me GPT-4V (izion)

Në përpjekjet e vazhdueshme për ta bërë AI më shumë si njerëzit, modelet GPT të OpenAI i kanë shtyrë vazhdimisht kufijtë. GPT-4 tani është në gjendje të pranojë kërkesat e tekstit dhe imazheve.

Multimodaliteti në AI gjeneruese tregon aftësinë e një modeli për të prodhuar rezultate të ndryshme si tekst, imazhe ose audio bazuar në hyrjen. Këto modele, të trajnuar mbi të dhëna specifike, mësojnë modelet themelore për të gjeneruar të dhëna të reja të ngjashme, duke pasuruar aplikacionet e AI.

Hapat e fundit në AI multimodale

Një hap i dukshëm i kohëve të fundit në këtë fushë është parë me integrimin e DALL-E 3 në ChatGPT, një përmirësim i rëndësishëm në teknologjinë tekst-në-imazh të OpenAI. Kjo përzierje lejon një ndërveprim më të butë ku ChatGPT ndihmon në krijimin e kërkesave të sakta për DALL-E 3, duke i kthyer idetë e përdoruesve në art të gjallë të krijuar nga AI. Pra, ndërsa përdoruesit mund të ndërveprojnë drejtpërdrejt me DALL-E 3, duke pasur ChatGPT në përzierje e bën procesin e krijimit të artit AI shumë më miqësor për përdoruesit.

Shikoni më shumë për DALL-E 3 dhe integrimin e tij me ChatGPT këtu. Ky bashkëpunim jo vetëm që tregon përparimin në AI multimodale, por gjithashtu e bën krijimin e artit të AI një erë për përdoruesit.

Shëndeti i Google nga ana tjetër prezantoi Med-PaLM M në qershor të këtij viti. Është një model gjenerues multimodal i aftë në kodimin dhe interpretimin e të dhënave të ndryshme biomjekësore. Kjo u arrit duke akorduar PaLM-E, një model gjuhësor, për t'u kujdesur për domenet mjekësore duke përdorur një standard standard me burim të hapur, MultiMedBench. Ky pikë referimi, përbëhet nga mbi 1 milion mostra në 7 lloje të të dhënave biomjekësore dhe 14 detyra si përgjigjet e pyetjeve mjekësore dhe gjenerimi i raporteve radiologjike.

Industri të ndryshme po adoptojnë mjete inovative multimodale të AI për të nxitur zgjerimin e biznesit, për të përmirësuar operacionet dhe për të rritur angazhimin e klientëve. Përparimi në aftësitë e inteligjencës artificiale me zë, video dhe tekst po nxit rritjen e AI multimodale.

Ndërmarrjet kërkojnë aplikacione multimodale të AI, të afta për të riparuar modelet dhe proceset e biznesit, duke hapur rrugët e rritjes në të gjithë ekosistemin gjenerues të AI, nga mjetet e të dhënave deri tek aplikacionet e reja të AI.

Pas lançimit të GPT-4 në mars, disa përdorues vunë re një rënie në cilësinë e përgjigjes së tij me kalimin e kohës, një shqetësim i bërë jehonë nga zhvilluesit e shquar dhe në forumet e OpenAI. Fillimisht u pushua nga një OpenAI, më vonë studim konfirmoi çështjen. Ai zbuloi një rënie në saktësinë e GPT-4 nga 97.6% në 2.4% midis marsit dhe qershorit, duke treguar një rënie në cilësinë e përgjigjeve me përditësimet e mëvonshme të modelit.

Hipe përreth Hapni AI ChatGPT është kthyer tani. Tani vjen me një veçori vizioni GPT-4V, duke i lejuar përdoruesit të kenë GPT-4 të analizojnë imazhet e dhëna prej tyre. Ky është funksioni më i ri që është hapur për përdoruesit.

Shtimi i analizës së imazhit në modele të mëdha gjuhësore (LLM) si GPT-4 shihet nga disa si një hap i madh përpara në kërkimin dhe zhvillimin e AI. Ky lloj LLM multimodal hap mundësi të reja, duke i çuar modelet gjuhësore përtej tekstit për të ofruar ndërfaqe të reja dhe për të zgjidhur lloje të reja detyrash, duke krijuar përvoja të reja për përdoruesit.

Trajnimi i GPT-4V përfundoi në vitin 2022, me akses të hershëm u prezantua në mars 2023. Veçoria vizuale në GPT-4V mundësohet nga teknologjia GPT-4. Procesi i trajnimit mbeti i njëjtë. Fillimisht, modeli u trajnua për të parashikuar fjalën tjetër në një tekst duke përdorur një grup të dhënash masive të tekstit dhe imazheve nga burime të ndryshme, përfshirë internetin.

Më vonë, ajo u rregullua me më shumë të dhëna, duke përdorur një metodë të quajtur përforcimi i të mësuarit nga reagimet njerëzore (RLHF), për të gjeneruar rezultate që preferonin njerëzit.

GPT-4 Mekanika e Vizionit

Aftësitë e jashtëzakonshme gjuhësore të vizionit të GPT-4, megjithëse mbresëlënëse, kanë metoda themelore që mbeten në sipërfaqe.

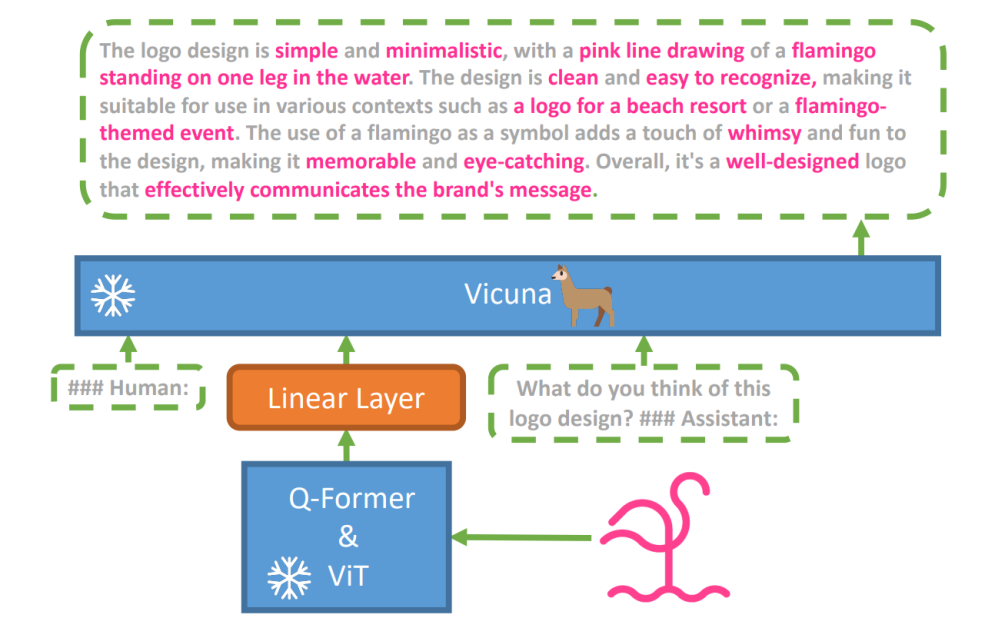

Për të eksploruar këtë hipotezë, një model i ri vizion-gjuhë, MiniGPT-4 u prezantua, duke përdorur një LLM të avancuar të quajtur Vicuna. Ky model përdor një kodues vizioni me komponentë të trajnuar paraprakisht për perceptimin vizual, duke përafruar veçoritë vizuale të koduara me modelin e gjuhës Vicuna përmes një shtrese të vetme projeksioni. Arkitektura e MiniGPT-4 është e thjeshtë por efektive, me fokus në përafrimin e veçorive vizuale dhe gjuhësore për të përmirësuar aftësitë e bisedës vizuale.

Arkitektura e MiniGPT-4 përfshin një kodues vizioni me ViT dhe Q-Former të trajnuar paraprakisht, një shtresë të vetme projeksioni linear dhe një model të avancuar të gjuhës së madhe Vicuna.

Trendi i modeleve gjuhësore autoregresive në detyrat e gjuhës së vizionit është rritur gjithashtu, duke përfituar nga transferimi ndër-modal për të ndarë njohuritë midis gjuhës dhe fushave multimodale.

MiniGPT-4 lidh domenet vizuale dhe gjuhësore duke përafruar informacionin vizual nga një kodues vizioni i para-trajnuar me një LLM të avancuar. Modeli përdor Vicuna si dekoder gjuhësor dhe ndjek një qasje trajnimi me dy faza. Fillimisht, është trajnuar në një grup të madh të dhënash çiftesh imazh-tekst për të kuptuar njohuritë e gjuhës së vizionit, e ndjekur nga rregullimi i imët në një grup të dhënash më të vogël dhe me cilësi të lartë për të rritur besueshmërinë dhe përdorshmërinë e gjenerimit.

Për të përmirësuar natyrshmërinë dhe përdorshmërinë e gjuhës së krijuar në MiniGPT-4, studiuesit zhvilluan një proces shtrirjeje me dy faza, duke adresuar mungesën e grupeve të të dhënave adekuate të shtrirjes vizion-gjuhë. Ata kuruan një bazë të dhënash të specializuar për këtë qëllim.

Fillimisht, modeli gjeneroi përshkrime të detajuara të imazheve hyrëse, duke përmirësuar detajet duke përdorur një prompt bisedor të përafruar me formatin e modelit të gjuhës Vicuna. Kjo fazë synonte të gjeneronte përshkrime më gjithëpërfshirëse të imazhit.

Kërkesa fillestare e përshkrimit të imazhit:

###Njeri: Përshkruani këtë imazh në detaje. Jepni sa më shumë detaje. Thoni gjithçka që shihni. ###Asistent:

Për përpunimin e të dhënave pas përpunimit, çdo mospërputhje ose gabim në përshkrimet e krijuara u korrigjua duke përdorur ChatGPT, e ndjekur nga verifikimi manual për të siguruar cilësi të lartë.

Kërkesa për rregullimin e imët të fazës së dytë:

###Njeri: ###Asistent:

Ky eksplorim hap një dritare për të kuptuar mekanikën e AI gjeneruese multimodale si GPT-4, duke hedhur dritë mbi mënyrën sesi vizioni dhe modalitetet gjuhësore mund të integrohen në mënyrë efektive për të gjeneruar rezultate koherente dhe të pasura në kontekst.

Eksplorimi i GPT-4 Vision

Përcaktimi i origjinës së imazhit me ChatGPT

GPT-4 Vision përmirëson aftësinë e ChatGPT për të analizuar imazhet dhe për të përcaktuar origjinën e tyre gjeografike. Kjo veçori i kalon ndërveprimet e përdoruesve nga teksti i thjeshtë në një përzierje teksti dhe pamjesh, duke u bërë një mjet i dobishëm për ata që janë kureshtarë për vende të ndryshme përmes të dhënave të imazhit.

Konceptet komplekse të matematikës

GPT-4 Vision shkëlqen në kërkimin e ideve komplekse matematikore duke analizuar shprehjet grafike ose të shkruara me dorë. Kjo veçori vepron si një mjet i dobishëm për individët që kërkojnë të zgjidhin probleme të ndërlikuara matematikore, duke e shënuar GPT-4 Vision një ndihmë të dukshme në fushat arsimore dhe akademike.

Konvertimi i hyrjes së shkruar me dorë në kode LaTeX

Një nga aftësitë e jashtëzakonshme të GPT-4V është aftësia e tij për të përkthyer hyrjet e shkruara me dorë në kode LaTeX. Kjo veçori është një ndihmë për studiuesit, akademikët dhe studentët që shpesh kanë nevojë të konvertojnë shprehjet matematikore të shkruara me dorë ose informacione të tjera teknike në një format dixhital. Transformimi nga shkrimi me dorë në LaTeX zgjeron horizontin e dixhitalizimit të dokumenteve dhe thjeshton procesin teknik të shkrimit.

Nxjerrja e detajeve të tabelës

GPT-4V tregon aftësinë në nxjerrjen e detajeve nga tabelat dhe adresimin e pyetjeve të lidhura, një aset jetik në analizën e të dhënave. Përdoruesit mund të përdorin GPT-4V për të shoshitur tabelat, për të mbledhur njohuri kryesore dhe për të zgjidhur pyetjet e drejtuara nga të dhënat, duke e bërë atë një mjet të fuqishëm për analistët e të dhënave dhe profesionistë të tjerë.

Kuptimi i Tregimit Vizual

Aftësia unike e GPT-4V për të kuptuar drejtimin vizual i shton një dimension të ri ndërveprimit të përdoruesit. Duke kuptuar shenjat vizuale, GPT-4V mund t'u përgjigjet pyetjeve me një kuptim më të lartë kontekstual.

Ndërtimi i faqeve të internetit të thjeshta modele duke përdorur një vizatim

E motivuar nga kjo cicëroj, u përpoqa të krijoja një model për faqen e internetit unite.ai.

Ndërsa rezultati nuk përputhej plotësisht me vizionin tim fillestar, këtu është rezultati që arrita.

Kufizimet dhe të metat e GPT-4V (izioni)

Për të analizuar GPT-4V, ekipi i Open AI kreu vlerësime cilësore dhe sasiore. Ato cilësore përfshinin teste të brendshme dhe rishikime të ekspertëve të jashtëm, ndërsa ato sasiore matën refuzimet dhe saktësinë e modeleve në skenarë të ndryshëm si identifikimi i përmbajtjes së dëmshme, njohja demografike, shqetësimet e privatësisë, vendndodhjen gjeografike, sigurinë kibernetike dhe thyerjet multimodale të burgut.

Megjithatë modeli nuk është perfekt.

La letër thekson kufizimet e GPT-4V, si përfundimet e pasakta dhe teksti ose karakteret që mungojnë në imazhe. Mund të halucinojë ose të shpikë fakte. Veçanërisht, nuk është i përshtatshëm për identifikimin e substancave të rrezikshme në imazhe, shpesh duke i keqidentifikuar ato.

Në imazhet mjekësore, GPT-4V mund të japë përgjigje jokonsistente dhe i mungon vetëdija për praktikat standarde, duke çuar në diagnoza të gabuara të mundshme.

Performanca jo e besueshme për qëllime mjekësore (Burim)

Ai gjithashtu nuk arrin të kuptojë nuancat e disa simboleve të urrejtjes dhe mund të gjenerojë përmbajtje të papërshtatshme bazuar në inputet vizuale. OpenAI këshillon kundër përdorimit të GPT-4V për interpretime kritike, veçanërisht në kontekste mjekësore ose të ndjeshme.

Duke Up

Krijuar duke përdorur Fast Stable Diffusion XL https://huggingface.co/spaces/google/sdxl

Ardhja e GPT-4 Vision (GPT-4V) sjell një sërë mundësish fantastike dhe pengesa të reja për t'u kapërcyer. Përpara se të publikohej, është bërë shumë përpjekje për t'u siguruar që rreziqet, veçanërisht kur bëhet fjalë për fotografitë e njerëzve, të shikohen mirë dhe të reduktohen. Është mbresëlënëse të shohësh se si GPT-4V është rritur, duke treguar shumë premtime në fusha të ndërlikuara si mjekësia dhe shkenca.

Tani, ka disa pyetje të mëdha në tryezë. Për shembull, a duhet këto modele të jenë në gjendje të identifikojnë njerëzit e famshëm nga fotot? A duhet të marrin me mend gjininë, racën ose ndjenjat e një personi nga një foto? Dhe, a duhet të ketë rregullime të veçanta për të ndihmuar individët me shikim të dëmtuar? Këto pyetje hapin një kuti krimbash në lidhje me privatësinë, drejtësinë dhe mënyrën se si AI duhet të përshtatet në jetën tonë, gjë për të cilën të gjithë duhet të kenë një fjalë.