Искусственный интеллект

GOTCHA — система CAPTCHA для живых дипфейков

Новое исследование Нью-Йоркского университета подтверждает растущее число признаков того, что вскоре нам, возможно, придется проходить фейковый эквивалент «теста на алкоголь», чтобы подтвердить свою подлинность, прежде чем начать конфиденциальный видеозвонок, например, видеоконференцию по работе или любой другой деликатный сценарий, который может привлечь мошенников, использующих дипфейк в реальном времени ПО для стриминга.

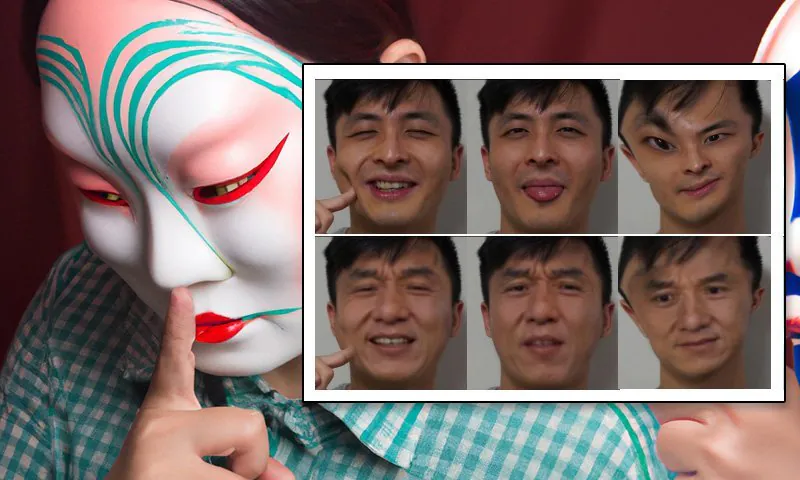

Некоторые активные и пассивные испытания, применяемые к сценариям видеозвонков в GOTCHA. Пользователь должен выполнить и пройти испытания, в то время как используются дополнительные «пассивные» методы (например, попытка перегрузить потенциальную систему дипфейка), на которые участник не имеет никакого влияния. Источник: http://export.arxiv.org/pdf/2210.06186.

Предлагаемая система называется GOTCHA — дань уважения системам CAPTCHA, которые за последние 10-15 лет стали все более серьезным препятствием для просмотра веб-страниц, когда автоматизированные системы требуют от пользователя выполнения задач, с которыми машины плохо справляются, например, идентификации животных. или расшифровка искаженного текста (и, по иронии судьбы, эти проблемы часто превращают пользователя в свободный AMTвнешний аннотатор в стиле).

По сути, GOTCHA продлевает август 2022 г. DF-капча документ из Университета Бен-Гуриона, в котором впервые было предложено заставить человека на другом конце провода прыгать через несколько визуально-семантических обручей, чтобы доказать свою подлинность.

В статье, опубликованной в августе 2022 года Университетом Бен-Гуриона, впервые был предложен ряд интерактивных тестов для пользователя, в том числе закрытие лица или даже надавливание на кожу — задачи, которые даже хорошо обученные живые системы дипфейков не могли предвидеть или не могли справиться фотореалистично. . Источник: https://arxiv.org/pdf/2208.08524.pdf

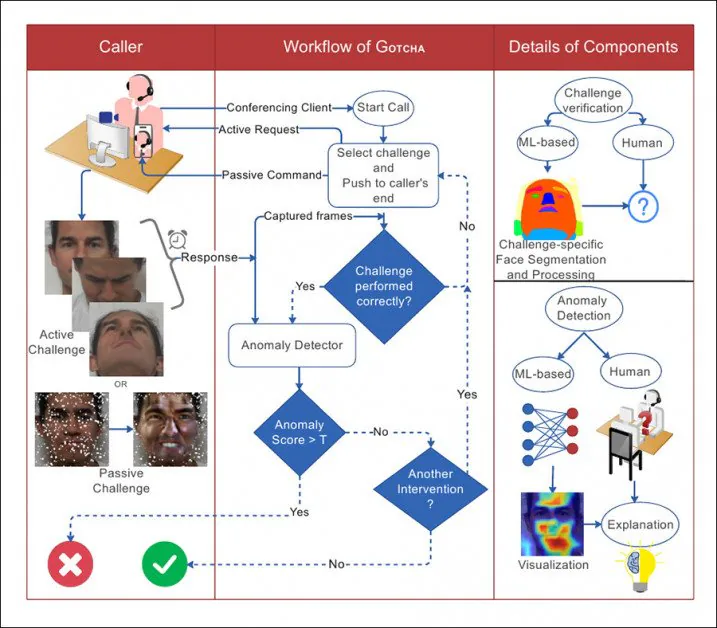

Примечательно, что GOTCHA добавляет «пассивные» методологии к «каскаду» предлагаемых тестов, включая автоматическое наложение нереальных элементов на лицо пользователя и «перегрузку» кадров, проходящих через исходную систему. Однако без специальных разрешений на доступ к локальной системе пользователя можно оценить только задачи, связанные с его реакцией. Такие разрешения, предположительно, будут реализованы в виде локальных модулей или дополнений к популярным системам, таким как Skype и Zoom, или даже в виде специализированного программного обеспечения, специально предназначенного для выявления мошенников.

Из статьи иллюстрация взаимодействия между вызывающим абонентом и системой в GOTCHA с пунктирными линиями в виде потоков принятия решений.

Исследователи проверили работу системы на новом наборе данных, содержащем более 2.5 млн видеокадров от 47 участников, каждый из которых выполнил 13 заданий GOTCHA. Они утверждают, что система обеспечивает «последовательное и измеримое» снижение качества контента, создаваемого мошенническими пользователями, нагружая локальную систему до тех пор, пока очевидные артефакты не сделают обман очевидным для невооруженного глаза (хотя GOTCHA также содержит ряд более тонких алгоритмических методов анализа).

Новый документ называется Попался: система «запрос-ответ» для обнаружения дипфейков в реальном времени (в тексте с заглавной буквы пишется название системы, но не название публикации, хотя оно и не является аббревиатурой).

Ряд вызовов

В основном в соответствии с документом Бен-Гуриона фактические проблемы, с которыми сталкивается пользователь, делятся на несколько типов задач.

Для пакетов окклюзия, пользователю необходимо либо закрыть лицо рукой или другими предметами, либо повернуть лицо под углом, который вряд ли был бы обработан для создания модели deepfake (обычно из-за отсутствия обучающих данных для «странных» поз — см. ряд изображений на первой иллюстрации выше).

Помимо действий, которые пользователь может выполнять самостоятельно в соответствии с инструкциями, GOTCHA может накладывать случайные вырезки лиц, наклейки и фильтры дополненной реальности, чтобы «исказить» поток лиц, ожидаемый локально обученной моделью deepfake, что может привести к её сбою. Как уже упоминалось, хотя этот процесс и является «пассивным» для пользователя, он является навязчивым для программного обеспечения, которому необходимо иметь возможность непосредственно вмешиваться в поток конечного корреспондента.

Затем пользователю может потребоваться изобразить на своем лице необычные выражения, которые, скорее всего, либо отсутствуют, либо недостаточно представлены в любом обучающем наборе данных, что приводит к снижению качества результата глубокой фейковости (изображение «b», второй столбец слева, на первой иллюстрации выше).

В рамках этой серии тестов от пользователя может потребоваться прочитать текст или начать разговор, предназначенный для того, чтобы бросить вызов местной живой системе дипфейкинга, которая, возможно, не обучила адекватный диапазон фонем или других типов данных рта до уровня где он может восстановить точное движение губ под таким пристальным вниманием.

Наконец (и это, похоже, бросает вызов актёрскому таланту конечного корреспондента), в этой категории пользователю может быть предложено изобразить «микровыражение» – короткое и непроизвольное выражение лица, которое имитирует эмоцию. Об этом, как говорится в статье, «[это] обычно длится 0.5–4.0 секунды, и его трудно подделать»..

Хотя в статье не описывается, как извлечь микровыражение, логика подсказывает, что единственный способ сделать это — вызвать соответствующую эмоцию у конечного пользователя, возможно, с помощью какого-то ошеломляющего контента, представленного ему в рамках процедуры теста.

Искажение лица, освещение и Неожиданные гости

Кроме того, в соответствии с предложениями августовской статьи, в новой работе предлагается попросить конечного пользователя выполнить необычные мимические искажения и манипуляции, такие как прижатие пальца к щеке, взаимодействие со своим лицом и/или волосами, а также выполнение других движений, которые ни одна существующая система deepfake в реальном времени вряд ли сможет хорошо обработать, поскольку это маргинальные действия — даже если бы они присутствовали в обучающем наборе данных, их воспроизведение, скорее всего, было бы низкого качества, как и другие «выбросы» данных.

Улыбка, но это «подавленное лицо» не очень хорошо передается локальной системой live deepfake.

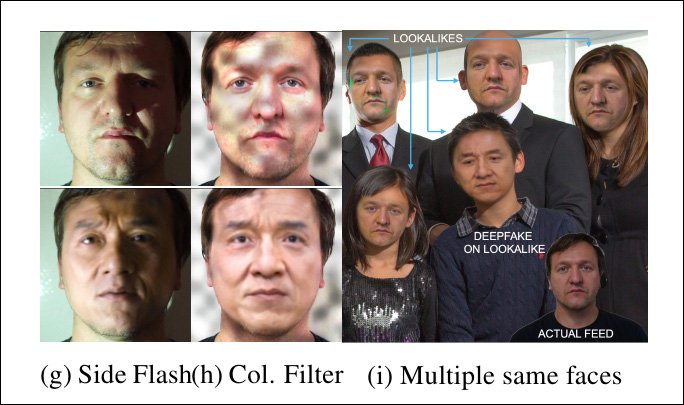

Дополнительная проблема заключается в изменении условий освещенности, в которых находится конечный пользователь, поскольку вполне возможно, что обучение модели deepfake было оптимизировано для стандартных условий освещения видеоконференций или даже для конкретных условий освещения, в которых происходит вызов.

Таким образом, пользователя могут попросить посветить фонариком своего мобильного телефона на лицо или каким-либо другим способом изменить освещение (и стоит отметить, что этот прием является центральным предложением еще одна работа по обнаружению дипфейков который вышел этим летом).

Живые дипфейковые системы сталкиваются с проблемами из-за неожиданного освещения — и даже из-за нескольких людей в потоке, где ожидался только один человек.

В случае, если предлагаемая система имеет возможность вмешиваться в локальный пользовательский поток (который подозревается в наличии посредника для глубоких подделок), добавление неожиданных шаблонов (см. средний столбец на изображении выше) может поставить под угрозу способность алгоритма глубоких подделок поддерживать симуляцию.

Кроме того, хотя неразумно ожидать, что у корреспондента будут дополнительные люди для помощи в аутентификации, система может вставить дополнительные лица (крайнее правое изображение выше) и посмотреть, совершит ли какая-либо локальная система deepfake ошибку, переключив внимание, или даже попытается ли подделать их всех (системы deepfake с автокодировщиком не обладают возможностями «распознавания личности», которые могли бы удерживать внимание на одном человеке в этом сценарии).

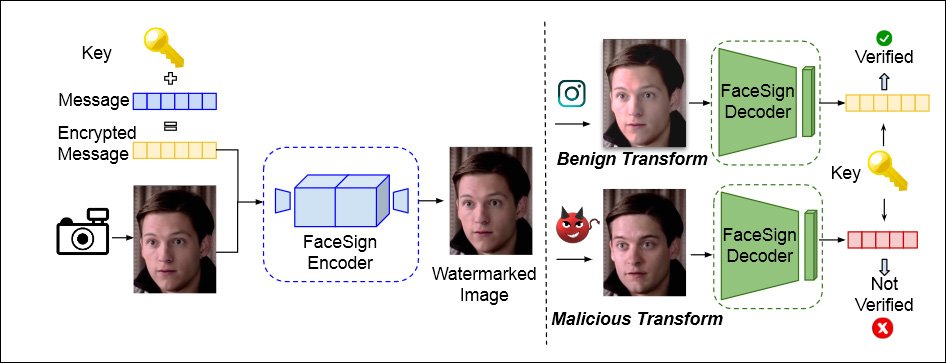

Стеганография и перегрузка

GOTCHA также включает подход первый предложенный Разработанный Калифорнийским университетом в Сан-Диего в апреле этого года, он использует стеганографию для шифрования сообщения в локальном видеопотоке пользователя. Дипфейковые алгоритмы полностью уничтожат это сообщение, что приведёт к сбою аутентификации.

В статье, опубликованной в апреле 2022 года Калифорнийским университетом в Сан-Диего и Государственным университетом Сан-Диего, описывается метод определения подлинной личности путем проверки того, сохраняется ли стеганографический сигнал, отправленный в видеопоток пользователя, в нетронутом виде на локальной линии связи. Если нет, то это может быть признаком мошенничества с дипфейком. Источник: https://arxiv.org/pdf/2204.01960.pdf

Кроме того, GOTCHA способен перегружать локальную систему (при наличии доступа и разрешения) путем дублирования потока и предоставления «избыточных» данных в любую локальную систему, что может привести к сбою репликации в локальной системе deepfake.

Система содержит дополнительные тесты (подробности см. в статье), в том числе испытание для корреспондента со смартфона перевернуть телефон вверх дном, что исказит локальную систему дипфейков:

Опять же, подобные вещи будут работать только в случае крайней необходимости, когда пользователь вынужден предоставить локальный доступ к потоку, и не могут быть реализованы путем простой пассивной оценки видео пользователя, в отличие от интерактивных тестов (например, прижатия пальца к лицу).

практицизм

В статье кратко затрагивается вопрос о том, в какой степени тесты такого рода могут раздражать конечного пользователя или каким-то образом доставлять ему неудобства, например, обязывая пользователя иметь под рукой ряд предметов, которые могут понадобиться для тестов, например солнцезащитные очки.

Он также признает, что может быть трудно заставить влиятельных корреспондентов соблюдать процедуры тестирования. Что касается случая видеозвонка с генеральным директором, авторы заявляют:

«Удобство использования может быть здесь ключевым фактором, поэтому неформальные или легкомысленные задачи (например, с искажением лица или выражением лица) могут быть неуместны. Задачи с использованием внешних физических предметов могут быть нежелательны. Здесь контекст соответствующим образом изменен, и GOTCHA адаптирует свой набор задач соответствующим образом».

Данные и тесты

GOTCHA тестировалась на четырех типах местной системы живых дипфейков, включая две вариации очень популярного создателя дипфейков с автокодировщиком. DeepFaceLab (Хотя, как ни странно, «DFL» в статье не упоминается) DeepFaceLive, который был, с августа 2021 года, «живая» реализация DeepFaceLab, и кажется наиболее вероятным первоначальным ресурсом для потенциального мошенника).

Четыре системы прошли DFL-обучение «легко» на незнаменитом человеке, участвовавшем в тестах, и на паре знаменитостей; DFL-обучение было более полным, до 2 млн итераций или шагов, при которых можно было бы ожидать гораздо более эффективной модели; Аниматор скрытого изображения (ЛИА); и Генеративно-состязательная сеть с обменом лицами (ФСГАН).

Для сбора данных исследователи сняли и отобрали вышеупомянутые видеоклипы, в которых 47 пользователей выполняли 13 активных задач, при этом каждый пользователь выводил около 5-6 минут видео в формате 1080p со скоростью 60 кадров в секунду. Авторы также заявляют, что эти данные в конечном итоге будут обнародованы.

Обнаружение аномалий может выполняться либо человеком-наблюдателем, либо алгоритмически. Для последнего варианта система обучалась на 600 лицах из Набор данных FaceForensics. Функция потери регрессии представляла собой мощное сходство выученных перцептивных изображений (LPIPS), а для обучения классификатора использовалась бинарная кросс-энтропия. ЭйгенКам использовался для визуализации весов детектора.

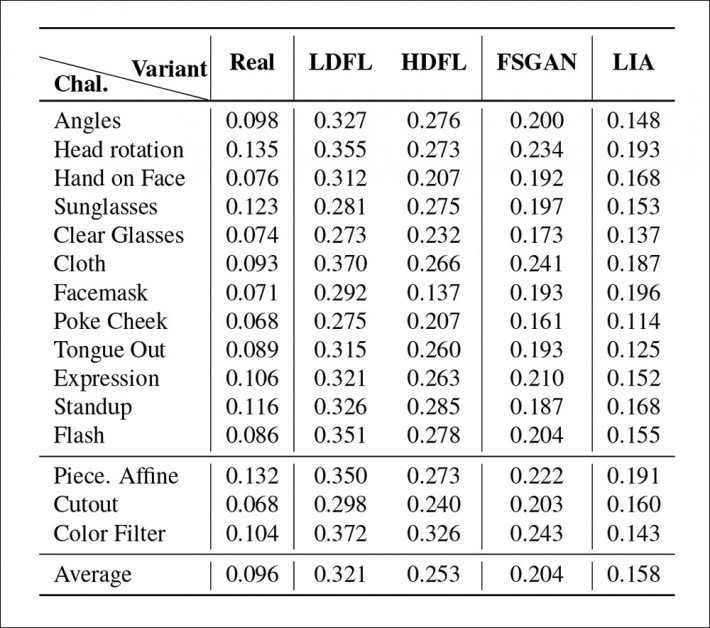

Первичные результаты тестов на GOTCHA.

Исследователи обнаружили, что для полного каскада тестов в четырех системах наименьшее количество и серьезность аномалий (т. е. артефактов, которые выявляли бы наличие дипфейковой системы) были получены при более обученном распределении DFL. Менее обученная версия, в частности, изо всех сил пыталась воссоздать сложные движения губ (которые занимают очень мало места в кадре, но которым уделяется большое внимание человека), в то время как FSGAN занимала золотую середину между двумя версиями DFL, а LIA оказалась совершенно неадекватной для этой задачи. , при этом исследователи полагают, что LIA потерпит неудачу в реальном развертывании.

Впервые опубликовано 17 октября 2022 г.