Lideri de opinie

Ce ar trebui să știe fiecare om de știință a datelor despre Graph Transformers și impactul lor asupra datelor structurate

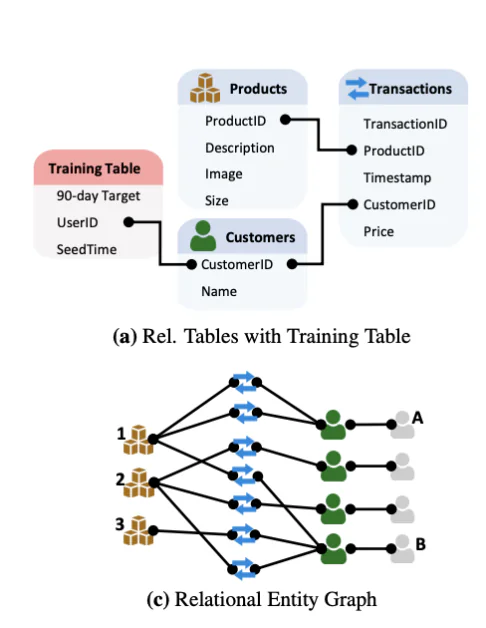

Am co-creat Rețelele Neuronale Grafice în timp ce eram la Stanford. Am recunoscut de la început că această tehnologie era incredibil de puternică. Fiecare punct de date, fiecare observație, fiecare bucată de cunoștințe nu există în izolare; face parte dintr-un graf conectat la alte bucăți de cunoștințe. Important, cele mai valoroase date de afaceri, adesea stocate sub formă de tabele în baze de date și depozite de date, pot fi reprezentate în mod natural sub formă de graf. Exploatarea acestei structuri relationale este cheia pentru construirea unor modele AI precise și non-halucinante.

Rețelele Neuronale Grafice (GNN) au introdus arhitecturi de transmitere a mesajelor care puteau raționa peste grafuri care capturau conexiunile dintre bucăți de cunoștințe.

Dar, la fel cum Transformerii au transformat înțelegerea limbajului, o nouă clasă de modele, Graph Transformerii, aduc câștiguri similare datelor bazate pe graf. Aceste modele combină flexibilitatea mecanismelor de atenție cu priori structurale grafice pentru a modela relații complexe mai eficient decât predecesorii GNN.

De ce grafurile necesită mai mult decât transmiterea mesajelor

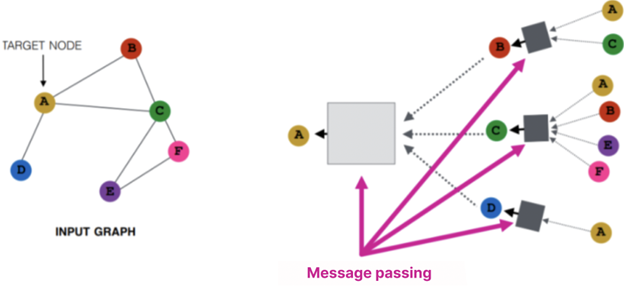

Rețelele Neuronale Grafice tradiționale (GNN) se bazează pe transmiterea mesajelor, un proces în care fiecare nod își actualizează starea internă prin agregarea informațiilor de la vecinii săi. Gândiți-vă la acest proces ca la un schimb de rezumate între noduri apropiate, apoi utilizarea acestor rezumate pentru a-și rafina propria înțelegere. Pe parcursul mai multor straturi, acest lucru permite informațiilor să se propage prin graf.

În timp ce este puternic pentru învățarea unor modele locale, transmiterea mesajelor are limitări importante:

- Supra-comprimarea: Pe măsură ce informațiile sunt agregate pe mai multe salturi, acestea pot deveni comprimate, pierzând detalii semnificative. Acest lucru este deosebit de problematic în GNN adânci.

- Context limitat: Transmiterea standard a mesajelor nu poate captura cu ușurință dependențe pe termen lung fără multiple straturi, ceea ce crește complexitatea și zgomotul.

- Exprimabilitate: Multe structuri de grafuri nu pot fi diferențiate utilizând doar informații locale despre vecinătate, limitând performanța modelului în sarcini care necesită distincții structurale fine.

Aici intervin Graph Transformerii. Prin înlocuirea sau completarea transmiterii mesajelor cu mecanisme de atenție, aceștia permit fiecărui nod să se concentreze direct asupra altor noduri (chiar și a celor îndepărtate) pe baza importanței învățate. Rezultatul este reprezentări mai bogate, o scalabilitate mai bună și capacitatea de a raționa peste structuri complexe mai flexibil.

De la GNN la Graph Transformer

Modelul original Transformer, introdus în lucrarea iconică, Atenția este tot ce ai nevoie, a fost conceput pentru a modela relațiile dintre tokeni într-o secvență. Succesul său se datorează atenției self, un mecanism care permite fiecărui intrare să considere fiecare altă intrare, ponderată de relevanța învățată.

Graph Transformerii adaptează acest paradigme, permițând nodurilor să se concentreze nu numai asupra vecinilor, ci și asupra oricărui nod din graf, fie prin atenție complet conectată, fie printr-o abordare hibridă care echilibrează semnalele globale și locale. Provocarea constă în introducerea unei noțiuni de structură într-un model conceput pentru secvențe neordonate.

Încodări poziționale specifice grafurilor

Spre deosebire de text, grafurile nu au o ordine intrinsecă, făcând încodarea pozițională, care se referă la tehnici pentru injectarea informațiilor structurale sau de localizare într-un model, non-trivială. Graph Transformerii abordează acest lucru prin diverse metode:

- Laplacian Eigenvectors: Derivate din matricea Laplacian a grafului, acestea oferă o încorporare spectrală care capturează structura globală.

- Plimbări aleatoare: Capturează probabilitatea de a traversa de la un nod la altul pe mai multe salturi.

- Încodări structurale: Includ metrici de distanță, grade de noduri sau tipuri de muchii.

Aceste încodări poziționale, fie spectrale, probabilistice sau structurale, oferă Graph Transformerilor o modalitate de a înțelege unde se află fiecare nod în cadrul grafului mai larg. Această conștientizare structurală este esențială pentru a permite mecanismelor de atenție să funcționeze în mod semnificativ peste date neordonate și neregulate, permițând în final modelului să captureze relații care ar fi invizibile pentru metodele mai simple, pur locale.

Implementări și cazuri de utilizare din lumea reală

Aducerea Graph Transformerilor în producție necesită o infrastructură care să poată scala la dimensiunile datelor din lumea reală. Biblioteci precum PyTorch Geometric (PyG) fac acest lucru posibil. Construit pe PyTorch, PyG oferă un cadru modular pentru implementarea GNN și a Graph Transformerilor într-o gamă largă de aplicații, de la modelarea moleculelor la sisteme de recomandare. Aceasta suportă antrenamentul cu mini-loturi pe multiple grafuri mici și pe un singur graf mare, cu suport multi-GPU și torch.compile, făcându-l potrivit atât pentru fluxurile de lucru de cercetare, cât și pentru cele din întreprinderi.

Aceste instrumente sunt deja utilizate într-o gamă largă de aplicații din lumea reală. În descoperirea de medicamente, Graph Transformerii ajută la predicția proprietăților moleculare prin modelarea interacțiunilor atomice sub formă de grafuri. În logistică și optimizarea lanțului de aprovizionare, aceștia pot reprezenta și raționa peste rețele dinamice de livrări, depozite și rute. Companiile de comerț electronic le utilizează pentru a îmbunătăți recomandările prin înțelegerea comportamentului de cumpărare și navigare relațional ca grafuri. Și în securitatea cibernetică, modelele bazate pe grafuri sunt utilizate pentru a detecta anomalii prin analizarea modelelor de acces, a topologiei rețelei și a secvențelor de evenimente.

În fiecare dintre aceste contexte, capacitatea de a învăța din structuri complexe și interconectate, fără a se baza exclusiv pe caracteristici create manual, se dovedește a fi un avantaj major.

Considerații tehnice

În ciuda potențialului lor, Graph Transformerii vin cu compromisuri reale de inginerie. Atenția self completă se scalează pătratic cu numărul de noduri, făcând eficiența memoriei și a calculului o preocupare de top, mai ales pentru grafuri mari sau dense. Multe grafuri din lumea reală au muchii orientate, introducând asimetrii care complică modul în care informațiile structurale sunt încodate. Și în implementările practice, intrările rareori sunt uniforme: combinarea datelor structurate sub formă de graf cu text, serii de timp sau imagini cere alegeri arhitecturale atente și o prelucrare robustă a datelor.

Aceste provocări nu sunt insurmontabile, dar necesită o proiectare sistemului gândită, mai ales atunci când se trece de la prototipurile de cercetare la modele gata de producție.

Ce urmează: LLM întâlnesc grafurile

O direcție importantă de cercetare este integrarea modelelor de limbaj mari (LLM) cu structuri de grafuri. Aceste sisteme hibride utilizează LLM pentru a încoda contextul textual sau pentru a extrage entități, apoi pentru a ancora aceste informații într-un graf pentru raționament și luare a deciziilor.

În biologie, acest lucru a pus bazele unor instrumente precum AlphaFold. În inteligența artificială din întreprinderi, acest lucru permite sisteme de suport pentru clienți care combină documentația și grafurile comportamentale. Graph Transformerii joacă un rol din ce în ce mai important în permiterea agenților AI să ia decizii mai inteligente și mai acționabile, permițându-le să raționeze peste reprezentări structurate ale stării și să prioritizeze interacțiunile în mod dinamic. Această fuziune ajută agenții să înțeleagă mai bine relațiile ierarhice, să urmărească dependențele în timp și să-și adapteze comportamentul în medii complexe.

Domeniul este încă în curs de dezvoltare, dar potențialul este semnificativ.

Concluzie

Graph Transformerii nu sunt doar următoarea iterație a GNN; ei reprezintă o convergență a atenției, structurii și scalabilității. Indiferent dacă lucrați în finanțe, științe ale vieții sau sisteme de recomandare, mesajul este clar: datele dvs. formează un graf, deci și modelele dvs. ar trebui să o facă.