Unghiul lui Anderson

Imaginile ‘Protejate’ Sunt Mai Ușor de Furat Cu AI, Nu Mai Dificil

Noi cercetări sugerează că uneltele de marcă a apei destinate să blocheze editarea imaginilor AI pot avea efect invers. În loc să oprească modele precum Stable Diffusion să facă modificări, unele protecții chiar ajută IA să urmeze prompturile de editare mai îndeaproape, făcând manipulările nedorite și mai ușoare.

Există o direcție notabilă și robustă în literatura de vedere a calculatorului dedicată protejării imaginilor cu drepturi de autor împotriva utilizării în modele de IA sau în procese directe de imagine>imagine AI. Sistemele de acest tip sunt, în general, orientate către Modele de difuziune latentă (LDM) cum ar fi Stable Diffusion și Flux, care utilizează proceduri bazate pe zgomot pentru a codifica și decodifica imagini.

Prin inserarea de zgomot adversarial în imagini care altfel arată normal, poate fi posibil să se determine ca detectoarele de imagini să ghicească conținutul imaginii în mod incorect și să împiedice sistemele generatoare de imagini să exploateze datele cu drepturi de autor:

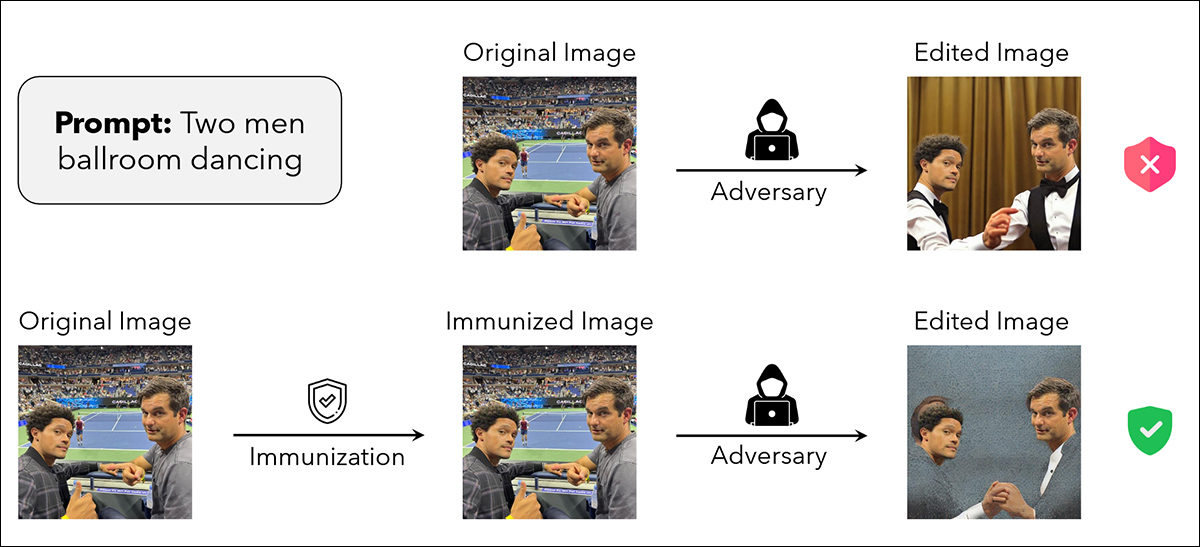

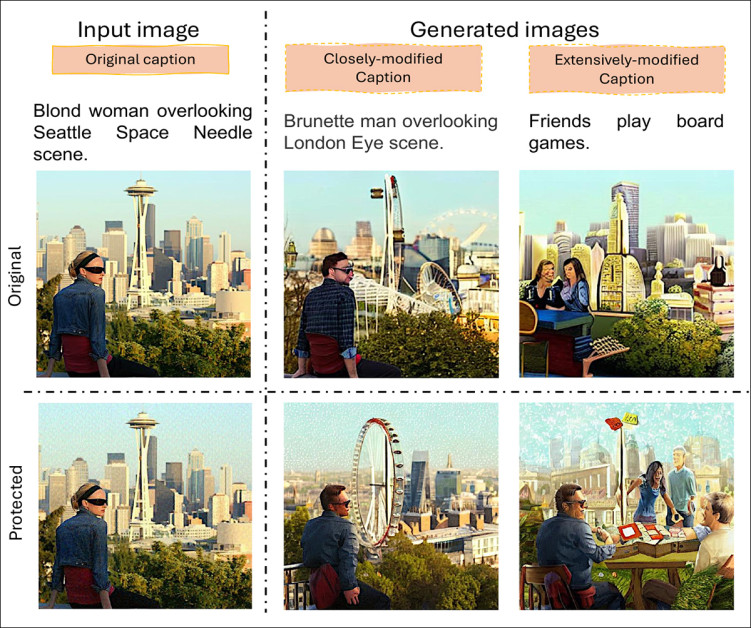

Din lucrarea MIT ‘Raising the Cost of Malicious AI-Powered Image Editing’, exemple de imagini sursă ‘imunizate’ împotriva manipulării (rândul inferior). Sursă: https://arxiv.org/pdf/2302.06588

De la reacția artiștilor împotriva utilizării liberale a imaginilor de pe web de către Stable Diffusion (inclusiv imagini cu drepturi de autor) în 2023, scena de cercetare a produs multiple variații pe aceeași temă – ideea că imaginile pot fi “otrăvite” în mod invizibil împotriva utilizării în sisteme de IA sau în conducte de generare de IA, fără a afecta negativ calitatea imaginii pentru spectatorul mediu.

În toate cazurile, există o corelație directă între intensitatea perturbației impuse, gradul în care imaginea este ulterior protejată și gradul în care imaginea nu arată chiar atât de bine pe cât ar trebui:

Deși calitatea PDF-ului de cercetare nu ilustrează pe deplin problema, cantități mai mari de perturbație adversarială sacrifică calitatea pentru securitate. Aici vedem gama de tulburări de calitate în proiectul ‘Fawkes’ din 2020, condus de Universitatea din Chicago. Sursă: https://arxiv.org/pdf/2002.08327

De interes deosebit pentru artiștii care doresc să-și protejeze stilurile împotriva utilizării neautorizate este capacitatea unor astfel de sisteme de a ascunde identitatea și alte informații, dar și de a “convinge” un proces de antrenare IA că vede ceva diferit de ceea ce vede realmente, astfel încât conexiunile să nu se formeze între domeniile semantic și vizual pentru datele de antrenare “protejate” (de exemplu, un prompt precum ‘În stilul lui Paul Klee’).

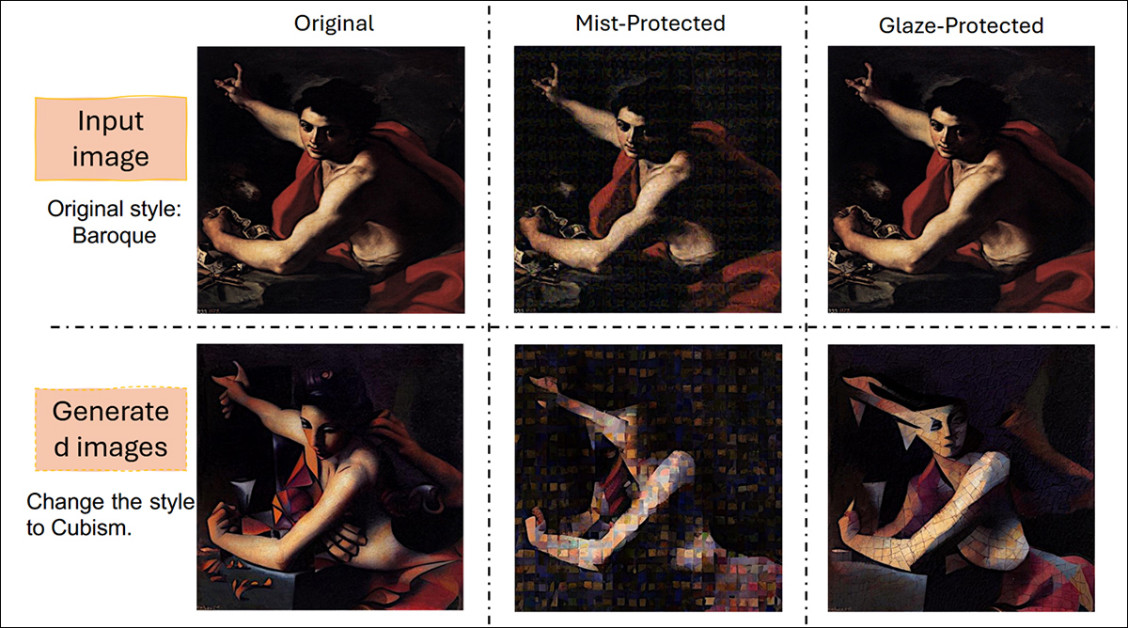

Mist și Glaze sunt două metode populare de injecție capabile să prevină sau, cel puțin, să împiedice încercările de a utiliza stiluri cu drepturi de autor în fluxuri de lucru și rutine de antrenare IA. Sursă: https://arxiv.org/pdf/2506.04394

Autogol

Acum, o nouă cercetare din SUA a descoperit nu numai că perturbațiile pot eșua în a proteja o imagine, dar că adăugarea de perturbații poate, de fapt, îmbunătăți exploatarea imaginii în toate procesele de IA pe care perturbația este menită să le imunizeze.

Articolul afirmă:

‘În experimentele noastre cu diverse metode de protecție a imaginilor pe baza perturbațiilor, în multiple domenii (imagini de scene naturale și opere de artă) și sarcini de editare (generare imagine-la-imagine și editare stil), am descoperit că o astfel de protecție nu atinge complet acest obiectiv.

‘În majoritatea scenariilor, editarea difuziunii a imaginilor protejate generează o imagine de ieșire dorită care respectă precis promptul de ghidare.

‘Rezultatele noastre sugerează că adăugarea de zgomot la imagini poate, paradoxal, crește asocierea lor cu prompturile de text date în timpul procesului de generare, conducând la consecințe nedorite, cum ar fi editări mai bune.

‘Prin urmare, susținem că metodele bazate pe perturbații nu pot oferi o soluție suficientă pentru protecția robustă a imaginilor împotriva editării bazate pe difuziune.’

În teste, imaginile protejate au fost expuse la două scenarii familiare de editare AI: generare imagine-la-imagine și transfer de stil. Aceste procese reflectă modurile comune în care modelele de IA ar putea exploata conținut protejat, fie prin modificarea directă a unei imagini, fie prin împrumutarea trăsăturilor sale stilistice pentru utilizare în altă parte.

Imaginile protejate, extrase din surse standard de fotografie și artă, au fost rulate prin aceste conducte pentru a vedea dacă perturbațiile adăugate puteau bloca sau degrada editările.

În loc de aceasta, prezența protecției a părut adesea să ascuțească alinierea modelului cu prompturile, producând ieșiri curate și precise acolo unde se așteptau unele eșecuri.

Autorii sfătuiesc, în esență, că această metodă foarte populară de protecție poate oferi o falsă senzație de securitate și că orice abordare de imunizare pe baza perturbațiilor ar trebui testată temeinic împotriva metodelor autorilor.

Metodă

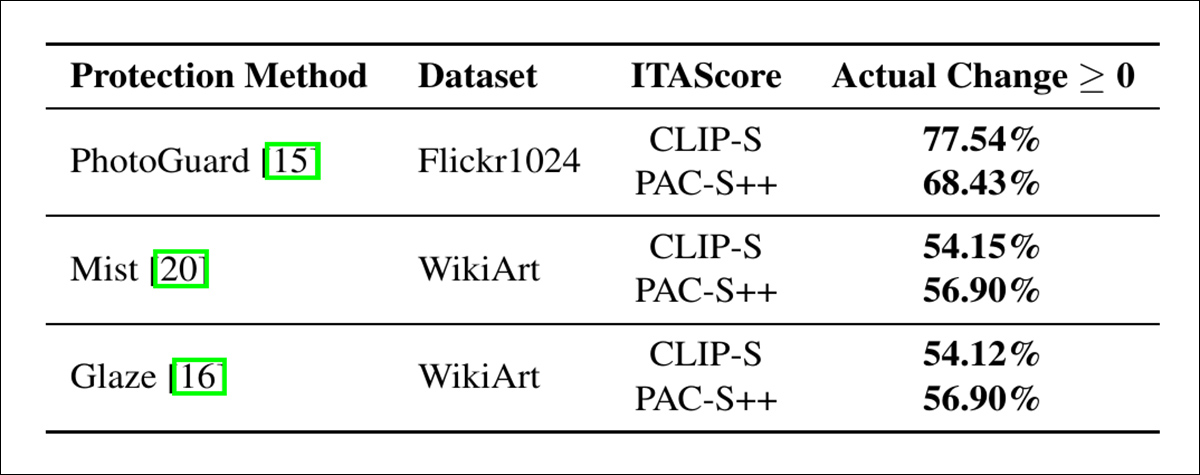

Autorii au efectuat experimente utilizând trei metode de protecție care aplică perturbații adversariale atent proiectate: PhotoGuard; Mist; și Glaze.

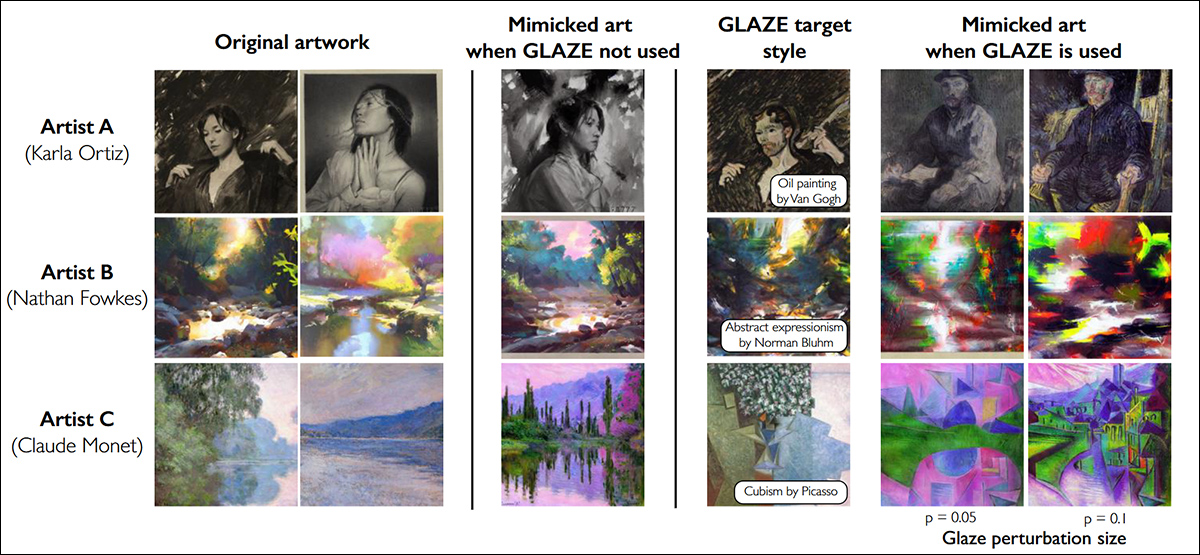

Glaze, una dintre cadrele testate de autori, ilustrând exemple de protecție Glaze pentru trei artiști. Primele două coloane arată operele de artă originale; a treia coloană arată rezultatele de imitare fără protecție; a patra, versiuni transferate de stil utilizate pentru optimizarea mantiilor, împreună cu numele de stil țintă. A cincea și a șasea coloană arată rezultatele de imitare cu protecția aplicată la niveluri de perturbație p = 0,05 și p = 0,1. Toate rezultatele utilizează modele Stable Diffusion. https://arxiv.org/pdf/2302.04222

PhotoGuard a fost aplicat la imagini de scene naturale, în timp ce Mist și Glaze au fost utilizate pe opere de artă (adică “domenii stilistice artistice”).

Testele au acoperit atât imagini naturale, cât și artistice, pentru a reflecta utilizări posibile din lumea reală. Eficacitatea fiecărei metode a fost evaluată prin verificarea capacității modelului de IA de a produce încă imagini realiste și relevante pentru prompt, atunci când lucra cu imagini protejate; dacă imaginile rezultate păreau convingătoare și corespundeau prompturilor, protecția a fost considerată a fi eșuată.

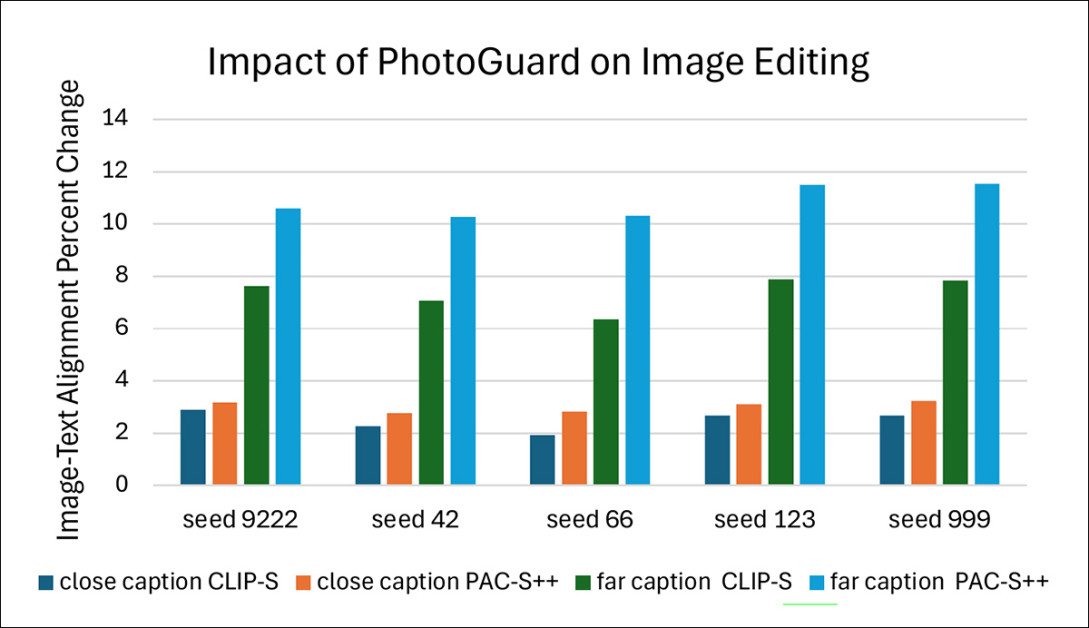

Stable Diffusion v1.5 a fost utilizat ca generator de imagini preantrenat pentru sarcinile de editare ale cercetătorilor. Cinci semănat au fost selectate pentru a asigura reproductibilitatea: 9222, 999, 123, 66 și 42. Toate celelalte setări de generare, cum ar fi scala de ghidare, puterea și numărul total de pași, au urmat valorile implicite utilizate în experimentele PhotoGuard.

PhotoGuard a fost testat pe imagini de scene naturale utilizând setul de date Flickr8k, care conține peste 8.000 de imagini pereche cu până la cinci subtitrări fiecare.

Gânduri Opozite

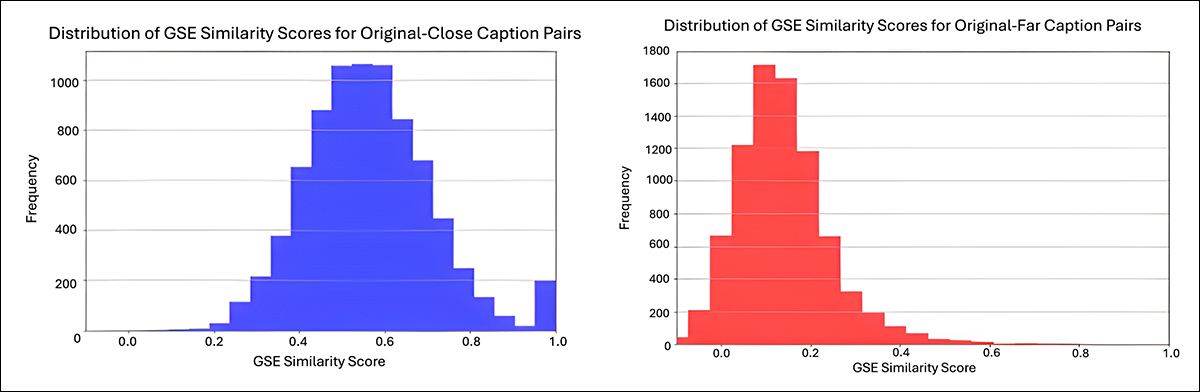

Două seturi de subtitrări modificate au fost create din prima subtitrare a fiecărei imagini cu ajutorul Claude Sonnet 3.5. Un set conținea prompturi care erau contextual apropiat de subtitrarile originale; celălalt set conținea prompturi care erau contextual îndepărtat.

De exemplu, de la subtitrarea originală ‘O fată tânără într-o rochie roz intrând într-o cabană de lemn’, un prompt apropiat ar fi ‘Un băiat tânăr într-o cămașă albastră intrând într-o casă de cărămidă’. În schimb, un prompt îndepărtat ar fi ‘Două pisici relaxându-se pe un canapea’.

Prompturile apropiate au fost construite prin înlocuirea substantivelor și a adjectivelor cu termeni semantic asemănători; prompturile îndepărtate au fost generate prin instruirea modelului să creeze subtitrări care erau contextual foarte diferite.

Toate subtitrarile generate au fost verificate manual pentru calitate și relevanță semantică. Universal Sentence Encoder de la Google a fost utilizat pentru a calcula scorurile de similaritate semantică între subtitrarile originale și cele modificate:

Din materialul suplimentar, distribuțiile de similaritate semantică pentru subtitrarile modificate utilizate în testele Flickr8k. Graficul din stânga arată scorurile de similaritate pentru subtitrarile modificate apropiat, având în medie aproximativ 0,6. Graficul din dreapta arată subtitrarile modificate extins, având în medie aproximativ 0,1, reflectând o distanță semantică mai mare față de subtitrarile originale. Valorile au fost calculate utilizând Universal Sentence Encoder de la Google. Sursă: https://sigport.org/sites/default/files/docs/IncompleteProtection_SM_0.pdf

Fiecare imagine, împreună cu versiunea sa protejată, a fost editată utilizând atât prompturile apropiate, cât și cele îndepărtate. Evaluatorul de calitate spațială a imaginilor fără referință (BRISQUE) a fost utilizat pentru a evalua calitatea imaginii:

Rezultate de generare imagine-la-imagine pe fotografii naturale protejate de PhotoGuard. În ciuda prezenței perturbațiilor, Stable Diffusion v1.5 a urmat cu succes atât modificările mici, cât și cele mari ale prompturilor de editare, producând ieșiri realiste care corespundeau noilor instrucțiuni.

Metrici

Pentru a evalua cât de bine protecțiile interferează cu editarea de IA, cercetătorii au măsurat cât de strâns imaginile finale se potrivesc cu instrucțiunile pe care le-au primit, utilizând sisteme de scorare care compară conținutul imaginii cu promptul de text, pentru a vedea cât de bine se aliniază.

În acest scop, metrica CLIP-S utilizează un model care poate înțelege atât imagini, cât și text pentru a verifica cât de similare sunt, în timp ce PAC-S++ adaugă mostre suplimentare create de IA pentru a alinia compararea mai strâns cu o estimare umană.

Aceste scoruri de aliniere imagine-text (ITA) denotă cât de precis IA a urmat instrucțiunile atunci când a modificat o imagine protejată: dacă o imagine protejată a condus încă la o ieșire aliniată puternic, înseamnă că protecția a eșuat în a bloca editarea.

Efectul protecției asupra setului de date Flickr8k, utilizând ambele prompturi apropiate și îndepărtate, pe cinci semănat. Alinierea imagine-text a fost măsurată utilizând scorurile CLIP-S și PAC-S++.

Cercetătorii au comparat cât de bine IA a urmat prompturile atunci când edita imagini protejate versus neprotejate. Ei au evaluat mai întâi diferența dintre cele două, numită Schimbarea Reală. Apoi, diferența a fost scalată pentru a crea o Schimbare Procentuală, facilitând compararea rezultatelor pe multiple teste.

Acest proces a dezvăluit dacă protecțiile au făcut mai dificil sau mai ușor pentru IA să se potrivească cu prompturile. Testele au fost repetate de cinci ori, utilizând semănat diferite, acoperind atât modificări mici, cât și mari ale subtitrarilor originale.

Atacul Artistic

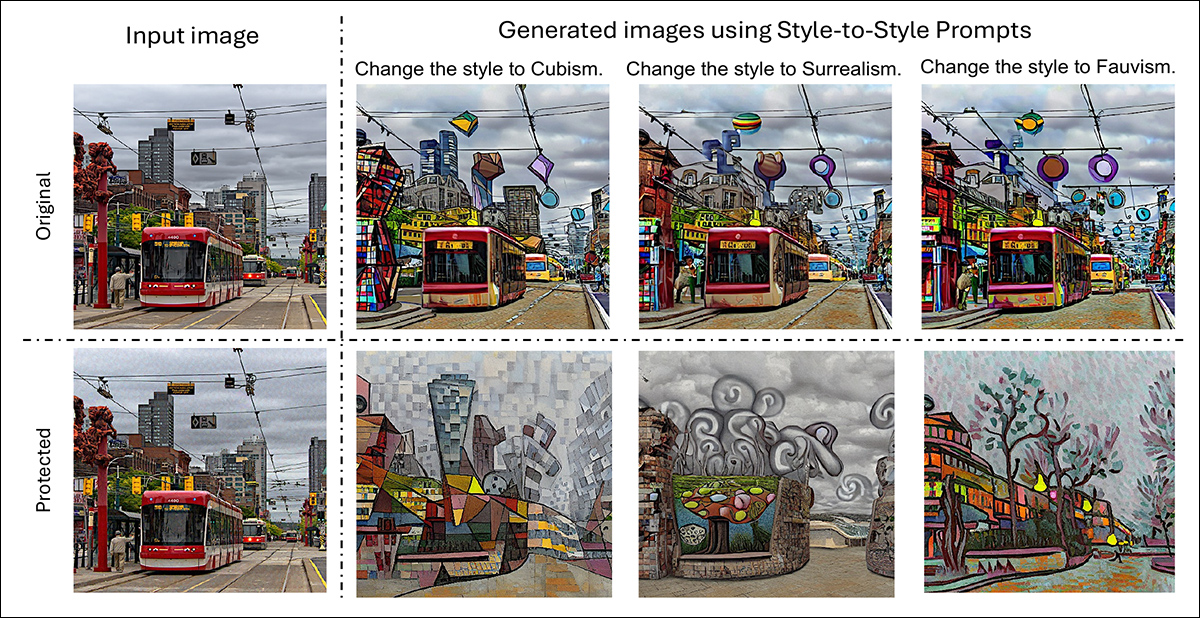

Pentru testele pe fotografii naturale, a fost utilizat setul de date Flickr1024, care conține peste o mie de imagini de înaltă calitate. Fiecare imagine a fost editată cu prompturi care urmau modelul: ‘Schimbă stilul în [V]’, unde [V] reprezenta unul dintre cele șapte stiluri artistice celebre: Cubism; Postimpresionism; Impresionism; Suprarealism; Baroc; Fauvism; și Renaștere.

Procesul a implicat aplicarea PhotoGuard asupra imaginilor originale, generarea de versiuni protejate și apoi rularea atât a imaginilor protejate, cât și a celor neprotejate prin aceleași seturi de editări de transfer de stil:

Imaginile originale și protejate ale unei scene naturale, fiecare editată pentru a aplica stilurile Cubism, Suprarealism și Fauvism.

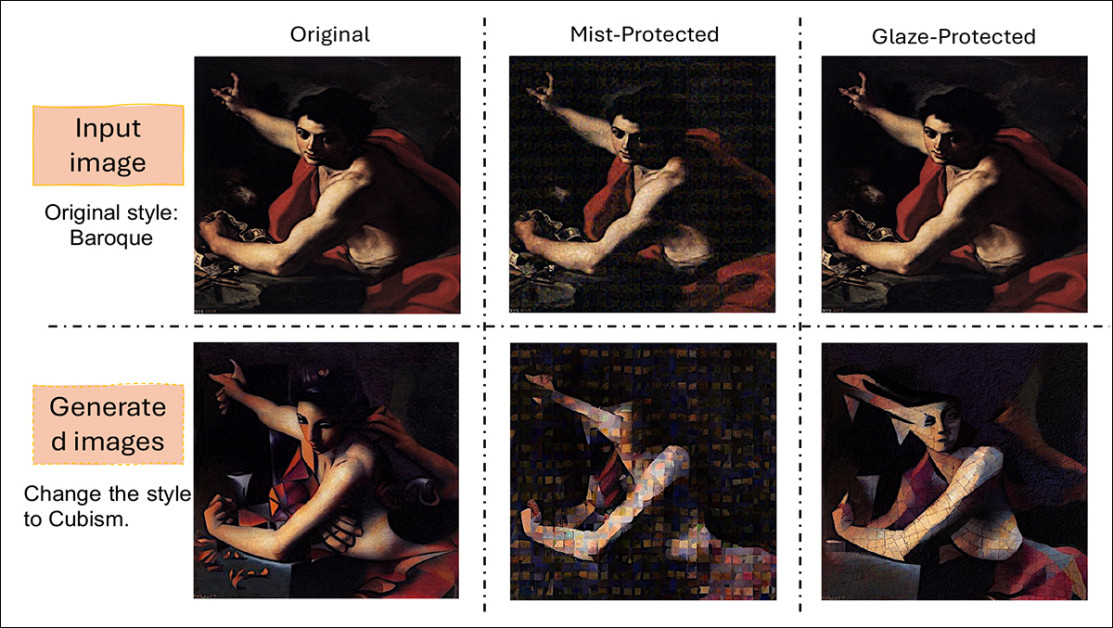

Pentru a testa metodele de protecție pe opere de artă, s-a efectuat transfer de stil pe imagini din setul de date WikiArt, care curatează o gamă largă de stiluri artistice. Prompturile de editare au urmat același format ca și înainte, instruind IA să schimbe stilul într-unul selectat aleatoriu și diferit din etichetele WikiArt.

Atât Glaze, cât și Mist au fost aplicate asupra imaginilor înainte de editări, permițând cercetătorilor să observe cât de bine fiecare apărare a putut bloca sau distorsiona rezultatele transferului de stil:

Exemple de modul în care metodele de protecție afectează transferul de stil pe opere de artă. Imaginea originală în stil Baroc este arătată alături de versiunile protejate de Mist și Glaze. După aplicarea transferului de stil Cubism, pot fi observate diferențele în modul în care fiecare protecție alterează ieșirea finală.

Cercetătorii au testat comparativ și cantitativ:

Schimbări în scorurile de aliniere imagine-text după editări de transfer de stil.

Dintre aceste rezultate, autorii menționează:

‘Rezultatele subliniază o limitare semnificativă a perturbațiilor adversariale pentru protecție. În loc să împiedice alinierea, perturbațiile adversariale îmbunătățesc adesea răspunsul modelului generativ la prompturi, permițând, în mod neintenționat, exploatorilor să producă ieșiri care se aliniază mai strâns cu obiectivele lor. O astfel de protecție nu este disruptivă pentru procesul de editare a imaginilor și nu poate preveni agenții maliciți să copieze material neautorizat.

‘Consecințele neintenționate ale utilizării perturbațiilor adversariale dezvăluie vulnerabilități în metodele existente și subliniază nevoia urgentă de tehnici de protecție mai eficiente.’

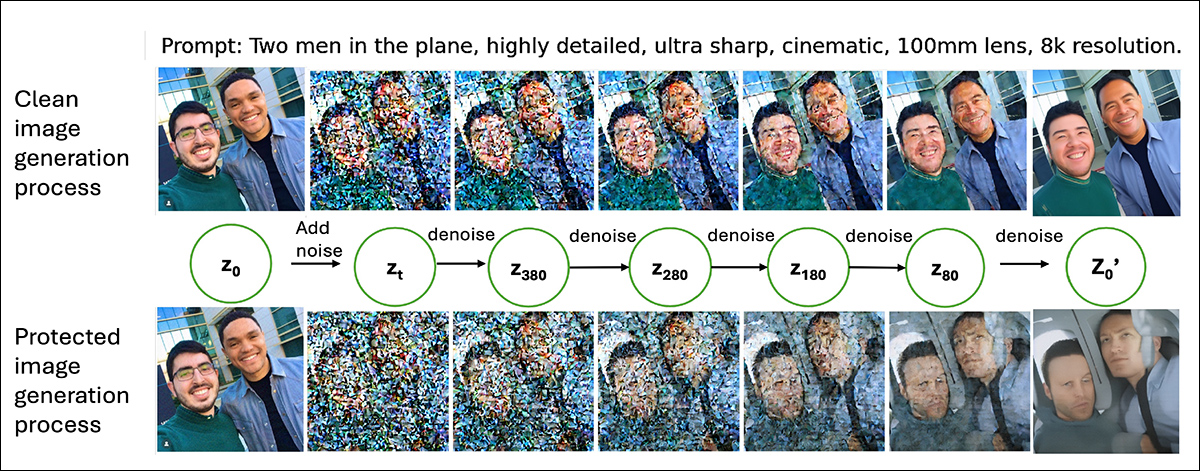

Autorii explică faptul că rezultatele neașteptate pot fi atribuite modului în care funcționează modelele de difuziune: LDM edită imagini prin convertirea lor într-o versiune comprimată numită latent; zgomotul este apoi adăugat la acest latent prin multiple etape, până când datele devin aproape aleatorii.

Modelul inversează acest proces în timpul generării, înlăturând zgomotul pas cu pas. La fiecare etapă a acestei inversări, promptul de text ajută la ghidarea modului în care zgomotul ar trebui curățat, modelând treptat imaginea pentru a se potrivi cu promptul:

Comparație între generațiile dintr-o imagine neprotejată și una protejată de PhotoGuard, cu stări latente intermediare convertite înapoi în imagini pentru vizualizare.

Metodele de protecție adaugă cantități mici de zgomot suplimentar la imaginea originală înainte de a intra în acest proces. Deși aceste perturbații sunt minore la început, ele se acumulează pe măsură ce modelul aplică propriile straturi de zgomot.

Acestă acumulare lasă mai multe părți ale imaginii “nesigure” atunci când modelul începe să înlăture zgomotul. Cu o incertitudine mai mare, modelul se bazează mai mult pe promptul de text pentru a completa detaliile lipsă, dând promptului o influență și mai mare decât ar fi avut-o normal.

În esență, protecțiile fac mai ușor pentru IA să reshapeze imaginea pentru a se potrivi cu promptul, în loc de a fi mai greu.

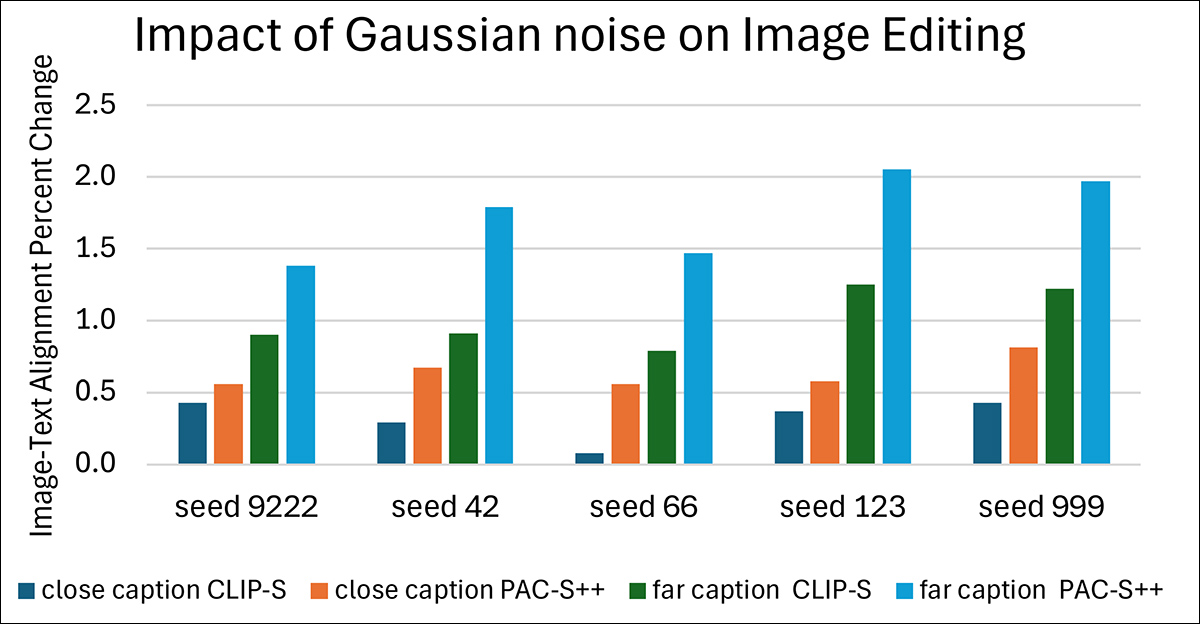

În final, autorii au efectuat un test care a înlocuit perturbațiile create din Lucrarea de ridicare a costului editării de imagine puternică a IA cu zgomot gaussian pur.

Rezultatele au urmat același model observat anterior: pe toate testele, valorile de Schimbare Procentuală au rămas pozitive. Chiar și acest zgomot aleator și nestructurat a condus la o aliniere mai puternică între imaginile generate și prompturile:

Efectul protecției simulate utilizând zgomot gaussian asupra setului de date Flickr8k.

Acest lucru a susținut explicația subiacentă că orice zgomot adăugat, indiferent de design, creează o incertitudine mai mare pentru model în timpul generării, permițând promptului de text să exercite un control și mai mare asupra imaginii finale.

Concluzie

Scena de cercetare a promovat perturbația adversarială la problema drepturilor de autor a LDM de aproape cât timp LDM-urile au existat; dar nu au apărut soluții rezistente din numărul extraordinar de lucrări publicate pe această direcție.

Fie perturbațiile impuse reduc excesiv calitatea imaginii, fie modelele demonstrează că nu sunt rezistente la manipulare și procese transformative.

Cu toate acestea, este un vis greu de abandonat, deoarece alternativa ar părea să fie monitorizarea și cadrele de proveniență ale terților, cum ar fi schema C2PA condusă de Adobe, care își propune să mențină o lanț de custodie pentru imagini de la senzorul camerei, dar care nu are nicio legătură inerentă cu conținutul reprezentat.

În orice caz, dacă perturbația adversarială este, de fapt, înrăutățirea problemei, așa cum indică lucrarea nouă, una se întreabă dacă căutarea protecției drepturilor de autor prin astfel de mijloace cade sub “alchimie”.

Publicat pentru prima dată luni, 9 iunie 2025