Unghiul lui Anderson

Servicii de inferență descentralizate în stil PiedPiper pentru IA?

Este o posibilitate iminentă ‘BitTorrent pentru IA’?

Opinie După ce ieri am terminat de revăzut satira tehnologică distractivă și acidă a lui Mike Judge, Silicon Valley – în care un grup de genii geek socialmente încurcați încearcă să creeze un ‘nou internet’ numit PiedPiper, prin intermediul unei rețele mesh instalate pe telefoanele mobile ale tuturor – am fost interesat să văd comunitatea HN implicată într-o nouă ofertă de aceeași natură.

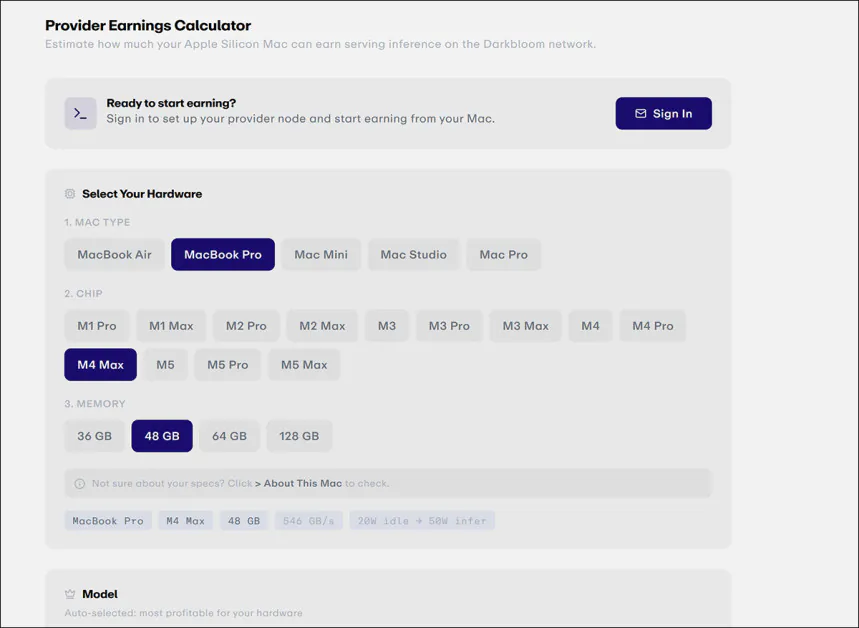

Eigen Labs’ DarkBloom se situează undeva între noțiunea egalitaristă a unei rețele mesh descentralizate pentru inferență IA și motivele de profit din mineritul de criptomonede, permițând proprietarilor de sisteme Mac cu siliciu Apple să-și transforme echipamentele într-un nod de inferență:

Din secțiunea de câștiguri a site-ului DarkBloom, utilizatorii pot selecta care echipamente doresc să le închirieze și care modele de IA doresc să le susțină. Sursă

Sistemul se concentrează în prezent pe modele textuale, cum ar fi Trinity Mini (3B) și Cohere Transcribe, deși oferă și diverse modele generatoare de imagini, cum ar fi FLUX 2 Klein 4B:

Gama de modele din care ‘proprietarul’ poate alege să le închirieze, împreună cu câștigurile lunare estimate.

Utilizatorii care participă la schema pot aparent câștiga suficient de mulți bani într-o lună solidă de furnizare a inferenței pentru a adăuga în mod regulat un nou Mac la o serie în creștere, până când, în teorie, pot câștiga o fermă de inferență deplină.

Eficient, o schemă de acest fel care să câștige cu adevărat popularitate (are o problemă de start rece în acest moment) ar putea pune utilizatorii entuziaști casual înapoi într-o poziție de căutare a hardware-ului, așa cum a fost în ultima mare boom a criptomonedelor (și prăbușirea ulterioară).

Nu atât de repede

Cu toate acestea, pentru micile companii, acea barcă poate fi plecată. Pe lângă nevoia apocaliptică a IA pentru RAM, cererea de echipare a centrelor de date cu IA la nivel global continuă să crească costurile hardware-ului și serviciilor pentru consumatorul obișnuit, care anterior putea să monopolizeze RAM-ul pentru mineritul de criptomonede, datorită naturii periferice a activității, precum și incertitudinii reglementării, care a ținut interesele comerciale circumspecte cu privire la criptomonede.

În timp ce MacBook-ul Neo foarte ieftin a apărut ca o alternativă care bate la cap pentru a escalada hardware-ul, cipul său mobil A18 și 8 GB de VRAM nu îl pun într-o poziție serioasă de a fi o mașină de inferență.

Dar chiar dacă utilizatorul final nu dorește să înceapă o fermă de inferență deplină și doar dorește să închirieze capacitatea sa curentă neutilizată M[n], câștigurile potențiale par semnificative, dacă problema de start rece se rezolvă rapid și dacă platforma începe să se promoveze ca ceva mai mult decât un experiment curios în cererea potențială.

Inferență diferită

Deși o serie de comentatori au recunoscut o democrație de tip PiedPiper/Torrent în schema DarkBloom, sarcinile de inferență nu sunt la fel de ușor de divizat ca fragmentarea unui fișier de film în multiple fragmente hashate, astfel încât să poată fi reasamblat ulterior într-un client de torrent.

Modelul DarkBloom nu propune ca un participant să își utilizeze cipul M[n] pentru a gestiona x% dintr-o sarcină de inferență. În utilizarea curentă, doar o serie limitată de cadre sau metodologii pot realiza acest tip de utilizare transversală a GPU-ului pe o singură sarcină de inferență, inclusiv TensorRT LLM al NVIDIA, care utilizează paralelismul pipeline-ului; și infernța fragmentată a DeepSpeed, care folosește paralelismul modelului (MP).

Mai degrabă, Mac-ul dvs. DarkBloom va descărca și va porni unul dintre modelele enumerate și va efectua 100% din inferența pentru utilizatorii care plătesc, cu criptare de la capăt la capăt și cu promturi decryptate doar pe noduri atestate hardware, ceea ce înseamnă că furnizorii nu vor putea citi datele în timpul executării. Încărcarea în sine ar constitui una sau mai multe inferențe textuale, sau cel puțin o imagine completă.

Nu este clar cât de extinsă ar fi o singură sesiune a utilizatorului; așa cum stau lucrurile, entuziaștii de IA sunt obișnuiți să obțină un GPU prin ferme de inferență, cum ar fi RunPod; deși poate dura ceva timp pentru a obține GPU-ul dorit la utilizarea de vârf, utilizatorul îl poate monopoliza atâta timp cât sesiunea nu este lăsată să expire.

Așadar, este posibil ca un singur utilizator care plătește să ajungă să utilizeze capacitatea de IA a unui singur Mac închiriat DarkBloom pentru o sesiune foarte lungă, cu excepția cazului în care există un avantaj logistic sau de conformitate în schimbarea clienților între solicitări.

Mașinile Mac au fost selectate pentru această abordare, aparent, pentru că există doar un număr limitat de configurații tehnice posibile pentru un participant, și este, prin urmare, ușor să se atribuie modele de dimensiuni adecvate unui client.

În plus, mașinile Mac capabile să contribuie la o rețea DarkBloom au un mediu sigur care garantează un zid între utilizator și furnizor.

Acestea sunt factori care nu sunt atât de ușor de raționalizat pe configurații mai generice, personalizate, și pe sutele sau mii de mașini laptop/desktop Windows și Linux disponibile în ultimii 6-7 ani.

Cu toate acestea, trebuie să fie evident că pool-ul mult mai mare de hardware non-Mac ar putea găzdui o cerere uriașă dacă caracteristicile sale diverse ar putea fi raționalizate, în loc de – așa cum este DarkBloom – a se bază pe seturile de specificații limitate ale Apple, ceea ce face o afacere ușoară și o abordare arhitecturală (presupunând) mult mai ușoară.

Supraveghere juridică?

Poate cea mai mare problemă cu care se confruntă o soluție ‘democratică’ de acest fel este natura închisă a procesului propus; guvernele din întreaga lume sunt în prezent implicate în legislație nouă care ar pune capăt efectiv anonimatului pe internet acolo unde este instituită, și sunt în mod evident nu într-o stare de spirit pro-privacie în această perioadă.

Prin urmare, perspectiva unei inferențe IA arbitrare efectuate fără filtre, verificări sau echilibre, pe o rețea distribuită (dacă putem numi DarkBloom astfel – este mai mult o piață de inferență) pare, ironic, distantă.

Este posibil ca DarkBloom, sau alte scheme de inferență mesh ulterioare, să fie nevoite să accepte portițe care restricționează în mod eficient confidențialitatea la gazdă, care nu va putea vedea sarcinile clienților în curs de executare; în schimb, datele de inferență returnate ar fi puse la dispoziția structurilor de agenție guvernamentală man-in-the-middle (MiTM), menținând toate inferențele auditabile.

Presupunând că valul de noi legi care propun verificări de identitate la nivel de sistem de operare ar putea ajunge vreodată la o adoptare pe scară largă, astfel de măsuri ar putea deveni redundante. Dar fără ele, luând în considerare climatul actual, o rețea de tip DarkBloom ar putea fi considerată similară unei ‘rețele întunecate’ IA, unde activitățile ilegale bazate pe IA ar putea avea loc în secret.

Teste divizate

Până în prezent, au existat surprinzător de puține încercări reale de a face ceea ce implică un sistem ‘în stil PiedPiper’; DarkBloom se situează la o extremă, distribuind sarcini complete către mașini individuale, mai degrabă decât încercând să le fragmenteze pe o rețea, în timp ce cele mai multe sisteme de producție evită în mod simplu problema, păstrând inferența pe un singur gazdă.

Există, cu toate acestea, o mână de proiecte care reprezintă ceva mai apropiat de ‘execuția partajată’.

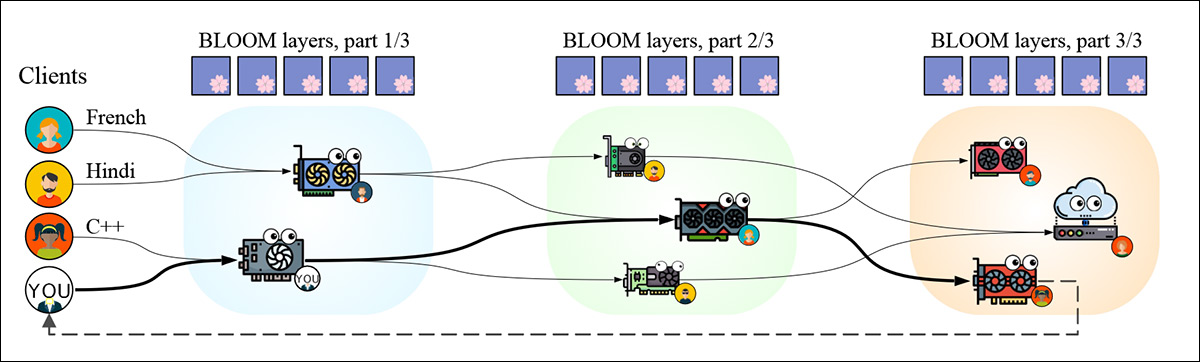

Petals, care se descrie activ ca o rețea ‘în stil BitTorrent’, distribuie blocuri de transformator pe multiple noduri conectate la internet, trecând stări intermediare între ele:

O flux de lucru tipic Petals, în care o singură solicitare de inferență este rutată pe multiple noduri GPU remote, fiecare conținând un subset de straturi de model; în contrast cu DarkBloom, execuția este fragmentată pe rețea, cu stări intermediare transmise între noduri operate independent, crește latența și expunerea la fiecare salt, aproximând un sistem de tip mesh adevărat. Sursă

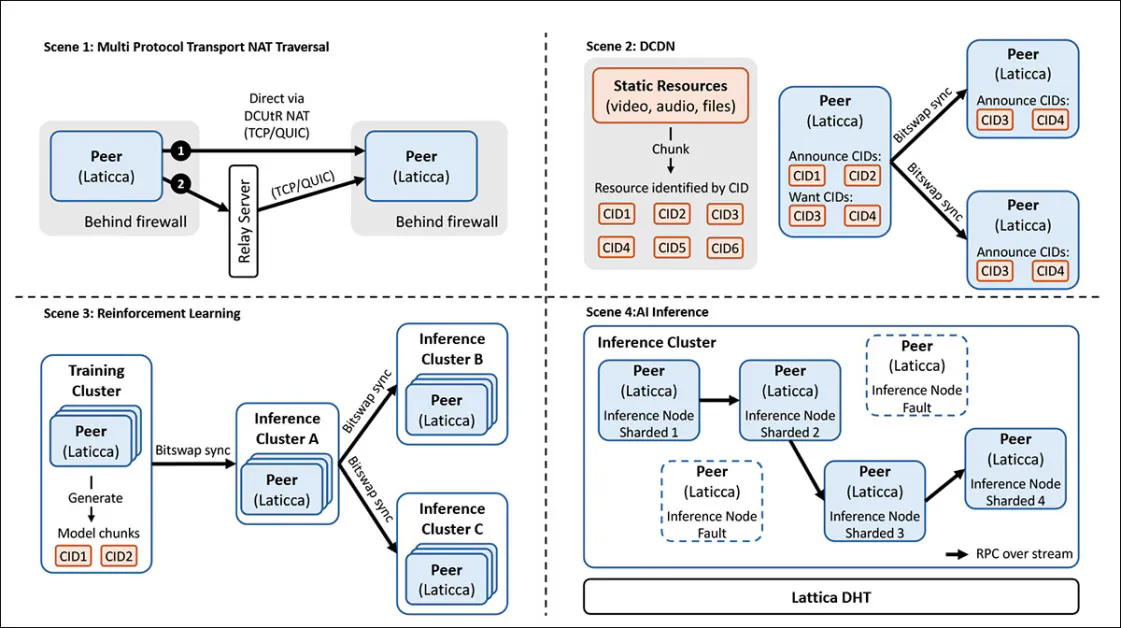

Hivemind experimentează cu coordonarea peer-to-peer și rutarea expert, deși în serviciul antrenării modelelor și nu al inferenței de la modele deja antrenate; și Lattica se concentrează pe stratul de rețea subiacent necesar pentru a face astfel de sisteme viabile:

O schemă a Lattica, arătând un substrat peer-to-peer de nivel inferior care gestionează traversarea NAT, distribuția de conținut și coordonarea bazată pe DHT; inferența fragmentată apare doar ca o posibilă aplicație, în timp ce Lattica nu definește în sine un sistem de inferență, ci oferă primitivele de rețea și sincronizare necesare pentru a construi unul. Sursă –

Toate aceste modele se apropie de idealul de rețea mesh, dar la costul latenței, instabilității și expunerii.

În schimb, exo păstrează inferența într-un cluster local, utilizând interconectări rapide pentru a divide sarcinile de lucru pe multiple GPU-uri, fără a se baza pe internetul public. În practică, un astfel de setup se comportă mai mult ca o mașină extinsă unică și nu ca o rețea distribuită, deși există posibilitatea clară de a extinde această abordare pe o rețea mai largă:

O vedere de cluster din exo, arătând un inel mic de mașini Apple Silicon locale care găzduiesc împreună un singur model, cu pipeline sau fragmentare tensor distribuind straturi pe noduri; în contrast cu sistemele WAN, exo se bazează pe interconectări locale rapide, transformând în mod eficient multiple dispozitive într-o mașină compozită de inferență. Sursă

În cele din urmă, mai multe abordări des citate nu abordează deloc inferența: venerabila (2016) FedAvg a Google; SplitNN a MIT din 2018; și oferta australiană din 2020 SplitFed, se ocupă de distribuirea antrenării sau de schimbul de date care protejează confidențialitatea, și nu de servirea solicitărilor de inferență live.

Deoarece antrenarea este o perspectivă mult mai intensivă din punct de vedere al resurselor decât inferența, orice rețele care pot distribui astfel de sarcini în mod eficient, pe cluster sau noduri, ar putea avea un interes disproporționat din partea entuziaștilor și a afacerilor în viitor.

Concluzie

Deoarece o mare parte din tehnologia din Silicon Valley a fost o invenție sălbatică, nu știm dacă PiedPiper a fost cu adevărat condus de hash (adică, împărțind și distribuind date în fragmente, în stil torrent) sau dacă a ‘stabilit’ o sarcină sau o sesiune pe orice nod la orice moment, ceea ce face DarkBloom.

Cu toate acestea, agitația actuală de a furniza hardware de antrenare și inferență la nivelul centrelor de date indică faptul că sectorul de furnizare se așteaptă fie să deservească pe toată lumea, în stil RunPod, fie se pregătește pentru cel mai profitabil nivel de furnizare la nivel de întreprindere – o perspectivă tentantă subminată de lipsa generală de brazde în implementarea IA.

Dacă inferența mesh devine o realitate, este rezonabil să ne așteptăm ca printre primele încercări de a o valorifica vor fi cele ale jucătorilor already existenți, cum ar fi OpenAI și Anthropic, care ar putea fie să implementeze sisteme dedicate într-o bază de aplicații existentă masivă, fie să colaboreze la sisteme open source care sunt ușor de instalat (deoarece companiile de această dimensiune și rază au banii și motivația de a simplifica instalațiile dificile de acest tip).

În ceea ce privește posibilitatea ca o rețea mesh mai democratică, condusă de utilizatori, să apară, o adevărată echivalentă IA a BitTorrent – o serie de factori sunt împotriva ei.

Mai întâi, actuala mișcare globală împotriva criptării și anonimatului ar putea elimina sau submina multe dintre mecanismele care fac sistemele precum BitTorrent anonime, cum ar fi criptarea de la capăt la capăt și VPN-urile. Odată ce fluxurile criptate ‘generice’ care ascund astfel de protocoale sunt deschise pentru inspectare, noi straturi de supraveghere și interdicție devin posibile, și acest lucru ar putea submina atracția unui sistem de tip DarkBloom.

În al doilea rând, reglementările emergente sau propuse împotriva ‘abuzului’ de IA, sau împotriva operațiunii anonime a cadrului open source, înseamnă că costul conformității – nesemnificativ la nivel de întreprindere – ar putea, probabil, să scoată jucătorii mai mici de pe piață.

În cele din urmă – puterea unui jucător major din sector de a îmbrățișa, extinde și stinge (EEE, așa cum au făcut Facebook și Twitter, probabil, cu comunitățile internetului mai ad hoc) înseamnă că jucătorii actuali majori pot operaționaliza și simplifica modelul mesh în avantajul lor, într-o piață în care utilizatorii finali sunt aproape în totalitate intoleranți la orice frecare în adoptare.

Publicat pentru prima dată joi, 16 aprilie 2026