Inteligență artificială

Abilitățile noastre subconștiente de detectare a deepfake-urilor ar putea alimenta sistemele automate viitoare

O nouă cercetare din Australia sugerează că creierul nostru este priceput în a recunoaște deepfake-uri sofisticate, chiar și atunci când conștient credem că imaginile pe care le vedem sunt reale.

Rezultatul sugerează, de asemenea, posibilitatea de a utiliza răspunsurile neuronale ale oamenilor la fețe deepfake (în loc de opinia lor declarată) pentru a antrena sisteme automate de detectare a deepfake-urilor. Astfel de sisteme ar fi antrenate pe caracteristicile deepfake ale imaginilor, nu pe estimările confuze ale plauzibilității, ci pe mecanismele noastre instinctive de recunoaștere a identității faciale.

‘[A]lthough creierul poate „recunoaște” diferența dintre fețe reale și fețe realiste, observatorii nu pot să le distingă conștient. Rezultatele noastre privind disocierea dintre răspunsul creierului și comportament au implicații pentru modul în care studiem percepția fețelor false, întrebările pe care le punem atunci când cerem identificarea imaginilor false și modalitățile posibile în care putem stabili standarde de protecție împotriva abuzului de imagini false.’

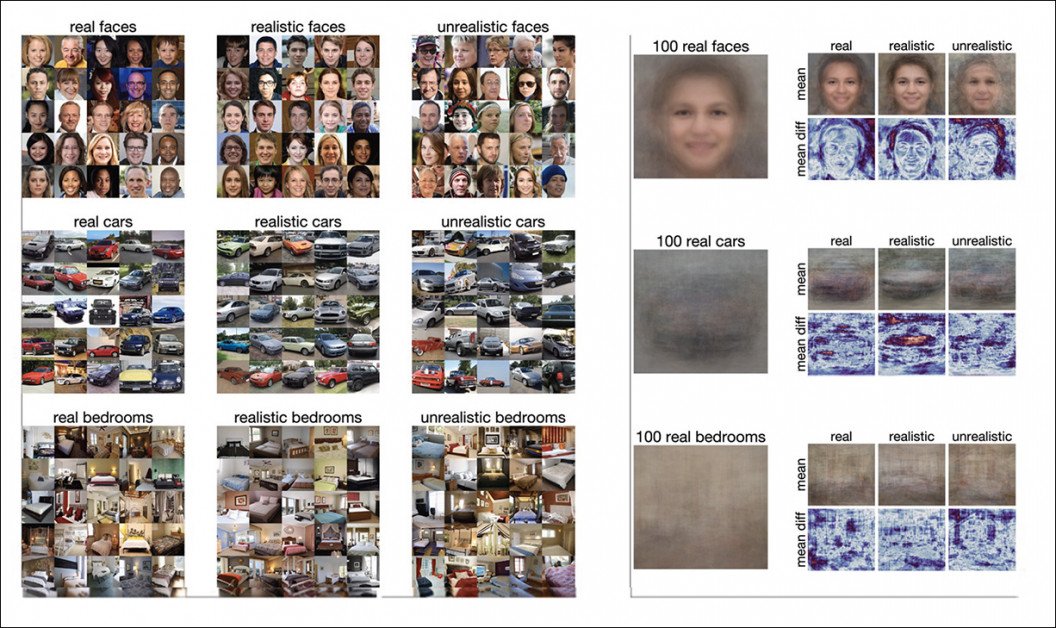

Rezultatele au apărut în urma unor teste concepute pentru a evalua modul în care oamenii răspund la imagini false, inclusiv imagini cu fețe evident false, mașini, spații interioare și fețe răsturnate (adică cu susul în jos).

Various iterations and approaches for the experiments, which involved two groups of test subjects needing to classify a briefly-shown image as ‘fake’ or ‘real’. The first round took place on Amazon Mechanical Turk, with 200 volunteers, while the second round involved a smaller number of volunteers responding to the tests while hooked up to EEG machines. Source: https://tijl.github.io/tijl-grootswagers-pdf/Moshel_et_al_-_2022_-_Are_you_for_real_Decoding_realistic_AI-generated_.pdf

Articolul afirmă:

‘Rezultatele noastre demonstrează că, având în vedere doar o scurtă privire, observatorii pot să identifice fețe false. Cu toate acestea, ei au mai multă dificultate în a distinge fețele reale de cele false și, în unele cazuri, au crezut că fețele false sunt mai reale decât fețele reale.

‘Cu toate acestea, utilizând EEG în timp real și metode de clasificare multivariată, am descoperit că a fost posibil să decodăm atât fețele nerealiste, cât și pe cele realiste, de la fețele reale, utilizând activitatea creierului.

‘Această disociere între comportament și răspunsurile neuronale pentru fețele realiste oferă dovezi importante noi despre percepția fețelor false, precum și implicații referitoare la clasa din ce în ce mai realistă a fețelor generate de GAN.’

Articolul sugerează că noua lucrare are ‘mai multe implicații’ în securitatea cibernetică aplicată și că dezvoltarea clasificatorilor de învățare a deepfake-urilor ar trebui să fie condusă de răspunsurile subconștiente, așa cum sunt măsurate pe EEG în răspuns la imagini false, și nu de estimarea conștientă a autenticității unei imagini.

Autorii comentă:

‘Acest lucru este asemănător cu descoperirile că indivizii cu prosopagnosie care nu pot să clasifice sau să recunoască fețele ca fiind familiare sau nefamiliare, totuși, afișează răspunsuri autonome mai puternice la fețele familiare decât la fețele nefamiliare.

‘La fel, ceea ce am demonstrat în acest studiu este că, deși am putut decoda cu acuratețe diferența dintre fețele reale și cele realiste din activitatea neurală, acea diferență nu a fost vizibilă comportamental. În schimb, observatorii au identificat greșit 69% din fețele reale ca fiind false.’

Noua lucrare se intitulează Sunteți reali? Decodarea fețelor generate de AI din activitatea neurală și provine de la patru cercetători de la Universitatea din Sydney, Universitatea Macquarie, Universitatea Western Sydney și Universitatea din Queensland.

Date

Rezultatele au apărut în urma unei examinări mai ample a capacității umane de a distinge imagini evident false, hiper-reale (dar totuși false) și reale, desfășurate în două runde de testare.

Cercetătorii au utilizat imagini create de Generative Adversarial Networks (GANs), împărtășite de NVIDIA.

GAN-generated human face images made available by NVIDIA. Source: https://drive.google.com/drive/folders/1EDYEYR3IB71-5BbTARQkhg73leVB9tam

Datele au cuprins 25 de fețe, mașini și dormitoare, la niveluri de rendering care variază de la ‘nerealist’ la ‘realist’. Pentru comparația fețelor (adică pentru materialul non-fals adecvat), autorii au utilizat selecții din datele sursă ale setului de date Flickr-Faces-HQ (FFHQ) al lui NVIDIA. Pentru comparația celorlalte scenarii, au utilizat material din setul de date LSUN.

Imaginile au fost prezentate subiecților de test fie cu susul în jos, fie cu susul în sus, și la o varietate de frecvențe, cu toate imaginile redimensionate la 256×256 pixeli.

După ce toate materialele au fost asamblate, au fost curate 450 de imagini de test.

Teste

Testele în sine au fost efectuate inițial online, prin jsPsych pe pavlovia.org, cu 200 de participanți care au evaluat diverse subansambluri ale datelor de test total gatherate. Imaginile au fost prezentate timp de 200ms, urmate de un ecran gol care a persistat până când privitorul a făcut o decizie cu privire la faptul că imaginea afișată era falsă sau reală. Fiecare imagine a fost prezentată doar o dată, iar întregul test a durat 3-5 minute.

A doua rundă, mai revelatoare, a utilizat subiecți în persoană, echipați cu monitoare EEG, și a fost prezentată pe platforma Psychopy2. Fiecare dintre cele douăzeci de secvențe a conținut 40 de imagini, cu 18.000 de imagini prezentate în întregul set de date de test.

Datele EEG colectate au fost decodate prin MATLAB cu cutia de instrumente CoSMoMVPA, utilizând un scheme de validare încrucișată leave-one-out sub Analiza Discriminantă Lineară (LDA).

Clasificatorul LDA a fost componenta care a putut face distincția dintre reacția creierului la stimuli falși și opinia subiectului cu privire la faptul că imaginea era falsă.

Rezultate

Interesați să vadă dacă subiecții de test EEG pot să distingă fețele false de cele reale, cercetătorii au agregat și procesat rezultatele, constatând că participanții au putut să distingă fețele reale de cele nerealiste cu ușurință, dar au avut dificultăți în a identifica fețele false realiste, generate de GAN. Faptul că imaginea era cu susul în jos sau în sus părea să nu aibă o mare importanță.

Behavioral discrimination of real and synthetically-generated faces, in the second round.

Cu toate acestea, datele EEG au spus o altă poveste.

Articolul afirmă:

‘Deși observatorii au avut dificultăți în a distinge fețele reale de cele false și au tendința de a supraclasifica fețele false, datele EEG conțin informații semnificative referitoare la această distincție, care diferă semnificativ între fețele realiste și nerealiste, și acest semnal pare să fie limitat la o etapă relativ scurtă de procesare.’

Here the disparity between EEG accuracy and the reported opinion of the subjects (i.e. as to whether or not the face images were fake) are not identical, with the EEG captures getting nearer to the truth than the manifest perception of the people involved.

Cercetătorii concluzionează că, deși observatorii pot avea dificultăți în a identifica tacit fețele false, aceste fețe au ‘reprezentări distincte în sistemul vizual uman’.

Diferența găsită i-a determinat pe cercetători să speculeze cu privire la posibila aplicabilitate a descoperirilor lor pentru mecanisme de securitate viitoare:

‘Într-un context aplicat, cum ar fi securitatea cibernetică sau deepfake-urile, examinarea capacității de detectare a fețelor realiste ar putea fi urmărită cel mai bine utilizând clasificatori de învățare automată aplicați la datele de neuroimagine, mai degrabă decât îndreptându-se spre performanța comportamentală.’

Ei concluzionează:

‘Înțelegerea disociării dintre creier și comportament pentru detectarea fețelor false va avea implicații practice pentru modul în care abordăm răspândirea potențial dăunătoare și universală a informațiilor generate artificial.’

* Conversia mea a citărilor inline în legături.

Publicat pentru prima dată pe 11 iulie 2022.