Inteligență artificială

Mistral AI: Setează noi repere în spațiul open-source, dincolo de Llama2

Modelele de limbaj mari (LLM) au intrat recent în centrul atenției, datorită unor performeri deosebiți precum ChatGPT. Când Meta a introdus modelele Llama, a reapărut interesul pentru LLM-urile open-source. Scopul? A crea LLM-uri open-source accesibile, la fel de bune ca modelele de top, cum ar fi GPT-4, dar fără prețul ridicat sau complexitatea acestora.

Această combinație de accesibilitate și eficiență nu numai că a deschis noi oportunități pentru cercetători și dezvoltatori, dar a și pregătit scena pentru o nouă eră de progrese tehnologice în procesarea limbajului natural.

Recent, startup-urile de inteligență artificială generativă au atras fonduri. Împreună, au strâns 20 de milioane de dolari, cu scopul de a modela inteligența artificială open-source. Anthropic a strâns, de asemenea, o sumă impresionantă de 450 de milioane de dolari, iar Cohere, în parteneriat cu Google Cloud, a obținut 270 de milioane de dolari în luna iunie a acestui an.

Introducere în Mistral 7B: Dimensiune și disponibilitate

Mistral AI, cu sediul în Paris și fondat de foști angajați ai Google DeepMind și Meta, a anunțat primul său model de limbaj mare: Mistral 7B. Acest model poate fi descărcat cu ușurință de oricine de pe GitHub și chiar prin intermediul unui torrent de 13,4 gigabiți.

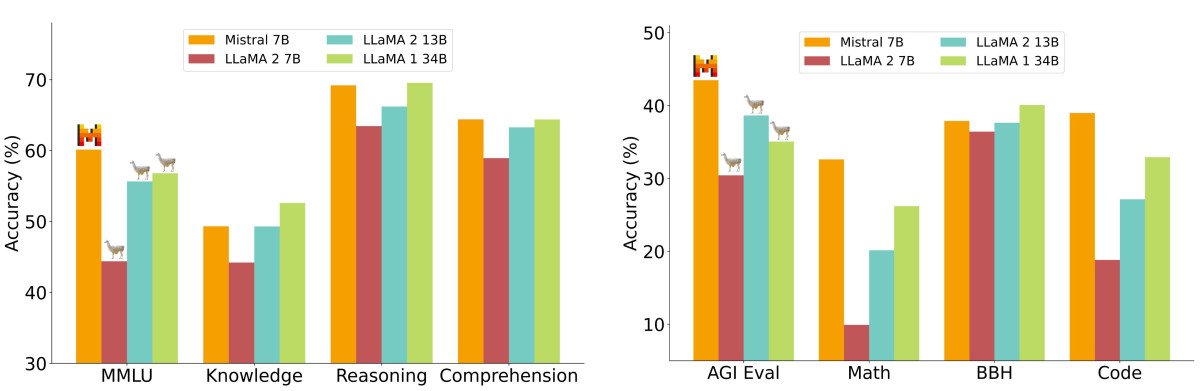

Acest startup a reușit să obțină finanțare record înainte de lansarea produsului. Primul model Mistral, cu 7 miliarde de parametri, depășește performanța modelului Llama 2 13B în toate testele și o întrece pe Llama 1 34B în multe metrici.

În comparație cu alte modele, cum ar fi Llama 2, Mistral 7B oferă capacități similare sau mai bune, dar cu o sarcină computațională mai mică. În timp ce modelele fundamentale, cum ar fi GPT-4, pot realiza mai mult, ele vin la un preț mai ridicat și nu sunt la fel de ușor de utilizat, deoarece sunt accesibile în principal prin API-uri.

Când vine vorba de sarcini de codare, Mistral 7B oferă o performanță similară cu CodeLlama 7B. În plus, este suficient de compact la 13,4 GB pentru a rula pe mașini standard.

De asemenea, Mistral 7B Instruct, reglat special pentru seturi de date instructive pe Hugging Face, a arătat o performanță remarcabilă. Acesta depășește alte modele de 7B pe MT-Bench și stă pe picior de egalitate cu modelele de chat de 13B.

Hugging Face Mistral 7B Exemplu

Testarea performanței

Într-o analiză detaliată a performanței, Mistral 7B a fost măsurat împotriva modelelor Llama 2. Rezultatele au fost clare: Mistral 7B a depășit semnificativ Llama 2 13B în toate testele. De fapt, a egalat performanța Llama 34B, în special în testele de cod și raționament.

Testele au fost organizate în mai multe categorii, cum ar fi Raționamentul comun, Cunoașterea lumii, Înțelegerea citirii, Matematică și Cod, printre altele. O observație deosebit de remarcabilă a fost metrica de performanță a costului, denumită “dimensiuni echivalente ale modelului”. În domenii precum raționamentul și înțelegerea, Mistral 7B a demonstrat o performanță similară cu un model Llama 2 de trei ori mai mare, ceea ce semnifică economii potențiale de memorie și o creștere a debitului. Cu toate acestea, în testele de cunoaștere, Mistral 7B s-a aliniat îndeaproape cu Llama 2 13B, ceea ce se datorează probabil limitărilor parametrilor care afectează comprimarea cunoașterii.

Ce face modelul Mistral 7B mai bun decât majoritatea celorlalte modele de limbaj?

Simplificarea mecanismelor de atenție

În timp ce subtilitățile mecanismelor de atenție sunt tehnice, ideea lor fundamentală este relativ simplă. Imaginați-vă citind o carte și evidențiind propoziții importante; acesta este analogul modului în care mecanismele de atenție “evidențiază” sau acordă importanță anumitor puncte de date într-o secvență.

În contextul modelelor de limbaj, aceste mecanisme permit modelului să se concentreze asupra părților cele mai relevante ale datelor de intrare, asigurând că ieșirea este coerentă și contextualmente precisă.

În transformatorii standard, scorurile de atenție sunt calculate cu formula:

Formula pentru aceste scoruri implică un pas crucial – înmulțirea matricelor Q și K. Provocarea aici este că, pe măsură ce lungimea secvenței crește, ambele matrice se extind în mod corespunzător, ducând la un proces computațional intensiv. Această problemă de scalabilitate este una dintre principalele motive pentru care transformatorii standard pot fi lenti, în special atunci când se lucrează cu secvențe lungi.

Atenția multi-întrebare (MQA) accelerează lucrurile prin utilizarea unui singur set de “capete cheie-valoare”, dar uneori sacrifică calitatea. Acum, vă puteți întreba, de ce nu combinați viteza MQA cu calitatea atenției multi-capete? Acesta este punctul în care intervine atenția grupată (GQA).

Atenția grupată (GQA)

GQA este o soluție de compromis. În loc să utilizați un singur set de “capete cheie-valoare” sau multiple, GQA le grupează. Acest mod, GQA realizează o performanță aproape de atenția multi-capete detaliată, dar cu viteza MQA. Pentru modele precum Mistral, acest lucru înseamnă o performanță eficientă fără a compromite prea mult calitatea.

Atenția ferestrei alunecătoare (SWA)

Fereastra alunecătoare este o altă metodă utilizată în procesarea secvențelor de atenție. Această metodă utilizează o fereastră de atenție de dimensiune fixă în jurul fiecărui token din secvență. Cu straturi multiple care stivuiesc această atenție ferestrală, straturile superioare capătă în cele din urmă o perspectivă mai largă, cuprinzând informații din întreaga intrare. Acest mecanism este analog receptivității câmpurilor din Rețelele Neurale Convolutive (CNN).

Pe de altă parte, “fereastra alunecătoare dilatată” a modelului Longformer, care este conceptual similar cu metoda ferestrei alunecătoare, calculează doar câteva diagonale ale matricei . Acest lucru duce la o creștere a utilizării memoriei care crește liniar, în loc de o creștere pătratică, făcând-o o metodă mai eficientă pentru secvențe lungi.

Transparența Mistral AI versus preocupările de securitate în descentralizare

În anunțul lor, Mistral AI a subliniat, de asemenea, transparența prin declarația: “Fără trucuri, fără date proprietare.” Însă, singurul model disponibil în acest moment, ‘Mistral-7B-v0.1’, este un model de bază preantrenat, deci poate genera o răspuns la orice întrebare fără moderare, ceea ce ridică preocupări potențiale de securitate. În timp ce modele precum GPT și Llama au mecanisme pentru a discerne când să răspundă, natura descentralizată a Mistral ar putea fi exploatată de actori răi.

Cu toate acestea, descentralizarea Modelelor de Limbaj Mare are meritele sale. În timp ce unii ar putea abuza de ea, oamenii pot valorifica puterea sa pentru binele societății și pentru a face inteligența accesibilă tuturor.

Flexibilitatea implementării

Unul dintre punctele forte este că Mistral 7B este disponibil sub licența Apache 2.0. Acest lucru înseamnă că nu există bariere reale în utilizarea sa – indiferent dacă îl utilizați pentru scopuri personale, o corporație uriașă sau chiar o entitate guvernamentală. Aveți nevoie doar de sistemul potrivit pentru a-l rula sau ar trebui să investiți în resurse cloud.

În timp ce există și alte licențe, cum ar fi licența MIT mai simplă și licența CC BY-SA-4.0 cooperativă, care impune creditarea și licențierea similară pentru derivate, Apache 2.0 oferă o bază solidă pentru proiecte de anvergură.

Gânduri finale

Ascensiunea Modelelor de Limbaj Mare open-source, cum ar fi Mistral 7B, semnifică o schimbare semnificativă în industria inteligenței artificiale, făcând modelele de limbaj de înaltă calitate accesibile unui public mai larg. Abordările inovatoare ale Mistral AI, cum ar fi atenția grupată și atenția ferestrei alunecătoare, promit o performanță eficientă fără a compromite calitatea.

În timp ce natura descentralizată a Mistral ridică anumite provocări, flexibilitatea și licențierea open-source subliniază potențialul de democratizare a inteligenței artificiale. Pe măsură ce peisajul evoluează, accentul va fi, inevitabil, pe echilibrarea puterii acestor modele cu considerații etice și mecanisme de securitate.

Următorul pas pentru Mistral? Modelul de 7B a fost doar începutul. Echipa își propune să lanseze modele și mai mari în curând. Dacă aceste noi modele vor egala performanța modelului de 7B, Mistral ar putea deveni rapid un jucător de top în industrie, toate acestea în primul an.