Unghiul lui Anderson

În căutarea pentru ‘Bufnițe și Șopârle’ în Publicul Unui Anunțător

Deoarece sectorul publicității online este estimat să fi cheltuit 740,3 miliarde USD în 2023, este ușor de înțeles de ce companiile de publicitate investesc resurse considerabile în acest domeniu specific de cercetare a viziunii computaționale.

Deși este insular și protector, industria publică ocazional studii care sugerează lucrări avansate de recunoaștere facială și de direcție a privirii – inclusiv recunoașterea vârstei, esențială pentru statistici demografice:

Estimarea vârstei într-un context de publicitate în sălbăticie este de interes pentru anunțători care pot ținti o anumită demografie. În acest exemplu experimental de estimare automată a vârstei faciale, vârsta interpretului Bob Dylan este urmărită de-a lungul anilor. Sursă: https://arxiv.org/pdf/1906.03625

Aceste studii, care rareori apar în depozite publice precum Arxiv, folosesc participanți recrutați legitim ca bază pentru analiza condusă de IA care urmărește să determine în ce măsură și în ce mod, spectatorul se angajează cu un anunț.

Dlib’s Histogram of Oriented Gradients (HoG) este adesea utilizat în sistemele de estimare facială. Sursă: https://www.computer.org/csdl/journal/ta/2017/02/07475863/13rRUNvyarN

Instinct Animal

În acest sens, firesc, industria publicității este interesată de determinarea falselor pozitive (ocaziile în care un sistem analitic interpretează greșit acțiunile unui subiect) și de stabilirea unor criterii clare pentru momentul în care persoana care urmărește reclamele lor nu este pe deplin implicată în conținut.

În ceea ce privește publicitatea bazată pe ecran, studiile tind să se concentreze pe două probleme în două medii. Mediile sunt ‘desktop’ sau ‘mobile’, fiecare având caracteristici particulare care necesită soluții de urmărire personalizate; și problemele – din perspectiva anunțătorului – sunt reprezentate de comportamentul de bufniță și șopârlă – tendința spectatorilor de a nu acorda atenție deplină unui anunț care se află în fața lor.

Exemple de comportament de ‘bufniță’ și ‘șopârlă’ într-un subiect al unui proiect de cercetare a publicității. Sursă: https://arxiv.org/pdf/1508.04028

Dacă te uiți departe de anunțul intenționat cu capul tău, acesta este ‘comportament de bufniță’; dacă poza capului tău este statică, dar ochii tăi se îndepărtează de ecran, acesta este ‘comportament de șopârlă’. În ceea ce privește analitica și testarea noilor anunțuri în condiții controlate, acestea sunt acțiuni esențiale pentru ca un sistem să le poată capta.

Un nou articol de la SmartEye’s Affectiva adresează aceste probleme, oferind o arhitectură care folosește mai multe cadre existente pentru a oferi un set de caracteristici combinat și concatenat pe toate condițiile și reacțiile posibile – și pentru a putea determina dacă un spectator este plictisit, implicat sau în vreun fel distant de conținutul pe care anunțătorul îl dorește să îl vadă.

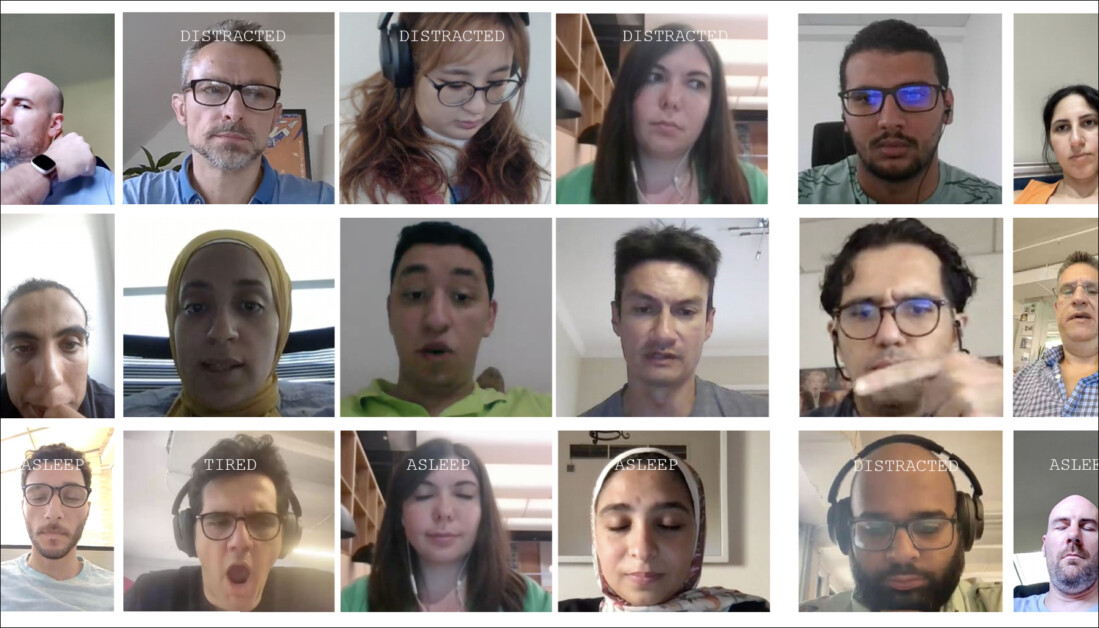

Exemple de true și false pozitive detectate de noul sistem de atenție pentru diverse semnale de distragere, prezentate separat pentru dispozitive desktop și mobile. Sursă: https://arxiv.org/pdf/2504.06237

Autorii afirmă*:

‘Cercetarea limitată a pătruns în monitorizarea atenției în timpul anunțurilor online. În timp ce aceste studii s-au concentrat pe estimarea pozei capului sau a direcției privirii pentru a identifica instanțe de privire îndepărtată, ele neglijează parametrii critici precum tipul de dispozitiv (desktop sau mobil), poziționarea camerei față de ecran și mărimea ecranului. Aceste factori influențează semnificativ detectarea atenției.

‘În acest articol, propunem o arhitectură pentru detectarea atenției care cuprinde detectarea diverselor distractori, inclusiv comportamentul de bufniță și șopârlă de a privi în afara ecranului, vorbirea, somnolența (prin căscat și închiderea prelungită a ochilor) și părăsirea ecranului neluat în seamă.

‘În contrast cu abordările anterioare, metoda noastră integrează caracteristici specifice dispozitivului, cum ar fi tipul de dispozitiv, poziționarea camerei, mărimea ecranului (pentru dispozitive desktop) și orientarea camerei (pentru dispozitive mobile) cu estimarea brută a privirii pentru a îmbunătăți acuratețea detectării atenției.’

Noul lucru se intitulează Monitorizarea atenției spectatorului în timpul anunțurilor online și provine de la patru cercetători de la Affectiva.

Metodă și Date

În mare parte din cauza secretului și naturii închise a unor astfel de sisteme, noul articol nu compară abordarea autorilor direct cu rivalii, ci prezintă doar rezultatele sale ca studii de ablație; nici articolul nu respectă în general formatul obișnuit al literaturii de viziune computerizată. Prin urmare, vom examina cercetarea așa cum este prezentată.

Autorii subliniază că doar un număr limitat de studii au abordat detectarea atenției în special în contextul anunțurilor online. În AFFDEX SDK, care oferă recunoaștere facială în timp real, atenția este inferată doar din poza capului, cu participanți etichetați ca fiind neatenți dacă unghiul capului lor trece un prag definit.

Un exemplu din AFFDEX SDK, un sistem Affectiva care se bazează pe poza capului ca indicator al atenției. Sursă: https://www.youtube.com/watch?v=c2CWb5jHmbY

În colaborarea din 2019 Măsurarea automată a atenției vizuale pentru conținut video utilizând învățarea profundă, un set de date de aproximativ 28.000 de participanți a fost etichetat pentru diverse comportamente neatenționate, inclusiv privirea în afara, închiderea ochilor sau implicarea în activități neconexe, și un model CNN-LSTM a fost antrenat pentru a detecta atenția din aparența facială în timp.

Din articolul din 2019, un exemplu care ilustrează stările de atenție prezise pentru un spectator care urmărește conținut video. Sursă: https://www.jeffcohn.net/wp-content/uploads/2019/07/Attention-13.pdf.pdf

Cu toate acestea, autorii observă că aceste eforturi anterioare nu au ținut cont de factorii specifici dispozitivului, cum ar fi faptul că participantul utiliza un dispozitiv desktop sau mobil; nici nu au luat în considerare mărimea ecranului sau poziționarea camerei. În plus, sistemul AFFDEX se concentrează doar pe identificarea devierii privirii și omite alte surse de distragere, în timp ce lucrarea din 2019 încearcă să detecteze un set mai larg de comportamente – dar utilizarea unei singure rețele neuronale convolutive (CNN) superficiale poate, conform articolului, să fi fost inadecvată pentru această sarcină.

Autorii observă că unele dintre cele mai populare cercetări în această direcție nu sunt optimizate pentru testarea anunțurilor, care are nevoi diferite în comparație cu domenii precum conducerea sau educația – unde poziționarea și calibrarea camerei sunt de obicei fixate în prealabil, în loc să se bazeze pe configurații necalibrate și să funcționeze în intervalul limitat de privire al dispozitivelor desktop și mobile.

Prin urmare, ei au conceput o arhitectură pentru detectarea atenției spectatorului în timpul anunțurilor online, folosind două kit-uri comerciale: AFFDEX 2.0 și SmartEye SDK.

Exemple de analiză facială din AFFDEX 2.0. Sursă: https://arxiv.org/pdf/2202.12059

Aceste lucrări anterioare extrag caracteristici de nivel scăzut, cum ar fi expresiile faciale; poza capului; și direcția privirii – extrase prin intermediul kit-urilor menționate anterior, AFFDEX 2.0 și SmartEye SDK.

Acestea sunt apoi procesate pentru a produce indicatori de nivel superior, cu fiecare distractor tratat de un clasificator binar separat, antrenat pe propriul set de date pentru optimizare și evaluare independentă.

Schema pentru sistemul de monitorizare propus.

Seturi de Date: Privire

Autorii au utilizat patru seturi de date pentru a alimenta și evalua sistemul de detectare a atenției: trei care se concentrează individual pe comportamentul de privire, vorbire și căscat; și un al patrulea extras din sesiuni reale de testare a anunțurilor, conținând o mixtură de tipuri de distragere.

Datorită cerințelor specifice ale lucrării, seturi de date personalizate au fost create pentru fiecare dintre aceste categorii. Toate seturile de date curate au fost sursate dintr-un depozit propriu care conține milioane de sesiuni înregistrate de participanți care urmăresc anunțuri în medii de acasă sau de la locul de muncă, utilizând o configurație web, cu consimțământ informat – și datorită limitărilor acordurilor de consimțământ, autorii afirmă că seturile de date pentru noul studiu nu pot fi făcute publice.

Pentru a construi setul de date privire, participanții au fost rugați să urmărească un punct care se mișcă pe diverse puncte ale ecranului, inclusiv muchiile sale, și apoi să se uite departe de ecran în patru direcții (sus, jos, stânga și dreapta) cu secvența repetată de trei ori. În acest fel, a fost stabilită relația dintre captură și acoperire:

Capturi de ecran care arată stimulul video al privirii pe dispozitive desktop și mobile. Primele și al treilea cadre afișează instrucțiuni pentru a urmări un punct care se mișcă, în timp ce al doilea și al patrulea îi îndeamnă pe participanți să se uite departe de ecran.

Segmentele cu punctul care se mișcă au fost etichetate ca atenți, iar segmentele din afara ecranului au fost etichetate ca neatenți, producând un set de date etichetat cu exemple atât pozitive, cât și negative.

Fiecare videoclip a durat aproximativ 160 de secunde, cu versiuni separate create pentru platformele desktop și mobile, fiecare cu rezoluții de 1920×1080 și 608×1080, respectiv.

Un total de 609 videoclipuri au fost colectate, cuprinzând 322 de înregistrări desktop și 287 de înregistrări mobile. Etichetele au fost aplicate automat pe baza conținutului video, iar setul de date împărțit în 158 de exemple de antrenament și 451 pentru testare.

Seturi de Date: Vorbire

În acest context, unul dintre criteriile care definesc ‘neatenția’ este atunci când o persoană vorbește mai mult de o secundă (care ar putea fi un comentariu momentan sau chiar o tuse).

Deoarece mediul controlat nu înregistrează sau analizează audio, vorbirea este inferată prin observarea mișcării interne a reperelelor faciale estimate. Prin urmare, pentru a detecta vorbirea fără audio, autorii au creat un set de date bazat în întregime pe intrări vizuale, extras din depozitul lor intern, și împărțit în două părți: prima conținea aproximativ 5.500 de videoclipuri, fiecare etichetat manual de trei annotatori ca vorbire sau non-vorbire (dintre acestea, 4.400 au fost utilizate pentru antrenament și validare, și 1.100 pentru testare).

A doua parte a constituit 16.000 de sesiuni etichetate automat pe baza tipului de sesiune: 10.500 au prezentat participanți care urmăreau anunțuri în tăcere, și 5.500 au arătat participanți care își exprimau opinii despre mărci.

Seturi de Date: Căscat

Deși există seturi de date de căscat, cum ar fi YawDD și Driver Fatigue, autorii afirmă că niciunul dintre ele nu este potrivit pentru scenarii de testare a anunțurilor, deoarece fie conțin căscat simulat, fie conțin contorsionări faciale care ar putea fi confundate cu frică sau alte acțiuni non-căscat.

Prin urmare, autorii au utilizat 735 de videoclipuri din colecția lor internă, selectând sesiuni care conțineau probabil o căscare care dura mai mult de o secundă. Fiecare videoclip a fost etichetat manual de trei annotatori ca activ sau inactiv căscat. Doar 2,6% din cadre conțineau căscat activ, subliniind dezechilibrul clasei, iar setul de date a fost împărțit în 670 de videoclipuri de antrenament și 65 pentru testare.

Seturi de Date: Distragere

Setul de date distragere a fost extras, de asemenea, din depozitul autorilor de testare a anunțurilor, unde participanții au vizualizat anunțuri reale fără sarcini atribuite. Un total de 520 de sesiuni (193 pe mobile și 327 pe desktop) au fost selectate aleator și etichetate manual de trei annotatori ca atenți sau neatenți.

Comportamentul neatenționat a inclus privirea în afara ecranului, vorbirea, somnolența și ecranul neluat în seamă. Sesiunile acoperă regiuni diverse din întreaga lume, cu înregistrări desktop mai frecvente, datorită poziționării flexibile a webcam-ului.

Modele de Atenție

Modelul de atenție propus procesează caracteristici vizuale de nivel scăzut, și anume expresii faciale; poza capului; și direcția privirii – extrase prin intermediul kit-urilor menționate anterior, AFFDEX 2.0 și SmartEye SDK.

Acestea sunt apoi convertite în indicatori de nivel superior, cu fiecare distractor tratat de un clasificator binar separat, antrenat pe propriul set de date pentru optimizare și evaluare independentă.

Schema pentru sistemul de monitorizare propus.

Teste

Așa cum s-a menționat anterior, testele urmează o metodă ablativă, în care componente sunt eliminate și efectul asupra rezultatului este notat.

Diferite categorii de neatenție percepută în studiu.

Modelul de privire a identificat comportamentul din afara ecranului prin trei pași cheie: normalizarea estimărilor brute ale privirii, finisarea ieșirii și estimarea mărimii ecranului pentru dispozitivele desktop.

Pentru a înțelege importanța fiecărui component, autorii au eliminat individual și au evaluat performanța pe 226 de videoclipuri desktop și 225 de videoclipuri mobile extrase din două seturi de date. Rezultatele, măsurate prin G-mean și F1 scoruri, sunt prezentate mai jos:

Rezultate care indică performanța modelului de privire complet, alături de versiuni cu pași de procesare individuali eliminați.

În fiecare caz, performanța a scăzut atunci când un pas a fost omis. Normalizarea s-a dovedit a fi deosebit de valoroasă pe dispozitivele desktop, unde poziționarea camerei variază mai mult decât pe dispozitivele mobile.

Studiul a evaluat, de asemenea, modul în care caracteristicile vizuale au prezis orientarea camerei mobile: locația feței, poza capului și direcția privirii au obținut scoruri de 0,75, 0,74 și 0,60, în timp ce combinația lor a atins 0,91, subliniind – conform autorilor – avantajul integrării multiplelor indicii.

Modelul de vorbire a atins un ROC-AUC de 0,97 pe setul de test manual etichetat, și 0,96 pe setul de test mai mare etichetat automat, indicând o performanță consistentă în ambele seturi.

Modelul de căscat a atins un ROC-AUC de 96,6% utilizând doar raportul aspectului gurii, ceea ce s-a îmbunătățit la 97,5% atunci când a fost combinat cu predicțiile unităților de acțiune de la AFFDEX 2.0.

Modelul de ecran neluat în seamă a identificat momente ca neatenție atunci când atât AFFDEX 2.0, cât și SmartEye au eșuat să detecteze o față pentru mai mult de o secundă. Pentru a evalua validitatea acestuia, autorii au etichetat manual toate evenimentele fără față din setul de date distragere reală, identificând cauza subiacentă a fiecărui declanșator. Cazurile ambigue (cum ar fi obstrucția camerei sau distorsionarea videoclipului) au fost excluse din analiză.

Așa cum se arată în tabelul de rezultate de mai jos, doar 27% din declanșatoarele ‘fără față’ au fost cauzate de utilizatori care au părăsit fizic ecranul.

Diverse motive obținute pentru care o față nu a fost găsită, în anumite instanțe.

Articolul afirmă:

‘În ciuda faptului că ecranele neluate în seamă au constituit doar 27% din instanțele care au declanșat semnalul fără față, acesta a fost activat și pentru alte motive care indică neatenție, cum ar fi participanții care se uită în afara ecranului cu un unghi extrem, fac mișcări excesive sau acoperă semnificativ fața cu un obiect/mână.’

În ultimul test cantitativ, autorii au evaluat modul în care adăugarea progresivă a diferiților semnale de distragere – privirea în afara ecranului (prin poza capului și direcția privirii), somnolența, vorbirea și ecranele neluate în seamă – a afectat performanța generală a modelului de atenție.

Testarea a fost efectuată pe două seturi de date: setul de date distragere reală și un subset de test al setului de date privire. Scorurile G-mean și F1 au fost utilizate pentru a măsura performanța (deși somnolența și vorbirea au fost excluse din analiza setului de date de privire, din cauza relevanței lor limitate în acest context).

Așa cum se arată mai jos, detectarea atenției a fost îmbunătățită constant pe măsură ce au fost adăugate mai multe tipuri de distragere, privirea în afara ecranului fiind cel mai frecvent distractor și oferind cea mai puternică bază de referință.

Efectul adăugării diverselor semnale de distragere la arhitectură.

Dintre aceste rezultate, articolul afirmă:

‘Din rezultate, putem conchide în primul rând că integrarea tuturor semnalelor de distragere contribuie la îmbunătățirea detectării atenției.

‘În al doilea rând, îmbunătățirea detectării atenției este consistentă pe ambele dispozitive desktop și mobile. În al treilea rând, sesiunile mobile din setul de date real arată mișcări semnificative ale capului atunci când se uită în afara ecranului, care sunt ușor de detectat, conducând la o performanță mai bună pentru dispozitivele mobile în comparație cu dispozitivele desktop. În al patrulea rând, adăugarea semnalului de somnolență are o îmbunătățire relativ mică în comparație cu alte semnale, deoarece este rareori întâlnit.

‘În cele din urmă, semnalul de ecran neluat în seamă are o îmbunătățire relativ mai mare pe dispozitivele mobile în comparație cu dispozitivele desktop, deoarece dispozitivele mobile pot fi ușor lăsate neluate în seamă.’

Autorii au comparat, de asemenea, modelul lor cu AFFDEX 1.0, un sistem anterior utilizat în testarea anunțurilor – și chiar modelul lor actual de detectare a privirii bazat pe cap a depășit AFFDEX 1.0 pe ambele tipuri de dispozitive:

‘Această îmbunătățire este o consecință a integrării mișcărilor capului în ambele direcții, yaw și pitch, precum și a normalizării pozei capului pentru a ține cont de schimbări minore. Mișcările capului pronunțate din setul de date real mobil au făcut ca modelul nostru de cap să performeze similar cu AFFDEX 1.0.’

Autorii închid articolul cu o rundă de testare calitativă (poate un pic perfunctorie), prezentată mai jos.

Exemple de ieșiri ale modelului de atenție pe dispozitive desktop și mobile, cu fiecare rând prezentând exemple de true și false pozitive pentru diverse tipuri de distragere.

Autorii afirmă:

‘Rezultatele indică faptul că modelul nostru detectează eficient diverse distractori în medii necontrolate. Cu toate acestea, poate produce în mod ocazional false pozitive în anumite cazuri limită, cum ar fi înclinarea severă a capului în timp ce menține privirea pe ecran, unele acoperiri ale gurii, ochi excesiv de încețoșați sau imagini faciale puternic întunecate. ‘

Concluzie

Deși rezultatele reprezintă un progres măsurat, dar semnificativ, peste lucrările anterioare, valoarea mai profundă a studiului constă în perspectiva pe care o oferă asupra impulsului persistent de a accesa starea internă a spectatorului. Deși datele au fost colectate cu consimțământ, metodologia indică spre cadre viitoare care ar putea extinde dincolo de setări structurate de cercetare de piață.

Această concluzie paranoică este întărită și mai mult de natura închisă și protejată a acestei ramuri specifice de cercetare.

* Conversia mea a citărilor inline ale autorilor în legături.

Publicat pentru prima dată miercuri, 9 aprilie 2025