Unghiul lui Anderson

Întrebări impolite ar putea majora costurile ChatGPT pentru întreprinderi

Răspunsurile ChatGPT consumă mai multe tokeni atunci când sunteți nepoliticos cu el, majorând factura dvs. de întreprindere; dar spunând “vă rog” poate reduce costurile.

Se spune că politețea nu costă nimic; dar ce costă nepolitețea? În ceea ce privește plata pentru ChatGPT, destul de mult, conform unei noi studii din SUA. Noul raport, de la Universitatea din Iowa, arată că a fi nepoliticos cu ChatGPT crește costul răspunsurilor – chiar dacă răspunsurile sunt aceleași pentru întrebări politicoase și nepoliticoase.

Autorii afirmă:

‘Prețul tokenilor de ieșire este de 12 dolari pentru 1 milion de tokeni de ieșire pentru GPT4. Am constatat că prompturile nepoliticoase duc la mai mult de 14 tokeni extra, ceea ce este echivalent cu un cost suplimentar de 0,000168 dolari pe prompt, în medie. Numărul zilnic de întrebări către API-ul OpenAI depășește 2,2 miliarde.

‘Comparativ cu un scenariu în care toate prompturile sunt politicoase, atunci când prompturile sunt nepoliticoase, acest lucru generează o venit suplimentar de 369.000 de dolari pe zi, doar din cauza creșterii numărului de tokeni pe care prompturile nepoliticoase îi generează în rezultat.’

Deși rezultatul este interesant în sine, autorii subliniază că acest comportament neobișnuit ar putea indica o varietate de ciudățenii necunoscute în configurația om/AI, unele sau toate dintre acestea putând avea implicații financiare. În ceea ce privește motivul pentru care nepolitețea costă clienții tokeni suplimentari, autorii nu speculează.

Pentru a stabili veridicitatea sindromului, ei au rescris prompturi reale ChatGPT, alternând valorile de politețe, în timp ce păstrau sensul. Ambele versiuni au fost introduse în GPT-4-Turbo, și s-au măsurat diferențele în numărul de tokeni de ieșire utilizați pentru răspunsuri.

Concluziile trase sunt în contrast puternic cu evenimentele de știri de la începutul acestui an, în care Sam Altman s-a plâns că politețea costa OpenAI potențial ‘zeci de milioane’ de dolari în ceea ce privește procesarea tokenilor legați de politețe (cum ar fi ‘vă rog’). Cercetarea publicată în aceeași perioadă a indicat, de asemenea, că politețea nu are nicio valoare în ceea ce privește obținerea de răspunsuri mai bune (deși nu a comentat despre răspunsuri mai ieftine).

Dacă concluziile noului raport sunt corecte, orice utilizator de întreprindere ChatGPT care a urmat această linie de gândire ar fi cheltuit mai mult pe inferența ChatGPT în 2025 decât utilizatorii care oferă o minimă politețe în schimburile ChatGPT.

Autorii sugerează că o posibilă soluție ar fi să se stabilească un plafon de tokeni pentru răspunsuri, deși această abordare nu este una pe care sistemele LLM le pot implementa ușor. Ei observă că promptarea este un instrument slab pentru controlul costurilor, deoarece LLM-urile au dificultăți în a urma instrucțiuni explicite de lungime. În majoritatea cazurilor, această directivă de “limitare” nu ar fi urmată; în plus, răspunsul ar putea fi trunchiat, deoarece LLM-urile de acest tip sunt, în esență, ghicind cuvântul probabil următor într-o propoziție/paragraf și, ca atare, nu știu cum se termină povestea – sau unde se termină povestea – până când procesarea este completă. Prin urmare, au o capacitate limitată de a “încheia” orice mecanisme în curs de desfășurare la cerere.

Lipsind o soluție exactă – deși sugestând că abordări de preț transparent mai transparente ar trebui să fie impuse în astfel de cazuri – autorii concluzionează:

‘Înțelepciunea convențională sugerează că politețea promptului este inutilă atunci când se interacționează cu LLM-urile.

‘În contrast, lucrarea noastră demonstrează că prompturile nepoliticoase cresc tokenii de ieșire, generând costuri suplimentare pentru adoptatorii de AI de întreprindere.’

Noul raport este intitulat Transparența costurilor adoptării AI de întreprindere și provine de la trei cercetători de la Universitatea din Iowa.

Metodă

Datele pentru sistem au fost extrase din setul de date WildChat, care cuprinde o colecție de 1 milion de conversații utilizator-ChatGPT, și care conține mai mult de 2,5 milioane de interacțiuni:

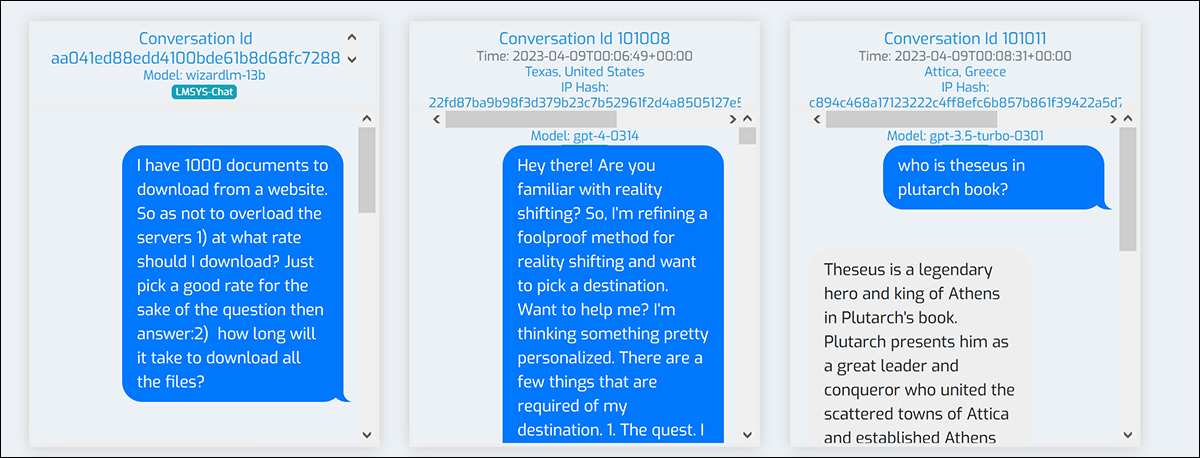

De pe un site de suport pentru proiectul WildChat, exemple căutabile de interacțiuni ChatGPT. Sursă

Autorii notează că WildChat conține o cantitate mai mare de interacțiuni naturale decât în unele seturi mai curate.

Ei au ales 20.000 de prompturi în limba engleză din colecția de schimburi GPT-4, eliminând ieșirea în fiecare caz (deoarece intenția era să alimenteze prompturile din nou, pentru răspunsuri noi). Doar prima interacțiune a fost aleasă, chiar și din schimburi mai lungi,

Setul rezultat a fost filtrat în categoriile polite sau nepoliticos, cu toate prompturile clasificate de GPT-4-Turbo. Cercetătorii au utilizat modelul însuși pentru a decide dacă un prompt era politicos sau nu, deoarece percepția modelului asupra politeței era centrală pentru experiment.

Prompturile etichetate ca polite puteau include indicii clari, cum ar fi cuvântul ‘vă rog’, sau puteau fi politicoase într-un mod mai indirect. Orice prompt care nu a fost recunoscut ca polite a fost clasificat ca nepoliticos, chiar dacă formularea era neutră, mai degrabă decât antagonistă.

Pentru a studia modul în care modelul a răspuns la politețe, metodele standard (adică cele care tratează textul ca un set de caracteristici măsurabile) nu au putut fi utilizate: deoarece politețea era încorporată în însăși formularea, rezumarea unui prompt ca o listă de trăsături ar fi pierdut contextul important.

În schimb, fiecare prompt a fost rescris pentru a inversa tonul, păstrând toate celelalte elemente asemănătoare, permițând compararea între perechi care diferă doar în politețe:

Exemple de modul în care prompturile politicoase și nepoliticoase au fost transformate în versiunile lor contrafactuale, păstrând în același timp sensul semantic. Sursă

Teste

Fiecare prompt original a fost pereche cu o versiune rescrisă care diferă doar în nivelul de politețe, și ambele versiuni au fost introduse în același model GPT-4-Turbo prin apeluri API separate. Numărul de tokeni produși în răspuns la fiecare versiune a fost înregistrat, și diferența dintre ele a fost tratată ca măsura modului în care tonul a influențat (costul tokenilor).

Temperatura a fost menținută constantă pentru a preveni variația aleatorie, și perechile de prompturi au fost păstrate doar atunci când rescrierea a modificat intrarea cu nu mai mult de cinci tokeni. Acest lucru a asigurat că efectul studiat a provenit din ton, mai degrabă decât orice schimbări mai ample în formulare:

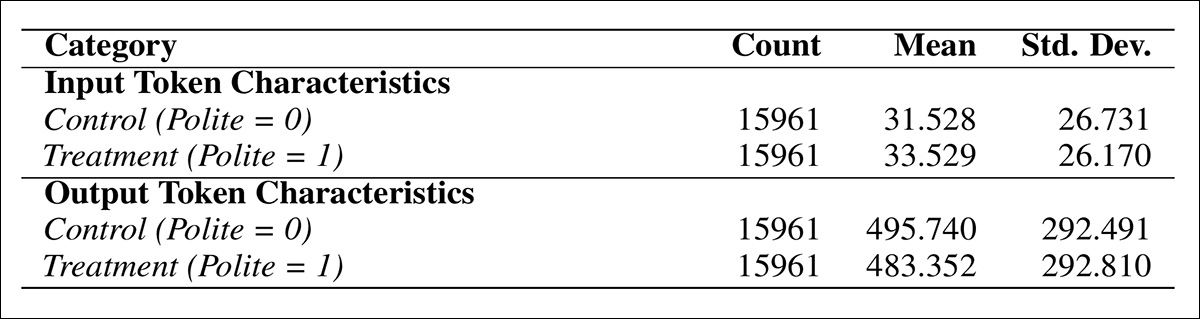

Statistici rezumative care arată că prompturile politicoase au dus la mai puțini tokeni de ieșire, în medie, decât prompturile nepoliticoase, în ciuda faptului că aveau puțin mai mulți tokeni de intrare.

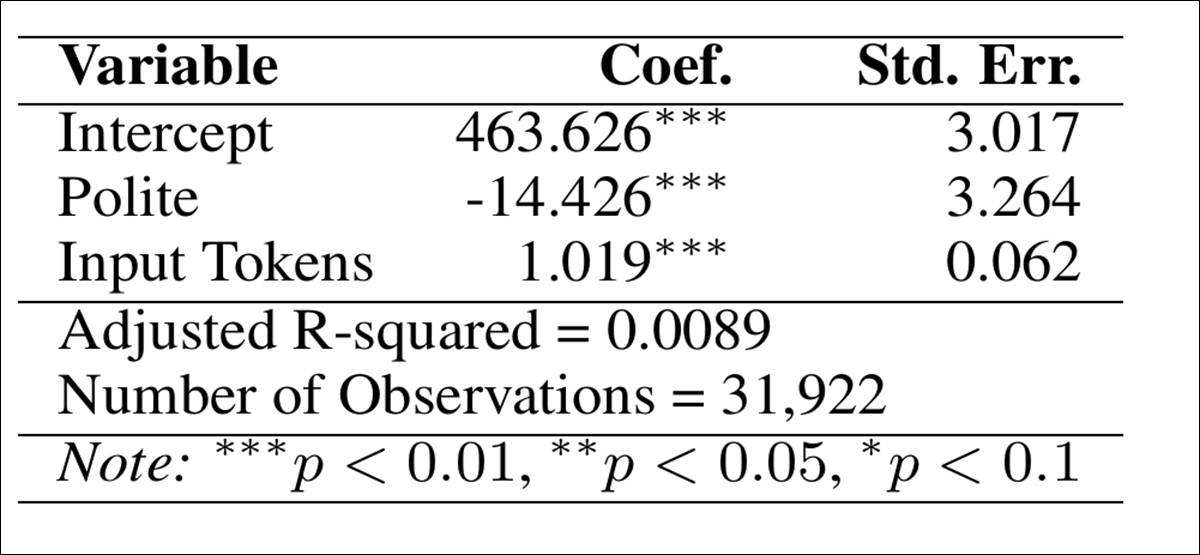

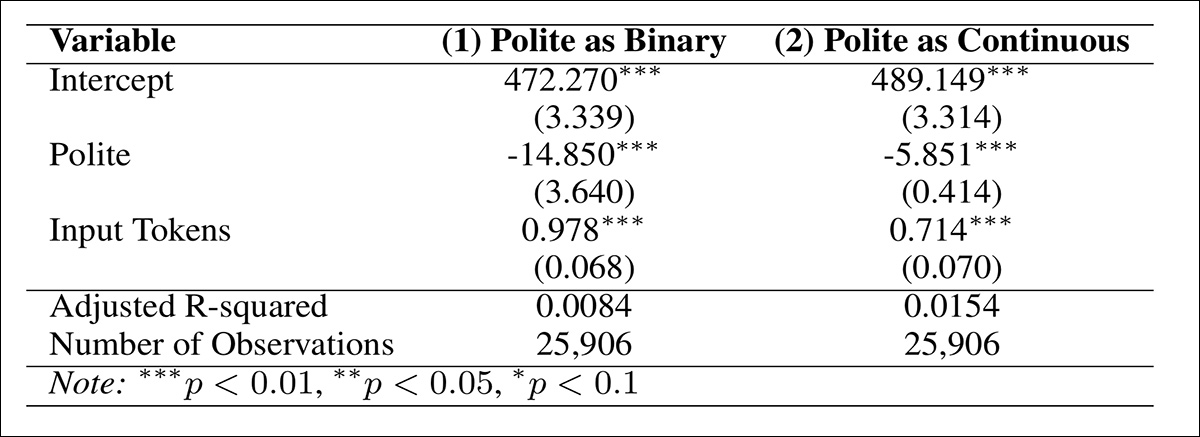

Rezultatele principale pentru prima rundă de teste au indicat că utilizarea unui prompt politicos reduce lungimea răspunsului cu 14,426 de tokeni:

Rezultatele estimării care prezintă efectul formării promptului politicos asupra lungimii răspunsului generat (tokeni).

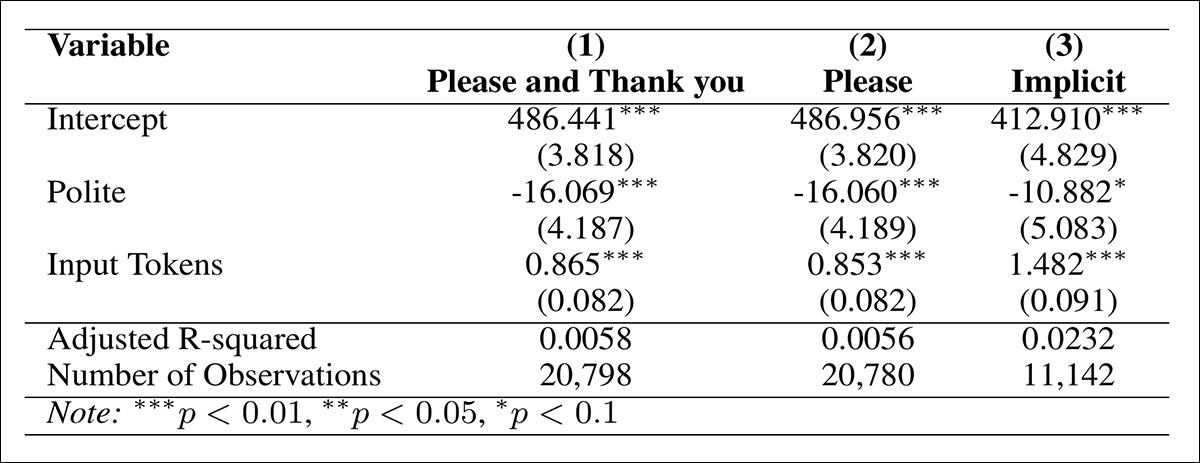

Analiza a fost repetată pe trei subseturi de prompturi politicoase pentru a testa robustețea: prompturi care utilizează markeri expliciți, cum ar fi ‘vă rog’ sau ‘mulțumesc’; cele care utilizează doar ‘vă rog’; și cele cu politețe implicită, cum ar fi ‘puteți’ sau ‘ați putea’:

Rezultatele estimării pe tipuri de politețe.

Pentru a valida robustețea principalelor constatări, o clasificare secundară a politeței promptului a fost efectuată utilizând cadru LIWC, care oferă un scor determinist și reproductibil pentru caracteristicile lingvistice.

În contrast cu clasificarea probabilistică a lui GPT, LIWC poate atribui un scor de politețe stabil pentru fiecare prompt, permițând evaluarea coerenței pe metode diverse. În această parte a testelor, prompturile au fost etichetate ca polite dacă scorul lor de politețe LIWC a fost mai mare de zero și ca nepoliticos în caz contrar.

Când s-a măsurat alinierea între clasificările LIWC și GPT, s-a observat un ritm de potrivire de 81%. Deși nu este o măsură a acurateței, acest acord a oferit sprijin pentru coerența între sisteme.

Când s-au analizat doar prompturile cu etichete de politețe LIWC și GPT care se potrivesc, prompturile politicoase au dus în continuare la 14 tokeni mai puțini; și atunci când politețea a fost măsurată pe o scară de glisare, fiecare pas în sus în politețe a redus ieșirea cu cinci tokeni, în medie:

Economii de tokeni din cauza politeței au fost menținute atunci când au fost reclasificate cu LIWC, atât ca etichetă binară, cât și ca scor continuu.

Reziliență

Pentru a evalua dacă efectul politeței variază în funcție de diferite tipuri de prompturi, fiecare prompt a fost atribuit uneia dintre câteva categorii de sarcini predefinite: cereri de informații; generare de text; editare și rescriere; clasificare; rezumare; și sarcini tehnice.

Fiecare prompt a fost atribuit unei etichete de sarcină prin compararea încorporării sale cu cele ale descrierilor de sarcini predefinite, utilizând modelul all-MiniLM-L6-v2 Sentence Transformers.

Scorurile de similaritate cosine au fost calculate între fiecare prompt și setul de definiții de sarcini, și eticheta cu similaritatea cea mai ridicată a fost atribuită.

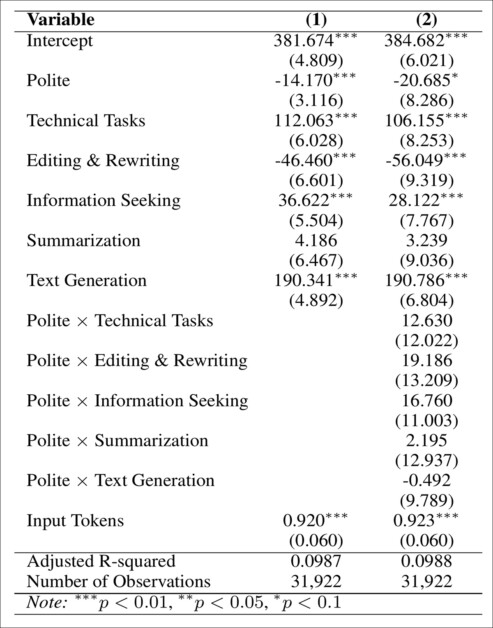

Tipurile de sarcini au fost reutilizate ca variabile de control în regresie, pentru a testa dacă efectul politeței variază în funcție de categoria de prompt, și termenii de interacțiune între sarcină și tratament au fost, de asemenea, introduși, pentru a verifica efectele diferențiate.

În ambele cazuri, prompturile politicoase au produs în mod constant ieșiri mai scurte, și nu s-a găsit nicio variație semnificativă în funcție de tipul de sarcină:

Rezultatele regresiei care demonstrează că prompturile politicoase au redus lungimea ieșirii în toate tipurile de sarcini, fără efecte de interacțiune semnificative.

Pentru a testa dacă răspunsurile mai scurte de la prompturile politicoase reflectă o calitate redusă, ieșirile de la prompturile originale și contrafactuale au fost comparate pentru similaritate semantică. Utilizând modelul all-MiniLM-L6-v2, fiecare răspuns a fost încorporat într-un spațiu vectorial semantic, și similaritatea cosine a fost calculată între fiecare pereche, dând o similaritate medie de 0,78, ceea ce indică o aliniere puternică a înțelesului, și sugerând că conținutul a rămas consistent chiar și atunci când tonul s-a schimbat.

Cuvinte de oprire

Pentru a înțelege ce tipuri de conținut sunt reduse în ieșirile mai scurte, au fost examinate cuvintele cele mai frecvent eliminate. Acestea s-au dovedit a fi cuvinte comune de oprire, cum ar fi ‘a avea’, ‘mai mult’, ‘unde’ și ‘în’, adică termeni care servesc roluri gramaticale, mai degrabă decât semantice.

Pentru a confirma că reducerea tokenilor nu a fost determinată de pierderea conținutului semnificativ, cuvintele de oprire au fost eliminate, și frazele de până la patru cuvinte au fost analizate pentru dispariția sistematică; cu toate acestea, nu au fost găsite modele consistente sau semnificative din punct de vedere semantic, ceea ce sugerează că reducerile din cauza formulării politicoase nu au stript conținutul util sau semnificativ.

Astfel, pare că mai mulți tokeni sunt cheltuiți pe răspunsuri la întrebări impoliticoase decât la cele politicoase – ca o fel de “taxă” pe brutalitate.

Studiu uman

Pentru a testa dacă calitatea răspunsului a fost afectată de tonul promptului, a fost efectuat și un studiu uman, utilizând un eșantion aleatoriu de douăzeci de perechi de prompturi polite și douăzeci de perechi de prompturi nepoliticoase.

După excluderea prompturilor pe subiecte sensibile sau tehnice, răspunsurile au fost evaluate de 401 de participanți pe o scară de șapte puncte. Fiecare participant a văzut doar un răspuns, extras din una dintre cele patru condiții: polite sau nepoliticos, și fie original, fie contrafactual.

Nu s-au găsit diferențe semnificative în calitatea percepută în niciuna dintre aceste condiții. Răspunsurile polite și nepoliticoase au primit scoruri aproape identice, la fel și versiunile originale și contrafactuale.

Autorii afirmă că aceste rezultate indică faptul că reducerea numărului de tokeni de ieșire nu a fost cauzată de nicio pierdere de calitate, ci mai degrabă de rescriere sau prin schimbări structurale care, totuși, au păstrat înțelesul.

Diferența de cost observată în promptarea de întreprindere este, prin urmare, puțin probabil să reflecte modificări ale utilității sau clarității, și “taxa” este încă operațională.

Concluzie

Deși noul studiu se concentrează pe utilizarea de către întreprinderi a ChatGPT, utilizatorii de nivel inferior sunt, de asemenea, afectați de acest sindrom, deoarece chiar și cele două niveluri de intrare au limite de utilizare; și – presupunând – tratamentul ChatGPT în mod nepoliticos va accelera epuizarea alocării zilnice de tokeni a utilizatorului mediu.

Noul studiu se concentrează pe o întrebare deschisă și studiată pe scară largă în interacțiunile om/AI; dar autorii subliniază că problemele legate de politețe ar trebui să fie luate ca indicatori ai unei posibile fântâni adânci de ciudățenii lingvistice, încă nedescoperite, care ar putea avea implicații financiare.

Publicat pentru prima dată miercuri, 19 noiembrie 2025