Lideri de opinie

Un ghid practic pentru ieșiri LLM defensabile

Există o presupunere tăcută care străbate majoritatea implementărilor de GenAI la nivelul întreprinderilor: dacă ieșirea arată corect, atunci este corectă. În medii cu risc scăzut, aceasta este o scurtătură rezonabilă. În industrii reglementate, cum ar fi sănătatea, finanțele, produsele farmaceutice și asigurarea calității, aceasta este o vulnerabilitate care așteaptă să apară.

În momentul în care o ieșire LLM influențează o decizie clinică, un document financiar sau un document de conformitate, fluența încetează să mai fie un proxy pentru fiabilitate. Și atunci când un auditor, un regulator sau o echipă juridică solicită informații despre datele utilizate, regulile aplicate și cine a aprobat, “modelul a spus așa” nu este un răspuns pe care cineva îl poate semna.

Acesta este decalajul de responsabilitate pe care majoritatea echipelor GenAI nu îl iau în considerare la proiectare. Iată cum să îl închidem.

De ce “Arată corect” este un standard greșit

Evaluarea tradițională a inteligenței artificiale se axează pe acuratețe, latență și cost. Acestea sunt importante. Dar mediile reglementate introduc o a patra axă care nu poate fi înlocuită de celelalte: auditabilitatea.

Actul UE privind IA, care este acum în vigoare, cere sistemelor de inteligență artificială cu risc ridicat să mențină documentația tehnică, log-urile de urmărire și dovezi ale supravegherii umane pe tot parcursul ciclului lor de viață. Prima versiune a ghidului FDA privind IA în dezvoltarea de medicamente și biologice semnalează aceeași direcție pentru științele vieții. Aceste cadre nu evaluează fluența. Ei cer sisteme care pot fi reconstruite, inspectate și apărate.

O ieșire LLM defensabilă este una care poate fi urmărită înapoi printr-o lanț de dovezi verificabile: ce date a folosit, ce constrângeri au modelat-o, cine a revizuit-o și ce a fost păstrat pentru inspectarea viitoare. Fără această lanț, chiar și o ieșire corectă este indefensabilă.

Acest lucru redefinesce ce înseamnă “gata pentru producție” pentru IA în medii guvernate.

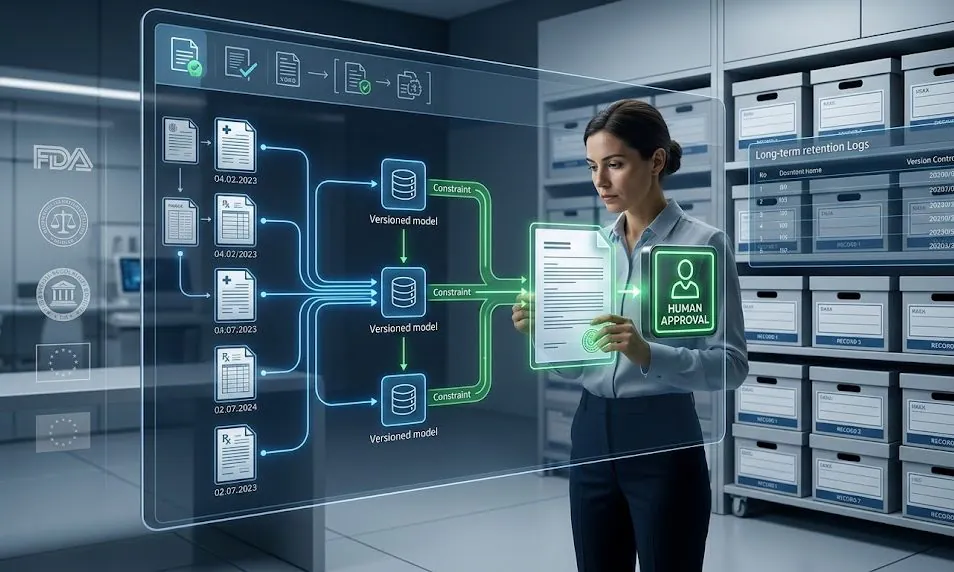

Cei patru stâlpilor ai GenAI gata pentru audit

Construirea de sisteme LLM defensabile se reduce la patru cerințe de inginerie. Acestea nu sunt principii abstracte – ele sunt decizii de infrastructură care determină dacă sistemul dvs. poate supraviețui scrutinului.

1. Proveniența: Controlați de unde obține modelul informațiile

Cea mai frecventă modalitate de eșec în IA la nivelul întreprinderilor este și cea mai puțin vizibilă: modelele care se bazează pe cunoștințe generale sau surse de date slab definite. Atunci când nu există o graniță de cunoaștere controlată, ieșirile nu pot fi urmărite până la o sursă auditabilă, și reconstrucția devine imposibilă.

O soluție practică este să se stabilească o graniță de cunoaștere aprobată: documente și seturi de date versionate pe care sistemul este în mod explicit autorizat să le utilizeze. Fiecare răspuns ar trebui să aibă un pachet minim de dovezi: un identificator de sursă cu versiune și dată valabilă, un jurnal de recuperare care arată ce a fost interogat și selectat, și citări inline. O regulă de funcționare utilă: fără citare, fără pretenție.

Acest lucru convertește sistemul de la generare bazată pe memorie la raționament bazat pe dovezi. Distincția devine critică atunci când cineva are nevoie să reconstruiască o anumită ieșire la câteva săptămâni sau luni după ce a fost generată.

2. Constrângeri: Înlocuiți improvisația cu comportament controlat

LLM-urile sunt construite pentru a fi convingătoare. Fără constrângeri, ele optimizează pentru plauzibilitate, și plauzibilitatea într-un context reglementat este unde trăiește riscul.

Constrângeri sunt mecanismul care transformă un generator de text probabilistic într-un component de execuție limitat. În practică, acest lucru înseamnă:

- Generare legată de sursă: Fiecare afirmație necesită o sursă aprobată, versionată. Fără sursă, nu există răspuns — doar refuz sau escaladare.

- Scheme de ieșire structurate: Răspunsurile urmează formate definite pe care atât mașinile, cât și auditorii le pot valida, și nu doar le pot citi.

- Aplicarea graniței de încredere: Conținutul recuperat este tratat ca intrare, abordând direct riscurile de injectare a promptului care pot submina atât securitatea, cât și auditabilitatea.

- Acces cu privilegii minime: Modelul interacționează doar cu datele și uneltele de care are cu adevărat nevoie, păstrând urmele de audit curate.

Constrângeri nu sunt o casetă de bifat pentru conformitate. Ele sunt decizia arhitecturală care determină dacă sistemul dvs. poate fi auditat deloc.

3. Revizuire: Faceți supravegherea umană un strat de control formal

În IA reglementată, revizuirea umană nu poate fi ad-hoc. Ea are nevoie să fie stratificată în funcție de risc (ieșiri cu risc mai mare declanșează validări mai stricte) și declanșată de evenimente, activând atunci când încrederea modelului este scăzută, sursele sunt absente sau se detectează anomalii.

Actul UE privind IA cere în mod explicit ca oamenii să poată interpreta, anula și opri deciziile conduse de IA în cazuri de utilizare cu risc ridicat. Îndeplinirea acestei cerințe înseamnă că înregistrările de revizuire trebuie să capteze cine a aprobat o ieșire, în ce condiții și cu ce nivel de examinare. “Cineva a verificat” nu este un control. Un înregistrare de revizuire documentată și timestampată este.

Acest lucru ridică revizuirea de la asigurarea calității manuale la un strat de guvernanță formal, exact așa cum regulatorii încep să o trateze.

4. Păstrare: Faceți responsabilitatea durabilă

Fără log-uri, nu există urmă de audit. Fără o urmă de audit, responsabilitatea este teoretică.

În același timp, păstrarea tuturor lucrurilor creează propriile riscuri, în special acolo unde datele de sănătate sau financiare sensibile sunt supuse unor cerințe de minimizare în cadrul unor cadre precum GDPR sau HIPAA.

Abordarea practică este un model în trepte. Păstrați întotdeauna metadatele modelului și versiunii, identificatorii de sursă, deciziile de politică și timestamp-urile. Păstrați conținutul interacțiunii (prompturi, ieșiri și urme complete) selectiv, pe baza clasificării riscului, cu redactarea și controlul accesului corespunzător. Scopul este de a permite reconstruirea oricărei ieșiri fără a colecta în exces date care creează expunere în aval.

Ce arată acest lucru în practică

Considerați cum se aplică acest lucru în științele vieții, unde CFR 21 Part 11 cere înregistrări electronice care să fie atribuibile, lizibile, contemporane, originale și exacte. Un LLM care generează documentație de reglementare trebuie să satisfacă toate cele cinci criterii – și nu doar să producă text lizibil.

În acest context, cei patru stâlpilor nu sunt îmbunătățiri opționale. Ei sunt bariera minimă pentru un sistem conform.

Proveniența asigură că ieșirea este atribuibilă și originală. Constrângeri asigură că rămâne în limite definite. Revizuirea asigură că este contemporană cu supravegherea umană. Păstrarea asigură că este lizibilă și inspectabilă.

Aceeași logică se aplică în serviciile financiare, unde MiFID II cere înregistrări ale deciziilor și raționamentului din spatele lor, și în sănătate, unde sistemele de sprijin pentru decizii clinice se confruntă cu o examinare tot mai strictă a explicabilității și a prejudecăților.

Schimbarea mai mare

GenAI se mută de la experimentare la infrastructură operațională. Această tranziție ridică standardul pentru ceea ce înseamnă sisteme acceptabile.

O ieșire utilă nu mai este suficientă. Organizațiile au nevoie de ieșiri care pot fi explicate, urmărite și apărate sub scrutin, pentru că IA este solicitată să facă lucruri care au consecințe reale.

Echipele care proiectează defensivitate de la început vor fi poziționate să scaleze IA în siguranță și să mențină încrederea regulatorilor. Cei care nu o fac vor întâmpina în cele din urmă același moment: un audit, o întrebare directă despre o anumită ieșire și nimic de arătat.

Construirea de IA gata pentru audit nu este despre încetinire. Este despre a construi ceva care poate dura.