Inteligência artificial

O problema da caixa preta em LLMs: desafios e soluções emergentes

O aprendizado de máquina, um subconjunto da IA, envolve três componentes: algoritmos, dados de treinamento e o modelo resultante. Um algoritmo, essencialmente um conjunto de procedimentos, aprende a identificar padrões a partir de um grande conjunto de exemplos (dados de treinamento). O ponto culminante deste treinamento é um modelo de aprendizado de máquina. Por exemplo, um algoritmo treinado com imagens de cães resultaria em um modelo capaz de identificar cães em imagens.

Caixa preta em aprendizado de máquina

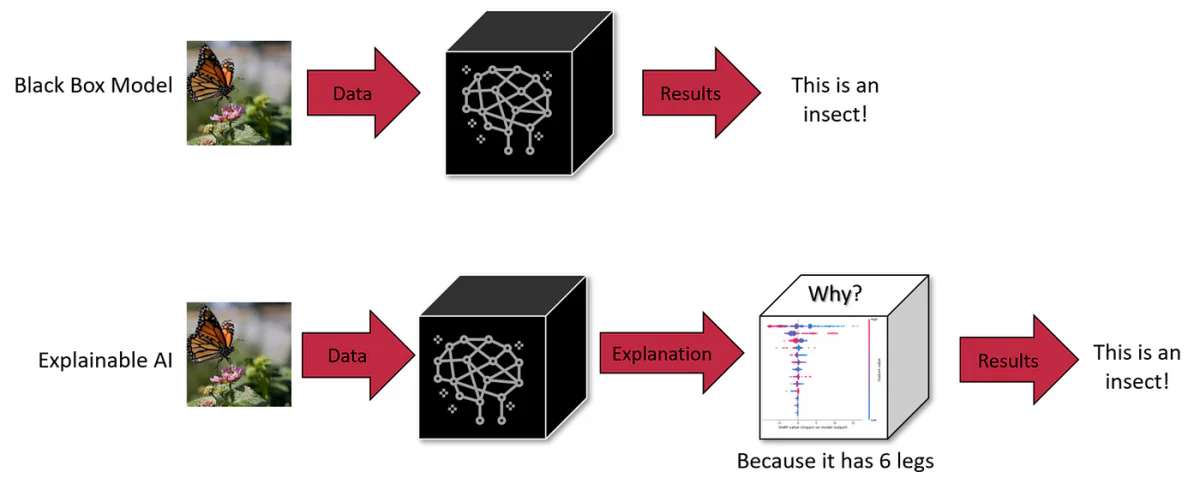

Em aprendizado de máquina, qualquer um dos três componentes — algoritmo, dados de treinamento ou modelo — pode ser uma caixa-preta. Embora os algoritmos sejam frequentemente de conhecimento público, os desenvolvedores podem optar por manter o modelo ou os dados de treinamento em segredo para proteger a propriedade intelectual. Essa obscuridade dificulta a compreensão do processo de tomada de decisão da IA.

As caixas pretas de IA são sistemas cujo funcionamento interno permanece opaco ou invisível para os usuários. Os usuários podem inserir dados e receber resultados, mas a lógica ou código que produz a saída permanece oculto. Esta é uma característica comum em muitos sistemas de IA, incluindo modelos generativos avançados como ChatGPT e DALL-E 3.

LLMs como o GPT-4 apresentam um desafio significativo: o seu funcionamento interno é em grande parte opaco, tornando-os “caixas pretas”. Essa opacidade não é apenas um quebra-cabeça técnico; apresenta preocupações éticas e de segurança no mundo real. Por exemplo, se não conseguimos discernir como estes sistemas chegam a conclusões, podemos confiar neles em áreas críticas como diagnósticos médicos ou avaliações financeiras?

A escala e complexidade dos LLMs

A escala desses modelos aumenta sua complexidade. Veja o GPT-3, por exemplo, com seus 175 bilhões de parâmetros, e os modelos mais recentes com trilhões. Cada parâmetro interage de maneiras complexas dentro da rede neural, contribuindo para capacidades emergentes que não são previsíveis examinando apenas componentes individuais. Esta escala e complexidade tornam quase impossível compreender totalmente a sua lógica interna, representando um obstáculo no diagnóstico de preconceitos ou comportamentos indesejados nestes modelos.

A compensação: escala versus interpretabilidade

A redução da escala dos LLMs poderia melhorar a interpretabilidade, mas à custa das suas capacidades avançadas. A escala é o que permite comportamentos que modelos menores não conseguem alcançar. Isso apresenta uma compensação inerente entre escala, capacidade e interpretabilidade.

Impacto do problema da caixa preta LLM

1. Tomada de decisão falha

A opacidade no processo de tomada de decisão de LLMs como GPT-3 ou BERT pode levar a preconceitos e erros não detectados. Em domínios como os cuidados de saúde ou a justiça criminal, onde as decisões têm consequências de longo alcance, a incapacidade de auditar os LLMs quanto à solidez ética e lógica é uma grande preocupação. Por exemplo, um LLM de diagnóstico médico baseado em dados desatualizados ou tendenciosos pode fazer recomendações prejudiciais. Da mesma forma, os LLMs nos processos de contratação podem perpetuar inadvertidamente preconceitos de género. A natureza da caixa negra, portanto, não só esconde falhas, mas pode potencialmente amplificá-las, necessitando de uma abordagem proativa para aumentar a transparência.

2. Adaptabilidade limitada em diversos contextos

A falta de conhecimento do funcionamento interno dos LLMs restringe a sua adaptabilidade. Por exemplo, um LLM de contratação pode ser ineficiente na avaliação de candidatos para uma função que valoriza as competências práticas em detrimento das qualificações académicas, devido à sua incapacidade de ajustar os seus critérios de avaliação. Da mesma forma, um LLM médico pode ter dificuldades com diagnósticos de doenças raras devido a desequilíbrios de dados. Esta inflexibilidade destaca a necessidade de transparência para recalibrar os LLMs para tarefas e contextos específicos.

3. Preconceitos e lacunas de conhecimento

O processamento de vastos dados de treinamento por LLMs está sujeito às limitações impostas por seus algoritmos e arquiteturas de modelos. Por exemplo, um LLM na área médica pode apresentar vieses demográficos se for treinado em conjuntos de dados desbalanceados. Além disso, a proficiência de um LLM em tópicos específicos pode ser enganosa, levando a resultados incorretos e excessivamente confiantes. Lidar com esses vieses e lacunas de conhecimento exige mais do que apenas dados adicionais; exige uma análise da mecânica de processamento do modelo.

4. Responsabilidade Legal e Ética

A natureza obscura dos LLMs cria uma zona cinzenta jurídica em relação à responsabilidade por quaisquer danos causados por suas decisões. Se um LLM em um ambiente médico fornece aconselhamento incorreto que leva a danos ao paciente, a determinação da responsabilização torna-se difícil devido à opacidade do modelo. Essa incerteza jurídica representa riscos para entidades que implementam LLMs em áreas sensíveis, ressaltando a necessidade de governança clara e transparência.

5. Problemas de confiança em aplicativos sensíveis

Para LLMs utilizados em áreas críticas como saúde e finanças, a falta de transparência prejudica a sua fiabilidade. Os utilizadores e os reguladores precisam de garantir que estes modelos não abrigam preconceitos nem tomam decisões com base em critérios injustos. A verificação da ausência de preconceitos nos LLMs exige uma compreensão dos seus processos de tomada de decisão, enfatizando a importância da explicabilidade para a implantação ética.

6. Riscos com Dados Pessoais

Os LLMs exigem extensos dados de treinamento, que podem incluir informações pessoais confidenciais. A natureza de caixa negra destes modelos levanta preocupações sobre a forma como estes dados são processados e utilizados. Por exemplo, um LLM médico treinado em registros de pacientes levanta questões sobre privacidade e uso de dados. Garantir que os dados pessoais não sejam utilizados indevidamente ou explorados requer processos transparentes de tratamento de dados dentro destes modelos.

Soluções emergentes para interpretabilidade

Para enfrentar esses desafios, novas técnicas estão sendo desenvolvidas. Estes incluem métodos de aproximação contrafactual (CF). O primeiro método envolve solicitar que um LLM altere um conceito de texto específico enquanto mantém outros conceitos constantes. Essa abordagem, embora eficaz, consome muitos recursos no momento da inferência.

A segunda abordagem envolve a criação de um espaço de incorporação dedicado guiado por um LLM durante o treinamento. Este espaço se alinha com um gráfico causal e ajuda a identificar correspondências que se aproximam dos CFs. Este método requer menos recursos no momento do teste e demonstrou explicar efetivamente as previsões do modelo, mesmo em LLMs com bilhões de parâmetros.

Estas abordagens destacam a importância das explicações causais nos sistemas de PNL para garantir a segurança e estabelecer confiança. As aproximações contrafactuais fornecem uma maneira de imaginar como um determinado texto mudaria se um determinado conceito em seu processo generativo fosse diferente, auxiliando na estimativa prática do efeito causal de conceitos de alto nível em modelos de PNL.

Mergulho profundo: métodos de explicação e causalidade em LLMs

Ferramentas de análise e importância de recursos

Sondagem é uma técnica usada para decifrar o que as representações internas nos modelos codificam. Pode ser supervisionado ou não supervisionado e tem como objetivo determinar se conceitos específicos estão codificados em determinados locais de uma rede. Embora sejam eficazes até certo ponto, as sondagens são insuficientes no fornecimento de explicações causais, conforme destacado por Geiger et al. (2021).

As ferramentas de importância de recursos, outra forma de método de explicação, geralmente se concentram em recursos de entrada, embora alguns métodos baseados em gradiente estendam isso a estados ocultos. Um exemplo é o método dos Gradientes Integrados, que oferece uma interpretação causal explorando dados de base (contrafactuais, CF). Apesar de sua utilidade, esses métodos ainda lutam para conectar suas análises com conceitos do mundo real além de simples propriedades de entrada.

Métodos Baseados em Intervenção

Os métodos baseados em intervenção envolvem a modificação de entradas ou representações internas para estudar os efeitos no comportamento do modelo. Esses métodos podem criar estados de FC para estimar efeitos causais, mas muitas vezes geram entradas ou estados de rede implausíveis, a menos que sejam cuidadosamente controlados. O Modelo Proxy Causal (CPM), inspirado no conceito S-learner, é uma abordagem inovadora neste domínio, imitando o comportamento do modelo explicado sob entradas de CF. No entanto, a necessidade de um explicador distinto para cada modelo é uma limitação importante.

Aproximando contrafactuais

Contrafactuais são amplamente utilizados em aprendizado de máquina para ampliação de dados, envolvendo perturbações em vários fatores ou rótulos. Eles podem ser gerados por meio de edição manual, substituição heurística de palavras-chave ou reescrita automatizada de texto. Embora a edição manual seja precisa, ela também consome muitos recursos. Métodos baseados em palavras-chave têm suas limitações, e abordagens generativas oferecem um equilíbrio entre fluência e abrangência.

Explicações fiéis

Fidelidade em explicações refere-se à representação precisa do raciocínio subjacente do modelo. Não existe uma definição universalmente aceita de fidelidade, o que leva à sua caracterização por meio de diversas métricas, como Sensibilidade, Consistência, Concordância de Importância de Características, Robustez e Simulabilidade. A maioria desses métodos concentra-se em explicações em nível de características e frequentemente confunde correlação com causalidade. Nosso trabalho visa fornecer explicações conceituais de alto nível, alavancando a literatura sobre causalidade para propor um critério intuitivo: Ordem-Fidelidade.

Mergulhamos nas complexidades inerentes aos LLMs, entendendo sua natureza de "caixa preta" e os desafios significativos que eles representam. Dos riscos de decisões equivocadas em áreas sensíveis como saúde e finanças aos dilemas éticos em torno de preconceito e imparcialidade, a necessidade de transparência nos LLMs nunca foi tão evidente.

O futuro dos LLMs e a sua integração nas nossas vidas quotidianas e nos processos críticos de tomada de decisões depende da nossa capacidade de tornar estes modelos não só mais avançados, mas também mais compreensíveis e responsáveis. A busca pela explicabilidade e interpretabilidade não é apenas um esforço técnico, mas um aspecto fundamental da construção de confiança nos sistemas de IA. À medida que os LLMs se tornam mais integrados na sociedade, a procura de transparência aumentará, não apenas por parte dos profissionais de IA, mas de todos os utilizadores que interagem com estes sistemas.