Kunstig intelligens

Øyeblikkelig-stil: Stilbevaring i tekst-til-bilde-generering

I løpet av de siste årene har tuningbaserte diffusjonsmodeller vist bemerkelsesverdig fremgang på tvers av et bredt spekter av bildetilpasnings- og tilpasningsoppgaver. Til tross for deres potensiale, fortsetter nåværende tuning-baserte diffusjonsmodeller å møte en rekke komplekse utfordringer med å produsere og generere stilkonsistente bilder, og det kan være tre årsaker bak det samme. For det første er begrepet stil fortsatt mye udefinert og ubestemt, og består av en kombinasjon av elementer, inkludert atmosfære, struktur, design, materiale, farge og mye mer. Andre inversjonsbaserte metoder er utsatt for stilforringelse, noe som resulterer i hyppig tap av finkornede detaljer. Til slutt krever adapterbaserte tilnærminger hyppig vektjustering for hvert referansebilde for å opprettholde en balanse mellom tekstkontrollerbarhet og stilintensitet.

Videre er det primære målet for et flertall av stiloverføringstilnærminger eller stilbildegenerering å bruke referansebildet og bruke dets spesifikke stil fra en gitt delmengde eller referansebilde til et målinnholdsbilde. Det er imidlertid det store antallet stilattributter som gjør jobben vanskelig for forskere å samle stiliserte datasett, representere stilen riktig og evaluere suksessen til overføringen. Tidligere har modeller og rammeverk som omhandler finjusteringsbasert diffusjonsprosess, finjustert datasettet med bilder som deler en felles stil, en prosess som er både tidkrevende og med begrenset generaliserbarhet i oppgaver i den virkelige verden siden det er vanskelig. for å samle et undersett av bilder som deler samme eller nesten identiske stil.

I denne artikkelen vil vi snakke om InstantStyle, et rammeverk designet med sikte på å takle problemene som de nåværende tuning-baserte diffusjonsmodellene står overfor for bildegenerering og tilpasning. Vi vil snakke om de to nøkkelstrategiene implementert av InstantStyle-rammeverket:

- En enkel, men effektiv tilnærming til å frakoble stil og innhold fra referansebilder i funksjonsrommet, spådd på antagelsen om at funksjoner innenfor samme funksjonsrom enten kan legges til eller trekkes fra hverandre.

- Forhindrer stillekkasjer ved å injisere referansebildefunksjonene eksklusivt i de stilspesifikke blokkene, og bevisst unngå behovet for å bruke tungvinte vekter for finjustering, som ofte karakteriserer mer parametertunge design.

Denne artikkelen tar sikte på å dekke InstantStyle-rammeverket i dybden, og vi utforsker mekanismen, metodikken, arkitekturen til rammeverket sammen med dets sammenligning med toppmoderne rammeverk. Vi vil også snakke om hvordan InstantStyle-rammeverket viser bemerkelsesverdige visuelle stiliseringsresultater, og oppnår en optimal balanse mellom kontrollerbarheten til tekstelementer og stilintensiteten. Så la oss komme i gang.

InstantStyle: Stilbevaring i generering av tekst til bilde

Diffusjonsbasert tekst til bildegenererende AI-rammeverk har oppnådd merkbar og bemerkelsesverdig suksess på tvers av et bredt spekter av tilpasnings- og personaliseringsoppgaver, spesielt i konsistente bildegenereringsoppgaver, inkludert objekttilpasning, bildebevaring og stiloverføring. Til tross for den nylige suksessen og ytelsesløftet, er stiloverføring fortsatt en utfordrende oppgave for forskere på grunn av stilens ubestemte og udefinerte natur, ofte inkludert en rekke elementer, inkludert atmosfære, struktur, design, materiale, farge og mye mer. Når det er sagt, er hovedmålet med stilisert bildegenerering eller stiloverføring å bruke den spesifikke stilen fra et gitt referansebilde eller en referanseundergruppe av bilder til målinnholdsbildet. Det store antallet stilattributter gjør imidlertid jobben vanskelig for forskere å samle stiliserte datasett, som representerer stilen riktig, og evaluere suksessen til overføringen. Tidligere har modeller og rammeverk som omhandler finjusteringsbasert diffusjonsprosess, finjustert datasettet med bilder som deler en felles stil, en prosess som er både tidkrevende og med begrenset generaliserbarhet i oppgaver i den virkelige verden siden det er vanskelig. for å samle et undersett av bilder som deler samme eller nesten identiske stil.

Med utfordringene som dagens tilnærming møter, har forskere interessert seg for å utvikle finjusterende tilnærminger for stiloverføring eller stilisert bildegenerering, og disse rammene kan deles inn i to forskjellige grupper:

- Adapterfrie tilnærminger: Adapterfrie tilnærminger og rammeverk utnytter kraften til selvoppmerksomhet i diffusjonsprosessen, og ved å implementere en delt oppmerksomhetsoperasjon er disse modellene i stand til å trekke ut viktige funksjoner, inkludert nøkler og verdier, direkte fra en gitt referansestil.

- Adapterbaserte tilnærminger: Adapterbaserte tilnærminger og rammeverk inkluderer på den annen side en lett modell designet for å trekke ut detaljerte bilderepresentasjoner fra referansestilbildene. Rammeverket integrerer deretter disse representasjonene i diffusjonsprosessen dyktig ved å bruke kryssoppmerksomhetsmekanismer. Det primære målet med integrasjonsprosessen er å veilede generasjonsprosessen, og å sikre at det resulterende bildet er på linje med de ønskede stilistiske nyansene i referansebildet.

Til tross for løftene, møter tuningfrie metoder ofte på noen få utfordringer. For det første krever den adapterfrie tilnærmingen en utveksling av nøkkel og verdier innenfor selvoppmerksomhetslagene, og forhåndsfanger nøkkel- og verdimatrisene avledet fra referansestilbildene. Når den implementeres på naturlige bilder, krever den adapterfrie tilnærmingen inversjon av bildet tilbake til den latente støyen ved å bruke teknikker som DDIM eller Denoising Diffusion Implicit Models inversjon. Bruk av DDIM eller andre inversjonsmetoder kan imidlertid føre til tap av finkornede detaljer som farge og tekstur, og dermed redusere stilinformasjonen i de genererte bildene. Videre er det ekstra trinnet introdusert av disse tilnærmingene en tidkrevende prosess, og kan utgjøre betydelige ulemper i praktiske anvendelser. På den annen side ligger hovedutfordringen for adapterbaserte metoder i å finne den rette balansen mellom kontekstlekkasje og stilintensitet. Innholdslekkasje oppstår når en økning i stilintensiteten resulterer i at det vises ikke-stilelementer fra referansebildet i det genererte resultatet, med det primære vanskelighetspunktet å skille stiler fra innhold i referansebildet effektivt. For å løse dette problemet, konstruerer noen rammeverk sammenkoblede datasett som representerer det samme objektet i forskjellige stiler, noe som letter utvinningen av innholdsrepresentasjon og frigjorte stiler. Men takket være den iboende ubestemte representasjonen av stil, er oppgaven med å lage store sammenkoblede datasett begrenset med tanke på mangfoldet av stiler den kan fange, og det er også en ressurskrevende prosess.

For å takle disse begrensningene introduseres InstantStyle-rammeverket som er en ny tuning-fri mekanisme basert på eksisterende adapterbaserte metoder med evnen til sømløs integrering med andre oppmerksomhetsbaserte injeksjonsmetoder, og oppnå effektiv frakobling av innhold og stil. Videre introduserer InstantStyle-rammeverket ikke én, men to effektive måter å fullføre frakoblingen av stil og innhold, og oppnå bedre stilmigrering uten å måtte introdusere flere metoder for å oppnå frakobling eller bygge sammenkoblede datasett.

Videre har tidligere adapterbaserte rammeverk blitt brukt mye i de CLIP-baserte metodene som en bildefunksjonsuttrekker, noen rammeverk har utforsket muligheten for å implementere funksjonsavkobling i funksjonsrommet, og sammenlignet med ubestemt stil er det lettere å beskriv innholdet med tekst. Siden bilder og tekster deler en funksjonsplass i CLIP-baserte metoder, kan en enkel subtraksjonsoperasjon av konteksttekstfunksjoner og bildefunksjoner redusere innholdslekkasjen betydelig. Videre i et flertall av diffusjonsmodeller, er det et spesielt lag i arkitekturen som injiserer stilinformasjonen, og oppnår frakobling av innhold og stil ved å injisere bildefunksjoner kun i spesifikke stilblokker. Ved å implementere disse to enkle strategiene, er InstantStyle-rammeverket i stand til å løse innholdslekkasjeproblemer som et flertall av eksisterende rammeverk møter, samtidig som stilstyrken opprettholdes.

For å oppsummere bruker InstantStyle-rammeverket to enkle, greie, men effektive mekanismer for å oppnå en effektiv oppløsning av innhold og stil fra referansebilder. Instant-Style-rammeverket er en modelluavhengig og tuningfri tilnærming som demonstrerer bemerkelsesverdig ytelse i stiloverføringsoppgaver med et stort potensial for nedstrømsoppgaver.

Øyeblikkelig stil: Metodikk og arkitektur

Som demonstrert av tidligere tilnærminger, er det en balanse i injeksjonen av stilforhold i tuningfrie diffusjonsmodeller. Hvis intensiteten til bildetilstanden er for høy, kan det føre til innholdslekkasje, mens hvis intensiteten til bildetilstanden faller for lavt, kan det hende at stilen ikke er åpenbar nok. En hovedårsak bak denne observasjonen er at i et bilde er stilen og innholdet sammenkoblet, og på grunn av de iboende ubestemte stilattributtene, er det vanskelig å koble fra stilen og intensjonen. Som et resultat blir nøye vekter ofte innstilt for hvert referansebilde i et forsøk på å balansere tekstkontrollerbarhet og stilstyrke. Videre, for et gitt inngangsreferansebilde og dets tilsvarende tekstbeskrivelse i de inversjonsbaserte metodene, blir inversjonstilnærminger som DDIM tatt i bruk over bildet for å få den inverterte diffusjonsbanen, en prosess som tilnærmer inversjonsligningen for å transformere et bilde til et latent støyrepresentasjon. Ved å bygge på det samme, og med utgangspunkt i den inverterte diffusjonsbanen sammen med et nytt sett med spørsmål, genererer disse metodene nytt innhold med stilen i samsvar med inputen. Imidlertid, som vist i den følgende figuren, er DDIM-inversjonstilnærmingen for ekte bilder ofte ustabil da den er avhengig av lokale lineariseringsforutsetninger, noe som resulterer i forplantning av feil og fører til tap av innhold og feil bilderekonstruksjon.

Når det gjelder metodikken, i stedet for å bruke komplekse strategier for å skille innhold og stil fra bilder, tar Instant-Style-rammeverket den enkleste tilnærmingen for å oppnå lignende ytelse. Sammenlignet med de underbestemte stilattributtene, kan innhold representeres av naturlig tekst, slik at rammeverket for Instant-Style kan bruke tekstkoderen fra CLIP for å trekke ut egenskapene til innholdsteksten som kontekstrepresentasjoner. Samtidig implementerer Instant-Style-rammeverket CLIP-bildekoder for å trekke ut funksjonene til referansebildet. Ved å dra nytte av karakteriseringen av CLIP globale funksjoner, og etter å trekke innholdstekstfunksjonene fra bildefunksjonene, er Instant-Style-rammeverket i stand til å frakoble stilen og innholdet eksplisitt. Selv om det er en enkel strategi, hjelper den at Instant-Style-rammeverket er ganske effektivt for å holde innholdslekkasje på et minimum.

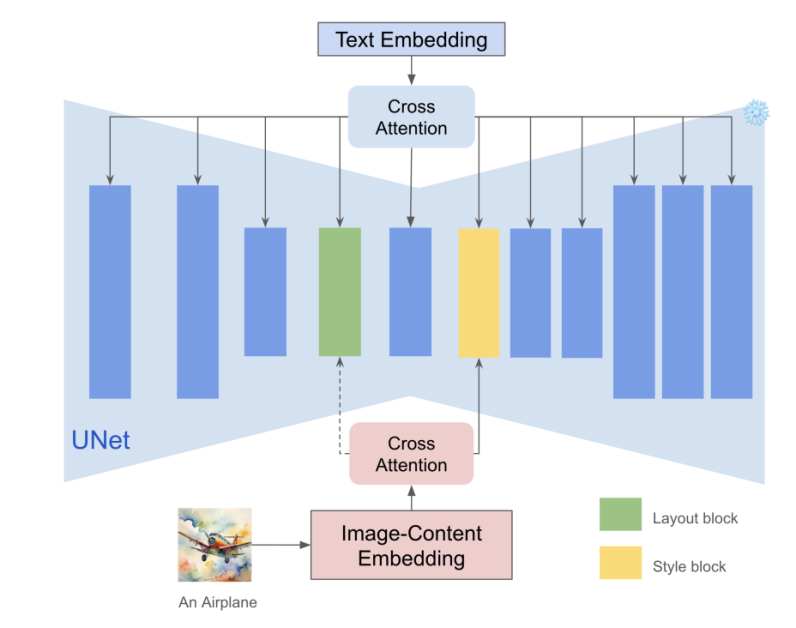

Videre er hvert lag i et dypt nettverk ansvarlig for å fange forskjellig semantisk informasjon, og den viktigste observasjonen fra tidligere modeller er at det finnes to oppmerksomhetslag som er ansvarlige for håndteringsstil. opp Nærmere bestemt er det blokkene.0.oppmerksomheter.1 og nedblokkene.2.oppmerksomhet.1-lagene som er ansvarlige for å fange stil som farge, materiale, atmosfære, og det romlige layoutlaget fanger opp henholdsvis struktur og komposisjon. Instant-Style-rammeverket bruker disse lagene implisitt for å trekke ut stilinformasjon, og forhindrer innholdslekkasje uten å miste stilstyrken. Strategien er enkel, men effektiv siden modellen har lokalisert stilblokker som kan injisere bildefunksjonene i disse blokkene for å oppnå sømløs stiloverføring. Siden modellen i stor grad reduserer antallet parametere til adapteren, forbedres tekstkontrollevnen til rammeverket, og mekanismen kan også brukes på andre oppmerksomhetsbaserte funksjonsinjeksjonsmodeller for redigering og andre oppgaver.

Øyeblikkelig stil: eksperimenter og resultater

Instant-Style-rammeverket er implementert på Stable Diffusion XL-rammeverket, og det bruker den ofte vedtatte forhåndstrente IR-adapteren som sitt eksempel for å validere metodikken, og demper alle blokker unntatt stilblokkene for bildefunksjoner. Instant-Style-modellen trener også IR-adapteren på 4 millioner store tekst-bilde-parrede datasett fra bunnen av, og i stedet for å trene alle blokker, oppdaterer kun stilblokkene.

For å utføre sine generaliseringsevner og robusthet, utfører Instant-Style-rammeverket en rekke stiloverføringseksperimenter med forskjellige stiler på tvers av forskjellig innhold, og resultatene kan observeres i følgende bilder. Gitt et enkelt stilreferansebilde sammen med varierende oppfordringer, gir Instant-Style-rammeverket høy kvalitet, konsistent stil bildegenerering.

Videre, siden modellen injiserer bildeinformasjon kun i stilblokkene, er den i stand til å redusere problemet med innholdslekkasje betydelig, og trenger derfor ikke å utføre vektjustering.

På vei videre tar rammeverket for Instant-Style også i bruk ControlNet-arkitekturen for å oppnå bildebasert stilisering med romlig kontroll, og resultatene vises i bildet nedenfor.

Sammenlignet med tidligere toppmoderne metoder, inkludert StyleAlign, B-LoRA, Swapping Self Attention og IP-Adapter, viser Instant-Style-rammeverket de beste visuelle effektene.

Final Thoughts

I denne artikkelen har vi snakket om Instant-Style, et generelt rammeverk som bruker to enkle, men effektive strategier for å oppnå en effektiv oppløsning av innhold og stil fra referansebilder. InstantStyle-rammeverket er designet med sikte på å takle problemene som de nåværende tuning-baserte diffusjonsmodellene står overfor for bildegenerering og tilpasning. Instant-Style-rammeverket implementerer to viktige strategier: En enkel, men effektiv tilnærming til å frikoble stil og innhold fra referansebilder i funksjonsrommet, forutsatt på antagelsen om at funksjoner innenfor samme funksjonsrom enten kan legges til eller trekkes fra hverandre. For det andre, forebygging av stillekkasjer ved å injisere referansebildefunksjonene utelukkende i de stilspesifikke blokkene, og bevisst unngå behovet for å bruke tungvinte vekter for finjustering, som ofte karakteriserer mer parametertunge design.