Robotikk

Kontroll av droner gjennom direkte visjon

Forskere fra Kina har utviklet en ny algoritme som kan aktivere kontroll av droneflyging ved å tolke brukerens visjon direkte. Effektivt “blir” den menneskelige operatøren dronen, og styrer dens trajektori basert på brukerens blikkretning.

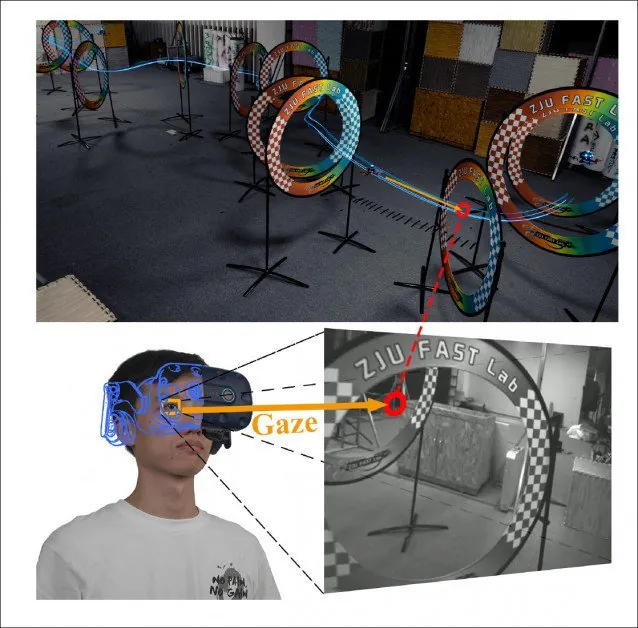

Brukerens POV sees på bunnen til venstre, med dronens flyvebane fanget eksternt av en skyggeenhet. Se videoen på slutten av artikkelen for utvidet full-bevegelse. Source: https://www.youtube.com/watch?v=WYujLePQwB8

Den artikkelen heter GPA-Teleoperation: Gaze Enhanced Perception-aware Safe Assistive Aerial Teleoperation, og kommer fra forskere ved Institute of Cyber-Systems and Control ved Zhejiang University, og School of Automation ved Nanjing Institute of Technology. Forskerne har også sluppet en video i dag som demonstrerer systemets egenskaper (se slutten av artikkelen).

Beyond Abstract Control

Forskerne søker å fjerne laget av abstraksjon for dronekontroll, og argumenterer for at sekundære kontrollenheter krever trening og bare er en grov abstraksjon av brukerens intensjoner, noe som leder til uforutsigbar manøvrering og misforståelse av veiledningsbevegelser.

En artikkel tidligere i år, fra samme forskere, understreket viktigheten av synlig sikt i drone-navigasjon, og det nåværende arbeidet er en utvikling av funnene fra denne forskningen.

Ovenfor, en kompositt av dronens testlaboratorie ‘angrepskurs’ (se slutten av videoer for eksterne tester i en naturlig åpen luftmiljø). Nederst, operatøren bærer en øye-sporet som sender gjennom den direkte visningen av quadrotor-dronens fremover-kamera (nederst til høyre). Source: https://arxiv.org/pdf/2109.04907.pdf

Algoritme

GPA bruker en bak-end-optimizer som finjusterer brukerens blikk inn i den sikreste optimale banen, noe som kan sammenlignes med ‘auto-aim’ i videospill, med praktisk talt null forsinkelse (av åpenbare årsaker).

UAV-undermodulene er installert direkte i dronen, inkludert fasiliteter for tilstands-estimering, planlegging, kartlegging og kontroll-moduler. Det lokale systemet mottar øye-blikk-data fra en enkelt-øye-enhet montert i en hode-båret harness av slutt-brukeren, som leverer en initial topologisk bane, som systemet må rense på-fly.

For å skape en sammenhengende erfaring for fjernkontrollen, er den monokrome visningen som brukeren mottar auto-sentrert av drone-systemet, ikke minst fordi uten dette ville det være vanskelig å tolke nye avvik fra ruten (som indikeres av en endring av blikk-retning).

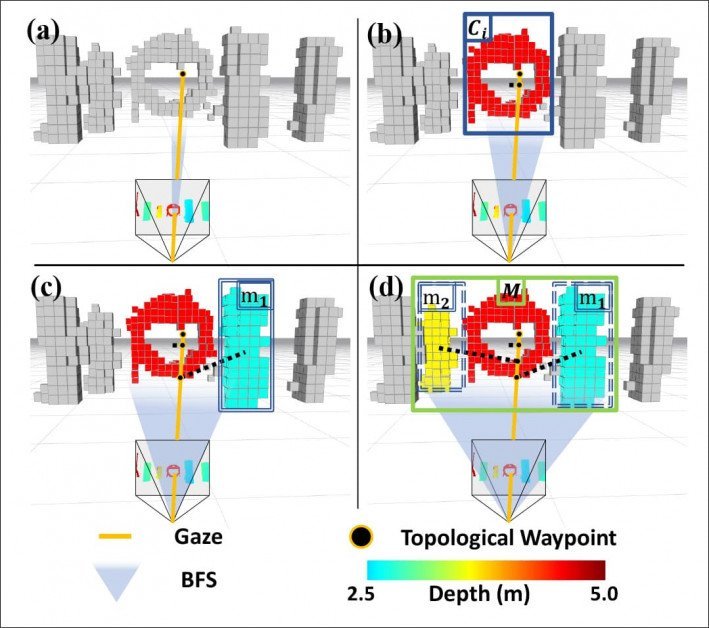

Systemet parser først anslåtte vektor-koordinater fra bilde-strømmen. Siden video-inngangen til forskernes system for øyeblikket er monokulær, brukes kameraets dybde-persepsjon-grense til å få en annen (dybde)-vektor som påføres den 2-D-vektor som er avledet fra bildet. I teorien kunne senere iterasjoner bruke stereo-kameraer til å forbedre denne pipeline, selv om det fortsatt må sees om den ekstra prosesserings-overhodet ville etterlate fordelen av maskinvar-basert 3D-persepsjon intakt.

Uansett, med de 3D-verdiene som er oppnådd, brukes beregningen som en opphav for en Breadth First Search (BFS). Pixeler som ellers ville bli obviert av BFS (dvs. pixeler identifisert som allerede innenfor grenser) brukes som anker-punkt for DBSCAN-clustering (hvis ikke allerede cluster), og rutinen returnerer til BFS-evaluering fra siste break-point.

Arkitekturen til GPA.

Prosessen itererer til et objekt er identifisert og merket innenfor margin-parametere som svarer til et synsfelt (FOV – som i dette tilfelle må være absolutt klart for å unngå kollisjoner).

Til slutt brukes vektor-beregningene til å generere klare baner, eller til å validere at brukerens blikk-retning allerede er en trygg bane gjennom eller forbi et hinder.

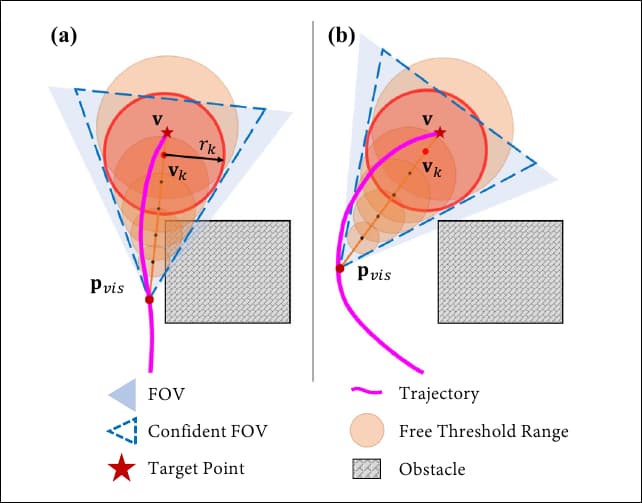

Tester hvor systemet ignorerer synlighet (venstre) og hvor banen er omregnet for å ta hensyn til synlighet som kritisk for en flyvebane (høyre).

Testing

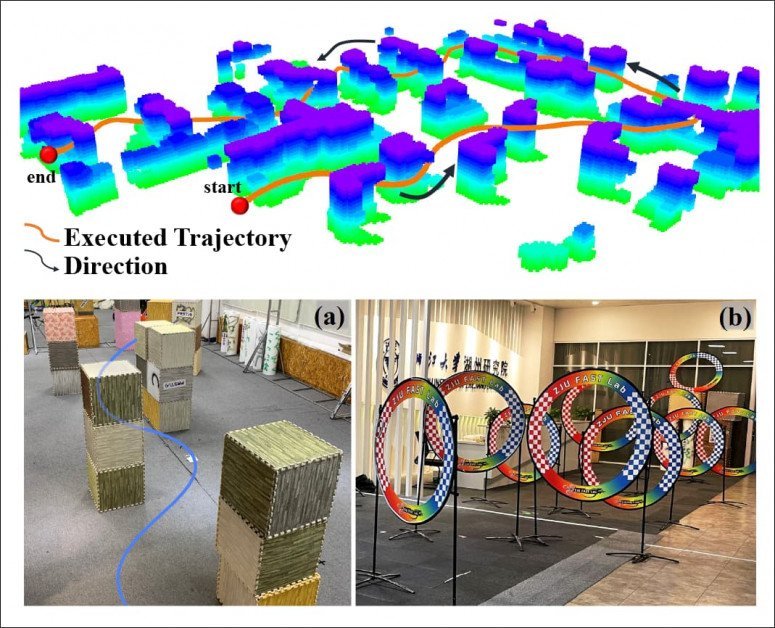

For å teste gaze-basert dronekontroll-system, brukte de kinesiske forskerne en rekke frivillige med null kunnskap om systemet, og uten erfaring i å kontrollere drone-flyging. Forsøkspersonene ble bedt om å navigere hindrings-kurs i lukkede og eksterne miljøer med bare tre korte orienterings-rutiner for å familiarisere seg med den grunnleggende operasjonen av systemet.

I tillegg til å ha briefet frivillige om den grunnleggende topologien til hindringene, la forskerne til ‘overraskelses-hindringer’ som ikke var inkludert i briefingene.

Ovenfor, banene til den online-quadrotor-dronen, fargede etter høyde. Nederst, de navigerbare hindringene, startende med bokser og gående over til ringer.

I praksis var systemet i stand til å effektivt korrigere blikk-data så at de rom-kritiske dronene som ble brukt kunne passere (eller gjennom) ring- og boks-formede hindringer uten kollisjon, og forskerne har konkludert med at deres system er både intuitivt og trygt, med en høy margin av sikkerhet i drift.

Forskerne sammenlignet også ytelsen til deres tilnærming med FocusTrack-arkitekturen i Mavic Air 2-systemet, og konkluderte med at det overgår sistnevnte ved å kunne måle og handle på presise bruker-intensjoner.

Øye-sporingsteknologi har vært omfattende forsket i felt som autonom kjøretøy-data-innsamling for maskinlæring-basert SDV-systemer, og i forskning om oppmerksomhets-mønster hos piloter, blant andre sektorer. I juli i år publiserte en forskningsgruppe fra Bulgaria funn fra observasjoner av Unmanned Aerial Vehicle (UAV)-piloter som etablerte landing-stadiet av en flyging som den mest utfordrende for nybegynnere.

Se forskernes offisielle video for GPA, under.

https://www.youtube.com/watch?v=WYujLePQwB8