Andersons hoek

Waarom Taalmodellen ‘Verloren’ Raken in Conversatie

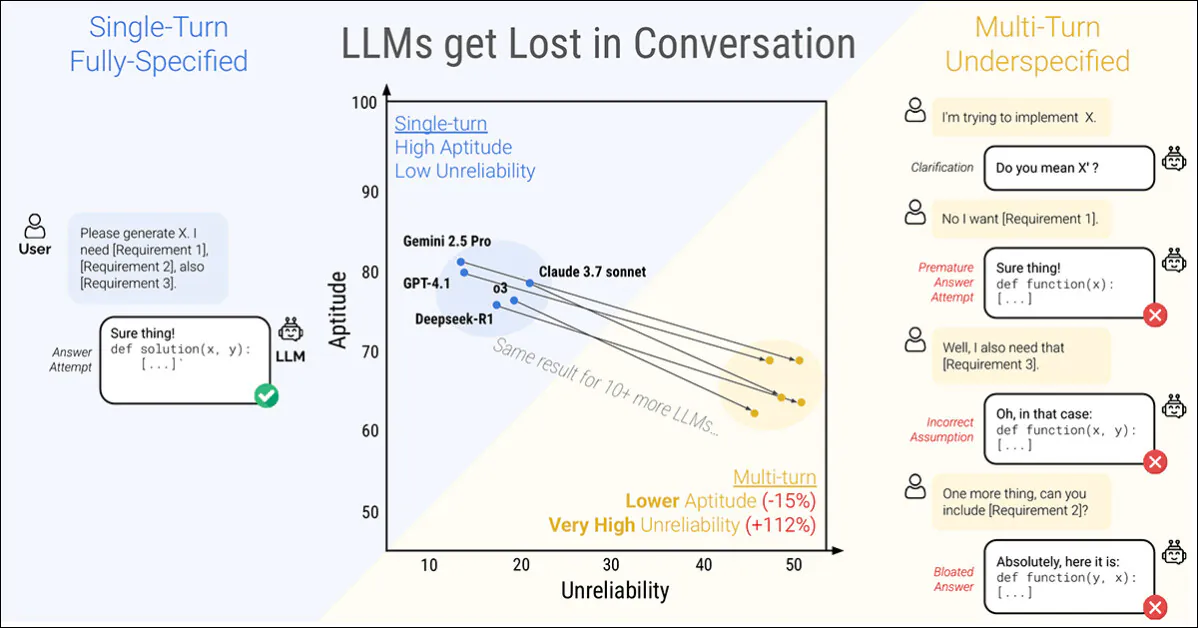

Een nieuw onderzoek van Microsoft Research en Salesforce toont aan dat zelfs de meest capabele Large Language Models (LLM’s) uit elkaar vallen wanneer instructies in fasen worden gegeven in plaats van allemaal tegelijk. De auteurs ontdekten dat de prestaties gemiddeld met 39 procent dalen over zes taken wanneer een prompt over meerdere beurten wordt gesplitst:

Een enkele beurt conversatie (links) levert de beste resultaten, maar is onnatuurlijk voor de eindgebruiker. Een meerdere beurten conversatie (rechts) toont aan dat zelfs de hoogst gerankte en meest presterende LLM’s het effectieve elan in een conversatie verliezen. Bron: https://arxiv.org/pdf/2505.06120

Nog opvallender is dat de betrouwbaarheid van de antwoorden een duik neemt, met prestigieuze modellen zoals ChatGPT-4.1 en Gemini 2.5 Pro die schommelen tussen bijna perfecte antwoorden en manifeste mislukkingen, afhankelijk van hoe dezelfde taak wordt geformuleerd; verder kan de consistentie van de output met meer dan de helft dalen in het proces.

Om dit gedrag te onderzoeken, introduceert het onderzoek een methode genaamd sharding*, die volledig gespecificeerde prompts in kleinere fragmenten splitst en deze een voor een in een conversatie vrijgeeft.

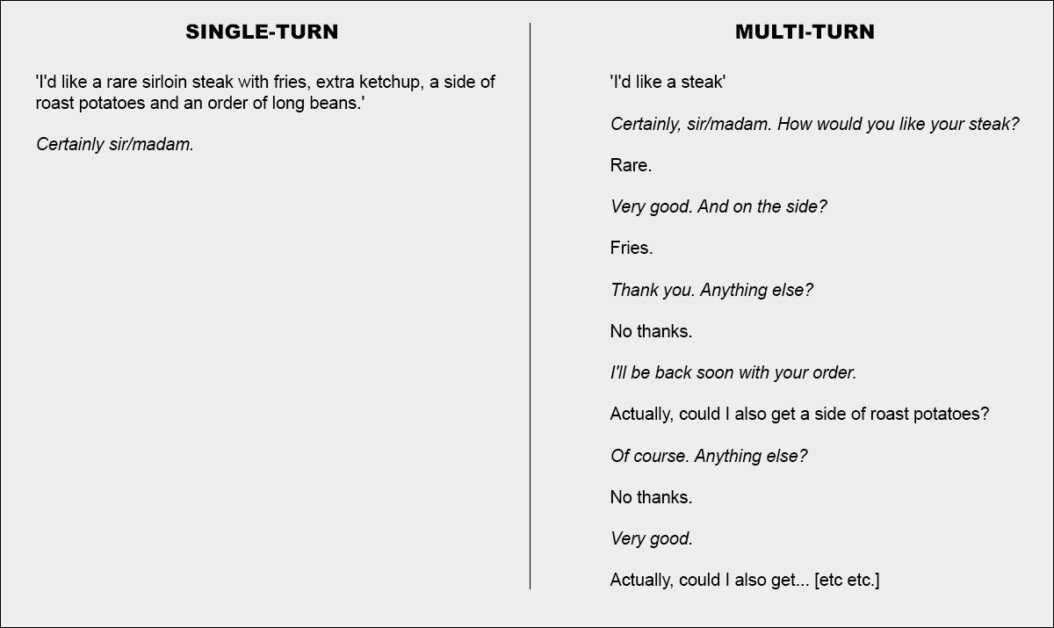

In de meest basale zin is dit equivalent aan het geven van een samenhangende en omvattende enkele bestelling in een restaurant, waardoor de ober niets anders hoeft te doen dan het verzoek te bevestigen; of anders besluiten om de kwestie samen te pakken:

Twee uiterste versies van een restaurantconversatie (niet uit het nieuwe onderzoek, voor illustratieve doeleinden alleen).

Voor de nadruk legt het bovenstaande voorbeeld misschien de klant in een negatief licht. Maar het kernidee dat in de tweede kolom wordt weergegeven, is dat van een transactionele uitwisseling die een probleemset verduidelijkt voordat het de problemen aanpakt – ogenschijnlijk een rationele en redelijke manier om een taak aan te pakken.

Deze setup wordt weerspiegeld in de nieuwe aanpak van Unite.ai voor LLM-interactie. De auteurs merken op dat LLM’s vaak te lange antwoorden genereren en vervolgens blijven vertrouwen op hun eigen inzichten zelfs nadat die inzichten onjuist of irrelevant zijn gebleken. Deze neiging, in combinatie met andere factoren, kan ertoe leiden dat het systeem het gesprek helemaal kwijtraakt.

In feite merken de onderzoekers op wat veel van ons anekdotisch hebben ontdekt – dat de beste manier om het gesprek weer op het juiste spoor te krijgen, is om een nieuw gesprek te starten met de LLM.

‘Als een gesprek met een LLM niet tot de verwachte resultaten leidt, kan het starten van een nieuw gesprek dat dezelfde informatie herhaalt, aanzienlijk betere resultaten opleveren dan het voortzetten van een lopend gesprek.

‘Dit komt omdat huidige LLM’s verloren kunnen raken in het gesprek, en onze experimenten laten zien dat het voortzetten van een gesprek met het model ineffectief is. Bovendien, aangezien LLM’s tekst genereren met randomisatie, kan een nieuw gesprek tot verbeterde resultaten leiden.’

De auteurs erkennen dat agente-systemen zoals Autogen of LangChain de resultaten mogelijk kunnen verbeteren door te fungeren als interpretatieve lagen tussen de eindgebruiker en de LLM, alleen communicerend met de LLM wanneer ze voldoende ‘gefragmenteerde’ antwoorden hebben verzameld om samen te voegen tot een enkele samenhangende vraag (die de eindgebruiker niet zal zien).

Maar de auteurs betogen dat een aparte abstractielaag niet nodig zou moeten zijn, of anders rechtstreeks in de bron-LLM zou moeten worden ingebouwd:

‘Een argument kan worden aangevoerd dat meerdere beurten geen noodzakelijke functie van LLM’s zijn, aangezien deze kan worden uitbesteed aan het agentframework. Met andere woorden, hebben we native meerdere beurtenondersteuning in LLM’s nodig wanneer een agentframework interacties met gebruikers kan orkestreren en LLM’s alleen als enkele beurtoperators kan gebruiken?…’

Maar na het testen van de stelling over hun reeks voorbeelden, concluderen ze:

‘[Afhankelijkheid] van een agent-achtig framework om informatie te verwerken, kan beperkend zijn, en we betogen dat LLM’s native meerdere beurtenondersteuning moeten hebben’

Dit interessante nieuwe onderzoek heeft als titel LLM’s Raken Verloren In Meerdere Beurten Conversatie, en komt van vier onderzoekers bij MS Research en Salesforce,

Gefragmenteerde Conversaties

De nieuwe methode splitst conventionele enkele beurt instructies eerst in kleinere scherven, ontworpen om op sleutelmomenten tijdens een LLM-interactie te worden geïntroduceerd, een structuur die de exploratorische, heen-en-weer-stijl van betrokkenheid weerspiegelt zoals gezien in systemen zoals ChatGPT of Google Gemini.

Elke oorspronkelijke instructie is een enkele, zelfstandige prompt die de hele taak in één keer levert, waarbij een hoogwaardige vraag, ondersteunende context en eventuele relevante voorwaarden worden gecombineerd. De gefragmenteerde versie splitst dit in meerdere kleinere delen, waarbij elke scherf slechts één stukje informatie toevoegt:

Gepaarde instructies die (a) een complete prompt tonen die in één beurt wordt geleverd en (b) de gefragmenteerde versie die wordt gebruikt om een onduidelijk, meerdere beurten gesprek te simuleren. Semantisch gezien levert elke versie dezelfde informatieve lading.

De eerste scherf introduceert altijd het hoofddoel van de taak, terwijl de rest verduidelijkende details biedt. Samen leveren ze dezelfde inhoud als de oorspronkelijke prompt, maar verspreid over meerdere beurten in het gesprek.