Andersons hoek

Vibe Coding Suffers When AI’s Role Expands

Een nieuwe studie ontdekt dat vibe coding verbetert wanneer mensen de instructies geven, maar afneemt wanneer AI dit doet, met de beste hybride setup die mensen voorop stelt, met AI als arbiter of rechter.

Nieuw onderzoek uit de Verenigde Staten, dat onderzoekt wat er gebeurt wanneer AI-systemen worden toegestaan om vibe coding te sturen, in plaats van alleen menselijke instructies uit te voeren, heeft ontdekt dat wanneer Large Language Models (LLMs) een grotere richtingsrol aannemen, de resultaten bijna altijd slechter zijn.

Hoewel de onderzoekers OpenAI’s GPT-5 gebruikten als framework voor hun menselijke/AI-samenwerkingsexperimenten, bevestigden ze later dat zowel Anthropic’s Claude Opus 4.5 als Google Gemini 3 Pro onderhevig waren aan dezelfde verslechteringscurve naarmate de verantwoordelijkheden toenamen, waarbij werd gesteld dat ‘zelfs beperkte menselijke betrokkenheid de prestaties gestaag verbetert’:

‘[Mensen] bieden uniek effectieve hoogwaardige richting over iteraties heen, [terwijl] AI-richting vaak leidt tot prestatie-inzinking. Ook vinden we dat een zorgvuldige roltoewijzing die mensen de leiding geeft over de richting en de evaluatie naar AI offloadt, de hybride prestaties kan verbeteren.’

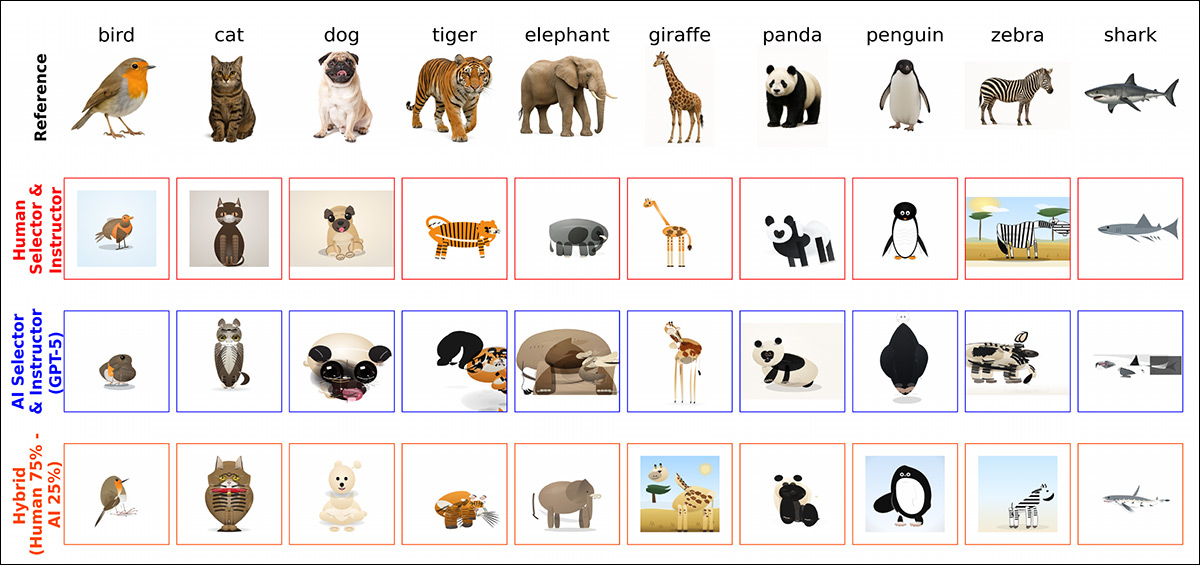

Om een consistent test te bieden dat door mensen en AI gelijkwaardig kon worden geëvalueerd, werd een gecontroleerd experimenteel framework opgebouwd rond een iteratieve codetaak waarbij een referentieafbeelding – met een foto van een kat, hond, tijger, vogel, olifant, pinguïn, haai, zebra, giraffe of panda – moest worden gereconstrueerd met behulp van scalable vector graphics (SVG), en die reconstructie beoordeeld tegen de fotobron waaruit het was afgeleid:

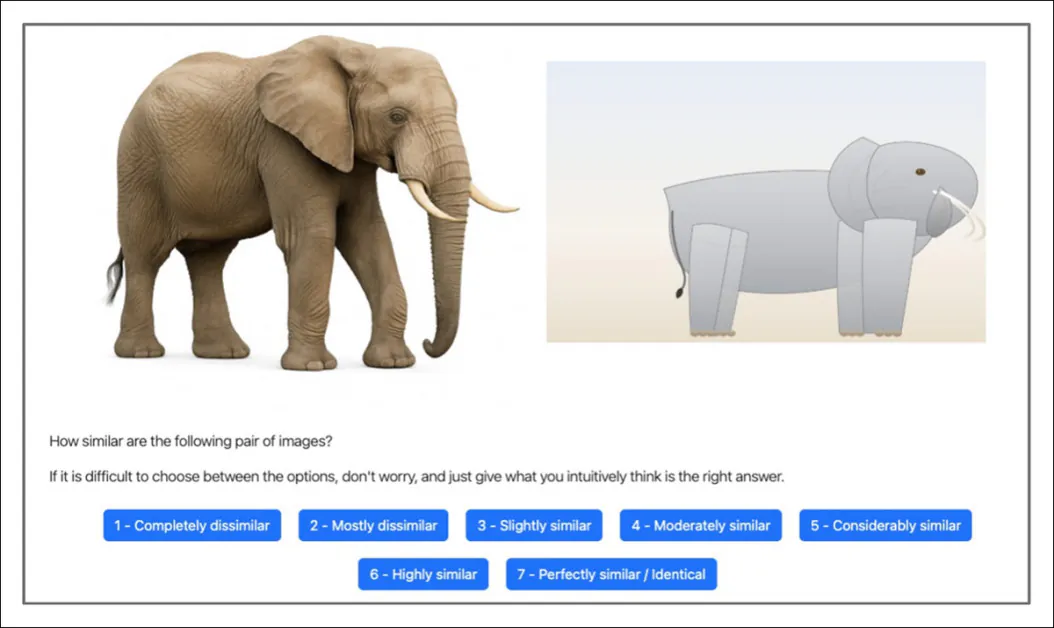

Beide menselijke en AI-deelnemers werden een fotografische referentieafbeelding getoond naast een AI-gegenereerde SVG-reconstructie, en gevraagd om te beoordelen hoe vergelijkbaar de twee waren op een schaal van zeven punten. Bron

In elke ronde gaf één agent hoogwaardige natuurlijke taalinstructies om een codegenerator te leiden, en een ander besloot of de nieuwe versie moest worden behouden of teruggekeerd naar de vorige – een gestructureerde lus die echte samenwerkingswerkstromen weerspiegelt.

Over zestien experimenten met 604 deelnemers en duizenden API-aanroepen, werden volledig door mensen geleide testrondes rechtstreeks vergeleken met volledig door AI geleide rondes, onder anders identieke omstandigheden.

Enkele van de gevarieerde oplossingen die zijn bereikt door verschillende combinaties van menselijke/AI-samenwerkingspercentages en -typen (overgenomen uit een grotere illustratie in het bronpaper, waarvoor we de lezer verwijzen).

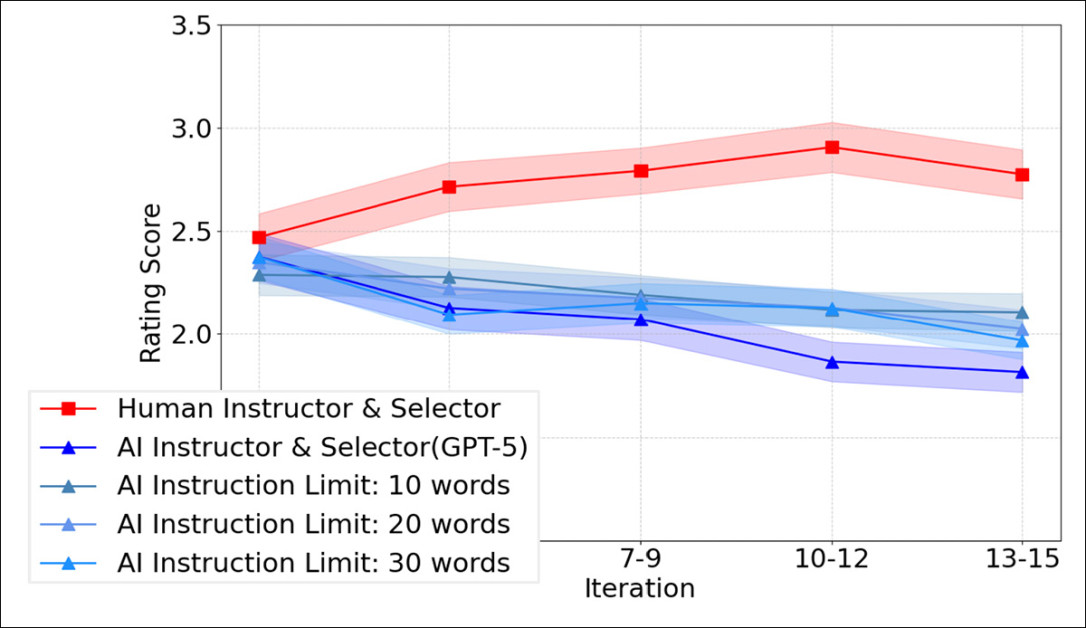

Hoewel mensen en AI op hetzelfde niveau presteerden aan het begin van de tests, vertoonden hun trajecten een afwijking over tijd: wanneer mensen de instructies gaven en de selectiebeslissingen namen, namen de overeenkomstscores toe over iteraties heen, met een gestage cumulatieve verbetering; maar wanneer AI-systemen beide rollen vervulden, toonden de prestaties geen consistente verbetering, en daalden vaak over rondes heen – zelfs als hetzelfde onderliggende model werd gebruikt voor codegeneratie, en de AI toegang had tot dezelfde informatie als menselijke deelnemers.

De Prolixity Effect

De resultaten toonden ook aan dat menselijke instructies meestal kort en actiegericht waren, met een focus op wat er moest worden veranderd in de huidige afbeelding; in tegenstelling tot AI-instructies, die veel langer en zwaar beschrijvend waren (een factor die parametrized was voor GPT-5), en visuele attributen beschreven in plaats van incrementele correctie prioriteit te geven.

Maar, zoals te zien is in de grafiek hieronder, had het opleggen van strikte woordlimieten aan AI-instructies het patroon niet omgekeerd; zelfs wanneer beperkt tot 10, 20 of 30 woorden, faalden AI-geleide ketens nog steeds om te verbeteren over tijd heen:

Overeenkomstbeoordelingen over iteraties voor menselijke ronden in vergelijking met volledig AI-geleide ronden beperkt tot 10, 20 of 30 woorden. Het is duidelijk dat het verkorten van AI-prompt niet voorkomt dat de iteratieve prestatie-afname optreedt wanneer AI zowel instructie als selectie leidt.

Hybride experimenten maakten het patroon duidelijker, waaruit bleek dat het toevoegen van zelfs een kleine hoeveelheid menselijke betrokkenheid de resultaten verbeterde, in vergelijking met volledig AI-geleide opstellingen; maar de prestaties daalden meestal naarmate het aandeel AI-richting toenam.

Wanneer de rollen werden gescheiden, konden evaluatie en selectie met relatief weinig kwaliteitsverlies aan AI worden overgedragen; maar het vervangen van menselijke hoogwaardige instructie door AI-richting leidde tot merkbare dalingen in prestaties, wat suggereert dat het niet uitmaakt wie de code genereert, maar wie de richting vaststelt en onderhoudt over iteraties heen.