Kunstmatige intelligentie

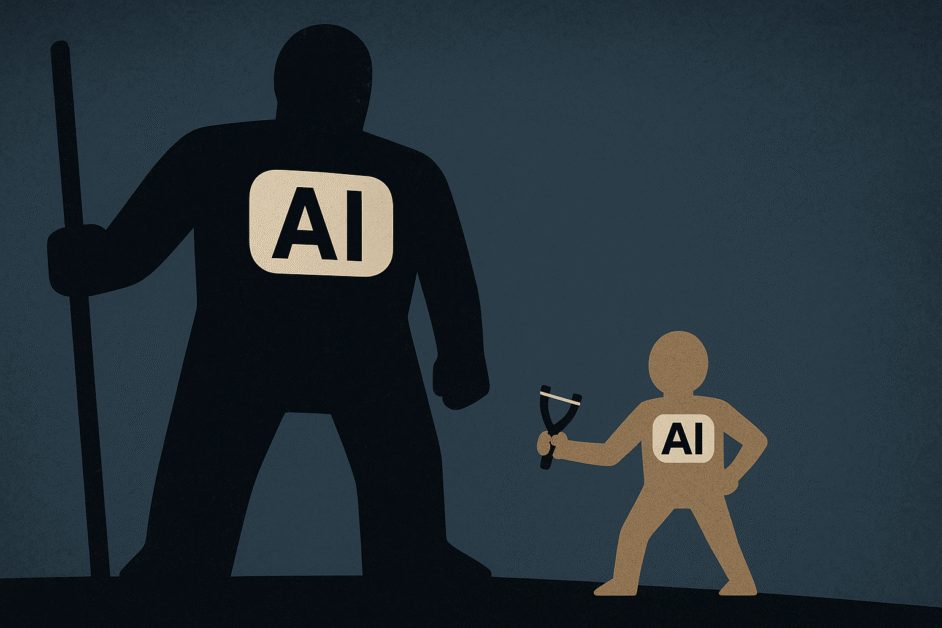

De opstand van het kleine model: waarom kleine AI de reusachtige taalmodellen overtreft

In recente jaren is de kunstmatige intelligentie gevormd door de race om steeds grotere modellen te bouwen. Elk nieuw uitgebracht model werd gemeten aan de hand van het aantal parameters, de grootte van de trainingsdata en de omvang van de infrastructuur erachter. Groter werd geacht beter te zijn. Terwijl technologiebedrijven steeds grotere taalmodellen met honderden miljarden parameters blijven bouwen, vindt er een stille revolutie plaats. Kleine AI-modellen, vaak duizenden keren kleiner dan hun reusachtige tegenhangers, behalen vergelijkbare en soms superieure prestaties op specifieke taken. Deze verschuiving vraagt alles wat we dachten te weten over AI-schaalbaarheid en opent nieuwe mogelijkheden voor gedemocratiseerde, efficiënte kunstmatige intelligentie.

Het verhaal van David en Goliath in de moderne AI

Gedurende jaren heeft de AI-industrie onder de veronderstelling gestaan dat grotere modellen betere prestaties bieden. De GPT-serie van OpenAI is gegroeid van 117 miljoen parameters tot meer dan 175 miljard. PaLM van Google heeft 540 miljard parameters bereikt. Grote technologiebedrijven hebben miljarden dollars geïnvesteerd in het trainen van deze modellen en investeren verder om nog grotere modellen te bouwen. In deze situatie, toen het aantal parameters een sleutelfactor werd om de modelcapaciteit en de AI-capaciteitsopbouw te bepalen en de AI-capaciteitsopbouw een race van computationele middelen en infrastructuuruitgaven werd, begon een interessant fenomeen plaats te vinden in onderzoekscentra over de hele wereld.

Engineers begonnen te ontdekken dat kleinere, zorgvuldig ontworpen modellen de prestaties van deze reuzen konden evenaren of overtreffen op specifieke taken. De Phi-serie van Microsoft heeft aangetoond dat een model met 2,7 miljard parameters kan concurreren met modellen die tien keer zo groot zijn. Meta’s LLaMA heeft bewezen dat modellen met 7 miljard parameters uitzonderlijke resultaten kunnen leveren wanneer ze goed getraind zijn. Deze ontwikkelingen vertegenwoordigen een fundamentele verschuiving in ons begrip van AI-efficiëntie.

Deze paradigma-verschuiving heeft een significante invloed op hoe AI wordt gebruikt en beheerd. Kleine modellen kunnen draaien op consumentenhardware, verzoeken sneller verwerken en een fractie van de energie verbruiken die grote modellen nodig hebben. Ze maken AI toegankelijk voor organisaties die geen toegang hebben tot massale computationele infrastructuur. Het belangrijkste is dat ze de monopolistische tendensen van AI-ontwikkeling uitdagen, waarbij alleen bedrijven met enorme middelen konden concurreren.

De opkomst van efficiënte AI-architectuur

De kleine modelrevolutie bouwt voort op geavanceerde technische benaderingen die de prestaties maximaliseren binnen beperkte parameterbudgetten. Deze modellen gebruiken geavanceerde technieken zoals kennisdistillatie, waarbij kleinere “student”-modellen leren van grotere “leraar”-modellen, essentiële kennis vastleggen en de computationele vereisten aanzienlijk verminderen.

De Phi-4-serie van Microsoft is een voorbeeld van deze benadering. Het Phi-4-redeneringsmodel met slechts 14 miljard parameters, kan concurreren met modellen die vijf keer zo groot zijn in wiskundige redenering en logisch probleemoplossend denken. Evenzo toont het Gemma 3 270M-model van Google aan dat een compact model met 270 miljoen parameters sterke instructievolgcapaciteiten kan bieden en een uitstekende basis kan vormen voor fine-tuning.

Het Llama 3.2 1B-model van Meta is een andere doorbraak in de efficiëntie van kleine modellen. Door middel van gestructureerde pruning en kennisdistillatie van grotere Llama-modellen, behoudt het opmerkelijke prestaties terwijl het efficiënt werkt op edge-apparaten. Deze modellen bewijzen dat architectonische innovatie en trainingsmethodologie belangrijker zijn dan parametercount voor veel echte toepassingen.

De mengeling van experts-architectuur is een significante doorbraak in efficiënte AI-ontwerp. In plaats van alle parameters voor elke taak te gebruiken, activeren deze modellen alleen de relevante gespecialiseerde componenten. Ze routeren verschillende queries naar gespecialiseerde sub-netwerken, waardoor ze een brede capaciteit behouden terwijl ze minder actieve parameters op elk moment gebruiken. Het Mixtral 8x7B-model van Mistral AI demonstreert deze benadering effectief. Ondanks dat het 47 miljard parameters in totaal heeft, activeert het slechts 13 miljard parameters per query, waardoor het prestaties kan behalen die vergelijkbaar zijn met die van veel grotere dichte modellen, terwijl het snellere inferentiesnelheden behoudt.

Quantization-technieken hebben ook een significante impact gehad op het verbeteren van de efficiëntie van kleine modellen. Door modelgewichten met minder bits te representeren, kunnen onderzoekers modellen verkleinen terwijl de nauwkeurigheid behouden blijft. Moderne quantization-methoden kunnen de modelgrootte met 75 procent verkleinen met minimale prestatieverlies. Het Phi-3-mini-model van Microsoft heeft de effectiviteit van deze benadering aangetoond. Wanneer het wordt gequantiseerd naar 4-bits precisie, behoudt het meer dan 95 procent van zijn oorspronkelijke prestaties, terwijl het de geheugeneisen van 7 GB naar minder dan 2 GB vermindert, waardoor het praktischer wordt voor mobiele implementatie.

Specialisatie overtreft generalisatie

De kleine modelrevolutie heeft een belangrijke waarheid over AI-implementatie onthuld. De meeste echte toepassingen hebben geen model nodig dat poëzie kan schrijven, calculus kan oplossen en filosofie kan bespreken. Ze hebben modellen nodig die uitblinken in specifieke taken. Een chatbot voor klantenservice heeft geen kennis van Shakespeare nodig. Een code-completie-tool heeft geen medische kennis nodig. Deze realisatie heeft de focus verschoven van het bouwen van universele modellen naar het creëren van gespecialiseerde modellen.

Domeinspecifieke training laat kleine modellen toe om hun beperkte capaciteit te concentreren op relevante kennis. Een model met 3 miljard parameters dat uitsluitend is getraind op juridische documenten, kan een model met 70 miljard parameters overtreffen in juridische taken. Het gespecialiseerde model leert diepere patronen binnen zijn domein in plaats van capaciteit over talloze ongerelateerde onderwerpen te verspreiden. Het is alsof je een specialistische arts vergelijkt met een algemeen praktijkarts voor complexe procedures.

Fine-tuning-strategieën zijn steeds geavanceerder geworden. In plaats van modellen van scratch te trainen, beginnen ontwikkelaars met kleine basismodellen en passen ze aan aan specifieke behoeften. Deze benadering vereist minimale computationele middelen en produceert hoge, capabele gespecialiseerde modellen. Organisaties kunnen nu aangepaste AI-oplossingen creëren zonder enorme infrastructuurinvesteringen.

Doorbreken van het prestatieplafond

Recente benchmarks onthullen verrassende prestatievoordelen voor kleine modellen in specifieke domeinen. Het Olmo 2 1B-model van AI2 overtreft modellen van vergelijkbare grootte van grote technologiebedrijven in taken voor natuurlijke taalbegrip. Het Phi-4-mini-flash-reasoning-model van Microsoft bereikt tot 10 keer hogere doorvoersnelheden met 2-3 keer lagere latentie in vergelijking met traditionele redeneringsmodellen, terwijl het wiskundige redeneringscapaciteiten behoudt.

De prestatieverschillen worden nog opvallender wanneer specifieke toepassingen worden onderzocht. Kleine modellen die zijn gefinetuned voor gespecialiseerde domeinen presteren consistent beter dan algemene grote modellen in nauwkeurigheid en relevantie. Toepassingen in de gezondheidszorg, juridische documentanalyse en klantenservice-implementaties laten bijzonder indrukwekkende resultaten zien wanneer kleine modellen zijn getraind op domeinspecifieke datasets.

Dit prestatievoordeel komt voort uit gefocuste trainingsbenaderingen. In plaats van brede maar ondiepe kennis over talloze domeinen te leren, ontwikkelen kleine modellen diepe expertise in gerichte gebieden. Het resultaat is meer betrouwbare, contextueel geschikte antwoorden voor specifieke gebruikscases.

De snelheid- en efficiëntievoordeel

Prestaties gaan niet alleen over nauwkeurigheid. Het gaat ook over snelheid, kosten en milieueffecten. Kleine modellen blinken uit in al deze dimensies. Een klein model kan antwoorden genereren in milliseconden waar grote modellen seconden nodig hebben. Dit snelheidsverschil lijkt misschien triviaal, maar het wordt kritisch in toepassingen die real-time interactie of verwerking van miljoenen verzoeken vereisen.

Energieverbruik is een ander kritisch aspect. Grote modellen vereisen enorme datacenters met geavanceerde koelsystemen. Elke query verbruikt aanzienlijke hoeveelheden elektriciteit. Kleine modellen kunnen draaien op standaard servers of zelfs persoonlijke computers, met een fractie van de energie. Terwijl organisaties onder druk staan om hun koolstofvoetafdruk te verminderen, wordt het milieuvoordeel van kleine modellen steeds belangrijker.

Edge-implementatie is misschien wel de meest transformatieve capaciteit van kleine modellen. Deze modellen kunnen rechtstreeks draaien op telefoons, laptops of IoT-apparaten zonder internetverbinding. Stel je voor dat medische diagnostische tools werken in afgelegen gebieden zonder internettoegang, of real-time vertaalapparaten die geen cloudconnectiviteit nodig hebben. Kleine modellen maken deze scenario’s mogelijk en brengen AI-capaciteiten naar miljarden apparaten over de hele wereld.

Privacybezorgdheden geven ook de voorkeur aan kleine modellen. Wanneer AI lokaal draait op gebruikersapparaten, verlaat gevoelige data nooit het apparaat. Zorgverleners kunnen patiëntgegevens analyseren zonder deze naar cloud-servers te uploaden. Financiële instellingen kunnen transacties verwerken zonder klantgegevens bloot te stellen aan externe systemen. Deze lokale verwerkingscapaciteit adresseert een van de belangrijkste bezorgdheden over AI-adoptie in gevoelige industrieën.

De conclusie

De opkomst van kleine AI-modellen daagt de overtuiging uit dat grotere modellen altijd betere prestaties leveren. Compacte modellen met minder parameters kunnen nu concurreren met of zelfs de prestaties van grotere modellen overtreffen in bepaalde taken door gebruik te maken van technieken zoals kennisdistillatie, quantisatie en specialisatie. Deze verandering maakt AI toegankelijker door snellere en energie-efficiëntere gebruikt op alledaagse apparaten mogelijk te maken. Het vermindert ook de kosten, vermindert de milieueffecten en verbetert de privacy door lokale implementatie mogelijk te maken. Door te focussen op efficiënte, taak-specifieke modellen in plaats van massale universele systemen, wordt AI praktischer, betaalbaarder en nuttiger voor zowel organisaties als individuen.