Kunstmatige intelligentie

Het Black Box-probleem in LLM’s: Uitdagingen en opkomende oplossingen

Machine learning, een subset van AI, bestaat uit drie componenten: algoritmes, trainingsgegevens en het resulterende model. Een algoritme, in wezen een set procedures, leert patronen te identificeren uit een grote set voorbeelden (trainingsgegevens). De culminatie van deze training is een machine learning-model. Bijvoorbeeld, een algoritme getraind met afbeeldingen van honden zou resulteren in een model dat in staat is om honden in afbeeldingen te identificeren.

Black Box in Machine Learning

In machine learning kan elk van de drie componenten – algoritme, trainingsgegevens of model – een black box zijn. Terwijl algoritmes vaak openbaar bekend zijn, kunnen ontwikkelaars ervoor kiezen om het model of de trainingsgegevens geheim te houden om intellectueel eigendom te beschermen. Deze duisternis maakt het moeilijk om het beslissingsproces van de AI te begrijpen.

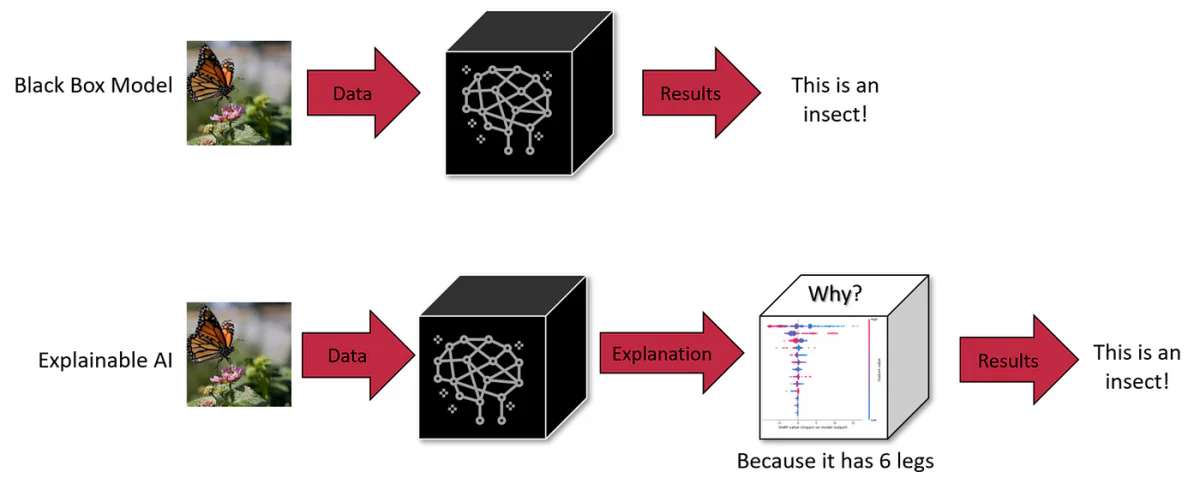

AI-black boxes zijn systemen waarvan de interne werkingen ondoorzichtig of onzichtbaar zijn voor gebruikers. Gebruikers kunnen gegevens invoeren en output ontvangen, maar de logica of code die de output produceert, blijft verborgen. Dit is een gemeenschappelijk kenmerk in veel AI-systemen, waaronder geavanceerde generatieve modellen zoals ChatGPT en DALL-E 3.

LLM’s zoals GPT-4 vormen een significante uitdaging: hun interne werkingen zijn grotendeels ondoorzichtig, waardoor ze “black boxes” zijn. Deze ondoorzichtigheid is niet alleen een technisch puzzel; het gaat ook om echte veiligheids- en ethische zorgen. Als we bijvoorbeeld niet kunnen begrijpen hoe deze systemen tot conclusies komen, kunnen we ze dan vertrouwen in kritieke gebieden zoals medische diagnoses of financiële beoordelingen?

Technieken van LIME en SHAP verkennen

Interpreteerbaarheid in machine learning (ML) en deep learning (DL) modellen helpt ons om in de ondoorzichtige interne werkingen van deze geavanceerde modellen te kijken. Local Interpretable Model-agnostic Explanations (LIME) en SHapley Additive exPlanations (SHAP) zijn twee dergelijke mainstream interpreteerbaarheidstechnieken.

LIME, bijvoorbeeld, breekt de complexiteit af door eenvoudigere, lokale surrogaatmodellen te creëren die het gedrag van het oorspronkelijke model rond een specifieke invoer benaderen. Door dit te doen, helpt LIME bij het begrijpen van hoe individuele kenmerken de voorspellingen van complexe modellen beïnvloeden, waardoor het een ‘lokale’ verklaring geeft voor waarom een model een bepaalde beslissing nam. Het is bijzonder nuttig voor niet-technische gebruikers, omdat het de ingewikkelde beslissingsprocessen van modellen vertaalt in meer begrijpelijke termen.

SHAP, aan de andere kant, haalt inspiratie uit de speltheorie, specifiek het concept van Shapley-waarden. Het wijst een ‘belangrijkheidswaarde’ toe aan elk kenmerk, waarmee wordt aangegeven hoeveel elk kenmerk bijdraagt aan het verschil tussen de werkelijke voorspelling en de basispredictie (de gemiddelde voorspelling over alle invoeren). De kracht van SHAP ligt in zijn consistentie en vermogen om een globaal perspectief te bieden – het legt niet alleen individuele voorspellingen uit, maar geeft ook inzicht in het model als geheel. Dit is vooral waardevol in deep learning-modellen, waar de verbonden lagen en talrijke parameters vaak het voorspellingsproces doen lijken op een reis door een labyrint. SHAP demystificeert dit door de bijdrage van elk kenmerk te kwantificeren, waardoor een duidelijker kaart van de beslissingspaden van het model ontstaat.

SHAP (Source)

Beide LIME en SHAP zijn essentiële tools geworden in het domein van AI en ML, waarmee wordt ingespeeld op de kritieke behoefte aan transparantie en betrouwbaarheid. Naarmate we AI dieper integreren in verschillende sectoren, wordt de mogelijkheid om deze modellen te interpreteren en te begrijpen niet alleen een technische noodzaak, maar een fundamentele vereiste voor ethische en verantwoorde AI-ontwikkeling. Deze technieken vertegenwoordigen significante stappen in het ontrafelen van de complexiteit van ML- en DL-modellen, waardoor ze van ondoorzichtige ‘black boxes’ worden omgevormd tot begrijpelijke systemen waarvan de beslissingen en gedragingen kunnen worden begrepen, vertrouwd en effectief gebruikt.

De schaal en complexiteit van LLM’s

De schaal van deze modellen voegt toe aan hun complexiteit. Neem GPT-3, bijvoorbeeld, met zijn 175 miljard parameters, en nieuwere modellen met triljoenen. Elk parameter werkt op een ingewikkelde manier samen binnen het neurale netwerk, waardoor emergente mogelijkheden ontstaan die niet voorspeld kunnen worden door afzonderlijke componenten te onderzoeken. Deze schaal en complexiteit maken het bijna onmogelijk om hun interne logica volledig te begrijpen, waardoor het een obstakel vormt bij het diagnosticeren van vooroordelen of ongewenst gedrag in deze modellen.

De afweging: schaal versus interpreteerbaarheid

Het verkleinen van de schaal van LLM’s kan de interpreteerbaarheid verbeteren, maar ten koste van hun geavanceerde mogelijkheden. De schaal is wat deze gedragingen mogelijk maakt die kleinere modellen niet kunnen bereiken. Dit presenteert een inherente afweging tussen schaal, mogelijkheid en interpreteerbaarheid.

Impact van het LLM Black Box-probleem

1. Gebrekkig beslissingsproces

De ondoorzichtigheid in het beslissingsproces van LLM’s zoals GPT-3 of BERT kan leiden tot ongedekte vooroordelen en fouten. In domeinen zoals gezondheidszorg of strafrecht, waar beslissingen verstrekkende gevolgen hebben, is de onmogelijkheid om LLM’s te controleren op ethische en logische solide gronden een groot probleem. Bijvoorbeeld, een medisch diagnose-LLM dat vertrouwt op verouderde of vooroordeelbevaste gegevens kan schadelijke aanbevelingen doen. Evenzo kunnen LLM’s in wervingsprocessen onbewust geslachtsvooroordeel in stand houden. De black box-aard verbergt dus niet alleen fouten, maar kan ze ook potentieel versterken, waardoor een proactieve aanpak nodig is om transparantie te verbeteren.

2. Beperkte aanpasbaarheid in diverse contexten

Het gebrek aan inzicht in de interne werkingen van LLM’s beperkt hun aanpasbaarheid. Bijvoorbeeld, een wervings-LLM kan inefficiënt zijn in het evalueren van kandidaten voor een rol die praktische vaardigheden boven academische kwalificaties waardeert, vanwege de onmogelijkheid om zijn evaluatiecriteria aan te passen. Evenzo kan een medisch LLM worstelen met zeldzame ziekte-diagnoses vanwege gegevensonevenwichtigheden. Deze inflexibiliteit benadrukt de noodzaak van transparantie om LLM’s opnieuw te kalibreren voor specifieke taken en contexten.

3. Vooroordeel en kennislacunes

LLM’s verwerken van grote trainingsgegevens is onderhevig aan de beperkingen die worden opgelegd door hun algoritmes en modelarchitecturen. Bijvoorbeeld, een medisch LLM kan demografische vooroordelen vertonen als het getraind is op onevenwichtige datasets. Ook kan de vaardigheid van een LLM in niche-onderwerpen misleidend zijn, waardoor overmoedige, onjuiste uitvoer ontstaat. Het aanpakken van deze vooroordelen en kennislacunes vereist meer dan alleen extra gegevens; het vereist een onderzoek naar de verwerkingsmechanismen van het model.

4. Juridische en ethische aansprakelijkheid

De ondoorzichtige aard van LLM’s creëert een juridisch grijs gebied met betrekking tot aansprakelijkheid voor eventuele schade veroorzaakt door hun beslissingen. Als een LLM in een medische omgeving verkeerde adviezen geeft die leiden tot patiëntschade, wordt het moeilijk om aansprakelijkheid te bepalen vanwege de ondoorzichtigheid van het model. Deze juridische onzekerheid vormt risico’s voor entiteiten die LLM’s in gevoelige gebieden inzetten, waardoor de noodzaak van duidelijke governance en transparantie wordt benadrukt.

5. Vertrouwensproblemen in gevoelige toepassingen

Voor LLM’s die in kritieke gebieden zoals gezondheidszorg en financiën worden gebruikt, ondermijnt de gebrek aan transparantie hun betrouwbaarheid. Gebruikers en regulators moeten ervoor zorgen dat deze modellen geen vooroordelen bevatten of beslissingen nemen op basis van oneerlijke criteria. Het verifiëren van het ontbreken van vooroordelen in LLM’s vereist een begrip van hun beslissingsprocessen, waardoor de belangrijkheid van uitlegbaarheid voor ethische inzet wordt benadrukt.

6. Risico’s met persoonlijke gegevens

LLM’s vereisen uitgebreide trainingsgegevens, die mogelijk gevoelige persoonlijke informatie bevatten. De black box-aard van deze modellen roept zorgen op over de manier waarop deze gegevens worden verwerkt en gebruikt. Bijvoorbeeld, een medisch LLM getraind op patiëntrecords roept vragen op over gegevensprivacy en -gebruik. Het garanderen dat persoonlijke gegevens niet worden misbruikt of uitgebuit, vereist transparante gegevensverwerkingsprocessen binnen deze modellen.

Opkomende oplossingen voor interpreteerbaarheid

Om deze uitdagingen aan te pakken, worden nieuwe technieken ontwikkeld. Deze omvatten counterfactual (CF) benaderingsmethoden. De eerste methode houdt in dat een LLM wordt geprompt om een specifiek tekstconcept te wijzigen terwijl andere concepten constant blijven. Deze aanpak, hoewel effectief, is hulpbronnenintensief op het moment van inferentie.

De tweede aanpak houdt in dat een speciale embeddingruimte wordt gemaakt die wordt geleid door een LLM tijdens de training. Deze ruimte is uitgelijnd met een causale grafiek en helpt bij het identificeren van overeenkomsten die CF’s benaderen. Deze methode vereist minder hulpbronnen op het moment van testen en is effectief gebleken in het verklaren van modelvoorspellingen, zelfs in LLM’s met miljarden parameters.

Deze benaderingen benadrukken het belang van causale verklaringen in NLP-systemen om veiligheid en vertrouwen te garanderen. Counterfactual approximaties bieden een manier om te visualiseren hoe een bepaalde tekst zou veranderen als een bepaald concept in zijn generatieve proces anders was, waardoor een praktische causale effectinschatting van hoogwaardige concepten op NLP-modellen mogelijk wordt.

Diepe duik: verklaringsmethoden en causaliteit in LLM’s

Proberen en feature importance tools

Proberen is een techniek die wordt gebruikt om te ontcijferen wat interne representaties in modellen coderen. Het kan zowel begeleid als onbegeleid zijn en is gericht op het bepalen of specifieke concepten op bepaalde plaatsen in een netwerk worden gecodeerd. Hoewel effectief tot op zekere hoogte, komen probers tekort in het bieden van causale verklaringen, zoals benadrukt door Geiger et al. (2021).

Feature importance tools, een andere vorm van verklaringsmethode, richten zich vaak op invoerkenmerken, hoewel sommige gradient-gebaseerde methoden zich uitstrekken tot verborgen staten. Een voorbeeld is de Integrated Gradients-methode, die een causale interpretatie biedt door baselinestoestanden (counterfactual, CF) te onderzoeken. Ondanks hun nut, worstelen deze methoden nog steeds om hun analyses te verbinden met echte concepten buiten eenvoudige invoereigenschappen.

Interventie-gebaseerde methoden

Interventie-gebaseerde methoden houden in dat invoer of interne representaties worden gewijzigd om de effecten op modelgedrag te bestuderen. Deze methoden kunnen CF-toestanden creëren om causale effecten te schatten, maar ze genereren vaak onwaarschijnlijke invoer of netwerkstaten, tenzij zorgvuldig gecontroleerd. De Causale Proxy Model (CPM), geïnspireerd door het S-learner-concept, is een novatieve aanpak in dit domein, die het gedrag van het uitgelegde model onder CF-invoer imiteert. Echter, de noodzaak voor een afzonderlijke verklarer voor elk model is een significante beperking.

Approximeren van counterfactuals

Counterfactuals worden breed gebruikt in machine learning voor gegevensverrijking, waarbij perturbaties van verschillende factoren of labels worden gemaakt. Deze kunnen worden gegenereerd door middel van handmatige bewerking, heuristische trefwoordvervanging of geautomatiseerde tekstherwerking. Hoewel handmatige bewerking nauwkeurig is, is het ook hulpbronnenintensief. Trefwoordgebaseerde methoden hebben hun beperkingen, en generatieve benaderingen bieden een balans tussen vloeiendheid en dekking.

Getrouwe verklaringen

Getrouwheid in verklaringen verwijst naar het nauwkeurig weergeven van de onderliggende redenering van het model. Er is geen universeel aanvaarde definitie van getrouwheid, waardoor deze wordt gekarakteriseerd door middel van verschillende metrics zoals Gevoeligheid, Consistentie, Feature Importance Overeenkomst, Robustheid en Simuleerbaarheid. De meeste van deze methoden richten zich op kenmerkenniveau-verklaringen en verwarren vaak correlatie met causaliteit. Ons werk is gericht op het bieden van hoogwaardige conceptverklaringen, waarbij de causaliteitsliteratuur wordt gebruikt om een intuïtief criterium voor te stellen: Order-Getrouwheid.

We zijn diep ingedoken in de inherente complexiteit van LLM’s, waarbij we hun ‘black box’-aard en de significante uitdagingen die dit met zich meebrengt, hebben begrepen. Van de risico’s van gebrekkig beslissingsproces in gevoelige gebieden zoals gezondheidszorg en financiën tot de ethische dilemma’s rond vooroordeel en eerlijkheid, is de noodzaak van transparantie in LLM’s nooit eerder zo evident geweest.

De toekomst van LLM’s en hun integratie in ons dagelijks leven en kritieke beslissingsprocessen hangt af van onze mogelijkheid om deze modellen niet alleen geavanceerder te maken, maar ook meer begrijpelijk en aanspreekbaar. Het nastreven van uitlegbaarheid en interpreteerbaarheid is niet alleen een technische onderneming, maar een fundamenteel aspect van het opbouwen van vertrouwen in AI-systemen. Naarmate LLM’s meer in de samenleving worden geïntegreerd, zal de vraag naar transparantie groeien, niet alleen van AI-praktijkmensen, maar van elke gebruiker die met deze systemen interacteert.