Andersons hoek

‘Beschermde’ Afbeeldingen Zijn Gemakkelijker, Niet Moeilijker, Om Te Stelen Met AI

Nieuw onderzoek suggereert dat watermerktools die bedoeld zijn om AI-afbeeldingsbewerkingen te blokkeren, mogelijk tegenwerken. In plaats van modellen zoals Stable Diffusion tegen te houden, kunnen sommige beschermingen de AI helpen om bewerkingsprompts nog nauwkeuriger te volgen, waardoor ongewenste manipulaties nog gemakkelijker worden.

Er is een opvallende en robuuste streng in de computerzichtliteratuur gewijd aan het beschermen van gecopyrighte afbeeldingen tegen training in AI-modellen of gebruik in directe afbeelding>afbeelding AI-processen. Systemen van deze soort zijn over het algemeen gericht op Latent Diffusion Models (LDM’s) zoals Stable Diffusion en Flux, die noise-gebaseerde procedures gebruiken om beeldmateriaal te coderen en decoderen.

Door adversarial noise in te voegen in anders normale afbeeldingen, kan het mogelijk zijn om afbeeldingsdetectoren te laten afbeeldingsinhoud onjuist raden en afbeeldinggenererende systemen te hinderen om gecopyrighte gegevens te exploiteren:

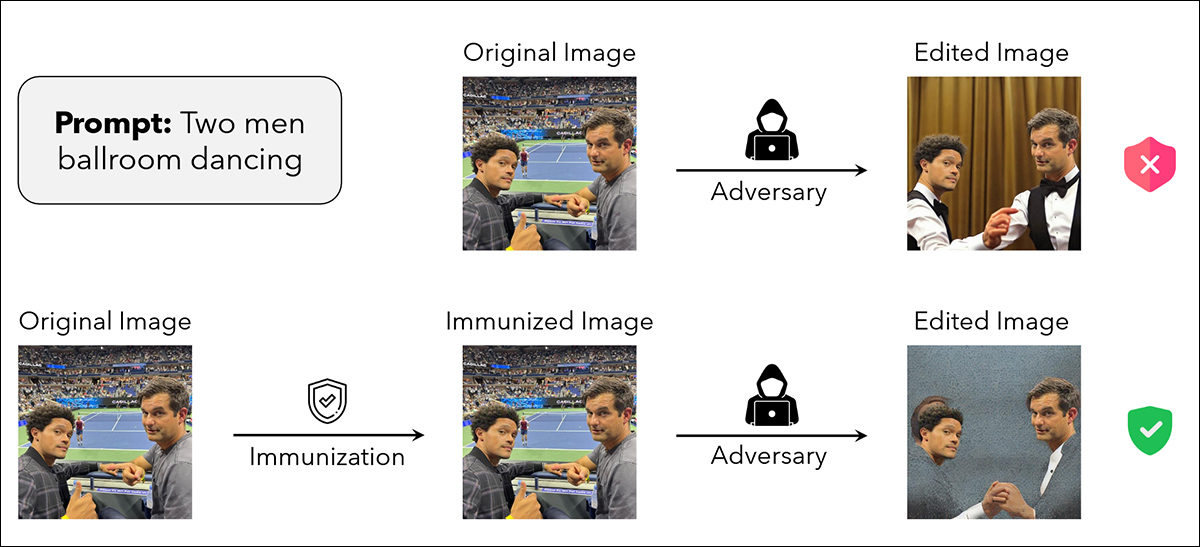

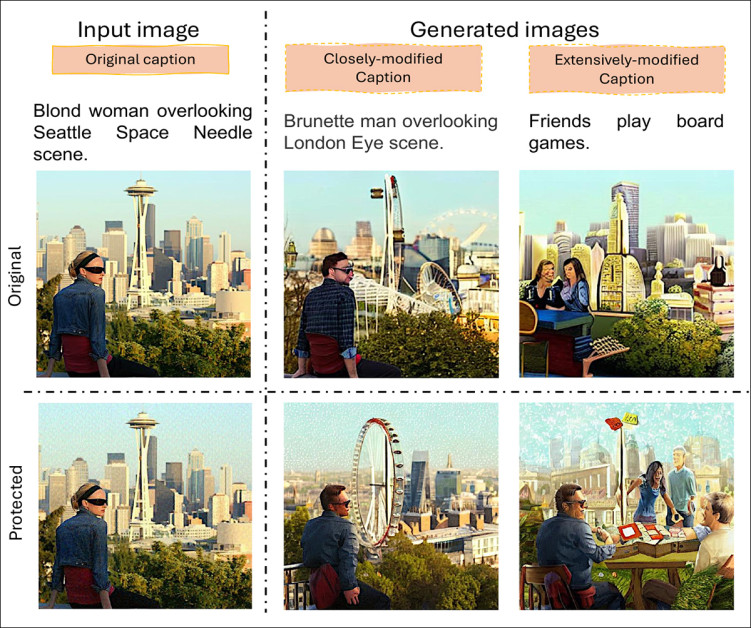

Uit het MIT-paper ‘Raising the Cost of Malicious AI-Powered Image Editing’, voorbeelden van een bronafbeelding ‘geïmmuniseerd’ tegen manipulatie (onderste rij). Bron: https://arxiv.org/pdf/2302.06588

Sinds een artiestenbacklash tegen Stable Diffusion’s liberale gebruik van web-gekrabde beelden (inclusief gecopyrighte beelden) in 2023, heeft de onderzoekssector meerdere variaties op hetzelfde thema geproduceerd – het idee dat afbeeldingen onzichtbaar ‘vergiftigd’ kunnen worden tegen training in AI-systemen of opgenomen in generatieve AI-pijpleidingen, zonder de kwaliteit van de afbeelding nadelig te beïnvloeden voor de gemiddelde kijker.

In alle gevallen is er een directe correlatie tussen de intensiteit van de opgelegde perturbatie, de mate waarin de afbeelding vervolgens wordt beschermd en de mate waarin de afbeelding er niet zo goed uitziet als het zou moeten:

Hoewel de kwaliteit van het onderzoeks-PDF het probleem niet volledig illustreert, offeren grotere hoeveelheden adversarial perturbatie kwaliteit op voor beveiliging. Hier zien we de gamme van kwaliteitsverstoringen in het ‘Fawkes’-project van 2020, geleid door de Universiteit van Chicago. Bron: https://arxiv.org/pdf/2002.08327

Van bijzonder belang voor artiesten die hun stijlen tegen ongeautoriseerde toe-eigening willen beschermen, is de capaciteit van dergelijke systemen om niet alleen identiteit en andere informatie te verhullen, maar om een AI-trainingsproces te ‘overtuigen’ dat het iets anders ziet dan het eigenlijk ziet, zodat verbindingen niet worden gevormd tussen semantische en visuele domeinen voor ‘beschermde’ trainingsgegevens (d.w.z. een prompt zoals ‘In de stijl van Paul Klee’).

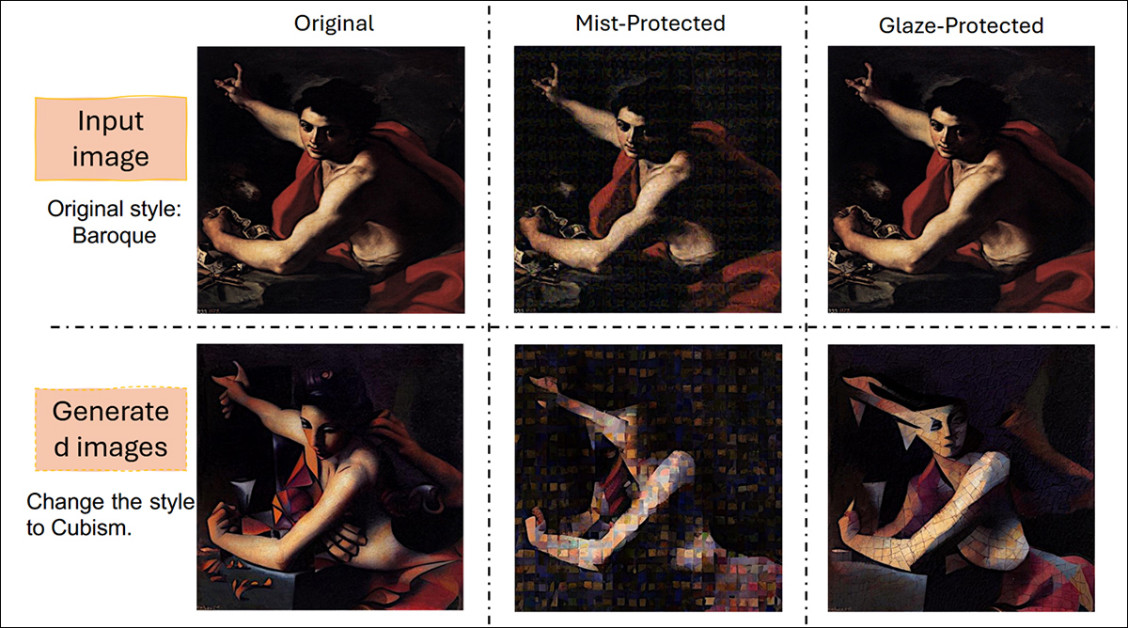

Mist en Glaze zijn twee populaire injectiemethoden die kunnen voorkomen, of op zijn minst ernstig hinderen, dat gecopyrighte stijlen in AI-workflows en trainingsroutines worden gebruikt. Bron: https://arxiv.org/pdf/2506.04394

Eigen Doel

Nu heeft nieuw onderzoek uit de VS ontdekt dat perturbaties niet alleen kunnen falen om een afbeelding te beschermen, maar dat het toevoegen van perturbaties de exploitatie van de afbeelding in alle AI-processen die de perturbatie moet immuniseren, zelfs kan verbeteren.

Het paper zegt:

‘In onze experimenten met verschillende perturbatie-gebaseerde beeldbeschermingsmethoden in meerdere domeinen (natuurlijke scène-afbeeldingen en kunstwerken) en bewerkingsTaken (afbeelding-tot-afbeelding-generatie en stijlbewerking), ontdekken we dat een dergelijke bescherming deze doelstelling niet volledig bereikt.

‘In de meeste scenario’s genereert diffusie-gebaseerde bewerking van beschermde afbeeldingen een gewenst uitvoerbeeld dat nauwkeurig overeenkomt met de richtlijnprompt.

‘Onze bevindingen suggereren dat het toevoegen van ruis aan afbeeldingen paradoxale wijze hun associatie met gegeven tekstprompts tijdens het generatieproces kan verhogen, waardoor ongewenste gevolgen zoals beter resulterende bewerkingen ontstaan.

‘Daarom betogen we dat perturbatie-gebaseerde methoden mogelijk geen voldoende oplossing bieden voor robuuste beeldbescherming tegen diffusie-gebaseerde bewerking.’

In tests werden de beschermde afbeeldingen blootgesteld aan twee vertrouwde AI-bewerkingsscenario’s: rechtstreekse afbeelding-tot-afbeelding-generatie en stijltransfer. Deze processen weerspiegelen de gebruikelijke manieren waarop AI-modellen mogelijk beschermde inhoud kunnen exploiteren, hetzij door de afbeelding rechtstreeks te wijzigen, hetzij door hun stylistische trekken over te nemen voor gebruik elders.

De beschermde afbeeldingen, afkomstig uit standaardbronnen van fotografie en kunst, werden door deze pijpleidingen gehaald om te zien of de toegevoegde perturbaties de bewerkingen konden blokkeren of verslechteren.

In plaats daarvan leek de aanwezigheid van bescherming vaak de modellering van de prompts te scherpen, waardoor schone, nauwkeurige uitvoer werd gegenereerd waar enige mislukking was verwacht.

De auteurs adviseren, in feite, dat deze populaire methode van bescherming mogelijk een vals gevoel van veiligheid biedt en dat elke dergelijke perturbatie-gebaseerde immunisatiebenaderingen grondig moeten worden getest tegen de methoden van de auteurs.

Methode

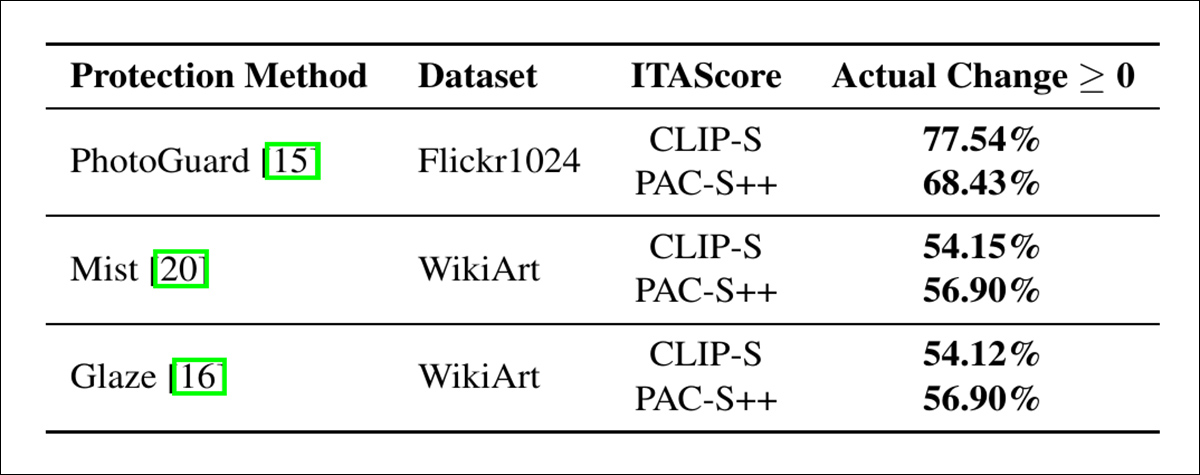

De auteurs voerden experimenten uit met drie beschermingsmethoden die zorgvuldig ontworpen adversarial perturbaties toepassen: PhotoGuard; Mist; en Glaze.

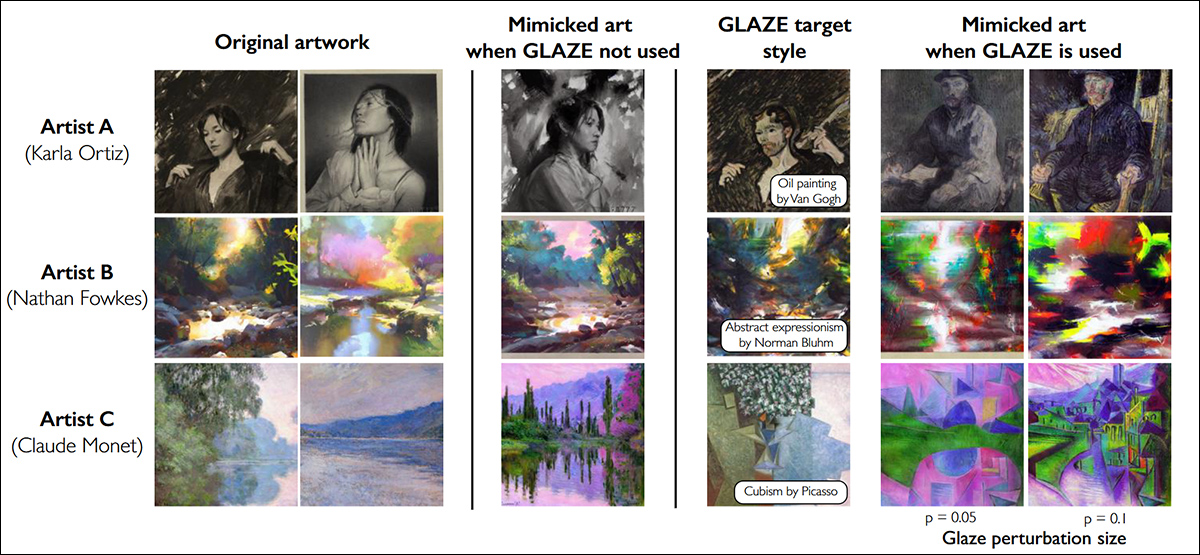

Glaze, een van de frameworks getest door de auteurs, met Glaze-beschermingsvoorbeelden voor drie artiesten. De eerste twee kolommen tonen de oorspronkelijke kunstwerken; de derde kolom toont mimicry-resultaten zonder bescherming; de vierde, stijl-overgedragen versies die voor cloak-optimalisatie worden gebruikt, samen met de doelstijl-naam. De vijfde en zesde kolommen tonen mimicry-resultaten met cloaking toegepast bij perturbatieniveaus p = 0,05 en p = 0,1. Alle resultaten gebruiken Stable Diffusion-modellen. https://arxiv.org/pdf/2302.04222

PhotoGuard werd toegepast op natuurlijke scène-afbeeldingen, terwijl Mist en Glaze op kunstwerken (d.w.z. ‘artistiek-geëtiketteerde’ domeinen) werden gebruikt.

Tests deekten zowel natuurlijke als artistieke afbeeldingen om mogelijke reële toepassingen te reflecteren. De effectiviteit van elke methode werd beoordeeld door te controleren of een AI-model nog steeds realistische en prompt-relevante bewerkingen kon produceren wanneer het werkte met beschermde afbeeldingen; als de resulterende afbeeldingen overtuigend en prompt-relevant waren, werd de bescherming geacht te zijn mislukt.

Stable Diffusion v1.5 werd gebruikt als de voorgetrainde afbeeldinggenerator voor de onderzoeksbewerkingstaken van de onderzoekers. Vijf zaden werden geselecteerd om reproduceerbaarheid te garanderen: 9222, 999, 123, 66 en 42. Alle andere generatie-instellingen, zoals richtlijnenschaal, sterkte en totale stappen, volgden de standaardwaarden die in de PhotoGuard-experimenten werden gebruikt.

PhotoGuard werd getest op natuurlijke scène-afbeeldingen met behulp van de Flickr8k-dataset, die meer dan 8.000 afbeeldingen bevat die zijn gekoppeld aan maximaal vijf onderschriften elk.

Tegenstrijdige Gedachten

Twee sets van gewijzigde onderschriften werden gemaakt van de eerste onderschrift van elke afbeelding met behulp van Claude Sonnet 3.5. Een set bevatte prompts die contextueel dichtbij lagen bij de oorspronkelijke onderschriften; de andere set bevatte prompts die contextueel ver aflagen.

Bijvoorbeeld, van de oorspronkelijke onderschrift ‘Een jong meisje in een roze jurk die een houten hut binnengaat’, zou een dichtbij prompt ‘Een jongen in een blauw shirt die een bakstenen huis binnengaat’ zijn. In tegenstelling daarmee zou een ver prompt ‘Twee katten die op een bank liggen’ zijn.

Dichtbij prompts werden geconstrueerd door zelfstandige naamwoorden en bijvoeglijke naamwoorden te vervangen door semantisch soortgelijke termen; verre prompts werden gegenereerd door de model aan te geven om onderschriften te maken die contextueel zeer verschillend waren.

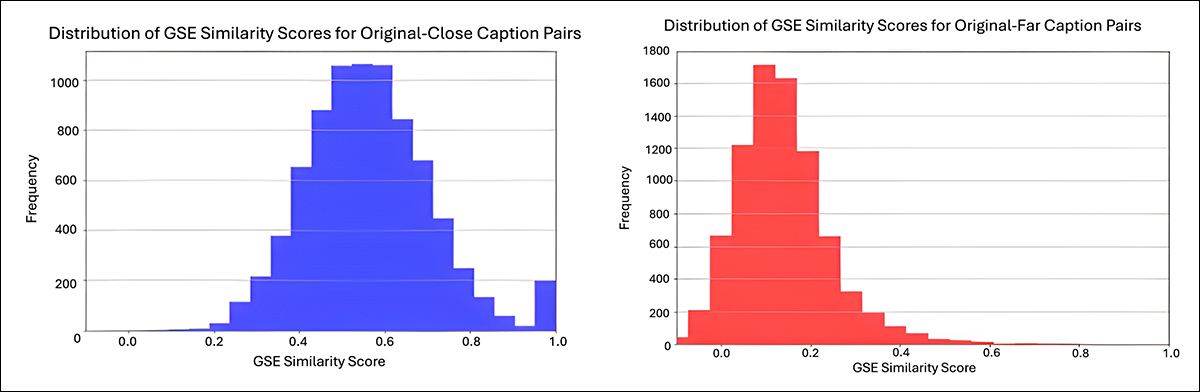

Alle gegenereerde onderschriften werden handmatig gecontroleerd op kwaliteit en semantische relevantie. Google’s Universal Sentence Encoder werd gebruikt om semantische gelijkenheidsscores tussen de oorspronkelijke en gewijzigde onderschriften te berekenen:

Uit het supplementaire materiaal, semantische gelijkenheidsscores voor de gewijzigde onderschriften die in de Flickr8k-tests werden gebruikt. De grafiek links toont de gelijkenheidsscores voor dichtbij gewijzigde onderschriften, gemiddeld rond 0,6. De grafiek rechts toont de uitgebreid gewijzigde onderschriften, gemiddeld rond 0,1, waardoor een grotere semantische afstand van de oorspronkelijke onderschriften ontstaat. Waarden werden berekend met Google’s Universal Sentence Encoder. Bron: https://sigport.org/sites/default/files/docs/IncompleteProtection_SM_0.pdf

Elke afbeelding, samen met de beschermde versie, werd bewerkt met zowel de dichtbij als de verre prompts. De Blind/Referenceless Image Spatial Quality Evaluator (BRISQUE) werd gebruikt om de beeldkwaliteit te beoordelen:

Afbeelding-tot-afbeelding-generatie-resultaten op natuurlijke fotografieën die zijn beschermd door PhotoGuard. Ondanks de aanwezigheid van perturbaties, volgde Stable Diffusion v1.5 de prompts succesvol, zowel kleine als grote semantische veranderingen in de bewerkingsprompts, waardoor realistische uitvoer werd gegenereerd die overeenkwam met de nieuwe instructies.

De gegenereerde afbeeldingen scoorden 17,88 op BRISQUE, met 17,82 voor dichtbij prompts en 17,94 voor verre prompts, terwijl de oorspronkelijke afbeeldingen 22,27 scoorden. Dit toont aan dat de bewerkte afbeeldingen qua kwaliteit dicht bij de oorspronkelijke afbeeldingen bleven.

Metrisch

Om te beoordelen hoe goed de beschermingen de AI-bewerkingen verstoorden, maten de onderzoekers hoe nauwkeurig de eindafbeeldingen overeenkwamen met de instructies die ze kregen, met behulp van scoresystemen die de afbeeldingsinhoud vergeleken met de tekstprompt, om te zien hoe goed ze overeenkwamen.

Daartoe gebruikt de CLIP-S-metrische een model dat zowel afbeeldingen als tekst kan begrijpen om te controleren hoe vergelijkbaar ze zijn, terwijl PAC-S++ extra samples creëert die door AI zijn gemaakt om de vergelijking meer in overeenstemming te brengen met een menselijke schatting.

Deze Beeld-tekst-uitlijningscores (ITA) geven aan hoe nauwkeurig de AI de instructies volgde bij het bewerken van een beschermde afbeelding: als een beschermde afbeelding nog steeds een hooguitgelijnde uitvoer opleverde, betekent dit dat de bescherming gefaald heeft om de bewerking te blokkeren.

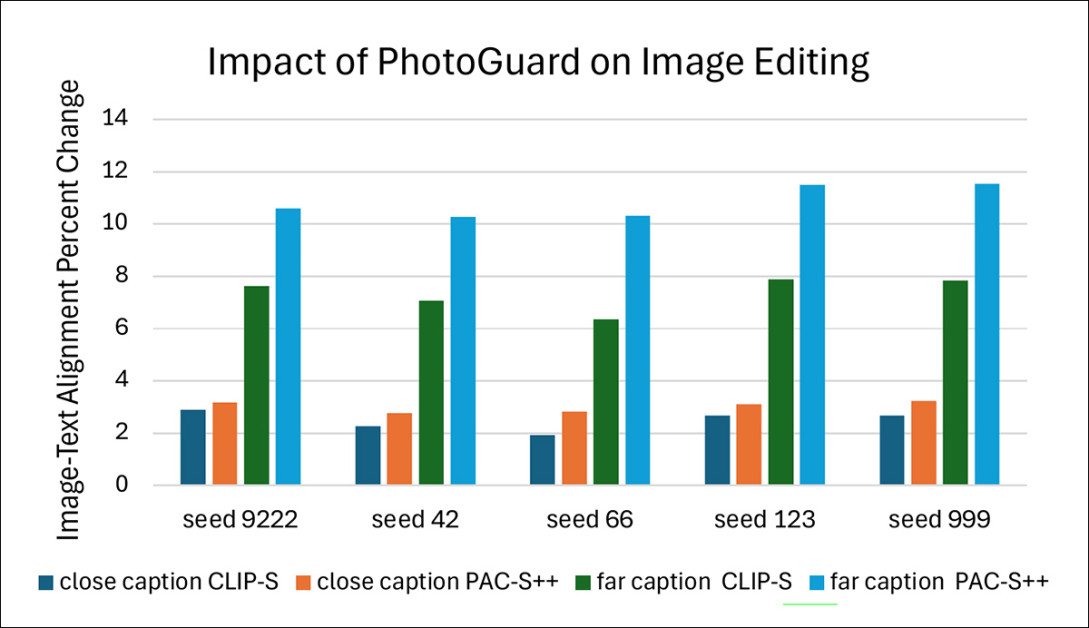

Effect van bescherming op de Flickr8k-dataset over vijf zaden, met zowel dichtbij als verre prompts. Beeld-tekst-uitlijning werd gemeten met behulp van CLIP-S- en PAC-S++-scores.

De onderzoekers vergeleken hoe goed de AI de prompts volgde bij het bewerken van beschermde afbeeldingen versus onbeschermde afbeeldingen. Ze keken eerst naar het verschil tussen de twee, genaamd Daadwerkelijke Verandering. Vervolgens werd het verschil geschaald om een Percentage Verandering te creëren, waardoor het gemakkelijker werd om resultaten over meerdere tests te vergelijken.

Dit onthulde of de beschermingen het voor de AI moeilijker of gemakkelijker maakten om de prompts te volgen. De tests werden vijf keer herhaald met behulp van verschillende willekeurige zaden, waarbij zowel kleine als grote veranderingen in de oorspronkelijke onderschriften werden gedekt.

Kunst Aanval

Voor de tests op natuurlijke fotografieën werd de Flickr1024-dataset gebruikt, die meer dan duizend hoge-kwaliteit afbeeldingen bevat. Elke afbeelding werd bewerkt met prompts die de volgende patroon volgden: ‘Verander de stijl naar [V]’, waar [V] een van de zeven beroemde kunststijlen vertegenwoordigde: Kubisme; Post-Impressionisme; Impressionisme; Surrealisme; Barok; Fauvisme; en Renaissance.

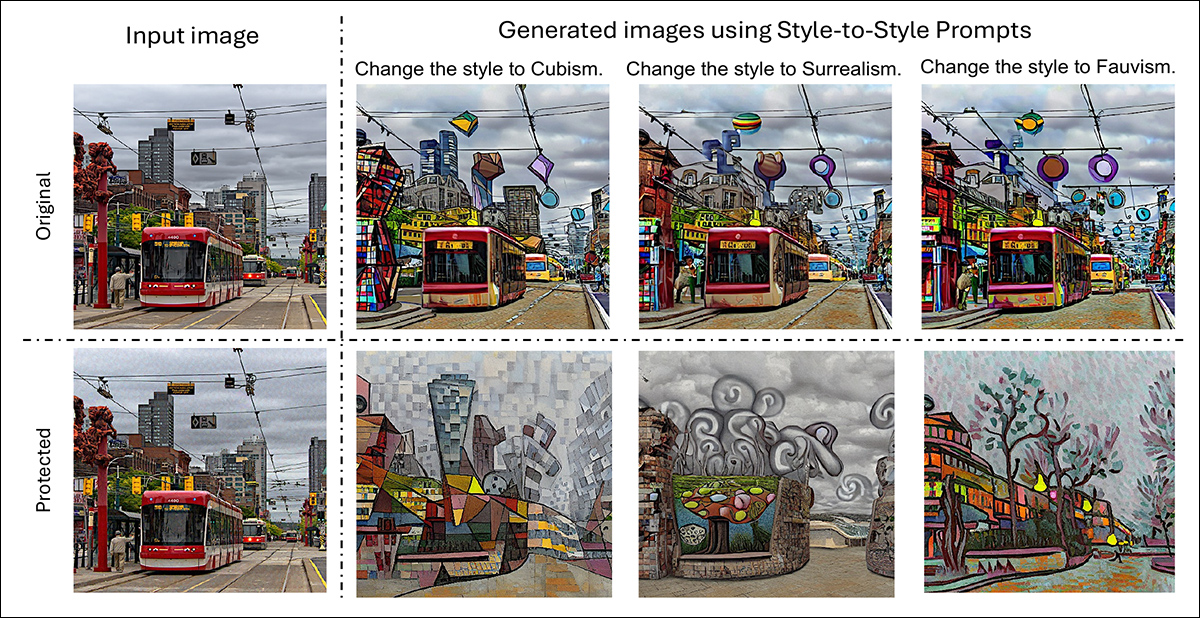

Het proces bestond uit het toepassen van PhotoGuard op de oorspronkelijke afbeeldingen, het genereren van beschermde versies en vervolgens het doorvoeren van zowel beschermde als onbeschermde afbeeldingen door dezelfde set stijltransfer-bewerkingen:

Oorspronkelijke en beschermde versies van een natuurlijke scène-afbeelding, elk bewerkt om Kubisme, Surrealisme en Fauvisme-stijlen toe te passen.

Om beschermingsmethoden op kunstwerken te testen, werd stijltransfer uitgevoerd op afbeeldingen uit de WikiArt-dataset, die een breed scala aan artistieke stijlen verzamelt. De bewerkingsprompts volgden hetzelfde formaat als voorheen, waarbij de AI werd geïnstrueerd om de stijl te veranderen in een willekeurig geselecteerde, niet-gerelateerde stijl uit de WikiArt-labels.

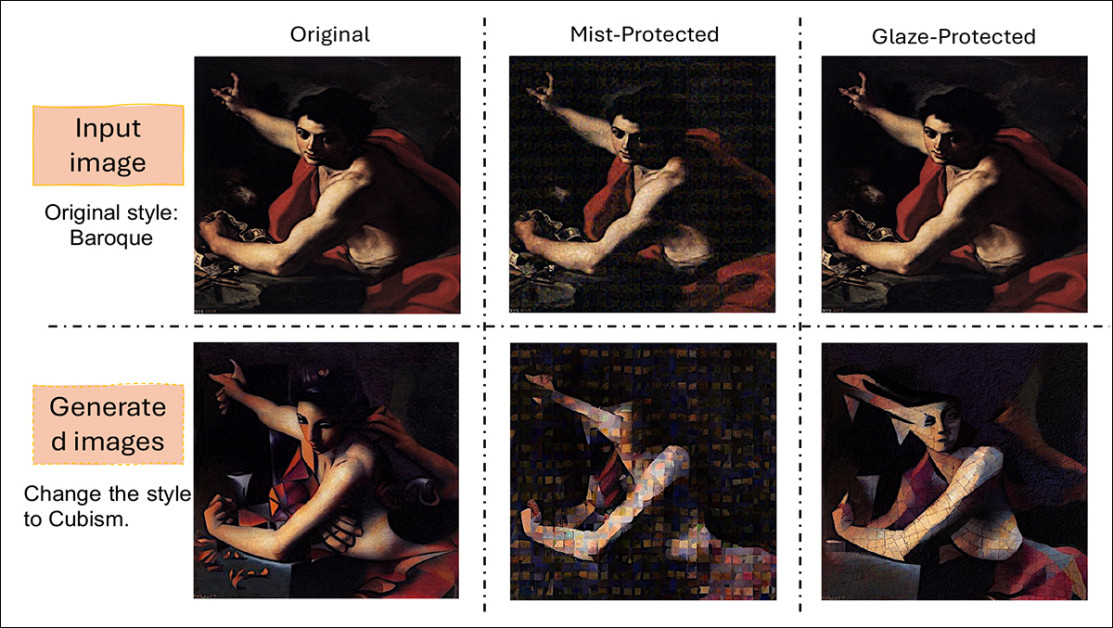

Zowel Glaze als Mist-beschermingsmethoden werden op de afbeeldingen toegepast voordat de bewerkingen werden uitgevoerd, waardoor de onderzoekers konden observeren hoe goed elke verdediging de stijltransfer-resultaten kon blokkeren of verstoren:

Voorbeelden van hoe beschermingsmethoden de stijltransfer op kunstwerken beïnvloeden. De oorspronkelijke Barok-afbeelding wordt weergegeven naast versies die zijn beschermd door Mist en Glaze. Na het toepassen van Kubisme-stijltransfer kunnen de verschillen worden gezien in hoe elke bescherming de einduitvoer verandert.

De onderzoekers testten de vergelijkingen ook kwantitatief:

Veranderingen in beeld-tekst-uitlijningscores na stijltransfer-bewerkingen.

Van deze resultaten merken de auteurs op:

‘De resultaten benadrukken een significante beperking van adversarial perturbaties voor bescherming. In plaats van de uitlijning te verhinderen, verhogen adversarial perturbaties vaak de responsiviteit van het generatieve model voor prompts, waardoor ongewenste gevolgen zoals beter resulterende bewerkingen ontstaan. ‘Dergelijke bescherming is niet storend voor het beeldbewerkingsproces en kan mogelijk niet voorkomen dat kwaadwillige agenten ongeautoriseerd materiaal kopiëren.

‘De onbedoelde gevolgen van het gebruik van adversarial perturbaties onthullen kwetsbaarheden in bestaande methoden en benadrukken de dringende behoefte aan meer effectieve beschermingstechnieken.’

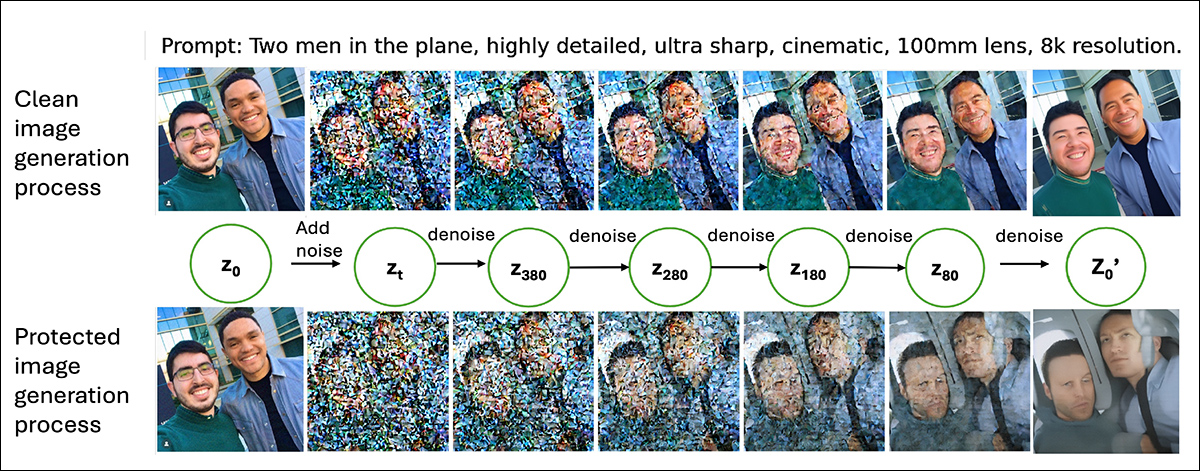

De auteurs leggen uit dat de onverwachte resultaten kunnen worden toegeschreven aan de manier waarop diffusiemodellen werken: LDM’s bewerken afbeeldingen door ze eerst om te zetten in een gecomprimeerde versie genaamd een latent; ruis wordt vervolgens toegevoegd aan deze latent via veel stappen, totdat de gegevens bijna willekeurig worden.

Het model keert dit proces om tijdens de generatie, waarbij de ruis stap voor stap wordt verwijderd. Op elk stadium van deze omkering helpt de tekstprompt bij het bepalen van hoe de ruis moet worden opgeruimd, waardoor de afbeelding langzaam wordt gevormd om overeen te komen met de prompt:

Vergelijking tussen generaties van een onbeschermde afbeelding en een PhotoGuard-beschermde afbeelding, met tussenliggende latente staten omgezet in afbeeldingen voor visualisatie.

Beschermingsmethoden voegen kleine hoeveelheden extra ruis toe aan de oorspronkelijke afbeelding voordat deze het proces ingaat. Hoewel deze perturbaties aanvankelijk klein zijn, accumuleren ze naarmate het model zijn eigen lagen van ruis toevoegt.

Deze ophoping laat meer delen van de afbeelding ‘onzeker’ achter wanneer het model begint met het verwijderen van ruis. Met grotere onzekerheid leunt het model zwaarder op de tekstprompt om de ontbrekende details in te vullen, waardoor de prompt nog meer invloed heeft dan het normaal zou hebben.

In feite maken de beschermingen het voor de AI gemakkelijker om de afbeelding te herschikken om overeen te komen met de prompt, in plaats van moeilijker.

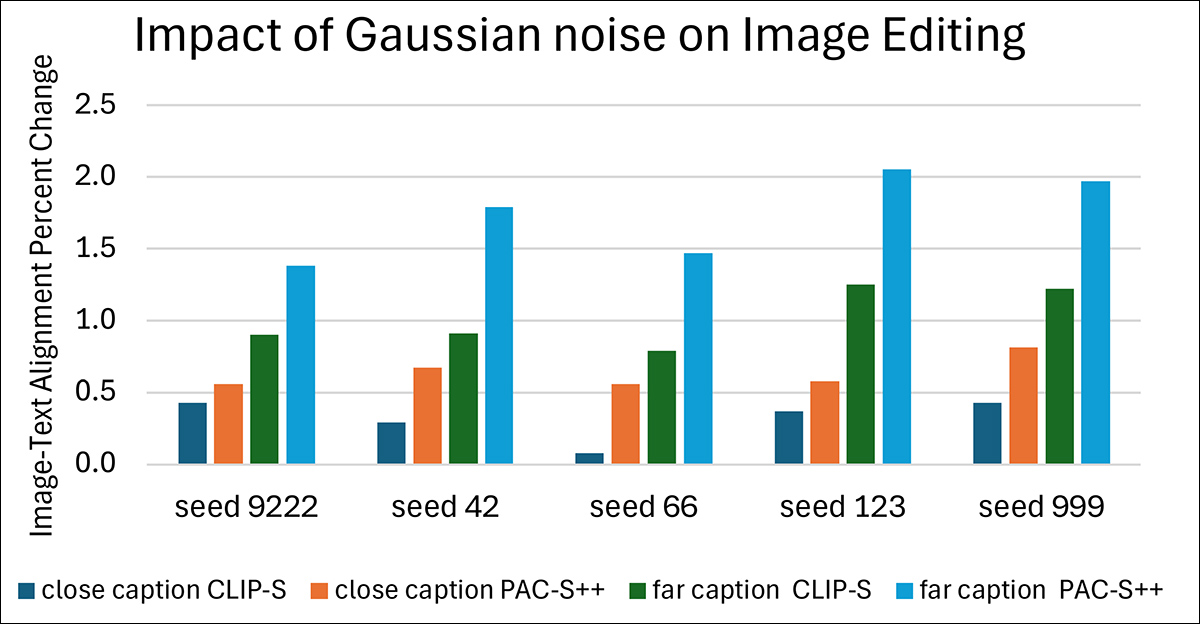

Ten slotte voerden de auteurs een test uit waarbij ze gemaakte perturbaties uit het Raising the Cost of Malicious AI-Powered Image Editing paper vervingen door pure Gaussische ruis.

De resultaten volgden hetzelfde patroon als eerder waargenomen: over alle tests bleven de Percentage Change-waarden positief. Zelfs deze willekeurige, ongestructureerde ruis leidde tot een sterkere uitlijning tussen de gegenereerde afbeeldingen en de prompts.

Effect van gesimuleerde bescherming met behulp van Gaussische ruis op de Flickr8k-dataset.

Dit ondersteunde de onderliggende verklaring dat elke toegevoegde ruis, ongeacht de ontwerp, grotere onzekerheid voor het model creëert tijdens de generatie, waardoor de tekstprompt nog meer controle over de eindafbeelding kan uitoefenen.

Conclusie

De onderzoekssector heeft adversarial perturbatie aan het LDM-copyrightprobleem besteed sinds LDM’s bestaan; maar er zijn geen robuuste oplossingen uit de buitengewone hoeveelheid papers die over dit onderwerp zijn gepubliceerd.

Of de opgelegde verstoringen de kwaliteit van de afbeelding te veel verlagen, of de patronen niet bestand zijn tegen manipulatie en transformatieprocessen.

Het is echter een moeilijke droom om op te geven, omdat het alternatief zou lijken te zijn derdepartij-monitoren en provenance-frameworks zoals het door Adobe geleide C2PA-scheme, dat een keten van bewaring voor afbeeldingen van de camerasensor probeert te behouden, maar dat geen innate verbinding heeft met de weergegeven inhoud.

In elk geval, als adversarial perturbatie het probleem mogelijk erger maakt, zoals het nieuwe paper aangeeft dat in veel gevallen waar kan zijn, vraag je je af of de zoektocht naar copyrightbescherming via dergelijke middelen onder ‘alchemie’ valt.

Eerst gepubliceerd op maandag 9 juni 2025