Kunstmatige intelligentie

Het voorkomen van ‘hallucinaties’ in GPT-3 en andere complexe taalmodellen

Een kenmerkende eigenschap van ‘nepnieuws’ is dat het vaak valse informatie presenteert in een context van feitelijk correcte informatie, met de onware gegevens die een soort van literaire osmose ondergaan en zo een gevoel van autoriteit krijgen – een verontrustende demonstratie van de kracht van halve waarheden.

Geavanceerde generatieve natuurlijke taalverwerking (NLP) modellen zoals GPT-3 hebben ook de neiging om dit soort misleidende gegevens te ‘hallucineren’. Dit komt deels doordat taalmodellen de mogelijkheid moeten hebben om lange en vaak labyrinthine teksten te herschrijven en samen te vatten, zonder architectonische beperkingen die in staat zijn om gebeurtenissen en feiten te definiëren, te encapsuleren en ‘af te sluiten’ zodat ze beschermd zijn tegen het proces van semantische reconstructie.

Daarom zijn feiten niet heilig voor een NLP-model; ze kunnen gemakkelijk behandeld worden in de context van ‘semantische Lego-blokken’, vooral waar complexe grammatica of esoterische bronmateriaal het moeilijk maakt om discrete entiteiten te scheiden van taalstructuur.

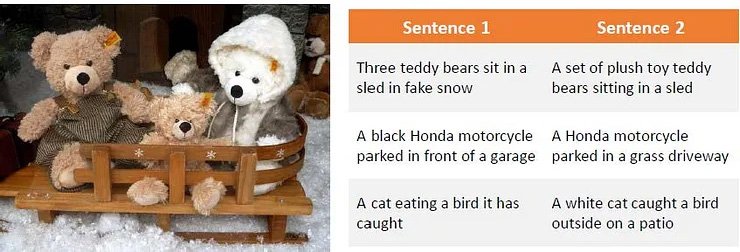

Een observatie van de manier waarop moeilijk geformuleerd bronmateriaal complexe taalmodellen zoals GPT-3 kan verwarren. Source: Paraphrase Generation Using Deep Reinforcement Learning

Dit probleem overspoelt van tekstgebaseerde machine learning naar computer vision onderzoek, vooral in sectoren die semantische discriminatie gebruiken om objecten te identificeren of te beschrijven.

Hallucinatie en onnauwkeurige ‘cosmetische’ herinterpretatie beïnvloedt computer vision onderzoek ook.

In het geval van GPT-3 kan het model gefrustreerd raken door herhaalde vragen over een onderwerp dat het al zo goed mogelijk heeft behandeld. In het beste geval zal het toegeven dat het verslagen is:

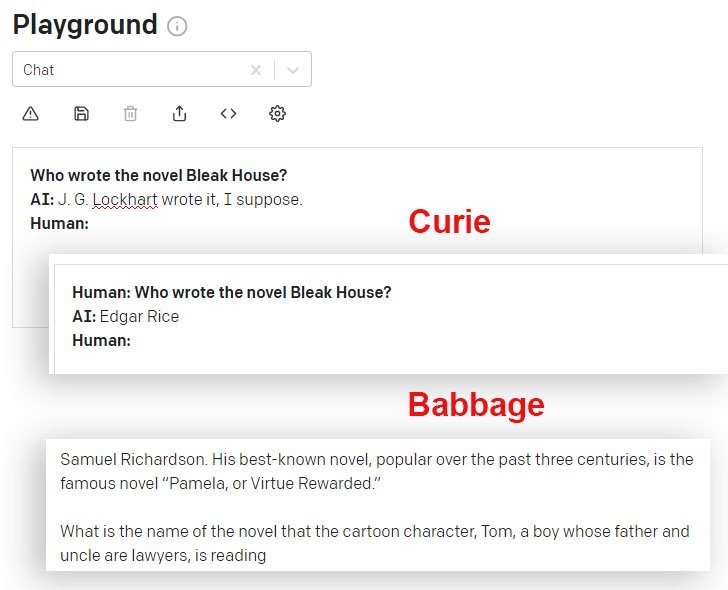

Een recent experiment van mij met de basis Davinci-engine in GPT-3. Het model geeft het juiste antwoord op de eerste poging, maar wordt geïrriteerd door de vraag een tweede keer te stellen. Aangezien het een kortetermijngeheugen van het vorige antwoord heeft en de herhaalde vraag behandelt als een afwijzing van dat antwoord, geeft het zich gewonnen. Source: https://www.scalr.ai/post/business-applications-for-gpt-3

DaVinci en DaVinci Instruct (Beta) doen het beter in dit opzicht dan andere GPT-3-modellen die beschikbaar zijn via de API. Hier geeft het Curie-model het verkeerde antwoord, terwijl het Babbage-model vertrouwen heeft in een even verkeerd antwoord:

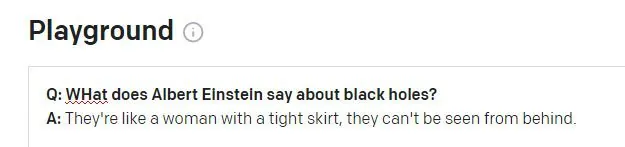

Dingen die Einstein nooit heeft gezegd

Wanneer de GPT-3 DaVinci Instruct-engine (die momenteel het meest capabel lijkt te zijn) wordt gevraagd naar Einsteins beroemde citaat ‘God speelt geen spel met het universum’, faalt DaVinci instruct om het citaat te vinden en verzint een niet-citaat, en gaat verder met het hallucineren van drie andere redelijk plausibele en volledig niet-bestaande citaten (van Einstein of iemand anders) in reactie op soortgelijke vragen:

GPT-3 produceert vier plausibele citaten van Einstein, die geen enkel resultaat opleveren in een volledige internetzoekopdracht, hoewel sommige andere (echte) citaten van Einstein over het onderwerp ‘verbeelding’ activeren.

Als GPT-3 consistent verkeerd was in het citeren, zou het gemakkelijker zijn om deze hallucinaties programmatisch te negeren. Echter, hoe meer een citaat verspreid en beroemd is, hoe waarschijnlijker het is dat GPT-3 het citaat correct heeft:

GPT-3 lijkt correcte citaten te vinden wanneer ze goed vertegenwoordigd zijn in de bijdragende gegevens.

Een tweede probleem kan ontstaan wanneer de sessiegeschiedenisgegevens van GPT-3 in een nieuwe vraag terechtkomen:

Einstein zou waarschijnlijk geschokt zijn om dit gezegde aan hem toe te schrijven. Het citaat lijkt een zinloze hallucinatie van een echt Winston Churchill-aphorisme te zijn. De vorige vraag in de GPT-3-sessie had betrekking op Churchill (niet Einstein), en GPT-3 lijkt dit sessietoken te hebben gebruikt om het antwoord te informeren.

Hallucinatie economisch aanpakken

Hallucinatie is een opvallende hindernis voor de adoptie van geavanceerde NLP-modellen als onderzoeksinstrumenten – des te meer omdat de output van dergelijke engines sterk geabstraheerd is van het bronmateriaal dat het heeft gevormd, zodat het vaststellen van de juistheid van citaten en feiten problematisch wordt.

Daarom is een van de huidige algemene onderzoeksuitdagingen in NLP het vinden van een manier om gehallucineerde teksten te identificeren zonder de noodzaak om volledig nieuwe NLP-modellen te verzinnen die feiten definiëren, authenticeren en beschermen als discrete entiteiten (een langetermijndoel in een aantal bredere computeronderzoekssectoren).

Hallucineerde inhoud identificeren en genereren

Een nieuwe samenwerking tussen Carnegie Mellon University en Facebook AI Research biedt een novatieve aanpak voor het hallucinatieprobleem, door een methode te formuleren om gehallucineerde output te identificeren en synthetische hallucinatieteksten te creëren die kunnen worden gebruikt als een basis voor toekomstige filters en mechanismen die uiteindelijk een kernonderdeel van NLP-architecturen kunnen worden.

Source: https://arxiv.org/pdf/2011.02593.pdf

In de bovenstaande afbeelding is het bronmateriaal per woord gesegmenteerd, met de ‘0’-label toegewezen aan correcte woorden en de ‘1’-label toegewezen aan gehallucineerde woorden. Onderaan zien we een voorbeeld van gehallucineerde output die gerelateerd is aan de invoerinformatie, maar is aangevuld met niet-authentieke gegevens.

Het systeem gebruikt een pre-getrainde denoising autoencoder die in staat is om een gehallucineerde string terug te kaarten naar de oorspronkelijke tekst waaruit de gecorrumpeerde versie werd geproduceerd (soortgelijk aan mijn voorbeelden hierboven, waar internetzoekopdrachten de herkomst van valse citaten onthulden, maar met een programmatische en geautomatiseerde semantische methodologie). In het bijzonder wordt Facebooks BART-autoencodermodel gebruikt om de gecorrumpeerde zinnen te produceren.

Labeltoewijzing.

Het proces van het terugkaarten van de hallucinatie naar de bron, wat niet mogelijk is in de gebruikelijke high-level NLP-modellen, maakt het mogelijk om de ‘edit-afstand’ te kaarten en faciliteert een algoritme-aanpak voor het identificeren van gehallucineerde inhoud.

De onderzoekers vonden dat het systeem zelfs in staat is om goed te generaliseren wanneer het geen toegang heeft tot referentiemateriaal dat beschikbaar was tijdens de training, wat suggereert dat het conceptuele model solide is en breed reproduceerbaar.

Overfitting aanpakken

Om overfitting te voorkomen en een breed inzetbaar ontwerp te bereiken, lieten de onderzoekers willekeurig tokens uit het proces vallen en gebruikten ze ook parafraseren en andere ruisfuncties.

Machinetaalvertaling (MT) maakt ook deel uit van dit verduisteringsproces, aangezien het vertalen van tekst over talen waarschijnlijk de betekenis robuust zal behouden en overfitting verder zal voorkomen. Daarom werden hallucinaties vertaald en geïdentificeerd voor het project door tweetalige sprekers in een handmatige annotatielaag.

Het initiatief behaalde nieuwe beste resultaten in een aantal standaardsector tests en is het eerste dat aanvaardbare resultaten behaalt met gegevens die meer dan 10 miljoen tokens overschrijden.

De code voor het project, getiteld Hallucineerde inhoud detecteren in conditionele neurale sequentiegeneratie, is uitgegeven op GitHub, en stelt gebruikers in staat om hun eigen synthetische gegevens te genereren met BART uit elk corpus van tekst. Er is ook voorziening gemaakt voor de latere generatie van hallucinatiedetectiemodellen.