Kunstmatige intelligentie

Hoe AI het herkennen van gebarentaal nog nauwkeuriger maakt dan ooit

Wanneer we denken aan het doorbreken van communicatiebarrières, richten we ons vaak op taalvertalingapps of spraakassistenten. Maar voor miljoenen mensen die gebarentaal gebruiken, hebben deze tools de kloof nog niet geheel overbrugd. Gebarentaal is niet alleen maar handbewegingen – het is een rijke, complexe vorm van communicatie die gezichtsuitdrukkingen en lichaamstaal omvat, waarbij elk element een cruciale betekenis draagt.

Dit maakt het bijzonder uitdagend: in tegenstelling tot gesproken talen, die voornamelijk verschillen in vocabulaire en grammatica, verschillen gebarentalen over de hele wereld fundamenteel in de manier waarop ze betekenis overdragen. Amerikaanse Gebarentaal (ASL), bijvoorbeeld, heeft zijn eigen unieke grammatica en syntaxis die niet overeenkomt met gesproken Engels.

Deze complexiteit betekent dat het creëren van technologie om gebarentaal in real-time te herkennen en te vertalen een begrip van een hele taalsysteem in beweging vereist.

Een nieuwe aanpak van herkenning

Dit is waar een team aan de Florida Atlantic University’s (FAU) College of Engineering and Computer Science besloot een verse aanpak te nemen. In plaats van te proberen de hele complexiteit van gebarentaal in één keer aan te pakken, richtten ze zich op het beheersen van een cruciale eerste stap: het herkennen van ASL-alfabetgebaren met ongekende nauwkeurigheid via AI.

Stel je voor dat je een computer leert handschriften te lezen, maar in drie dimensies en in beweging. Het team bouwde iets opmerkelijks: een dataset van 29.820 statische afbeeldingen die ASL-handgebaren laten zien. Maar ze verzamelden niet alleen afbeeldingen. Ze markeerden elke afbeelding met 21 sleutelpunten op de hand, waardoor een gedetailleerde kaart ontstond van hoe handen bewegen en verschillende tekens vormen.

Dr. Bader Alsharif, die dit onderzoek leidde als promovendus, legt uit: “Deze methode is niet eerder in eerder onderzoek onderzocht, waardoor het een nieuwe en veelbelovende richting is voor toekomstige vooruitgang.”

De technologie uitgelegd

Laten we dieper duiken in de combinatie van technologieën die dit gebarentaalherkenningssysteem laat werken.

MediaPipe en YOLOv8

De magie gebeurt door de naadloze integratie van twee krachtige tools: MediaPipe en YOLOv8. Denk aan MediaPipe als een expert hand-watcher – een ervaren gebarentolken die elke subtiele vingerbeweging en handpositie kan volgen. Het onderzoeksteam koos MediaPipe specifiek vanwege zijn uitzonderlijke vermogen om nauwkeurige handlandmark-tracking te bieden, waarbij 21 precieze punten op elke hand worden geïdentificeerd, zoals we hierboven vermeldden.

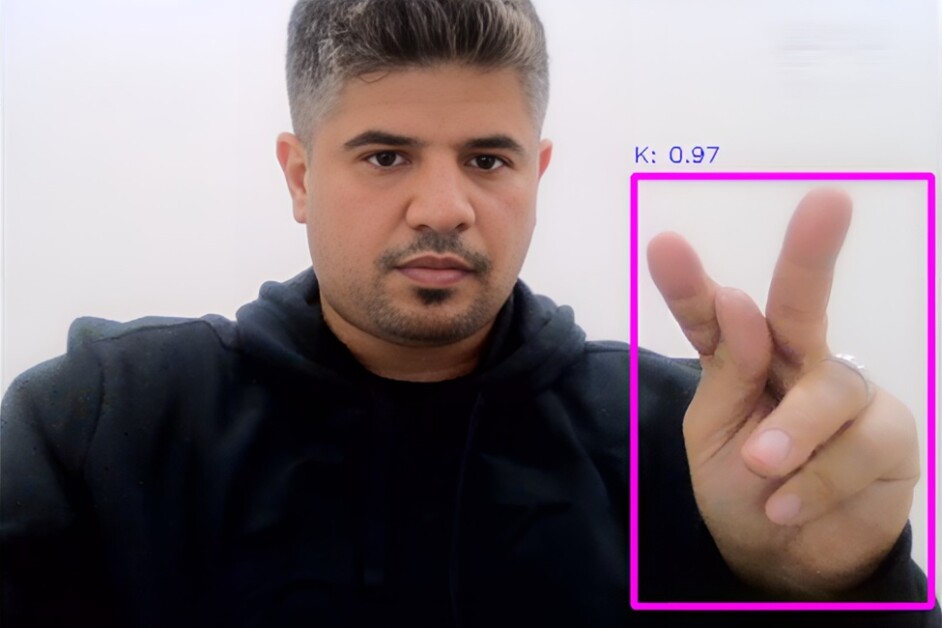

Maar volgen is niet genoeg – we moeten begrijpen wat deze bewegingen betekenen. Daar komt YOLOv8 om de hoek kijken. YOLOv8 is een patroonherkenningsexpert, die al die getrackte punten neemt en bepaalt welk letter of gebaar ze vertegenwoordigen. Het onderzoek toont aan dat wanneer YOLOv8 een afbeelding verwerkt, het deze opdeelt in een S × S-rooster, waarbij elke rooster cel verantwoordelijk is voor het detecteren van objecten (in dit geval handgebaren) binnen zijn grenzen.

Alsharif et al., Franklin Open (2024)

Hoe het systeem werkelijk werkt

Het proces is ingewikkelder dan het op het eerste gezicht lijkt.

Dit is wat er achter de schermen gebeurt:

Handdetectiefase

Wanneer je een teken maakt, identificeert MediaPipe eerst je hand in het kader en maapt die 21 sleutelpunten uit. Deze zijn niet zomaar willekeurige punten – ze komen overeen met specifieke gewrichten en kenmerken op je hand, van vingertoppen tot palm basis.

Ruimtelijke analyse

YOLOv8 neemt dan deze informatie en analyseert deze in real-time. Voor elke rooster cel in de afbeelding, voorspelt het:

- De waarschijnlijkheid van de aanwezigheid van een handgebaar

- De precieze coördinaten van de locatie van het gebaar

- De betrouwbaarheidsscore van zijn voorspelling

Classificatie

Het systeem gebruikt iets dat “begrenzingsvakvoorspelling” wordt genoemd – stel je voor dat je een perfecte rechthoek rond je handgebaar tekent. YOLOv8 berekent vijf cruciale waarden voor elke doos: x- en y-coördinaten voor het centrum, breedte, hoogte en een betrouwbaarheidsscore.

Alsharif et al., Franklin Open (2024)

Waarom deze combinatie zo goed werkt

Het onderzoeksteam ontdekte dat door deze technologieën te combineren, ze iets creëerden dat groter was dan de som van zijn delen. MediaPipe’s precieze tracking in combinatie met YOLOv8’s geavanceerde objectdetectie produceerde opmerkelijk nauwkeurige resultaten – we hebben het over een precisie van 98% en een F1-score van 99%.

Wat dit bijzonder indrukwekkend maakt, is hoe het systeem de complexiteit van gebarentaal aanpakt. Sommige tekens kunnen voor ongetrainde ogen erg op elkaar lijken, maar het systeem kan subtiele verschillen opmerken.

Recordbrekende resultaten

Wanneer onderzoekers nieuwe technologie ontwikkelen, is de grote vraag altijd: “Hoe goed werkt het eigenlijk?” Voor dit gebarentaalherkenningssysteem zijn de resultaten indrukwekkend.

Het team aan de FAU heeft hun systeem grondig getest, en hier zijn de resultaten:

- Het systeem identificeert tekens correct 98% van de tijd

- Het detecteert 98% van alle tekens die voor het worden gemaakt

- De algehele prestatiescore bereikt een indrukwekkende 99%

“Resultaten uit ons onderzoek demonstreren het vermogen van ons model om Amerikaanse Gebarentaalgebaren met heel weinig fouten nauwkeurig te detecteren en te classificeren,” legt Alsharif uit.

Het systeem werkt goed in alledaagse situaties – verschillende verlichting, verschillende handposities en zelfs met verschillende mensen die tekenen.

Deze doorbraak duwt de grenzen van wat mogelijk is in het herkennen van gebarentaal. Eerdere systemen hebben moeite gehad met nauwkeurigheid, maar door MediaPipe’s handtracking te combineren met YOLOv8’s detectievermogen, creëerde het onderzoeksteam iets speciaals.

“Het succes van dit model is grotendeels te wijten aan de zorgvuldige integratie van transfer learning, zorgvuldige datasetcreatie en precieze afstemming,” zegt Mohammad Ilyas, een van de co-auteurs van de studie. Deze aandacht voor detail betaalde zich uit in de opmerkelijke prestaties van het systeem.

Wat dit betekent voor communicatie

Het succes van dit systeem opent opwindende mogelijkheden voor het maken van communicatie toegankelijker en inclusiever.

Het team stopt niet bij het herkennen van letters. De volgende grote uitdaging is het systeem leren om een nog bredere reeks handvormen en gebaren te begrijpen. Denk aan die momenten waarop tekens bijna identiek lijken – zoals de letters ‘M’ en ‘N’ in gebarentaal. De onderzoekers werken eraan om hun systeem deze subtiele verschillen nog beter te laten opmerken. Zoals Dr. Alsharif het zegt: “Belangrijk is dat de resultaten van deze studie niet alleen de robuustheid van het systeem benadrukken, maar ook het potentieel om in praktische, real-time toepassingen te worden gebruikt.”

Het team richt zich nu op:

- Het systeem zo laten werken dat het soepel op reguliere apparaten werkt

- Het zo snel maken dat het geschikt is voor real-time conversaties

- Ervoor zorgen dat het betrouwbaar werkt in elke omgeving

Decaan Stella Batalama van de FAU’s College of Engineering and Computer Science deelt de bredere visie: “Door het herkennen van Amerikaanse Gebarentaal te verbeteren, draagt dit werk bij aan het creëren van tools die de communicatie voor de dove en slechthorende gemeenschap kunnen verbeteren.”

Stel je voor dat je een dokterspraktijk binnenloopt of een klas bijwoont waar deze technologie communicatiebarrières direct overbrugt. Dat is het echte doel hier – het creëren van technologie die mensen echt helpt om verbinding te maken. Of het nu in onderwijs, gezondheidszorg of alledaagse conversaties is, dit systeem vertegenwoordigt een stap naar een wereld waar communicatiebarrières steeds kleiner worden.