Kunstmatige intelligentie

Mistral AI: Nieuwe benchmarks stellen in de open-source ruimte, voorbij Llama2

Grote taalmodellen (LLMs) hebben onlangs het centrum van de aandacht ingenomen, dankzij opvallende prestaties van modellen zoals ChatGPT. Toen Meta hun Llama-modellen introduceerde, ontstond er een hernieuwde interesse in open-source LLMs. Het doel? Het creëren van betaalbare, open-source LLMs die even goed zijn als topmodellen zoals GPT-4, maar zonder de hoge prijs of complexiteit. Deze combinatie van betaalbaarheid en efficiëntie heeft niet alleen nieuwe wegen geopend voor onderzoekers en ontwikkelaars, maar ook het toneel gezet voor een nieuwe era van technologische vooruitgang in natuurlijke taalverwerking. Onlangs hebben generatieve AI-startups een rol van betekenis gespeeld in de financiering. Together heeft 20 miljoen dollar opgehaald, met als doel open-source AI te ontwikkelen. Anthropic heeft een indrukwekkende 450 miljoen dollar opgehaald, en Cohere, in samenwerking met Google Cloud, heeft 270 miljoen dollar opgehaald in juni van dit jaar.

Introductie van Mistral 7B: Grootte & Beschikbaarheid

Hugging Face Mistral 7B Example

Prestatiebenchmarking

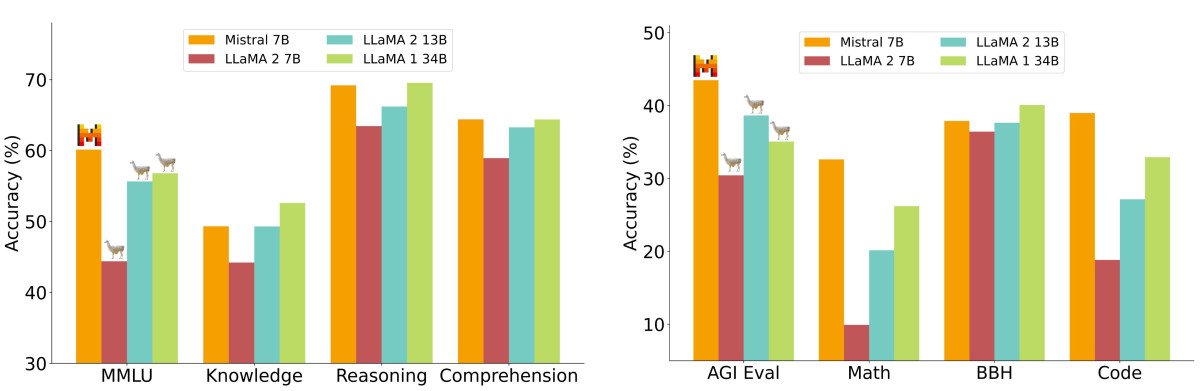

In een gedetailleerde prestatieanalyse werd Mistral 7B gemeten tegen de Llama 2-familie modellen. De resultaten waren duidelijk: Mistral 7B overschrijdt de Llama 2 13B aanzienlijk in alle benchmarks. In feite komt het overeen met de prestaties van Llama 34B, vooral uitblinkend in code- en redeneerbewijsbenchmarks.

Wat maakt het Mistral 7B-model eigenlijk beter dan de meeste andere taalmodellen?

Vereenvoudiging van aandachtsmechanismen Terwijl de subtiliteiten van aandachtsmechanismen technisch zijn, is hun fundamentale idee relatief eenvoudig. Stel je voor dat je een boek leest en belangrijke zinnen markeert; dit is analoog aan hoe aandachtsmechanismen “markeert” of belang hecht aan specifieke gegevenspunten in een sequentie. In de context van taalmodellen maken deze mechanismen het mogelijk voor het model om te focussen op de meest relevante delen van de invoergegevens, waardoor de uitvoer coherent en contextueel accuraat is. In standaardtransformatoren worden aandachtscores berekend met de formule:

De formule voor deze scores omvat een cruciale stap – de matrixvermenigvuldiging van Q en K. De uitdaging hier is dat als de sequentielengte toeneemt, beide matrices dienovereenkomstig uitbreiden, wat leidt tot een computationeel intensief proces. Deze schaalbaarheidszorg is een van de belangrijkste redenen waarom standaardtransformatoren langzaam kunnen zijn, vooral bij het omgaan met lange sequenties.

Grouped-query Aandacht (GQA)

GQA is een tussenoplossing. In plaats van het gebruik van slechts één of meerdere ‘key-value’ heads, groepeert het ze. Op deze manier bereikt GQA een prestatie die dicht bij de gedetailleerde multi-head aandacht ligt, maar met de snelheid van MQA. Voor modellen zoals Mistral betekent dit efficiënte prestaties zonder te veel in te boeten op kwaliteit.

Sliding Window Aandacht (SWA)

Transparantie van Mistral AI versus veiligheidszorgen in decentralisatie

In hun aankondiging benadrukte Mistral AI ook transparantie met de verklaring: “Geen trucs, geen propriëtaire gegevens.” Maar hun enige beschikbare model op dit moment, ‘Mistral-7B-v0.1’, is een pregetraind basismodel, dus het kan een reactie geven op elke query zonder moderatie, wat potentiële veiligheidszorgen oproept. Terwijl modellen zoals GPT en Llama mechanismen hebben om te bepalen wanneer ze moeten reageren, kan de volledig gedecentraliseerde aard van Mistral worden uitgebuit door slechte actoren. Echter, de decentralisatie van Large Language Models heeft zijn verdiensten. Terwijl sommigen het kunnen misbruiken, kunnen mensen de kracht ervan gebruiken voor het algemeen welzijn en om intelligentie toegankelijk te maken voor iedereen.

Implementatieflexibiliteit

Een van de highlights is dat Mistral 7B beschikbaar is onder de Apache 2.0-licentie. Dit betekent dat er geen echte barrières zijn voor het gebruik ervan – of je het nu gebruikt voor persoonlijke doeleinden, een groot bedrijf of zelfs een overheidsentiteit. Je hebt alleen het juiste systeem nodig om het te draaien, of je moet investeren in cloudresources. Terwijl er andere licenties zijn, zoals de eenvoudigere MIT-licentie en de coöperatieve CC BY-SA-4.0, die krediet en vergelijkbare licenties voor afgeleiden vereist, biedt Apache 2.0 een solide basis voor grote ondernemingen.

Slotgedachten

De opkomst van open-source Large Language Models zoals Mistral 7B markeert een belangrijke verschuiving in de AI-industrie, waardoor hoge kwaliteit taalmodellen toegankelijk worden voor een bredere doelgroep. Mistral AI’s innovatieve benaderingen, zoals Grouped-query aandacht en Sliding Window Aandacht, beloven efficiënte prestaties zonder in te boeten op kwaliteit. Terwijl de gedecentraliseerde aard van Mistral bepaalde uitdagingen met zich meebrengt, onderstreept de flexibiliteit en open-source licentie het potentieel voor het democratiseren van AI. Naarmate het landschap evolueert, zal de focus onvermijdelijk liggen op het vinden van een balans tussen de kracht van deze modellen en ethische overwegingen en veiligheidsmechanismen. Wat komt er hierna voor Mistral? Het 7B-model was slechts het begin. Het team heeft als doel om nog grotere modellen te lanceren. Als deze nieuwe modellen de prestaties van de 7B evenaren, kan Mistral snel opklimmen als een topspeler in de industrie, allemaal binnen hun eerste jaar.