Partnerschappen

Infineon Technologies en d-Matrix gaan samenwerken aan lage-latentie-AI-infrastructuur

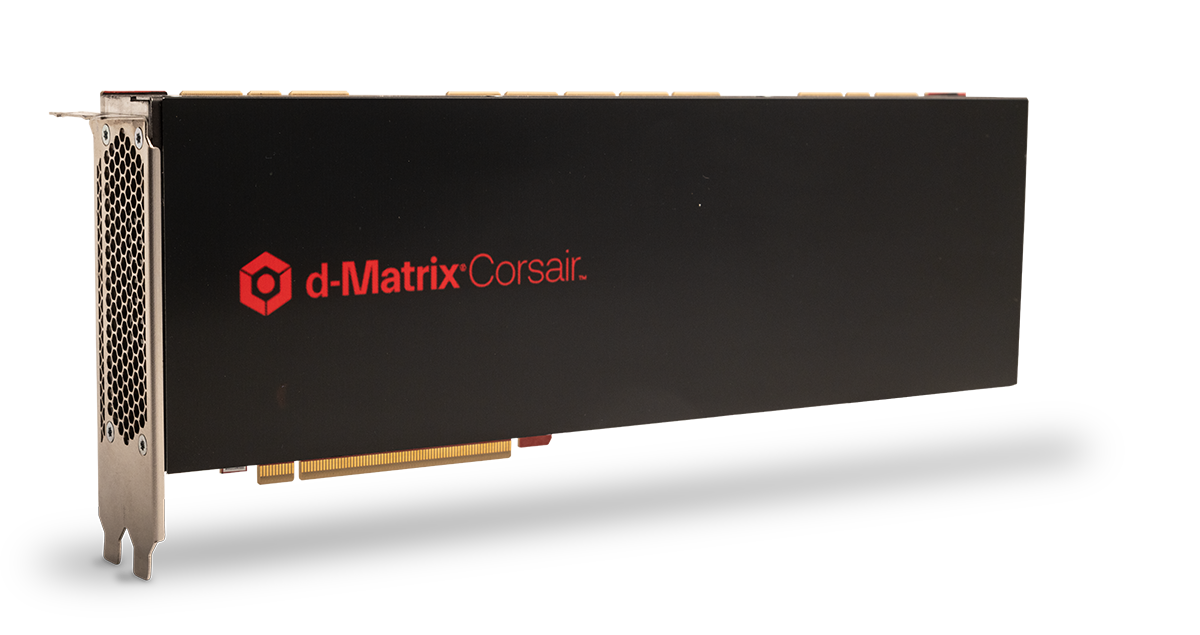

Infineon Technologies heeft aangekondigd een samenwerking met d-Matrix gericht op het verbeteren van de prestaties en energie-efficiëntie van AI-inferentiesystemen die worden gebruikt in moderne datacenters. De samenwerking draait om d-Matrix’s Corsair AI-inferentieversnellerplatform en Infineon’s OptiMOS dual-phase vermogenseenheden, die zijn ontworpen om hoge-dichtheidcompute-omgevingen voor interactieve AI-werklasten te ondersteunen.

De aankondiging benadrukt een groeiende verschuiving binnen de AI-hardware-industrie. Terwijl een groot deel van de infrastructuurgroei in de afgelopen jaren zich richtte op het trainen van steeds grotere AI-modellen, breidt de industrie zich nu snel uit naar inferentie — het proces van het daadwerkelijk uitvoeren van modellen in real-worldtoepassingen zoals chatbots, agente AI-systemen, copilots, zoekopdrachten, financiële analyses en besluitvorming in de gezondheidszorg. Deze werklasten stellen andere eisen aan hardware, met name rondom latentie, responsiviteit en energieverbruik.

Waarom AI-inferentie een belangrijk slagveld voor hardware wordt

AI-inferentie is een van de snelst groeiende segmenten van de AI-infrastructuurmarkt geworden, omdat interactieve AI-systemen antwoorden in milliseconden nodig hebben in plaats van seconden. d-Matrix heeft Corsair specifiek voor deze werklasten gepositioneerd, met de nadruk op ultra-lage latentie en energie-efficiënte inferentie voor grote taalmodellen en AI-agents.

Volgens d-Matrix is Corsair ontworpen rondom een digitale in-memory compute-architectuur die bedoeld is om de geheugengebreken te verminderen die vaak de generatieve AI-inferentie vertragen. Het bedrijf beweert dat het platform de latentie aanzienlijk kan verlagen en de doorvoer kan verbeteren in vergelijking met traditionele GPU-georiënteerde inferentiesystemen, met name voor interactieve toepassingen.

De samenwerking met Infineon richt zich op een andere steeds kritieker wordende uitdaging: stroomlevering.

Naarmate AI-servers in dichtheid toenemen, is het efficiënt leveren van stroom aan versnellers een beperkende factor voor het schalen van infrastructuur geworden. Infineon’s OptiMOS TDM2254xx-modules zijn ontworpen voor verticale stroomleveringsarchitecturen die helpen om elektrische verliezen te verminderen en de stroomdichtheid in compacte serversystemen te verbeteren.

De verschuiving naar real-time AI-systemen

De bedrijven hebben de samenwerking geframd rondom de opkomst van “interactieve AI”, waarbij inferentiesystemen continu uitvoer moeten genereren met extreem lage vertraging. Dat omvat conversational AI, AI-agents, real-time redeneringssystemen en toepassingen die snelle token-generatie van grote taalmodellen vereisen.

d-Matrix-oprichter en CEO Sid Sheth zei dat de architectuur achter Corsair specifiek is ontworpen voor sub-2 milliseconden token-latentie, een meting die steeds belangrijker wordt nu bedrijven AI-systemen van experimenten naar klantgerichte omgevingen verplaatsen.

De bredere AI-industrie begint ook te erkennen dat inferentie-infrastructuur mogelijk anders evolueert dan trainingsinfrastructuur. Terwijl GPU-clusters de eerste fase van de expansie van generatieve AI domineerden, beloont inferentie steeds vaker architecturen die zijn geoptimaliseerd voor geheugengroottes, latentie, netwerken en energie-efficiëntie in plaats van alleen brute rekenkracht.

Energie-efficiëntie wordt centraal voor AI-schaling

Een van de grootste beperkingen waarmee hyperscalers en AI-cloudproviders worden geconfronteerd, is het elektriciteitsverbruik. AI-inferentiewerklasten kunnen continu draaien over miljoenen verzoeken per dag, waardoor operationele efficiëntie kritisch is voor implementatiekosten.

Infineon heeft zijn positie binnen AI-infrastructuur agressief uitgebreid via halfgeleidertechnologieën op basis van silicium, siliciumcarbide (SiC) en galliumnitride (GaN). Het bedrijf heeft zich steeds meer gericht op het leveren van de stroomleveringslaag onder AI-versnellers en server-infrastructuur.

De samenwerking met d-Matrix weerspiegelt hoe halfgeleiderbedrijven steeds nauwer geïntegreerd raken met AI-versnellerstartups, nu de industrie op zoek is naar alternatieven voor conventionele GPU-zware architecturen.

AI-infrastructuur breidt zich uit voorbij traditionele GPUs

De samenwerking komt tijdens een bredere golf van experimenten in AI-hardware. Een groeiend aantal startups ontwikkelt gespecialiseerde versnellers die specifiek zijn gericht op inferentie, geheugengeoriënteerd rekenen of AI-netwerken.

d-Matrix heeft zich onderscheiden door zijn nadruk op compute-in-memory-technologieën en lage-latentie-inferentiesystemen die zijn afgestemd op generatieve AI. Het bedrijf heeft zijn infrastructuurstrategie ook uitgebreid voorbij alleen versnellerchips, waarbij onlangs de nadruk is gelegd op netwerken, composable infrastructuur en full-systemoptimalisatie voor inferentieclusters.

Naarmate AI-toepassingen steeds interactiever en agenter worden, zullen infrastructuurproviders naar verwachting meer nadruk leggen op het verlagen van latentie, het verlagen van energieverbruik en het verbeteren van systeemniveau-efficiëntie over hele datacenterstacks, in plaats van zich alleen te richten op brute rekenkracht.