Kunstmatige intelligentie

Ontwarping is de volgende diepe valse revolutie

CGI-gegevensverrijking wordt gebruikt in een nieuw project om meer controle te krijgen over diepe valse beelden. Hoewel u nog steeds geen CGI-hoofden effectief kunt gebruiken om de ontbrekende gaten in diepe valse gezichtsdatasets op te vullen, betekent een nieuwe golf van onderzoek naar het ontwarren van identiteit van context dat u dit binnenkort mogelijk niet meer hoeft te doen.

De makers van enkele van de meest succesvolle virale diepe valse video’s van de afgelopen jaren selecteren hun bronvideo’s zeer zorgvuldig, waarbij ze gestaagde profielfoto’s (d.w.z. het soort zij-aanzichten dat populair is gemaakt door politie-arresteringsprocedures), acute hoeken en ongebruikelijke of overdreven uitdrukkingen vermijden. Steeds vaker zijn de demonstratievideo’s die door virale diepe valse makers worden geproduceerd, bewerkte compilaties die de ‘makkelijkste’ hoeken en uitdrukkingen selecteren om diepe valse te maken.

In feite is de meest geschikte doelvideo om een diepe valse beroemdheid in te voegen een video waarin de oorspronkelijke persoon (wiens identiteit wordt gewist door de diepe valse) rechtstreeks in de camera kijkt, met een minimaal bereik aan uitdrukkingen.

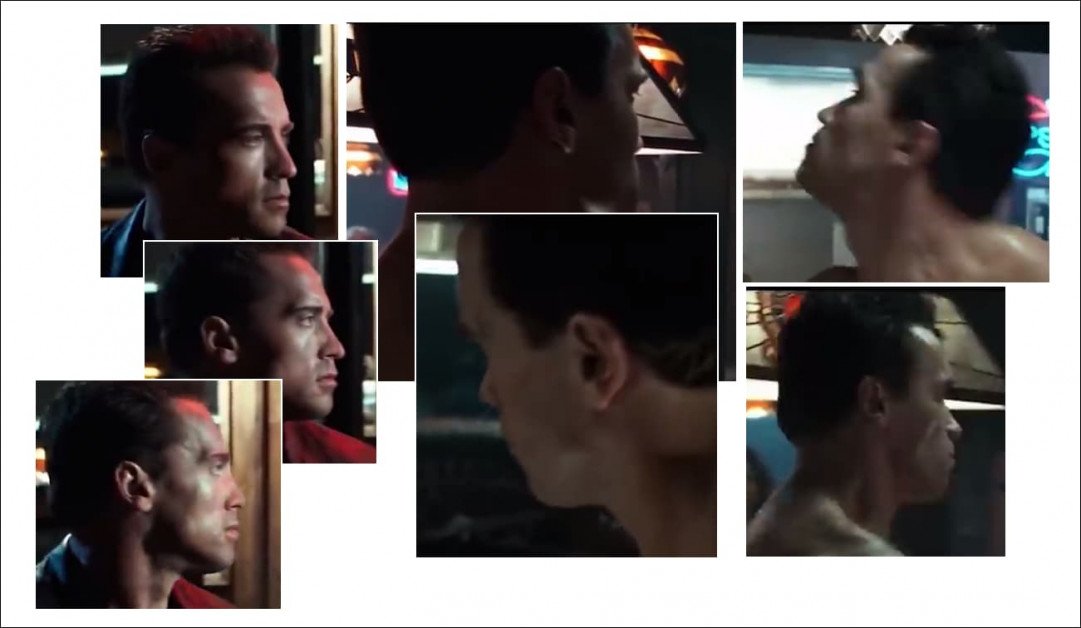

De meerderheid van de populaire diepe valse van de afgelopen jaren heeft onderwerpen getoond die rechtstreeks in de camera kijken, en ofwel alleen maar populaire uitdrukkingen (zoals glimlachen), die gemakkelijk kunnen worden geëxtraheerd uit rode loper-paparazzi-uitvoer, of (zoals bij de valse van Sylvester Stallone als de Terminator, links afgebeeld), ideaal met helemaal geen uitdrukking, aangezien neutrale uitdrukkingen extreem gewoon zijn, waardoor ze gemakkelijk in diepe valse modellen kunnen worden geïntegreerd.

Omdat diepe valse technologieën zoals DeepFaceLab en FaceSwap deze eenvoudige swaps heel goed uitvoeren, zijn we voldoende verblind door wat ze bereiken om niet te merken wat ze niet kunnen, en – vaak – proberen we het niet eens:

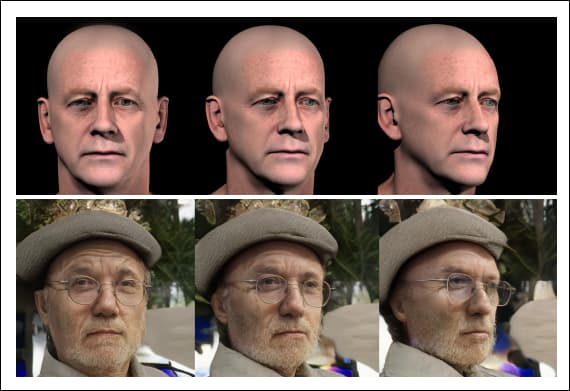

Grabs uit een gelauwerde diepe valse video waarin Arnold Schwarzenegger wordt getransformeerd in Sylvester Stallone – tenzij de hoeken te lastig zijn. Profielen blijven een hardnekkig probleem met huidige diepe valse benaderingen, gedeeltelijk omdat de open source-software die wordt gebruikt om gezichtshoudingen in diepe valse kaders te definiëren, niet is geoptimaliseerd voor zij-aanzichten, maar voornamelijk omdat er een gebrek is aan geschikt bronmateriaal in een of beide van de benodigde datasets. Bron: https://www.youtube.com/watch?v=AQvCmQFScMA

Nieuw onderzoek uit Israël stelt een novate methode voor om synthetische gegevens, zoals CGI-hoofden, te gebruiken om diepe valse in de jaren 2020 te brengen, door identiteit echt te scheiden van context (d.w.z. de essentiële gezichtskarakteristieken van ‘Tom Cruise’, vanuit alle hoeken) van hun context (d.w.z. omhoog kijken, zijwaarts kijken, fronsen, fronsen in het donker, wenkbrauwen fronsen, ogen sluiten, enz.).

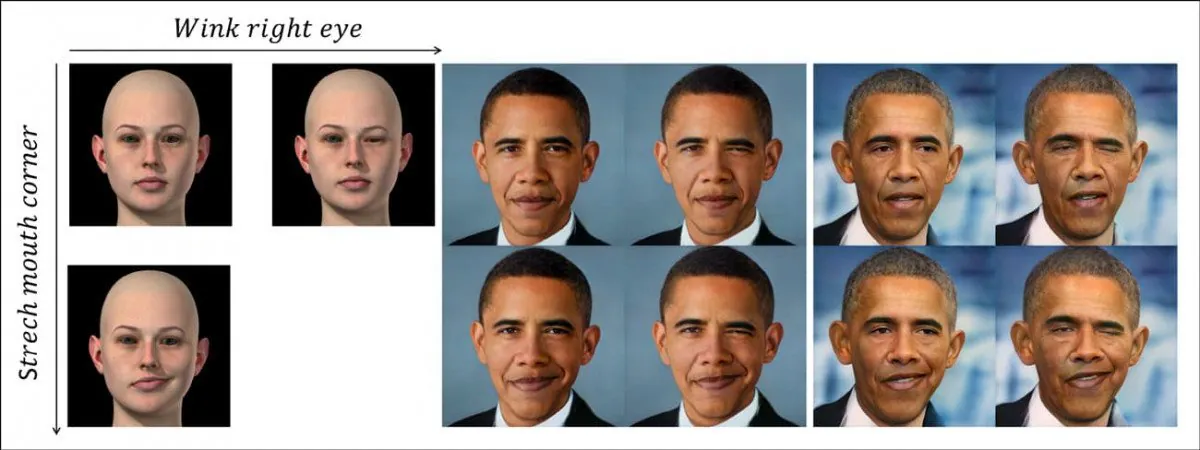

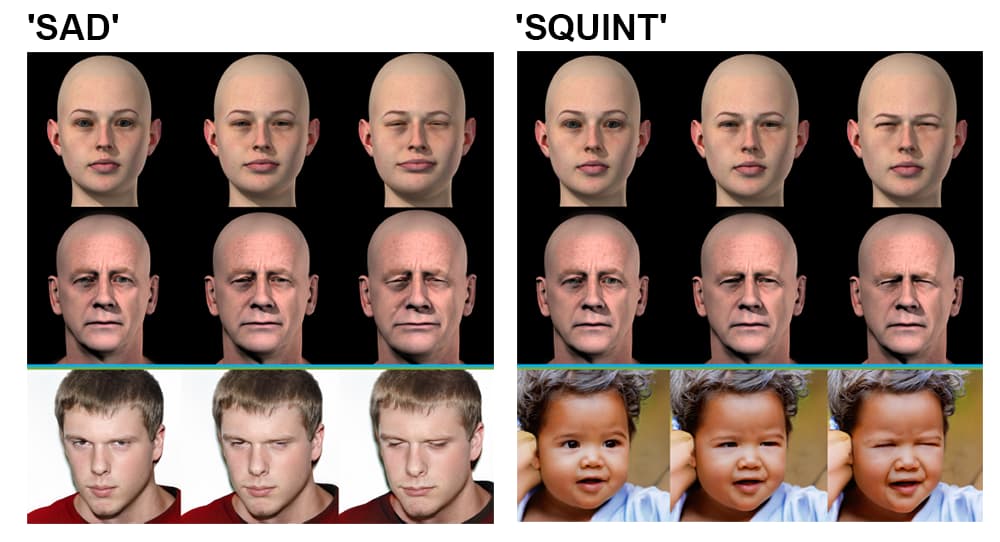

Het nieuwe systeem scheidt pose en context (d.w.z. een oog knipperen) van de identiteitscodering van het individu, met behulp van niet-gerelateerde synthetische gezichtsgegevens (afgebeeld links). In de bovenste rij zien we een ‘knipperen’ dat wordt overgedragen op de identiteit van Barack Obama, aangegeven door het geleerde niet-lineaire pad van de latentie-ruimte van een GAN, weergegeven door het CGI-beeld links. In de rij eronder zien we de gestrekte mondhoekfacet overgedragen op de voormalige president. Onderaan rechts zien we beide kenmerken tegelijk toegepast. Bron: https://arxiv.org/pdf/2111.08419.pdf

Dit is geen gewone diepe valse hoofdpoppenkast, een techniek die meer geschikt is voor avatars en gedeeltelijke gezichtslip-synchronisatie, en die een beperkt potentieel heeft voor volledige diepe valse videotransformaties.

In plaats daarvan vertegenwoordigt dit een manier om vooruit te komen voor een fundamentele scheiding van instrumentatie (zoals ‘verander de hoek van het hoofd’, ‘maak een frons’) van identiteit, waardoor een pad wordt geboden naar een hoogwaardige in plaats van ‘afgeleide’ beeldsynthese-gebaseerde diepe valse kader.

Het nieuwe artikel heet Delta-GAN-Encoder: Encoding Semantic Changes for Explicit Image Editing, using Few Synthetic Samples, en komt van onderzoekers aan het Technion – Israel Institute of Technology.

Om te begrijpen wat het onderzoek betekent, laten we eens kijken hoe diepe valse momenteel overal worden geproduceerd, van diepe valse pornowebsites tot Industrial Light and Magic (aangezien de DeepFaceLab open source-repository momenteel dominant is in zowel ‘amateur’ als professionele diepe valse).

Wat houdt de huidige diepe valse technologie tegen?

Diepe valse worden momenteel gemaakt door een encoder/decoder machine learning-model te trainen op twee mappen met gezichtsbeelden – de persoon die je wilt ‘overschilderen’ (in het eerder genoemde voorbeeld, dat is Arnie) en de persoon die je wilt superimponeren in de beeldmateriaal (Sly).

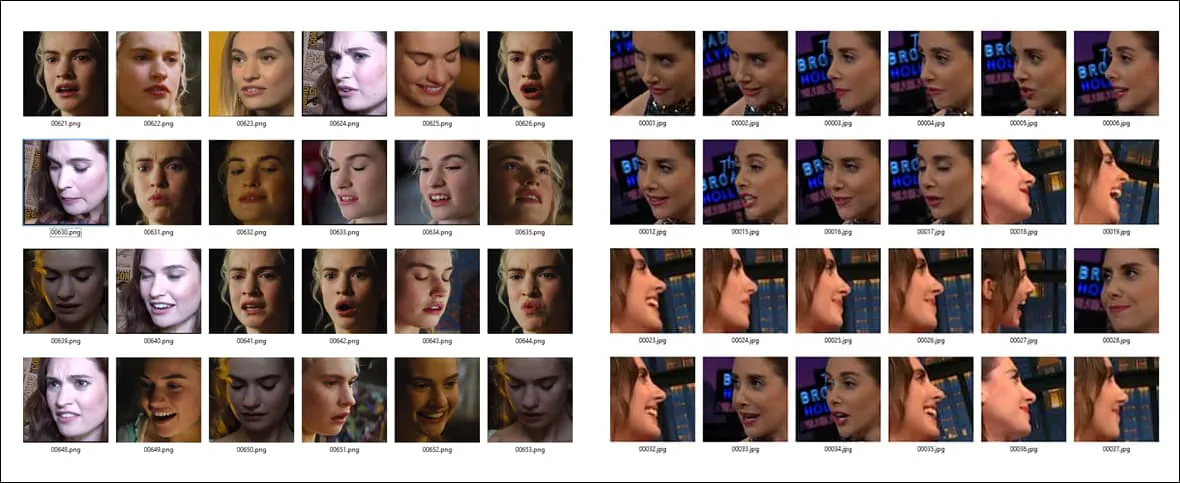

Voorbeelden van variërende pose en lichtomstandigheden over twee verschillende gezichtssets. Let op de karakteristieke uitdrukking aan het einde van de derde rij in kolom A, die waarschijnlijk geen equivalent heeft in de andere dataset.

Het encoder/decoder-systeem vergelijkt dan elk afzonderlijk beeld in elke map met elkaar, onderhoudt, verbetert en herhaalt deze bewerking honderdduizenden keren (vaak zo lang als een week), totdat het de essentiële kenmerken van beide identiteiten goed genoeg begrijpt om ze naar believen om te wisselen.

Voor elk van de twee personen die worden omgewisseld in het proces, is wat de diepe valse architectuur leert over identiteit verward met context. Het kan geen principes leren en toepassen over een generieke pose ‘voor goed en voor altijd’, maar heeft overvloedige voorbeelden nodig in de trainingsdataset, voor elke identiteit die betrokken zal zijn bij het gezichtswisselen.

Daarom, als je twee identiteiten wilt omwisselen die iets ongebruikelijers doen dan alleen maar glimlachen of rechtstreeks in de camera kijken, heb je veel voorbeelden van die specifieke pose/identiteit nodig over de twee gezichtssets:

Omdat gezichts-ID en pose-karakteristieken momenteel zo verward zijn, is een brede gelijkheid van expressie, hoofdpose en (in mindere mate) licht nodig over twee gezichtsdatasets om een effectief diepe valse model te trainen op systemen zoals DeepFaceLab. Hoe minder een bepaalde configuratie (zoals ‘zij-aanzicht/glimlachen/zonlicht’) in beide gezichtssets wordt weergegeven, hoe minder nauwkeurig het zal worden weergegeven in een diepe valse video, als dat nodig is.

Als set A de ongebruikelijke pose bevat, maar set B het ontbreekt, ben je eigenlijk pech; hoe lang je het model ook traint, het zal nooit leren om die pose goed tussen de identiteiten te reproduceren, omdat het alleen de helft van de benodigde informatie had toen het werd getraind.

Zelfs als je overeenkomende beelden hebt, kan het nog steeds niet genoeg zijn: als set A de overeenkomende pose heeft, maar met harde zijverlichting, in vergelijking met de plat verlichte equivalent pose in de andere gezichtsset, zal de kwaliteit van de swap niet zo goed zijn als als elke gezichtsset dezelfde lichtkarakteristieken deelt.

Waarom de gegevens schaars zijn

Tenzij je regelmatig wordt aangehouden, heb je waarschijnlijk niet veel zij-aanzichten van jezelf. Als die er al zijn, heb je ze waarschijnlijk weggegooid. Aangezien fotoagentschappen dit ook doen, zijn profielgezichten moeilijk te vinden.

Diepe valse makers voegen vaak meerdere kopieën van de beperkte zij-aanzichtsgegevens die ze voor een identiteit in een gezichtsset hebben toe, alleen maar om die pose een kleine aandacht en tijd te geven tijdens de training, in plaats van het als uitbijter te behandelen.

Maar er zijn veel meer mogelijke soorten zij-aanzichten dan waarschijnlijk beschikbaar zijn voor opname in een dataset – glimlachen, fronsen, schreeuwen, huilen, donker verlicht, minachtend, verveeld, vrolijk, flits verlicht, omhoog kijken, omlaag kijken, ogen open, ogen dicht… enzovoort. Elke van deze poses, in meerdere combinaties, kan nodig zijn in een doelwit diepe valse video.

En dat is alleen maar profielen. Hoeveel foto’s heb je van jezelf die recht omhoog kijken? Heb je genoeg om de 10.000 mogelijke uitdrukkingen die je zou kunnen dragen terwijl je die exacte pose vanuit die exacte camera-hoek houdt, die ten minste enkele van de één miljoen mogelijke lichtomgevingen dekken?

Het is waarschijnlijk dat je niet eens één foto van jezelf hebt die omhoog kijkt. En dat is alleen maar twee hoeken van de honderd of meer die nodig zijn voor volledige dekking.

Zelfs als het mogelijk was om volledige dekking van een gezicht vanuit alle hoeken onder een reeks lichtomstandigheden te genereren, zou de resulterende dataset veel te groot zijn om te trainen, in de orde van honderdduizenden beelden; en zelfs als het wel getraind kon worden, zou de aard van het trainingsproces voor huidige diepe valse kaders het grootste deel van die extra gegevens ten gunste van een beperkt aantal afgeleide functies weggooien, omdat de huidige kaders reductief zijn en niet erg schaalbaar.

Synthetische vervanging

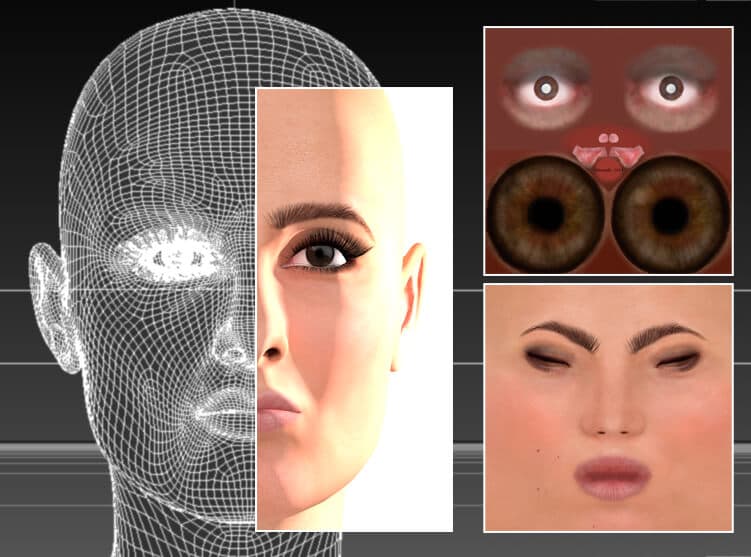

Sinds de dageraad van diepe valse hebben diepe valse makers geëxperimenteerd met het gebruik van CGI-achtige beelden, hoofden gemaakt in 3D-toepassingen zoals Cinema4D en Maya, om die ‘ontbrekende poses’ te genereren.

Geen AI nodig; een actrice wordt gereconstrueerd in een traditionele CGI-programma, Cinema 4D, met behulp van mesh en bitmapped textures – technologie die teruggaat tot de jaren 1960, hoewel het pas vanaf de jaren 1990 op grote schaal werd gebruikt. In theorie kan dit gezichtsmodel worden gebruikt om diepe valse brondata te genereren voor ongebruikelijke poses, lichtstijlen en gezichtsuitdrukkingen. In werkelijkheid is het van beperkt of geen nut geweest in diepe valse, omdat de ‘valsheid’ van de renders de neiging heeft door te sijpelen in omgewisselde video’s. Bron: Deze artikel auteur’s beeld op https://rossdawson.com/futurist/implications-of-ai/comprehensive-guide-ai-artificial-intelligence-visual-effects-vfx/

Deze methode wordt over het algemeen vroeg in de weg gestaan door nieuwe diepe valse beoefenaars, omdat hoewel het ongebruikelijke poses en uitdrukkingen kan bieden, de synthetische verschijning van de CGI-gezichten meestal doorsijpelt naar de swaps vanwege de verstrengeling van ID en contextuele/semantische informatie.

Dit kan leiden tot het plotselinge verschijnen van ‘uncanny valley’-gezichten in een overtuigende diepe valse video, omdat het algoritme begint te putten uit de enige gegevens die het kan hebben voor een ongebruikelijke pose of uitdrukking – manifest foute gezichten.

Onder de meest populaire onderwerpen voor diepe valse makers is een 3D diepe valse algoritme voor de Australische actrice Margot Robbie opgenomen in de standaardinstallatie van DeepFaceLive, een versie van DeepFaceLab die diepe valse kan uitvoeren in een live-stream, zoals een webcam-sessie. Een CGI-versie, zoals hierboven afgebeeld, kan worden gebruikt om ongebruikelijke ‘ontbrekende’ hoeken in diepe valse datasets te verkrijgen. Bron: https://sketchfab.com/3d-models/margot-robbie-bust-for-full-color-3d-printing-98d15fe0403b4e64902332be9cfb0ace

CGI-gezichten als losse, conceptuele richtlijnen

In plaats daarvan is de nieuwe Delta-GAN Encoder (DGE) methode van de Israëlische onderzoekers effectiever, omdat de pose en contextuele informatie van de CGI-afbeeldingen volledig zijn gescheiden van de ‘identiteit’ van het doelwit.

We kunnen dit principe in actie zien in het onderstaande beeld, waarin verschillende hoofdoriëntaties zijn verkregen door het gebruik van CGI-afbeeldingen als richtlijn. Aangezien de identiteitskenmerken niet gerelateerd zijn aan de contextuele kenmerken, is er geen doorsijpeling van de nep-uitziende synthetische verschijning van het CGI-gezicht, noch van de identiteit die erin wordt afgebeeld:

Met de nieuwe methode hebt u geen drie afzonderlijke echte beelden nodig om een diepe valse vanuit meerdere hoeken te maken – u kunt gewoon het CGI-hoofd draaien, waarvan de hoogwaardige abstracte kenmerken worden opgelegd aan de identiteit zonder enige ID-informatie te lekken.

Delta-GAN-Encoder. Bovenste groep links: de hoek van een bronbeeld kan in een seconde worden veranderd om een nieuw bronbeeld te renderen, dat wordt weergegeven in de uitvoer; bovenste groep rechts: verlichting is ook ontkoppeld van identiteit, waardoor het superimponeren van verlichtingsstijlen mogelijk is; onderste groep links: meerdere gezichtsdetails worden gewijzigd om een ‘treurige’ uitdrukking te creëren; onderste groep rechts: één enkel gezichtsdetailuitdrukking wordt gewijzigd, zodat de ogen knipperen.

Deze scheiding van identiteit en context wordt bereikt in het trainingsstadium. De pijplijn voor de nieuwe diepe valse architectuur zoekt de latentie-vector in een vooraf getrainde Generatieve Adversarial Network (GAN) die overeenkomt met het beeld dat moet worden getransformeerd – een Sim2Real-methode die voortbouwt op een project uit 2018 van IBM’s AI-onderzoeksafdeling.

De onderzoekers observeren:

‘Met slechts een paar voorbeelden, die verschillen door een specifiek kenmerk, kan men het ontkoppelde gedrag van een vooraf getraind verward generatief model leren. Er is geen behoefte aan exacte echte voorbeelden om dat doel te bereiken, wat niet noodzakelijkerwijs haalbaar is.

‘Door het gebruik van niet-reële gegevensvoorbeelden kan hetzelfde doel worden bereikt door de semantiek van de gecodeerde latentie-vectoren te benutten. Het toepassen van gewenste veranderingen op bestaande gegevensvoorbeelden kan worden gedaan zonder expliciete latentie-ruimtegedragsonderzoek.’

De onderzoekers verwachten dat de kernprincipes van ontkoppeling die in het project worden onderzocht, kunnen worden overgedragen naar andere domeinen, zoals interieurarchitectuursimulaties, en dat de Sim2Real-methode die voor Delta-GAN-Encoder wordt gebruikt, uiteindelijk diepe valse instrumentatie op basis van schetsen in plaats van CGI-achtige invoer kan mogelijk maken.

Het kan worden betoogd dat de mate waarin het nieuwe Israëlische systeem al dan niet in staat is om diepe valse video’s te synthetiseren, veel minder belangrijk is dan de vooruitgang die het onderzoek heeft geboekt in het ontkoppelen van context van identiteit, waardoor meer controle wordt verkregen over de latentie-ruimte van een GAN.

Ontkoppeling is een actief onderzoeksgebied in beeldsynthese; in januari 2021 toonde een door Amazon geleid onderzoeksartikel soortgelijke pose-controle en ontkoppeling, en in 2018 maakte een artikel van de Shenzhen Institutes of Advanced Technology aan de Chinese Academy of Sciences vooruitgang bij het genereren van willekeurige gezichtspunten in een GAN.