Kunstmatige intelligentie

DeepSeek-V3 onthuld: Hoe hardware-georiënteerd AI-ontwerp kosten verlaagt en prestaties verbetert

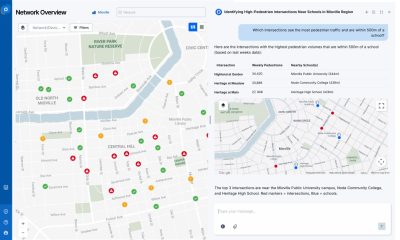

DeepSeek-V3 vertegenwoordigt een doorbraak in kosteneffectieve AI-ontwikkeling. Het demonstreert hoe slimme hardware-software co-ontwerp state-of-the-art prestaties kan leveren zonder excessieve kosten. Door te trainen op slechts 2.048 NVIDIA H800 GPU’s, bereikt dit model opmerkelijke resultaten door innovatieve benaderingen zoals Multi-head Latent Attention voor geheugenefficiëntie, Mixture of Experts-architectuur voor geoptimaliseerde berekening en FP8 mixed-precision training die de hardwaremogelijkheden ontgrendelt. Het model laat zien dat kleinere teams kunnen concurreren met grote technologiebedrijven door intelligente ontwerpkeuzes in plaats van brute force scaling.

De uitdaging van AI-schaalvergroting

De AI-industrie staat voor een fundamenteel probleem. Grote taalmodellen worden groter en krachtiger, maar ze vereisen ook enorm veel rekenkracht die de meeste organisaties niet kunnen betalen. Grote technologiebedrijven zoals Google, Meta en OpenAI implementeren trainingsclusters met tientallen of honderden duizenden GPU’s, waardoor het moeilijk wordt voor kleinere onderzoeksteams en startups om te concurreren.

Deze resourcekloof dreigt de AI-ontwikkeling te concentreren in de handen van een paar grote technologiebedrijven. De schaalwetten die de AI-vooruitgang aandrijven, suggereren dat grotere modellen met meer trainingsdata en rekenkracht tot betere prestaties leiden. Echter, de exponentiële groei in hardwarevereisten heeft het steeds moeilijker gemaakt voor kleinere spelers om te concurreren in de AI-race.

Geheugeneisen zijn een andere significante uitdaging geworden. Grote taalmodellen hebben aanzienlijke geheugeneisen, met een vraag die meer dan 1000% per jaar toeneemt. Ondertussen groeit de capaciteit van high-speed geheugen met een veel langzamere tempo, typisch minder dan 50% per jaar. Deze mismatch creëert wat onderzoekers de “AI-geheugwand” noemen, waarbij geheugen de beperkende factor wordt in plaats van rekenkracht.

De situatie wordt nog complexer tijdens inferentie, wanneer modellen echte gebruikers bedienen. Moderne AI-toepassingen omvatten vaak meerdere conversaties en lange contexten, waardoor krachtige caching-mechanismen nodig zijn die aanzienlijke geheugen verbruiken. Traditionele benaderingen kunnen snel de beschikbare middelen overweldigen en efficiënte inferentie een significante technische en economische uitdaging maken.

DeepSeek-V3’s hardware-georiënteerde benadering

DeepSeek-V3 is ontworpen met hardware-optimalisatie in gedachten. In plaats van meer hardware te gebruiken voor het schalen van grote modellen, richtte DeepSeek zich op het creëren van hardware-georiënteerde modelontwerpen die efficiëntie optimaliseren binnen bestaande beperkingen. Deze benadering stelt DeepSeek in staat om state-of-the-art prestaties te bereiken met slechts 2.048 NVIDIA H800 GPU’s, een fractie van wat concurrerende bedrijven typisch vereisen.

De kerninzicht achter DeepSeek-V3 is dat AI-modellen hardwaremogelijkheden moeten beschouwen als een sleutelparameter in het optimalisatieproces. In plaats van modellen te ontwerpen in isolatie en vervolgens te proberen ze efficiënt uit te voeren, richtte DeepSeek zich op het bouwen van een AI-model dat een diep begrip van de hardware waarop het werkt, incorporeert. Deze co-ontwerpstrategie betekent dat het model en de hardware efficiënt samenwerken, in plaats van hardware als een vaste beperking te behandelen.

Het project bouwt voort op de belangrijkste inzichten van eerdere DeepSeek-modellen, met name DeepSeek-V2, die succesvolle innovaties introduceerde zoals DeepSeek-MoE en Multi-head Latent Attention. Echter, DeepSeek-V3 breidt deze inzichten uit door FP8 mixed-precision training te integreren en nieuwe netwerktopologieën te ontwikkelen die infrastructurele kosten verlagen zonder prestaties te offeren.

Deze hardware-georiënteerde benadering is niet alleen van toepassing op het model, maar ook op de hele trainingsinfrastructuur. Het team ontwikkelde een Multi-Plane two-layer Fat-Tree netwerk om traditionele drie-laagse topologieën te vervangen, waardoor cluster-netwerk kosten aanzienlijk werden verlaagd. Deze infrastructurele innovaties demonstreren hoe doordachte ontwerpkeuzes significante kostenbesparingen kunnen opleveren in de hele AI-ontwikkelingspipeline.

Sleutelinnovaties die efficiëntie stimuleren

DeepSeek-V3 introduceert verschillende verbeteringen die de efficiëntie aanzienlijk verhogen. Een sleutelinnovatie is de Multi-head Latent Attention (MLA) mechanisme, die het hoge geheugengebruik tijdens inferentie aanpakt. Traditionele aandachtsmechanismen vereisen caching van Key en Value vectoren voor alle aandachtskoppen. Dit verbruikt enorm veel geheugen naarmate conversaties langer worden.

MLA lost dit probleem op door de Key-Value-representaties van alle aandachtskoppen samen te voegen in een kleinere latent vector met behulp van een projectiematrix die samen met het model getraind wordt. Tijdens inferentie hoeft alleen deze gecomprimeerde latent vector te worden gecached, waardoor geheugeneisen aanzienlijk worden verlaagd. DeepSeek-V3 vereist slechts 70 KB per token in vergelijking met 516 KB voor LLaMA-3.1 405B en 327 KB voor Qwen-2.5 72B1.

De Mixture of Experts-architectuur biedt een andere cruciale efficiëntiegrens. In plaats van het hele model te activeren voor elke berekening, activeert MoE selectief alleen de meest relevante expertnetwerken voor elke invoer. Deze benadering behoudt modelcapaciteit terwijl de daadwerkelijke berekening die nodig is voor elke forward pass aanzienlijk wordt verlaagd.

FP8 mixed-precision training verbetert de efficiëntie verder door over te schakelen van 16-bit naar 8-bit floating-point precisie. Dit verlaagt geheugengebruik met de helft terwijl trainingskwaliteit behouden blijft. Deze innovatie adresseert de AI-geheugwand rechtstreeks door een efficiëntere gebruik van beschikbare hardwarebronnen te maken.

De Multi-Token Prediction Module voegt een extra laag efficiëntie toe tijdens inferentie. In plaats van één token tegelijk te genereren, kan dit systeem meerdere toekomstige tokens tegelijk voorspellen, waardoor de generatiesnelheid aanzienlijk toeneemt door speculatieve decoding. Deze benadering verlaagt de totale tijd die nodig is om antwoorden te genereren, waardoor de gebruikerservaring wordt verbeterd en rekenkosten worden verlaagd.

Sleutelleerpunten voor de industrie

DeepSeek-V3’s succes biedt verschillende sleutelleerpunten voor de bredere AI-industrie. Het toont aan dat innovatie in efficiëntie net zo belangrijk is als het opschalen van modelgrootte. Het project benadrukt ook hoe zorgvuldige hardware-software co-ontwerp resourcebeperkingen kan overwinnen die anders AI-ontwikkeling zouden beperken.

Deze hardware-georiënteerde ontwerpenbenadering kan de manier waarop AI wordt ontwikkeld veranderen. In plaats van hardware te zien als een beperking om mee te werken, kunnen organisaties het behandelen als een kerndesignfactor die modelarchitectuur vanaf het begin vormt. Deze mentaliteitsverandering kan leiden tot efficiëntere en kosteneffectievere AI-systemen in de hele industrie.

De effectiviteit van technieken zoals MLA en FP8 mixed-precision training suggereert dat er nog veel ruimte is voor het verbeteren van efficiëntie. Naarmate hardware blijft evolueren, zullen nieuwe kansen voor optimalisatie ontstaan. Organisaties die gebruikmaken van deze innovaties zullen beter zijn toegerust om te concurreren in een wereld met groeiende resourcebeperkingen.

Netwerkinnovaties in DeepSeek-V3 benadrukken ook het belang van infrastructurele ontwerp. Terwijl de focus veelal ligt op modelarchitecturen en trainingsmethoden, speelt infrastructuur een kritieke rol in de algehele efficiëntie en kosten. Organisaties die AI-systemen bouwen, moeten infrastructurele optimalisatie prioriteren naast modelverbeteringen.

Het project demonstreert ook de waarde van open onderzoek en samenwerking. Door hun inzichten en technieken te delen, draagt het DeepSeek-team bij aan de bredere vooruitgang van AI en vestigt het zijn positie als leider in efficiënte AI-ontwikkeling. Deze benadering heeft voordelen voor de hele industrie door vooruitgang te versnellen en duplicatie van inspanningen te verminderen.

De bottom line

DeepSeek-V3 is een belangrijke stap voorwaarts in kunstmatige intelligentie. Het toont aan dat zorgvuldig ontwerp prestaties kan leveren die vergelijkbaar zijn met, of beter zijn dan, het enkel opschalen van modellen. Door gebruik te maken van ideeën zoals Multi-Head Latent Attention, Mixture-of-Experts lagen en FP8 mixed-precision training, bereikt het model topniveau resultaten terwijl het significante hardwarebehoeften verlaagt. Deze focus op hardware-efficiëntie geeft kleinere labs en bedrijven nieuwe kansen om geavanceerde systemen te bouwen zonder enorme budgetten. Naarmate AI blijft evolueren, zullen benaderingen zoals die in DeepSeek-V3 steeds belangrijker worden om duurzame en toegankelijke vooruitgang te garanderen. DeepSeek-3 leert ook een bredere les. Met slimme architectuurkeuzes en strakke optimalisatie kunnen we krachtige AI bouwen zonder de behoefte aan uitgebreide middelen en kosten. Op deze manier biedt DeepSeek-V3 de hele industrie een praktische weg naar kosteneffectieve, meer toegankelijke AI die veel organisaties en gebruikers over de hele wereld helpt.