Thought leaders

Decoding Opportunities en Uitdagingen voor LLM-Agents in Generatieve AI

We zien een ontwikkeling van Generatieve AI-toepassingen die worden aangedreven door grote taalmodellen (LLM) van prompts tot retrieval augmented generation (RAG) tot agents. Agents worden zwaar besproken in de industrie en onderzoekskringen, voornamelijk vanwege de kracht die deze technologie biedt om Enterprise-toepassingen te transformeren en superieure klantervaringen te bieden. Er zijn gemeenschappelijke patronen voor het bouwen van agents die de eerste stappen mogelijk maken naar kunstmatige algehele intelligentie (AGI).

In mijn vorige artikel, zagen we een ladder van intelligentie van patronen voor het bouwen van LLM-gepowered toepassingen. Beginnend met prompts die het probleemdomein vastleggen en het interne geheugen van LLM gebruiken om output te genereren. Met RAG voegen we de prompt toe met externe kennis die wordt gezocht uit een vectordatabase om de uitvoer te controleren. Vervolgens kunnen we door LLM-aanroepen te ketenen workflows bouwen om complexe toepassingen te realiseren. Agents brengen dit naar een hoger niveau door automatisch te bepalen hoe deze LLM-ketens moeten worden gevormd. Laten we hier dieper in duiken.

Agents – Onder de motorkap

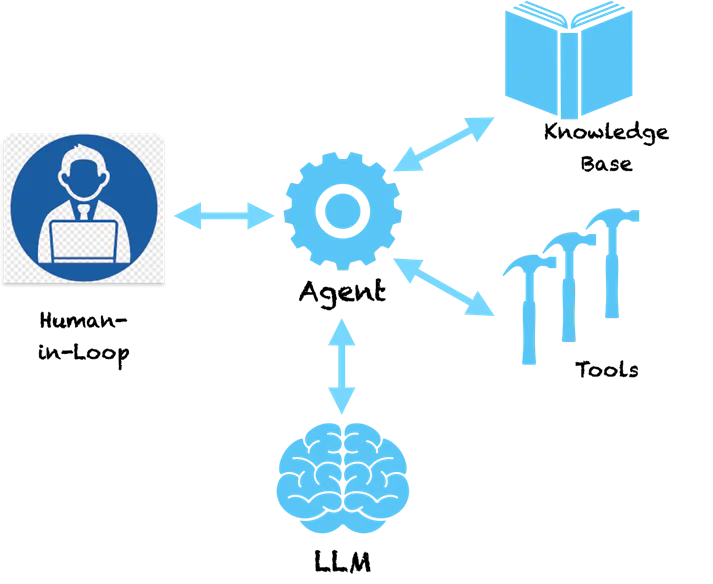

Een belangrijk patroon met agents is dat ze de taalbegripskracht van LLM gebruiken om een plan te maken over hoe een bepaald probleem moet worden opgelost. LLM begrijpt het probleem en geeft ons een reeks stappen om het probleem op te lossen. Maar het stopt daar niet. Agents zijn geen puur ondersteuningsysteem dat aanbevelingen zal geven over het oplossen van het probleem en vervolgens de fakkel doorgeeft aan u om de aanbevolen stappen te nemen. Agents zijn uitgerust met tooling om door te gaan en actie te ondernemen. Angstaanjagend, nietwaar?!