Ethiek

Huidige AI-praktijken kunnen een nieuwe generatie auteursrechtelijke trolls mogelijk maken

Een nieuwe onderzoeks samenwerking tussen Huawei en de academische wereld suggereert dat een groot deel van het meest belangrijke huidige onderzoek op het gebied van kunstmatige intelligentie en machine learning mogelijk aan rechtszaken blootgesteld kan worden zodra het commercieel prominent wordt, omdat de datasets die doorbraken mogelijk maken, worden verspreid met onjuiste licenties die de oorspronkelijke voorwaarden van de openbare domeinen waaruit de gegevens zijn verkregen, niet respecteren.

In feite heeft dit twee vrijwel onvermijdelijke mogelijke gevolgen: dat zeer succesvolle, gecommercialiseerde AI-algoritmen die bekend staan om het gebruik van dergelijke datasets, in de toekomst het doelwit zullen worden van opportunistische octrooitolken wiens auteursrechten niet werden gerespecteerd toen hun gegevens werden verzameld; en dat organisaties en individuen deze zelfde juridische kwetsbaarheden kunnen gebruiken om te protesteren tegen de inzet of verspreiding van machine learning-technologieën die zij afkeuren.

Het paper heeft als titel Kan ik deze openbaar beschikbare dataset gebruiken om commerciële AI-software te bouwen? Waarschijnlijk niet, en is een samenwerking tussen Huawei Canada en Huawei China, samen met de York University in het VK en de University of Victoria in Canada.

Vijf van de zes (populaire) open source-datasets zijn niet juridisch bruikbaar

Voor het onderzoek vroegen de auteurs afdelingen bij Huawei om de meest gewenste open source-datasets te selecteren die ze in commerciële projecten wilden gebruiken, en selecteerden de zes meest gevraagde datasets uit de antwoorden: CIFAR-10 (een subset van de 80 miljoen kleine afbeeldingen-dataset, sinds ingetrokken vanwege ‘smalende termen’ en ‘aanstootgevende afbeeldingen’, hoewel zijn afgeleiden zich vermenigvuldigen); ImageNet; Cityscapes (die uitsluitend origineel materiaal bevat); FFHQ; VGGFace2, en MSCOCO.

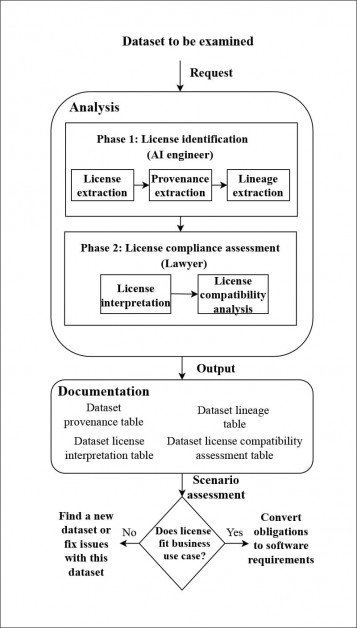

Om te analyseren of de geselecteerde datasets geschikt waren voor juridisch gebruik in commerciële projecten, ontwikkelden de auteurs een nieuwe pipeline om de keten van licenties zo ver mogelijk terug te traceren voor elke set, hoewel ze vaak moesten terugvallen op webarchief-captures om licenties van inmiddels verlopen domeinen te lokaliseren, en in sommige gevallen moesten ‘raden’ naar de licentiestatus op basis van de dichtstbijzijnde beschikbare informatie.

Architectuur voor het provenance-tracingsysteem ontwikkeld door de auteurs. Bron: https://arxiv.org/pdf/2111.02374.pdf

De auteurs ontdekten dat licenties voor vijf van de zes datasets ‘risico’s bevatten die zijn verbonden met ten minste één commercieel gebruikskader’:

‘[We] observeren dat, behalve MS COCO, geen van de bestudeerde licenties praktijkmensen het recht geeft om een AI-model te commercialiseren dat is getraind op de gegevens of zelfs de uitvoer van het getrainde AI-model. Een dergelijk resultaat voorkomt praktijkmensen ook effectief om zelfs vooraf getrainde modellen te gebruiken die zijn getraind op deze datasets. Openbaar beschikbare datasets en AI-modellen die zijn getraind op deze datasets, worden wijdverspreid commercieel gebruikt.’ *

De auteurs merken verder op dat drie van de zes bestudeerde datasets bovendien kunnen leiden tot licentieovertreding in commerciële producten als de dataset wordt gewijzigd, aangezien alleen MS-COCO dit toestaat. Toch is gegevensverrijking en het maken van sub- en supersets van invloedrijke datasets een gebruikelijke praktijk.

In het geval van CIFAR-10 hebben de oorspronkelijke compilers geen conventionele vorm van licentie gemaakt, maar alleen vereist dat projecten die de dataset gebruiken, een citaat opnemen naar het oorspronkelijke artikel dat de release van de dataset begeleidde, waardoor een verdere belemmering ontstaat voor het vaststellen van de juridische status van de gegevens.

Bovendien bevat alleen de CityScapes-dataset materiaal dat uitsluitend is gegenereerd door de makers van de dataset, in plaats van te zijn ‘gecurateerd’ (verzameld) van netwerkbronnen, terwijl CIFAR-10 en ImageNet meerdere bronnen gebruiken, die elk moeten worden onderzocht en getraceerd om enige vorm van auteursrechtmechanisme (of zelfs een zinvolle disclaimer) vast te stellen.

Geen uitweg

Er zijn drie factoren waarop commerciële AI-bedrijven lijken te vertrouwen om zich te beschermen tegen rechtszaken rond producten die zijn gemaakt met auteursrechtelijk beschermd materiaal uit datasets, zonder toestemming, om AI-algoritmen te trainen. Geen van deze factoren biedt veel (of enige) betrouwbare langetermijnbescherming:

1: Laissez Faire Nationale Wetten

Hoewel overheden over de hele wereld verplicht zijn om wetten rond datascraping te versoepelen om niet achterop te raken in de race naar prestatiegerichte AI (die afhankelijk is van grote hoeveelheden echte gegevens waarvoor reguliere auteursrechtelijke naleving en licentieverlening onrealistisch zou zijn), biedt alleen de Verenigde Staten volledige immuniteit in dit opzicht, onder de Fair Use Doctrine – een beleid dat in 2015 is geratificeerd met de conclusie van Authors Guild v. Google, Inc., die bevestigde dat de zoekgigant vrijelijk auteursrechtelijk beschermd materiaal kon opnemen voor zijn Google Books-project zonder van inbreuk te worden beschuldigd.

Als het Fair Use Doctrine-beleid ooit verandert (bijv. als reactie op een andere baanbrekende zaak met voldoende krachtige organisaties of bedrijven), zou het waarschijnlijk worden beschouwd als een a priori toestand in termen van het exploiteren van huidige auteursrechtinbreukdatabases, waardoor eerder gebruik wordt beschermd; maar niet gaand gebruik en ontwikkeling van systemen die in staat zijn gesteld door auteursrechtelijk beschermd materiaal zonder overeenkomst.

Dit zet de huidige bescherming van de Fair Use Doctrine op een zeer voorlopige basis, en zou mogelijk, in dat scenario, gevestigde, gecommercialiseerde machine learning-algoritmen verplichten om de bedrijfsvoering te staken in gevallen waarin hun oorsprong is mogelijk gemaakt door auteursrechtelijk beschermd materiaal – zelfs in gevallen waarin het gewicht van het model uitsluitend te maken heeft met toegestane inhoud, maar is getraind op (en nuttig gemaakt door) illegaal gekopieerd materiaal.

Buiten de VS, zoals de auteurs in het nieuwe paper opmerken, zijn de beleidsregels over het algemeen minder soepel. Het VK en Canada komen alleen het gebruik van auteursrechtelijk beschermd materiaal voor niet-commerciële doeleinden in aanmerking, terwijl de EU’s Wet op tekst- en datamining (die niet volledig is ingetrokken door de recente voorstellen voor formeel AI-reguleringsbeleid) evenmin commerciële exploitatie toestaat voor AI-systemen die niet voldoen aan de auteursrechtvereisten van de oorspronkelijke gegevens.

Deze laatste regelingen betekenen dat een organisatie grote dingen kan bereiken met andermans gegevens, tot – maar niet inclusief – het punt waarop men er geld mee verdient. Op dat moment zou het product ofwel juridisch kwetsbaar worden, of zouden regelingen moeten worden getroffen met letterlijk miljoenen auteursrechthebbenden, van wie velen nu onvindbaar zijn vanwege de veranderende aard van het internet – een onmogelijke en onbetaalbare onderneming.

2: Caveat Emptor

In gevallen waarin inbreukmakende organisaties hopen de schuld af te wentelen, merkt het nieuwe paper ook op dat veel licenties voor de meest populaire open source-datasets zichzelf automatisch vrijwaren tegen enige claims van auteursrechtelijke misbruik:

‘Bijvoorbeeld, vereist de licentie van ImageNet expliciet dat praktijkmensen de ImageNet-team vrijwaren tegen enige claims die voortkomen uit het gebruik van de dataset. De datasets FFHQ, VGGFace2 en MS COCO vereisen dat de dataset, als deze wordt verdeeld of gewijzigd, onder dezelfde licentie wordt gepresenteerd.’

In feite dwingt dit degene die FOSS-datasets gebruikt ertoe om de schuld op zich te nemen voor het gebruik van auteursrechtelijk beschermd materiaal, in het licht van eventuele rechtszaken (hoewel het de oorspronkelijke compilers niet noodzakelijkerwijs beschermt in een zaak waarin de huidige ‘safe harbor’-sfeer is aangetast).

3: Vrijwaring door Obscuriteit

De collaboratieve aard van de machine learning-gemeenschap maakt het vrij moeilijk om corporate occultisme te gebruiken om de aanwezigheid van algoritmen te verhullen die hebben geprofiteerd van auteursrechtinbreukdatabases. Langetermijncommerciële projecten beginnen vaak in open FOSS-omgevingen waar het gebruik van datasets een kwestie van record is, op GitHub en andere openbaar toegankelijke forums, of waar de oorsprong van het project is gepubliceerd in preprint- of peer-reviewed papers.

Zelfs als dat niet het geval is, is model-inversie steeds meer in staat om de typische kenmerken van datasets (of zelfs uitdrukkelijk uitvoer van sommige van de bronmateriaal) te onthullen, hetzij als bewijs op zich, hetzij voldoende vermoeden van inbreuk om gerechtelijke toegang te krijgen tot de geschiedenis van de ontwikkeling van het algoritme en details van de datasets die bij die ontwikkeling zijn gebruikt.

Conclusie

Het paper schetst een chaotisch en ad hoc gebruik van auteursrechtelijk beschermd materiaal dat zonder toestemming is verkregen, en van een reeks licentieketens die, logisch gevolgd tot de oorspronkelijke bron van de gegevens, zou vereisen dat onderhandelingen worden gevoerd met duizenden auteursrechthebbenden wiens werk werd gepresenteerd onder de auspiciën van sites met een breed scala aan licentievoorwaarden, waarvan velen commerciële afgeleide werken uitsluiten.

De auteurs concluderen:

‘Openbaar beschikbare datasets worden wijdverspreid gebruikt om commerciële AI-software te bouwen. Men kan dit doen als [en] alleen als de licentie die is gekoppeld aan de openbaar beschikbare dataset het recht geeft om dit te doen. Echter, het is niet gemakkelijk om de rechten en verplichtingen te verifiëren die zijn verleend in de licentie die is gekoppeld aan de openbaar beschikbare datasets. Omdat, soms, de licentie onduidelijk of mogelijk ongeldig is.’

Een ander nieuw werk, getiteld Building Legal Datasets, dat op 2 november is uitgebracht door het Centre for Computational Law van de Singapore Management University, benadrukt ook de noodzaak voor datawetenschappers om te erkennen dat de ‘wilde westen’-periode van ad hoc-gegevensverzameling ten einde loopt, en weerspiegelt de aanbevelingen van het Huawei-paper om strengere gewoonten en methodologieën aan te nemen om ervoor te zorgen dat het gebruik van datasets een project niet blootstelt aan juridische gevolgen naarmate de cultuur verandert in de loop van de tijd, en naarmate de huidige wereldwijde academische activiteit in de machine learning-sector een commerciële terugverdienst zoekt op jaren van investeringen. De auteur merkt op*:

‘[De] corpus van wetgeving die ML-datasets beïnvloedt, zal groeien, temidden van bezorgdheid dat de huidige wetten onvoldoende bescherming bieden. Het ontwerp AIA [EU Artificial Intelligence Act], als het wordt aangenomen, zou de AI- en datagovernancelandschap aanzienlijk veranderen; andere rechtsgebieden kunnen hiermee volgen met hun eigen Acts. ‘

* Mijn conversie van inline-citaten naar hyperlinks