Andersons hoek

Het brengen van een geurzintuig naar AI-ontwikkeling

Een nieuwe AI-dataset leert machines om te ruiken door geurdata te koppelen aan afbeeldingen, waardoor modellen geuren kunnen koppelen aan objecten, scènes en materialen.

Misschien vanwege het feit dat geur-uitvoermachines een zo gevlekt verleden hebben, is olfactie een vrij verwaarloosd zintuig in AI-onderzoeksliteratuur. Tenzij je van plan was om nog een andere inzending te maken in de langlopende (meer dan een eeuw, tot op heden) smell-o-vision-saga, leken use cases altijd nogal ‘niche’ in vergelijking met de potentieel exploitatie van beeld-, audio- en videodatasets, en de AI-modellen die daaruit getraind worden.

In feite zou de mogelijkheid om de soort detectiefaciliteiten te automatiseren, te industrialiseren en te populariseren die worden aangeboden door bomhonden, cadaverhonden, ziekte-ruikhonden en diverse andere soorten hondenneus-eenheden, een opvallend voordeel zou zijn in gemeentelijke en beveiligingsdiensten. Ondanks de hoge vraag, ver boven de aanbod, is het trainen en onderhouden van detectiehonden een duur bedrijf dat niet altijd goede waarde voor geld biedt.

Tot op heden is het grootste deel van het onderzoek dat dit gebied van studie betreedt, beperkt tot een laboratorium, met gecuratede collecties die typisch bestaan uit voorbeelden met handgemaakte functies – een profiel dat meer geneigd is naar maatwerk-cottage-industrieoplossingen dan geïndustrialiseerde toepassingen.

Vooruit door een neus

In deze nogal stoffige klimaat komt een interessante nieuwe academische/industriële samenwerking uit de VS, waarin een team van onderzoekers enkele maanden besteedde aan het catalogiseren van diverse geuren in binnen- en buitenomgevingen in New York City – en, voor het eerst, het verzamelen van afbeeldingen die geassocieerd zijn met de vastgelegde geuren:

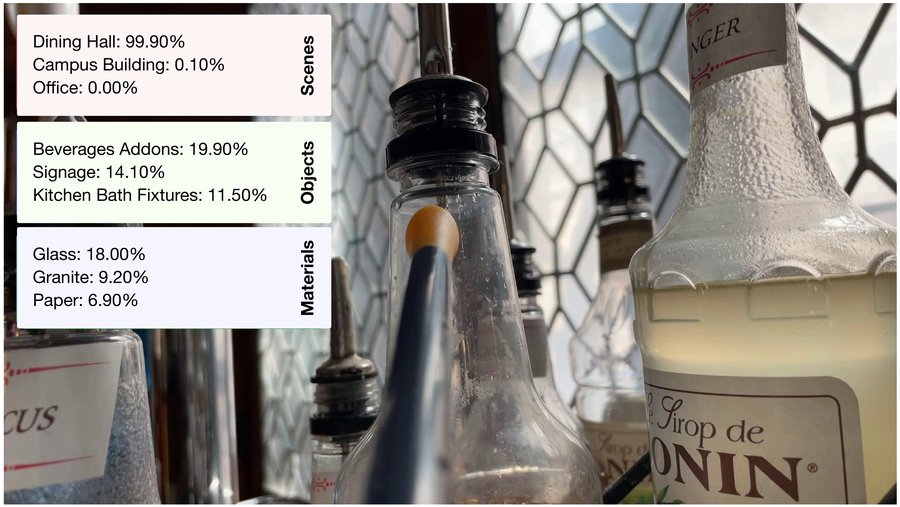

Let op de centrale sensor, de ‘neus’ van het olfactorische apparaat. Getraind op alleen geur, gokt het model of het graniet, plastic of leer ruikt – en identificeert zelfs de kamer waarin het zich bevindt, zonder één pixel te zien. Bron

Dit onderzoek heeft de auteurs van het nieuwe werk ertoe gebracht om een spin te maken op het enorm populaire Contrastive Language-Image Pretraining (CLIP)-framework, dat tekst en afbeeldingen verbindt, in de vorm van Contrastive Olfaction-Image Pretraining (COIP) – dat geuren en afbeeldingen verbindt.

Top: gesynchroniseerde video- en olfactorische sensordata worden vastgelegd in natuurlijke omgevingen met behulp van een camera-e-neus-rig. Onderaan links (b): een gezamenlijke insluiting wordt geleerd via cross-modale zelfsupervisie. (c): het systeem haalt visuele overeenkomsten op op basis van alleen een geurquery. (d): individuele geurmonsters worden gebruikt om omgevings-, object- en materiaalcategorieën te classificeren. (e): hoogst gelijkaardige geuren, zoals twee soorten gras, worden onderscheiden zonder visuele input. Bron

De nieuwe dataset, getiteld New York Smells, bevat 7.000 geur-afbeeldingsparen met 3.500 verschillende objecten. Toen getest, werd de nieuwe data gevonden om de populaire handgemaakte functies in het relatief kleine aantal soortgelijke eerdere datasets te overtreffen.

De auteurs hopen dat hun eerste uitstapje de weg zal openen voor later en follow-up werk naar olfactorische detectiesystemen die zijn ontworpen om in het wild te functioneren, op dezelfde manier als snuffelhonden*:

‘We zien deze dataset als een stap naar in-het-wild, multimodale olfactorische perceptie, evenals een stap naar het koppelen van zicht aan geur. Terwijl olfactie traditioneel is benaderd in beperkte instellingen, zoals kwaliteitscontrole, zijn er veel toepassingen in natuurlijke omgevingen.

‘Bijvoorbeeld, als mensen, gebruiken we constant ons geurzintuig om de kwaliteit van voedsel te beoordelen, gevaren te identificeren en onzichtbare objecten te detecteren.

‘Bovendien laten veel dieren, zoals honden, beren en muizen, supermenselijke olfactorische mogelijkheden zien, wat suggereert dat de menselijke reukperceptie ver van de limiet van machine-mogelijkheden is.’

Hoewel de nieuwe paper, getiteld New York Smells: A Large Multimodal Dataset for Olfaction, belooft dat data en code zullen worden vrijgegeven, is een 27GB-datafile al beschikbaar via de projectsite. Het paper is geproduceerd door negen onderzoekers van Columbia University, Cornell University en Osmo Labs.

Methode

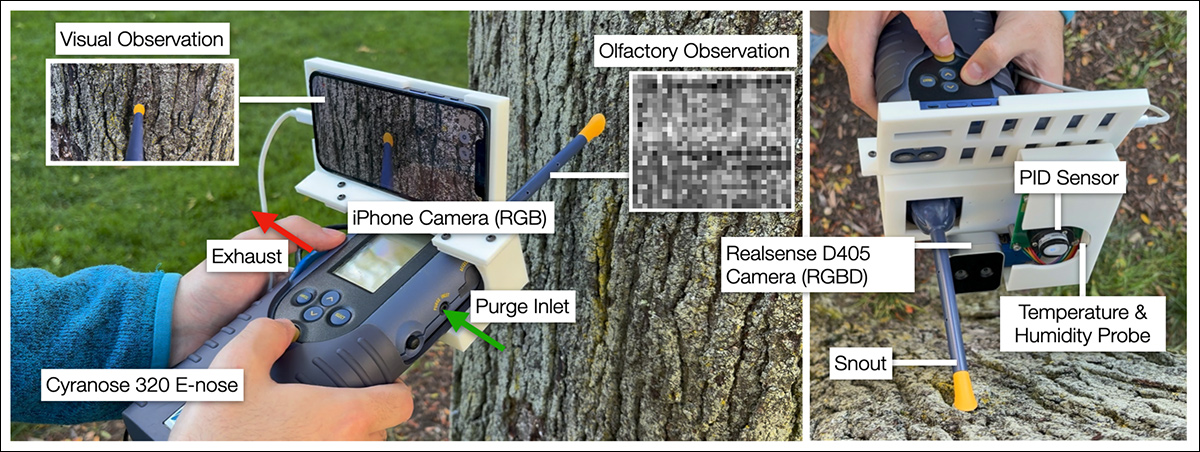

Om materiaal te verzamelen voor de nieuwe collectie, gebruikten de onderzoekers de Cyranose 320 elektronische neus, met een iPhone gemonteerd boven de voorste inlaat om visueel te registreren welke geuren werden geregistreerd:

Een handheld sensor-rig verzamelt gepaarde video- en geurdata door een iPhone-camera te monteren op een Cyranose 320 e-neus. De snuit is gericht op objecten terwijl de uitlaat en purge-inlaat de luchtstroom tijdens het bemonsteren beheren. Een RGB-D-camera legt diepte vast, terwijl de concentratie van vluchtige organische verbindingen (VOC), temperatuur en luchtvochtigheid worden geregistreerd via geïntegreerde sensoren, waaronder een Proportional-integral-derivative (PID)-module en een milieuproef.

Het Cyranose-apparaat loopt op 2Hz, waarbij 32-dimensionale olfactorische tijdstappen worden geregistreerd. De concentraties van vluchtige organische verbindingen (VOC) werden geregistreerd met een MiniPID2 PPM WR-sensor.

De draagbare eenheid functioneerde als een behendige sensor, die gegevens doorgaf aan een meer compute-capabele mobiele station voor verwerking.

Om de doelgeur in context te plaatsen, werd een ‘baseline-geur’ geregistreerd, voordat het specifiekere object rechtstreeks werd gericht met de ‘snuit’ van de Cyranose. Het ambient monster werd vervolgens genomen van een zijpoort in de eenheid, om ervoor te zorgen dat het ver genoeg van de hoofdgeurbron was om niet te worden verontreinigd.

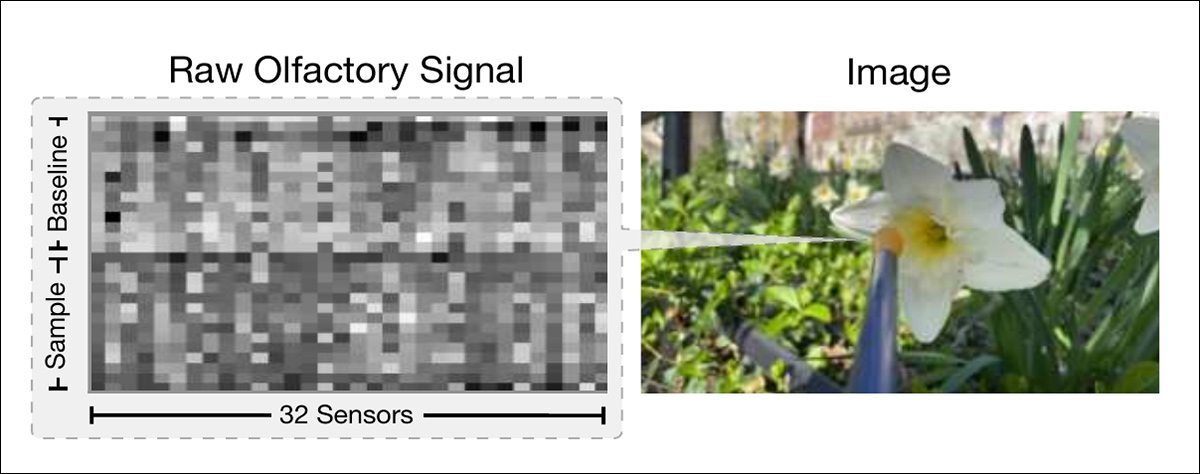

Twee monsters werden genomen via de hoofdinlaat van de sensor, met elk tienseconden-opname vastgelegd vanuit een andere positie rond het object, om de gegevensefficiëntie te verbeteren. De monsters werden vervolgens gecombineerd met de ambient-baseline om een 28×32-matrix te vormen, die de volledige olfactorische meting vertegenwoordigde:

Dit voorbeeld toont het signaal en de overeenkomstige afbeelding voor een bloem. Het volledige olfactorische signaal bestaat uit een 28×32-matrix, die een 14-kaders ambient-baseline combineert met twee 10-seconden-monsters genomen vanuit verschillende hoeken rond het doelobject.

Gegevens en tests

Vision Language Models (VLMs) werden gebruikt om automatisch objecten en materialen te labelen die werden vastgelegd door de iPhone in de Cyranose-rig, met GPT-4o gebruikt voor de taak; echter, scène categorieën werden handmatig gelabeld:

Een klein monster van een uitgebreide illustratie in het bronpaper waarin de uiteenlopende geurbronnen en omgevingen worden gedetailleerd die in het project zijn vastgelegd.

De dataset werd gesplitst in trainings- en validatie splits, met beide monsters van elk object toegewezen aan dezelfde split om kruisbesmetting te voorkomen. De definitieve collectie bestaat uit 7.000 olfactorisch-visuele paren getrokken uit 3.500 ongelabelde objecten, evenals 70 uur video en 196.000 tijdstappen van ruwe olfactorische data uit zowel de baseline- als de steekproef fasen.

Gegevens werden verzameld tijdens 60 sessies over een periode van twee maanden, waarin parken, universiteitsgebouwen, kantoren, straten, bibliotheken, appartementen en eetzaal werden bestreken, met meerdere sessies uitgevoerd op elke locatie. De resulterende dataset bevat 41% buitengebied en 59% binnengebied.

Om algemene olfactorische representaties te ontwikkelen, trainden de auteurs een contrastief model om gesynchroniseerde beeld-geurparen uit de dataset te koppelen. Deze aanpak, de eerder genoemde COIP, gebruikt een verliesfunctie aangepast van CLIP om de insluitingen van co-occurrerende visuele en olfactorische signalen te aligneren.

Training gebruikte zowel een visuele encoder als een geur-encoder, met als doel het model te leren om overeenkomende geuren en afbeeldingen dichter bij elkaar te brengen in een gedeelde representatieruimte. De resulterende representaties ondersteunen een reeks downstream-taken, waaronder geur-afbeeldingsopname, scène- en objectherkenning, materiaalclassificatie en fijne geuronderscheiding.

Het model werd getraind met twee soorten olfactorische invoer: het volledige ruwe sensorteken en een gereduceerd handgemaakt overzicht dat bekend staat als smellprints – breed gebruikte functies in olfactorisch onderzoek die elke sensorrespons comprimeren tot één nummer door de piekweerstand tijdens het bemonsteren te vergelijken met de gemiddelde weerstand tijdens de ambient-baseline.

In tegenstelling tot de ruwe invoer die overal in NYC werd opgenomen, bestaat uit een tijdreeks van 32 chemische sensoren in het Cyranose-apparaat, die registreert hoe elke sensorweerstand verandert over tijd als het reageert op de geur.

Voor de curatie van de dataset werd dit onbewerkte signaal rechtstreeks in een neurale netwerk ingevoerd, waardoor end-to-end leren mogelijk was met een convolutioneel of transformator-gebaseerd backbone. Modellen werden getraind met zowel smellprints als de ruwe invoer verzameld uit diverse omgevingen in New York City, met beide invoertypen geëvalueerd met contrastief leren.

Cross-Modale Opname

Cross-modale opname werd geëvalueerd door elk geurmonster en de bijbehorende afbeelding in een gedeelde representatieruimte in te sluiten en te testen of de correcte afbeelding kon worden opgehaald op basis van alleen de olfactorische invoer.

Ranking werd bepaald door de nabijheid van elke afbeeldingsinsluiting tot de query-geur binnen deze ruimte, en de prestatie werd gemeten met behulp van gemiddelde rang, mediaanrang en herroepingswaarde bij meerdere drempels:

Cross-modale opname-accuratie voor verschillende geur-encoders, waaruit blijkt hoe goed elk model de correcte afbeelding identificeert vanuit een geurquery. De resultaten vergelijken architectuur getraind op ruwe olfactorische signalen met die welke gebruikmaken van smellprints.

Met betrekking tot deze resultaten, verklaren de auteurs:

‘Contrastieve pretraining met smellprint presteert beter dan toeval in alle metrieken. Echter, training van de olfactorische encoder op het ruwe olfactorische signaal leidt tot een aanzienlijke verbetering in vergelijking met de smellprint-encoder, onafhankelijk van de architectuur.

‘Dit toont de rijkere informatie aan die aanwezig is in de ruwe olfactorische gegevens, waardoor sterkere cross-modale associaties tussen zicht en geur mogelijk worden.’

Een detail van de zevende illustratie in het bronpaper, die te gecondenseerd is om hier zinvol te reproduceren. Hier, cross-modale opnamevoorbeelden die laten zien hoe het model geuren koppelt aan overeenkomende afbeeldingen. Elke rij begint met een geurquery, gevolgd door de top-gerangschikte afbeeldingsvoorspellingen in de gedeelde insluitingsruimte. De correcte afbeelding voor elke query is omlijnd in groen, waaruit blijkt hoe geuren van boeken, planten, metselwerk en andere materialen het model trekken naar visueel en semantisch verwante scènes.

De auteurs merken ook op dat de opname-resultaten duidelijke semantische patronen laten zien:

‘Opnames van ons model laten vaak semantische groeperingen zien. De geur van een boek haalt afbeeldingen van andere boeken op, de geur van bladeren haalt afbeeldingen van bladeren op.

‘Deze resultaten suggereren dat de geleerde representatie een betekenisvolle cross-modale structuur vastlegt.’

Scène-, Object- en Materiaalherkenning

De mogelijkheid van het model om geuren te herkennen zonder visuele invoer werd geëvalueerd door het te trainen om scènes, objecten en materialen te identificeren op basis van alleen olfactorische gegevens; hiertoe werd een lineaire sonde (een eenvoudige classificator getraind op bevroren representaties) gebruikt om te beoordelen hoeveel informatie werd gecodeerd in de geleerde geur-insluitingen.

Labels werden afgeleid van de bijbehorende afbeeldingen in de trainingsset met behulp van GPT-4o – maar alleen het olfactorische signaal werd gebruikt tijdens de classificatie.

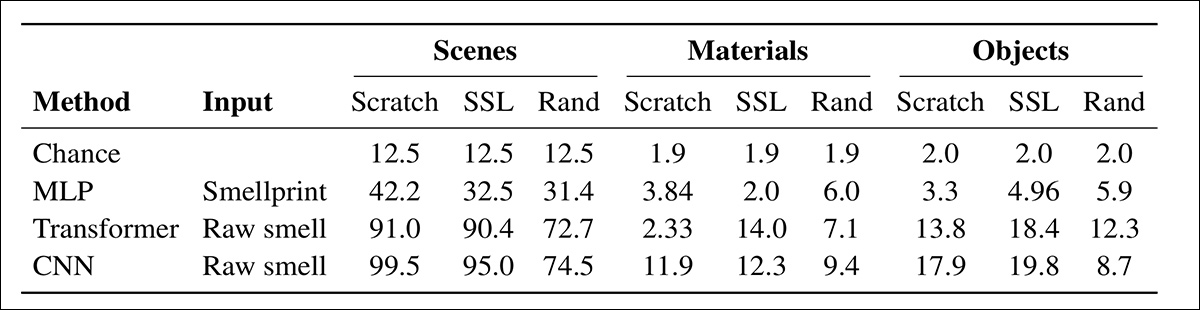

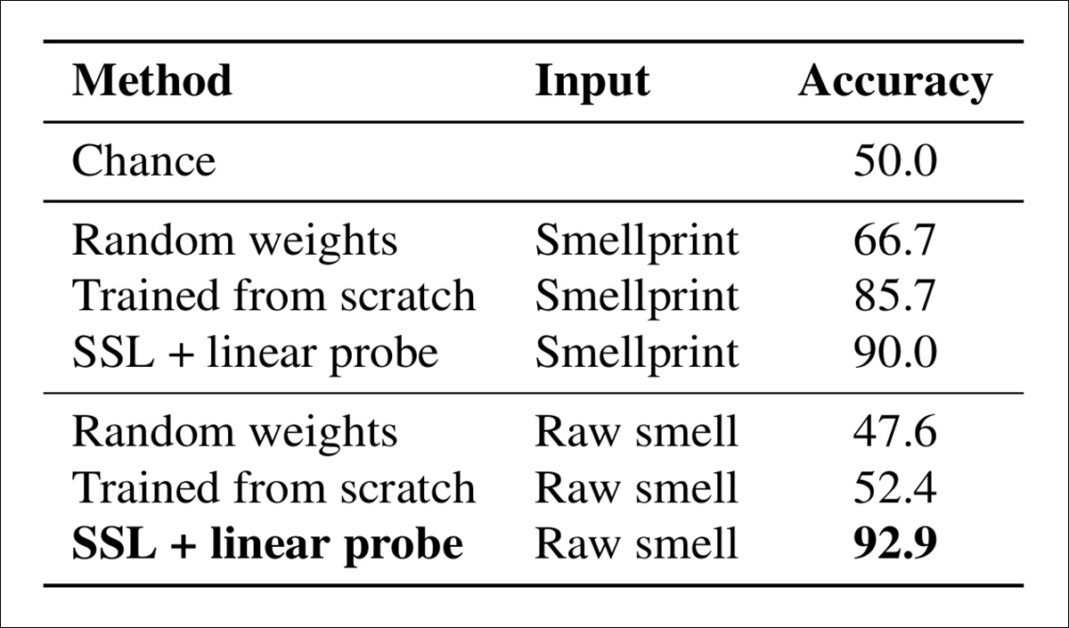

Verschillende encoder-typen werden getest: sommige willekeurig geïnitialiseerd, sommige getraind van scratch, en anderen getraind met contrastief leren om geur en visie in een gedeelde representatieruimte te aligneren, met ruwe gegevens en smellprints geëvalueerd:

Classificatie-accuratie voor scènes, materialen en objecten werd beoordeeld met behulp van olfactorische signalen alleen. Ruwe sensor-invoer overtrof smellprints, met CNN’s getraind van scratch die de hoogste resultaten opleverden, waaronder 99,5% voor scènes. SSL-pretaining hielp in sommige gevallen, maar werd over het algemeen overtroffen door gesuperviseerde training. Random-weight-baselines geven aan dat modelcapaciteit alleen ontoereikend is.

Aanzienlijk hogere nauwkeurigheid werd behaald wanneer ruwe olfactorische gegevens werden gebruikt, vooral in modellen getraind met cross-modale supervisie. De auteurs merken op**:

‘Modellen getraind op ruwe sensor-invoer behalen ook hogere nauwkeurigheid dan modellen getraind met de handgemaakte smellprint-functies. Deze resultaten laten zien dat diepe leren van ruwe olfactorische signalen aanzienlijk beter is dan handgemaakte functies.’

Fijne Geuronderscheiding

Om te beoordelen of fijne geuronderscheidingen konden worden geleerd, werd een benchmark opgebouwd uit twee grassoorten die samen bestaan op dezelfde campuswei. Alternatieve monsters werden verzameld tijdens zes 30-minuten sessies, waardoor 256 voorbeelden ontstonden. Een lineaire classificator werd getraind op functies van olfactorisch-visuele contrastieve leren, en geëvalueerd op een afgezonderde set van 42 monsters:

Accuratie van grassoort-classificatie vanuit geur alleen. Modellen werden geëvalueerd op hun vermogen om twee visueel vergelijkbare grassoorten te onderscheiden met behulp van alleen olfactorische invoer. Prestatie werd vergeleken over smellprints en ruwe sensorgegevens, met modellen die of willekeurig werden geïnitialiseerd, van scratch werden getraind of getraind met zelfsupervisie (SSL) gevolgd door een lineaire sonde. De hoogste accuratie, 92,9%, werd behaald met ruwe olfactorische signalen en SSL, wat aangeeft dat fijne geurverschillen het beste worden vastgelegd via ruwe invoer en visie-gestuurde training.

Hier verklaren de onderzoekers:

‘Training op het ruwe olfactorische sensorsignaal (in plaats van handgemaakte functies) levert de hoogste accuratie – overschrijdt alle varianten op basis van smellprints.

‘Deze resultaten suggereren dat olfactorisch-visueel leren meer fijne informatie vastlegt dan leren met smellprints, en dat visuele supervisie een signaal biedt voor het exploiteren van deze informatie.’

Conclusie

Hoewel geursynthese waarschijnlijk een onopgelost probleem zal blijven voor een tijd, heeft een effectief en betaalbaar in-het-wild geur analyse-systeem een enorm potentieel, niet alleen voor politie-, beveiligings- en medische doeleinden, maar ook voor kwaliteit van leven en stedelijke monitoring.

Op dit moment is de apparatuur betrokken niche en meestal vrij duur; daarom lijkt echte vooruitgang in ‘olfactorische AI’ voor detectie waarschijnlijk te vereisen een visionair en betaalbaar sensor in de Raspberry PI-geest.

* Mijn conversie van de inline-citaten van de auteurs naar hyperlinks.

** Let op dat verdere illustraties (figuur 8) beschikbaar zijn in het bronpaper, maar het beste in die context worden bekeken.

Eerst gepubliceerd op vrijdag 28 november 2025