Kunstmatige intelligentie

Een Inleiding Tot Vertex AI

Gezien de snel evoluerende landschap van Artificial Intelligence, is een van de grootste hindernissen die techleiders vaak tegenkomen het overgang maken van “experimenteel” naar “enterprise-ready”. Terwijl consumentenchatbots en een interactief platform helpen met de publieke verbeelding, kunnen bedrijven niet slagen met alleen een chatinterface. In een tijdperk waarin de concurrentie agressiever is dan ooit tevoren, hebben bedrijven een robuust, schaalbaar en beveiligd ecosysteem nodig, en dit is wat Google probeert te bieden met de Vertex AI, Google Cloud’s unified Artificial Intelligence & Machine Learning platform.

Vertex AI probeert zichzelf te verankeren als de ruggengraat voor Generative AI-integratie met moderne cloud-infrastructuur, door een uitgebreide reeks functies aan te bieden die de kloof overbruggen tussen ruwe foundation models en productieklare toepassingen. Vertex AI is niet alleen een wrapper voor grote taalmodellen (LLM’s), maar een unified Machine Learning- en Artificial Intelligence (ML/AI)-ecosysteem dat Generative AI behandelt als een eerste klas burger van de moderne cloud-infrastructuur.

In het hart van Vertex AI zit de Model Garden, een centrale marktplaats die toegang biedt tot meer dan 200 gecureerde foundation models, waaronder de multimodale krachtpatser Gemini 2.5 Pro, die een verbluffende 2-miljoen-token context window heeft. In dit artikel zullen we de architectuur van Vertex AI ontleed, onderzoeken hoe Model Garden dient als de “App Store” voor intelligentie en kijken naar de technische pijlers die deze platform de ruggengraat maken van de volgende generatie enterprise software.

De Core Architectuur : Een Unified Platform

Vertex AI is geen losse verzameling van tools, maar een unified data- en AI-ecosysteem ontworpen om de fragmentatie van data, tools en teams te overbruggen die de machine learning tot op de dag van vandaag teistert. Traditioneel vinden AI-ontwikkelingen plaats in geïsoleerde omgevingen, en soms wordt de data verspreid en opgeslagen in meerdere repositories. Bijvoorbeeld kunnen organisaties klantgegevens opslaan in SQL-warehouses, terwijl ongestructureerde documenten worden gedumpt in een Data Lake. Wanneer data wordt opgesplitst, ziet de AI alleen een “gedeeltelijke waarheid”, wat leidt tot vooringenomen resultaten of hoge hallucinatiesnelheden omdat het de volledige context van het bedrijf ontbreekt.

Vertex AI probeert de hele levenscyclus te integreren, vanaf de raw data-inname in BigQuery en Cloud Storage tot productiebewaking, en dient in wezen als een “verbindingweefsel” tussen deze silo’s. Vertex AI integreert native met Cloud Storage en BigQuery, waardoor de AI-modellen de data kunnen ophalen zonder complexe Extraction, Transformation en Load-pijplijnen.

De Foundation : Google’s AI Hypercomputer

De GenAI-laag van Vertex AI zit bovenop Google’s AI Hypercomputer-architectuur, een geïntegreerd supercomputersysteem, dat bestaat uit:

TPU v5p & v5e (Tensor Processing Units)

Google’s Tensor Processing Units zijn custom-built ASIC’s (Application-Specific Integrated Circuits) specifiek ontworpen voor de matrixvermenigvuldiging die diepe leerdefinieert.

- TPU v5p (Prestatie): Dit is de vlaggenschipversneller voor massale schaaltraining. Elke TPU v5p-pod kan schalen tot 8.960 chips die zijn verbonden door Google’s hoogste bandbreedte Inter-Chip Interconnect (ICI) op 4.800 Gbps. Voor een techleider betekent dit 2,8x snellere training voor een GPT-3 formaatmodel (175B parameters) in vergelijking met de vorige generatie, waardoor de time-to-market aanzienlijk wordt verminderd.

- TPU v5e (Efficiëntie): Ontworpen voor “kosten-geoptimaliseerde” prestaties, is de v5e de werkpaard voor medium-schaaltraining en hoge-doorvoer inferentie. Het biedt tot 2,5x betere prijs-prestatie, waardoor het de ideale keuze is voor bedrijven die 24/7 inferentie moeten uitvoeren zonder een enorm budget.

NVIDIA H100/A100 GPUs voor Flexibiliteit

Terwijl TPUs gespecialiseerd zijn, vertrouwen veel ontwikkelteams op de NVIDIA CUDA-ecosysteem. Vertex AI biedt first-class ondersteuning voor NVIDIA’s laatste hardware:

- NVIDIA H100 (Hopper): Ideaal voor het fijntunen van de grootste open-source modellen (zoals Llama 3.1 405B) die een enorme geheugencapaciteit vereisen.

- Jupiter Networking: Om de “Netwerkbeperking” te voorkomen, gebruikt Google zijn Jupiter datacenter netwerkweefsel. Dit zorgt ervoor dat data tussen GPUs op een verbluffende snelheid verplaatst, ondersteunt RDMA (Remote Direct Memory Access) om CPU-overhead te omzeilen en lokale prestaties te leveren over gedistribueerde knooppunten.

Dynamic Orchestration

De meest kritieke technische verschuiving in Vertex AI is Dynamic Orchestration. In een legacy-omgeving kan een GPU-knooppunt tijdens een 3-weken durende trainingsrun falen, waardoor de hele taak kan crashen.

- Automated Resiliency: Vertex AI, vaak aangedreven door Google Kubernetes Engine (GKE) onder de motorkap, heeft “self-healing” knooppunten. Als een hardwarefout wordt gedetecteerd, migreert de platform de workload automatisch naar een gezond knooppunt.

- Dynamic Workload Scheduler: Dit hulpmiddel laat teams toe om capaciteit aan te vragen op basis van urgentie. U kunt kiezen voor Flex Start (goedkoper, start wanneer capaciteit beschikbaar is) of Garantiecapaciteit voor missie-kritische releases.

- Serverless Training: Voor teams die geen infrastructuurbeheer willen, biedt Vertex AI Serverless Training de mogelijkheid om uw code en data in te dienen; de platform biedt de cluster, voert de taak uit en breekt deze af – u wordt alleen in rekening gebracht voor de compute-seconden die worden gebruikt.

De Drie Toegangspunten: Ontdekking, Experimentatie en Automatisering

Om verschillende technische persona’s te accommoderen – van datawetenschappers tot applicatie-ontwikkelaars – biedt Vertex AI drie primaire toegangspunten:

- Model Garden: De Marketplace voor Ontdekking.

- Vertex AI Studio: De Speelplaats voor Experimentatie.

- Vertex AI Agent Builder: De Fabriek voor Automatisering.

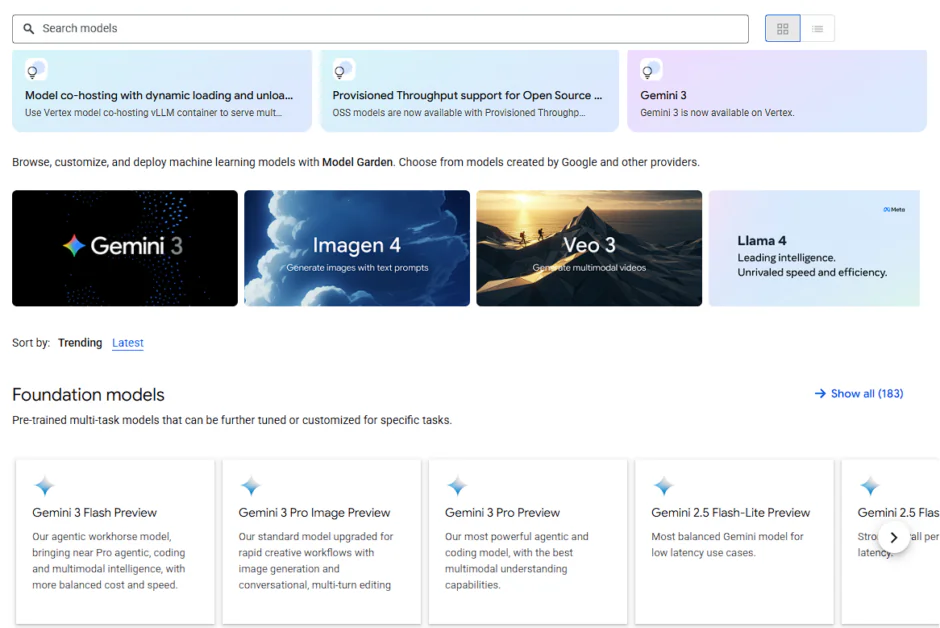

Model Garden: De Marketplace voor Ontdekking

Google Cloud’s Vertex AI Model Garden is een centrale platform binnen Google Cloud voor het ontdekken, testen, aanpassen en implementeren van een breed scala aan eerste, open-source en derde partij AI-modellen, waaronder multimodale modellen (visie, tekst, code) voor verschillende bedrijfsbehoeften, en biedt naadloze integratie met Vertex AI’s tools voor gestroomlijnde MLOps. Het fungeert als een uitgebreide bibliotheek, waardoor ontwikkelaars en bedrijven de juiste model (van grote foundation modellen tot gespecialiseerde modellen) voor hun taken kunnen kiezen, of het nu gaat om tekstgeneratie, beeldanalyse of codevoltooiing, en deze efficiënt kunnen implementeren binnen hun Google Cloud-omgeving.

Model Garden categoriseert zijn 200+ modellen in drie distincte lagen, waardoor architecten prestaties, kosten en controle kunnen balanceren:

- Eerste Partij (Google) Modellen: Dit zijn de vlaggenschip multimodale modellen beschikbaar binnen Vertex AI, en Google biedt ze aan in verschillende maten, variërend van Pro met complexe redenering tot Flash met lage latentie en hoge volume, waardoor ontwikkelaars hun modellen kunnen optimaliseren op basis van hun gebruikscases.

- Derde Partij (Propriëtaire) Modellen: Door strategische partnerschappen biedt Vertex AI “Model-as-a-Service” (MaaS) toegang tot titans als Anthropic (Claude 3.5) en Mistral AI. In plaats van afzonderlijke facturering en beveiligingsreferenties voor vijf verschillende AI-aanbieders te beheren, kan een technisch team toegang krijgen tot allemaal via hun bestaande Google Cloud-project, met een uniform API-formaat.

- Open-Source & Open-Weight Modellen: Deze laag omvat Meta’s Llama 3.2, Mistral, en Google’s eigen Gemma. Deze zijn ideaal voor organisaties die modellen zelf willen implementeren binnen hun eigen VPC (Virtual Private Cloud) om maximale gegevensisolatie te garanderen.

In een niet-unified omgeving vereist het implementeren van een open-source model zoals Llama het instellen van een PyTorch-omgeving, configureren van CUDA-stuurprogramma’s en beheren van een Flask- of FastAPI-wrapper.

Model Garden elimineert deze “Munging”-fase door Unified Managed Endpoints:

- Een-Klik Implementatie: Voor veel modellen kan het klikken op “Implementeren” automatisch de benodigde TPU/GPU-bronnen inrichten, het model in een productieklare container wikkelen en een REST API-eindpunt bieden.

- Hugging Face Integratie: Vertex AI laat nu ontwikkelaars toe om modellen rechtstreeks vanuit de Hugging Face Hub naar een Vertex-eindpunt te implementeren, waardoor een bijna oneindige uitbreiding van beschikbare intelligentie mogelijk wordt.

- Private Service Connect (PSC): Voor hoog gereguleerde industrieën kunnen modellen worden geïmplementeerd met behulp van Private Service Connect, waardoor wordt gegarandeerd dat het model-eindpunt nooit wordt blootgesteld aan het openbare internet – de dataverkeer blijft strikt binnen het bedrijfsnetwerk.

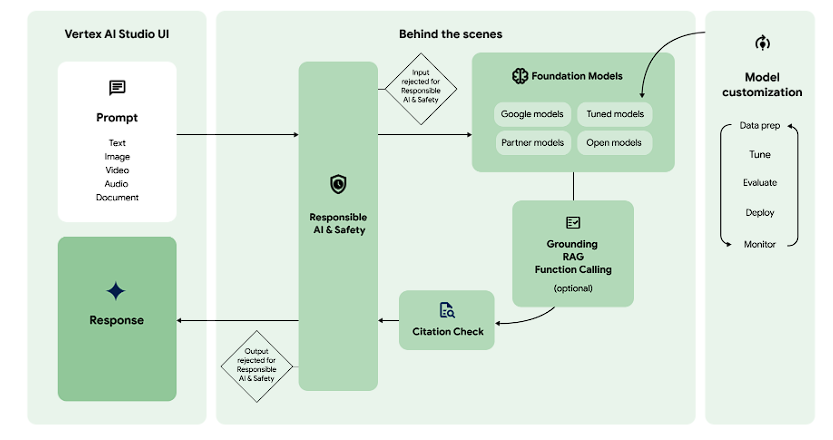

Vertex AI Studio: De Speelplaats voor Experimentatie

Terwijl de Model Garden gaat over selectie, is Vertex AI Studio over precisie. Vertex AI Studio kan worden vergeleken met de compilers en debuggers die u tegenkomt in de traditionele softwarewereld. De Vertex AI Studio is de werkruimte waarin ruwe modellen worden geslepen tot specifieke bedrijfsinstrumenten door een combinatie van prompt-engineering, multimodale testing en geavanceerde hyperparameter-tuning.

Multimodale Prototyping: Beyond Text

Een van de opvallende functies van de Studio is de native ondersteuning voor multimodaliteit. Terwijl andere platforms complexe coding vereisen om niet-tekstgegevens te verwerken, laat Vertex AI Studio u bestanden rechtstreeks in de interface droppen om de Gemini 2.5 redeneercapaciteiten te testen.

- Video Intelligentie: U kunt een 45-minuten durende technische keynote uploaden en de model vragen om “elke keer dat een specifieke API wordt vermeld en een getijdstempel samenvatting te geven”.

- Document Analyse: In plaats van alleen tekst te lezen, kan het model de visuele lay-out van een 1.000 pagina’s tellende PDF analyseren, de relatie tussen grafieken, tabellen en de omringende proza begrijpen.

- Code Uitvoering: Studio ondersteunt nu code-uitvoering in de speelplaats. Als u een model vraagt om een complex wiskundig probleem op te lossen of een CSV te analyseren, kan het model Python-code schrijven en uitvoeren in een beveiligde sandbox-omgeving om een geverifieerd antwoord te geven.

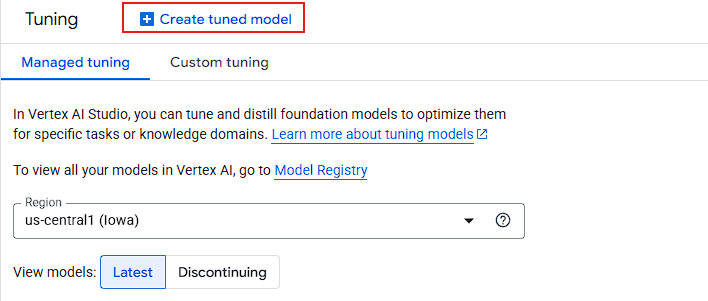

Geavanceerde Aanpassing: De Tuning Pathway

Wanneer prompt-engineering (Zero-shot of Few-shot) een plafond bereikt, biedt Vertex AI Studio de zware machine: Model Tuning.

- Begeleide Fijne Tuning (SFT): Ontwikkelaars bieden een dataset van “Prompt/Antwoord” paren (ideaal 100+ voorbeelden). Dit leert het model om een specifieke bedrijfsstem, uitvoerformaat (zoals gespecialiseerde JSON) of domeinspecifieke jargon aan te nemen.

- Context Caching: Voor bedrijven die te maken hebben met enorme, statische datasets (zoals een juridische bibliotheek of een codebasis), laat de Studio Context Caching toe. Dit laat u toe om een miljoen tokens aan data vooraf in het geheugen van het model te laden, waardoor de latentie en kosten voor latere queries aanzienlijk worden verminderd.

- Destillatie (Leraar-Leerling): Dit is een hoog niveau architectonische zet. U kunt een enorm model (Gemini 2.5 Pro) gebruiken om een kleiner, sneller model (Gemini 2.0 Flash) te “leren”. Het resultaat is een lichtgewicht model dat presteert op een “Pro”-niveau, maar loopt met “Flash”-snelheid en -kosten.

Vertex AI Agent Builder: De Fabriek voor Automatisering

Vertex AI Agent Builder is een hoog niveau orkestratieframework dat ontwikkelaars in staat stelt om deze agenten te maken door foundation modellen te combineren met bedrijfsdata en externe API’s.

De Architectuur van “Waарheid”: Grounding & RAG

De primaire technische barrière voor enterprise AI is hallucinatie. Agent Builder lost dit op door een geavanceerde Grounding engine.

- Grounding met Google Search: Voor queries die real-time wereldkennis vereisen (bijv. “Wat zijn de huidige hypotheektarieven in New York?”), kan de agent een Google Search uitvoeren, feiten extraheren en bronnen citeren.

- Vertex AI Search (RAG-as-a-Service): In plaats van handmatig een vector database (Pinecone, Weaviate) te bouwen, kunnen ontwikkelaars Vertex AI Search gebruiken om hun eigen documenten (PDF’s, HTML, BigQuery) te indexeren. Het behandelt de “chunking”, “embedding” en “retrieval” stappen automatisch, waardoor wordt gegarandeerd dat de agent alleen antwoordt op basis van uw interne “Bron van Waarheid”.

- Vertex AI RAG Engine: Voor high-scale, aangepaste implementaties, biedt deze beheerde service een hybride zoekopdracht (combinatie van vectorgebaseerde en trefwoordgebaseerde resultaten) om de nauwkeurigheid te verbeteren met tot 30% boven standaard LLM-uitvoer.

Mult-Agent Orkestratie (A2A Protocol)

Geavanceerde enterprise workflows vereisen vaak meerdere gespecialiseerde agenten die samenwerken. Vertex AI introduceert het Agent-to-Agent (A2A) Protocol, een open standaard die het volgende mogelijk maakt:

- De “Reisagent” kan praten met de “Financiële Agent” om ervoor te zorgen dat een vluchtboeking binnen het bedrijfsbudget valt.

- Interoperabiliteit: Omdat het een open protocol gebruikt, kunnen agenten die zijn gebouwd op Vertex communiceren met die gebouwd op andere frameworks zoals LangChain of CrewAI.

De Ontwikkelaars Stack: ADK en Agent Engine

Voor het “tech platform” publiek biedt de Agent Builder twee distincte paden:

- Geen Code Console: Een visuele drag-and-drop interface voor snelle prototyping en bedrijfsgebruikerconfiguratie.

- Agent Development Kit (ADK): Een code-first Python-toolkit voor ingenieurs. Het laat “Prompt-as-Code” toe, versiebeheerintegratie en de mogelijkheid om te implementeren op de Vertex AI Agent Engine—een beheerde runtime die sessiepersistentie, schaling en statische beheer automatisch afhandelt.

Conclusie: Van “Wat Als” naar “Wat Volgt”

De overgang van een flashy AI-demonstratie naar een productieklare enterprise-toepassing is lange tijd de “vallei van de dood” geweest voor digitale transformatieprojecten. Zoals we hebben onderzocht, is Vertex AI specifiek ontworpen om deze kloof te overbruggen. Door de gefragmenteerde silo’s van data, infrastructuur en modelorkestratie te verenigen, heeft Google Cloud het gesprek verplaatst van de ruwe kracht van Large Language Models naar de operationele volwassenheid van de AI-levenscyclus.