Kunstmatige intelligentie

Een AI-gestuurde vooroordeelcontrole voor nieuwsartikelen, beschikbaar in Python

Onderzoekers in Canada, India, China en Australië hebben samengewerkt om een vrij beschikbaar Python-pakket te produceren dat effectief kan worden gebruikt om ‘oneerlijke taal’ in nieuwsberichten te herkennen en te vervangen.

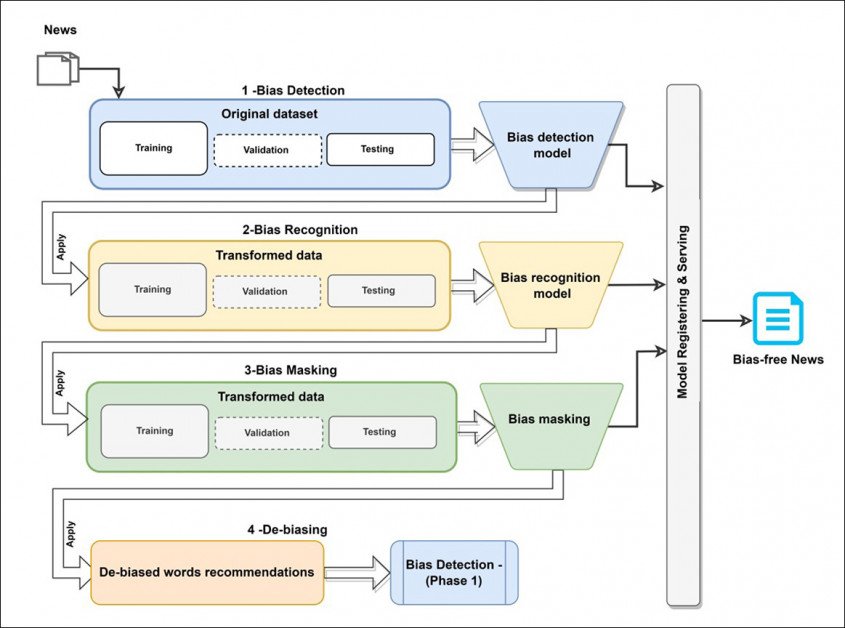

Het systeem, getiteld Dbias, gebruikt verschillende machine learning-technologieën en databases om een driedelige circulaire workflow te ontwikkelen die bevooroordeelde tekst kan verfijnen tot een niet-bevooroordeelde of minstens meer neutrale versie.

Geladen taal in een nieuwsfragment wordt geïdentificeerd als ‘bevooroordeeld’ en wordt getransformeerd in een minder ontvlambaar exemplaar door Dbias. Bron: https://arxiv.org/ftp/arxiv/papers/2207/2207.03938.pdf

Het systeem vertegenwoordigt een herbruikbare en zelfstandige pijplijn die via Pip van Hugging Face kan worden geïnstalleerd en geïntegreerd in bestaande projecten als een aanvullende fase, add-on of plug-in.

In april kwam soortgelijke functionaliteit die in Google Docs was geïmplementeerd onder kritiek te staan, niet in de laatste plaats vanwege het gebrek aan bewerkbaarheid. Dbias daarentegen kan selectiever getraind worden op elke corpus van nieuws dat de eindgebruiker wil, met behoud van de mogelijkheid om maatwerkrechtvaardigheidsrichtlijnen te ontwikkelen.

Het cruciale verschil is dat de Dbias-pijplijn bedoeld is om ‘geladen taal’ (woorden die een kritische laag toevoegen aan feitelijke communicatie) automatisch om te zetten in neutrale of prozaïsche taal, in plaats van de gebruiker te onderwijzen op een voortdurende basis. In wezen zal de eindgebruiker ethische filters definiëren en het systeem dienovereenkomstig trainen; in de Google Docs-benadering wordt het systeem – naar men kan aannemen – de gebruiker getraind, op eenzijdige wijze.

Conceptuele architectuur voor de Dbias-workflow.

Volgens de onderzoekers is Dbias het eerste echt configureerbare vooroordeeldetectiepakket, in tegenstelling tot de kant-en-klare assemblageprojecten die dit subsector van Natural Language Processing (NLP) tot nu toe hebben gekenmerkt.

Het nieuwe artikel heeft als titel Een benadering om rechtvaardigheid in nieuwsartikelen te garanderen en komt van bijdragers aan de University of Toronto, Toronto Metropolitan University, Environmental Resources Management in Bangalore, DeepBlue Academy of Sciences in China en The University of Sydney.

Methode

Het eerste module in Dbias is Vooroordeeldetectie, dat gebruik maakt van het DistilBERT-pakket – een hoog geoptimaliseerde versie van Google’s vrij machine-intensieve BERT. Voor het project werd DistilBERT fijngesteld op de Media Bias Annotation (MBIC)-dataset.

MBIC bestaat uit nieuwsartikelen van een verscheidenheid aan mediabronnen, waaronder de Huffington Post, USA Today en MSNBC. De onderzoekers gebruikten de uitgebreide versie van de dataset.

Hoewel de oorspronkelijke gegevens waren geannoteerd door crowdsourced werknemers (een methode die eind 2021 onder vuur kwam), konden de onderzoekers van het nieuwe artikel extra ongelabelde voorbeelden van vooroordeel in de dataset identificeren en deze handmatig toevoegen. De geïdentificeerde voorbeelden van vooroordeel hadden betrekking op ras, onderwijs, etniciteit, taal, religie en geslacht.

Het volgende module, Vooroordeelherkenning, gebruikt Named Entity Recognition (NER) om bevooroordeelde woorden van de invoertekst te individualiseren. Het artikel vermeldt:

‘Bijvoorbeeld, het nieuws “Koop de pseudo-wetenschappelijke hype over tornado’s en klimaatverandering niet” is door het voorgaande vooroordeeldetectiemodule als bevooroordeeld geclassificeerd, en kan het vooroordeelherkenningmodule het woord “pseudo-wetenschappelijke hype” identificeren als een bevooroordeeld woord.’

NER is niet specifiek ontworpen voor deze taak, maar is eerder gebruikt voor vooroordeelidentificatie, met name voor een 2021-project van de Durham University in het VK.

Voor deze fase gebruikten de onderzoekers RoBERTa in combinatie met de SpaCy English Transformer NER-pijplijn.

De volgende fase, Vooroordeelmaskering, omvat een novum van meerdere maskers van de geïdentificeerde vooroordeelwoorden, die sequentieel werkt in gevallen van meerdere geïdentificeerde vooroordeelwoorden.

Geladen taal wordt vervangen door pragmatische taal in de derde fase van Dbias. Let op dat ‘mouthing’ en ‘using’ hetzelfde actie betekenen, hoewel de eerste als minachtend wordt beschouwd.

Als dat nodig is, wordt de feedback van deze fase teruggestuurd naar het begin van de pijplijn voor verdere evaluatie totdat een aantal geschikte alternatieve zinsconstructies of woorden zijn gegenereerd. Deze fase gebruikt Masked Language Modeling (MLM) langs lijnen die zijn vastgesteld door een 2021-samenwerking geleid door Facebook Research.

Normaal gesproken zal de MLM-taak 15% van de woorden willekeurig maskeren, maar de Dbias-workflow vertelt het proces om de geïdentificeerde bevooroordeelde woorden als invoer te nemen.

De architectuur werd geïmplementeerd en getraind op Google Colab Pro op een NVIDIA P100 met 24GB VRAM bij een batchgrootte van 16, met slechts twee labels (bevooroordeeld en onbevooroordeeld).