Andersons hoek

AI kan een foto’s jaar raden op basis van mensenleeftijd

Nieuw onderzoek toont aan dat AI mensenleeftijd kan gebruiken om het jaar van een foto te schatten, door leeftijdschattingen te combineren met bekende geboortedata om huidige scene-gebaseerde methoden te verslaan.

Het raden van de datum van een foto was vroeger een stuk eenvoudiger dan het nu is, omdat haarmodes en kledingstijlen vroeger met een razend tempo evolueerden at breakneck speed. Om veel bediscussieerde redenen is deze verandering van visuele stijl ongeveer dertig jaar geleden gestopt, waardoor het niet langer zo eenvoudig is om naar een haarstijl of kledingstukken te kijken en het jaar te raden op basis van dit soort visuele aanwijzing.

Voor een tijdje was het ook mogelijk om afbeeldingen en films te dateren op basis van de kleurresolutie en korrelkenmerken van filmstock. Men hoefde geen forensisch specialist te zijn; als je genoeg oude films keek, zouden de culturele aanwijzingen (zoals muziek, auto’s, mode, onderwerpen, enz.) uiteindelijk geassocieerd worden met filmstockstijlen:

![Een illustratie van de manier waarop verbeteringen in filmstock de range van huidtinten en lichtstijlen geleidelijk hebben uitgebreid over tijd, van platte, frontale opstellingen naar meer naturalistische en gevarieerde looks. [ Bron ] https://archive.is/3ZSjN (mijn eigen artikel)](https://www.unite.ai/wp-content/uploads/2025/11/grain-styles.jpg)

Een illustratie van de manier waarop verbeteringen in filmstock de range van huidtinten en lichtstijlen geleidelijk hebben uitgebreid over tijd, van platte, frontale opstellingen naar meer naturalistische en gevarieerde looks. Bron (mijn eigen artikel)

Een extra ‘anker’ voor het dateren van een foto was of het in zwart-wit was – een economie die overbodig werd na de popularisering van digitale fotografie vroeg in deze eeuw

Een aantal commerciële en experimentele systemen, zoals de MyHeritage-abonnement-gebundelde PhotoDater proberen foto’s te dateren met behulp van deze en diverse andere criteria.

![Een voorbeeld van foto-leeftijdschatting van de MyHeritage PhotoDater-abonnement-only-service. Bron [ https://www.youtube.com/watch?v=2oVyLI6tBcY ]](https://www.unite.ai/wp-content/uploads/2025/11/photodater.jpg)

Een voorbeeld van foto-leeftijdschatting, van de MyHeritage PhotoDater-abonnement-only-service. Bron

Afwezigheid van andere aanwijzingen, zoals smartphones of andere era-specifieke technologie, is de beste manier om de leeftijd van een foto te schatten die in de afgelopen 15-25 jaar is genomen, als je bekend bent met de persoon (d.w.z. een beroemdheid, of misschien een kennis), en kan hun leeftijd schatten, wat een ruwe equivalent van het jaar oplevert.

Gezichtsleeftijd als referentie

In het veld van computerzicht, en in diverse andere velden (d.w.z. forensisch, archiefverwerking, journalistiek, datasetarchitectuur, enz.) is de mogelijkheid om de leeftijd van een foto te bepalen een gewild doel, aangezien veel van de meest interessante digitale en analoge collecties geen juiste annotatie en metadata hebben, of zelfs onjuiste metadata hebben van eerdere (verkeerde) schattingen.

Daarom zou het nuttig zijn als een AI-systeem foto’s op dezelfde manier kon bekijken als wij wanneer we terugkijken op onze historische collecties, en commentaar geven ‘Oh ja, dat was toen…’. De vraag is, wat zou de haak kunnen zijn, afwezig van de gebruikelijke vereiste aanwijzingen?

Een nieuw onderzoeksartikel uit Tsjechië biedt een eerste aangrijpingspunt voor deze benadering, door AI-gebaseerde leeftijdsrecognitiesystemen te exploiteren, in combinatie met gezichtsherkenningssystemen die zijn gekoppeld aan een gemeenschappelijke database van identiteiten (in dit geval een IMDB-achtige collectie met Tsjechische uitvoerders en filmmakers):

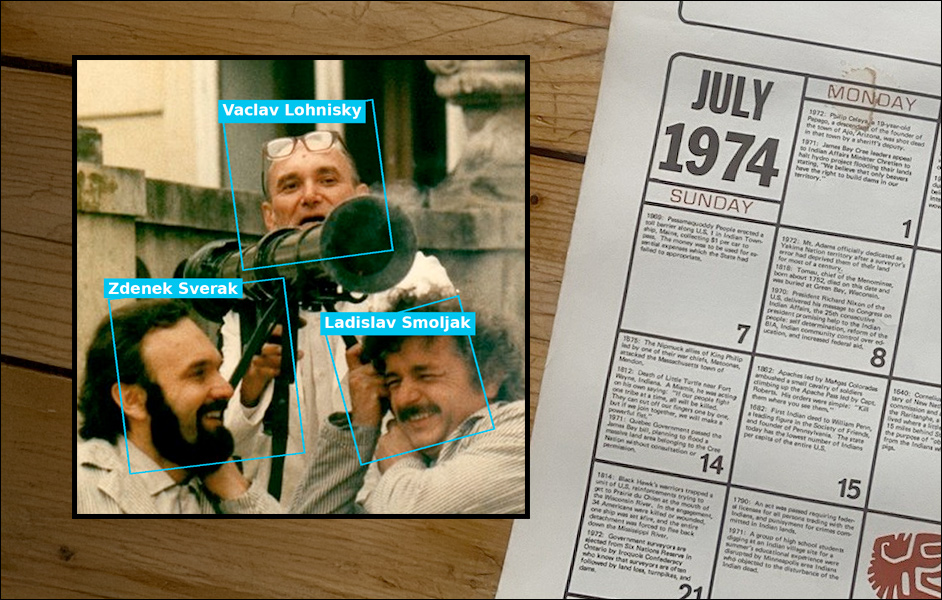

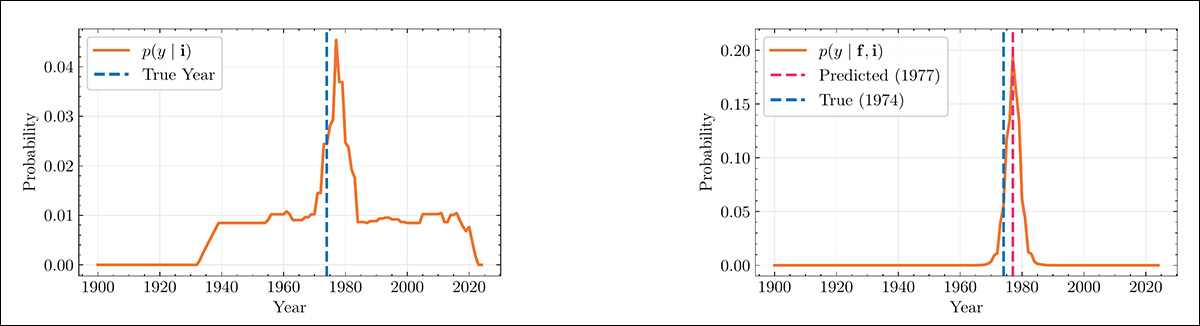

![Een still uit Joachim, Put It in the Machine (1974), gebruikt om het dateringsproces te illustreren. Het model detecteert bekende personen in de foto, schat hun leeftijd met behulp van een gezichtsleeftijdschatting (rechterkolom), en trekt die waarde af van elke persoon zijn geboortejaar om een waarschijnlijkheidsverdeling over mogelijke fotodatums te genereren. De grafieken tonen de waarschijnlijkheid van elke leeftijdschatting, met gestreepte lijnen die de persoon zijn werkelijke leeftijd op het moment van de foto aangeven. [ Bron ] https://arxiv.org/pdf/2511.05464](https://www.unite.ai/wp-content/uploads/2025/11/fig-1a-and-1b.jpg)

Een still uit ‘Joachim, Put It in the Machine’ (1974), gebruikt om het dateringsproces te illustreren. Het model detecteert bekende personen in de foto, schat hun leeftijd met behulp van een gezichtsleeftijdschatting (rechterkolom), en trekt die waarde af van elke persoon zijn geboortejaar om een waarschijnlijkheidsverdeling over mogelijke fotodatums te genereren. De grafieken tonen de waarschijnlijkheid van elke leeftijdschatting, met gestreepte lijnen die de persoon zijn werkelijke leeftijd op het moment van de foto aangeven. Bron

Het systeem werkt door bekende personen in een foto te detecteren, hun gezichtsleeftijd te schatten met behulp van een vooraf getraind model, en deze schatting af te trekken van hun gedocumenteerde geboortejaar om waarschijnlijke datums voor de foto te genereren. Wanneer meerdere gezichten aanwezig zijn, worden de datumschattingen geaggregeerd om een definitieve voorspelling te produceren.

De methode werd getest op afbeeldingen die zijn geselecteerd uit de Czecho-Slowaakse Film Database (CSFD), met als resultaat dat de benadering, zoals de auteurs beweren, consistent betere nauwkeurigheid biedt dan scene-gebaseerde modellen (statische modellen die afhankelijk zijn van achtergrondelementen of visuele context in plaats van gezichten) die zijn getraind op dezelfde gegevens.

Het schema voor deze methode vereist een centrale database die kennis bevat van een brede groep personen; maar elke soortgelijke collectie die bevestigde geboortedata en centrale datum-bevestigde gebeurtenissen bevat, kan een soortgelijk resultaat opleveren.

Het artikel vermeldt:

‘Uniek, onze dataset biedt annotaties voor meerdere personen binnen een enkele afbeelding, waardoor de studie van multi-gezichtsinformatie-aggregatie mogelijk wordt. We stellen een probabilistisch kader voor dat visuele bewijzen van moderne gezichtsherkenning en leeftijdschatting combineren, en carrière-gebaseerde temporele prioriteiten om de fotodatum af te leiden.

‘Onze experimenten tonen aan dat het aggregaat van bewijzen van meerdere gezichten de prestaties consistent verbetert en de benadering significant beter presteert dan sterke, scene-gebaseerde baselines, vooral voor afbeeldingen met meerdere identificeerbare personen.’

Het nieuwe artikel heeft de titel Foto dateren door gezichtsleeftijdsaggregatie, en komt van twee onderzoekers aan de Tsjechische Technische Universiteit in Praag, met de belofte van een latere code/gegevensrelease.

Methode

Om te schatten wanneer een foto is genomen, kijkt het nieuwe systeem van de auteurs naar elk gedetecteerd gezicht en probeert te raden wie het zou kunnen zijn, met behulp van de eerder genoemde database van bekende personen. Aangezien een persoon slechts eenmaal in een foto kan verschijnen, controleert het systeem alle combinaties van mogelijke identiteiten en gebruikt hun bekende geboortejaren om te schatten hoe oud elke persoon eruitziet.

Daarna werkt het terug om de meest waarschijnlijke jaar te schatten die zou maken dat die leeftijden overeenkomen:

Links: het systeem bouwt een tijdslijn die aangeeft wanneer de herkende personen het meest actief waren, op basis van hun bekende carrières. Rechts: dit wordt gecombineerd met gezichtsleeftijdschattingen om een definitieve schatting te produceren van wanneer de afbeelding is genomen.

Om het grote aantal mogelijke identiteitscombinaties te beheren, gaat het systeem ervan uit dat gezichten onafhankelijk zijn, en dat elk gezicht uitsluitend afhankelijk is van zijn identiteit en de datum van de foto.

Om te schatten wanneer een foto is genomen, schat het systeem eerst de leeftijd van elk gedetecteerd gezicht met behulp van het NIST cvut-002 model, dat is gebaseerd op een ViT-B/16-architectuur, en getraind op een privé-dataset (die, zoals de auteurs vermelden, hoog scoort in NIST’s Face Analysis Technology Evaluation (FATE) database).

Zodra het geboortejaar van de persoon bekend is, converteert het model de leeftijdschatting naar een waarschijnlijke fotodatum door eenvoudig de leeftijd toe te voegen aan het geboortejaar, waardoor een waarschijnlijkheidsverdeling over mogelijke opnamejaren ontstaat. Om te beoordelen hoe goed een gedetecteerd gezicht overeenkomt met een bekende identiteit, vergelijkt het systeem hun embeddings in ArcFace-ruimte:

![ArcFace, de centrale bijdragende architectuur voor het nu populaire InsightFace-model, werd in 2015 gelanceerd, met als lotsbestemming om een invloedrijk project te worden in gezichtsbeoordeling en -evaluatie. [Bron ] https://arxiv.org/pdf/1801.07698](https://www.unite.ai/wp-content/uploads/2025/11/arcface.jpg)

ArcFace, de centrale bijdragende architectuur voor het nu populaire InsightFace-model, werd in 2015 gelanceerd, met als lotsbestemming om een invloedrijk project te worden in gezichtsbeoordeling en -evaluatie. Bron

Elke identiteit wordt vertegenwoordigd door een gemiddelde embedding die is gebouwd uit zijn referentieportretten. De overeenkomst tussen een testgezicht en een identiteit wordt vervolgens gemeten met behulp van een Von Mises Fisher Distribution, die aangeeft hoe strak de identiteitsportretten clusteren rond die gemiddelde. Een gedeelde scherpte-parameter controleert hoe vertrouwd het systeem is in die clusters, en wordt geschat met behulp van een leave-one-out-strategie op de identiteitsportretten.

Het model definieert vijf soorten prior om te schatten wanneer een herkende persoon in een foto kan verschijnen: uniform; decade; film; afbeelding; en een convex combinatie prior die de sterkste en zwakste opties combineert, om gevoeligheid voor prior-sterkte te testen (d.w.z. de veerkracht van de prior tegen stress).

Om gezichten te behandelen die niet met vertrouwen kunnen worden geïdentificeerd, bevat het model een fallback ‘onbekende’ identiteit met oninformatieve verdelingen, met een gezichtswaarschijnlijkheid die plat is in de embedding-ruimte, en een temporele prior die plat is over alle jaren. Dit stelt onzekere gezichten in staat om te worden genegeerd zonder de definitieve datumschatting te beïnvloeden:

Hoe de prestatie wordt beïnvloed wanneer sommige gezichten in een afbeelding niet kunnen worden geïdentificeerd. Elke vierkant toont de gemiddelde dateringsfout voor verschillende aantallen bekende en onbekende identiteiten, met vierkantgrootte die de frequentie van die combinatie in de dataset weerspiegelt. Fout neemt toe met meer onbekenden, maar daalt gestaag naarmate meer bekende identiteiten worden toegevoegd.

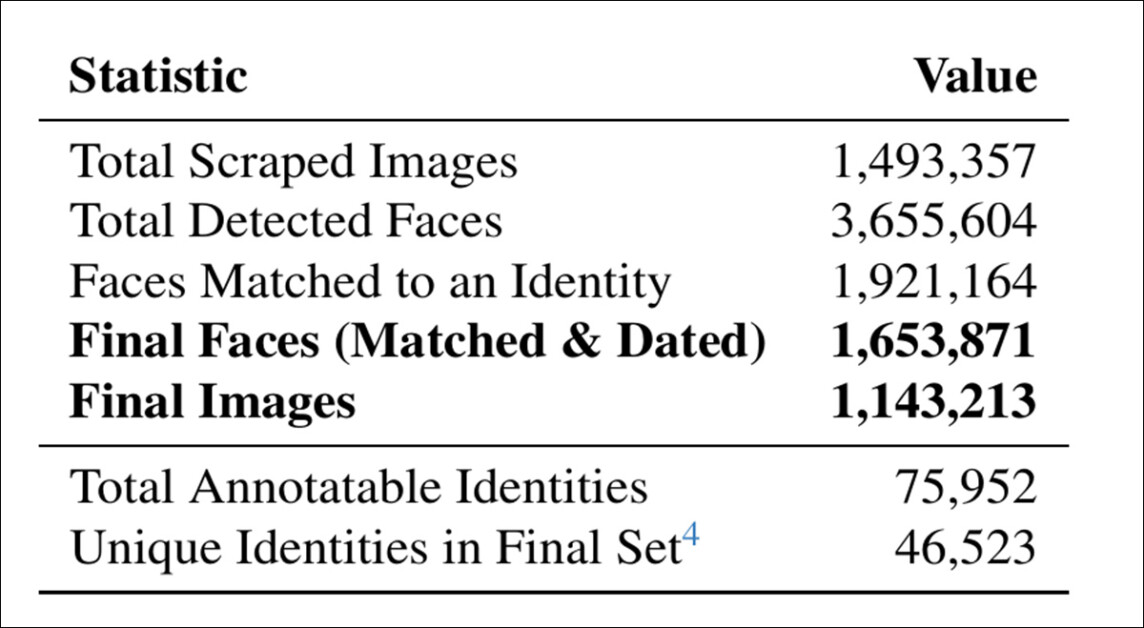

Gegevens en tests

De auteurs gebruikten de eerder genoemde CSFD-dataset om gegevens te leveren voor een nieuwe collectie die ze CSFD-1.6M noemden. De dataset werd opgebouwd uit scènes met meerdere personen, met elk gezicht gelabeld met identiteit en jaar. Deze structuur was noodzakelijk om het model te leren hoe gezichten met elkaar in verband staan in de context; single-gezichtsdatasets zoals IMDB-WIKI ondersteunen dit niet, omdat ze slechts één persoon per afbeelding labelen.

Filmreleasejaren uit de Czecho-Slowaakse Film Database werden gebruikt om te schatten wanneer elke foto was genomen, met elke persoon in de afbeelding gematcht met een openbaar profiel met hun geboortejaar en een portret.

Vervolgens werd elk gezicht in de afbeelding gematcht met een van de bekende identiteiten, eerst met behulp van ArcFace om gezichtsembeddings te maken, en een gemiddelde embedding te berekenen voor elke identiteit.

Daarna werd de Hungarian-algoritme gebruikt om gezichten toe te wijzen aan identiteiten door embedding-overeenkomst te vergelijken, met aanpassingen gemaakt wanneer het aantal gedetecteerde gezichten via het SCRFD-10GE-framework niet overeenkwam met het aantal bekende personen.

Statistieken van de CSFD-1.6M-dataset, met details over gescrapede afbeeldingen, gedetecteerde gezichten, identiteitsmatches, definitieve geannoteerde monsters en het beschikbare identiteitspool.

Overeenkomsten werden afgewezen als de overeenkomst te laag was of als de geschatte leeftijd te veel afweek van de bekende leeftijd, met grotere tolerantie toegestaan voor oudere personen, en gezichten werden niet gefilterd op kwaliteit of grootte.

De auteurs merken de superioriteit van hun gecuratede set op die van de dichtstbijzijnde vergelijkbare dataset, IMDB-WIKI:

‘Onze dataset is niet alleen aanzienlijk groter, maar, kritisch, bestaat uit meerpersoonscènes die vereist zijn door ons model. Terwijl geen web-geëxtraheerde dataset vrij is van labelruis, levert onze annotatiepijplijn de expliciete links tussen afbeeldingen en identiteitsprofielen die door de database worden geleverd, met als doel hogerwaardige identiteitsassignments.’

Hun evaluatie vergeleek verschillende versies van het dateringssysteem, om te begrijpen waar de winst vandaan kwam. Een model ging ervan uit dat er een perfecte kennis was van wie er in de afbeelding zat, waardoor een bovengrens voor de prestatie werd geboden door alle onzekerheid in identiteitsherkenning te verwijderen, met het volledige model dat identiteiten en datums gezamenlijk schatte, waarbij verschillende mogelijke identiteitsconfiguraties werden afgewogen voordat een definitieve jaarschatting werd gedaan.

Een eenvoudigere variant selecteerde de meest waarschijnlijke identiteitsconfiguratie zonder marginalisatie over alternatieven, wat bijna even effectief bleek in de praktijk.

In tegenstelling tot de meest basale baseline werden alle gezichten onafhankelijk toegewezen en werden de resulterende leeftijdsgebaseerde jaarschattingen gecombineerd, zonder te overwegen of de identiteiten collectief zin hadden.

Om te testen hoeveel de methode profiteerde van het gebruik van gezichten, werd een afzonderlijk model getraind om de datum rechtstreeks te schatten uit de hele scène. Dit scene-gebaseerde model vormt de sterkste alternatieve benadering die momenteel in beeldhouwerij wordt gebruikt, omdat het era-specifieke visuele patronen over de hele afbeelding kan leren, in plaats van te vertrouwen op identiteit of leeftijd.

Metrische gegevens en gegevens

Mean Absolute Error (MAE) tussen de voorspelde jaar en de bekende grondwaarheid was de centrale meting voor de experimenten.

De gegevens werden gedeeld in vijf delen, met zorg genomen om ervoor te zorgen dat alle afbeeldingen uit dezelfde film binnen één partitie bleven. Drie van deze delen werden gebruikt voor training, één voor validatie en één voor testen. Deze vijfvoudige rotatie werd toegepast om overfitting te voorkomen.

Aangezien de gezichtsgebaseerde modellen niet op deze dataset waren getraind, was geen splitsing vereist, en werden ze in plaats daarvan rechtstreeks geëvalueerd op de volledige CSFD-1.6M-set.

Het Scene-model werd getraind voor 200 epochs onder de Adam-optimizer, met afbeeldingen die waren omgezet naar een 384×384 crop.

Resultaten

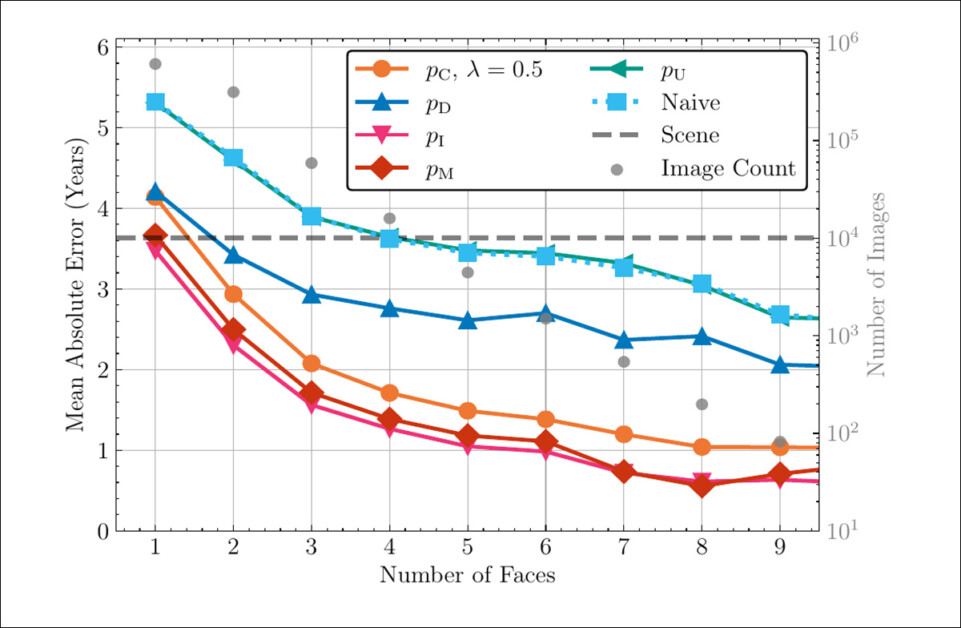

Het resultaatengedeelte van het artikel is ongebruikelijk verdeeld over een aantal prestatie-indicatoren, zonder één uitstekende of centrale test. Echter, we zullen een selectie van de meest pertinente resultaten hier presenteren.

Het belangrijkste resultaat is niet één getal, maar een patroon: gezichtsaggregatiemodellen (vooral de Volledige en Top-1-varianten) presteren consistent beter dan de sterke Scene-baseline wanneer twee of meer bekende identiteiten aanwezig zijn – zelfs als het Scene-model rechtstreeks op de dataset is getraind, waardoor de centrale claim wordt ondersteund dat identiteit-gekoppelde gezichtsdatuming een robuustere signaal biedt dan holistische scèneinterpretatie.

Om de invloed van temporele prior te evalueren, vergeleken de auteurs verschillende configuraties van hun Volledige model. De sterkste prestatie werd behaald met behulp van de Decade Prior, die aanzienlijk beter presteerde dan zowel het Naïeve model (dat geen temporele prior gebruikt) als de Uniform Prior (die geen voorkeur heeft voor jaren):

Prestatie daalt scherp voor alle methoden naarmate het aantal gezichten toeneemt, maar modellen die realistische temporele prioriteiten gebruiken, zoals de Decade Prior, worden veel minder beïnvloed. De Naive en Scene-baselines blijven plat of verslechteren met grotere groepen, terwijl het Volledige model met informatieve prioriteiten een lage fout behoudt. De orakel-gebaseerde prioriteiten, die zijn gebaseerd op testset-statistieken, definiëren de ondergrens voor de te bereiken prestatie.

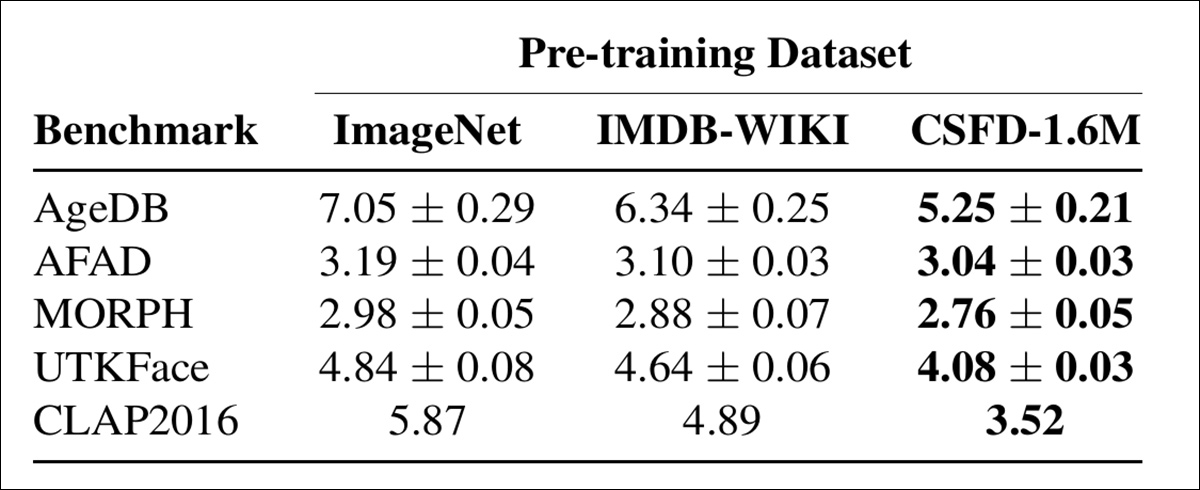

Om de waarde van CSFD-1.6M te demonstreren buiten fotodatering, werd de dataset ook getest als een vooraftrainingsbron voor de bredere taak van gezichtsleeftijdschatting. Na een standaard evaluatieprotocol werden ResNet101-modellen vooraf getraind op CSFD-1.6M en vergeleken met tegenhangers die waren vooraf getraind op IMDB-WIKI en ImageNet. Deze modellen werden vervolgens fijngesteld en geëvalueerd op vijf populaire benchmarks: AgeDB; AFAD, MORPH; UTKFace; en CLAP2016:

Mean Absolute Error (plus minus standaarddeviatie) op vijf leeftijdschattingbenchmarks, waarbij modellen worden vergeleken die zijn voorafgetraind op ImageNet, IMDB-WIKI en CSFD-1.6M. Lagere waarden geven betere prestatie aan. CSFD-1.6M levert de sterkste resultaten op alle benchmarks.

Op alle vijf datasets leidde vooraftrainen op CSFD-1.6M tot de laagste foutpercentages, waarbij de andere twee vooraftrainingsbronnen met een duidelijke marge werden overtroffen – een prestatieverschil dat het sterkst was op AFAD en CLAP2016, maar consistent bleef over de hele linie.

We verwijzen de lezer naar de rest van het enigszins gefragmenteerde resultaatengedeelte in het bronartikel, dat ook uitgebreid ingaat op ablatiestudies.

Conclusie

Hoewel het nieuwe artikel snel dicht en ontoegankelijk wordt voor de gemiddelde lezer, is het onderwerp dat wordt aangepakt een van de meest interessante en relevante in computerzichtliteratuur – niet in de laatste plaats omdat het overloopt in antropologie en cultuurstudies, waar de constanten moeilijk te bepalen zijn.

* Net zoals de evolutie van muziek ook haar tempo van verandering vertraagde.

Voor het eerst gepubliceerd op maandag 10 november 2025